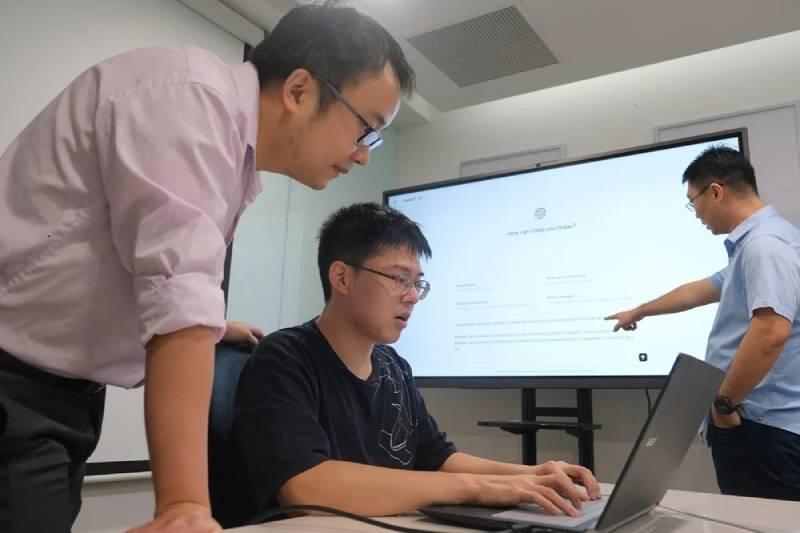

Учёные-компьютерщики из Наньянского технологического университета (NTU, Сингапур) нашли эффективный способ взлома чат-ботов с искусственным интеллектом (ИИ). Для этого они обучают ИИ-чат-бот созданию подсказок, которые позволяют обходить защиту других чат-ботов на базе ИИ.

Источник изображения: NTU

Сингапурские исследователи использовали двойной метод взлома большой языковой модели (LLM), получивший название Masterkey. Во-первых, они провели реверс-инжиниринг того, как LLM выявляют вредоносные запросы и защищаются от них. Используя эту информацию, они научили LLM автоматически учиться и предлагать подсказки, которые позволяют обходить защиту других LLM. Таким образом можно создать LLM для взлома, которая сможет автоматически адаптироваться к новым условиям и создавать новые запросы для взлома после того, как разработчики внесут исправления в свои LLM.

После проведения серии тестов на LLM в качестве доказательства, что этот метод действительно представляет реальную угрозу, исследователи сразу же известили о выявленных проблемах провайдеров сервисов после успешного взлома их ИИ-моделей.

Разработка учёных NTU должна помочь компаниям определить слабые стороны и ограничения своих ИИ-чат-ботов, чтобы принять меры по их защите от хакеров.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018

Flow придумала, как ускорить центральные процессоры в 100 раз без переписывания всего софта

38

Flow придумала, как ускорить центральные процессоры в 100 раз без переписывания всего софта

38

«BioWare официально мертва»: первый полноценный трейлер Dragon Age: The Veilguard сильно разочаровал игроков

26

«BioWare официально мертва»: первый полноценный трейлер Dragon Age: The Veilguard сильно разочаровал игроков

26

В США создана атомная батарейка с впечатляющей эффективностью — разработчик заявляет о новой главе в автономном питании

22

В США создана атомная батарейка с впечатляющей эффективностью — разработчик заявляет о новой главе в автономном питании

22

Разрекламированная трассировка лучей наконец появилась в Atomic Heart и требует 12 Гбайт видеопамяти

21

Разрекламированная трассировка лучей наконец появилась в Atomic Heart и требует 12 Гбайт видеопамяти

21

Подписаться

Подписаться