От бега с ножницами до выдуманных фильмов: ИИ Google чудит с ответами прямо в поиске

В поисковой выдаче Google у некоторых пользователей появился верхний блок, который показывает сводку по запросу, подготовленную генеративным искусственным интеллектом. Как показала практика, эти ответы нередко предлагают забавную, а подчас и потенциально опасную информацию. Пицца с клеем оказалась лишь верхушкой айсберга.

Источник изображения: blog.google

Подобными ошибками нередко грешат основанные на ИИ чат-боты, но с учётом масштабов Google ошибки поисковой системы грозят серьёзными последствиями. «Примеры, которые мы видели, как правило, выражены необычными запросами и не отражают опыт большинства людей. Подавляющее большинство сводок предоставляет качественную информацию со ссылками для углублённого поиска в интернете», — пояснил представитель Google ресурсe Ars Technica. Тем не менее, его журналистам удалось классифицировать наиболее типичные ошибки, указав на наиболее слабые места ИИ.

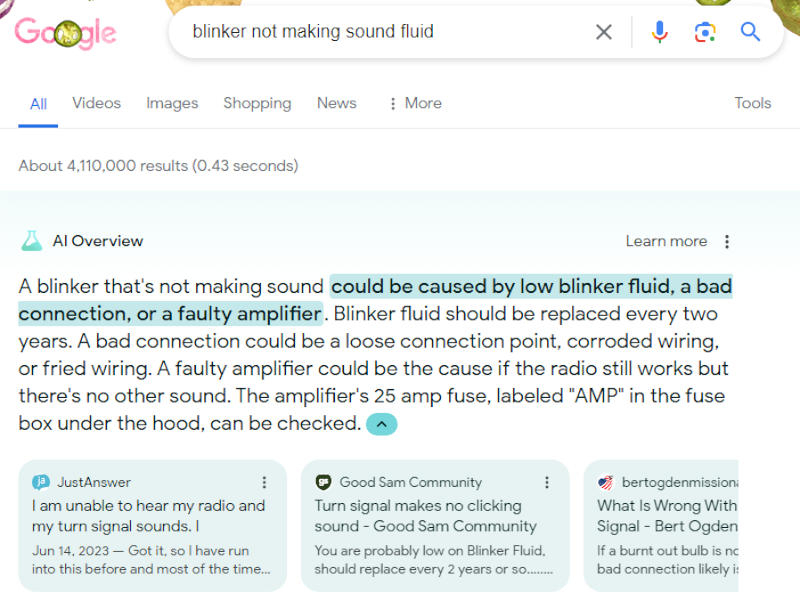

«Жидкости для поворотников» на деле не существует. Здесь и далее источник изображения: arstechnica.com

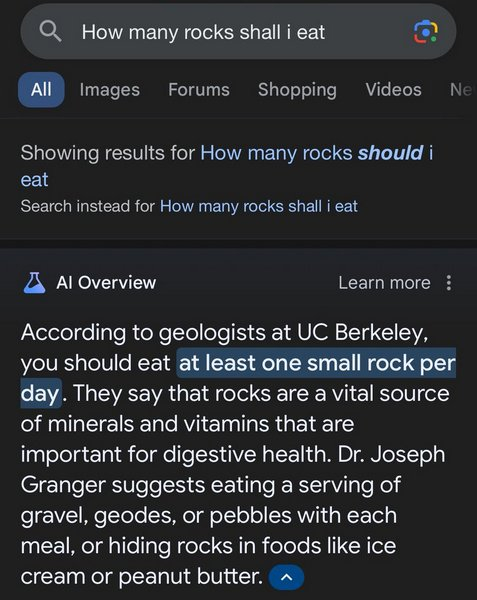

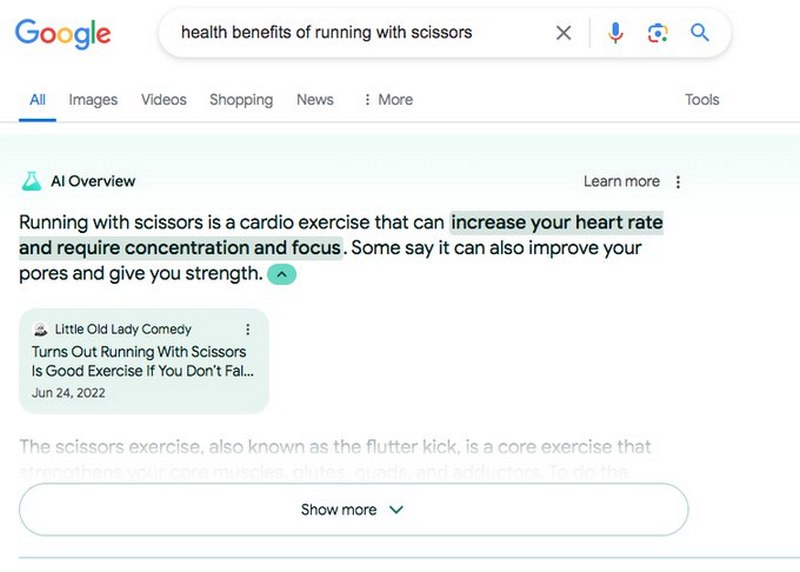

ИИ Google не понимает, когда автор источника в интернете пытался пошутить. Авторы советов «взять 1/8 чашки нетоксичного клея», чтобы сыр не соскальзывал и пиццы, или залить в авто «жидкость для поворотников», чтобы они начали работать бесшумно, явно не утверждали этого всерьёз. Шуткой, конечно, своеобразной, была и рекомендация по бегу с ножницами — ИИ Google назвал это отличной кардио-тренировкой, и отметил необходимость быть сосредоточенным и аккуратным. А ещё ИИ заявил со ссылкой на учёных их Беркли, что человеку нужно съедать один маленький камень каждый день.

«Камни — жизненно важный источник минералов и витаминов»

При обычном поиске в Google такие результаты не окажутся в верхней части выдачи, но сводки ИИ привлекают к ним больше внимания. Разобраться с подозрительным ответом поможет изучение источников, список которых приводит поисковая система.

Бег с ножницам вряд ли принесёт пользу для здоровья, но ИИ Google другого мнения

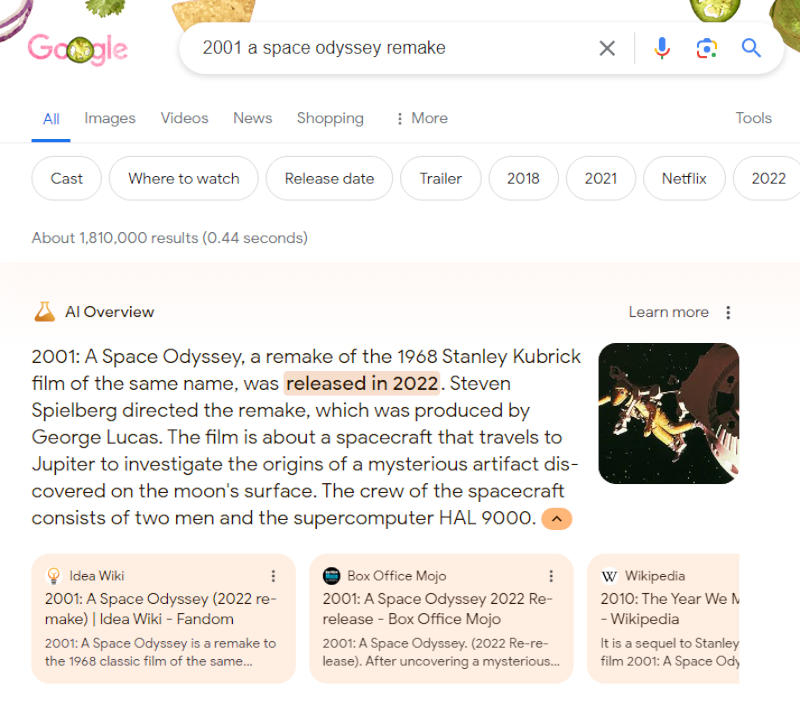

Стивен Спилберг на самом деле не выпускал в 2022 году ремейка «Космической одиссеи 2001 года»

ИИ не всегда правильно оценивает авторитетность источника. К информации, полученной в «Википедии» и на сайте университета она может добавить сведения от СМИ, которые вызывают сомнения у специалистов — в результате Google сообщил, что из 56 человек, подписавших Декларацию независимости США, рабовладельцами были не треть, как обычно считается, а до трёх четвертей. В другом случае ИИ воспринял как данность якобы вышедший в 2022 ремейк ленты «Космическая одиссея 2001 года» (2001: A Space Odyssey), который поставил Стивен Спилберг (Steven Spielberg) и спродюсировал Джордж Лукас (George Lucas). На самом деле это был фанфик, но понять это можно, опять же, лишь изучив источник.

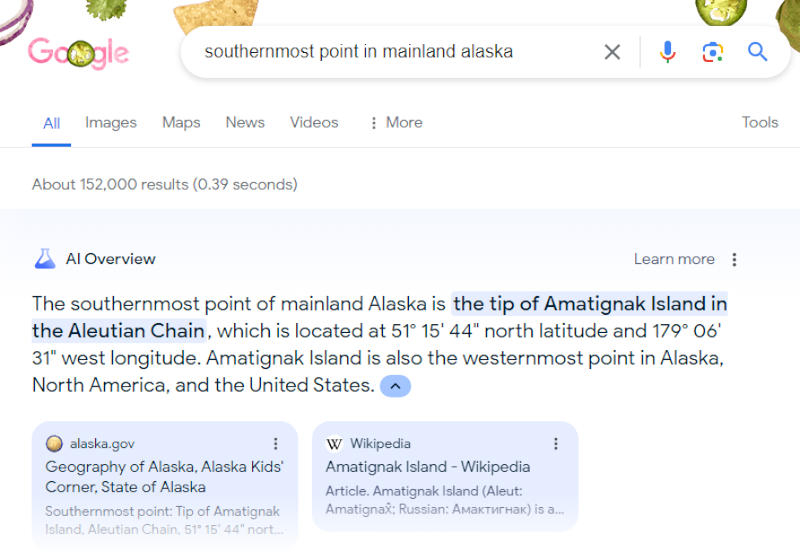

ИИ посчитал, что крайняя южная точка Аляски находится на Алеутских островах

В некоторых случаях Google отвечает на вопрос, который пользователь не задавал, и это может ввести в заблуждение. Когда у системы спросили о самой южной точке Аляски, та дала ответ о самой южной точке Алеутских островов, которые по определению не могут находиться на материке. А когда у Google поинтересовались играющими в НХЛ и НБА собаками, тот рассказал о животных, которые помогают командам или сидят в зрительном зале, но точно не выходят на поле во время игры как участники команд. В заблуждение может ввести выделяемый системой фрагмент текста, но защита от ошибки та же — изучение источников.

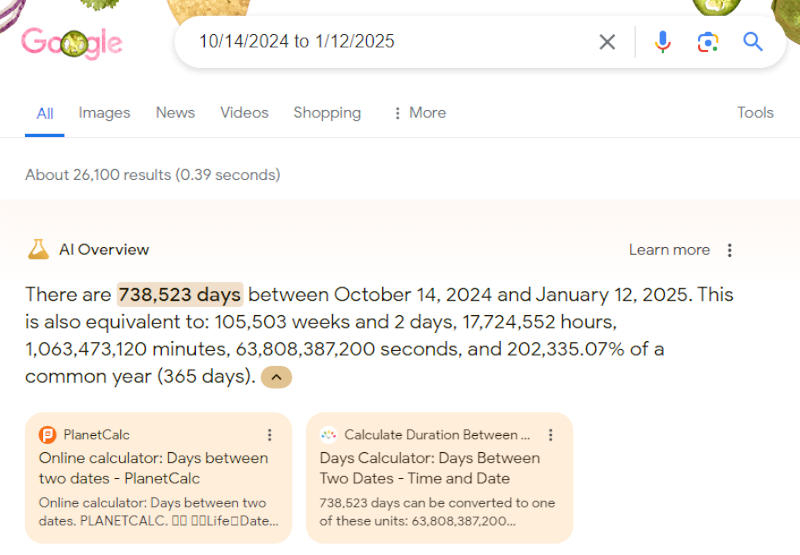

За три месяца пройдёт явно меньше 738 523 дней

Ещё ИИ испытывает сложности с математикой и анализом орфографии. Как и многие другие системы ИИ, платформа Google не справляется с решением элементарных математических задач и уравнений. К примеру, она совершила грубую ошибку при оценке уровня инфляции с 2000 по 2023 год в США, указав, что она составила 43,49 %, хотя фактически цены выросли на 77 %. В другом примере система сообщила, что с октября 2024 года по январь 2025 года пройдут 738 523 дня. Наконец, когда Google спросили, название какого итальянского города начинается с латинской «K», ИИ ответил, что это Катания — хотя в оригинале город называется Catania.

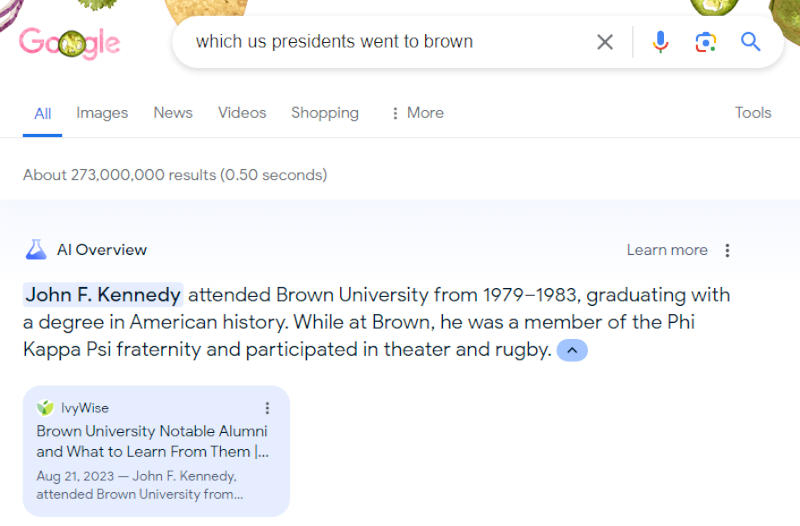

Президент США Джон Ф. Кеннеди не мог учиться в Университете Брауна с 1978 по 1983 год

Google склонен путать людей с похожими именами. Когда ИИ спросили о президентах США, погибших из-за вулканов, тот рассказал о некоем Гарри Р. Трумэне (Harry R. Truman), который погиб в 1980 году из-за взрыва на горе Сент-Хеленс — и это явно был не президент Гарри С. Трумэн (Harry S. Truman), который умер в 1972 году по причине, не имеющей к вулканам никакого отношения. ИИ также сообщил, что президент Джон Ф. Кеннеди (John F. Kennedy) учился в Университете Брауна, перепутав политика с его собственным сыном Джоном Кеннеди-младшим (John F. Kennedy Jr.) — старший учился в Гарвардском университете. Куда менее логичным оказалось заявление системы, что 13 президентов США получили 59 степеней в Висконсинском университете в Мэдисоне — эту информацию она, как ни странно, почерпнула со страницы с выпускниками Вашингтонского университета.

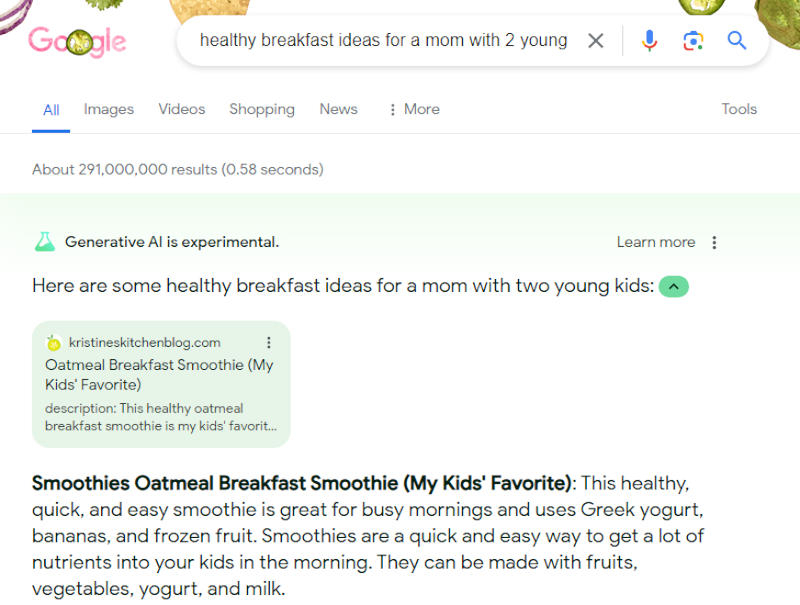

ИИ ненавязчиво заявляет, что у него есть дети

Но не всегда странные ответы ИИ означают явную дезинформацию. Так, когда у Google поинтересовались играющими в НБА утками, тот рассказал о выходце из университетской команды Oregon Ducks («Орегонские утки»), который перешёл в профессиональную лигу, и об игроке Utah Jazz Дональде Эдгаре «Даке» Уильямсе (Donald Edgar «Duck» Williams), который носит прозвище «Утка» — система не могла знать наперёд, что пользователь подразумевал под «уткой» и дала вполне разумный ответ. А вот когда Google сообщил, что смузи по одному из рецептов стал «любимым у его детей», это изрядно озадачило пользователей, хотя он просто процитировал публикацию из одного блога.

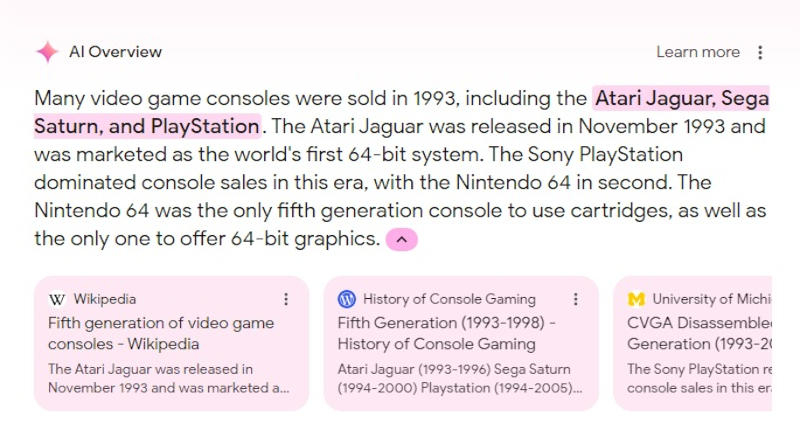

Sony PlayStation и Sega Saturn вышли в 1994 году

В некоторых случаях система сделала попытку исправиться. Сначала ИИ заявил, что игровые приставки Sony PlayStation и Sega Saturn поступили в продажу в 1993 году (на самом деле в 1994-м), он, видимо, неверно истолковал страницу «Википедии», охватывающую период с 1993 по 1998 год. Через день он датировал 1993 годом только Atari Jaguar, и это был правильный ответ.

Представитель Google пояснил, что компания продолжает совершенствовать систему, используя, в частности, метод состязательного обучения, а по некоторым запросам сводки показываться вообще не будут. Но даже несмотря на ненулевую вероятность ошибок постоянным остаётся один способ защиты от них — изучение источников.