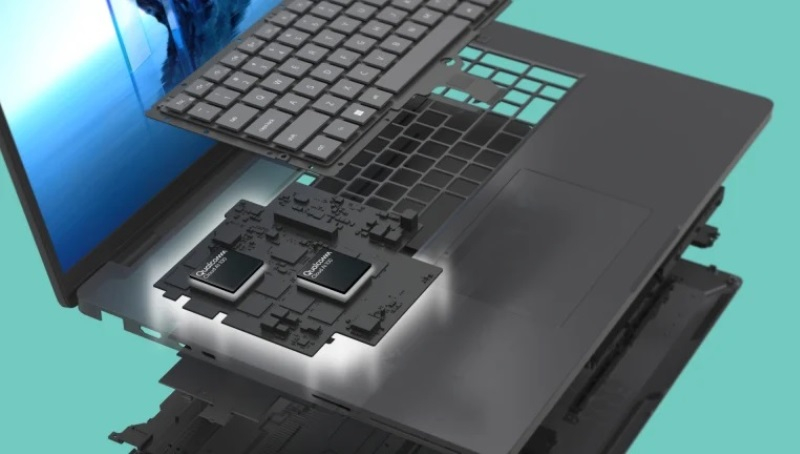

Dell анонсировала мощный ноутбук без видеокарты — её заменил дискретный ИИ-ускоритель

Компания Dell официально представила ноутбук Pro Max Plus, ориентированный на представителей бизнес-сегмента, которым требуются мощные рабочие станции для обработки ресурсоёмких ИИ-задач. Главная особенность новинки — наличие дискретного нейронного сопроцессора (NPU) от Qualcomm, который позволяет локально запускать большие языковые модели (LLM) размером в несколько миллиардов параметров.

Источник изображений: Brian Westover / Dell

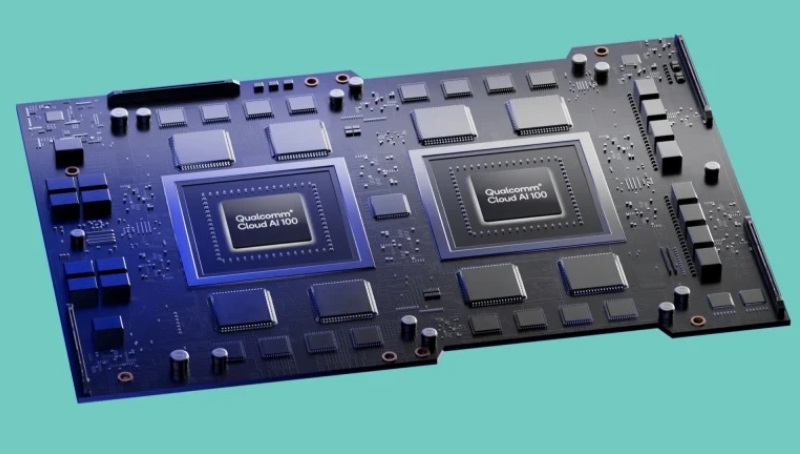

В то время как другие компьютеры серии Pro Max представляют собой производительные рабочие станции с графическими ускорителями и премиальными функциями, в ноутбуке Pro Max Plus разработчики решили полностью отказаться от использования GPU, заменив его дискретным нейронным чипом. Речь идёт о специализированном чипе Qualcomm Cloud AI 100 — первом дискретном NPU корпоративного уровня.

Он создан специально для использования в рабочих станциях инженеров, разработчиков и учёных, чтобы дать им возможность запускать LLM на локальном устройстве. Ускоритель Qualcomm Cloud AI 100 выполнен в виде дискретной 150-ваттной карты расширения PCIe и оснащён 32 ядрами и 64 Гбайт памяти LPDDR4x. Поскольку NPU разработан для работы с нейросетями, он обеспечивает более высокую производительность на ватт мощности, чем любая сопоставимая видеокарта с поддержкой ИИ.

Многие подробности о ноутбуке Pro Max Plus пока остаются неизвестными. Dell не озвучила розничную стоимость новинки и даже не сообщила точный размер экрана, указав лишь, что ноутбук будет оснащён панелью с диагональю от 16 до 18 дюймов. Вероятно, больше информации появится ближе к началу продаж, которые намечены на конец текущего года.

По данным Dell, ноутбук Pro Max Plus способен запускать языковые модели размером до 109 миллиардов параметров. Это существенно превышает возможности любой рабочей станции, представленной на рынке, хотя и недостаточно для запуска самых передовых моделей, таких как OpenAI GPT-4 с 1,8 трлн параметров. Тем не менее, нейросеть, запущенная на ноутбуке, будет функционировать полностью локально и не потребует подключения к удалённым серверам или облачным платформам. Это особенно важно для бизнеса: при разработке ИИ-инструментов можно обеспечить полную конфиденциальность наработок и даже самих запросов к алгоритму.