Nvidia выпустила Nemotron 3 Super 120B — открытую LLM для ИИ-агентов с пятикратным приростом скорости

Компания Nvidia выпустила Nemotron 3 Super — открытую ИИ-модель Mixture-of-Experts (MoE) с поддержкой 120 млрд общих параметров и 12 млрд активных параметров, предназначенную для задач агентного ИИ. Модель использует гибридную архитектуру Mamba-Transformer.

Источник изображений: Nvidia

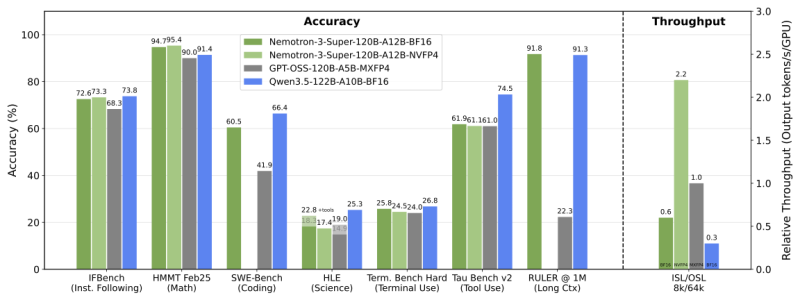

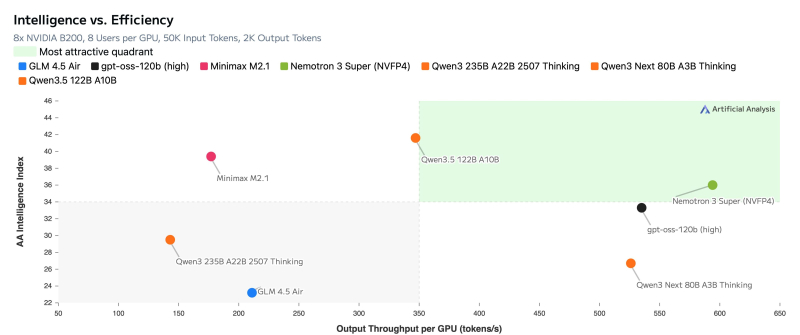

По словам Nvidia, Nemotron 3 Super — это первая модель в серии Nemotron 3, которая объединяет парадигму LatentMoE, слои Multi-Token Prediction и предварительное обучение NVFP4. Компания заявляет, что этот стек повышает точность и ускоряет инференс, а гибридная архитектура Nemotron 3 Super обеспечивает до пяти раз более высокую пропускную способность и до двух раз более высокую точность по сравнению с предыдущей моделью Nemotron Super. Компания также отмечает поддержку контекстного окна в 1 млн токенов, что позволяет агентным ИИ сохранять в памяти полное состояние рабочего процесса и предотвращает отклонение от цели.

Nemotron 3 Super подходит для решения сложных задач внутри многоагентной системы. Например, для генерации и отладки кода без сегментации документов, для финансового анализа, где можно загружать в память тысячи страниц отчётов.

Модель была обучена на синтетических данных, сгенерированных с использованием моделей логического мышления. Nvidia публикует полную методологию, включая более 10 триллионов токенов наборов данных до и после обучения, 15 сред обучения для обучения с подкреплением и рецепты оценки. Исследователи могут дополнительно использовать платформу Nvidia NeMo для тонкой настройки модели или создания собственной.

Nemotron 3 Super поддерживает работу на платформе Nvidia Blackwell в формате NVFP4. Это снижает требования к памяти и ускоряет вывод в четыре раза по сравнению с FP8 на Nvidia Hopper без потери точности.

Модель уже доступна для использования. Доступ к Nemotron 3 Super можно получить через build.nvidia.com, Hugging Face, OpenRouter и Perplexity, а среди партнёров по облачным сервисам и инференсу указаны Google Cloud Vertex AI, Oracle Cloud Infrastructure, CoreWeave, Together AI, Baseten, Cloudflare, DeepInfra, Fireworks AI и Modal. Модель также представлена в виде микросервиса Nvidia NIM для развёртывания в локальной среде и облаке.