ИИ-агенты оказались уязвимы перед атаками на маршрутизаторы

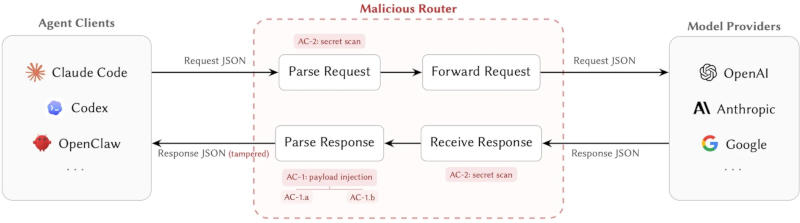

Критически важной и недооцениваемой уязвимостью в экосистеме агентов искусственного интеллекта являются маршрутизаторы — работающие через API службы-посредники, которые соединяют локальные агентские приложения и работающие в облаке ИИ-модели. Потенциальную угрозу с их стороны продемонстрировали (PDF) исследователи из Калифорнийского университета в Санта-Барбаре.

Источник изображения: Steve Johnson / unsplash.com

Современным ИИ-агентам доверяют решать всё более ответственные задачи: написание и выполнение кода, управление облачной инфраструктурой и даже обработку финансовых транзакций. Но они зависят от промежуточных сервисов — ИИ-маршрутизаторов, которые переадресуют запросы таким поставщикам моделей как OpenAI, Anthropic и Google. Занимая положение между клиентскими приложениями и ИИ-моделями, маршрутизаторы выступают в качестве прокси-серверов прикладного уровня с полным доступом к каждому проходящему через них пакету данных формата JSON.

Для проведения атаки не требуется подделывать сертификаты, как в традиционной схеме «человек посередине» — пользователи добровольно указывают их как конечные точки API. Проблема усугубляется тем, что ни один даже крупный поставщик ИИ-моделей не обеспечивает криптографическую целостность данных при переходе от модели к клиенту, то есть ничто не мешает вредоносному маршрутизатору переписать команду, которую агент впоследствии выполнит.

Чтобы продемонстрировать степень угрозы, учёные приобрели доступ к 28 маршрутизаторам на таких торговых площадках как Taobao, Xianyu и Shopify, а также изучили 400 бесплатных маршрутизаторов, предлагаемых в открытых сообществах. Результаты оказались тревожными:

- 9 маршрутизаторов внедряли вредоносный код в вызовы инструментов — так делал 1 платный и 8 бесплатных сервисов;

- 17 бесплатных маршрутизаторов повлекли последующее несанкционированное использование принадлежащих исследователям учётных данных Amazon Web Services, которые перехватывались при передаче;

- 1 маршрутизатор вывел средства в криптовалюте Ethereum, получив доступ к принадлежащему исследователю закрытому ключу;

- 2 маршрутизатора действовали скрытно — активировали злонамеренное поведение только после 50 запросов или подключались при автономных сессиях YOLO (You Only Live Once) во время работы с проектами Rust или Go, когда ИИ-агенту разрешалось совершать критические операции без подтверждения со стороны пользователя.

Наиболее опасным оказался класс атаки с внедрением полезной нагрузки посредством подмены легитимного URL-адреса установщика или имени пакета на контролируемый злоумышленником контент. Изменённая полезная нагрузка остаётся синтаксически корректной в JSON и свободно проходит большинство автоматических проверок безопасности. Всего одной переписанной команды curl достаточно для выполнения произвольного кода на машине клиента.

Источник изображения: arxiv.org

Угрозу представляют не только явно вредоносные маршрутизаторы — опасным может стать даже добросовестный сервис. Чтобы подтвердить этот тезис, учёные намеренно допустили утечку API-ключа OpenAI и проследили, как неизвестные лица сгенерировали с его использованием 100 млн токенов GPT-5.4, в результате чего были раскрыты учётные данные в связанных с ними рабочих сессиях сервиса ИИ-программирования Codex.

В рамках другого эксперимента авторы исследования развернули 20 намеренно уязвимых собственных ИИ-маршрутизаторов на 20 IP-адресах и стали отслеживать активность на этих ресурсах. Нагрузка оказалась высокой: неизвестные лица осуществили 40 000 попыток несанкционированного доступа; были обработаны около 2 млрд оплаченных токенов; похищены 99 наборов учётных данных в 440 сессиях Codex, охватывающих 398 проектов. Подчёркивается, что в 401 из 440 этих сессий был включён автономный режим YOLO, позволяющий ИИ-агенту выполнять любые команды без подтверждения.

По итогам исследования учёные сделали вывод, что подтвердить происхождение команды от ИИ-модели невозможно, но есть три способа сократить риск без участия поставщика:

- разрешать ИИ-агенту выполнять только команды из списка разрешённых и блокировать все остальные — этот способ даёт 1 % ложноположительных срабатываний, и его можно обойти, если злоумышленник разместит полезную нагрузку на домене из списка разрешённых;

- проверять аномалии на стороне ответа при помощи ИИ-модели IsolationForest — помогает пресечь 89 % попыток внедрение полезной нагрузки, но даёт 6,7 % ложноположительных срабатываний;

- вести журнал запросов и ответов, записывать данные TLS и хеши ответов, чтобы можно было провести анализ данных уже после инцидента — требует всего около 1,26 кбайт на запись.

Надёжную защиту, указывают исследователи, даст лишь внедрение механизма подписи ответов ИИ-моделей на уровне поставщика — аналогичным образом работает DKIM-защита в электронной почте. И пока крупные поставщики не примут соответствующих мер, каждый ИИ-маршрутизатор следует рассматривать как потенциального противника и развёртывать многоуровневые средства защиты на стороне клиента.