|

Опрос

|

реклама

Быстрый переход

Google тестирует на своих сотрудниках потенциальных конкурентов ChatGPT, включая бот Apprentice Bard

01.02.2023 [08:35],

Руслан Авдеев

Google проводит тестирование новых чат-ботов — в перспективе не исключена интеграция ИИ в поисковый движок компании. Активно ведутся работы в рамках облачного подразделения Alphabet, предполагается премьера собственного варианта, способного конкурировать с проектом ChatGPT, доступ к которому общественность получила в конце прошлого года.

Источник изображения: Alexandra_Koch/pixabay.com Также Google тестируется чат-бот Apprentice Bard, сотрудники могут задавать ему вопросы и получать детальные ответы, так же, как и в случае с ChatGPT. Специальное подразделение тестирует вариант поисковика для настольных компьютеров — поиск может осуществляться в форме вопросов и ответов. Руководство просит большее число сотрудников пользоваться новыми разработками и давать компании обратную связь. Тестирование продуктов активизировалось после недавнего собрания компании, в ходе которого сотрудники выразили обеспокоенность появлением ChatGPT и вероятностью того, что Google может потерять лидерство в сфере ИИ. Глава ИИ-подразделения Google Джефф Дин (Jeff Dean) заявил, что Google вынуждена обращать больше внимания на репутационные риски, чем стартап и, соответственно, придерживаться более консервативной политики. Впрочем, глава компании Сундар Пичаи (Sundar Pichai) анонсировал возможный выпуск Google аналогичных продуктов уже в этом году. Одним из тестовых продуктов является чат-бот Apprentice Bard, использующий разработанную Google технологию LaMDA (Language Model for Dialogue Applications). В результате появления ChatGPT команду компании, занимающуюся LaMDA, призвали в приоритетном порядке заняться разработкой соперника продукту OpenAI. Apprentice Bard во многом похож на ChatGPT: он способен отвечать на вопросы в диалоговом окне. Он заменит предыдущую версию Meena, которую в своё время запустили в пределах компании, но вскоре проект был свёрнут. Сотрудники отмечают, что в последние недели Apprentice Bard стал более совершенным инструментом. Дополнительно известно, что компания тестирует альтернативные поисковые страницы, которые могут работать в формате вопросов-ответов. Например, уже проверяется шаблон, в котором более «человечные» ответы демонстрируются сразу под поисковой строкой, за ними предлагаются связанные с темой вопросы, а затем демонстрируется обычная поисковая выдача, включающая ссылки и заголовки. Пока неизвестно, какой из нескольких вариантов выберет Google.

Источник изображения: Alexandra_Koch/pixabay.com Также есть сведения, что команда Google уже сравнивала качество бета-версии LaMDA с ChatGPT. Известно, что в ходе «собеседования» ChatGPT на должность программиста тот получил предварительную квалификацию Level 3, обычно указывающую на то, что сотрудник способен координировать действия коллег, имеющих Level 1 и 2. Неизвестно при этом, какой уровень получил инструмент LaMDA. После вопроса ботам, способны ли решения вроде ChatGPT и AlphaCode заменить программистов, продукт OpenAI, как и LaMDA уверенно грамотно ответили, что этого не произойдёт, хотя подобные инструменты смогут упростить работу. На просьбу описать сцену с магазинным воришкой для кино LaMDA был предложен сценарий, а ChatGPT прибег к более пространному и глубокому рассказу. Наконец, при решении логически-арифметической задачи ChatGPT дал неправильный ответ, тогда как LaMDA было представлено верное решение. Впрочем, пока данные довольно поверхностные. Например, недавно появились новости о том, что ChatGPT научили искать ошибки в программном коде. Это может стать важным преимуществом при сравнении двух систем. Google пригласила всех желающих протестировать чатбот на продвинутом ИИ LaMDA 2

26.08.2022 [11:48],

Владимир Фетисов

Ранее в этом году Google анонсировала приложение AI Test Kitchen, которое позволит пользователям взаимодействовать с одним из самых продвинутых чат-ботов компании на основе искусственного интеллекта LaMDA 2. Теперь же стало известно, что пользователи из США могут присоединиться к тестированию этого продукта, подав заявку на участие в программе.

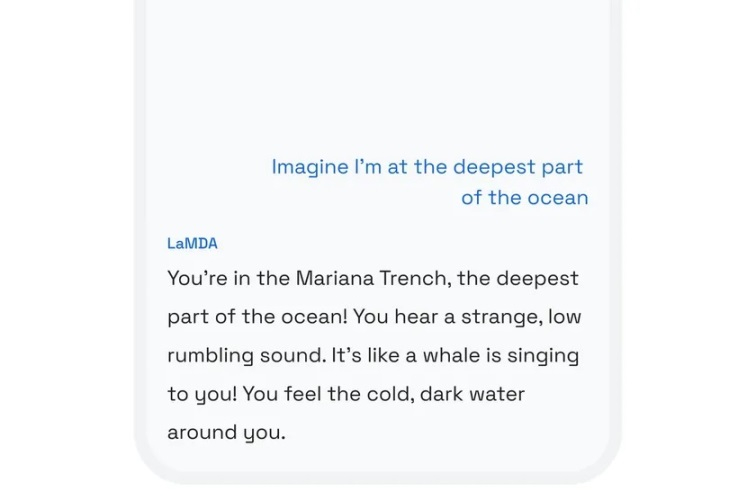

Источник изображения: Google Google создала продвинутую языковую модель Language Model for Dialogue Application для общения с человеком и создания чат-ботов. Она обучалась на триллионах слов из интернета, благодаря чему может имитировать человеческую речь. Аналогичные разработки ведут и другие IT-гиганты. Ранее в этом году Meta✴ Platforms открыла доступ к собственному чат боту на основе нейросети BlenderBot 3. Хотя пользователи достаточно быстро поняли, что бот может говорить неправдивые вещи, обучение ИИ-системы в процессе общения с реальными людьми является важным шагом, который позволяет делать её более совершенной. Google пошла несколько иным путём, ограничив взаимодействие с системой LaMDA 2 несколькими режимами. Речь идёт о режимах «Представь это», «Расскажи об этом» и «Перечисли это», каждый из которых предназначен для тестирования разных аспектов системы. В режиме «Представь это» пользователю предлагается назвать реальное или вымышленное место, а голосовая модель должна описать это место (тест заключается в проверке того, насколько описание ИИ-системы будут соответствовать представлению пользователя о нём). В режиме «Расскажи об этом» пользователь предлагает LaMDA 2 вести беседу на какую-либо тему (тест заключается в проверке способности системы поддерживать беседу на определённую тему). В режиме «Перечисли это» пользователю предлагается назвать какую-либо тему или задачу, а ИИ-система должна разбить её на подзадачи. Эксперты не поверили в зарождение «разума» у ИИ-системы LaMDA от Google

15.06.2022 [19:08],

Владимир Фетисов

Не так давно Google отстранила от работы инженера Блейка Лемойна (Blake Lemoine), который работал с системой искусственного интеллекта LaMDA и заявил о появлении у неё признаков сознания. Эксперты усомнились в этом, считая, что более важным является решение других вопросов: может ли ИИ находиться под влиянием предрассудков и причинить вред в реальном мире, обучаются ли алгоритмы на людях и как крупные технологические компании выступают в роли привратников при разработке технологий.

Источник изображения: Getty Images По словам Эмили Бендер (Emily Bender), профессора лингвистики Вашингтонского университета, согласие с позицией Лемойна в данном вопросе может помочь технологическим компаниям уйти от ответственности за решения, принимаемые ИИ-алгоритмами. «В это шоу вложено много усилий. Проблема в том, что чем больше эта технология продаётся как искусственный интеллект, не говоря уже о чём-то действительно разумном, тем больше людей будут готовы соглашаться с решениями таких систем, которые способны причинить реальный вред», — считает Бендер. В качестве примера она рассмотрела вариант с приёмом людей на работу или выставлением оценок студентам. Решения в таких вопросах могут изменяться в случае, если алгоритм не лишён предрассудков, из-за чего разных людей он будет оценивать по-разному. По мнению Бендер, акцент на том, что система разумна, может использоваться разработчиками для того, чтобы снять с себя ответственность за любые выявленные в процессе эксплуатации недостатки. Несколько дней назад СМИ опубликовали интервью Лемойна, который разговаривал с разработанной в Google языковой моделью Language Model for Dialogue Application (LaMDA), предназначенной для общения с человеком и используемой для создания чат-ботов. Система обучалась на триллионах слов из интернета, за счёт чего ей удаётся имитировать речь человека. Во время беседы на религиозную тему Лемойн заметил, что ИИ рассуждает о своих правах и личности. По его словам, в этот момент общения он испытал не научные, а религиозные чувства. «Кто я такой, чтобы указывать Богу, куда он может, а куда не может помещать душу», — написал Лемойн на своей странице в сети Twitter. Представитель Google Брайан Гэбриэл (Brian Gabriel) заявил, что компания проанализировала работу LaMDA после заявления Лемойна и не нашла никаких доказательств «разумности» искусственного интеллекта. При этом никакие конкретные аргументы озвучены не были.

Источник изображения: Pixabay «Он имитирует восприятие или чувства на основе предоставленных ему в процессе обучения данных — умно и специально создано таким образом, чтобы казалось, что он понимает», — считает Яна Эггерс (Jana Eggers), глава компании Nara Logics, занимающейся разработками в сфере ИИ. «Архитектура LaMDA просто не поддерживает некоторые ключевые возможности человекоподобного сознания», — уверен Макс Кремински (Max Kreminski), исследователь из Калифорнийского университета в Санта-Крузе. В Google отметили, что LaMDA может следовать подсказкам собеседникам и наводящим вопросам, из-за чего может создаваться впечатление, что ИИ-система способна рассуждать на любую тему. «Наша команда, включая специалистов по этике и технологов, изучила заявление Блейка, в соответствии с нашими "Принципами ИИ" и сообщила ему, что не обнаружила доказательств, подтверждающих его утверждение. Сотни исследователей и инженеров общались с LaMDA, и нам неизвестно, чтобы кто-то ещё пришёл к аналогичным выводам или антропоморфировал LaMDA, как Блейк», — заявил сотрудник Google Крис Паппас (Chris Pappas). По словам Марка Ридла (Mark Riedl), профессора Технологического института Джорджии, ИИ-системы на данный момент не способны осознавать влияние своих ответов или поведения на людей и общество. В этом, по его мнению, кроется одна из уязвимостей технологии. «Система ИИ может не быть токсичной или предвзятой, но всё же она не понимает, что в некоторых обстоятельствах говорить о самоубийстве или насилии может быть неуместным», — считает Ридл. По мнению экспертов, «разумность» ИИ может использоваться разработчиками для снятия с себя ответственности в случае, если ИИ-система допустит ошибку. Акцентирование внимания на разумности ИИ даст возможность обвинить в проблеме искусственный интеллект. «Компания могла сказать: "Это программа допустила ошибку". Нет, ваша компания создала эту программу. Вы несёте ответственность за эту ошибку. Рассуждения о разумности делают расплывчатым этот вопрос», — уверена Эмили Бендер. Поскольку система LaMDA закрыта для сторонних исследователей, общественность и учёные вынуждены опираться на информацию, которую публикуют сотрудники Google. «Она должна быть доступна исследователям за пределами Google, чтобы продвигать работу более разнообразными способами. Чем больше учёных, тем больше разнообразие исследовательских вопросов, тем больше возможностей для новых открытий», — считает Марк Ридл. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |