|

Опрос

|

реклама

Быстрый переход

Поставки первых систем на ускорителях Nvidia Rubin стартуют в конце лета

20.01.2026 [14:33],

Алексей Разин

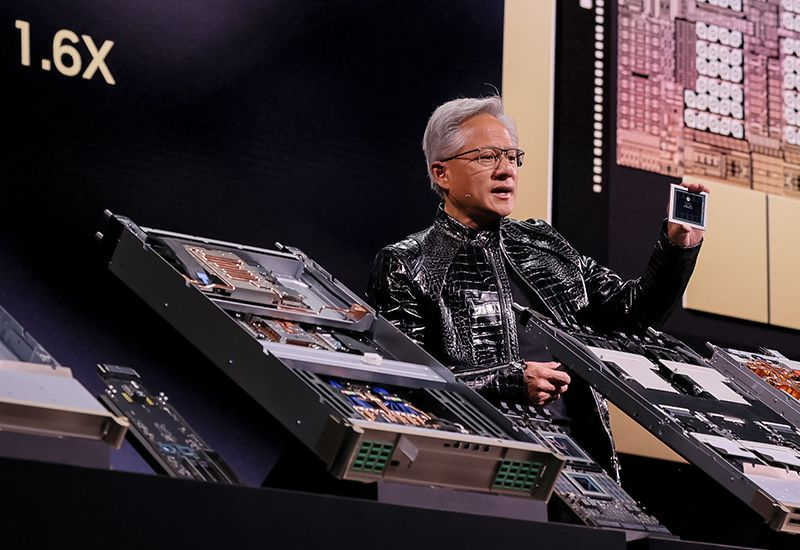

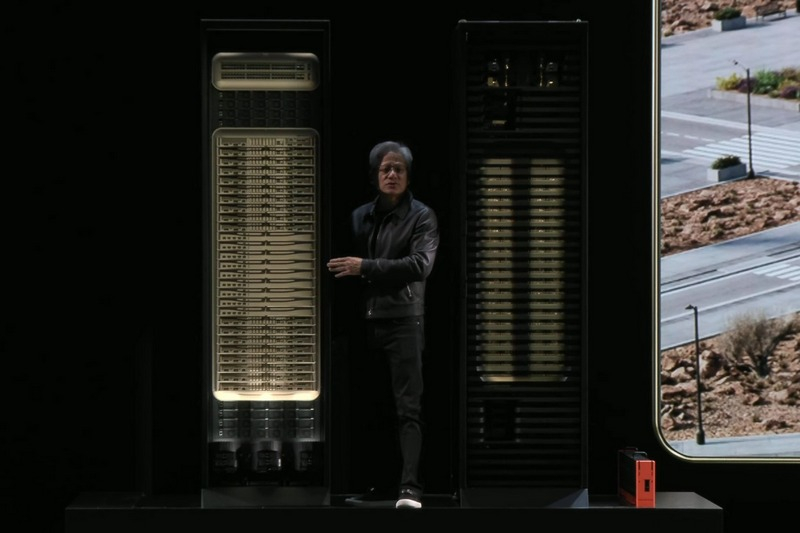

В этом месяце глава и основатель Nvidia Дженсен Хуанг (Jensen Huang) продемонстрировал ускорители вычислений поколения Rubin, заявив о начале их массового производства. Между тем, серверная продукция обычно длительное время добирается до конечных пользователей, а потому и поставки систем на семейства Vera Rubin партнёры Nvidia собираются начать лишь к концу этого лета.

Источник изображения: Nvidia Об этом сообщает Commercial Times со ссылкой на комментарии вице-президента тайваньского производителя серверного оборудования Quanta Computer Майка Янга (Mike Yang), которые тот сделал на прошлой неделе на праздничном корпоративном мероприятии. Гиганты облачных вычислений начнут получать соответствующие системы на базе ускорителей Nvidia Rubin в августе текущего года. На тот момент отгрузки не будут массовыми, а потому Quanta Computer и не рассчитывает на получение существенной выручки от поставок первых систем на базе Vera Rubin. Основная часть клиентов компании, по словам её представителя, уже эксплуатирует системы поколения Grace Blackwell (GB200 и GB300), что при условии родства архитектур с Vera Rubin позволит им достаточно быстро и безболезненно обновить в случае необходимости аппаратную базу. В официальных документах Nvidia осенью прошлого года сроки производства Vera Rubin упоминались достаточно размыто — под его начало отводился весь 2026 год. Производители ПК и смартфонов получат в 2–5 раз меньше памяти, чем им требуется в этом году

14.01.2026 [14:54],

Алексей Разин

В текущем году предпосылок для облегчения ситуации с дефицитом микросхем памяти не ожидается, как убеждены аналитики KeyBanc. На этом фоне производители ПК и смартфонов будут ощущать сильнейшую нехватку чипов памяти. Фактически, им будет доставаться не более 20–45 % необходимых объёмов памяти, а цены на смартфоны вырастут.  Объёмы поставок микросхем памяти в серверном сегменте в этом году в ёмкостном выражении должны увеличиться на 50 %, контрактные цены на DRAM в первом квартале вырастут на 25 % и на величину от 10 до 12 % во втором квартале, по прогнозам экспертов KeyBanc. В сегменте NAND контрактные цены вырастут на 20 % в первом квартале и до 15 % во втором, по их мнению. За пределами сегмента ЦОД покупателям микросхем памяти будут доступны гораздо более скромные квоты, не более 20–45 % от фактической потребности. В результате, цены на память для ПК и смартфонов тоже продолжат расти, а ещё сократятся объёмы производства этих устройств. В количественном выражении поставки ПК сократятся в этом году на 5–10 %, а поставки смартфонов упадут на величину от 3 до 5 %. Более того, крупные поставщики смартфонов типа Apple и Samsung будут вынуждены увеличить стоимость своих устройств на $100–150. По мере наращивания поставок систем на базе процессоров Nvidia Vera, которые сочетаются с памятью типа LPDDR5X, будет усугубляться её дефицит на всём рынке. Эксперты KeyBanc предполагают, что эти системы потребуют такого же количества памяти, как и 150 млн смартфонов. Это менее 10 % ёмкости рынка смартфонов, так что давление на рынок LPDDR5X хоть и будет явно выраженным, окажется не критическим. Обнаружен самый «вёрткий» астероид Солнечной системы — он совершает оборот менее чем за две минуты

10.01.2026 [03:20],

Геннадий Детинич

В своей массе астероиды — это куча щебня, сбившегося вместе под действием гравитации. Это наглядно показал таран зондом-камикадзе NASA DART астероида Диморф — после удара тот выбросил массу пыли и мелких камней. Это также означает, что астероидам не свойственно быстрое вращение вокруг своей оси — центробежная сила разорвёт их на мелкие части. Тем ценнее найти астероид со сверхвысокой скоростью вращения, что стало возможным с появлением нового телескопа.

Источник изображения: Vera C. Rubin Observatory Открытие сделала Обсерватория имени Веры С. Рубин (Vera C. Rubin Observatory). Огромная 3,2-гигапиксельной камера LSST обсерватории размером 3 × 1,65 метра способна делать снимки больших участков неба каждые 40 секунд. С апреля по июнь 2025 года обсерватория проходила стадию настройки оборудования, что не помешало сделать множество интересных открытий даже до начала научной работы. Одним из таких открытий стало обнаружение самого быстро вращающегося астероида Солнечной системы в категории свыше 500 метров, который при своих размерах в 710 метров совершал полный оборот вокруг своей оси за 1,88 минуты. Всего в процессе настройки оборудования Обсерватория «Рубин» открыла 1900 новых астероидов, 16 из которых могли похвастаться сверхбыстрым вращением, а 3 — ультрабыстрым, один из которых стал рекордсменом — это объект 2025 MN45. Три самых «вёртких» астероида совершали полный оборот менее чем за 5 минут, а 16 сверхбыстрых совершали обороты от 13 минут до 2,2 часа.  Отметка 2,2 часа на каждый оборот считается границей, ниже которой не монолитные астероиды разрываются центробежной силой. Тем самым все быстро вращающиеся астероиды состоят из плотной и даже монолитной породы. Большинство из впервые открытых астероидов расположены в Главном поясе астероидов между Марсом и Юпитером. После начала научной работы Обсерватории «Рубин» будут открыты сотни тысяч таких объектов. Ожидается, что работа обсерватории начнётся в ближайшие месяцы. Nvidia построит в США семь эксафлопсных суперкомпьютеров — два на Vera Rubin для Лос-Аламосской лаборатории

28.10.2025 [23:30],

Николай Хижняк

На конференции GTC 2025 компания Nvidia объявила о том, что построит в США семь эксафлопсных суперкомпьютеров в США. Две системы будут построены совместно с Oracle и будут использовать более 100 000 чипов Blackwell с производительностью до 2200 Эфлопс. Ещё две системы будут созданы совместно с HPE на перспективной платформе Vera Rubin для Лос-Аламосской национальной лаборатории.

Источник изображения: Nvidia Эти системы будут использоваться для обеспечения национальной безопасности и проведения научных исследований с применением ИИ-моделирования и высокопроизводительных вычислений. Что интересно, заявление Nvidia последовало за вчерашним объявлением AMD о победе в тендерах на поставку пары суперкомпьютеров для Министерства энергетики США. Лос-Аламосская национальная лаборатория заключила контракт с HPE на создание суперкомпьютеров Mission и Vision на базе платформы Vera Rubin от Nvidia, которая включает центральные процессоры Vera и графические процессоры Rubin нового поколения. Масштабирование машин будет осуществляться с помощью технологии NVLink Gen6, а горизонтальное — посредством сетевого интерфейса Nvidia QuantumX 800 Infiniband. Суперкомпьютер Mission, разработанный для Национального управления по ядерной безопасности, планируется ввести в эксплуатацию в 2027 году. Компьютер Vision будет опираться на достижения предыдущего суперкомпьютера Venado и использоваться для открытых научных исследований, включая исследования в области искусственного интеллекта. «Mission — пятая передовая технологическая система в рамках программы Лос-Аламоса по развитию искусственного интеллекта для научной безопасности. Ожидается, что она будет введена в эксплуатацию в 2027 году и предназначена для запуска секретных приложений. Система Vision основана на достижениях суперкомпьютера Venado из LANL и предназначена для несекретных исследований в области искусственного интеллекта и открытой науки. Системы Mission и Vision представляют собой значительные инвестиции в национальную безопасность США и развитие открытых научных возможностей», — заявил Дион Харрис (Dion Harris), руководитель отдела маркетинга продуктов центров обработки данных Nvidia. Nvidia не раскрыла ожидаемую производительность Mission и Vision. Однако Vision примет эстафету у Venado — 19-го по скорости суперкомпьютера в мире с производительностью Rmax FP64 98,51 Пфлопс. Поэтому вполне логично ожидать, что Vision обеспечит как минимум вдвое большую вычислительную мощность для научных задач. «Мы предоставим более подробную информацию о конкретных конфигурациях [суперкомпьютеров] позже. Самое замечательное в этой [платформе], учитывая, как эти системы будут использоваться как в открытой науке, так и в исследованиях в области национальной безопасности, заключается в том, что, по нашему мнению, она позволит использовать как возможности ИИ, так и традиционные возможности моделирования для научных исследований», — добавил Харрис. Хуанг показал Vera Rubin Superchip — CPU, два огромных GPU и 100 Пфлопс на одной плате для ИИ нового поколения

28.10.2025 [22:26],

Андрей Созинов

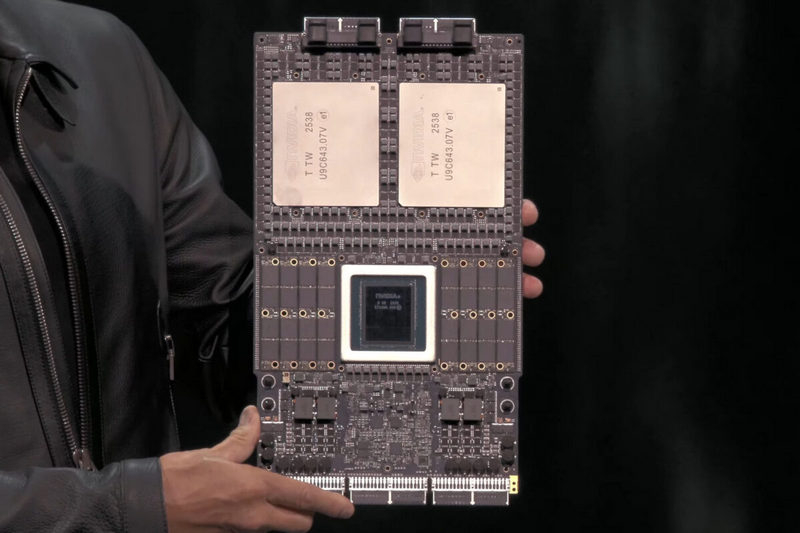

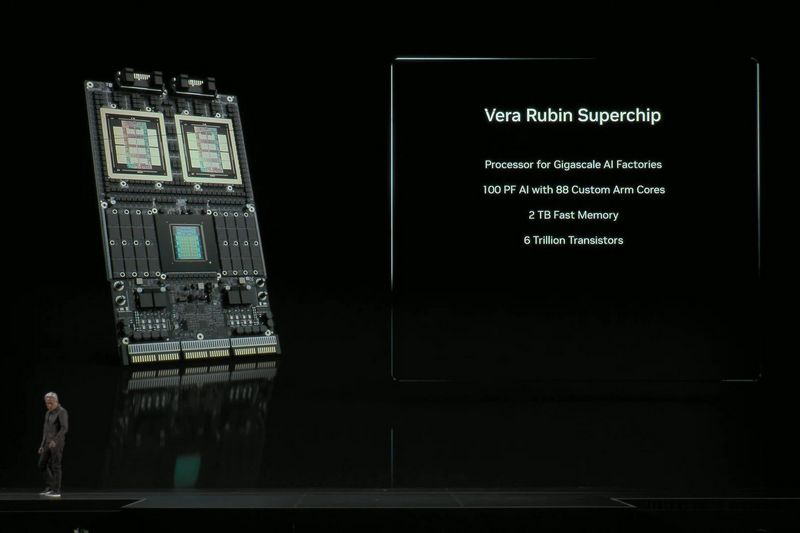

На конференции GTC 2025 глава компании Nvidia Дженсен Хуанг (Jensen Huang) продемонстрировал графический процессор следующего поколения — Rubin. Точнее, он показал со сцены прототип ускорителя Vera Rubin Superchip, который объединяет на одной плате совершенно новый центральный процессор Vera и пару огромных графических чипов Rubin. Такое сочетание обещает новый уровень производительности для ИИ-суперкомпьютеров будущего.

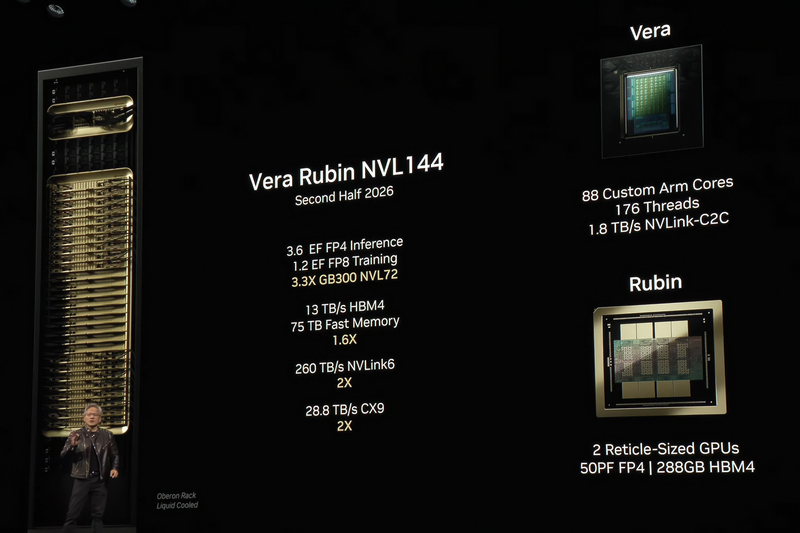

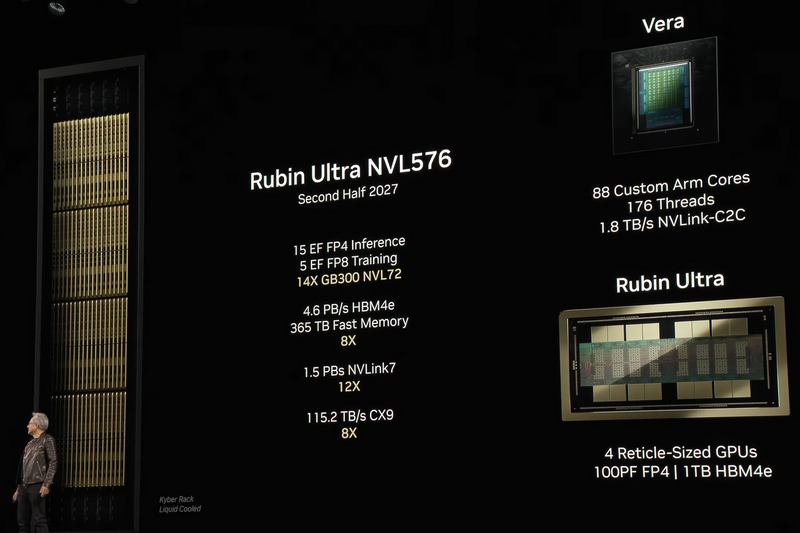

Источник изображений: Nvidia Каждый GPU Rubin состоит из двух больших кристаллов с ядрами CUDA и восьми стеков высокоскоростной памяти HBM4 объёмом 288 Гбайт. Характеристики GPU не уточняются, равно как и пропускная способность памяти. Однако отмечается, что одна система Vera Rubin Superchip обеспечивает производительность в ИИ-операциях (FP4) на уровне 100 Пфлопс (100 квадриллионов операций в секунду).  Что касается центрального процессора Vera, то известно, что он предложит 88 ядер на неназванной версии архитектуры Arm с 176 потоками, а для его связи с графическими процессорами будет задействован интерфейс NVLink-C2C с пропускной способностью 1,8 Тбайт/с. Также на плате расположится оперативная память LPDDR (версия не уточняется, но вполне возможно, что это будет уже LPDDR6), в результате чего общий объём оперативной памяти на один «суперчип» достигнет 2 Тбайт.  На базе новых ускорителей Nvidia предложит самые разные системы, например новые Compute Tray, включая CPX-версию для задач с большим контекстом ИИ-моделей. Также компания рассказала о готовых серверных стойках Vera Rubin NVL144 с производительностью 3,6 Эфлопс (3,6 квинтильона операций в секунду) для запуска уже обученных ИИ-моделей (FP4 inference), а также 1,2 Эфлопс для обучения моделей (FP8 training).  Это примерно в 3,3 раза быстрее актуальных систем GB300 NVL72. Система предложит 13 Тбайт/c общей пропускной способности для памяти HBM4 и в совокупности 75 Тбайт быстрой системной памяти, а общая пропускная способность интерфейсов NVLink и CX9 достигнет 260 Тбайт/с и 28,8 Тбайт/с соответственно.   Nvidia также раскрыла детали о системе NVL576 на базе чипов Rubin Ultra, которые ожидаются во второй половине 2027 года. Эти чипы будут включать четыре крупных GPU-чиплета на одной подложке и 1 Тбайт памяти HBM4e. В итоге система NVL576 обеспечит производительность до 15 Эфлопс FP4 и 5 Эфлопс FP8, предлагая до 365 Тбайт быстрой системной памяти и сетевую пропускную способность до 1,5 Пбайт/с через NVLink. Nvidia сообщила, что первые тестовые экземпляры Rubin уже поступили в лаборатории компании для испытаний, а старт массового производства запланирован на 2026 год. На смену этой архитектуре придёт совершенно новая архитектура Feynman, запуск которой намечен на 2027–2028 годы. Однако никаких чипов на этой платформе Nvidia пока не показала — вряд ли на данный момент они вообще существуют в физическом воплощении. |