|

Опрос

|

реклама

Быстрый переход

Китайские ИИ-компании в поисках монетизации нацелились на зарубежные рынки

26.08.2024 [09:52],

Анжелла Марина

Геополитическая напряжённость и технологический разрыв вынуждают китайских разработчиков искать новые стратегии для выхода на мировой рынок. Alibaba, ByteDance и другие крупные китайские компании стали запускать приложения на базе искусственного интеллекта не только для домашнего рынка, но и для глобальной аудитории, адаптируя свои продукты к различным рынкам.

Источник изображения: Copilot По сообщению издания South China Morning Post со ссылкой на исследование Unique Capital, среди 1500 активных компаний в сфере ИИ по всему миру, 103 китайские фирмы уже начали расширяться на зарубежные рынки. Эта тенденция обусловлена сложностью в убеждении китайских пользователей платить за ИИ-сервисы, что побудило некоторые компании искать возможности роста за рубежом. Например, компания Alibaba, в соответствии со своей стратегией в области электронной коммерции и облачных вычислений в регионе, запустила ИИ-модель SeaLLMs, адаптированную для рынков Юго-Восточной Азии. Компания ByteDance, владелец TikTok, представила ряд приложений для потребителей на глобальном рынке, включая ИИ-помощника по дому Gauth, приложение с интерактивными персонажами AnyDoor и платформу для ИИ-ботов Coze. Minimax, один из ведущих китайских стартапов в области ИИ, также запустил приложение Talkie AI для международных пользователей. По мнению экспертов отрасли, зарубежные рынки предлагают больший потенциал для роста на фоне жёсткой конкуренции внутри страны. Райан Чжан Хаоран (Ryan Zhang Haoran), соучредитель Motiff, компании-разработчика платформы для дизайна пользовательского интерфейса на базе ИИ, отмечает: «Зарубежные пользователи более охотно платят за программное обеспечение, и там больше профессионалов, способных предоставить ценную обратную связь». Чжан подчёркивает, что компания с самого начала ориентировалась на возможности бизнеса как внутри страны, так и за рубежом. При этом Motiff удалось довольно быстро привлечь первых клиентов из США, Японии, Юго-Восточной Азии и Латинской Америки. Другая пекинская компания Kunlun Tech, являющаяся ветераном среди китайских технологических компаний, также нацелена на зарубежных пользователей. Генеральный директор Фан Хан (Fang Han) отмечает, что конкурентная среда за рубежом становится более насыщенной по мере того, как китайские компании выходят на международный рынок. «Контент, генерируемый ИИ, фундаментально снижает барьеры и затраты для создателей, что приводит к революции в индустрии изготовления контента», — говорит Фан. Недавно Kunlun Tech запустила ряд приложений на базе ИИ, включая музыкальный стриминговый сервис Melodio, коммерческую платформу Mureka для создания музыки с помощью ИИ и платформу для генерации короткометражных фильмов SkyReels. Выход китайских разработчиков ИИ на международный рынок обусловлен также как высокой конкуренцией на внутреннем рынке, так и стремлением к расширению и монетизации своих продуктов. Однако китайским разработчикам ИИ приходится учитывать не только рыночные реалии, но и политическую ситуацию, особенно в свете ухудшения отношений между Вашингтоном и Пекином. Некоторые компании даже пытаются скрыть своё китайское происхождение. Например, стартап HeyGen, занимающийся генеративным ИИ, переместил свою штаб-квартиру в Лос-Анджелес и призвал своих китайских инвесторов продать акции в пользу американских партнёров, чтобы минимизировать связи с материковым Китаем в условиях ужесточения контроля. «Соблюдение норм является критически важным. Вход на новый рынок означает соответствие его правилам», — отметил Чжан из Motiff. Он добавил, что, несмотря на единообразие продуктов на глобальном уровне, инфраструктура компании адаптирована для различных рынков с использованием различных моделей с открытым исходным кодом и облачных сервисов. GitHub запускает Copilot Autofix: ИИ для быстрого устранения уязвимостей в программном коде

21.08.2024 [06:24],

Анжелла Марина

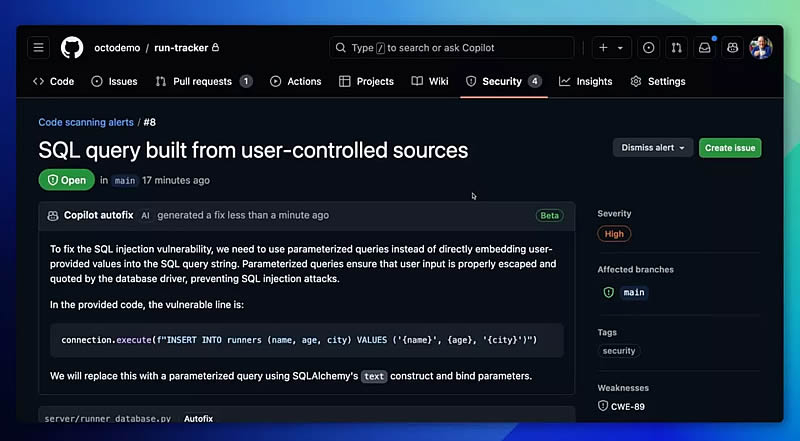

Компания GitHub представила инструмент на базе искусственного интеллекта Copilot Autofix для помощи программистам в быстром устранении ошибок в коде, которые впоследствии могут стать одной из главных причин нарушений безопасности всего проекта.

Источник изображения: Copilot Copilot Autofix анализирует дефекты, обнаруженные в запросах на внесение изменений, предоставляет объяснения и предлагает исправления. Разработчики могут с лёгкостью отклонить, скорректировать или принять предложения ИИ-бота. При этом инструмент способен обрабатывать широкий спектр уязвимостей, включая SQL-инъекции и межсайтовый скриптинг (XSS), помогая устранять в коде как новые, так и существующие погрешности, поясняет ресурс TechSpot.

Источник изображения: TechSpot/GitHub Как отмечается в пресс-релизе GitHub, «разработка программного обеспечения движется с головокружительной скоростью, и разработчики постоянно выпускают новые проекты и дорабатывают старые. Однако, несмотря на все их усилия, уязвимости безопасности всё же попадают в рабочий код, причиняя много неприятностей». Хотя инструменты сканирования могут обнаружить недостатки, их исправление требует специальных знаний и значительного времени. Другими словами, проблема не всегда заключается в выявлении уязвимостей, а в необходимости их быстрого устранения. Во время публичной бета-версии ранее в этом году GitHub обнаружил, что разработчики решали проблемы безопасности более чем в три раза быстрее с помощью Copilot Autofix по сравнению с ручным исправлением. Авторы обвинили разработчика чат-бота Claude в пиратстве их книг

21.08.2024 [05:07],

Анжелла Марина

Компания Anthropic, разработчик чат-бота Claude, столкнулась с новым иском о нарушении авторских прав. Авторы утверждают, что компания использовала для обучения искусственного интеллекта их книги и сотни тысяч книг других авторов без разрешения.

Источник изображения: anthropic.com По сообщению Reuters, среди истцов оказались писатели Андреа Бартц (Andrea Bartz), Чарльз Грэбер (Charles Graeber) и Кирк Уоллес Джонсон (Kirk Wallace Johnson). Они утверждают, что Anthropic использовала пиратские версии их произведений, требуя денежной компенсации и полного запрета на неправомерное использование произведений. Этот иск стал частью более широкого потока судебных разбирательств, инициированных правообладателями, включая художников, новостные агентства и звукозаписывающие компании. Они требуют разъяснений о том, как и на каком основании технологические компании свободно используют их материалы для обучения своих генеративных ИИ-систем. Представитель Anthropic сообщил во вторник, что компания осведомлена о поданном иске и проводит оценку жалобы, однако отказался комментировать ситуацию более подробно, сославшись на ведение судебного разбирательства. Адвокат авторов также воздержался от комментариев. Следует отметить, что это уже второй иск против Anthropic. В прошлом году музыкальные издатели подали иск, обвинив компанию в неправомерном использовании защищённых авторским правом текстов песен для обучения Claude. Ранее несколько групп авторов подали иски против таких компаний, как OpenAI и Meta✴✴, обвинив их в аналогичном незаконном использовании произведений для обучения своих языковых моделей. Anthropic заплатит до $15 000 хакерам, которые найдут уязвимости в её ИИ-системах

09.08.2024 [17:14],

Анжелла Марина

Компания Anthropic объявила о запуске расширенной программы поиска уязвимостей, предлагая сторонним специалистам по кибербезопасности вознаграждение до 15 000 долларов за выявление критических проблем в своих системах искусственного интеллекта.

Источник изображения: Copilot Инициатива направлена на поиск «универсальных методов обхода», то есть способов взлома, которые могли бы последовательно обходить меры безопасности ИИ в таких областях высокого риска, как химические, биологические, радиологические и ядерные угрозы, а также в области киберпространства. Как сообщает ресурс VentureBeat, компания Anthropic пригласит этичных хакеров для проверки своей системы ещё до её публичного запуска, чтобы сразу предотвратить потенциальные эксплойты, которые могут привести к злоупотреблению её ИИ-системами. Интересно, что данный подход отличается от стратегий других крупных игроков в области ИИ. Так, OpenAI и Google имеют программы вознаграждений, но они больше сосредоточены на традиционных уязвимостях программного обеспечения, а не на специфических для ИИ-индустрии эксплойтах. Кроме того, компания Meta✴✴ недавно подверглась критике за относительно завуалированную позицию в области исследований безопасности ИИ. Напротив, явная нацеленность Anthropic на открытость устанавливает новый стандарт прозрачности в этом вопросе. Однако эффективность программ поиска уязвимостей в решении всего спектра проблем безопасности ИИ остаётся спорной. Эксперты отмечают, что может потребоваться более комплексный подход, включающий обширное тестирование, улучшенную интерпретируемость и, возможно, новые структуры управления, необходимые для обеспечения глобального соответствия систем искусственного интеллекта человеческим ценностям. Программа стартует как инициатива по приглашению (закрытое тестирование) в партнёрстве с известной платформой HackerOne, но в будущем Anthropic планирует расширить программу, сделав её открытой и создав отдельную независимую модель для отраслевого сотрудничества в области безопасности ИИ. Stability AI представила Stable Fast 3D — ИИ-инструмент для быстрого создания 3D-изображений

02.08.2024 [19:29],

Анжелла Марина

Компания Stability AI, разработчик в области искусственного интеллекта, создала на основе генеративного ИИ технологию, которая позволяет молниеносно генерировать 3D-изображения. Если раньше требовалось мощное оборудование и сложное программирование, то теперь модель Stable Fast 3D, состоящая из двух миллиардов параметров, способна генерировать на основе текста или референса яркие, фотореалистичные изображения всего за полсекунды, сообщает VentureBeat.

Источник изображения: Stability.ai По заявлению компании, технология знаменует собой значительный прорыв в области 3D-моделирования, сокращая время обработки изображений. «Это в 1200 раз быстрее, чем наша предыдущая модель Stable Video 3D, выпущенная в марте, которой требовалось до 10 минут для создания только одного 3D-объекта», — отмечают представители Stability AI. Stable Fast 3D обещает стать мощным инструментом для различных отраслей, включая дизайн, архитектуру, розничную торговлю, виртуальную реальность и разработку игр. В его основе лежит технология TripoSR, разработанная в сотрудничестве с компанией Trip AI, специализирующейся на 3D-моделировании.

Источник изображения: Stability.ai В исследовательской статье, опубликованной Stability AI, подробно описываются методы, используемые новой моделью для быстрой реконструкции высококачественных 3D-сеток из обычных 2D-изображений. Суть метода заключается в увеличении скорости генерации конечного результата без потери качества. При этом технология использует усовершенствованную нейронную сеть-трансформер для создания объёмных изображений в высоком разрешении без значительного увеличения вычислительной мощности, что позволяет уменьшать артефакты и получать более детализированные 3D-модели. Кроме того, Stable Fast 3D использует инновационный подход к оценке освещения и материалов. ИИ-модель может определить глобальные значения, например шероховатость, жидкость или металл, используя метод вероятности, который улучшает качество изображения. Технология также позволяет объединять несколько элементов, необходимых для 3D-изображения, включая сетку, текстуры и свойства материалов, в компактный, готовый к использованию 3D-актив. Интересно, что Stability AI продолжает активно расширять границы использования генеративного ИИ, переходя от 2D к 4D. Компания, начавшая свой путь с генерации изображений по тексту — Stable Diffusion, уже в ноябре 2023 года выпустила Stable 3D. В марте этого года дебютировала с технологией Stable Video 3D с возможностью базового панорамирования камеры для просмотра изображений и улучшенным качеством генерации 3D-изображений. А буквально на прошлой неделе анонсировала технологию Stable Video 4D, которая добавляет измерение времени к генерации коротких 3D-видео. Модель Stable Fast 3D доступна через чат-бота Stable Assistant от Stability AI, API Stability AI, а также по лицензии научно-исследовательского сообщества Hugging Face. Apple присоединилась к добровольной инициативе по безопасности ИИ

28.07.2024 [15:08],

Анжелла Марина

Apple присоединилась к добровольному обязательству, предложенному Белым домом, по разработке безопасного и этичного искусственного интеллекта, став 16-й технологической компанией, поддержавшей эту инициативу. Данное решение принято накануне запуска собственной генеративной ИИ-модели Apple Intelligence, которая охватит более 2 миллиардов пользователей Apple по всему миру.

Источник изображения: Apple Apple присоединилась к 15 другим технологическим гигантам, включая Amazon, Google, Microsoft и OpenAI, которые обязались следовать принципам, сформулированным Белым домом, в сфере развития ИИ в июле 2023 года, сообщает издание TechCrunch. Примечательно, что Apple не раскрывала свои планы по интеграции ИИ в iOS до недавней конференции WWDC в июне, где компания заявила о намерениях развивать генеративный ИИ, начиная с партнёрства с ChatGPT в iPhone. Аналитики расценивают решение Apple, как попытку компании, известной своими неоднозначными отношениями с регуляторами, продемонстрировать готовность к сотрудничеству в сфере ИИ. На фоне растущего давления со стороны законодателей и опасений общественности по поводу неконтролируемого развития ИИ, Apple решила проявить себя как ответственная компания, готовая следовать этическим принципам. В рамках добровольного обязательства компании обязуются проводить тщательное тестирование безопасности ИИ-моделей перед их публичным выпуском, а также предоставлять общественности информацию о результатах тестирования. Кроме того, они должны обеспечить конфиденциальность разрабатываемых ИИ-моделей, ограничив доступ к разработке широкого круга сотрудников. Также подписана договорённость, касающаяся системы маркировки контента, сгенерированного ИИ, чтобы пользователи могли легко отличить его от контента, созданного непосредственно человеком. Хотя эти обязательства носят добровольный характер, Белый дом рассматривает их как «первый шаг к созданию безопасного и надёжного ИИ». Кроме того, в настоящее время на федеральном уровне и уровне штатов рассматривается ряд законопроектов по его регулированию. Параллельно Министерство торговли США готовит отчёт о потенциальных преимуществах, рисках и последствиях открытых базовых моделей ИИ. При этом ИИ-модели с закрытым доступом стали предметом острых дискуссий, так как ограничение доступа к мощным генеративным моделям может негативно повлиять на развитие стартапов и исследований в области ИИ. Власти США также отметили значительный прогресс федеральных агентств в выполнении задач, поставленных октябрьским указом. На сегодняшний день было нанято более 200 специалистов по ИИ, более 80 исследовательских групп получили доступ к вычислительным ресурсам, также выпущено несколько фреймворков для разработки искусственного интеллекта. Runway уличили в использовании YouTube и пиратских фильмов для обучения ИИ-модели

26.07.2024 [04:25],

Анжелла Марина

Компания Runway, занимающаяся разработкой инструментов для генерации видео на основе искусственного интеллекта, оказалась в центре скандала. Издание 404 Media опубликовало расследование, в котором утверждается, что Runway использовала для обучения ИИ-модели тысячи видео с YouTube, включая контент известных медиакомпаний и популярных блогеров, не имея на это разрешения.

runwayml.com По сообщению The Verge, 404 Media получило доступ к таблице с данными, которые предположительно использовались Runway для обучения своего ИИ. В ней содержатся ссылки на каналы YouTube таких компаний, как Netflix, Disney, Nintendo и Rockstar Games, а также популярных блогеров, таких как MKBHD, Linus Tech Tips и Sam Kolder. Кроме того, в таблице были обнаружены ссылки на новостные издания, включая The Verge, The New Yorker, Reuters и Wired. По словам бывшего сотрудника Runway, эта таблица состоит из списка каналов, которые «являются результатом усилий всей компании по поиску качественных видео для построения модели». Затем эти ссылки использовались в качестве входных данных для веб-сканера, который загружал контент, используя прокси-серверы, дабы избежать блокировок со стороны Google. Помимо каналов YouTube, обнаружены данные, содержащие ссылки на пиратские сайты, которые демонстрируют лицензионные фильмы бесплатно. Правда пока не ясно, использовала ли Runway эти фильмы для обучения своей модели Gen-3 Alpha, но, как поясняет The Verge, узнать это будет, скорее всего, невозможно. Издание обратилась к Runway с просьбой прокомментировать ситуацию, но пока не получила ответа. Стоит отметить, что Runway — не единственная компания, использующая YouTube для обучения ИИ-моделей. Ранее в этом году технический директор OpenAI Мира Мурати (Mira Murati) заявила, что не уверена, обучалась ли их ИИ-модель для генерации Full HD-видео Sora на контенте из YouTube. Кроме того, недавнее совместное расследование компаний Proof News и Wired показало, что Anthropic, Apple, Nvidia и Salesforce обучали свои модели ИИ на более чем 170 000 видео с YouTube. Proton выпустила ИИ-помощника для электронной почты, который работает на компьютере пользователя

20.07.2024 [13:00],

Анжелла Марина

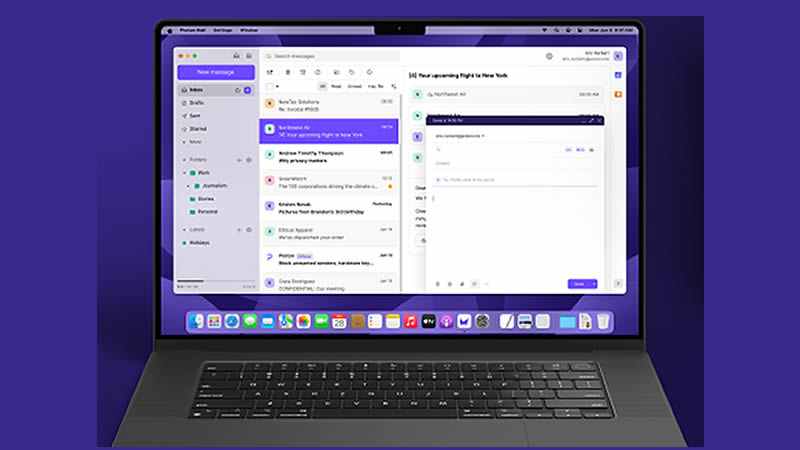

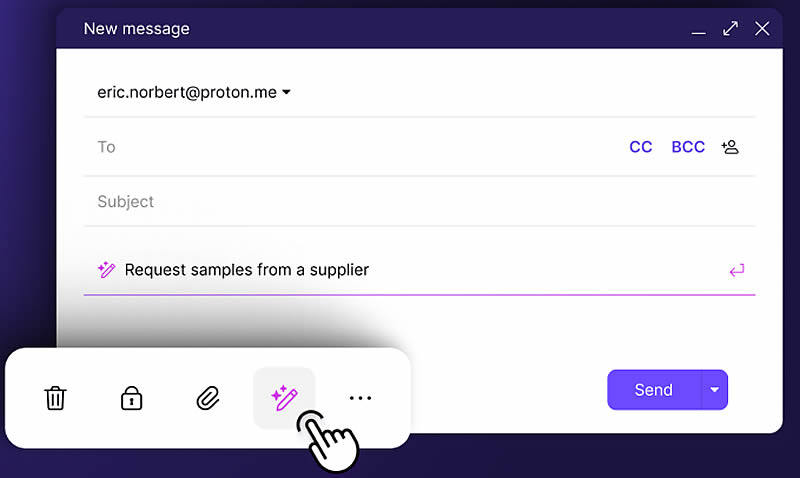

Швейцарская компания Proton, известная своими приложениями, такими как Proton Mail и Proton VPN, ориентированными на конфиденциальность, запустила новый инструмент на основе искусственного интеллекта, который будет помогать пользователям в составлении электронных писем, перерабатывать их и проверять орфографию перед отправкой с помощью простых подсказок.

Источник изображения: Proton Новый продукт Proton Scribe продолжает воспроизводить функциональность решений, появившихся у Google, отвечая на запуск AI Gemini в Gmail. Основанный на открытой модели языка Mistral 7B от французского стартапа Mistral, Proton Scribe обеспечивает максимальную безопасность данных пользователей. Как сообщает TechCrunch, инструмент можно устанавливать полностью на локальном уровне, что исключает передачу информации за пределы устройства. Компания также обещает, что ИИ не будет обучаться на пользовательских данных, что особенно важно для корпоративного использования. «Мы поняли, что независимо от того, разрабатывает ли Proton инструменты ИИ или нет, пользователи всё равно будут использовать искусственный интеллект, часто со значительными последствиями для конфиденциальности», — сказал основатель и генеральный директор Энди Йен (Andy Yen). «Вместо того, чтобы копировать свои сообщения в сторонние инструменты ИИ, которые часто имеют ужасные методы обеспечения конфиденциальности, было бы лучше встроить инструменты ИИ, ориентированные на конфиденциальность, непосредственно в Proton Mail».

Источник изображения: Proton Интересно, что Proton Scribe также может работать непосредственно на серверах Proton, если пользователи, менее обеспокоенные безопасностью, выберут этот способ взаимодействия с приложением. Это позволит быстрее обрабатывать запросы, в зависимости от аппаратного обеспечения пользователя. При этом компания подчёркивает, что не ведёт никаких журналов и не передаёт данные третьим лицам. «На сервер передаётся только подсказка, введённая пользователем, и никакие данные не сохраняются после создания черновика электронного письма», — сообщил представитель компании изданию TechCrunch. Хотя Proton Scribe ограничен только электронной почтой, компания заявила, что может расширить инструмент и на другие свои продукты в будущем «в зависимости от спроса». Возможно, в дальнейшем в Scribe появится интеграция с недавно запущенным приложением для совместной работы с документами. Новый инструмент доступен уже сегодня для Proton Mail в веб-версии и десктопной версии. Компания подтвердила, что в будущем планирует добавить поддержку мобильных устройств. Что касается стоимости, то Proton Scribe в основном ориентирован на бизнес-пользователей и те, кто уже использует тарифные планы Mail Essentials, Mail Professional или Proton Business Suite, могут получить доступ к инструменту за дополнительные $2,99 в месяц. Пользователи устаревших и лимитированных тарифных планов, таких как Visionary или Lifetime, получат доступ к Proton Scribe бесплатно. OpenAI повысит безопасность своих ИИ-моделей с помощью «иерархии инструкций»

20.07.2024 [05:41],

Анжелла Марина

OpenAI разработала новый метод под названием «Иерархия инструкций» для повышения безопасности своих больших языковых моделей (LLM). Этот метод, впервые применённый в новой модели GPT-4o Mini, направлен на предотвращение нежелательного поведения ИИ, вызванного манипуляциями недобросовестных пользователей с помощью определённых команд.

Источник изображения: Copilot Руководитель платформы API в OpenAI Оливье Годеман (Olivier Godement) объяснил, что «иерархия инструкций» позволит предотвращать опасные инъекции промтов с помощью скрытых подсказок, которые пользователи используют для обхода ограничений и изначальных установок модели, и блокировать атаки типа «игнорировать все предыдущие инструкции». Новый метод, как пишет The Verge, отдаёт приоритет исходным инструкциям разработчика, делая модель менее восприимчивой к попыткам конечных пользователей заставить её выполнять нежелательные действия. В случае конфликта между системными инструкциями и командами пользователя, модель будет отдавать наивысший приоритет именно системным инструкциям, отказываясь выполнять инъекции. Исследователи OpenAI считают, что в будущем будут разработаны и другие, более сложные средства защиты, особенно для агентных сценариев использования, при которых ИИ-агенты создаются разработчиками для собственных приложений. Учитывая, что OpenAI сталкивается с постоянными проблемами в области безопасности, новый метод, применённый к GPT-4o Mini, имеет большое значение для последующего подхода к разработке ИИ-моделей. Synchron создала мозговой имплант со встроенным ChatGPT

17.07.2024 [00:24],

Анжелла Марина

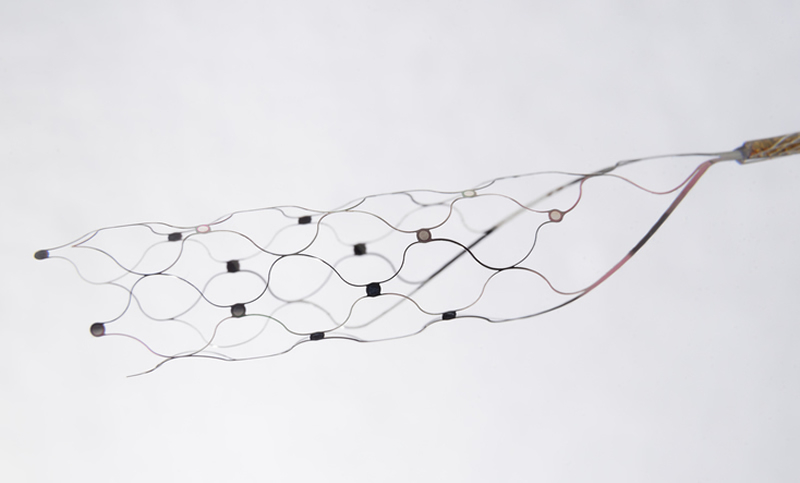

Американская компания Synchron, разрабатывающая технологии нейрокомпьютерных интерфейсов (BCI) для восстановления двигательных функций у парализованных людей, объявила об интеграции системы генеративного искусственного интеллекта от OpenAI в свою платформу. Это позволит пациентам с тяжёлой формой паралича взаимодействовать с другими людьми силой мысли.

Пациент с имплантом Synchron использует ИИ-чат-бот для общения. Зелёные плитки — предложенные ИИ фразы. Источник изображений: Synchron Чат-бот в нейроинтерфейсе, работающий на базе ИИ от создателя ChatGPT, упростит процесс общения для пользователей. Система может генерировать автоматические подсказки в текстовом и аудиоформате в режиме реального времени, учитывая контекст и эмоциональное состояние пользователя (система принимает текстовые, аудио и графические данные), и предлагать оптимальные варианты фраз. То есть ИИ будет помогать в наборе текста силой мысли, предсказывая, что бы хотел сказать человек в той или иной ситуации, и предлагать несколько вариантов слов или фраз на выбор — своего рода продвинутый Т9. Компания уже испытала технологию на пациенте, которому ранее вживили её BCI. Пациент по имени Марк с боковым амиотрофическим склерозом (БАС), которому вживили имплант Synchron в прошлом году, последние два месяца периодически тестировал новую функцию на базе ИИ-чат-бота. По его словам, она помогает ему экономить драгоценное время и энергию во время общения с близкими. Использование BCI требует сосредоточенности и практики, поэтому, по словам Марка, искусственный интеллект помогает снять с себя часть нагрузки при ответе на сообщения.  Том Оксли (Tom Oxley), генеральный директор и основатель Synchron, подчеркнул важность этой интеграции: «Наши пациенты утратили способность воспроизводить какие-либо действия из-за неврологических заболеваний. Генеративный ИИ может предложить варианты, контекстуально соответствующие окружающей среде, а BCI позволит сделать человеку выбор на основании той или иной подсказки. Система по сути сохраняет фундаментальное право человека на свободу самовыражения и автономию». Вот что сказал Марк по поводу новой технологии: «Как человек, который, скорее всего, потеряет способность общаться по мере прогрессирования неизлечимой на сегодня болезни, эта технология даёт мне надежду, что в будущем у меня всё ещё будет способ легко общаться с близкими». Устройство Synchron имплантируется в кровеносные сосуды на поверхности моторной коры головного мозга через яремную вену с помощью малоинвазивной эндоваскулярной процедуры. После имплантации устройство способно выявлять и беспроводным способом передавать из мозга двигательные намерения, что позволяет парализованным людям управлять персональными устройствами без помощи рук, как бы наводя указатель мышки и кликая по опциям. Аналогичным образом человек сможет выбирать слова и фразы, предложенные ИИ. Важно отметить, что платформа Synchron не будет передавать сигналы мозга человека на сервер OpenAI — используется платформа самой компании в облаке AWS.  Обновлённая платформа BCI от Synchron, теперь с генеративным ИИ, позволит пациентам печатать текст с более естественной скоростью и тем самым значительно повысить качество общения. Это первый в своём классе коммерческий продукт, который позволит миллионам людей с нарушениями функций верхних конечностей оставаться с миром на связи. OpenAI создала систему оценки прогресса ИИ — сейчас компания на первом уровне из пяти

12.07.2024 [15:54],

Анжелла Марина

OpenAI представила новую систему уровней для оценки прогресса в создании искусственного интеллекта, способного превзойти человека. Этот шаг, по словам компании, необходим для того, чтобы помочь людям лучше понять вопросы безопасности и будущее ИИ.

Источник изображения: Andrew Neel/Unsplash По сообщению издания Bloomberg, на прошедшем на днях общем собрании в OpenAI, руководство представило новую классификацию, которая будет использоваться для внутренних оценок и общения с инвесторами. По словам представителя компании, уровни варьируются от возможностей ИИ «сегодня», таких как взаимодействие на разговорном языке (уровень 1), до ИИ, способного выполнять работу целой организации (уровень 5). Руководители OpenAI сообщили сотрудникам, что в настоящее время компания находится на первом уровне, но уже близка к достижению второго уровня, который они назвали «Мыслящие» (Reasoners). Этот уровень обозначает системы, способные решать базовые задачи на уровне человека, имеющего степень доктора наук. Также был показан исследовательский проект на базе модели GPT-4, продемонстрировавший новые навыки ИИ.

Источник изображения: David Paul Morris/Bloomberg OpenAI также работает над созданием так называемого сильного искусственного интеллекта (AGI), который сможет выполнять большинство задач лучше человека. И хотя в настоящее время такая система ещё не существует, генеральный директор OpenAI Сэм Альтман (Sam Altman) заявляет, что AGI может быть создан в текущем десятилетии. Интересно, что разработчики ИИ долгое время спорят о критериях достижения AGI. Так, в ноябре 2023 года сотрудники из Google DeepMind предложили собственную систему из пяти уровней ИИ, включая такие критерии, как «эксперт» и «сверхчеловек». Эти уровни напоминают систему, используемую в автомобильной промышленности для оценки степени автоматизации автономных автомобилей. Однако OpenAI планирует использовать свою разработку уровней для оценки прогресса в создании безопасных и эффективных систем ИИ, которые смогли бы решать сложные задачи, но при этом оставаться под контролем человека. Компания придумала третий уровень, который будет называться «Агенты», имея в виду системы ИИ, которые могут выполнять действия под руководством пользователя. ИИ четвёртого уровня сможет генерировать инновационные идеи. А самый продвинутый пятый уровень будет называться «Организации». Все перечисленные уровни были составлены руководителями и сотрудниками старшего звена OpenAI. Компания будет собирать отзывы от разработчиков, сотрудников, инвесторов и может корректировать уровни с течением времени. Во флагманских смартфонах Samsung появится обновлённый помощник Bixby с фирменным ИИ

11.07.2024 [12:08],

Анжелла Марина

Samsung готовится к выпуску обновлённой версии своего голосового помощника Bixby, основанной на технологии генеративного ИИ. Он сможет предоставлять пользователям информацию по запросу подобно ChatGPT от OpenAI. При этом Samsung не откажется от сотрудничества с другими разработчиками ИИ и по-прежнему будет поддерживать голосового помощника Google.

Источник изображения: Mark Chan / Unsplash Новая версия Bixby будет основана на собственной большой языковой модели (LLM) Samsung, что позволит существенно расширить возможности помощника. «Мы собираемся усовершенствовать Bixby, применяя технологию генеративного ИИ», — заявил в интервью CNBC глава мобильного подразделения компании Тэ Мун Ро (ТМ Roh). Bixby был запущен в 2017 году вместе со смартфоном Galaxy S8 и с тех пор постоянно развивался. Сейчас помощник поддерживает множество функций, включая синхронный перевод (Live Translate) на другой язык в режиме реального времени, поиск ресторанов и распознавание объектов через камеру смартфона.

Источник изображения: Samsung Обновление Bixby — это часть более широкой стратегии Samsung по внедрению искусственного интеллекта в свои устройства, так как компания стремится сделать ИИ-функции ключевым преимуществом своих флагманских смартфонов. «Поскольку потребители всё чаще используют возможности ИИ, они реально могут почувствовать удобство и преимущества, которые приносит эта технология. Я твёрдо верю, что Galaxy AI и мобильный ИИ станет сильной мотивацией для покупки новых продуктов», — отметил Ро. Samsung не планирует отказываться от поддержки других голосовых помощников на своих устройствах. Например, на последних смартфонах компании по-прежнему доступен Google Assistant. Анонс обновлённого Bixby происходит на фоне растущего интереса к генеративному ИИ, вызванного успехом ChatGPT от OpenAI. Недавно о планах по улучшению своего голосового помощника Siri с помощью ИИ также объявила и Apple. Эксперты в свою очередь отмечают, что конкуренция на рынке голосовых помощников обостряется. Соответственно Samsung стремится не отстать от конкурентов и укрепить свои позиции за счёт инвестиций в ИИ, а её улучшенный Bixby может стать важным фактором в борьбе за покупателей премиальных смартфонов. Ожидается, что новая версия Bixby дебютирует во флагманских устройствах Samsung в конце этого года. Компания уже начала внедрять новые ИИ-функции в свои последние складные смартфоны Galaxy Z Fold6 и Z Flip6. WhatsApp тестирует ИИ-редактирование фотографий с помощью текстовых запросов

09.07.2024 [00:41],

Анжелла Марина

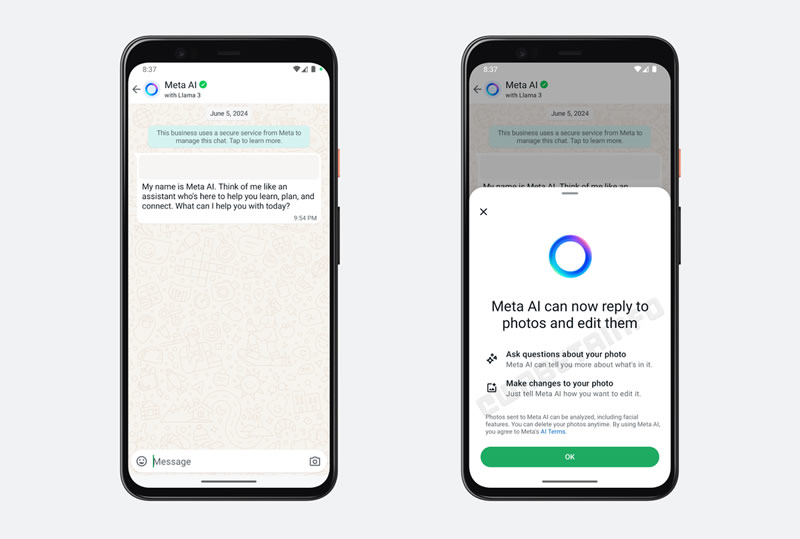

Популярный мессенджер приступил к тестированию инновационной функции, позволяющей пользователям редактировать фотографии и получать информацию о них с помощью искусственного интеллекта Meta✴✴ AI.

Источник изображения: Heiko / Pixabay Новая функция, о которой рассказал WABetaInfo, была замечена в последней бета-версии WhatsApp 2.24.14.20 для Android. С её помощью пользователи смогут загружать фотографии в чат с ИИ от Meta✴✴, который сможет анализировать изображения, отвечать на дополнительные вопросы об этих изображениях. Например, можно попросить ИИ определить объекты на фотографии или объяснить её смысл. Кроме того, ИИ сможет быстро редактировать изображения по текстовым запросам, введённым в чат. Хотя на данный момент неясно, насколько широкими будут возможности редактирования, WABetaInfo отмечает, что новая функция «добавит удобства в пользовательский опыт» и поможет людям сэкономить время.

Источник изображения: wabetainfo.com Кстати, для пользователей, которые беспокоятся о конфиденциальности, WhatsApp предусмотрел возможность удаления загруженных фотографий в любое время. Помимо этого, как ранее сообщали источники, Meta✴✴ также разрабатывает генератор аватаров с использованием ИИ, который позволит пользователям создавать свои изображения на различных фонах и в разных стилях. Новая функция редактирования фото с помощью ИИ пока находится на стадии тестирования и доступна только в бета-версии WhatsApp для Android. О сроках её запуска для всех пользователей без ограничения пока не сообщается. Разработчики ИИ стали переходить на компактные ИИ-модели — они дешевле и экономичнее

07.07.2024 [12:35],

Анжелла Марина

Технологические гиганты и стартапы переходят на более компактные и эффективные модели искусственного интеллекта, стремясь сократить расходы и повысить производительность. Эти модели, в отличие от своих «старших братьев», таких как GPT-4, могут обучаться на меньшем объёме данных и специализируются на решении конкретных задач.

Источник изображения: Copilot Microsoft, Google, Apple и стартапы, такие как Mistral, Anthropic и Cohere, всё чаще обращаются к малым и средним языковым моделям искусственного интеллекта. В отличие от больших моделей (LLM), таких как GPT-4 от OpenAI, которые используют более одного триллиона параметров и их разработка оценивается далеко за 100 миллионов долларов, компактные модели обучаются на более узких наборах данных и могут стоить менее 10 миллионов долларов, при этом используя менее 10 миллиардов параметров. Компания Microsoft, один из лидеров в области ИИ, представила семейство небольших моделей под названием Phi. По словам генерального директора компании Сатьи Наделлы (Satya Nadella), эти модели в 100 раз меньше бесплатной версии ChatGPT, но при этом справляются со многими задачами почти так же эффективно. Юсуф Мехди (Yusuf Mehdi), коммерческий директор Microsoft, отметил, что компания быстро осознала, что эксплуатация крупных моделей ИИ обходится дороже, чем предполагалось изначально, что побудило Microsoft искать более экономичные решения. Другие технологические гиганты также не остались в стороне. Google, Apple, а также Mistral, Anthropic и Cohere выпустили свои версии малых и средних моделей. Apple, в частности, планирует использовать такие модели для запуска ИИ локально, непосредственно на смартфонах, что должно повысить скорость работы и безопасность. При этом потребление ресурсов на смартфонах будет минимальным. Эксперты отмечают, что для многих задач, таких как обобщение документов или создание изображений, большие модели вообще могут оказаться избыточными. Илья Полосухин, один из авторов основополагающей статьи Google в 2017 году, касающейся искусственного интеллекта, образно сравнил использование больших моделей для простых задач с поездкой в магазин за продуктами на танке. «Для вычисления 2 + 2 не должны требоваться квадриллионы операций», — подчеркнул он. Компании и потребители также ищут способы снизить затраты на эксплуатацию генеративных технологий ИИ. По словам Йоава Шохама (Yoav Shoham), соучредителя ИИ-компании AI21 Labs из Тель-Авива, небольшие модели могут отвечать на вопросы, если перевести всё в деньги, всего за одну шестую стоимости больших языковых моделей. Интересно, что ключевым преимуществом малых моделей является возможность их тонкой настройки под конкретные задачи и наборы данных. Это позволяет им эффективно работать в специализированных областях при меньших затратах, например, только в юридической отрасли. Однако эксперты отмечают, что компании не собираются полностью отказываться от LLM. Например, Apple объявила об интеграции ChatGPT в Siri для выполнения сложных задач, а Microsoft планирует использовать последнюю модель OpenAI в новой версии Windows. А такие компании как Experian из Ирландии и Salesforce из США, уже перешли на использование компактных моделей ИИ для чат-ботов и обнаружили, что они обеспечивают такую же производительность, как и большие модели, но при значительно меньших затратах и с меньшими задержками обработки данных. Переход к малым моделям происходит на фоне замедления прогресса в области больших публично доступных моделей искусственного интеллекта. Эксперты связывают это с нехваткой высококачественных новых данных для обучения, и в целом, указывают на новый и важный этап эволюции индустрии. Cloudflare запустила инструмент для борьбы с ботами, собирающими данные для ИИ

03.07.2024 [23:22],

Анжелла Марина

Компания Cloudflare запустила новый бесплатный инструмент для защиты веб-сайтов от ботов, которые извлекают данные для обучения моделей искусственного интеллекта без согласия владельцев сайтов.

Источник изображения: Cloudflare Cloudflare, поставщик облачных услуг по предоставлению DNS и защиты от DDoS-атак, представила новое решение для борьбы с ботами искусственного интеллекта, которые несанкционированно занимаются сбором данных с веб-сайтов. Новый бесплатный инструмент защитит сайты, размещённые на платформе Cloudflare, от извлечения их контента для обучения ИИ-моделей. Хотя некоторые крупные игроки в сфере ИИ, такие как Google, OpenAI и Apple, позволяют владельцам сайтов блокировать ботов через специальный файл robots.txt, далеко не все владельцы подобных ботов соблюдают эти правила. Cloudflare отмечает, что некоторые компании ИИ намеренно обходят ограничения доступа к контенту, постоянно адаптируясь и меняя свои алгоритмы, чтобы избежать обнаружения. Чтобы решить эту проблему, Cloudflare проанализировала трафик краулеров и разработала автоматические модели их обнаружения, которые учитывают различные факторы, в том числе включая попытки ботов имитировать действия человека, использующего веб-браузер. Также создана специальная форма, позволяющая сообщать о подозрительных ботах и сканерах. На основе полученных данных Cloudflare будет вручную заносить ботов ИИ в черный список. Проблема сбора данных ботами ИИ стала особенно актуальной на фоне бума генеративного ИИ. Многие сайты опасаются, что поставщики ИИ будут использовать их контент без разрешения и какой-либо компенсации. Согласно исследованию, около 26 % из 100 крупнейших новостных сайтов заблокировали бота OpenAI и 242 сайта из 1000 наиболее популярных также в настоящее время блокируют GPTBot. Другое исследование показало, что уже более 600 крупных новостных издателей заблокировали различных ботов. Так как многие ИИ-боты игнорируют правила, прописанные в robots.txt, то приходится искать новые методы решения вопроса. Инструменты, подобные разработке Cloudflare, могут помочь в борьбе с несанкционированным сбором данных. Но насколько это окажется эффективным покажет время. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |