|

Опрос

|

реклама

Быстрый переход

OpenAI забронировала 1,6-нм мощности TSMC для выпуска передовых ИИ-чипов

03.09.2024 [10:11],

Алексей Разин

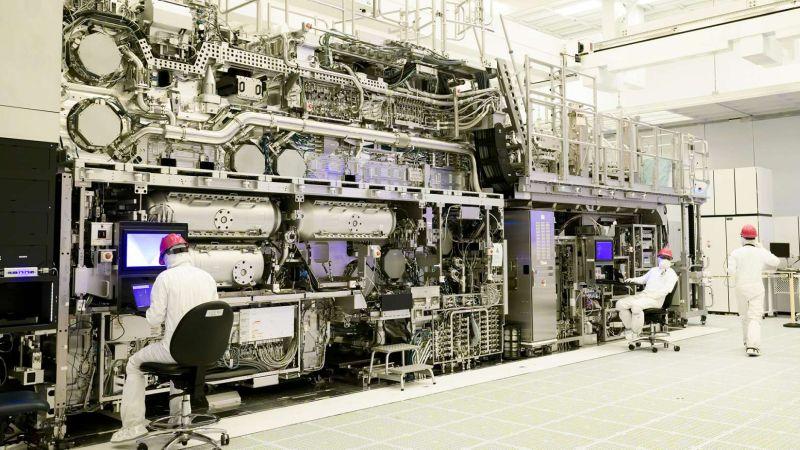

Многие источники не раз упоминали о наличии у стартапа OpenAI амбиций по организации если не производства чипов для ускорителей вычислений, то хотя бы их разработки. По данным тайваньских СМИ, среди клиентов TSMC на передовой 1,6-нм техпроцесс A16 как раз может оказаться компания OpenAI, которая к моменту его освоения надеется располагать готовым проектом собственного чипа.

Источник изображения: Intel Во всяком случае, об этом сообщает издание Economic Daily News. Основным заказчиком выпускаемых TSMC по технологии A16 чипов должна оказаться всё же Apple, по уже сложившейся практике и благодаря наличию у последней потребности в совершенствовании собственных мобильных процессоров. Освоить техпроцесс A16 компания TSMC рассчитывает в 2026 году, но обсуждать свои взаимоотношения с заказчиками публично она традиционно отказывается. По данным тайваньских источников, OpenAI активно обсуждала с TSMC возможность создания специализированной фабрики исключительно под её нужды. Однако после оценки потенциальных преимуществ план создания специализированного предприятия был отложен. Разработку чипов для OpenAI ведут такие американские компании, как Broadcom и Marvell Technology, в случае с первой из них OpenAI даже может оказаться в числе её четырёх крупнейших клиентов. К слову, первые чипы OpenAI могут выпускаться TSMC по более зрелому 3-нм техпроцессу, а выбор технологии A16 уже сделан для последующих поколений. Как отмечала TSMC ранее, 1,6-нм техпроцесс A16 по сравнению с ближайшим предшественником 2-нм N2P обеспечивает увеличение скорости переключения транзисторов на 8–10 % при неизменном напряжении, либо снижает энергопотребление на 15–20 % при том же уровне быстродействия. Плотность размещения транзисторов при этом удаётся увеличить на 10 %. Новая статья: Практикум по ИИ-рисованию, часть десятая: да будет FLUX!

03.09.2024 [00:05],

3DNews Team

Данные берутся из публикации Практикум по ИИ-рисованию, часть десятая: да будет FLUX! В Windows 11 появится ИИ-функция поиска по аудио- и видеозаписям

01.09.2024 [23:09],

Владимир Фетисов

В сборке Windows 11 под номером 27695, которая недавно стала доступна участникам программы предварительной оценки Windows Insider на канале Canary, появились упоминания функции «интеллектуального поиска мультимедиа». Этот инструмент задействует работающий локально ИИ-алгоритм для сканирования всех слов, которые есть в аудио- и видеозаписях, которые хранятся на устройстве пользователя.

Источник изображения: Microsoft Функция интеллектуального поиска мультимедиа описывается как инструмент, который расшифровывает все аудиофайлы и видео на пользовательском компьютере. В дальнейшем пользователь сможет задействовать поиск в Windows для того, чтобы отыскать на устройстве аудио или видео по словам, содержащимся в записи. По данным источника, в настоящее время данный инструмент недоступен ни в одной тестовой сборке Windows 11. Однако появление упоминаний новой функции указывает на то, что вскоре интеллектуальный поиск мультимедиа может стать доступен инсайдерам. «Поиск по произнесённым словам в проиндексированных аудио- и видеофайлах. Нажимая «Я согласен», вы соглашаетесь на сканирование медиафайлов, хранящихся на вашем устройстве. При необходимости нужная модель будет загружена и установлена в фоновом режиме. После настройки ИИ-модели ей необходимо расшифровать ваши медиафайлы и проиндексировать их, прежде чем они будут добавлены в поиск по контенту. Мы сообщим вам, как только процесс настройки завершится», — говорится в описании функции интеллектуального поиска мультимедиа. Похоже, что новая функция тесно связана с функцией Recall, которая станет доступна инсайдерам в октябре. Recall задействует работающие локально ИИ-алгоритмы для регистрации всех действий пользователя в приложениях, при просмотре веб-контента и др. Собранные таким образом данные отображаются на временной шкале, что позволяет пользователю легко найти интересующую его информацию из прошлого и продолжить взаимодействие с ней. Для работы Recall потребуется наличие компьютера с Windows 11 и производительным процессором со встроенным нейронным сопроцессором (NPU) для ускорения выполнения задач искусственного интеллекта. В российские ПК с ИИ производства «Гравитон» попали процессоры AMD Ryzen 8000

01.09.2024 [18:37],

Владимир Мироненко

Российский производитель электроники «Гравитон» представил новые настольные ПК Д31А и Д51А с поддержкой ИИ, основанные на передовых процессорах AMD с технологией Ryzen AI на архитектуре Zen 4 и разъёмом АМ5 — Ryzen 5 8600G, Ryzen 7 8700F и Ryzen 7 8700G. Новинки будут включены в реестр российской промышленной продукции Минпромторга России в следующем квартале.  Процессоры Ryzen 5 8600G, Ryzen 7 8700F и Ryzen 7 8700G включают ИИ-сопроцессор NPU, построенный на архитектуре XDNA с производительностью на уровне 16 TOPS, предназначенный для максимально эффективной обработки данных. Как сообщает «Гравитон», ПК Д31А и Д51А на базе новых процессоров позволяют запускать ИИ-интерфейсы на локальных компьютерах и ускоряют приложения, опирающиеся на алгоритмы ИИ. Например, с их помощью ускоряется работа виртуальных помощников, редакторов изображений и видео — в том числе в режиме реального времени, включая видеоконференции. С развитием ПО с поддержкой алгоритмов ИИ, функциональность клиентских решений «Гравитон» с интегрированным ИИ будет расширяться. Д31А и Д51А предлагаются с оперативной памятью DDR5, поддерживают шину PCI Express 4-го поколения и имеют ряд портов и видеовыходов для подключения внешних устройств. ИИ-функции в приложениях Meta✴ ежемесячно используют 400 млн человек

01.09.2024 [17:32],

Владимир Фетисов

Инструменты на основе искусственного интеллекта компании Meta✴✴ Platforms, доступные в Facebook✴✴, Instagram✴✴, WhatsApp и Threads, используют не менее 400 млн человек в месяц и 40 млн человек ежедневно. Об этом пишет издание The Information со ссылкой на данные, полученные от двух осведомлённых сотрудников Meta✴✴.

Источник изображения: Growtika/unsplash.com Информация о количестве пользователей ИИ-функций Meta✴✴ появилась вскоре после того, как стало известно, что с ИИ-ботом ChatGPT компании OpenAI еженедельно взаимодействуют более 200 млн человек. В OpenAI позднее подтвердили эту информацию. Это означает, что поддерживаемая Microsoft компания нарастила пользовательскую базу на 100 млн человек менее чем за год. Несмотря на это, данные по количеству пользователей указывают, что Meta✴✴ остаётся полноценным конкурентом OpenAI в сфере предоставления услуг на основе генеративных нейросетей. Что касается Meta✴✴, то компания Марка Цукерберга (Mark Zuckerberg) выбрала подход, отличный от того, как работает OpenAI. Разработчики из Meta✴✴ выпустили на рынок несколько больших языковых моделей Llama с открытым исходным кодом, которые разработчики могут настраивать в соответствии с собственными потребностями. Напомним, ИИ-алгоритмы Meta✴✴ можно задействовать для помощи в написании и редактировании текстов, а также генерации изображений по текстовому описанию. Они доступны во многих пользовательских приложениях Meta✴✴, включая Facebook✴✴ и Instagram✴✴. OpenAI обсуждает возможность изменения организационной структуры ради привлечения инвесторов

01.09.2024 [07:47],

Алексей Разин

Стартап OpenAI имеет достаточно необычную для компаний, старающихся привлечь средства инвесторов, организационную структуру. Бизнесом руководит некоммерческая организация с собственным советом директоров, а коммерческое подразделение привлекает средства акционеров, но не гарантирует им получение прибыли. При нынешних масштабах бизнеса подобное несоответствие отпугивает инвесторов.

Источник изображения: OpenAI Как сообщает Financial Times, руководство OpenAI сейчас обсуждает возможность преобразования собственной организационной структуры ради повышения привлекательности для инвесторов. С 2019 года Microsoft вложила в OpenAI около $13 млрд, и это всего лишь позволяет ей претендовать на получение 49 % прибыли стартапа, а фактически влиять на принимаемые советом директоров решения ключевой инвестор до сих пор не может. Высокие расходы на развитие бизнеса не позволяют рассчитывать на регулярное получение прибыли инвесторами, и фактически все принимаемые от инвесторов средства юридически оформляются OpenAI как добровольные взносы в капитал. Одна из обсуждаемых идей подразумевает снятие ограничений на размер прибыли, получаемой инвесторами OpenAI. Представители компании эти слухи комментировать не стали, но пояснили, что «некоммерческая суть является основой нашей миссии, и она будет сохранена». Участники переговоров на условиях анонимности подчёркивают, что переход к более традиционной схеме инвестирования мог бы привлечь к бизнесу компании больше финансовых ресурсов. У OpenAI появляется всё больше конкурентов с более доступными и эффективными ИИ-моделями

31.08.2024 [15:32],

Владимир Мироненко

Недавно стало известно о планах Apple и Nvidia присоединиться к Microsoft в числе инвесторов компании OpenAI, разработчика чат-бота ChatGPT с генеративным ИИ. Сообщившая об этом газета The Wall Street Journal (WSJ) предупредила о рисках этих инвестиций, поскольку OpenAI придётся столкнуться с более жёсткой чем когда-либо конкуренцией на рынке ИИ.

Источник изображения: Franz26/Pixabay По словам WSJ, угроза исходит со стороны других стартапов, предлагающих услуги по более низким ценам, а также собственные ИИ-модели, более эффективные в решении более узких задач. В частности, компания Meta✴✴ Platforms видит перспективы в новом поколении стартапов ИИ. Её гендиректор Марк Цукерберг (Mark Zuckerberg) позиционирует свою компанию как заступника простых людей, предлагая бесплатно сторонним разработчикам для использования передовую ИИ-модель Llama. Google также выпустила ИИ-модель с открытым исходным кодом. В отличие от них, OpenAI взимает плату с конечных пользователей и компаний за доступ к своим самым мощным ИИ-моделям. Многие эксперты считают, что в конечном итоге пользователи будут полагаться на различные ИИ-модели — некоторые от поставщиков ПО с закрытым кодом, таких как OpenAI, другие на модели с открытым исходным кодом от их конкурентов, интересы которых отстаивает Цукерберг. Тем временем ИИ с открытым исходным кодом уже догоняет по эффективности решения первопроходцев на рынке ИИ, особенно в повседневных бизнес-применениях, которые требуют стабильной производительности и низких затрат. Meta✴✴ на этой неделе объявила, что версии ИИ-модели Llama были загружены почти 350 млн раз разработчиками ПО и пользователями, что в 10 раз больше, чем год назад. В свою очередь, OpenAI утверждает, что у сервиса ChatGPT сейчас 200 млн еженедельно активных пользователей. По словам Жюльена Лоне (Julien Launay), главы стартапа Adaptive ML, для многих повседневных целей ИИ-модели, обученные для выполнения только определённых задач, будут лучше и дешевле в использовании. Стартап Adaptive ML использует модель Llama для обучения небольших, настраиваемых ИИ-моделей для компаний. Их гораздо легче настраивать, чем гигантские, закрытые ИИ, такие как ChatGPT, говорит Лоне. И число пользователей таких моделей растёт. Например, такие компании, как DoorDash, Shopify, Goldman Sachs и Zoom, заявили, что используют ИИ с открытым исходным кодом для различных задач, начиная с обслуживания клиентов и заканчивая подведением итогов совещаний. Ещё один пример — Procore Technologies, разработчик платформы для управления сложными строительными проектами. В начале этого года Procore впервые запустила функции, использующие большие языковые модели, полагаясь на ChatGPT OpenAI с доступом через облачную платформу Microsoft. Затем Procore создала ПО, которое упрощает использование практически любого ИИ во всей её системе. И надобность в сервисе ChatGPT OpenAI отпала. В подобных случаях удержание клиентов может стать проблемой для OpenAI. Большинство компаний не хотят быть привязанными к одному поставщику ИИ, и, по крайней мере, сейчас переключение между провайдерами услуг ИИ не составляет труда. Это делает ИИ-модели OpenAI конкурентами ИИ-решений, которые клиенты стартапа теперь могут разрабатывать самостоятельно. В свою очередь, представитель OpenAI высказал мнение, что конкуренция со стороны ИИ с открытым исходным кодом увеличивает количество специалистов, которые знают, как использовать ИИ, что также приводит к росту спроса на услуги OpenAI. Когда вопрос касается проблем безопасности, то мнения тоже резко отличаются. Сторонники закрытых систем говорят, что у них есть ресурсы и контроль, чтобы помочь предотвратить нецелевое использование технологии, и что инструментами с открытым исходным кодом могут воспользоваться злоумышленники. В свою очередь, сторонники решений с открытым исходным кодом наставивают на том, что в их системах проще обнаруживать проблемы и справляться с непреднамеренным вредом, который было бы трудно обнаружить в закрытых системах, поскольку они доступны для контроля общественности. Переосмысленная Amazon Alexa будет использовать ИИ-модели Anthropic Claude и станет платной

30.08.2024 [16:54],

Владимир Мироненко

Готовящаяся к выходу новая версия голосового помощника Alexa, получившая в компании названия Remarkable Alexa и Project Banyan, будет использовать ИИ-модели Claude от Anthropic, а не собственные ИИ-технологии Amazon, пишет Reuters со ссылкой на информированные источники. Как ожидается, Alexa 2 выйдет в октябре, а превью сервиса представят в сентябре на ежегодном мероприятии Amazon.

Источник изображений: aboutamazon.com По словам одного из источников, первым версиям обновлённого помощника Alexa на базе собственных ИИ-технологий Amazon, иногда требовалось шесть или семь секунд, чтобы подтвердить получение запроса и ответить. Поэтому Amazon решила использовать Claude, чат-бот на основе ИИ стартапа Anthropic, который показал себя лучше, чем собственные ИИ-модели компании. Нынешняя версия Alexa позволяет устанавливать таймеры, воспроизводить музыку, выступать в качестве центрального узла для управления умным домом и отвечать на вопросы. Вместе с тем попытки Amazon убедить пользователей совершать с помощью голосового помощника покупки, что позволило бы увеличить доход, не увенчались успехом, и подразделение по разработке Alexa остаётся убыточным. В отличие от нынешней бесплатной версии голосового помощника, Remarkable Alexa будет доступен по подписке стоимостью от $5 до $10 в месяц. Платная версия Alexa будет предлагать более продвинутые функции, включая ведение разговоров, основанных на предыдущих вопросах и ответах. Она также будет давать советы по покупкам, собирать новости и выполнять более сложные запросы, такие как заказ еды или составление писем. Кроме того, новая Alexa будет служить центром домашней автоматизации, запоминая предпочтения клиентов и выполняя такие задачи, как установка будильника или запись любимых телешоу. Сотрудники Amazon выражают сомнение по поводу готовности клиентов платить от $60 до $120 в год за услугу, которая сейчас бесплатна. Тем не менее Amazon стремится показать потенциал Alexa в получении доходов и делает ставку на обновлённую версию умного помощника как ключевую стратегию для достижения этой цели. Amazon не раскрывает количество активных пользователей Alexa. По данным аналитика Bank of America Джастина Поста (Justin Post), аудитория Alexa составляет около 100 млн человек. Согласно прогнозу аналитика, около 10 % пользователей может выбрать платную версию Alexa, что означает для компании не менее $600 млн дополнительного годового дохода. Чистая прибыль Dell взлетела на 85 % на фоне ИИ-бума

30.08.2024 [11:57],

Алексей Разин

На этой неделе о результатах фискального квартала отчиталась компания Dell, которая продолжает оставаться крупным игроком как на рынке серверных систем, так и в сегменте ПК. Совокупная выручка компании выросла на 9 % до $25,06 млрд и превзошла ожидания рынка, а в серверном сегменте она последовательно увеличилась сразу на 82 % до $3,2 млрд. Если быть точнее, данную сумму Dell выручила на реализации серверов для систем искусственного интеллекта.

Источник изображения: Dell Удельный доход Dell на одну акцию тоже оказался выше ожиданий инвесторов: $1,89 против $1,71. Чистая прибыль компании выросла на 85 % до $841 млн. Прогноз по годовой выручке Dell несколько улучшила до диапазона от $95,5 млрд до $98,5 млрд. В прошлом году она выручила $88,4 млрд, так что динамика выручки обещает быть приятной для инвесторов. В текущем квартале Dell рассчитывает выручить от $24 млрд до $25 млрд, что примерно соответствует ожиданиям рынка. Эта компания вошла в число крупнейших поставщиков серверного оборудования для систем искусственного интеллекта, как сообщает CNBC, поэтому по сравнению с аналогичным кварталом прошлого года её выручка в минувшем отчётном периоде выросла сразу с $1,7 млрд до $3,2 млрд в последовательном сравнении. После закрытия торгов накануне публикации квартального отчёта акции Dell выросли в цене на 3 %, всего с начала года они поднялись на 48 %. В целом инфраструктурное подразделение, которое и занимается поставками серверного оборудования, увеличило свою выручку на 38 % до $11,65 млрд и превзошло ожидания рынка. Серверное оборудование и телекоммуникационные решения принесли Dell в прошлом квартале $7,76 млрд, выручка на этом направлении выросла в годовом сравнении на 80 %. Другими словами, в серверном сегменте в целом Dell получает чуть менее половины одной трети своей выручки. Но к системам для ИИ по итогам квартала относились лишь $3,2 млрд выручки. Компания уже располагает заказами на ИИ-серверы на общую сумму $3,8 млрд, которые только предстоит выполнить. Впрочем, не всё так безоблачно в серверном бизнесе в целом, поскольку на направлении систем хранения данных выручка Dell сократилась на 4 % до $4 млрд. Клиентское направление бизнеса принесло компании только $12,41 млрд выручки по итогам прошлого квартала, это на 4 % меньше прошлогоднего результата. В корпоративном сегменте реализация ПК принесла Dell стабильность по сравнению с прошлым годом (на уровне $10,55 млрд), а вот в потребительском выручка сократилась сразу на 22 % до $1,86 млрд. Google готовит ИИ, способный на слух распознавать простуду и другие болезни

30.08.2024 [10:50],

Павел Котов

Компания Google решила расширить возможности современных систем искусственного интеллекта — сейчас компания работает над технологией, которая поможет обнаруживать ранние признаки заболеваний по звукам, издаваемым человеком.

Источник изображения: pixabay.com Для достижения этой цели Google обучила базовую модель ИИ на 300 млн фрагментов аудиозаписей, на которых звучат кашель, признаки насморка и затруднённое дыхание — эти исходные данные помогут идентифицировать человека, который болен, например, туберкулёзом, передаёт Bloomberg. Модель получила название HeAR (Health Acoustic Representations). Поисковый гигант также объединил усилия с индийской компанией Salcit Technologies. Стартап, специализирующийся на технологиях ИИ в области респираторных заболеваний поможет развернуть эту технологию на смартфонах — она поможет гражданам, принадлежащим к группам высокого риска, в регионах с недостаточным доступом к услугам здравоохранения. Это не первая попытка Google найти цифровое выражение органов человеческих чувств. Профильное подразделение компании ранее поддержало стартап, который разрабатывает ИИ, способный идентифицировать заболевания по запаху. Acer: через год 40 % поставляемых ПК будут соответствовать Copilot+ PC

30.08.2024 [10:30],

Алексей Разин

Производители ПК с энтузиазмом оценивают перспективы выхода на рынок моделей, соответствующих требованиям Copilot+ PC, которые позволяют ускорять работу систем искусственного интеллекта на локальном уровне. Компания Acer ожидает, что уже в третьем квартале 2025 года такие компьютеры будут составлять до 40 % отгружаемой ею продукции.

Источник изображения: Acer Даже при отсутствии соединения с интернетом такие ПК будут способны генерировать изображения по текстовому описанию или переводить речь с одного языка на другой в масштабе реального времени. Acer собирается выделить свою продукцию семейства Copilot+ PC на фоне конкурентов, оснастив свои компьютеры такого класса дополнительными функциональными клавишами. В области тачпэда появится индикатор активности, который будет подсвечиваться при использовании специализированного сопроцессора для обработки команд ИИ. Acer собирается выпускать компьютеры Copilot+ PC, оснащаемые процессорами всех разработчиков, одобренных для этого семейства систем компанией Microsoft, как признался в интервью Nikkei генеральный директор тайваньского производителя Джейсон Чэнь (Jason Chen). Помимо Qualcomm, поставлять совместимые процессоры собираются Intel и AMD. В Японии первые ноутбуки с поддержкой данных функций сейчас предлагаются по цене $1800, их доля не превышает пары процентов в структуре поставок продукции Acer. В первую очередь объёмы поставок Copilot+ PC компания собирается наращивать в корпоративном сегменте, через год их доля должна будет вырасти до 40 %. Напомним, что конкурирующая Lenovo в этом году рассчитывает приблизить такой показатель к 10 %, а в 2026 году покорить рубеж в 50 или 60 %. Центральные процессоры для Copilot+ PC в следующем году подешевеют, как считает руководство Acer, и это позволит увеличить объёмы поставок соответствующих ПК. По прогнозам Gartner, рынок ПК в целом по итогам текущего года вырастет на 4 % до 250,4 млн штук. В Gmail встроили ИИ, который будет читать все ваши письма — это облегчит работу с почтой

30.08.2024 [07:36],

Анжелла Марина

Google меняет подход к поиску информации в Gmail. Вместо того чтобы искать письма вручную, пользователи смогут задавать вопросы чат-боту Gemini, который проанализирует всю почту и предоставит нужные данные. Новая функция, получившая название Gmail Q&A, будет пока доступна на устройствах под управлением Android, сообщил TechCrunch.

Источник изображения: Solen Feyissa/Unsplash Gmail Q&A позволяет взаимодействовать с искусственным интеллектом Google Gemini непосредственно в приложении Gmail, используя его как персонального помощника для работы с электронной почтой. Gemini может анализировать весь почтовый ящик пользователя и выполнять различные задачи, например, предоставлять краткие обзоры писем по определённой теме или искать конкретную информацию в переписке. Например, можно попросить Gemini «ввести в курс дела по письмам о квартальном планировании» или узнать, «сколько компания потратила средств на последнее маркетинговое мероприятие». Однако, как и другие ИИ-модели, Gemini может допускать ошибки и неточности, поэтому рекомендуется проверять данные, которые он предоставляет. Традиционно, чтобы найти информацию в Gmail, надо было использовать строку поиска. Сейчас строка поиска также будет доступна, однако рядом с ней будет добавлена кнопка Gemini. Теперь, вместо того чтобы искать нужное письмо, пользователи по желанию смогут получать необходимую информацию непосредственно от чат-бота, который будет ссылаться на источник в своих ответах. На данный момент Gmail Q&A доступна только подписчикам Gemini и Google One AI Premium. Стоимость подписки составит около 20 долларов в месяц. Доступ к функции возможен через значок чёрной звезды в правом верхнем углу приложения, который уже стал символом Gemini в продуктах Google. Позднее Gmail Q&A сможет работать не только с письмами, но и с файлами аккаунта Google Drive. Google также добавит Gemini во все свои существующие продукты, включая Google Docs, Google Calendar и другие. Как отмечает TechCrunch, к сожалению маловероятно, что функция Gmail Q&A в ближайшее время станет доступна для бесплатных пользователей. Компания также анонсировала скорое появление этой функции на устройствах iOS. Apple и Nvidia намерены стать следующими крупными инвесторами OpenAI

30.08.2024 [04:48],

Алексей Разин

Когда накануне речь шла о намерениях OpenAI привлечь дополнительный капитал на своё развитие, помимо венчурного фонда Thrive Capital в качестве потенциальных инвесторов упоминалась только корпорация Microsoft, но теперь The Wall Street Journal утверждает, что к ним могут присоединиться Apple и Nvidia. Сумма инвестиций может измеряться несколькими миллиардами долларов США.

Источник изображения: Nvidia Как уже отмечалось, Microsoft с 2019 года вложила в OpenAI примерно $13 млрд, что даёт ей право получать 49 % прибыли стартапа. И Nvidia, и Apple являются партнёрами OpenAI, поскольку первая снабжает стартап необходимыми для работы его больших языковых моделей ускорителями вычислений, а вторая заинтересована в развитии систем искусственного интеллекта в рамках собственной экосистемы Apple Intelligence. На первых порах она будет полагаться на ChatGPT, а позже должна развить собственные возможности в данной сфере. Если Apple решится вложить средства в капитал OpenAI, для неё это будет нетипичный шаг, поскольку обычно она не инвестирует в стартапы. Зато в 2017 году Apple вложила $1 млрд в японский Vision Fund компании SoftBank, поскольку этот фонд занимался венчурными инвестициями, но напрямую в такой деятельности она не участвовала. В 2016 году Apple вложила $1 млрд в китайский стартап Didi, который по сути является агрегатором услуг такси. Тогда предполагалось, что такая инвестиция поможет Apple приблизить момент создания собственного автоматического такси, но в этом году проект был похоронен. Как отмечает Bloomberg, в эту среду финансовый директор OpenAI Сара Фрайар (Sarah Friar) уведомила в рассылке сотрудников компании о поиске новых источников капитала. Подобные попытки, по данным источника, предпринимались с прошлого декабря. Вырученные деньги OpenAI намеревается потратить на увеличение вычислительных мощностей и покрытие прочих операционных расходов, как отметила финансовый директор. Новая статья: Не генеративным ИИ единым

30.08.2024 [00:03],

3DNews Team

Данные берутся из публикации Не генеративным ИИ единым Аудитория ChatGPT достигла 200 млн еженедельных пользователей — вдвое больше, чем год назад

29.08.2024 [22:50],

Николай Хижняк

Компания OpenAI сообщила, что число еженедельно активных пользователей ИИ-чат-бота ChatGPT теперь превышает 200 миллионов — это вдвое больше, чем год назад. Это достижение тем более интересно на фоне того, что конкуренция на рынке ИИ-чат-ботов только растёт.

Источник изображения: Levart_Photographer/Unsplash ChatGPT остается лидером среди чат-ботов на основе генеративного искусственного интеллекта, но это крайне конкурентная среда, поскольку другие крупные игроки в сфере технологий ИИ также выпускают частые обновления для своих решений в надежде захватить долю рынка. OpenAI также заявила, что 92 % компаний из списка Fortune 500 используют её продукты, а объёмы использования её автоматизированных API удвоились с июля, когда была представлена языковая модель GPT-4o. «Теперь люди используют наши инструменты в своей повседневной жизни, внося реальные изменения в такие сферы, как здравоохранение и образование. Наши решения помогают в выполнении рутинных задач, решении сложных проблем или раскрытии творческих способностей», — прокомментировал глава OpenAI Сэм Альтман (Sam Altman) изданию Axios. На рынке языковых моделей сохраняется жёсткая конкуренция среди таких компаний, как Microsoft, Google, OpenAI и Meta✴✴, каждая из которых старается для того, чтобы её ИИ-продуктами пользовались больше людей. Ранее Meta✴✴ отчиталась о значительном росте загрузок её языковых моделей Llama с открытым исходным кодом. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |