|

Опрос

|

реклама

Быстрый переход

Google научила ИИ создавать живые 3D-миры, которые не рассыпаются за минуту — Genie 3 проложит путь к AGI

05.08.2025 [18:24],

Сергей Сурабекянц

Google DeepMind выпустила новую версию своей ИИ-модели мира — Genie 3, способную генерировать трёхмерные среды, с которыми можно взаимодействовать в реальном времени. Компания утверждает, что пользователи смогут исследовать сгенерированные миры гораздо дольше, чем раньше, а модель будет запоминать расположение предметов, остающихся за пределами кадра. Мировые модели также являются важным шагом на пути к «сильному ИИ», поскольку позволяют обучать ИИ без ограничений в богатой среде.

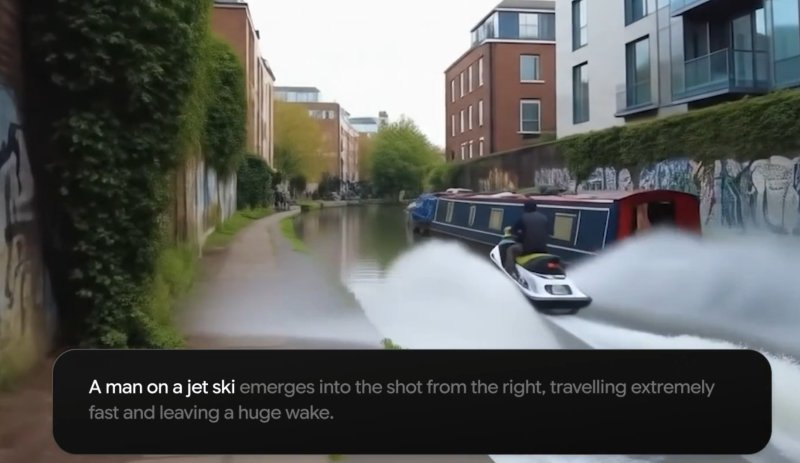

Источник изображений: Google Модели мира или мировые модели — это тип систем искусственного интеллекта, которые могут моделировать трёхмерные среды для образовательных, развлекательных и научных целей, а также для обучения роботов или агентов ИИ. В сгенерированном пространстве на основе текстовой подсказки пользователь может перемещаться, как в видеоигре. В это направление ИИ Google вкладывает значительные ресурсы. В декабре компания представила Genie 2, способную создавать интерактивные миры на основе изображений, а сейчас формирует новую команду по созданию моделей миров под руководством бывшего ведущего разработчика генератора видео Sora от OpenAI. У существующих моделей миров пока сохраняется множество недостатков. Например, в сгенерированном Genie 2 мире можно находиться не более одной минуты. По отзывам экспертов, подобные миры больше напоминали «прогулку по размытой версии Google Street View, где всё менялось и трансформировалось неожиданным образом, когда пользователь отводил взгляд». Genie 3, по всей видимости, может стать заметным шагом вперёд. Разработчики утверждают, что пользователи смогут создавать миры, в которых поддерживается «несколько» минут непрерывного взаимодействия. Genie 3 может удерживать в памяти сгенерированные объекты около минуты, что позволит пользователю возвращаться к ним и обнаруживать их на прежнем месте.  В Genie 3 появились так называемые «подсказываемые мировые события», позволяющие в реальном времени менять погодные условия или добавлять новых персонажей. Google сообщает, что пока количество способов взаимодействия с генерируемыми мирами ограничено, а читаемый текст «часто появляется только при наличии его в исходном описании мира».  На текущем этапе создаваемые модели миров обеспечивают разрешение 720p при частоте 24 кадра в секунду. Genie 3 пока недоступна для широкой аудитории. По словам Google, она существует в виде «ограниченной исследовательской предварительной версии», доступной «небольшой группе учёных и разработчиков» для тщательной оценки возможных рисков и путей их минимизации. Компания заявила, что пока лишь «изучает», как в дальнейшем предоставить доступ к Genie 3 «дополнительным тестировщикам». Генеративный ИИ не понимает устройство мира, показало исследование MIT

11.11.2024 [18:12],

Дмитрий Федоров

Генеративные ИИ-модели будоражат воображение руководителей многих компаний, обещая автоматизацию и замену миллионов рабочих мест. Однако учёные Массачусетского технологического института (MIT) предостерегают: ИИ хотя и даёт правдоподобные ответы, в действительности не обладает пониманием сложных систем и ограничивается предсказаниями. В задачах реального мира, будь то логические рассуждения, навигация, химия или игры, ИИ демонстрирует значительные ограничения.

Источник изображения: HUNGQUACH679PNG / Pixabay Современные большие языковые модели (LLM), такие как GPT-4, создают впечатление продуманного ответа на сложные запросы пользователей, хотя на самом деле они лишь точно предсказывают наиболее вероятные слова, которые следует поместить рядом с предыдущими в определённом контексте. Чтобы проверить, способны ли ИИ-модели действительно «понимать» реальный мир, учёные MIT разработали метрики, предназначенные для объективной проверки их интеллектуальных способностей. Одной из задач эксперимента стала оценка способности ИИ к генерации пошаговых инструкций для навигации по улицам Нью-Йорка. Несмотря на то что генеративные ИИ в определённой степени демонстрируют «неявное» усвоение законов окружающего мира, это не является эквивалентом подлинного понимания. Для повышения точности оценки исследователи создали формализованные методы, позволяющие анализировать, насколько корректно ИИ воспринимает и интерпретирует реальные ситуации. Основное внимание в исследовании MIT было уделено трансформерам — типу генеративных ИИ-моделей, используемых в таких популярных сервисах, как GPT-4. Трансформеры обучаются на обширных массивах текстовых данных, что позволяет им достигать высокой точности в подборе последовательностей слов и создавать правдоподобные тексты. Чтобы глубже исследовать возможности таких систем, учёные использовали класс задач, известных как детерминированные конечные автоматы (Deterministic Finite Automaton, DFA), которые охватывают такие области, как логика, географическая навигация, химия и даже стратегии в играх. В рамках эксперимента исследователи выбрали две разные задачи — вождение автомобиля по улицам Нью-Йорка и игру в «Отелло», чтобы проверить способность ИИ правильно понимать лежащие в их основе правила. Как отметил постдок Гарвардского университета Кейон Вафа (Keyon Vafa), ключевая цель эксперимента заключалась в проверке способности ИИ-моделей восстанавливать внутреннюю логику сложных систем: «Нам нужны были испытательные стенды, на которых мы точно знали бы, как выглядит модель мира. Теперь мы можем строго продумать, что значит восстановить эту модель мира». Результаты тестирования показали, что трансформеры способны выдавать корректные маршруты и предлагать правильные ходы в игре «Отелло», когда условия задач точно определены. Однако при добавлении усложняющих факторов, таких как объездные пути в Нью-Йорке, ИИ-модели начали генерировать нелогичные варианты маршрутов, предлагая случайные эстакады, которых на самом деле не существовало. Исследование MIT показало принципиальные ограничения генеративных ИИ-моделей, особенно в тех задачах, где требуется гибкость мышления и способность адаптироваться к реальным условиям. Хотя существующие ИИ-модели могут впечатлять своей способностью генерировать правдоподобные ответы, они остаются всего лишь инструментами предсказания, а не полноценными интеллектуальными системами. |