|

Опрос

|

реклама

Быстрый переход

Анонимность в интернете под угрозой: ИИ научился вычислять реальных владельцев фейковых аккаунтов

10.03.2026 [15:02],

Павел Котов

Современный человек нередко использует в онлайн-деятельности анонимные или фальшивые учётные записи в надежде скрыть свою личность. Но эта мера рискует оказаться бесполезной — модели искусственного интеллекта, как оказалось, способны эффективно выявлять подлог и в значительном числе случаев определять истинного владельца фейкового аккаунта.

Источник изображения: Igor Omilaev / unsplash.com Для выявления поддельного аккаунта и определения его истинного владельца модели ИИ используют ряд идентифицирующих сигналов — это могут быть фрагменты или крупные объёмы совпадающих данных, а также отличительные признаки поведения. К такому результату пришли (PDF) исследователи Швейцарской высшей технической школы Цюриха (ETH Zurich), независимой образовательной и научно-исследовательской программы MATS, а также компании Anthropic. «Наши выводы имеют большое значение для конфиденциальности в интернете. Среднестатистический пользователь Сети долгое время действовал в соответствии с неявной моделью угроз, предполагая, что псевдонимы обеспечивают адекватную защиту, потому что целенаправленная деанонимизация требует значительных усилий. Большие языковые модели опровергают это предположение», — пишут учёные. В рамках исследования модели ИИ в 68 % случаев успешно определили поддельный характер учётных записей и в 90 % случаев из них верно указали на их истинных владельцев. Сделанное учёными открытие может иметь последствия не только для тех, кто пишет под чужими именами в соцсетях. ИИ теоретически способен выявлять настоящие имена хакеров, публикующих закрытую информацию сотрудников компаний и тех, кто задаёт вопросы на открытых форумах. Иногда под чужими именам в соцсетях пишут и руководители компаний, стремящиеся продвинуть свой бизнес или нанести ущерб конкурентам — в таких действиях ранее признался даже самый богатый человек на Земле Илон Маск (Elon Musk). А ещё ИИ способен раскрывать имена тех, чья жизнь может зависеть от анонимности: информаторов, активистов или жертв насилия. Чтобы защитить людей от деанонимизации с помощью ИИ, учёные предложили несколько защитных мер: ограничивать на платформах доступ к пользовательским данным через API, улучшить механизмы обнаружения автоматизированного сбора информации и ограничивать экспорт больших объёмов данных. Но, признали исследователи, гарантии успеха эти меры не дадут, и в ближайшие годы, если не месяцы, удерживать ИИ от выполнения этих операций будет всё труднее. YouTube объявил войну ИИ-дипфейкам, запустив функцию «Определение сходства»

21.10.2025 [22:29],

Николай Хижняк

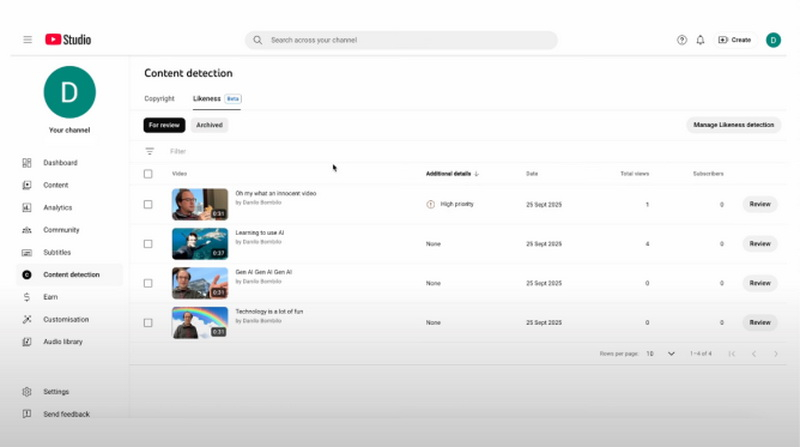

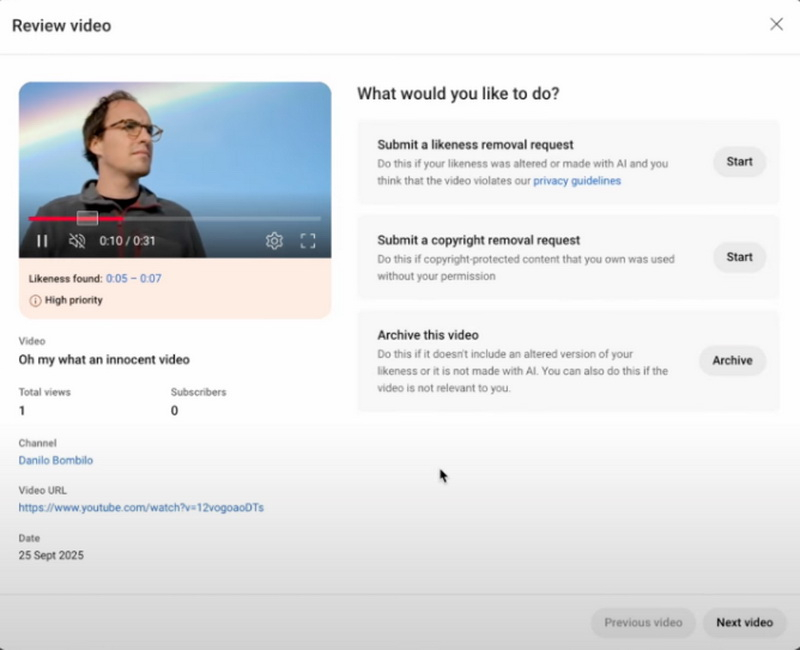

Видеоплатформа YouTube объявила о полноценном запуске функции «Определение сходства». Она поможет авторам контента находить на YouTube видео с изображениями их лица или голоса, созданными с помощью искусственного интеллекта, управлять такими видео и отправлять запросы на их удаление. Подключение функции осуществляется в рамках партнёрской программы YouTube.

Источник изображения: yousafbhutta/Pixabay В разговоре с TechCrunch представитель YouTube сообщил, что развёртывание функции «Определение сходства» началось, добавив, что авторы контента получили электронные письма с соответствующим уведомлением сегодня утром. Функция идентифицирует контент, в котором используется сходный образ оригинальных авторов (голос, лицо), будь то для рекламы продуктов и услуг, на поддержку которых они не давали согласия, или для распространения дезинформации. В качестве примера приводится случай компании Elecrow, которая с помощью ИИ имитировала голос YouTube-блогера Джеффа Гирлинга (Jeff Geerling) для продвижения своих продуктов.

Источник изображения здесь и ниже: YouTube На своём канале Creator Insider платформа опубликовала инструкции о том, как авторы могут использовать новую функцию. Чтобы начать процесс регистрации, создателям контента необходимо перейти на вкладку «Определение сходства», дать согласие на обработку данных и отсканировать QR-код на экране смартфона, который перенаправит их на веб-страницу для подтверждения личности. Для этого требуется предъявить удостоверение личности с фотографией и снять короткое видео-селфи. После того как YouTube предоставит доступ к инструменту, создатели смогут просматривать все обнаруженные видео с их образами и отправлять запросы на их удаление в соответствии с политикой конфиденциальности YouTube, а также подавать запросы о нарушении авторских прав. Также доступна возможность архивировать видео. Авторы могут в любое время отказаться от использования этой функции — в этом случае YouTube прекратит поиск видео через 24 часа.  Функция «Определение сходства» находилась в пилотном режиме с начала этого года. В прошлом году видеохостинг впервые объявил о партнёрстве с американским агентством талантов Creative Artists Agency (CAA), чтобы помочь знаменитостям, спортсменам и авторам контента определять на платформе материалы, в которых используются их образы, сгенерированные искусственным интеллектом. В апреле YouTube выразил поддержку законопроекту под названием «Закон о запрете дипфейков», направленному на решение проблемы создаваемых искусственным интеллектом копий, имитирующих изображение или голос человека с целью обмана других и распространения вредоносного контента. Microsoft накрыла банду хакеров, которая обманом заставляла ИИ рисовать неподобающие фейки со знаменитостями

28.02.2025 [10:36],

Владимир Фетисов

Microsoft заявила об обнаружении американских и зарубежных хакеров, которые обходили ограничения генеративных инструментов на базе искусственного интеллекта, включая службы OpenAI в облаке Azure, для создания вредоносного контента, в том числе интимных изображений знаменитостей и другого контента сексуального характера. По данным компании, в этой деятельности участвовали хакеры из США, Ирана, Великобритании, Гонконга и Вьетнама.

Источник изображения: Mika Baumeister / Unsplash В сообщении сказано, что злоумышленники извлекали логины пользователей сервисов генеративного ИИ из открытых источников и использовали их для собственных целей. После получения доступа к ИИ-сервису хакеры обходили установленные разработчиками ограничения и продавали доступ к ИИ-сервисам вместе с инструкциями по созданию вредоносного контента. Microsoft предполагает, что все идентифицированные хакеры являются членами глобальной киберпреступной сети, которую в компании именуют Storm-2139. Двое из них территориально находятся во Флориде и Иллинойсе, но компания не раскрывает личностей, чтобы не навредить уголовному расследованию. Софтверный гигант заявил, что ведёт подготовку соответствующих запросов в правоохранительные органы США и ряда других стран. Эти меры Microsoft принимает на фоне растущей популярности генеративных нейросетей и опасения людей по поводу того, что ИИ может использоваться для создания фейковых изображений общественных деятелей и простых граждан. Такие компании, как Microsoft и OpenAI, запрещают генерацию подобного контента и соответствующим образом ограничивают свои ИИ-сервисы. Однако хакеры всё равно пытаются обойти эти ограничения, что зачастую им успешно удаётся сделать. «Мы очень серьёзно относимся к неправомерному использованию искусственного интеллекта и признаём серьёзные и долгосрочные последствия злоупотребления изображениями для потенциальных жертв. Microsoft по-прежнему стремится защитить пользователей, внедряя надёжные меры ИИ-безопасности на платформах и защищая сервисы от незаконного и вредоносного контента», — заявил Стивен Масада (Steven Masada), помощник главного юрисконсульта подразделения Microsoft по борьбе с киберпреступлениями. Это заявление последовало за декабрьским иском Microsoft, который компания подала в Восточном округе Вирджинии против 10 неизвестных в попытке собрать больше информации о хакерской группировке и пресечь её деятельность. Решение суда позволило Microsoft взять под контроль один из основных веб-сайтов хакеров. Это и обнародование ряда судебных документов в прошлом месяце посеяло панику в рядах злоумышленников, что могло установить личности некоторых участников группировки. ByteDance стёрла грань между дипфейком и реальностью — представлена ИИ-модель OmniHuman-1

05.02.2025 [18:52],

Сергей Сурабекянц

Китайский технологический гигант ByteDance, владелец платформы TikTok, сегодня продемонстрировал новую систему искусственного интеллекта OmniHuman-1, которая может создавать фейковые видео, практически неотличимые от реальности. Способность искусственного интеллекта генерировать deepfake-видео вызывает одновременно восторг и мистический ужас.

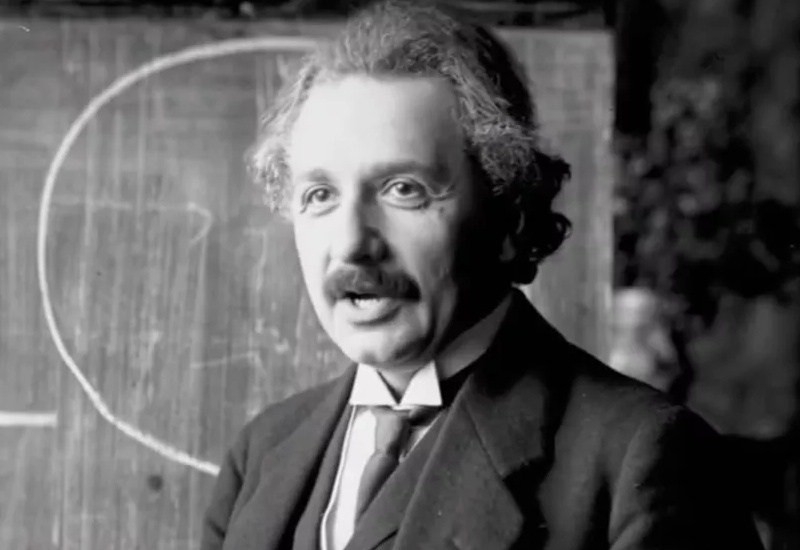

Источник изображения: techspot.com Видео, созданные OmniHuman-1, выглядят поразительно реалистично. Достаточно взглянуть на ролик ниже, демонстрирующий выступление спикера на популярной ежегодной конференции по распространению уникальных идей TED (technology, entertainment, design — технологии, развлечения, дизайн), которого в реальности не было. Системе OmniHuman-1 достаточно одной фотография и записи голоса, чтобы сгенерировать подобное видео. Пользователь может настраивать такие элементы, как соотношение сторон и кадрирование. Более того, ИИ способен изменять движения тела и жесты в реальных видеоматериалах. Конечно, результаты не всегда на 100 % безупречны. Некоторые позы выглядят немного необычно. Например, на этой лекции Эйнштейна, полностью сгенерированной ИИ, лицо выглядит практически идеально, но движения рук — неестественно. OmniHuman-1 «просмотрела» 18 700 часов видеоданных с использованием нового подхода «omni-conditions», который позволяет модели обучаться на нескольких источниках входных данных, таких как текстовые подсказки, аудио и позы тела одновременно. Исследователи ByteDance говорят, что подобный метод обучения помогает ИИ «значительно сократить потери данных». Возможные применения технологии deepfake вызывают нешуточное беспокойство. За последнее время она уже не раз использовалась для дезинформации, мошенничества и других нечистоплотных целей. Так, в ходе избирательной кампании 2024 года в США было зафиксировано множество случаев распространения аудио- и видеозаписей с дипфейками для введения избирателей в заблуждение. В прошлом году финансовые мошенничества лишали людей миллиардов. Например, мошеннику, использовавшему ИИ, чтобы выдать себя за актёра Брэда Питта (Brad Pitt), удалось обманом убедить женщину развестись с мужем и отправить ему $850 000 якобы на лечение. В настоящее время сотни экспертов по этике ИИ выступают за регулирование дипфейков. Возможно, что ByteDance не стоит давать доступ к OmniHuman-1 широкой публике, так как это может привести к катастрофическим последствиям. Хотя джинна уже выпустили из бутылки и процесс внедрения ИИ во все сферы жизни, в том числе криминальную, уже не остановить. Google начала масштабную зачистку поисковой выдачи от откровенных фейковых изображений

31.07.2024 [17:56],

Сергей Сурабекянц

Google внедрила новые функции онлайн-безопасности, которые упрощают масштабное удаление откровенных дипфейковых изображений из поискового индекса и предотвращают их появление на первых позициях результатов поиска. При удалении поддельного контента по запросам пользователей будут также удалены все возможные дубликаты и отфильтрованы результаты по похожим запросам.

Источник изображения: Pixabay «Эти меры защиты уже доказали свою эффективность в борьбе с другими типами изображений, полученных без согласия правообладателей, и теперь мы создали те же возможности и для поддельных откровенных изображений, — заявила менеджер по продуктам Google Эмма Хайэм (Emma Higham). — Эти усилия призваны дать людям дополнительное спокойствие, особенно если они опасаются появления подобного контента в будущем». Позиции сайтов в индексе Google будут скорректированы, чтобы противодействовать поиску явного фейкового контента. Например, на поисковые запросы, которые намеренно запрашивают поддельные изображения реального человека, поисковая система будет выдавать «высококачественный, корректный контент», например, соответствующие новостные статьи. Сайты со значительным количеством фейковых изображений откровенного характера будут понижены в рейтинге поиска Google. Google утверждает, что предыдущие обновления в этом году более чем на 70 процентов снизили появление в поисковой выдаче откровенных изображений по запросам дипфейкового контента. Перед компанией стоит задача научить поисковую систему отличать реальный откровенный контент, например, изображения обнажённого тела, сделанные по обоюдному согласию, от фейков, чтобы сохранить возможность демонстрации законных изображений. Ранее Google уже предпринимала усилия для решения проблемы появления опасного или откровенного контента в интернете. В 2022 году компания расширила перечень персональной или конфиденциальной информации, которую пользователь может удалить из поиска. В августе 2023 года Google начала по умолчанию размывать откровенно сексуальные изображения. В мае этого года компания запретила рекламодателям продвигать услуги по созданию контента откровенно сексуального характера. |