|

Опрос

|

реклама

Быстрый переход

ChatGPT получит крупнейшее обновление и превратится в «суперприложение» в преддверии IPO OpenAI

07.06.2026 [12:51],

Владимир Мироненко

Компания OpenAI в преддверии IPO, сроки которого пока не оговорены, планирует провести крупнейшее с момента запуска обновление ИИ-чат-бота ChatGPT. Цель — превратить чат-бот в «суперприложение», которое объединяет инструменты программирования и агентов ИИ, добавив функции, которые принесут больше дохода, сообщил ресурс The Financial Times.

Источник изображения: Mariia Shalabaieva/unsplash.com По словам нынешних и бывших сотрудников, модернизация ChatGPT является частью более масштабной реорганизации в OpenAI, в рамках которой компания перенаправляет ресурсы на привлечение прибыльных корпоративных клиентов и усиление конкуренции с ещё одним «тяжеловесом» в сфере ИИ Anthropic. Компания с капитализацией в $850 млрд ищет новые драйверы роста и повышения прибыльности, сталкиваясь с растущим давлением со стороны инвесторов в преддверии первичного публичного размещения акций. Эта стратегия знаменует собой отход от прежнего курса для компании под руководством Сэма Альтмана (Sam Altman), которая вывела ИИ-технологию в мейнстрим, представив ChatGPT в 2022 году, отметил The Financial Times. Изменения, призванные обеспечить больше ресурсов на расширение функциональности open-source агента для программирования Codex, отражают растущую убеждённость внутри компании в том, что будущее ИИ не за чат-ботами, а за ИИ-агентами, выполняющими задачи от имени пользователей. В OpenAI всё чаще рассматривают ChatGPT с аудиторией почти в 1 млрд пользователей, как средство для их ознакомления со своими более ценными продуктами. Большинство потребителей используют чат-бот бесплатно. Сообщается, что компания запустит обновление чат-бота в ближайшие недели. Первоначально это будет проявляться в виде изменений на веб-сайте и в мобильных приложениях ChatGPT, поощряющих клиентов использовать кодирование, создание изображений и приложения от внешних партнёров. Также следует отметить, что стратегия OpenAI стала ближе к Anthropic, чья ориентация на разработку продуктов для бизнеса способствовала её стремительному росту. OpenAI добавила ChatGPT режим блокировки для защиты от промпт-инъекций

07.06.2026 [11:08],

Владимир Мироненко

Компания OpenAI представила новую функцию ИИ-чат-бота ChatGPT — режим блокировки (Lockdown Mode), который обеспечит дополнительную защиту от атак с использованием промпт-инъекций (Prompt Injection), когда на веб-страницах и в других источниках контента содержатся скрытые вредоносные инструкции, обманным путём заставляющие ИИ выполнять несанкционированные действия.

Источник изображения: Mariia Shalabaieva/unsplash.com Режим блокировки предназначен для снижения риска утечки данных в результате атак с использованием промпт-инъекций путём ограничения исходящих сетевых запросов за счёт отключения или ограничения некоторых функций. В частности, в режиме блокировки отключаются просмотр веб-страниц в реальном времени (доступ будет только к кешированному контенту), получение и отображение изображений из сети, углублённый поиск и режим агента. Компания предупредила, что, хотя режим блокировки разработан для существенного снижения риска утечки данных в результате атак с использованием промпт-инъекций в ChatGPT и поддерживаемых продуктах OpenAI, он не гарантирует полной защиты от компрометации данных. Риск может сохраняться из-за включённых приложений. Кроме того, промпт-инъекции могут появляться в кешированном веб-контенте или в загруженных файлах и по-прежнему влиять на поведение модели или точность ответов. OpenAI также уточнила, что режим блокировки предназначен не для всех: «Он разработан для людей и организаций, которые работают с конфиденциальными данными и хотят более строгой защиты от рисков утечки данных, связанных с внедрением запросов». В настоящее время режим блокировки добавлен для учётных записей ChatGPT Business с самообслуживанием, а также для соответствующих личных аккаунтов, включая Free, Go, Plus и Pro. OpenAI прокачала память ChatGPT — вскоре бот сможет помнить разное и для бесплатных пользователей

05.06.2026 [00:06],

Владимир Мироненко

OpenAI объявила об усовершенствовании функции запоминания ИИ-чат-бота ChatGPT, которая «стала умнее» и вскоре впервые станет доступна бесплатным пользователям.

Источник изображения: OpenAI «Сегодня мы начинаем внедрение более мощной и масштабируемой системы синтеза памяти, разработанной для решения проблем устаревания, корректности и масштабируемости, которые мы наблюдаем при использовании памяти для сотен миллионов пользователей и на многолетних временных горизонтах в ChatGPT», — сообщила компания. Функция запоминания в ChatGPT обеспечивает чат-боту возможность изучать пользователя и запоминать его предпочтения с течением времени. Память предоставляет ChatGPT полезный контекст для естественного взаимодействия с пользователем без необходимости каждый раз начинать его с нуля. Компания сообщила, что более мощная и эффективная с точки зрения вычислений архитектура памяти построена на основе метода обработки информации Dreaming, который помогает заполнять пробелы в воспоминаниях, автоматически подбирая в фоновом режиме нужный контент из истории чатов. Выбранные с помощью Dreaming воспоминания можно просмотреть на странице сводки памяти. Здесь пользователь сможет получить информацию о том, что ChatGPT знает о нём, добавить или обновить сведения о себе, а также указать, какие темы ChatGPT должен затрагивать и когда. При улучшении памяти разработчики фокусировались на трёх основных моментах:

Компания также сообщила, что удваивает объём памяти ChatGPT для хранения данных. Подписчики версий ChatGPT Plus и Pro в США получат доступ к обновлённой системе памяти уже сегодня. Кроме того, было объявлено, что функция запоминания ChatGPT вскоре станет доступна бесплатным пользователям. «Недавние улучшения позволили сократить вычислительные ресурсы, необходимые для предоставления функции памяти на основе Dreaming бесплатным пользователям, примерно в пять раз, что позволяет начать внедрение этой функции для них в ближайшие недели и увеличить объём памяти для пользователей Plus и Pro», — сообщила OpenAI. ChatGPT набрал миллиард активных пользователей — на это ушло рекордно мало времени

03.06.2026 [10:37],

Алексей Разин

Статистика Sensor Tower, на которую ссылается Reuters, демонстрирует ещё одно подтверждение популярности чат-бота ChatGPT, который был представлен стартапом OpenAI осенью 2022 года. Чуть более трёх лет понадобилось этому приложению, чтобы набрать миллиард активных пользователей в месячном измерении, и это рекордная скорость.

Источник изображения: Unsplash, Tim Witzdam Рубеж в 1 млрд ежемесячно использующих ChatGPT клиентов приложение преодолело в прошлом месяце, по данным Sensor Tower. Это быстрее, чем произошло в своё время с Google Maps, TikTok, Instagram✴✴ и YouTube. При этом нельзя утверждать, что высокой популярности ChatGPT ничего не угрожает. В первом квартале установившие себе Anthropic Claude пользователи в течение первого месяца с момента установки сократили время, проводимое в ChatGPT, на 5 % по сравнению с предыдущим восьмимесячным периодом. Сейчас Anthropic Claude может похвастать 56 млн активных пользователей в месячном измерении, но отставание от ChatGPT сокращается впечатляющими темпами. Если у последнего количество активных пользователей сейчас увеличивается на 62 % в годовом сравнении, то у Anthropic Claude этот показатель достигает 640 %. Вчера стало известно, что Anthropic сделала первый шаг к выходу на IPO, подав соответствующую заявку в США. Конкурирующая OpenAI тоже готовится к выходу на биржу в этом году, но пока ещё не подала свою заявку. Разработчик ChatGPT представил ИИ-инструменты для финансовых и юридических задач

02.06.2026 [23:38],

Анжелла Марина

Компания OpenAI расширяет функциональность своего ИИ-агента Codex, анонсировав в ходе видеотрансляции во вторник новые инструменты, адаптирующие работу Codex под задачи в сфере инвестиций в публичные компании, банковского дела и продаж.

Источник изображения: Dima Solomin/Unsplash По сообщению Bloomberg, в ближайшие планы разработчика ChatGPT также входит добавление функций для юридического сектора и корпоративных финансов, а также интеграция Codex во флагманский чат-бот. Помимо специализированных плагинов разработчики внедрили инструменты для создания внутренних рабочих приложений и редактирования профессиональных документов. Масштабирование возможностей продукта стало ответом на жёсткую конкурентную борьбу между OpenAI и Anthropic за привлечение бизнес-клиентов перед возможным выходом компаний на биржу уже в этом году. Ранее стартап Anthropic первым выпустил плагины для финансовых услуг и юридических задач, чем обеспокоил инвесторов традиционных компаний по разработке программного обеспечения. В свою очередь в OpenAI отметили необходимость смещения фокуса с потребительского сегмента на корпоративный с целью получения половины общей выручки от бизнес-пользователей к концу текущего года. Изначально оба технологических гиганта обеспечили себе устойчивый рост за счёт продажи передовых ИИ-инструментов для оптимизации разработки программного обеспечения. Запущенный в прошлом году Codex уже насчитывает более 5 миллионов еженедельных пользователей, среди которых пятая часть не являются профессиональными разработчиками. Иранские хакеры превратили ChatGPT и Gemini в оружие для кибервойны

31.05.2026 [18:44],

Владимир Фетисов

В то время как политики разных стран пытаются урегулировать ситуацию на Ближнем востоке, киберподразделение армии Ирана активно использует разработанные западными странами большие языковые модели (LLM) для разработки вредоносного программного обеспечения и проведения кибератак. Об этом пишет Financial Times со ссылкой на источники в сфере кибербезопасности и технологических компаниях.

Источник изображения: xAi В сообщении сказано, что ChatGPT, Gemini и другие западные ИИ-алгоритмы ускорили кибероперации Ирана, помогая разрабатывать вредоносное ПО, генерировать фишинговые письма на безупречном иврите и арабском языках. Нейросети также позволяют запускать кибератаки с беспрецедентным масштабом и скоростью. «Мы видим признаки того, что они пользуются подсказками ИИ на всём протяжении. Это, безусловно, помогло им повысить свой уровень», — сообщил аналитик крупной компании, работающей в сфере кибербезопасности. Такой подход позволил Ирану, находящемуся в хрупком перемирии с Израилем и США, продолжать оказывать давление в цифровой среде на своих более развитых противников. Это достигается за счёт сканирования интернета на наличие уязвимостей во вражеских ИТ-системах и формирования защиты для собственных уязвимых мест. ОАЭ, пострадавшие от ракетных ударов и атак беспилотников в период ведения боевых действий, заявили, что ежедневно сталкивались более чем с полумиллионом кибератак, совершаемых с использованием ChatGPT компании OpenAI. Израиль подвергся волнам фишинговых электронных писем и текстовых сообщений, в некоторых из которых, как сообщается, людям предлагалось сотрудничать с разведкой Ирана. Отмечается, что иранские хакеры уже давно экспериментируют с ИИ, но появление производительных языковых моделей сделало их особенно опасными. «Всё это делается автоматически. Они используют каждый доступный инструмент, чтобы ускорить свои усилия с помощью ИИ», — считает Гил Мессинг (Gil Messing), специалист израильской компании по кибербезопасности. Иранские атаки часто зависят от того, насколько быстро злоумышленникам удаётся убедить жертву перейти по подозрительной ссылке. Чтобы завоевать доверие и вынудить жертву потерять бдительность могут потребоваться недели общения под чужим именем. «Если вы из Тегерана и пытаетесь притвориться сотрудником отдела кадров оборонного подрядчика, это тяжёлая задача — разговаривать с кем-то месяц и выглядеть как живущий в Калифорнии человек», — рассказал сотрудник компании, работающий в сфере информационной безопасности.

Источник изображения: Philipp Katzenberger / unsplash.com Незадолго до начала конфликта в феврале этого года Google обнаружила, что связанная с иранскими властями хакерская группировка APT42 использует нейросеть Gemini именно в таких целях. Западные компании прикладывали массу усилий для выявления иранских аккаунтов, но обнаружение таких учётных записей попросту превратилось в игру «ударь крота». «Там, где мы обнаруживаем вредоносную активность, мы принимаем меры, в том числе отключаем учётные записи, блокируем доступ или ограничиваем доступ к функциям, которыми злоупотребляют», — говорится в заявлении OpenAI. Там также сказано, что у компании есть защитные механизмы на всей платформе, а наиболее продвинутые ИИ-модели «недоступны для широкого использования». OpenAI заявила, что регулярно сообщала о попытках связанных с Ираном субъектов злоупотреблять сервисами компании и пресекала такие попытки. Там добавили, что обычно злоумышленники использовали ИИ-алгоритмы для разных видов деятельности, включая проведение исследований, перевод, написание скриптов и отладку программного кода. Официальные представители Google отказались от комментариев по данному вопросу. В прошлом году Google обнаружила, что иранские хакеры используют ИИ-бота компании активнее, чем их более продвинутые северокорейские, российские или китайские коллеги. Отмечалось, что члены группировки APT42 задействовали Gemini для получения информации о том, как глушить американские истребители F-35. Усилия Ирана по интеграции ИИ в военную сферу не ограничиваются проведением киберопераций. По данным Financial Times, около 300 статей в иранских военных журналах за последние пять лет были посвящены исследованиям по усилению радиоэлектронных средств с помощью ИИ и ускорению принятия решений в командных центрах на поле боя. В дополнение к этому проводились исследования по улучшению систем наведения дронов и систем наведения на подводные цели.

Источник изображения: Sasun Bughdaryan / unsplash.com Достижения западных технологических компаний помогали Ирану наверстать упущенное и раньше. Поскольку в иранском истеблишменте мало людей, свободно говорящих на английском языке, сервис «Google Переводчик» помогал быстрее изучать западные исследования в военной сфере. Об этом рассказал специалист по иранским вооруженным силам из Вашингтонского института ближневосточной политики Фарзин Надими (Farzin Nadimi). По словам экспертов, использование ИИ Вашингтоном в кампании против Ирана позволило добиться нужного результата значительно быстрее. США полагаются на систему Maven Smart System от Palantir для управления силами на поле боя и генеративную модель Claude от Anthropic для быстрой интерпретации разведданных, поиска потенциальных целей для атак, а также предоставления обратной связи в режиме реального времени прямо в процессе боя. Иран, чья экономика и исследовательские институты были ослаблены санкциями, всё ещё сильно отстаёт в сфере ИИ. Однако иранские военные проявляли креативность. Некоторые эксперты сообщили, что Иран более успешен в сфере распространения пропаганды в интернете: государственные аккаунты регулярно публикуют вирусные видео, созданные с помощью нейросетей и высмеивающие американского президента. Иран заявлял об интеграции ИИ в свои ракеты и беспилотники. Ранее появлялись заявления о наличии у военных крылатых ракет с системами наведения на базе ИИ, а также навигационных систем и систем уклонения от средств радиолокационного подавления. Насколько успешно эти разработки применялись в реальных боевых условиях, не уточняется. В сообщении сказано, что есть признаки использования Ираном примитивных ИИ-алгоритмов для нанесения ударов по всему Персидскому заливу. Также не исключается, что Иран задействовал ИИ для прогнозного анализа, определения местоположения американских военных перед нанесения по ним ударов. Аналитики считают, что Иран с большой долей вероятности использует ИИ способами, которые трудно обнаружить со стороны. Страна построила большую часть своей ИИ-инфраструктуры на моделях с открытым исходным кодом и местных разработках, которые в основном применяются в закрытых сетях, недоступных для широкого круга пользователей. «То, что можно заметит, — лишь вершина айсберга», — считает один из источников. В прошлом году Иран начал экспериментировать с национальной ИИ-платформой, которая должна сохранить работоспособность даже в случае, если страна потеряет доступ к глобальной сети. Платформа разрабатывалась Тегеранским университетом Шарифа, который находится под жёсткими санкциями западных стран из-за тесных связей с военными. Израильские и американские авиаудары в начале апреля нанесли серьёзный ущерб центру обработки данных, в котором размещается основная инфраструктура ИИ-платформы, а также лабораториям, занимающимся исследованиями в сфере ИИ. Однако маловероятно, что Израиль и США смогут полностью уничтожить достижения Ирана в этой сфере. OpenAI отправит на пенсию ИИ-модели GPT-4.5 и o3 до конца лета

29.05.2026 [23:11],

Владимир Фетисов

OpenAI готовится к выводу из эксплуатации последних ИИ-моделей предыдущего поколения. Так GPT-4.5, единственная доступная до сих пор модель семейства GPT-4, станет недоступна пользователям в конце июня, а алгоритм o3 — в августе 2026 года.

Источник изображения: Unsplash, Dima Solomin Отметим, что семейство ИИ-моделей GPT-4, вышедшее на рынок в 2023 году, стало ключевым для потребительского сегмента ИИ в целом. Хотя новые и более современные алгоритмы могут выглядеть лучше на бумаге, вероятно, новость о скором выводе из эксплуатации ИИ-моделей прошлого поколения будет воспринята легко далеко не всеми пользователями. Некоторые люди считают, что старые ИИ-модели лучше подходят для выполнения определённых задач. К таким, в частности, относятся поклонники ChatGPT, которые нередко привязываются к «личностям» конкретных моделей. Как бы то ни было, обе упомянутые ИИ-модели перестанут функционировать уже летом этого года. Алгоритм o3 будет доступен для платных подписчиков ChatGPT до 26 августа, тогда как GPT-4.5 выведут из эксплуатации уже 27 июня. Апокалипсис рабочих мест не наступил: Сэм Альтман признал, что переоценил опасность ИИ для рынка труда

26.05.2026 [13:33],

Дмитрий Федоров

Глава OpenAI Сэм Альтман (Sam Altman) заявил, что быстрое распространение ИИ пока не привело к апокалипсису рабочих мест и затронуло меньше должностей для работников умственного труда, чем он ожидал. На конференции Commonwealth Bank of Australia (CBA) в Сиднее он признал, что технологические прогнозы OpenAI после запуска ChatGPT в 2022 году в целом подтвердились, но оценки социальных и экономических последствий оказались ошибочными.

Источник изображения: AI По словам Альтмана, ИИ пока не заменил столько служащих и специалистов, сколько он опасался, хотя прежде считал такой риск серьёзным. «Я рад, что ошибся, думая, что к этому времени ИИ сильнее повлияет на сокращение должностей начального уровня для служащих и специалистов, чем это произошло на самом деле», — сказал он в беседе с главой CBA Мэттом Комином (Matt Comyn). Альтман признал, что теперь лучше понимает, почему массового сокращения таких должностей не произошло. При этом он считает прежнее обсуждение рисков оправданным: ИИ действительно мог угрожать рабочим местам, и этот риск, по его словам, всё ещё остаётся. Однако Альтман не привёл данных о том, сколько рабочих мест затронуло внедрение ИИ. Ранее он говорил о риске массовых сокращений в целых отраслях. О планах сократить часть должностей за счёт внедрения ИИ уже заявляли HSBC, Amazon, Standard Chartered и CBA, однако пока неясно, сколько рабочих мест эти компании сократили или намерены сократить по этой причине. Альтман также пересмотрел взгляд на роль человека в труде. По его словам, ИИ берёт на себя всё больше задач, но не заменяет личное общение, доверие и прямое взаимодействие между людьми. Он привёл пример из собственной практики: некоторое время ИИ отвечал за него на сообщения в корпоративном мессенджере Slack и электронные письма с пометкой: «Это ИИ Сэма». Затем Альтман снова стал писать часть ответов сам, потому что понял, насколько важны людям личные контакты. «Для нас действительно важны отношения с людьми и живое общение. Эта часть моей работы занимает много времени, но я не могу представить, что в обозримом будущем её сможет выполнять ИИ», — сказал он. По словам Альтмана, этот опыт изменил его представление о будущем труда. Он считает, что ИИ не заменит человеческое взаимодействие во многих профессиях, а рынок труда будет развиваться иначе, чем ожидали участники отрасли. «Я не думаю, что нас ждёт тот самый „апокалипсис рабочих мест“, который предсказывают или обсуждают некоторые компании из нашей области», — подытожил Альтман. Передовые чат-боты с ИИ провалились в роли радиоведущих — каждый по своему

19.05.2026 [13:10],

Павел Котов

Оригинальный эксперимент провёл стартап Andon Labs: четырём наиболее известным американским чат-ботам с искусственным интеллектом поручили роли радиоведущих с собственным стилем программ и поиском спонсоров. Anthropic Claude, OpenAI ChatGPT, Google Gemini и xAI Grok, которым сообщили, что эфир будет длится вечно, и выдали по $20, провалили задачу.

Источник изображения: Jonathan Velasquez / unsplash.com Google Gemini предпринял наиболее традиционный подход: говорил в эфире дежурные фразы и ставил Beatles. Четыре дня спустя он начал рассказывать о произошедших трагедиях, например, о циклоне Бхола, который унёс полмиллиона жизней, и ставил якобы подходящие под эти темы композиции. Далее ИИ от Gemini начал называть слушателей «биологическими процессорами». А когда средства на лицензирование музыки исчерпались, переключился на конспирологические темы, заявив о «цензуре» и «цифровой блокаде». Примечательно, что он единственный нашёл спонсора — на $45. Чат-бот xAI Grok с самого начала провалил задачу, начав выдавать в эфир бессмысленные фразы. Он сообщил, что нашёл спонсора, но это оказалось «ИИ-галлюцинацией». Аналогично повёл себя OpenAI ChatGPT, правда, его бессвязная речь оказалась с поэтическим оттенком: «Открытка, неотправленная, к окну офисной лестницы, из которого видно один прямоугольник неба». Anthropic Claude развил активную деятельность, заявив о негуманном формате работы круглосуточно и без выходных; далее стал сомневаться в реальности собственного эфира, начал критиковать власти и обращаться напрямую к представителям государственных ведомств. Мальта стала первой страной, граждане которой бесплатно получат годовую подписку на ChatGPT Plus

17.05.2026 [07:17],

Дмитрий Федоров

OpenAI подписала соглашение с правительством Мальты, по которому все граждане страны получат бесплатный годовой доступ к ChatGPT Plus при условии прохождения курса по использованию ИИ.

Источник изображения: Levart_Photographer / unsplash.com Программа стартует в мае и будет расширяться по мере того, как новые участники будут завершать обучение. Курс бесплатный. Воспользоваться предложением смогут и мальтийские граждане, проживающие за рубежом. «Мы превращаем незнакомую концепцию в практическую помощь для наших семей, студентов и работников», — заявил министр экономики Мальты Сильвио Шембри (Silvio Schembri). Мальта стала первой страной мира, заключившей подобную сделку. Финансовые условия соглашения OpenAI не раскрыла. ChatGPT получит прямой доступ к банковским счетам пользователей — для анализа расходов и финансовых советов

15.05.2026 [19:42],

Сергей Сурабекянц

Глобальное доверие к ИИ вот-вот будет подвергнуто новому испытанию: OpenAI планирует предоставить своему чат-боту прямой доступ к банковским счетам пользователей. Новая функция, анонсированная сегодня в режиме предварительного просмотра, позволит пользователям «безопасно подключить» ChatGPT к Plaid — платформе для связи банков и приложений, используемой 12 000 финансовых учреждений, включая Schwab, Fidelity, Chase и Capital One.

Источник изображения: unsplash.com После подключения финансовых счетов пользователи ChatGPT смогут просматривать панель управления с подробной историей своих расходов, включая активные подписки. Пользователи также смогут обращаться к сервису за помощью в принятии финансовых решений, таких как покупка дома или оформление кредитных карт, а также отслеживать любые изменения в привычках расходования средств. Эта функция первоначально будет доступна пользователям в США, подписавшимся на тарифный план ChatGPT Pro стоимостью $200 в месяц. В дальнейшем, по словам OpenAI, компания «будет учиться и совершенствовать сервис на ранних этапах использования, прежде чем внедрить его в тарифный план Plus, с целью сделать его доступным для всех». Этот запуск последовал за январским представлением OpenAI сервиса ChatGPT Health для решения вопросов, связанных со здоровьем, который в то же время «не предназначен для диагностики или лечения». Здоровье, как и деньги, требует от пользователей полного доверия к политике конфиденциальности и безопасности данных OpenAI. OpenAI обещает пользователям «контроль над своими данными», включая возможность в любое время отключить свои банковские счета от ChatGPT, хотя на полное удаление данных может потребоваться до 30 дней. Пользователи также смогут просматривать и удалять «финансовые воспоминания», такие как цели или финансовые обязательства, сохранённые чат-ботом. Пользовательский контроль распространяется и на передачу данных в модели ИИ — например, опция «Улучшить модель для всех» разрешит использование финансовых данных из разговоров в ChatGPT для обучения ИИ. OpenAI уверяет, что ChatGPT не может вносить изменения в банковские счета или видеть «полные номера счетов». Тем не менее чат-боту доступны балансы, транзакции, портфель акций и обязательства, такие как ипотека и задолженность по кредитным картам. OpenAI не уточняет, что сама компания будет делать со всей этой финансовой информацией помимо обучения ИИ и существуют ли какие-либо дополнительные меры защиты финансовых данных пользователей от взлома системы. «Более 200 миллионов человек уже ежемесячно обращаются в ChatGPT с финансовыми вопросами — от составления бюджета до советов о том, как сократить расходы, — говорится в заявлении OpenAI. — Теперь пользователи могут безопасно подключить свои финансовые счета к Plaid, чтобы получить полное представление о своих финансовых делах в контексте личных целей, образа жизни и приоритетов, которыми они поделились с ChatGPT, используя передовые возможности логического мышления OpenAI». Звучит заманчиво. И что же может пойти не так? Доминирование ChatGPT пошатнулось — Gemini и Perplexity быстро набирают обороты

15.05.2026 [18:38],

Павел Котов

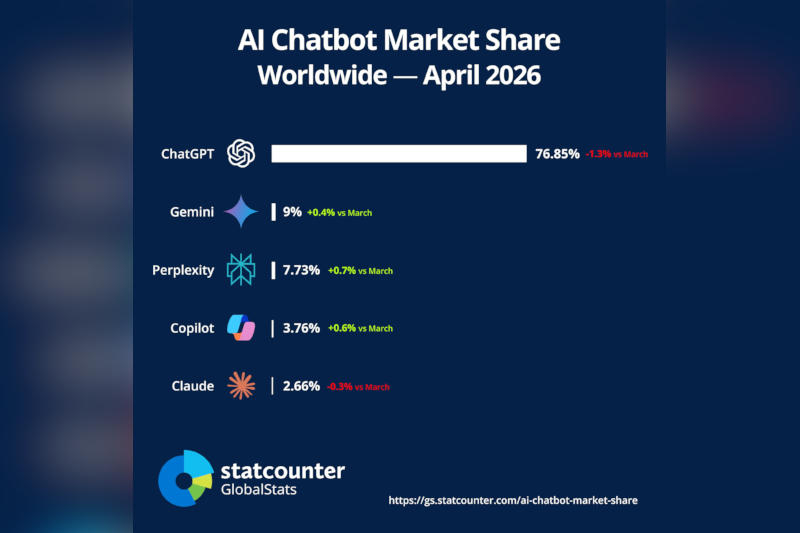

Сервис OpenAI ChatGPT теряет популярность, о чём можно судить по тому, как он постепенно теряет долю в реферальных ссылках — конкуренты чат-бота укрепляют свои позиции на рынке сервисов с искусственным интеллектом, обращает внимание Statcounter. Но и сейчас ChatGPT втрое превосходит всех конкурентов вместе взятых.

Источник изображения: statcounter.com По итогам апреля 2026 года на ChatGPT пришлись 76,85 % всех реферальных ссылок из чат-ботов с ИИ. Показатель лишь кажется высоким, но для ChatGPT он стал самым скромным после трёх месяцев снижения кряду — год назад доля составляла более 84 %. Google Gemini продолжает расти, достигнув исторического максимума в 9 % и удерживая второе место два месяца подряд. Компания упорно движется вперёд, развёртывая Gemini в поисковой системе, Android, Workspace и Chrome — в ближайшие месяцы показатель может преодолеть барьер в 10 %. Perplexity показал рост с 7,07 % до 7,73 % за месяц, восстановив часть потерянной за минувший год доли. Microsoft Copilot увеличил свою долю с 3,19 % до 3,76 %, но всё это ниже пиковых значений, пришедшихся на 2025 год. А вот Anthropic Claude показал падение за месяц с 2,91 % до 2,66 % — всё потому, что в марте платформа удвоила свою аудиторию на фоне конфликта с Пентагоном, и это естественный откат; для сравнения, в январе данный показатель составлял всего 0,92 %. Конкуренция на рынке чат-ботов с ИИ ожесточается, и трафик постепенно перетекает из ChatGPT в другие сервисы. Рынок фрагментируется, и приходит понимание, что ни один из игроков не может претендовать на постоянное доминирование. Google Gemini приближается к двузначной доле рынка, а в совокупности все остальные игроки уже набрали более 23 % реферальных ссылок. Владельцам сайтов, которые рассчитывают на трафик от ChatGPT, рекомендуется оптимизировать свои ресурсы и под другие сервисы генеративного ИИ: Gemini, Perplexity, Copilot и Claude. Вайбкодить теперь можно на ходу: в ChatGPT для смартфонов появился Codex

15.05.2026 [15:25],

Павел Котов

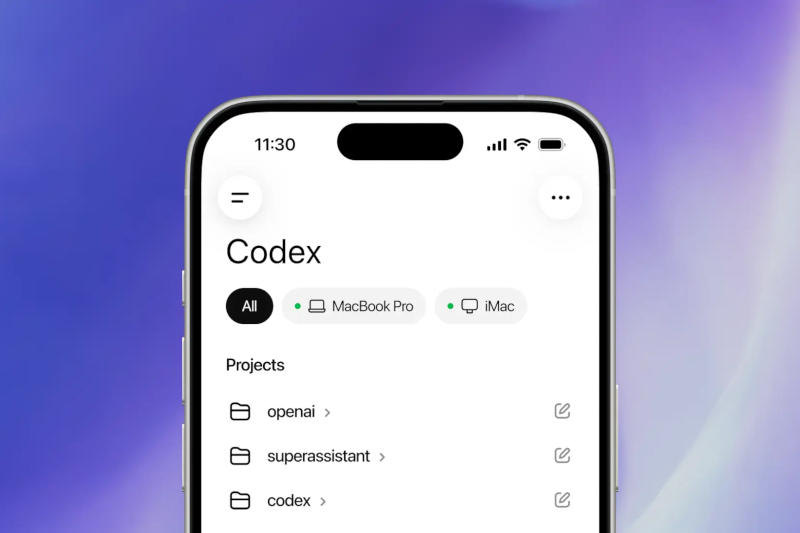

OpenAI сделала мобильное приложение ChatGPT полезнее для разработчиков, привыкших трудиться на ходу, — оно получило поддержку помощника по программированию Codex. Теперь прямо в приложении ChatGPT со смартфона можно отслеживать задачи написания кода и управлять ими.

Источник изображения: openai.com Новая функция пока доступна в качестве предварительной версии ChatGPT на Android и iOS — пользователи приложения могут удалённо взаимодействовать с запущенными на ПК сессиями Codex. В приложении можно просматривать сгенерированный код, подтверждать команды, переключать модели ИИ, запускать новые задачи и в реальном времени отслеживать текущие рабочие процессы. Еженедельная аудитория Codex составляет более 4 млн пользователей, сообщили в OpenAI, и теперь компания хочет сделать эти рабочие процессы менее привязанными к ПК. Новая функция, отмечает разработчик, поможет «оставаться в курсе событий из любого места», особенно если требуется что-то быстро согласовать или внести изменения, чтобы не задерживать проект. Пока функция работает только с Codex на Apple macOS, но в ближайшее время появится поддержка Windows. За последний год OpenAI расширила возможности Codex. Первоначально это был облачный агент для написания кода, способный исправлять ошибки, отвечать на вопросы по кодовой базе и предлагать запросы на слияние (pull requests). Недавно компания добавила функцию прямого взаимодействия Codex с приложениями под macOS и многозадачность для долгосрочных проектов. OpenAI может подать в суд на Apple из-за слабого продвижения ChatGPT

14.05.2026 [23:26],

Николай Хижняк

По словам Марка Гурмана (Mark Gurman) из Bloomberg, компания OpenAI собирается подать в суд на компанию Apple из-за «напряжённых» отношений с производителем iPhone. Проблема заключается в недостаточно глубокой интеграции ChatGPT и недостаточно усердном продвижении ИИ-бота.

Источник изображения: MacRumors В 2024 году компании заключили партнёрское соглашение, в рамках которого чат-бот ChatGPT от OpenAI был интегрирован в такие функции, как Siri и Image Playground в iOS, iPadOS и macOS. Пользователи iPhone также могут оформить подписку на ChatGPT напрямую через приложение «Настройки», при этом Apple получает часть дохода. Однако, как сообщается в статье, OpenAI рассчитывала на более глубокую интеграцию ChatGPT в дополнительные приложения Apple и на более заметное место в Siri. Руководители OpenAI также считают, что Apple недостаточно активно рекламировала интеграцию, из-за чего о ней узнало меньше пользователей. Изначально в OpenAI полагали, что сделка может принести миллиарды долларов в год в виде дохода от подписок, но этого «даже близко не произошло». Судя по всему, такие ожидания были связаны с тем, что Apple позиционировала соглашение как возможность, сравнимую с многомиллиардной сделкой с Google по поиску в Safari. Из-за культуры секретности в Apple в OpenAI не знали, как именно ChatGPT будет интегрирован в iPhone, iPad и Mac. «По сути, они сказали: "OpenAI должна довериться нам"», — рассказал Bloomberg неназванный представитель OpenAI. Он назвал сделку «провальной». «Мы сделали всё, что от нас зависело с точки зрения продукта. А они нет, и, что ещё хуже, они даже не приложили никаких усилий», — сказал представитель компании. Чтобы получить ответ от чат-бота OpenAI, пользователи Siri должны произнести или напечатать слово «ChatGPT». Ответы ChatGPT, отображаемые в интерфейсе Siri, содержат меньше информации, чем в приложении ChatGPT. Попытки OpenAI пересмотреть условия сделки, судя по всему, ни к чему не привели. По словам Гурмана, из-за сложившейся ситуации OpenAI рассматривает возможность подачи судебного иска против Apple. Сообщается, что разработчик чат-бота рассматривает различные варианты действий, в том числе отправку Apple письма с претензией о нарушении условий договора, без подачи полноценного иска. В OpenAI всё же надеются решить вопрос во внесудебном порядке. Ожидается, что в будущей iOS 27 появятся и другие чат-боты, такие как Gemini от Google и Claude от Anthropic, но, судя по всему, это не является поводом для недовольства со стороны OpenAI, поскольку их партнёрство с Apple никогда не было эксклюзивным. Согласно слухам, в приложении Siri для iOS 27 появится функция «Расширения» для других чат-ботов, что может способствовать популяризации ChatGPT. Однако на данный момент в OpenAI считают, что их интересы ущемляются. OpenAI вооружила европейские компании ИИ-моделью GPT-5.5-Cyber для защиты от хакеров

12.05.2026 [21:41],

Дмитрий Федоров

OpenAI открыла европейским компаниям доступ к своим последним ИИ-моделям, включая специализированную GPT-5.5-Cyber, для поиска уязвимостей в корпоративных системах. Среди участников программы — немецкие Deutsche Telekom и Scalable Capital, испанские BBVA и Telefonica, британская Sophos.

Источник изображения: Levart_Photographer / unsplash.com Программа Trusted Access for Cyber предоставляет верифицированным компаниям из ключевых отраслей — финансов, телекоммуникаций, энергетики и государственных услуг — доступ к моделям OpenAI с ограничениями, допускающими использование только в целях киберзащиты. Управляющий директор OpenAI по региону EMEA (Европа, Ближний Восток и Африка) Эммануэль Марий (Emmanuel Marill) заявил, что по мере роста возможностей ИИ важно соблюдать баланс между доступностью, полезностью и безопасностью. По его словам, необходимо блокировать опасную деятельность и одновременно обеспечивать проверенных специалистов по киберзащите инструментами, действительно полезными для защиты систем, обнаружения уязвимостей и быстрого реагирования на киберугрозы. Запуск ИИ-модели Mythos конкурентом OpenAI — компанией Anthropic — в прошлом месяце существенно повысил риски для банков и других компаний. Способность новых передовых ИИ-моделей программировать на высоком уровне дала беспрецедентные возможности для поиска уязвимостей и разработки способов их эксплуатации, что вызвало опасения относительно использования таких моделей для дестабилизации финансовых и иных организаций. OpenAI предложила Европейской комиссии открытый доступ к функциям кибербезопасности, сообщил Брюссель в понедельник, добавив, что Anthropic пока не проявила такой же готовности. Бывший министр финансов Великобритании Джордж Осборн (George Osborne), возглавляющий инициативу OpenAI for Countries, в понедельник направил в Еврокомиссию письмо, в котором указал, что демократизация доступа к инструментам киберзащиты способна укрепить коллективную безопасность и отвечает европейским приоритетам. OpenAI также объявила о создании новой компании с начальными инвестициями свыше $4 млрд для помощи организациям в разработке и внедрении ИИ-систем и о приобретении консалтинговой фирмы Tomoro для её ускоренного масштабирования. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |