|

Опрос

|

реклама

Быстрый переход

«Лучший на сегодня» ИИ-генератор изображений Google Imagen 4 стал доступен бесплатно для всех

25.06.2025 [12:23],

Владимир Мироненко

Компания Google представила ИИ-генератор изображений следующего поколения — Imagen 4, назвав его «лучшей на сегодняшний день моделью преобразования текста в изображение». «Imagen 4 предлагает значительно улучшенную визуализацию текста по сравнению с нашими предыдущими моделями и расширяет границы качества генерации изображений по тексту», — сообщила компания.

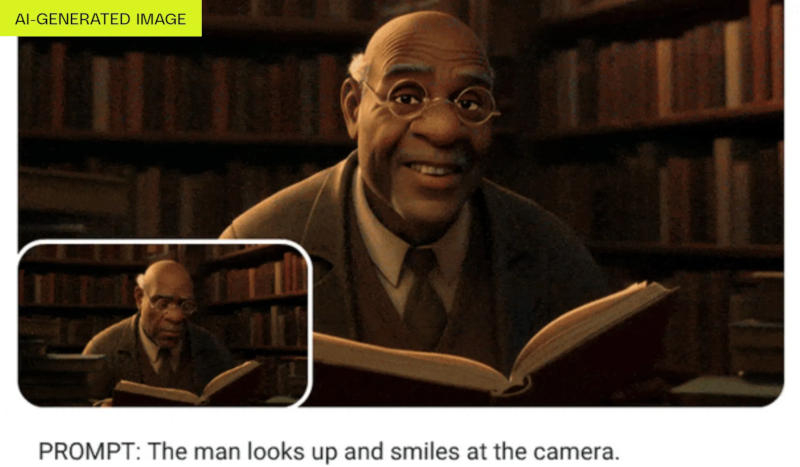

Источник изображений: Google Developers Blog Imagen 4 доступен в виде платной предварительной версии через API Gemini, а также для ограниченного бесплатного тестирования — в Google AI Studio. В настоящее время семейство Imagen 4 включает две модели: Imagen 4 и Imagen 4 Ultra. Модель преобразования текста в изображение Imagen 4 разработана для решения широкого спектра задач генерации изображений с существенным улучшением качества — особенно при работе с текстом — по сравнению с Imagen 3. Стоимость использования Imagen 4 составляет $0,04 за одно сгенерированное изображение.  Флагманская модель Imagen 4 Ultra предназначена для создания изображений, максимально точно соответствующих текстовым подсказкам пользователя, что позволяет добиться лучших результатов по сравнению с другими ведущими генеративными моделями. Стоимость одного изображения, созданного с помощью Imagen 4 Ultra, составляет $0,06. Все изображения, созданные моделями Imagen 4, получают маркировку в виде невидимого цифрового водяного знака SynthID. В «Google Презентациях» появился ИИ для генерации изображений Imagen 3 и другие инструменты для «потрясающих презентаций»

31.03.2025 [20:12],

Сергей Сурабекянц

Google представила несколько новых функций для «Презентаций», которые «упрощают создание визуально потрясающих презентаций». Пользователи теперь могут получить доступ к шаблонам, генерации изображений Imagen 3, новым компонентам дизайна и многим другим визуальным инструментам в новой боковой панели в правой части холста. Из новой боковой панели можно получить доступ к следующим функциям:

Google представила генератор картинок для тех, кто не любит писать — Whisk

17.12.2024 [12:54],

Павел Котов

Google анонсировала Whisk — основанный на искусственном интеллекте инструмент, который позволяет генерировать картинки, используя в качестве запроса другие изображения вместо длинных текстовых формулировок.

Источник изображения: blog.google Работая с Whisk, можно загружать изображения, используя образцы картинок в качестве основной темы, сцены или стиля. При желании можно дополнить их текстовыми подсказками; а если нужных картинок не окажется под рукой, система предложит свои — вероятно, также сгенерированные ИИ. Получив результат, можно добавить его в избранное или скачать; либо улучшить его, дополнив или отредактировав текстовый запрос. Whisk предназначается для «быстрого создания визуального эскиза, а не дотошного редактирования с точностью до пикселя»; он может «промахнуться», признают в Google, поэтому позволяет редактировать исходные подсказки. В основу сервиса лёг последний вариант генератора изображений Imagen 3, который подразделение Google DeepMind анонсировало вместе с генератором видео Veo 2 — мощный конкурент OpenAI Sora пока доступен лишь ограниченному кругу пользователей экспериментальной платформы VideoFX. Google запустила ИИ-генератор видео Veo, но вы вряд ли сможете его опробовать

04.12.2024 [17:40],

Павел Котов

Google Veo, новая модель искусственного интеллекта для генерации видеороликов, стала доступной для компаний, которые теперь могут подключать её к своим приложениям для создания контента. OpenAI представила аналогичную Sora на три месяца раньше, но работать с ней нельзя до сих пор, тогда как к Veo уже открыт предварительный доступ на платформе Google Vertex AI.

Источник изображения: Google Veo поддерживает генерацию видео «высокого качества» в разрешении 1080p в различных визуальных и кинематографических стилях по запросам в текстовом формате или в виде изображения. Во время анонса модели в мае эти ролики по продолжительности были немного длиннее минуты, но сейчас Google ограничений не указывает. Качество образцов действительно впечатляет: нужно очень внимательно всматриваться в видео, чтобы разглядеть признаки ИИ. Помимо Veo, все клиенты Google Cloud «со следующей недели» смогут подключить через Vertex AI генератор изображений Imagen 3. Некоторым будут доступны дополнительные функции: редактирование фотографий по текстовым запросам или возможность добавить на сгенерированное изображение свой фирменный стиль. Veo и Imagen 3, уверяет Google, имеют встроенные средства защиты, которые не позволят создавать вредоносный контент или нарушать авторские права. Созданные обеими моделям материалы получают маркировку SynthID, указывающую на причастность генеративного ИИ. Учитывая, что Google уже вывела свои продукты на рынок, OpenAI отстаёт от конкурентов, и у неё остаётся всё меньше времени, чтобы выполнить своё обещание и выпустить Sora до конца 2024 года. Продвинутый ИИ-художник Imagen 3 стал доступен всем пользователям Google Gemini

10.10.2024 [11:45],

Павел Котов

Как Google пообещала в августе, модель искусственного интеллекта для генерации изображений стала доступной для всех пользователей службы Gemini.

Источник изображения: x.com/GeminiApp Обновлённую модель Imagen 3, представленную в мае на мероприятии Google I/O 2024, по версии разработчика, отличают три аспекта:

Для создания изображений пользователям необходимо использовать в запросах к Gemini слова вроде «нарисуй» или «создай»; можно указать желаемый стиль, например, «фотореалистичная акварель» или «мультяшная иллюстрация»; помогут и детальные пояснения. В ответ чат-бот пояснит, что картинка создаётся при помощи Imagen 3; кроме того, скачиваемый файл получит пометку SynthID. Воспользоваться генератором изображений могут и пользователи бесплатных учётных записей, но для них возможности пока ограничены — система откажется создавать картинки с людьми. Первыми доступ к Imagen 3 получили англоязычные пользователи подписок Gemini Advanced, Business и Enterprise. Google открыла всем американским пользователям доступ к генератору изображений Imagen 3

16.08.2024 [17:31],

Павел Котов

Google без громких анонсов открыла всем пользователям из США доступ к последней модели генератора изображений с искусственным интеллектом Imagen 3 на платформе ImageFX. Компания также опубликовала исследовательскую работу, в которой подробно описывается эта технология.

Источник изображения: deepmind.google Модель Imagen 3 была анонсирована в мае на конференции Google I/O и выпущена в ограниченный доступ для пользователей платформы Vertex AI. «Представляем Imagen 3 — модель скрытой диффузии, которая генерирует высококачественные изображения по текстовым запросам. На момент проведения оценки Imagen 3 является более предпочтительной, чем другие современные модели», — говорится в научной работе. Выпуск Google нового генератора изображений для широкой общественности в США — важный стратегический шаг для компании, вступившей в гонку технологий ИИ. С одной стороны, разработчику удалось повысить качестве её работы, с другой — модель подвергается критике за излишне строгие фильтры контента. Пользователи Reddit, в частности, сообщают, что генератор изображений отклоняет до половины запросов, даже если не предлагать ему «нарисовать» нечто сомнительное — дошло до того, что он отказался создать изображение киборга. Это резко контрастирует с подходом стартапа Илона Маска (Elon Musk) xAI, который на этой неделе выпустил модель Grok-2. Она генерирует изображения практически без ограничений, допуская создание картинок с общественными деятелями и деталями, которые на других платформах считаются недопустимыми. Это тоже вызвало недоумение общественности и породило предположения, что на xAI будет оказываться давление. Перед отраслью ИИ встаёт вопрос о балансе между творчеством и ответственностью, а также возможном влиянии генераторов изображений на публичный дискурс и достоверность информации. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |