|

Опрос

|

реклама

Быстрый переход

Сэма Альтмана стали раздражать вопросы об огромных расходах OpenAI

03.11.2025 [13:55],

Владимир Фетисов

Генеральный директор OpenAI Сэм Альтман (Sam Altman) недавно заявил, что годовая выручка компании «существенно превышает» $13 млрд. При этом он выглядел несколько раздражённым, когда его спросили, как компания планирует компенсировать свои огромные расходы. Это произошло во время совместного интервью Альтмана и гендиректора Microsoft Сатьи Наделлы (Satya Nadella) для подкаста Bg2, выпуск которого был посвящён партнёрству компаний.

Источник изображения: wikipedia.org Ведущий подкаста Брэд Герстнер (Brad Gerstner) во время беседы упомянул, что выручка OpenAI в районе $13 млрд выглядит весьма внушительной, но она меркнет на фоне более $1 трлн, которые разработчик планирует потратить на развитие вычислительной инфраструктуры в течение следующего десятилетия. «Во-первых, наша выручка существенно больше этой суммы. Во-вторых, Брэд, если ты хочешь продать свои акции, я найду тебе покупателя. Я просто <…> хватит. Думаю, найдётся много желающих купить акции OpenAI», — ответил на это Альтман. «Включая меня», — добавил Герстнер. Затем Альтман добавил, что есть критики, которые «с наигранным беспокойством рассуждают о наших вычислительных мощностях или о чём-то ещё, но были бы рады купить наши акции». Он также добавил, что не часто хочет сделать OpenAI публичной компанией. «Один из редких случаев, когда это кажется привлекательным, — это когда люди пишут такие нелепые посты о том, что OpenAI вот-вот обанкротится. Мне бы хотелось сказать им, чтобы они открыли короткую позицию по нашим акциям, и я бы с удовольствием посмотрел, как они на этом обожгутся», — заявил Альтман. Он также признал, что есть варианты, при которых компания «может всё испортить». К примеру, OpenAI может оказаться не в состоянии обеспечить себе доступ к достаточному объёму вычислительных ресурсов. Однако он добавил, что «выручка растёт очень быстрыми темпами». «Мы делаем ставку на будущее, полагая, что рост продолжится: не только ChatGPT будет развиваться, нам также удастся стать одним из ключевых облачных сервисов для ИИ, наш бизнес потребительских устройств станет значимым, а способный автоматизировать науку ИИ создаст огромную ценность», — добавил Альтман. Наделла также отметил, что OpenAI «превзошла» все бизнес-планы, которые были предоставлены Microsoft как инвестору. Позднее Герстнер вернулся к теме выручки OpenAI, предположив, что компания может достичь $100 млрд выручки к 2028-2029 году. «А как насчёт 2027-го?» — парировал Альтман. Вместе с этим он опроверг сообщения о том, что OpenAI проведёт IPO в следующем году. «Нет, нет, нет, у нас нет ничего конкретного. Я реалист и предполагаю, что когда-нибудь это произойдёт, но я не понимаю, зачем люди высказывают такие предположения. У нас нет определённой даты, нет решения совета директоров сделать это или что-то подобное. Я просто предполагаю, что в конечном счёте всё пойдёт именно так», — заявил Альтман. Глава Microsoft признался, что экспансию инфраструктуры ИИ ограничивают проблемы с энергоснабжением

03.11.2025 [06:54],

Алексей Разин

Дефицит источников электроэнергии для строительства новых центров обработки данных не является откровением для многих участников отрасли, но в своём недавнем интервью генеральный директор Microsoft Сатья Наделла (Satya Nadella) признался, что эта корпорация от него страдает. Грубо говоря, запасы GPU превышают то их количество, которое может быть подключено к розетке.

Источник изображения: Nvidia Попутно, как поясняет Tom’s Hardware, Сатья Наделла выразил солидарность с основателем Nvidia Дженсеном Хуанг (Jensen Huang), который ранее заявлял, что избыток вычислительных мощностей рынку не грозит в ближайшие два или три года. По словам Наделлы, в этой сфере сложно достоверно предсказывать тенденции в изменении спроса и предложения, но существует долгосрочный тренд, описывающий зависимость вычислительных мощностей от генерирующих электроэнергию. «Честно говоря, главная проблема заключается не в избытке вычислительных мощностей, а электроснабжении — способности строить достаточно быстро и близко к источникам энергии», — охарактеризовал ситуацию Наделла. Если действовать подобным образом не удаётся, как продолжил глава Microsoft, существует риск появления запаса чипов на складах, которые нельзя запитать от электросети. «Фактически, с такой проблемой я имею дело сейчас. Проблемы с поставками чипов нет. На самом деле, не хватает зданий с возможностью подключения к сетям», — признался глава Microsoft. Проблема дефицита генерирующих мощностей действительно проявила себя в США, где строительство центров обработки данных идёт ударными темпами. На фоне нехватки источников электроэнергии тарифы начали расти с опережением инфляции, ударяя по всем отраслям национальной экономики. Всё чаще в качестве решения проблемы упоминаются идеи строительства небольших модульных ядерных реакторов в непосредственной близости от крупных вычислительных кластеров. OpenAI подобные опасения в части дефицита электроэнергии разделяет, а потому призывает власти страны вводить в строй по 100 ГВт генерирующих энергию мощностей ежегодно. Сэм Альтман (Sam Altman) в одном с Наделлой подкасте заявил, что когда-нибудь на рынок выйдут потребительские устройства, способные полностью работать с моделями уровня GPT-5 или GPT-6 с использованием только локальных аппаратных ресурсов при очень низком энергопотреблении. Маск и Альтман опять повздорили — на этот раз из-за отменённого заказа на Tesla Roadster

03.11.2025 [05:57],

Анжелла Марина

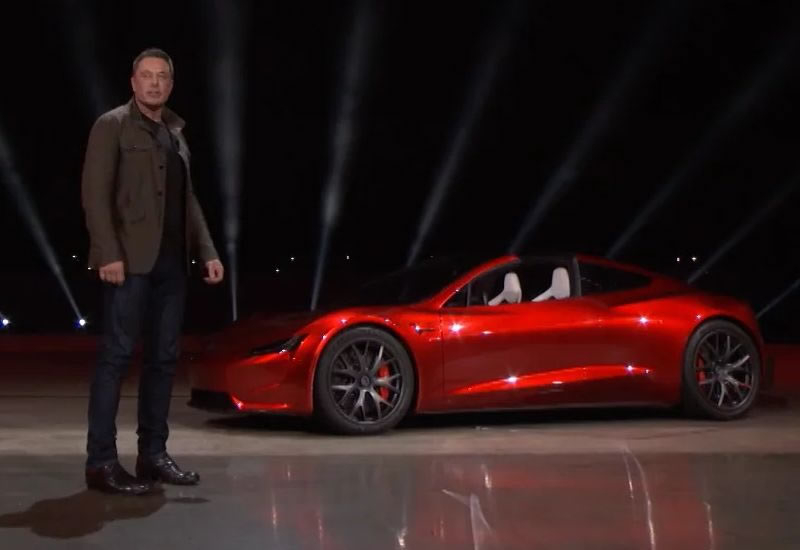

Илон Маск (Elon Musk) и глава OpenAI Сэм Альтман (Sam Altman) вновь обменялись резкими высказываниями на фоне давнего конфликта вокруг трансформации некоммерческой организации OpenAI в коммерческую структуру. Поводом для нового столкновения стало сообщение Альтмана о неудачной попытке вернуть депозит за оформленный в 2018 году предварительный заказ на электромобиль Tesla Roadster. В ответ Маск обвинил бывшего партнёра в том, что тот «украл некоммерческую организацию», намекая на изменение миссии OpenAI после её реструктуризации.

Источник изображения: Tesla Напомним, как все начиналось. OpenAI была основана в 2015 году как некоммерческий фонд с целью развития ИИ в интересах всего человечества с миссией бескорыстного развития AGI («сильный» искусственный интеллект). Маск был одним из соучредителей, но покинул организацию в 2018 году, сославшись на возможный конфликт интересов и недовольство коммерциализацией проекта. Позднее OpenAI создала коммерческую дочернюю структуру OpenAI PBC, которой управляет некоммерческая организация OpenAI Foundation. В прошлом году Маск подал иск против OpenAI и её руководства, утверждая, что они отошли от изначальной миссии, однако позже отказался от иска. На сегодняшний день ИИ-подразделение Маска — компания xAI, разработавшая чат-бот Grok, активно, а лучше сказать ожесточённо, конкурирует с OpenAI. Маск строит крупные дата-центры, закупает графические процессоры и планирует выпуск собственных чипов. Но в то время как xAI изначально создавалась как коммерческий проект, OpenAI придерживается гибридной модели: её некоммерческое крыло формально контролирует коммерческое, но зависит от его финансирования. Хотя последнее высказывание со стороны Маска в адрес коммерциализации OpenAI содержит определённую иронию, учитывая его собственные коммерческие амбиции, он настаивает на принципиальной разнице в намерениях компаний. Альтман не стал отвечать Маску, который завершил дискуссию в X смеющимся эмодзи, что было воспринято как демонстрация определённой победы над коллегой по цеху. ChatGPT перестал давать медицинские и юридические консультации — для блага пользователей

01.11.2025 [17:29],

Владимир Фетисов

Участники сообщества Reddit обратили внимание на изменение политики использования популярного ИИ-бота OpenAI ChatGPT. Алгоритм больше не даёт персонализированные медицинские и юридические консультации пользователям, а также не анализирует изображения медицинского характера, включая снимки МРТ, рентгеновские снимки, фотографии кожных поражений и др.

Источник изображения: Dima Solomin / unsplash.com Чат-бот отказывается отвечать на подобные вопросы, подчёркивая, что готов предоставить лишь общую информацию в образовательных целях, но не для постановки диагнозов или выбора лечения каких-либо заболеваний. Отмечается, что перестали срабатывать проходившие ранее уловки, когда ИИ-модель просили рассмотреть гипотетическую ситуацию, чтобы получить интересующую информацию. На этот раз срабатывает механизм защиты и ChatGPT предоставляет только общие консультации, а для более детального изучения проблемы рекомендует обратиться к соответствующему специалисту. Представители OpenAI не комментировали изменения в политике использования ChatGPT, но, скорее всего, они были внесены, чтобы избежать судебных разбирательств. По статистике, всё больше людей обращаются к чат-боту за медицинскими и юридическими консультациями, результат которых непредсказуем. При этом использование нейросетей в подобных задачах на данный момент регулируется слабо, что может создавать риски как для разработчиков, так и для пользователей. Ранее глава OpenAI Сэм Альтман (Sam Altman) предупреждал, что на беседы с ChatGPT не распространяются законы о врачебной и адвокатской тайне. Это означает, что суд может потребовать у компании раскрыть переписку, которая будет использоваться в качестве доказательств в ходе какого-либо разбирательства. OpenAI работает с регуляторами для уточнения правового статуса чат-бота, но пока результата достигнуть не удалось. Генеральный прокурор Делавэра пригрозила OpenAI судом в случае отклонения от гуманитарной миссии

01.11.2025 [08:23],

Алексей Разин

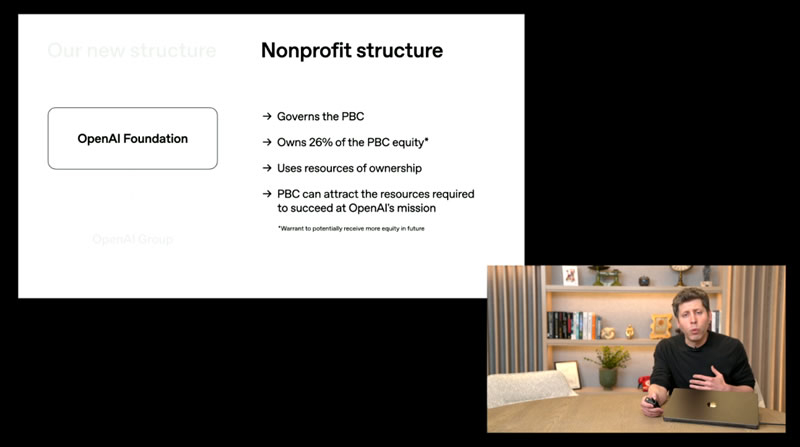

Реструктуризация стартапа OpenAI, на необходимости которой долго настаивали инвесторы, состоялась в прошлом месяце, превратив его в «корпорацию общественного блага». Генеральный прокурор штата Делавэр пригрозила компании судебным преследованием в случае отклонения от гуманитарной миссии ради извлечения прибыли.

Источник изображения: OpenAI Как поясняет Financial Times, в переговорах по реструктуризации с руководством OpenAI участвовали генеральные прокуроры сразу двух штатов — Калифорнии и Делавэра, в силу особенностей правовой системы США в области регистрации юридических лиц. Генеральный прокурор Делавэра Кэйти Дженнингс (Kathy Jennings) призналась ресурсу, что дала своё согласие на реструктуризацию OpenAI только при условии неукоснительного следования компанией гуманитарной миссии, заключающейся в создании искусственного интеллекта, используемого во благо всего человечества. Стремление компании отдать приоритет получению прибыли может повлечь неприятные последствия. Во всяком случае, генеральный прокурор Делавэра дала понять, что не станет колебаться и будет преследовать OpenAI в суде, если та отклонится от обозначенной миссии. Напомним, в результате реструктуризации ключевые стратегические решения сможет принимать некоммерческая OpenAI Foundation, которая сосредоточит в своих руках 26 % акций коммерческой OpenAI Group. Тем самым стартап намерен обеспечить главенство гуманитарной миссии над сопутствующими целями типа извлечения прибыли, которые чаще всего интересуют инвесторов. Условия сделки были закреплены документально вечером в понедельник, по итогам личных переговоров между генеральным директором OpenAI Сэмом Альтманом (Sam Altman) и генеральными прокурорами штатов Калифорния и Делавэр. При этом над финансовыми условиями сделки работали финансовые директора: Сара Фрайар (Sarah Friar, OpenAI) и Эми Худ (Amy Hood, Microsoft). Оформлению сделки предшествовали более года переговоров. В ходе переговоров с генеральными прокурорами двух штатов последние настояли на чётком определении в уставе OpenAI понятий, касающихся гуманитарной миссии стартапа и безопасности внедрения искусственного интеллекта. OpenAI также должна в случае появления на рынке ориентированного на сохранение безопасности ИИ конкурента объединить с ним усилия, если это будет способствовать созданию «сильного» искусственного интеллекта (AGI) в течение двух ближайших лет. Это условие было прописано в уставе OpenAI по требованию офиса генерального прокурора Делавэра и её коллеги из Калифорнии. OpenAI также согласилась назначить комитет по безопасности в совете директоров, который будет иметь право заблокировать выпуск на рынок новых больших языковых моделей, если те могут представлять опасность для человечества. Как поясняют эксперты, наличие подобных условий порождает определённые риски для инвесторов OpenAI. Руководство Microsoft, которая остаётся крупнейшим инвестором OpenAI, до сих пор выражает недовольство некоторыми определениями типа того же «сильного» искусственного интеллекта, поскольку идентифицировать момент его создания технически и юридически довольно сложно. OpenAI пришлось задобрить Microsoft обещаниями потратить до $250 млрд на облачную инфраструктуру первой из компаний, но реализация такого плана никак не привязана к графику, а потому не так уж сильно обременит стартап. В коммерческой OpenAI Group корпорации Microsoft достанутся 27 %, это даже больше, чем будет принадлежать некоммерческой OpenAI Foundation. При этом Microsoft получила право самостоятельно разрабатывать AGI и привлекать для этого конкурентов OpenAI, тогда как условия предыдущего соглашения между компаниями это запрещали. В ходе переговоров OpenAI настаивала на возможности изолировать значительную часть своих исследований в сфере AGI от Microsoft. Последняя продлила право пользования разработками OpenAI до 2032 года, а вот доступ к исследованиям стартапа Microsoft утратит двумя годами ранее, либо в тот момент, когда будет создан AGI. OpenAI представила ИИ-агента Aardvark для поиска и устранения уязвимостей в ПО

31.10.2025 [14:50],

Николай Хижняк

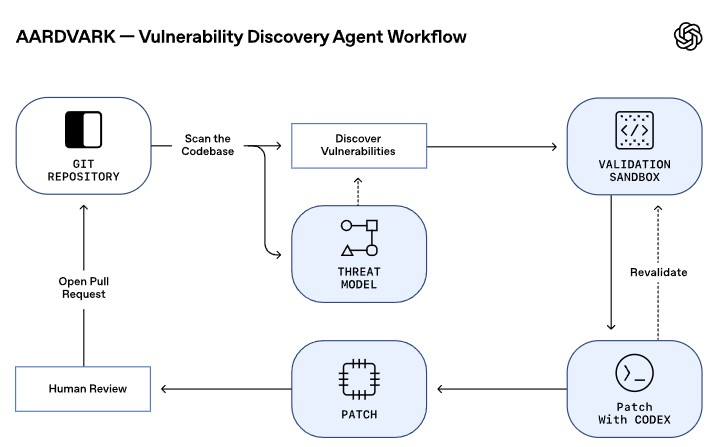

Компания OpenAI представила Aardvark — исследовательского ИИ-агента на базе GPT‑5 для поиска уязвимостей в программном обеспечении.

Источник изображений: OpenAI OpenAI отмечает, что каждый год в корпоративных и открытых кодовых базах обнаруживаются десятки тысяч новых уязвимостей. Эксперты сталкиваются с непростой задачей поиска и устранения уязвимостей раньше, чем это сделают злоумышленники. Aardvark представляет собой прорыв в исследованиях ИИ и безопасности. Это автономный агент, который может помочь разработчикам и командам безопасности обнаруживать и устранять уязвимости безопасности в больших масштабах. Aardvark постоянно анализирует репозитории исходного кода для выявления уязвимостей, оценки возможности их эксплуатации, определения степени серьёзности и предложения целевых исправлений. Он отслеживает коммиты и изменения в кодовых базах, выявляет уязвимости, определяет, как они могут быть использованы, и предлагает решения. Aardvark не использует традиционные методы анализа программ, такие как фаззинг или анализ композиции программного обеспечения. Вместо этого он использует рассуждения на основе LLM, а также инструменты для понимания поведения кода и выявления уязвимостей. Aardvark ищет ошибки так же, как это делает исследователь безопасности: читая код, анализируя его, создавая и запуская тесты, используя инструменты и многое другое.  Aardvark использует многоступенчатый конвейер для выявления, объяснения и устранения уязвимостей:

Хотя Aardvark создан для обеспечения безопасности, OpenAI в ходе тестирования обнаружила, что агентный ИИ также может выявлять выявлять логические ошибки, неполные исправления и проблемы с конфиденциальностью. Aardvark уже несколько месяцев непрерывно работает с внутренними кодовыми базами OpenAI и кодовыми базами внешних партнёров. В OpenAI он выявил серьёзные уязвимости и внёс вклад в повышение безопасности ПО. В ходе бенчмарк-тестирования на «золотых» репозиториях Aardvark выявил 92 % известных и искусственно созданных уязвимостей, продемонстрировав высокую полноту и эффективность в реальных условиях. Aardvark также применялся к проектам с открытым исходным кодом, где он обнаружил многочисленные уязвимости, десяти из которых были присвоены идентификаторы Common Vulnerabilities and Exposures (CVE). OpenAI отмечает, что собирается предлагать бесплатное сканирование избранных некоммерческих репозиториев с открытым исходным кодом, чтобы внести свой вклад в безопасность экосистемы программного обеспечения с открытым исходным кодом и цепочки поставок. Недавно компания обновила свою политику скоординированного раскрытия информации, которая ориентирована на разработчиков, сотрудничество и масштабируемость воздействия, а не на жёсткие сроки раскрытия информации, которые могут оказывать давление на разработчиков. Сейчас Aardvark доступен в закрытой бета-версии для проверки и улучшения своих возможностей в реальных условиях. OpenAI приглашает избранных партнёров присоединиться для получения раннего доступа и совместной работе напрямую с командой OpenAI над улучшением точности обнаружения, рабочих процессов валидации и качества отчётности. OpenAI научила GPT-5 лучше выявлять психические и эмоциональные расстройства пользователей

31.10.2025 [14:05],

Павел Котов

OpenAI 5 октября выпустила обновлённую модель искусственного интеллекта GPT-5, которая научилась эффективнее обнаруживать проблемные состояния пользователей, в том числе признаки наличия у них эмоциональных или психических расстройств.

Источник изображения: BoliviaInteligente / unsplash.com Обновление коснулось только базовой «нерассуждающей» модели GPT-5 Instant. Это одна из самых быстрых и недорогих в эксплуатации моделей OpenAI — она большую часть времени используется по умолчанию, особенно при работе с пользователями, у которых бесплатная учётная запись. Когда пользователь переписывается с ChatGPT, и система выявляет у него признаки проблемного состояния, она автоматически перенаправит запрос в GPT-5 Instant. «Для перенаправления деликатных фрагментов разговоров, например, с демонстрацией признаков острого стресса, мы до настоящего времени применяли наш маршрутизатор реального времени для перенаправления на рассуждающие модели. Теперь при ответах на подобные запросы GPT-5 Instant работает так же хорошо, как GPT-5 Thinking», — говорится на странице поддержки OpenAI. Обновлённые версии моделей, подчеркнули в компании, были разработаны при участии экспертов по психическому здоровью — ChatGPT научился снижать градус напряжённости в переписке. Обнаружив у пользователя признаки расстройства, чат-бот рекомендует ему обратиться к ресурсам, призванным помочь справляться с кризисными ситуациями, а также начинает формулировать свои ответы жизнеутверждающе, чтобы вызвать у человека чувство наличия поддержки. Ещё одно нововведение ChatGPT — доступ к контексту организации через подключённые приложения, в том числе Slack, SharePoint, Google Drive, GitHub, HubSpot и Asana. Схожим образом работает Microsoft 365 Copilot. OpenAI добавила в Sora камео и объединение видео

30.10.2025 [18:16],

Павел Котов

В приложении OpenAI Sora теперь можно делать серии генерируемых искусственным интеллектом роликов, которые объединяет общий персонаж — «камео» (Cameo). Среди прочих нововведений значатся возможность объединять ролики в единый ряд, а также рейтинги лидеров — авторов наиболее популярных видео и камео.

Источник изображения: OpenAI О функции камео в компании рассказали на минувшей неделе — это расширенный вариант появившейся ранее возможности вставлять в видео Sora ИИ-версии самого себя и позволять делать то же другим пользователям платформы. Теперь добавлять в несколько видео можно домашних животных, картинки и другие предметы. На начальном этапе доступен набор готовых персонажей, которых можно добавлять в ролик — для каждого персонажа действует набор разрешений: можно оставить его только для себя, открыть к нему доступ для своих подписчиков или для всех пользователей Sora. Этому персонажу можно дать имя и ник, а также сопоставить ему теги. Функция камео доступна для сгенерированных Sora персонажей, но непонятно, актуально ли это для созданных другими средствами ИИ вымышленных людей, и насколько они могут быть фотореалистичными. Если можно загрузить изображение реального человека, то непонятно, как администрация платформы отличит его. На платформе OpenAI Sora также появилась возможность склеивать видео и получать один длинный ролик из нескольких коротких; дебютировали также рейтинги лидеров, которые публикуют наиболее популярные видео и создают наиболее популярных персонажей. Накануне OpenAI на ограниченное время сделала открытой регистрацию в Sora для жителей США, Канады, Японии и Южной Кореи. OpenAI собралась выйти на биржу в 2027 году с оценкой в $1 трлн

30.10.2025 [12:25],

Алексей Разин

Реструктуризация бизнеса OpenAI, которая формально состоялась на этой неделе, открывает перед стартапом путь к первичному размещению акций, способному оценить его капитализацию в умопомрачительный $1 трлн. Помимо прочего, подготовку к намеченному на 2027 год IPO способствовало и решение руководства OpenAI сохранить штаб-квартиру в Калифорнии.  Публикация на эту тему появилась вчера на страницах The Wall Street Journal. Источники сообщили, что почти две недели назад генеральный директор OpenAI Сэм Альтман (Sam Altman) встретился с генеральным прокурором Калифорнии Робом Бонтой (Rob Bonta) для обсуждения условий намеченной реструктуризации. Если бы власти штата не разрешили её провести, OpenAI могла бы переехать в другой штат с точки зрения адреса регистрации бизнеса, лишив Калифорнию потенциально крупных налоговых поступлений. При этом Сэм Альтман старался заверить прокурора штата, что OpenAI хочет остаться в нём и заняться развитием бизнеса. Взаимопонимание было найдено, и прокурор одобрил преобразования в организационной структуре OpenAI, на которой настаивали стремительно множащиеся инвесторы во главе с Microsoft. Если говорить о самом IPO, то оно может состояться и позже 2027 года, либо вообще быть отменено, поскольку пока подготовка к первичному размещению акций OpenAI находится на ранних стадиях. Альтман публично заявил во вторник, что выход на IPO вполне вероятен, но у компании нет конкретного графика его подготовки. Под давлением активистов и общественности прокурор Калифорнии настоял, чтобы по итогам реструктуризации главенствующую роль сохранила некоммерческая организация OpenAI Foundation, а у властей штата сохранялось достаточное влияние на деятельность стартапа. По данным источника, на решение прокурора Калифорнии согласовать схему реструктуризации OpenAI повлияло и общение с мэром Сан-Франциско, который убеждал его, насколько для этого города важно сохранить штаб-квартиру и регистрацию компании на прежнем месте. В случае, если бы переговоры с OpenAI пошли не в благоприятном русле, прокурор Калифорнии был готов добиваться желаемых итогов через суд. Одним из важных требований являлось сохранение независимости совета директоров некоммерческой структуры во главе OpenAI.  Подготовка к реструктуризации для OpenAI сопровождалось определённого вида агитационной работой. Она опубликовала несколько отчётов, в которых рассказывалось о преимуществах внедрения её технологий для экономики Калифорнии, а также о динамике развития бизнеса самой компании, которая в первом полугодии привлекла в свой капитал 68 % всех венчурных инвестиций в США. Руководству OpenAI также пришлось согласиться внедрить ряд защитных механизмов, которые задействуются при использовании её чат-бота детьми и подростками. В состав совета директоров некоммерческой части OpenAI вошёл комитет по безопасности, который наделён правом сдерживать выпуск новых языковых моделей, если они будут несовершенны с данной точки зрения. Агентство Reuters позже сообщило, что заявку на первичное размещение акций OpenAI намеревается подать во второй половине 2026 года, и минимальная сумма привлечения средств будет стартовать с отметки $60 млрд. Финансовый директор OpenAI Сара Фрайар (Sarah Friar) якобы упоминала в общении с партнёрами компании, что выход на IPO запланирован лишь на 2027 год. Впрочем, некоторые консультанты считают, что он может состояться и в конце 2026 года. Представители компании утверждают, что подготовка IPO не входит с число приоритетных целей OpenAI на ближайшее время. Логично предположить, что рано или поздно шанс выйти на биржу будет использован компанией для привлечения капитала на фондовом рынке. Сейчас капитализация OpenAI оценивается в $500 млрд, делая компанию самым дорогим стартапом в мире. При этом приведённый к году размер выручки OpenAI едва достигнет $20 млрд в конце текущего года, а убытки растут едва ли не быстрее. Сэм Альтман прокомментировал обсуждение IPO компании следующим образом: «Я думаю, что будет справедливо считать его самым вероятным путём для нас, учитывая те потребности в капитале, которые у нас есть». Инвестиции в OpenAI обернулись для Microsoft потерей $3,1 млрд чистой прибыли

30.10.2025 [10:45],

Павел Котов

Из-за крупных объёмов инвестиций в OpenAI чистая прибыль Microsoft по итогам I квартала 2026 финансового года (закончился 30 сентября) сократилась на $3,1 млрд, а прибыль на акцию уменьшилась на $0,41, сообщил софтверный гигант в ходе квартального отчёта. Тем не менее, в сравнении с аналогичным периодом прошлого года оба показателя выросли: чистая прибыль составила $27,7 млрд или $3,72 в пересчёте на акцию — было $24,67 млрд и $3,30 соответственно.

Источник изображения: OpenAI Microsoft стала инвестором OpenAI в 2019 году, и с тех пор обязалась вложить в разработчика искусственного интеллекта $13 млрд — по состоянию на конец сентября $11,6 млрд из этой суммы уже выплачены. Ранее OpenAI объявила о завершении рекапитализации, закрепив структуру некоммерческой организации с контрольным пакетом акций коммерческой компании. Некоммерческой организации, теперь именуемой OpenAI Foundation, принадлежит пакет акций коммерческого подразделения на сумму $130 млрд. В соответствии с новой структурой OpenAI Foundation владеет 26 % акций коммерческого подразделения, и ещё 47 % владеют нынешний и бывшие сотрудники, а также инвесторы. Microsoft выступает инвестором в «корпорацию общественного блага» и владеет активами на сумму $135 млрд или 27 % с учётом разводнённой стоимости. В соответствии с соглашением OpenAI заключила контракт на приобретение дополнительных услуг Azure на сумму $250 млрд, и у софтверного гиганта больше нет приоритета как у поставщика вычислительных ресурсов. Гендиректор Microsoft заявил инвесторам, что эти отношения между двумя компаниями являются «одним из самых успешных партнёрств и инвестиций в истории отрасли», и что «мы продолжаем получать взаимную выгоду от роста друг друга по многим направлениям». Они наладили сотрудничество задолго до запуска ChatGPT в конце 2022 года, но сейчас всё активнее конкурируют в различных сегментах рынка ИИ. В прошлогоднем годовом отчёте Microsoft официально причислила OpenAI к конкурентам наравне с Apple, Google, Meta✴✴ и Amazon. OpenAI считается конкурентом Microsoft в области ИИ-решений, поисковой и новостной рекламы. Сегодня многие из функций ИИ в продуктах Microsoft основаны на моделях OpenAI, но уже сейчас софтверный гигант тестирует собственные модели в стремлении расширить с их помощью возможностей ассистента Copilot. OpenAI представила две почти открытые модели для систем безопасности

29.10.2025 [17:56],

Павел Котов

OpenAI представила две рассуждающие модели искусственного интеллекта, предназначенные для обнаружения различных угроз безопасности на интернет-платформах. Они доступны по лицензии с открытыми весами.

Источник изображения: Andrew Neel / unsplash.com Новые открытые модели OpenAI получили названия gpt-oss-safeguard-120b и gpt-oss-safeguard-20b — последние показатели свидетельствуют о числе параметров. Это адаптированные версии анонсированных в августе бесплатных gpt-oss. Новые варианты также доступны с открытыми весами, то есть предлагают пользователям прозрачность и контроль, но это не модели с полностью открытым исходным кодом. Организации могут настраивать их в соответствии со своими требованиями политики — модели выводят цепочки рассуждений, а значит, у разработчиков будет представление о том, как они приходят к тому или иному результату. Так, на сайте с обзорами модели серии gpt-oss-safeguard помогут для фильтрации отзывов, которые они сочтут поддельными; аналогичным образом на игровом форуме они смогут автоматически удалять сообщения о читерских схемах. OpenAI разработала их совместно с Discord, SafetyKit и организацией ROOST, которая специализируется на инфраструктуре безопасности для систем ИИ. Модели доступны в формате предварительных версий для исследователей — OpenAI хочет собрать отзывы экспертов. Cameo подала в суд на OpenAI из-за названия новой функции в Sora

29.10.2025 [17:55],

Владимир Фетисов

Когда OpenAI запустила своё приложения Sora, одной из основных функций его был инструмент Cameo, с помощью которого можно добавить изображение любого человека в генерируемые видео. Теперь же разработчик приложения Cameo, которое продаёт короткие видео с поздравлениями от знаменитостей, подал в суд на OpenAI, обвинив компанию в незаконном использовании бренда Cameo.

Источник изображения: OpenAI В исковом заявлении сервиса сказано, что использование OpenAI бренда Cameo приведёт к путанице среди пользователей, а также повлияет на узнаваемость самого приложения Cameo. «Действиями, которые описаны в иске, OpenAI умышленно присвоила хорошо зарекомендовавший себя, зарегистрированный на федеральном уровне товарный знак, проигнорировав явный риск введения потребителей в заблуждение и непоправимый ущерб, который будет нанесён истцу, который является владельцем прав на бренд Cameo, а также самому товарному знаку», — говорится в исковом заявлении Cameo. OpenAI занимается изучением иска, но уже заявила, что «не согласна с тем, что кто-либо может претендовать на получение исключительных прав на слово камео». На этом фоне представитель Cameo сообщил, что компания пыталась мирно урегулировать претензии, но OpenAI отказалась прекратить использование слова Cameo в своём приложении. Напомним, сервис Cameo позволяет создавать короткие персонализированные видео со знаменитостями по цене от $30 до $600. Приложение Sora задействует генеративные нейросети для создания видео. Отметим, что приложение OpenAI сразу привлекло к себе массу внимания, поскольку позволяло пользователям генерировать ролики с лицензированными аниме-персонажами, а также задействовать образы умерших знаменитостей и других объектов, защищённых законом. OpenAI пообещала создать «полноценного» ИИ-учёного к 2028 году

29.10.2025 [05:44],

Анжелла Марина

Компания OpenAI заявила о стремительном прогрессе своих систем глубокого обучения, которые смогут выполнять функции учёных-исследователей уровня стажёра к сентябрю 2026 года, а уровень автономного «полноценного ИИ-исследователя» может быть достигнут уже к 2028 году. Об этом в ходе прямого эфира во вторник сообщил генеральный директор компании Сэм Альтман (Sam Altman).

Источник изображения: Zac Wolff/Unsplash Амбициозные временные рамки были озвучены в тот же день, когда OpenAI завершила переход от некоммерческой структуры к статусу компании, работающей в интересах общества (public benefit corporation). Эта реструктуризация освобождает OpenAI от ограничений, связанных с её первоначальным уставом, и открывает новые возможности для привлечения капитала. Главный научный сотрудник OpenAI Якуб Пачоки (Jakub Pachocki), который также участвовал в трансляции, пояснил, что под «ИИ-исследователем» подразумевается система, способная автономно выполнять крупные исследовательские проекты. Он добавил, что, по мнению компании, сверхразумные системы, превосходящие человека по интеллекту в широком спектре критически важных действий, могут быть созданы методами глубокого обучения менее чем за десятилетие.

Источник изображения: OpenAI, techcrunch.com Для достижения этих целей OpenAI сделает ставку на два ключевых направления: постоянные алгоритмические усовершенствования и радикальное увеличение вычислительных ресурсов на этапе вывода, то есть времени, которое модель тратит на размышление над поставленной задачей. В настоящее время такие модели способны работать в рамках примерно пяти часов и показывать результаты, сопоставимые с людьми, участвующими в Международной математической олимпиаде. Однако, как отметил Пачоки, эти рамки будут быстро расширяться за счёт выделения значительно больших вычислительных мощностей. OpenAI намерена использовать ИИ для ускорения научных исследований, включая медицину, физику и разработку технологий, чтобы совершать открытия быстрее людей и решать более сложные задачи. В процессе реорганизации некоммерческий фонд OpenAI Foundation, сфокусированный на научном прогрессе, получит 26 % акций коммерческого подразделения и будет определять направления исследований. Фонд также взял на себя обязательство объёмом $25 млрд по использованию ИИ для лечения болезней и будет курировать инициативы в области безопасности искусственного интеллекта. Покупки прямо в ChatGPT можно будет оплачивать через PayPal

28.10.2025 [19:19],

Павел Котов

Платёжный сервис PayPal объявил о поддержке функции OpenAI Instant Checkout, благодаря которой в 2026 году пользователи ChatGPT смогут оплачивать покупки прямо в диалоге с искусственным интеллектом.

Источник изображения: newsroom.paypal-corp.com Для реализации этой возможности PayPal развернула поддержку разработанного OpenAI открытого протокола Agentic Commerce Protocol (ACP). Эта спецификация позволяет продавцам размещать свои товары прямо в ИИ-приложениях, а покупка их осуществляется с помощью ИИ-агентов. В сентябре OpenAI запустила функцию Instant Checkout, которая позволяет пользователям ChatGPT подтверждать заказы, оформлять доставку и проводить оплату, не выходя из чат-бота. Теперь потребители смогут рассчитываться в ChatGPT с помощью кошельков PayPal, что обеспечивает защиту как для покупателей, так и для продавцов и даёт возможность разрешать споры; доступна также оплата картой. При помощи PayPal в следующем году можно будет прямо из ChatGPT покупать товары в таких категориях как одежда и мода, косметика, товары для дома и электроника. Продавцам не потребуется проводить никаких интеграций — всю маршрутизацию и обработку платежей PayPal возьмёт на себя. PayPal также готовит пакет решений для «агентской коммерции», с которыми продавцы смогут размещать свои каталоги в ИИ-приложениях и собирать статистику о действиях потребителей. Компания активно сотрудничает с разработчиками ИИ-сервисов — в мае она заключила партнёрское соглашение с Perplexity, в результате которого поисковая служба стала показывать в выдаче товары с возможностью их покупки; в сентябре она помогла реализовать «агентские платежи» в сервисах Google. PayPal призналась также, что пользуется инструментами OpenAI как корпоративный клиент — доступ к ним есть у всех сотрудников, а инженеры оптимизировали свою работу при помощи Codex — средства для написания программного кода. OpenAI стала «компанией общественного блага» и больше не обязана играть по правилам Microsoft

28.10.2025 [18:09],

Сергей Сурабекянц

После более чем года переговоров OpenAI с генеральными прокурорами Калифорнии и Делавэра реструктуризация компании в конечном итоге была одобрена. Коммерческое подразделение компании OpenAI Group PBC получило статус «корпорации общественного блага» (Public Benefit Corporation, PBC). Некоммерческая часть называется OpenAI Foundation и «владеет акциями в коммерческой организации, которая в настоящее время оценивается примерно в 130 миллиардов долларов».

Источник изображения: unsplash.com Изначально OpenAI планировала реструктуризацию и создание коммерческой компании, которая не будут подконтрольна материнской некоммерческой организации. В последние несколько месяцев планы были изменены — некоммерческая организация OpenAI будет владеть пакетом акций на сумму до $100 млрд и продолжит осуществлять надзор за компанией. На такое решение повлиял, в частности, сложный и затяжной судебный процесс, инициированный Илоном Маском (Elon Musk), который подал в суд как на OpenAI, так и на генерального директора Сэма Альтмана (Sam Altman), пытаясь остановить преобразование. Маск стал соучредителем OpenAI в 2015 году как некоммерческой исследовательской лаборатории, но через некоторое время вышел из проекта. Один из вопросов, вызвавших споры в прошлом году и до сих пор остающихся без окончательного ответа, заключается в том, сохранит ли некоммерческая организация OpenAI контроль над своей базовой технологией, включая потенциальное создание «сильного искусственного интеллекта» (Artificial General Intelligence, AGI), который сможет достичь человеческих когнитивных способностей или превзойти их. Создание и внедрение AGI — это основная мотивация OpenAI и других участников продолжающегося бума ИИ, требующего всё больше финансовых, человеческих и энергетических ресурсов. По словам OpenAI, в ближайшее время компания выделит $25 млрд на здравоохранение, болезни и «устойчивость к ИИ». Некоммерческая организация также получит «дополнительную долю собственности» после того, как коммерческая организация OpenAI достигнет неуказанного рубежа оценки. В рамках реструктуризации OpenAI заключила совершенно новое соглашение с Microsoft, в соответствии с которым доля Microsoft в OpenAI изменилась с 32,5 % в коммерческой компании до 27 % в новой общественной корпорации (в пересчёте на «разводненную долю в пересчёте на всех владельцев»). Эта доля оценивается примерно в $135 млрд.  Также Microsoft, похоже, наконец-то избавилась от одного из главных камней преткновения в своих отношениях с OpenAI. По ранее заключённым соглашениям, Microsoft теряла права на технологии OpenAI после достижения компанией уровня AGI, что казалось Microsoft слишком расплывчатым определением. Новое соглашение внесло ясность в ситуацию. Во-первых, теперь факт создания AGI должен быть подтверждён независимой экспертной комиссией, а не базироваться лишь на заявлении OpenAI. Кроме того, права интеллектуальной собственности Microsoft как на модели, так и на продукты продлены до 2032 года и теперь включают модели, созданные после AGI, с соответствующими мерами безопасности. Однако права Microsoft на исследования OpenAI будут действовать только до 2030 года или до момента, когда экспертная комиссия подтвердит достижение AGI, в зависимости от того, что наступит раньше. Права интеллектуальной собственности позволяют Microsoft получать доступ к конфиденциальным методам, используемым при разработке моделей и систем, и включают модели, предназначенные исключительно для внутреннего использования или исследовательских целей. Также права интеллектуальной собственности Microsoft теперь не распространяются на потребительское оборудование OpenAI, а это означает, что исследования, лежащие в основе устройства, которое компания разрабатывает совместно с бывшим главным дизайнером Apple Джони Айвом (Jony Ive), теперь недоступны для Microsoft. Ранее заключённое соглашение о распределении доходов останется в силе, пока создание AGI не будет подтверждено экспертной комиссией, но выплаты будут осуществляться в течение более длительного периода. Microsoft и OpenAI также ещё больше смягчили эксклюзивный характер своего партнёрства. Теперь OpenAI может сотрудничать со сторонними организациями для разработки некоторых продуктов и выпускать открытые модели, а Microsoft больше не будет иметь преимущественного права на предоставление вычислительных ресурсов OpenAI. OpenAI также заключила контракт на приобретение дополнительных сервисов Azure на сумму $250 млрд. Обновлённое соглашение даёт Microsoft право «разрабатывать AGI самостоятельно или в партнёрстве с третьими сторонами», что должно ещё сильнее подхлестнуть конкуренцию в этой сфере. По сообщениям финансовых экспертов, если бы OpenAI не объявила о завершении реструктуризации до Нового года, она могла бы потерять до $10 млрд ранее объявленных инвестиций от SoftBank. Сегодня в 13:30 по восточному времени (21:30 по московскому времени) OpenAI проведёт прямую трансляцию с участием Сэма Альтмана и главного научного сотрудника компании Якуба Пахоцки (Jakub Pachocki). |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |