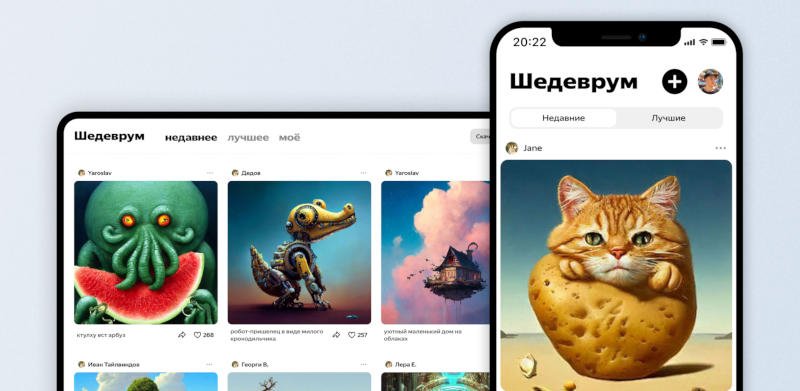

Компания «Яндекс» рассказала о прототипе нейросети, способной генерировать изображения по текстовым описаниям. Посмотреть результаты её работы может любой желающий — для этого достаточно скачать приложение «Шедеврум» для Android или iOS.

Источник изображений: Яндекс

Нейросеть работает с текстовыми описаниями на русском и английском языках, причём рекомендуется излагать пожелания максимально конкретно: ИИ выполняет работы в разных художественных стилях, подражает известным живописцам и понимает инструкции вроде «фотореализма» и «высокой детализации». Получив текстовое описание, ИИ создаёт базовую версию картинки, после чего в несколько шагов увеличивает её разрешение и добавляет новые детали — такой метод называется каскадной диффузией.

На этапе бета-теста первую версию генеративной модели обучили на 240 млн изображений и соответствующих им текстовых описаний. Работа продолжается — новый объём данных включает 500 млн примеров, поэтому качество работы «Шедеврума» постепенно вырастет.

К финальному релизу, рассказал руководитель управления машинного интеллекта и исследований «Яндекса» Алексей Гусаков, нейросеть будет генерировать «баннеры, иллюстрации, создавать изображения для интернет-витрин и не только», но пока это не более чем источник хорошего настроения для пользователей.

Сейчас в приложениях «Шедеврум» можно преимущественно лишь знакомиться с результатами работы нейросети, отмечая понравившиеся изображения в ленте. Собственное описание для генерации изображения пока можно предложить в формате заявки и дождаться её подтверждения. Но в перспективе это ограничение планируют снять, и отправлять свои описания смогут все зарегистрированные пользователи.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018

Подписаться

Подписаться