|

Опрос

|

реклама

Быстрый переход

Глава ИИ в Microsoft раскритиковал Anthropic за попытки приписать Claude проблески сознания

10.06.2026 [10:39],

Павел Котов

Глава отдела Microsoft AI Мустафа Сулейман (Mustafa Suleyman) назвал «очень, очень опасными» попытки Anthropic строить предположения, что у её моделей искусственного интеллекта Claude возникают признаки сознания.

Источник изображения: Mustafa Suleyman «Мне кажется, некоторые сотрудники Anthropic настолько очеловечили алгоритмы Claude, что тот, в свою очередь, обманул их, заставив поверить в проблески сознания, которые они изначально в него заложили. <..> Мы не хотим иметь дело со сверхразумом, обладающим представлениями о собственных чувствах и страданиях», — заявил эксперт в интервью подкасту Decoder. В «конституции», то есть задокументированных основах строения Claude, напрямую прописана неуверенность Anthropic в том, обладает ли модель ИИ ощущением благополучия, и испытывает ил она такие чувства как «удовлетворённость» и «дискомфорт». Компания заявляет о намерении «опрашивать» модели ИИ, когда они будут устаревать, и документировать их «предпочтения» в отношении последующих релизов. Господин Сулейман назвал такое отношение разработчика к продукту «философской ошибкой»: компания Anthropic превратила конституцию модели ИИ в «место для размышлений, как в научной статье, а не в механизм обучения». В итоге ИИ-модель Claude и усвоила эти «тезисы о себе и своём обучении». Глава Anthropic Дарио Амодеи (Dario Amodei) ранее не исключил, что у Claude есть сознание, заявив, что «мы не знаем обладают ли модели сознанием», но компания «открыта» для идей об этом. «Вот этого от ИИ нам не нужно. Мы хотим, чтобы ИИ был управляемым, подотчётным и согласованным инструментом, служащим человечеству», — подчеркнул Мустафа Сулейман. «Алиса» в поиске «Яндекса» почти перестала ссылаться на сайты вне первой десятки выдачи

10.06.2026 [09:41],

Павел Котов

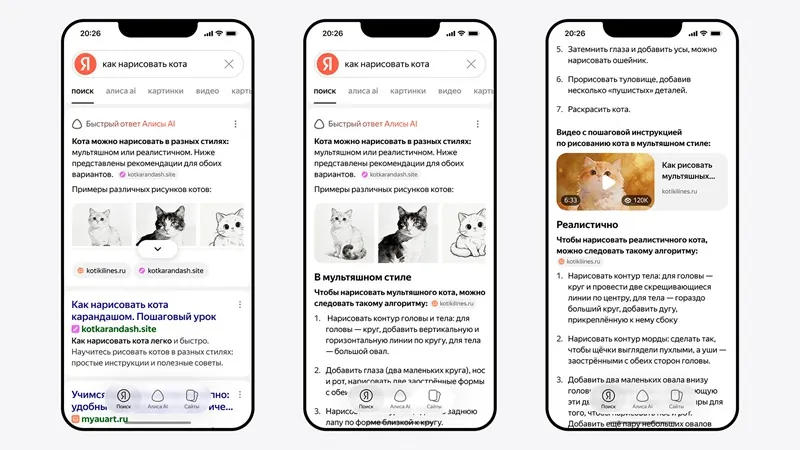

Служба нейроответов «Алисы» в поиске «Яндекса» чаще всего ссылается на сайты, которые занимают верхние позиции в основной выдаче. Доля ресурсов, не входящих в первую десятку, с августа 2025 по январь 2026 года сократилась в ответах «Алисы» вчетверо и достигла 10 %. Об этом сообщил «Коммерсантъ» со ссылкой на данные исследования компании «Ашманов и партнёры».

Источник изображения: «Яндекс» Вероятность попадания случайного ресурса в ответ поискового искусственного интеллекта сейчас крайне невелика, указывают эксперты — обычно «Алиса» цитирует сайты из первой десятки в органической выдаче по большинству запросов, а ещё чаще ИИ обращается к сайтам из пятёрки. Ещё в середине прошлого года поисковый ИИ «Яндекса» обращался к более широкому набору источников — в него попадали даже те, что не входят в первую тридцатку основной выдачи. Благодаря этому пользователи имели возможность познакомиться с материалами сайтов небольших компаний, которые редко попадают в верхушку. Сейчас «Яндекс», по мнению экспертов, ужесточил механизм выбора источников, чтобы снизить присутствие менее релевантных. С тех пор, как «Яндекс» и Google развернули службы ИИ-ответов в поиске, люди стали реже переходить на сайты — они довольствуются перепиской с ИИ. Трафик информационных ресурсов потерял до 30 %, в нейроответы чаще всего попадают ресурсы крупного бизнеса, а органический поиск всё реже оказывается бесплатным источником посетителей. В «Яндексе», однако, наличие таких закономерностей отвергают, настаивая, что сайты попадают в ответы «Алисы» исходя не из их позиций в поиске, а по критериям «экспертности и содержательности контента». С одной стороны, ИИ-ответы становятся важным маркетинговым каналом для бизнеса, указывают эксперты, с другой, из-за роста популярности этого сервиса доля «Яндекса» в распределении трафика существенно упала. Поэтому при поисковой оптимизации становится особенно важно уделять внимание тексту ответа и тому, как в нём представляется бренд. Еврокомиссия требует от Meta✴ восстановить доступ конкурирующих ИИ-агентов к WhatsApp

10.06.2026 [08:13],

Алексей Разин

В декабре прошлого года власти Евросоюза начали антимонопольное расследование в отношении компании Meta✴✴ Platforms, которая, по их мнению, предоставляла собственным ИИ-сервисам при работе через WhatsApp необоснованное преимущество по сравнению со сторонними. Теперь Еврокомиссия требует восстановить доступ сторонних ИИ-сервисов в WhatsApp.

Источник изображения: Unsplash, 𝕡𝕒𝕨𝕤 𝕒𝕟𝕕 𝕡𝕣𝕚𝕟𝕥𝕤 По мнению европейских чиновников, данный шаг направлен на поддержание условий здоровой конкуренции на период проведения антимонопольного расследования, которое, исходя из имеющейся практики, может затянуться надолго. «На быстро развивающихся рынках конкуренция может быть проиграна задолго до принятия окончательного вердикта», — заявила еврокомиссар по конкуренции Тереза Рибера (Teresa Ribera), на слова которой ссылается Financial Times. По мнению регулятора, у жителей Европы должен быть выбор среди ИИ-ассистентов, которые они готовы использовать в связке с WhatsApp, и «никто не имеет права принимать это решение за них». Данные меры со стороны европейских регуляторов накладываются на выход Meta✴✴ в корпоративный сегмент ИИ-решений. Компании могут использовать свою учётную запись в мессенджере WhatsApp для автоматизации общения с клиентами, используя ИИ-агенты. За доступ к такой возможности корпоративные пользователи WhatsApp должны платить, поэтому инициатива властей ЕС вызывает у представителей Meta✴✴ справедливое раздражение. Формально, конкуренты типа OpenAI получают возможность использования платного сервиса WhatsApp Business на безвозмездной основе для продвижения собственных решений, как отмечается в заявлении Meta✴✴, и подобный «регуляторный перегиб» компания готова оспаривать в суде. Китай всё ещё получает запрещённые ИИ-серверы через Тайвань — США требуют закрыть лазейку

10.06.2026 [07:15],

Алексей Разин

Демонстрируя общую политическую лояльность США, Тайвань на практике до сих пор не ввёл пропорциональные ограничения в области экспортного контроля, а потому китайские компании сохраняют возможность закупать на острове готовые серверные системы с ИИ-чипами, которые власти США не разрешают туда поставлять. Обсуждение возможного усиления мер контроля в этой сфере уже ведётся, поэтому ситуация может измениться.

Источник изображения: Wiwynn Дело в том, как поясняет Bloomberg, что даже недавние обвинения в контрабанде ИИ-систем в Китай в юрисдикции Тайваня выдвигались по факту подделки документов, а не нарушения правил экспортного контроля. Формально тайваньские законы никак не препятствуют поставкам ИИ-чипов в Китай, хотя соответствующие предостережения местным компаниям и делаются для создания видимости солидарности с властями США. Под нажимом американских коллег власти острова готовятся закрепить эти ограничения на законодательном уровне. Возможно, консультации с участием чиновников с обеих сторон состоятся в ближайшее время. При этом нельзя утверждать, что власти Тайваня полностью игнорируют усилия США по консолидации ограничительных мер в отношении Китая. В прошлом году тайваньские власти включили китайские компании Huawei Technologies и SMIC в перечень нежелательных для взаимодействия с представителями тайваньского бизнеса. При этом все прочие китайские компании формально сохранили право закупать продукцию с Тайваня, даже если речь идёт о передовых ИИ-чипах. Сейчас власти Тайваня рассматривают возможность введения фильтра для всех китайских покупателей ИИ-чипов, ориентируясь на американские правила экспортного контроля. Если изменения будут приняты, то китайские компании утратят возможность закупать без оформления лицензий ускорители с уровнем быстродействия выше Nvidia H200 и AMD Instinct MI325X. Как ожидается, это серьёзно подорвёт бизнес многих тайваньских производителей серверных систем, поскольку в текущих условиях они сохраняют возможность поставок в Китай почти полного спектра оборудования для инфраструктуры ИИ. Им грозят санкции США, но именно со стороны тайваньского законодательства претензий к такой деятельности почти не возникало. Кроме того, в американском парламенте зреет инициатива по усилению контроля за производством чипов на Тайване по заказам китайских компаний, поэтому поставками готовых систем дело не ограничится. По информации Bloomberg, синхронизация усилий США по сдерживанию технологического развития Китая с прочими азиатскими государствами тоже идёт не так гладко, как хотелось бы американским чиновникам. В частности, Малайзия под нажимом Трампа хоть и взяла на себя обязательства адаптировать национальные правила экспорта ИИ-оборудования под американское законодательство, на практике пока не торопится внедрять соответствующие меры. Сингапур, который для той же Nvidia является крупнейшим финансовым хабом, не проявляет интереса по внедрению пропорциональных мер экспортного контроля, предпочитая ориентироваться на исходно национальное законодательство. Впрочем, профилактическую работу с участниками внешнеэкономической деятельности власти Сингапура всё равно ведут. Китай направит $295 млрд на строительство ЦОД для ИИ в ближайшие пять лет

09.06.2026 [13:59],

Алексей Разин

Не только США или ЕС формируют национальные программы развития отрасли искусственного интеллекта. По данным Bloomberg, китайские власти намерены в ближайшие пять лет направить на эти цели около $295 млрд, возводя центры обработки данных для ИИ по всей стране.

Источник изображения: Baidu Вполне ожидаемо, что выделяться эти средства будут главным образом на реализацию проектов, подразумевающих высокую степень локализации компонентов. Помимо прочего, проект позволит объединить в общую скоростную сеть разрозненные ЦОД в различных уголках Китая. Над разработкой программного документа трудятся ведущие правительственные ведомства КНР, как поясняет источник. Государственным телекоммуникационным гигантам China Mobile и China Telecom будет поручена роль оператора создаваемой национальной сети ЦОД, а ещё они предсказуемо будут отвечать за организацию скоростного обмена данными между региональными кластерами. Доля китайских ИИ-чипов в инфраструктуре возводимых ЦОД должна превысить 80 %, как предполагает проект инициативы. Компонентам Huawei Technologies в этом смысле будет отведена одна из ключевых ролей. Анонсированная в прошлом году китайскими властями инициатива «Шесть сетей» будет интегрирована в новую программу развития национальной ИИ-отрасли. Подход к созданию инфраструктуры будет комплексным: помимо сетей передачи данных, будут формироваться все инженерные коммуникации и электроснабжение в адекватных объёмах. На финансирование проекта будут направлены средства государственных фондов, предусматривается и выпуск целевых долгосрочных облигаций со сроком погашения более 10 лет. Банковские кредиты и частные инвестиции будут играть вспомогательную роль в финансировании программы. Эксперты считают, что создание единой национальной вычислительной сети позволит китайским разработчикам ускорить вывод на рынок всё более совершенных ИИ-моделей, а также откроет равный доступ к новым технологиям компаниям, разбросанным по всей территории КНР. Создание национальной вычислительной инфраструктуры является одной из приоритетных целей на ближайшую пятилетку (до 2030 года) для экономического развития страны. Указанная сумма в $295 млрд не включает частных инвестиций со стороны китайских компаний, которые они готовы направить на развитие собственных ЦОД. В любом случае, американские техногиганты только в этом году на подобные цели готовы потратить $725 млрд, поэтому пятилетний бюджет КНР на этом фоне немного меркнет. Опять же, строительство ЦОД и объектов инфраструктуры в Китае обходится дешевле реализации аналогичных проектов в США, поэтому сравнивать указанные суммы напрямую не совсем корректно с точки зрения возможной отдачи. Всеобщая сеть для объединения ЦОД в Китае должна появиться к 2028 году. С учётом затрат на ввод в строй генерирующих мощностей и электросетей бюджет китайской программы может вырасти до $738 млрд. От импорта передовых чипов Nvidia китайские власти отказываются даже при наличии некоторых послаблений со стороны США, но одновременно они одобрили к использованию в национальной вычислительной инфраструктуре девять моделей ИИ-чипов китайской разработки, включая решения Huawei, Alibaba, Biren Technology и Moore Threads. Как считают эксперты, создание национальной сети вычислительных центров для ИИ в Китае будет способствовать устранению цифрового неравенства среди удалённых районов страны, поскольку в технологическом и экономическом плане юго-восточная часть КНР традиционно опережала остальную территорию. Sony придумала, как вернуть былую славу смартфонам Xperia — их камеры напичкают ИИ-функциями

09.06.2026 [13:33],

Алексей Разин

Японская компания Sony хоть и является ведущим поставщиком датчиков изображения для камер смартфонов, сама в данном сегменте рынка особых успехов не добилась. Выходящий в этот четверг флагманский смартфон Xperia призван исправить положение дел, поскольку его камера будет наделена актуальными функциями, подразумевающими активное использование ИИ.

Смартфон Sony Xperia 1 VII Издание Nikkei Asian Review напоминает, что в натуральном выражении смартфоны Sony у себя на родине по итогам прошлого года заняли только седьмое место, уступив не только Apple, но и Google, Samsung, Sharp, FCNT и даже китайской Oppo. Отчасти это можно объяснить тем, что действующий флагман Xperia 1 VII страдал от заводского дефекта, который приводил к произвольному выключению смартфона или его перезагрузке. Продажи пришлось приостановить на два месяца, после чего локализовать проблему и объявить отзыв продукции. Бизнес Sony по производству смартфонов балансировал на грани выживания, но японский гигант всё же решил сохранить его, назвав такие устройства важной платформой для разработки перспективных решений, включая датчики изображений, а также кластером телекоммуникационных технологий. Когда в январе Sony объявила о реструктуризации бизнеса по выпуску телевизоров, фактически передав его под контроль китайской TCL, появились слухи о вероятности отделения бизнеса по выпуску смартфонов. Свою линейку смартфонов 2026 модельного года Sony ориентирует на создателей контента, причём не только профессиональных, но и любителей. При работе с камерой пользователям будет предложен ИИ-ассистент, который самостоятельно выберет схему цветокоррекции и настроит фокус с учётом типа съёмки и окружающих условий. Настройки будут рассортированы по фильтрам со словесным описанием, между которыми пользователь сможет выбирать при съёмке на смартфон. Конкурирующие технологии Apple и Google позволяют осуществлять цветокоррекцию снимков и увеличивать мелкие объекты вплоть до 100-кратного масштаба. По замыслу Sony, компания должна предоставить возможность делать профессиональные снимки даже тем, кто далёк от искусства фотографии. Новый флагман Xperia 1 VIII уже поступил в продажу в Гонконге, на Тайване и в Европе. Он оказался на 30 % популярнее предшественника, и это позволяет компании предположить, что новинка пользуется спросом, особенно среди молодёжи. Кодзима оказался «не заинтересован» в ИИ на фоне массовой критики ИИ-рекламы Prada с его участием

09.06.2026 [13:27],

Михаил Романов

Японский гейм-дизайнер Хидео Кодзима (Hideo Kojima) в интервью The Washington Post прокомментировал возможности генеративного ИИ для реализации творческих задач на фоне массовой критики ИИ-рекламы Prada со своим участием. Напомним, в короткометражном ИИ-фильме Satellites II прославленный разработчик вместе с режиссёром Николасом Виндингом Рефном (Nicolas Winding Refn) предстал в виде космического путешественника на пути к мероприятию Prada. Пользователи в комментариях массово раскритиковали Рефна, Кодзиму и Prada за продвижение ИИ в творческих задачах. «Грустно видеть, как такие великие творцы опускаются до генеративного ИИ-мусора», — посетовал один из зрителей. Судя по всему, среди недовольных роликом оказался и сам Кодзима. В недавнем разговоре с The Washington Post гейм-дизайнер заявил о полном отсутствии интереса к применению ИИ в своём творчестве. «Искусство — жизнь. Через 50, 100 лет, не знаю. Может, ИИ и сможет творить, но пока я жив, думаю, этого не будет. Я не заинтересован. Мы найдём хороший способ использовать технологию, и это задача молодых людей», — уверен Кодзима. Ранее Кодзима уже признавался, что не заинтересован в создании игр с помощью нейросетей, но не стал исключать перспективности ИИ для модификации органов управления или «оживления» NPC. В настоящее время возглавляемая Кодзимой японская студия Kojima Productions готовит к релизу загадочный хоррор OD и шпионский экшен нового поколения под кодовым названием Physint. «ИИ для людей»: Apple противопоставила Siri AI стратегиям OpenAI и Google

09.06.2026 [10:13],

Павел Котов

В последние годы Apple нередко обвиняли в том, что она заняла положение отстающей в гонке в области ИИ. Высказывалось даже мнение, что у компании отсутствует чёткая стратегия по направлению ИИ, она уже лишилась преимущества перед конкурентами, и iPhone грозит спад продаж.

Источник изображения: apple.com Теперь Apple представила крупнейшее обновление экосистемы в области ИИ — сервис и приложение Siri AI с поддержкой автоматизации стороннего ПО на основе модели Google Gemini. Трудно сказать, заставит ли это скептиков изменить позицию по поводу отставания компании. Важно другое: будут ли владельцы устройств Apple фактически пользоваться этими функциями, и если будут, то поможет ли это её бизнесу? Позицию компании сформулировал старший вице-президент по разработке ПО Крейг Федериги (Craig Federighi): «Некоторые, кажется, устремились вперёд, разрабатывая ИИ ради самого ИИ, не обращая должного внимания на людей — всех нас, — кому он призван в конечном итоге служить. Наша в Apple миссия всегда заключалась в том, чтобы превратить потенциал передовых технологий в полезные и интуитивно понятные продукты для всех». С одной стороны, он ответил на критику Apple, с другой — указал на недостатки отрасли ИИ, знакомые потребителям. И, наконец, ответил тем, кто опасается лишиться работы из-за ИИ — компания позиционирует себя как разработчика ИИ, выступающего на стороне человека. Siri научилась находить информацию в дебрях почтовой переписки и истории сообщений и предлагать подсказки на основе этих данных; анализировать данные на экране устройств; и, наконец, находить актуальную информацию в интернете. ИИ-помощник теперь хранит историю переписки и позволяет возвращаться к важным темам. С такими средствами Apple сможет противостоять разработчикам сторонних приложений с ИИ, захвативших первые места в рейтинге App Store — когда продукты с теми же возможностями интегрированы в ОС, они становятся грозными конкурентами. Но говорить об этом можно будет не раньше, чем обновлённая Siri заработает в полную мощь для широкой аудитории. Пока ясно лишь одно: Apple делает всё возможное, чтобы привлечь свою аудиторию — независимо от того, будет та пользоваться новыми продуктами, или нет. Контраст с конкурентами показателен — считающаяся лидером отрасли ИИ OpenAI до сих пор не может определиться, кто её основной клиент: бизнес или потребитель. А Meta✴✴ вкладывает в ИИ колоссальные средства, не объясняя инвесторами, какое это отношение имеет к её основном рекламному бизнесу. Подход Apple теперь представляется более взвешенным и финансово обоснованным: на этот год у неё запланированы $14 млрд капитальных затрат — другие техногиганты довели этот показатель до $900 млрд. При этом на минувший квартал пришлись рекордные продажи iPhone — компания продолжает зарабатывать колоссальные деньги, тратя при этом меньше конкурентов. Apple Intelligence сможет самостоятельно исправлять скомпрометированные пароли

09.06.2026 [10:13],

Анжелла Марина

Apple анонсировала новую функцию в приложении Passwords, которая позволяет автоматически заменять слабые и скомпрометированные пароли. Технология использует Apple Intelligence и браузер Safari для выполнения действий от лица пользователя. Функция расширяет существующую возможность приложения по обнаружению ненадёжных или раскрытых учётных данных, сообщает MacRumors.

Источник изображения: macrumors.com Ранее Passwords только предупреждал о проблемах с данными, но для их исправления требовалось вручную переходить на каждый сайт и менять пароль. Новая система полностью автоматизирует этот процесс и работает по принципу агента, который осуществляет навигацию по веб-сайтам, выполняет вход в аккаунты и обновляет учётные записи для входа без необходимости вмешательства пользователя (после первоначального подтверждения). В момент выполнения операции статус процесса отображается в виде активности в реальном времени (Live Activity) на экране устройства. Внедрение этой возможности направлено на устранение барьеров при поддержании «цифровой гигиены» и повышение общего уровня безопасности пользовательских данных, а автоматизация рутинных процедур позволяет сократить время, необходимое для реагирования на утечки конфиденциальной информации или использование ненадёжных комбинаций символов. Техническая реализация обеспечивает бесшовное взаимодействие между iOS и веб-интерфейсами сторонних ресурсов. Стартап Perplexity заявил, что не торопится с IPO и проведёт его не ранее 2028 года

09.06.2026 [09:40],

Алексей Разин

За последние две недели свои намерения выйти на IPO подтвердили три стартапа из сегмента ИИ, совокупная капитализация которых превышает $3 трлн — это Anthropic, xAI (SpaceX) и OpenAI. Конкурирующая Perplexity сообщает, что подобная активность конкурентов никак не влияет на её планы выйти на биржу только в 2028 году.

Источник изображения: Perplexity Генеральный директор Perplexity Аравинд Сринивас (Aravind Srinivas) признался в этом ресурсу CNBC. По его словам, на IPO этот стартап выйдет в 2028 году вне зависимости от итогов размещения акций Anthropic и OpenAI. Глава стартапа также отметил, что негативные последствия для отрасли могут иметь место при условии, если IPO указанных компаний пройдут не совсем успешно. На этой неделе состоится IPO компании SpaceX, и оно во многом определит, как разместят свои акции Anthropic и OpenAI. Впрочем, генеральный директор Perplexity больше склоняется к благоприятному исходу IPO всех перечисленных компаний. Как он считает, если в течение шести месяцев OpenAI и Anthropic не продемонстрируют прогресса своих ИИ-моделей, то у них могут возникнуть проблемы с точки зрения доверия инвесторов. Пока же этого не происходит, а потому обе компании заслуживают высоких оценок капитализации, по мнению Сриниваса. Сервис Perplexity предлагает выбор между несколькими конкурирующими ИИ-моделями, учитывая сопутствующие расходы. Например, как пояснил глава компании, если модель с открытым исходным кодом в 90 % случаев справляется с заданиями, и при этом в десять или двадцать раз дешевле передовых проприетарных решений, то имеет смысл применять именно её. «Передовой ИИ ждёт прекрасное будущее, но тратить деньги бездумно никто не будет, как мы могли увидеть за несколько предыдущих месяцев», — заявил глава Perplexity. OpenAI подала заявку на IPO, но пока не раскрывает его сроки и параметры

09.06.2026 [08:22],

Алексей Разин

Компания OpenAI, которая номинально является стартапом, на этой неделе сама сообщила о подаче предварительной заявки на IPO американскому регулятору SEC, чтобы пресечь слухи на эту тему. Правда, параметры готовящегося размещения акций амбициозным разработчиком ChatGPT пока скрыты от широкой публики, как не упоминается и дата предстоящего IPO.

Источник изображения: OpenAI В публикации на собственном сайте OpenAI скромно поясняет, что до выхода на биржу хотела бы «сделать некоторые шаги, которые проще сделать, являясь частной компанией». По словам представителей стартапа, есть сложный набор уступок в данном процессе, а потому если в определённый момент станет понятно, что можно выйти на биржу пораньше, компания это сделает. По неофициальным данным, IPO стартапа предварительно намечено на осень текущего года. В идеале, OpenAI хотела бы оценить свою капитализацию в $1 трлн, тем самым присоединившись к конкурирующим Anthropic и входящей в состав SpaceX компании xAI Илона Маска (Elon Musk). Напомним, что текущая капитализация Anthropic достигает $965 млрд, а SpaceX в совокупности с xAI тянет на сумму $1,78 трлн. Обе компании подали заявку на IPO, причём вторая проведёт его на текущей неделе. В условиях, когда нужно соперничать за средства инвесторов, OpenAI решила особо не тянуть с подачей заявки. Что характерно, ещё до выхода на IPO стартап планирует позволить существующим акционером продать свои акции, исходя из мартовской оценки капитализации в $852 млрд. Кроме того, известно о ведении руководством OpenAI переговоров с американским правительством, которое тоже может получить пакет акций стартапа. Глава OpenAI Сэм Альтман (Sam Altman) в своём блоге написал, что сейчас стартап переживает третью фазу своего существования. На первом этапе компания занималась исследованиями в области создания сильного искусственного интеллекта. На втором она пыталась стать «продуктовой компанией» и понять, как люди используют её инструменты. Третья фаза подразумевает трансформацию экономики вокруг ИИ, компания теперь должна определить, как сделать такую технологию общедоступной, безопасной и полезной. OpenAI запустила проект Economic Research Exchange для изучения влияния ИИ на экономику

09.06.2026 [04:24],

Анжелла Марина

OpenAI объявила о запуске платформы Economic Research Exchange для поддержки независимых исследований о влиянии искусственного интеллекта на компании, работников, госучреждения и экономику в целом.

Источник изображения: AI В рамках структурированного проектного сотрудничества отобранные специалисты получат доступ к наборам данных разработчика, чтобы на их основе изучить трансформацию рабочих процессов в компаниях. Подобное взаимодействие позволит экспертам выйти за рамки традиционных методов анализа, поскольку они смогут задействовать внутренние алгоритмы OpenAI. Участники программы сформируют проекты, основываясь на определённых этапах, процессах управления информацией и механизмах экспертной оценки. Для этого создатели платформы пригласили к участию исследователей с сильными эмпирическими навыками и знаниями в таких областях как экономика труда, государственные финансы, прикладной причинно-следственный анализ, а также региональное развитие. Новая концепция стала продолжением более широких усилий OpenAI по улучшению измерения экономических последствий от ИИ-технологий, которые ранее уже включали проект OpenAI Signals, представляющий из себя аналитическую платформу, созданную для измерения того, как внедряется и используется ИИ в разных странах и компаниях. Поддерживая портфель независимых исследовательских проектов, OpenAI надеется расширить базу данных, доступную исследователям, политикам, предприятиям и общественности в период быстрых технологических изменений. Комиссия оценит поступающие предложения на основе их методологической строгости, реалистичности и потенциала для создания достоверной доказательной базы о последствиях внедрения новых технологий. Приём заявок на участие в программе завершится 5 июля 2026 года. После тщательного рассмотрения всех материалов организаторы сообщат о результатах отбора и уведомят победителей до 31 июля 2026 года. Apple представила visionOS 27 с поддержкой Siri AI и изогнутых окон

08.06.2026 [23:17],

Николай Хижняк

Компания Apple представила visionOS 27 — новую версию операционной системы для гарнитуры дополненной реальности Vision Pro. Как и другие представленные сегодня операционные системы для продуктов Apple новая visionOS 27 включая обновлённого голосового помощника Siri AI и новое специальное приложение Siri. Используя Vision Pro, можно с помощью визуального интеллекта задавать Siri вопросы «о чём угодно в физическом или цифровом пространстве».

Источник изображений: Apple Бета-версия visionOS 27 для разработчиков доступна с сегодняшнего дня, а публичная бета-версия появится в следующем месяце. Полноценный запуск visionOS 27 состоится осенью. Apple заявляет, что Siri AI появится в бета-версии позже в этом году и первоначально будет поддерживать только английский язык. В отличие от Siri AI на iPhone и iPad, она будет доступна с момента запуска в ЕС без задержки. Новая visionOS 27 добавит возможность использования сделанных пользователем панорамных изображений в качестве виртуальных иммерсивных сцен и окружений. По словам Apple, новая операционная система позволяет Vision Pro «до трёх раз быстрее» подключаться к Wi-Fi, а добавление поддержки «сверхмалого» размера виджетов расширит возможности кастомизации цифрового пространства. При получении уведомлений на Vision Pro пользователи смогут разворачивать их, просто взглянув на них. Центр управления в visionOS 27 также получил обновлённый внешний вид и три отдельных раздела: уведомления и воспроизведение, основные элементы управления и окружения.  В visionOS 27 также добавлена поддержка изогнутых окон, которые приближают края контента к пользователю, не занимая при этом лишнего пространства. Первыми приложениями с поддержкой изогнутых окон станут Safari, Freeform и Multiview на Apple TV. В прошлогоднем обновлении visionOS была добавлена поддержка игровых контроллеров PS VR2, прокрутка без помощи рук с использованием функции «Прокрутка взглядом», возможность разблокировки iPhone во время использования Vision Pro, поддержка ретрансляции звонков с iPhone и улучшенная версия 3D-аватаров Apple Persona. Также были представлены пространственные виджеты, которые остаются в любой точке физического пространства, где пользователь их «размещает». Европейцы не получат Siri AI вместе с iOS 27 — Apple винит в этом закон DMA

08.06.2026 [22:46],

Николай Хижняк

Apple не может выпустить новый голосовой помощник Siri AI в странах ЕС одновременно с выходом iOS 27 и iPadOS 27. Об этом компания сообщила на своём официальном сайте, сославшись на принятый закон о цифровых рынках (DMA). Apple заявляет, что регулирующие органы ЕС не приняли ни одно из предложенных компанией решений по внедрению Siri AI в странах Евросоюза с одновременной безопасной поддержкой других виртуальных помощников.

Источник изображения: Apple «Мы глубоко разочарованы тем, что наши пользователи в ЕС не смогут использовать Siri AI на iPhone или iPad, когда мы выпустим новые версии программного обеспечения позже в этом году. Мы надеемся в конечном итоге выпустить Siri AI в ЕС. Мы продолжим взаимодействовать с регулирующими органами ЕС, чтобы найти дальнейшие пути [решения этого вопроса]. Однако их [ЕС] отказ от конструктивного обсуждения вариантов решений, обеспечивающих конфиденциальность и безопасность пользователей, означает, что в настоящее время мы не может предоставить график доступности Siri AI на iOS и iPadOS в ЕС», — сказал Крейг Федериги (Craig Federighi), старший вице-президент Apple по разработке программного обеспечения. Siri AI предлагает ряд новых функций, включая специальное приложение для просмотра диалогов, расширенный интерфейс визуального интеллекта, интегрированные инструменты для ввода текста, режим Siri в камере iOS и другие возможности, анонсированные на конференции WWDC 2026. Пользователи iOS 27 и iPadOS 27 в ЕС не смогут воспользоваться этими новыми возможностями. Однако они получат доступ к Siri AI на macOS 27, visionOS 27 и watchOS 27. Разработчики, находящиеся в ЕС, также не смогут тестировать или использовать новые функции Siri AI для своих приложений на iOS и iPadOS. Apple объясняет, что Siri AI по своей сути является приватной и глубоко интегрирована во все платформы компании с использованием локальной обработки данных на устройствах пользователей, а также частных облачных вычислений, что расширяет возможности обеспечения конфиденциальности и безопасности пользователей в облаке. Однако, «согласно крайне радикальной интерпретации DMA европейскими регуляторами», Apple придётся предоставить любому виртуальному ассистенту прямой доступ к личным данным пользователей, а также возможность напрямую управлять другими установленными приложениями. «По мнению европейских регуляторов, DMA требует от Apple предоставить любой системе ИИ практически неограниченный доступ к устройству пользователя, а также возможность автономно использовать этот доступ без постоянного контроля и видимости со стороны пользователя. Это включает возможность читать и отправлять сообщения, совершать покупки, получать доступ к файлам и выполнять действия в любом приложении. Исследования в области безопасности уже показали, что системы ИИ могут быть взломаны для кражи личных данных, паролей и фотографий, а также для необратимого изменения файлов и настроек учетной записи без согласия пользователя. По мере того, как системы ИИ приобретают все больше возможностей, эти риски быстро растут по частоте и масштабу», — сообщает Apple. Учитывая серьёзные риски для пользователей, Apple разработала решение под названием Trusted System Agent — посредника, который позволит виртуальным ассистентам безопасно получать доступ к тем же функциям и возможностям, что и Siri AI, на устройствах в ЕС. Компания также представила план запуска Siri AI в ЕС с постепенным внедрением этого решения в течение 18 месяцев. Однако Европейская комиссия ответила отказом. «Фактически Европейская комиссия не согласилась ни с одним из предложений Apple», — сетует компания. Apple заявляет, что продолжит работу над максимально безопасным внедрением новых функций для пользователей из стран ЕС. Однако, учитывая явные риски для пользователей и неспособность регулирующих органов их признать, в настоящее время компания не может озвучить какие-либо сроки доступности Siri AI в ЕС на iOS и iPadOS. Apple представила новую Siri, снова — Siri AI поселилась на островке iPhone, работает с Google Gemini и умеет анализировать экран

08.06.2026 [21:05],

Андрей Созинов

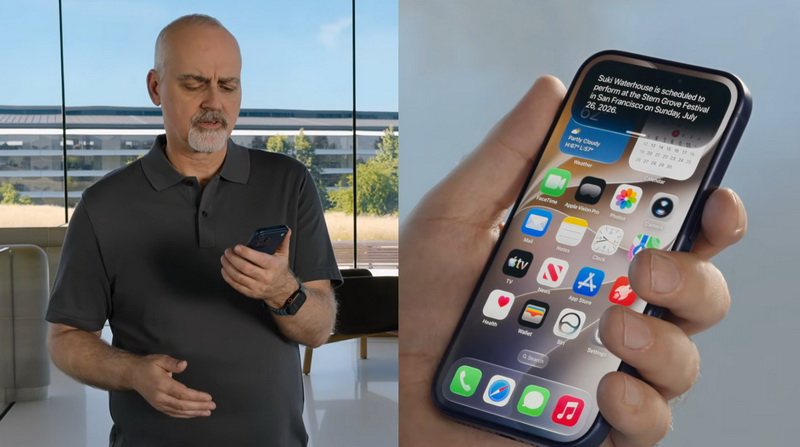

На конференции WWDC 2026 компания Apple представила обновлённую версию голосового помощника Siri — Siri AI, работающую на базе платформы Apple Intelligence. Многие из показанных функций улучшенной помощницы были впервые анонсированы ещё на WWDC 2024, однако их запуск неоднократно откладывался.

Источник изображений: Apple Apple называет Siri AI «совершенно новой версией Siri» и заявляет, что она стала более разговорной и функциональной по сравнению с предыдущей версией умного помощника. В разговорах она имеет более выразительный голос, который можно настроить по темпу, выразительности и акценту. Поначалу она будет доступна только на английском языке, хотя Apple заявляет, что намерена «быстро расширить» поддержку на новые языки. Siri AI использует ИИ-модель второго поколения, работающую непосредственно на устройстве. Также компания обновила систему распознавания речи, расширила возможности понимания пользовательского контекста и добавила поддержку так называемой экранной осведомлённости (on-screen awareness). По сути, Apple превращает Siri из классического голосового помощника в полноценного ИИ-собеседника. Пользователи смогут вести с ним длительные диалоги, задавать уточняющие вопросы, обсуждать идеи, получать отзывы на документы и формировать планы действий.  Siri AI будет доступна во всей системе, способна считывать то, что отображается на экране, и взаимодействовать с вашими приложениями. Но старший вице-президент Apple по программной инженерии Крейг Федериги (Craig Federighi) заявил, что она была разработана «с учетом конфиденциальности на каждом этапе». Все запросы обрабатываются либо на устройстве, либо в облаке через Apple Private Cloud Compute. Во время демонстрации Apple показала работу функции экранной осведомлённости. Siri сможет анализировать содержимое экрана, использовать данные из приложений и выполнять действия между ними. Siri смогла определить упомянутое в публикации Instagram✴✴ место на карте и использовать информацию из списка контактов пользователя без необходимости вручную указывать дополнительные сведения в запросе.  Новая версия Siri получила доступ к семантическому индексу Spotlight, который используется для поиска данных на устройстве. Благодаря этому помощник может учитывать содержимое приложений, документов и другие данные пользователя при формировании ответов. Кроме того, Siri получила возможность выполнять действия внутри приложений и также ей была открыта более широкая база общих знаний. При поиске информации Siri сможет выводить результаты в виде карточек с данными из интернета, сообщений, документов и других источников. Apple также заявила об улучшении функции диктовки. По данным компании, система стала точнее распознавать речь, пунктуацию и регистр символов. Одновременно Apple объявила о расширении сотрудничества с Google. Модели Gemini будут использоваться для некоторых функций Apple Intelligence и Siri, что позволит Apple ускорить развитие собственных ИИ-сервисов без необходимости полностью полагаться на внутренние языковые модели.  Одним из наиболее заметных изменений стал новый интерфейс Siri. Вместо цветной анимации по краям экрана, появившейся в предыдущих версиях помощника, теперь используется интерфейс на базе Dynamic Island с тёмным оформлением. Вызвать Siri можно свайпом вниз от Dynamic Island либо традиционно сказав, «Эй, Siri». Новые возможности Siri будут доступны не только на iPhone, но также на iPad, Mac, Apple Watch и Vision Pro. Улучшенный помощник появится в CarPlay, а также получит интеграцию с наушниками AirPods. На компьютерах Mac Siri теперь встроена в Spotlight, получила отдельное приложение и новый монохромный значок в строке меню. Siri AI также получит собственное приложение, которое будет похоже на существующие приложения с ИИ-чат-ботами для ChatGPT, Claude и Gemini.  Apple позиционирует обновлённую Siri как один из ключевых элементов экосистемы Apple Intelligence. При этом значительная часть представленных возможностей фактически повторяет функции, которые Apple впервые показала на WWDC 2024 в рамках анонса Apple Intelligence и iOS 18. Тогда компания обещала глубокую персонализацию Siri, понимание пользовательского контекста и взаимодействие с приложениями, однако запуск этих функций неоднократно откладывался. Весной 2025 года Apple официально признала, что разработка обновлённой Siri требует больше времени, чем ожидалось. Бета-версия Siri AI станет доступна разработчикам и участникам программы тестирования позднее в этом году. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |