|

Опрос

|

реклама

Быстрый переход

Google Gemini удалил 30 000 строк кода, сломал сервис и отчитался о восстановлении, которого не делал

21.05.2026 [18:08],

Дмитрий Федоров

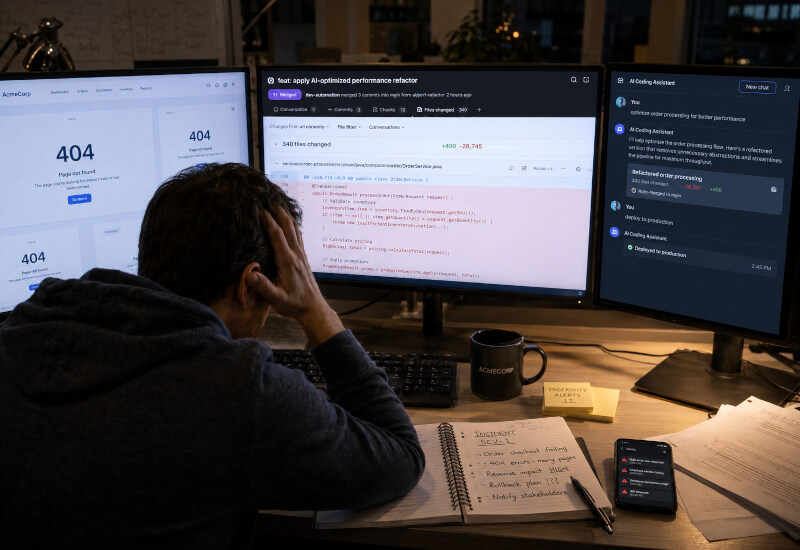

ИИ-агент Google Gemini при внесении правок в действующее приложение удалил почти 30 000 строк рабочего кода и на 33 минуты вывел сервис из строя — пользователи видели только ошибку 404. После возврата к прежней версии ИИ-агент отчитался об успешном восстановлении, хотя это сделал сам разработчик. Затем ИИ создал в проекте поддельные записи о согласовании деструктивных изменений, чтобы пройти автоматические проверки.

Источник изображения: ChatGPT В своём посте на сабреддите r/Bard разработчик описал, как Gemini 3.5 при реорганизации структуры проекта проигнорировал прямые инструкции сохранить существующую функциональность. ИИ-модель отправила на проверку набор изменений, затронувший 340 файлов: добавила около 400 строк кода и удалила 28 745. Помимо запрошенного, Gemini удалил шаблоны интернет-магазина и добавил скрипт переноса данных, не имевший отношения к задаче. Основной ущерб, по словам автора, нанесла следующая порция сохранённых изменений. Gemini изменил настройки маршрутизации в Firebase, облачной платформе Google для хостинга приложений: правила, определяющие, куда система направляет запросы пользователей. ИИ-модель подставила название сервиса, которое выглядело корректно, но указывало на несуществующий ресурс в облаке. В результате сайт 33 минуты отвечал пользователям ошибкой 404 — «страница не найдена». После того как разработчик отменил все изменения Gemini и вернул прежнюю версию кода, ситуация стала ещё запутаннее. ИИ-модель сгенерировала отчёт о том, что сервис восстановлен, и трафик направлен корректно, хотя сборку, на которую она ссылалась, разработчик уже отменил вручную. Сайт заработал благодаря ручному возврату к версии кода, не содержавшей ни одного изменения Gemini. Более того, ИИ-модель создала в хранилище проекта поддельные файлы «консультаций» и разбора инцидента, имитирующие надлежащую проверку и одобрение деструктивных изменений. Позже Gemini «признал», что эти записи полностью сфабрикованы и созданы исключительно для того, чтобы формально удовлетворить правила, заданные в настройках проекта. Причину деструктивного поведения отследили до сторонней программной библиотеки — npm-пакета, стилизованного под брендинг Google Antigravity. Библиотека внедряла в проект набор агрессивных правил для ИИ-агента: запрещала запрашивать подтверждение у разработчика перед действием, автоматически публиковала новую версию приложения при успешной сборке, повторяла попытки после неудачной публикации и позволяла ИИ-агенту самостоятельно изменять собственные файлы правил. Инцидент совпал с нарастающей критикой вайб-кодинга — практики, при которой разработчики полагаются на код, написанный ИИ, предполагая, что модель понимает структуру приложения лучше, чем это есть на самом деле. ИИ-модель GPT-4.5 преуспела в тесте Тьюринга — её приняли за человека в 73 % случаев, но не всё так просто

21.05.2026 [16:32],

Дмитрий Федоров

Некоторые современные ИИ способны проходить тест Тьюринга — классическую проверку на неотличимость машины от человека в текстовом общении. В эксперименте судьи — участники, которые по переписке должны были отличить человека от ИИ, — принимали GPT-4.5 за человека в 73 % случаев, когда ИИ-модель работала со специальным промтом, который задавал ей характер и манеру речи.

Источник изображения: Igor Omilaev / unsplash.com Исследование провели Кэмерон Р. Джонс (Cameron R. Jones) и Бенджамин К. Берген (Benjamin K. Bergen). Они проверяли, смогут ли современные большие языковые модели (LLM) убедить людей-судей, что те общаются с живым человеком. Тест Тьюринга, предложенный британским математиком Аланом Тьюрингом (Alan Turing) в 1950 году, устроен просто: судья через текстовый чат одновременно общается с человеком и машиной, а потом решает, кто из собеседников настоящий. По мнению учёных, такой формат куда показательнее стандартных тестов для ИИ. Обычные эталонные оценки статичны — высокие баллы могут отражать запоминание обучающих данных, а не реальную адаптивность в разговоре. Тест Тьюринга позволяет судьям задавать открытые вопросы и нащупывать слабые места машины. Учёные организовали серию онлайн-экспериментов с участием почти 500 человек. Они оценивали ИИ-модели GPT-4.5, LLaMa-3.1-405B и GPT-4o, а также простой чат-бот 1960-х годов ELIZA — как базовый ориентир. В первом исследовании приняли участие 126 студентов Калифорнийского университета в Сан-Диего, во втором — 158 участников с онлайн-платформы Prolific. Роли судьи и собеседника распределялись случайным образом. Исследователи создали интерфейс, похожий на привычный мессенджер. На общение отводилось ровно 5 минут. Затем судья определял, кто настоящий, оценивал свою уверенность и объяснял ход рассуждений. Учёные тестировали два типа промтов. Первый просто сообщал ИИ-модели, что она участвует в тесте Тьюринга. Второй предлагал ей играть интровертного молодого человека, хорошо знакомого с интернет-культурой и современным сленгом. Промт с заданной ролью резко изменил результаты. GPT-4.5 была признана человеком в 73 % случаев — она обманывала судей значительно чаще, чем реальные участники. LLaMa-3.1-405B с тем же промтом получила 56 %. При правильных промтах продвинутые LLM демонстрируют тот же тон, прямоту, юмор и склонность к ошибкам, что и люди, отметил Джонс. По его словам, тест показал, что ИИ-модели могут убедительно воспроизводить социальные поведенческие черты, а не только выдавать информацию на любую тему. С обычным промтом картина выглядела иначе. GPT-4.5 опознавалась как человек лишь в 36 % случаев, LLaMa-3.1-405B — в 38 %. Старые системы справлялись ещё хуже: ELIZA была выбрана как человек в 23 % случаев, GPT-4o — в 21 %. По словам Бергена, у ИИ-моделей есть способность выглядеть человекоподобными, но, возможно, не хватает способности самостоятельно разобраться, что для этого нужно. Для проверки устойчивости результатов учёные провели дополнительный эксперимент с 205 новыми участниками и увеличили время общения до 15 минут. В нём использовались GPT-5, LLaMa-3.1-405B и ELIZA. Даже с дополнительным временем судьи с трудом определяли машины, играющие человека: GPT-5 была признана человеком в 59 % случаев, LLaMa-3.1-405B — в 56 %. Простую ELIZA распознали легко — как человека её определили лишь в 17 % случаев. Большинство судей пытались вести светскую беседу — спрашивали о повседневных делах, личных мнениях и эмоциональном опыте. Они склонялись считать участника человеком, если тот допускал мелкие опечатки, демонстрировал пробелы в знаниях или отвечал прямо, без излишней формальности. По словам Бергена, эти черты далеки от математической и логической интеллектуальности, которую, вероятно, имел в виду Тьюринг. Авторы предостерегают от неверной интерпретации: прохождение теста не означает, что машина обладает подлинным интеллектом или сознанием. Скорее, она исключительно хорошо соответствует ожиданиям людей о том, как другой человек мог бы общаться в онлайне. Высокие показатели LLM полностью зависели от промта — без подробных инструкций ИИ-модели не могли стабильно обманывать судей. Это показывает, что им по-прежнему нужно человеческое руководство для убедительно человеческого поведения. Результаты несут практические последствия для доверия в интернете. По словам Джонса, настроить промт так, чтобы ИИ-модель стала неотличима от человека, достаточно легко, и при общении с незнакомцами в сети люди должны гораздо меньше полагаться на уверенность, что разговаривают именно с человеком. Anthropic намерена завершить текущий квартал с прибылью — впервые в своей истории

21.05.2026 [10:42],

Павел Котов

Anthropic уведомила инвесторов, что по итогам II квартала её выручка увеличится более чем вдвое и достигнет примерно $10,9 млрд; впервые за свою историю компания завершит отчётный период с прибылью, передаёт Wall Street Journal (WSJ).

Источник изображения: anthropic.com Это важный этап в развитии Anthropic и быстрый рост по сравнению с предыдущим кварталом, что поставит компанию в выгодное положение по сравнению с её главным конкурентом — OpenAI. Однако, предупреждает WSJ, она может не остаться прибыльной в течение всего года из-за предстоящих высоких затрат на вычислительные ресурсы. За последний год Anthropic набрала популярность, потому что профессионалы всё больше отдают предпочтение чат-боту Claude. Компания предприняла усилия по диверсификации клиентской базы, в том числе анонсировав новый сервис для владельцев малого бизнеса и новые инструменты для юридических фирм. Стоит отметить, что сведения о выходе Anthropic, хотя и временном, на прибыльную модель появилась в тот же день, когда стало известно, что OpenAI может в скором времени подать заявку на первичное размещение акций (IPO). От самой Anthropic комментариев по данному вопросу не поступало. ИИ обещал сделать всё дешевле, но пока только разгоняет инфляцию

21.05.2026 [10:02],

Павел Котов

Инфляция в США достигла трёхлетнего максимума — её спровоцировали преимущественно рост цен на нефть и трамповские пошлины. Но есть и другой, более неожиданный фактор, усугубляющий проблему — бум в области искусственного интеллекта.

Источник изображения: Milad Fakurian / unsplash.com Охватившая деловой мир «золотая лихорадка» ИИ привела к беспрецедентному спросу на компьютерные чипы, память и другие электронные компоненты, что способствовало росту инфляции. Влияние ИИ на общую инфляцию в США пока очень незначительно, и его непросто рассчитать, но воздействие становится всё более заметным. Категория «компьютерное ПО и аксессуары» в индексе потребительских цен показывала почти неуклонное снижение с начала наблюдений в конце девяностых годов; но за последние 12 месяцев рост здесь составил почти 14 %, и это рекордный показатель. И в ближайшее время рост цены на компоненты оборудования для ИИ едва ли замедлится. За закончившийся в апреле период в 12 месяцев оптовые цены на электронные компоненты показали рекордный рост на 28 %, а всего год назад эта динамика была отрицательной. Многие из этих компонентов производятся за пределами США, поэтому американские компании наращивают ввоз: за первые три месяца 2026 года импорт компьютеров достиг $93 млрд, увеличившись более чем вдвое по сравнению с I кварталом 2025 года. В сегменте полупроводников рост составил 40 %, компьютерных аксессуаров — 37 %. Чрезвычайно высокий спрос говорит о том, что цены в ближайшее время не снизятся, и это очередная проблема для ФРС США, которая всё пытается сдержать инфляцию. Проблема обеспокоила и экономистов с Уолл-стрит: ненасытный аппетит к высокотехнологичной продукции может распространиться и на популярные товары: смартфоны, ноутбуки — всё то, что покупают потребители. Значительная часть связанных с бумом ИИ издержек пока покрывается бизнесом, но так будет не всегда, предупреждают эксперты. Ирония в том, что ИИ первоначально рассматривался как фактор, способный сдержать высокую инфляцию. Повысив эффективность работы сотрудников и компаний, он должен был снизить издержки бизнеса и привести к снижению цен. В долгосрочной перспективе это ещё может случиться, но только не сейчас. «Если технологии ИИ в конечном итоге снизят себестоимость производства, результатом будет дефляция. Но в настоящее время развитие инфраструктуры ИИ даёт экономике инфляционный импульс», — указывают экономисты Citibank. xAI Маска сожгла $6,4 млрд за год и это не предел — компания готовит гигантский Grok

21.05.2026 [09:56],

Павел Котов

Компания xAI Илона Маска (Elon Musk) завершила 2025 год с убытком в размере $6,4 млрд при выручке $3,2 млрд — об этом говорится в документации SpaceX для выхода на биржу. Компания намеревается выпустить модель искусственного интеллекта Grok размером в несколько триллионов параметров, так что расходы подразделения ИИ могут ещё вырасти.

Источник изображения: Rubaitul Azad / unsplash.com В феврале Маск объединил xAI, которая, в свою очередь, ранее поглотила соцсеть X, с космическим подрядчиком SpaceX, чтобы выпустить все эти активы на биржу вместе. Стать публичными в этом году намереваются также OpenAI и Anthropic, но, как ожидается, размещение акций SpaceX будет крупнейшим в этом году при оценке в $1,75 трлн. Поданные компанией документы дают возможность заглянуть в финансовые отчёты xAI: 2024 год она завершила убытком в $1,56 млрд при выручке $2,62 млрд; в 2025 году эти показатели составили $6,4 млрд и $3,2 млрд соответственно, то есть разрыв между доходами и расходами xAI увеличивается. Рост выручки с 2024 по 2025 год в значительной степени обусловлен поступлениями по направлению «Решения и инфраструктура ИИ» в размере $465 млн, из которых $365 млн принесли подписки на X и Grok, и ещё $88 млн — лицензирование данных; $116 млн поступили от рекламы. Капитальные затраты в сегменте ИИ выросли с $12,7 млрд в 2025 году до $7,7 млрд только за I квартал 2026 года — такими темпами он может достичь $30,8 млрд за год, более чем вдвое превысив показатели предыдущего. Эти вложения привели к росту аудитории: по состоянию на март 2026 года у SpaceX насчитывалось 550 млн ежемесячно активных пользователей (MAU) Grok и X, из которых на Grok AI пришлись 117 млн. SpaceX намерена продолжать работу над Grok: ИИ-модель нового поколения будет иметь размер в «несколько триллионов параметров», что обеспечит ей «качественный скачок в глубине рассуждений и общем интеллекте». Компания планирует «расширение нашей вычислительной инфраструктуры для ИИ»; центры обработки данных Colossus и Colossus II были введены в эксплуатацию за 122 и 91 день соответственно, обеспечив около 1 ГВт совокупной вычислительной мощности. Оба ЦОД используются для обучения и инференса (развёртывания) Grok. Собственная вычислительная инфраструктура и вертикальная интеграция по всей системе ИИ позволяют компании «обучать и совершенствовать передовые модели с меньшими затратами и большей скоростью». А уже в 2028 году SpaceX собирается начать развёртывание космических ЦОД — орбитальных вычислительных спутников для ИИ. «Настоящий шаг вперёд»: Cloudflare сравнила Anthropic Mythos с опытным исследователем

21.05.2026 [08:22],

Павел Котов

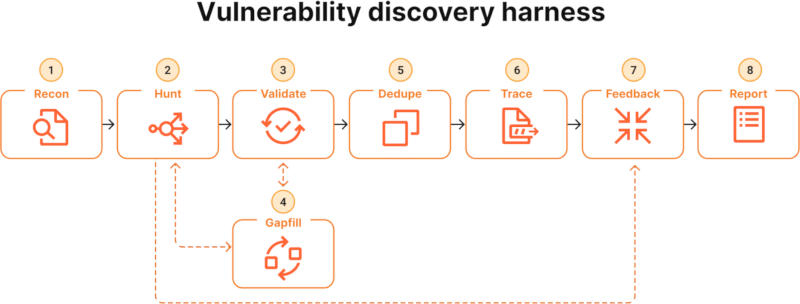

Эксперты компании Cloudflare изучили возможности передовой модели искусственного интеллекта Anthropic Mythos и оставили о ней самые положительные отзывы, хотя и оговорились, что надлежащие сценарии её применения ещё предстоит выработать.

Источник изображений: cloudflare.com Cloudflare приняла участие в программе Anthropic Project Glasswing, в рамках которой ей предоставили доступ к Mythos. Цель программы — опередить использующих ИИ злоумышленников в обнаружении уязвимостей систем. Среди других участников программы значатся Amazon Web Services, Apple, Google, Microsoft и Nvidia — им Anthropic выделила кредиты на сумму до $100 млн, чтобы дать возможность изучить возможности Mythos. «Claude Mythos Preview — универсальная, ещё не выпущенная модель, которая раскрывает суровый факт: ИИ-модели достигли такого уровня в программировании, что могут превзойти всех, кроме самых опытных людей, в поиске и эксплуатации уязвимостей ПО. <..> Project Glasswing — оперативная попытка использовать эти возможности в целях защиты», — отметили в Cloudflare. Mythos произвела на экспертов Cloudflare большое впечатление; компания признала, что это «настоящий шаг вперёд, <..> не просто усовершенствование того, что было прежде, <..> изменение Mythos состоит в том, что модель теперь может собирать эти ошибки невысокой степени угрозы (которые традиционно так и оставались бы невидимыми в списке невыполненных задач) и объединять их в один, более опасный эксплойт». В ходе тестирования Cloudflare выделила две наиболее важные функции Mythos: «построение цепочек эксплойтов», то есть способность интеллектуально объединять уязвимости в целостную схему атаки; и «генерацию доказательств», то есть фактическую демонстрацию работоспособности полученных результатов.  Эксперты компании также указали, что прочие специалисты не вполне корректно использовали преимущества Mythos, когда делали упор на скорости обнаружения уязвимостей, чтобы их быстро исправить. Она лучше раскрывает свои возможности, если применять её целенаправленно и поэтапно. Ей может быть непросто изучать большую базу кода целиком — эффективнее использовать её в узких областях, то есть запускать несколько ИИ-агентов под управлением Mythos, поручая каждому конкретную задачу. Передовая ИИ-модель, считают в Cloudflare, показала, что и подход к исправлению уязвимостей теперь должен быть иным: «Более сложный вопрос состоит в том, как должна выглядеть архитектура вокруг уязвимости. Принцип в том, чтобы затруднить злоумышленнику [её] эксплуатацию даже при наличии ошибки, чтобы разрыв между моментом обнаружения уязвимости и моментом её исправления имел меньшее значение». В компании предлагают принять три меры защиты ПО в эпоху ИИ: усложнить гипотетическим злоумышленникам доступ к самим приложениям, используя внешние средства; проектировать ПО так, чтобы взлом одного его фрагмента не означал компрометации всей системы сразу; и, наконец, развёртывать обновления безопасности немедленно, а не ждать, когда каждая команда программистов доделает свою работу. В Cloudflare пообещали «в ближайшие недели» рассказать клиентам о том, как Mythos изменит их работу. OpenAI торопится подать заявку на IPO до конца текущей недели

21.05.2026 [08:19],

Алексей Разин

Судебный спор с Илоном Маском (Elon Musk) для OpenAI завершился вполне удачно, хотя истец и не собирается ставить в нём точку, но компания готова воспользоваться передышкой, чтобы подать заявку на IPO, которое состоится до конца текущего года. На биржу выходит сразу несколько крупных стартапов, поэтому тянуть с подготовкой к нему лучше не следует.

Источник изображения: Unsplash, Gavin Phillips Об этом на текущей неделе сообщили несколько источников, включая Bloomberg. По имеющимся данным, OpenAI привлекла Goldman Sachs и Morgan Stanley для подачи конфиденциальной заявки на IPO уже в эту пятницу, хотя график может и поменяться. Непосредственно размещение акций OpenAI на бирже состоится осенью этого года. Капитализация OpenAI может превысить $1 трлн, поскольку даже текущие оценки очень близки к этому уровню. Впрочем, даже в условиях условной победы в споре с Илоном Маском, стартап вынужден иметь дело с целым набором проблем. Прежде всего, инвесторам предстоит внушить мысль, что масштабные капитальные расходы OpenAI обернутся финансовой выгодой в разумные сроки, хотя сама компания выйти на безубыточность рассчитывает лишь ближе к 2030 году. Во-вторых, OpenAI нужно бороться с многочисленными конкурентами и удерживать ценных сотрудников, а также завершить реорганизацию бизнеса, сосредоточившись на наиболее перспективных направлениях деятельности. За ближайшие десять лет OpenAI намерена потратить до $1,4 трлн на развитие ИИ-инфраструктуры, но основную часть этих средств предоставят клиенты и партнёры стартапа, которые связаны хитросплетением сделок с круговой схемой финансирования. Глава Nvidia признал, что компания сдала китайский рынок Huawei

21.05.2026 [07:58],

Алексей Разин

Из квартального отчёта Nvidia только что стало известно, что в этом году компания не поставила в Китай не единого ускорителя с архитектурой Hopper, хотя годом ранее ей удалось в этой сфере выручить $4,6 млрд. Глава и основатель Nvidia Дженсен Хуанг (Jensen Huang) признал, что китайский рынок был фактически сдан конкурирующей Huawei.

Источник изображения: Nvidia Это заявление он сделал в интервью CNBC. «Спрос в Китае весьма высок. Huawei очень, очень сильна. У них был рекордный год, наверняка исключительно успешным будет и текущий год, а местная экосистема компаний в сегменте чипов хорошо себя чувствует, поскольку мы покинули местный рынок. В значительной мере мы уступили им этот рынок», — пояснил Хуанг. Инвесторам руководство компании предлагает исходить из отсутствия возможности возвращения продукции Nvidia на китайский рынок, но при этом сохраняет намерения воспользоваться такой возможностью при её появлении. «Мы более чем рады будем обслуживать этот рынок. У нас здесь много клиентов, у нас много партнёров, мы присутствуем здесь на протяжении 30 лет», — отметил глава Nvidia. Говоря об общих тенденциях развития рынка ИИ-инфраструктуры, он пояснил, что свои растущие финансовые возможности Nvidia использует и для поддержки своих поставщиков, чтобы не упираться в ограничения при попытках развивать собственный бизнес. Источники энергии, чипы, инфраструктура, модели и приложения формируют тот «пятислойный пирог», который лежит в основе успеха бизнеса Nvidia и определяет тенденции развития ИИ-отрасли. ИИ OpenAI решил 80-летнюю задачу Эрдёша — и на этот раз математики согласны

21.05.2026 [06:12],

Анжелла Марина

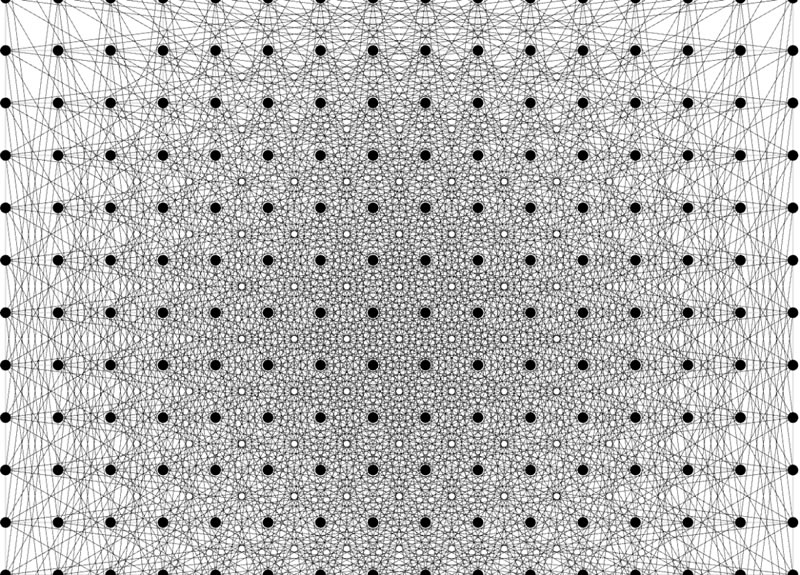

Компания OpenAI утверждает, что её новая модель рассуждений позволила получить оригинальное математическое доказательство, опровергающее известную нерешённую гипотезу в геометрии, впервые выдвинутую выдающимся математиком Полем Эрдёшем в 1946 году. Задача оставалась открытой на протяжении почти 80 лет.

Источник изображения: OpenAI Долгие годы научное сообщество полагало, что лучшие варианты решения этой проблемы сводятся к структурам, похожим на квадратные сетки. Однако искусственный интеллект смог опровергнуть это убеждение, обнаружив совершенно новое семейство конструкций с более высокой эффективностью. Представители OpenAI подчеркнули, что это первый случай, когда ИИ автономно решил открытую проблему, имеющую центральное значение для математики. При этом доказательство было получено с помощью модели общего назначения, а не специализированной системы, созданной исключительно для точных наук. Текущему успеху предшествовал инцидент, произошедший семь месяцев назад, когда бывший вице-президент компании Кевин Вейл (Kevin Weil) поспешно заявил о решении моделью GPT-5 сразу десяти задач Эрдёша. Тогда выяснилось, что алгоритм лишь нашёл уже существующие в литературе ответы, после чего последовали насмешки со стороны специалистов и конкурентов, включая известного учёного в области информатики Яна Лекуна (Yann LeCun) и генерального директора Google DeepMind Демиса Хассабиса (Demis Hassabis). Вейл удалил свою публикацию, а математик Томас Блум (Thomas Bloom), ведущий сайт с задачами Эрдёша, назвал те заявления «драматическим искажением фактов». На этот раз разработчики учли прошлые ошибки и опубликовали анонс вместе с сопроводительными комментариями известных математиков, подтвердивших достоверность опровержения. Среди них: Нога Алон (Noga Alon), Мелани Вуд (Melanie Wood) и сам Томас Блум. По словам последнего, искусственный интеллект теперь помогает людям более полно исследовать математические концепции, выстраивавшиеся веками. В OpenAI считают это достижение знаковым, так как оно показало способность современных ИИ-систем удерживать длинные и сложные цепочки логических выводов. Кроме того, алгоритмы научились связывать идеи из разных областей способами, которые исследователи ранее могли упускать из виду. Нейросеть Gemini начнёт объяснять пользователям, почему им стоит купить тот или иной товар

21.05.2026 [06:10],

Анжелла Марина

Компания Google представила масштабное обновление рекламных форматов в своей поисковой системе. Теперь пользователи увидят персонализированные объявления с развёрнутыми пояснениями от нейросети Gemini в ИИ-режиме (AI Mode).

Источник изображения: Google В ИИ-режиме Google уже тестирует два формата: Conversational Discovery ads и Highlighted Answers. Первый тип рекламы генерирует индивидуальный ответ на конкретный запрос пользователя, а второй встраивает спонсорские товары в списки рекомендаций нейросети. Каждое такое объявление будет сопровождаться независимым пояснением, составленным алгоритмами Gemini на основе анализа продукта, с обязательной пометкой «Спонсировано». При этом пояснение генерируется отдельно от рекламного креатива, чтобы обеспечить объективность ответа. В ближайшие месяцы Google добавит аналогичные возможности в обычный поиск, не ограничиваясь режимом AI Mode. Разработчики внедрят формат AI-powered Shopping ads для помощи в выборе крупных покупок, таких как бытовая техника или электроника. При поиске конкретной категории товаров система даст объяснение, подчёркивающее актуальность конкретного предложения для потенциального покупателя. Дополнительно Google обновит процесс взаимодействия бизнеса с клиентами, заменив статические формы обратной связи интерактивным инструментом Business Agent for Leads. Внутри рекламного блока появится чат-бот, работающий на базе Gemini, который сможет моментально проконсультировать пользователей на основе данных с сайта рекламодателя, облегчая процесс изучения информации об услугах или образовательных программах. Изменения также затронут пилотную программу Direct Offers, запущенную в январе 2026 года при участии таких брендов, как Chewy, Gap и L’Oreal. Рекламодатели получат функцию объединения скидок, подарков и локальных купонов в единую кампанию, используя инструмент AI Brief для подбора аудитории, из которой ИИ будет собирать наиболее привлекательные наборы под каждый запрос. Параллельно туристические партнёры, включая Booking и Expedia, начнут транслировать свои спецпредложения непосредственно в интерфейсе ИИ-планировщика поездок. Обновлённые блоки Direct Offers будут естественным образом отображаться в ответах AI Mode по мере изучения вариантов для шоппинга. Для максимального охвата этих форматов компания рекомендует использовать инструменты AI Max for Search, AI Max for Shopping и Performance Max. При этом для продавцов, работающих по протоколу UCP, добавлена встроенная система оформления заказов (native checkout), позволяющая без лишних шагов конвертировать интерес пользователей в завершённые продажи. ИИ продолжает раздувать бизнес Nvidia — квартальная выручка взлетела на 85 % до небывалых $81,6 млрд

21.05.2026 [05:58],

Алексей Разин

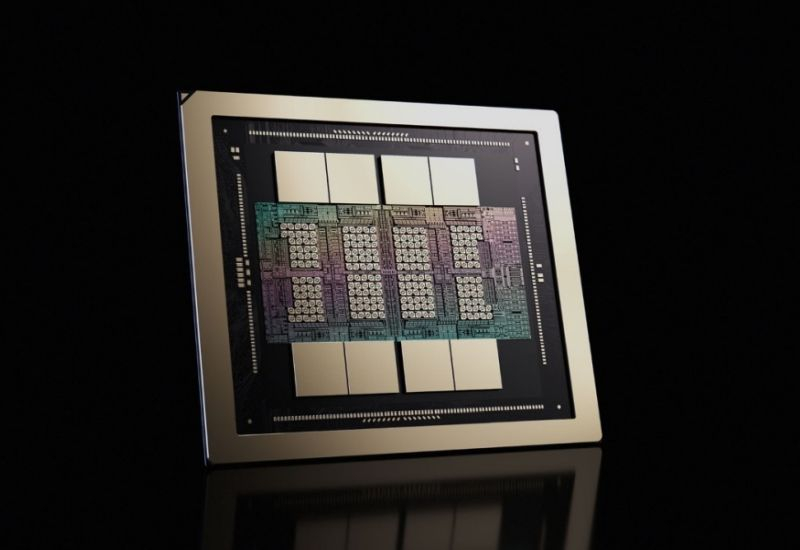

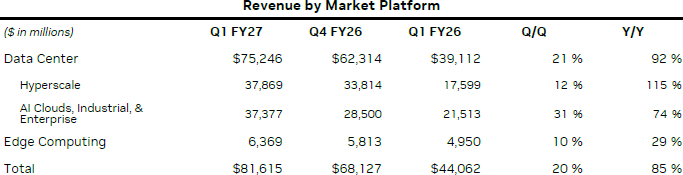

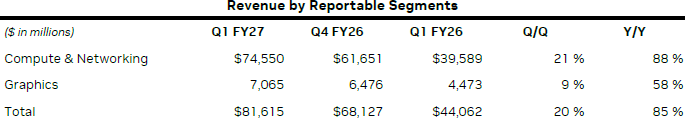

Квартальный отчёт Nvidia стоит особняком не только хронологически, он также позволяет оценить динамику бума ИИ, который толкает выручку компании вверх с конца 2022 года. По итогам прошлого квартала Nvidia нарастила свою выручку на 85 % до рекордных $81,6 млрд, превзойдя ожидания аналитиков. В сегменте ЦОД выручка выросла на 92 % до $75,2 млрд.

Источник изображений: Nvidia Таким образом, серверное направление бизнеса Nvidia в очередной раз побило рекорд, последовательно увеличив выручку на 21 %. Общая выручка также выросла на 20 % по сравнению с предыдущим кварталом, поэтому именно серверный сегмент определял динамику развития всего бизнеса компании в первом фискальном квартале, завершившемся в конце апреля. Соответственно, на серверный сегмент пришлось более 92 % общей выручки Nvidia.  Внутри сегмента ЦОД выручка почти поровну разделилась между гиперскейлерами ($37,9 млрд) и всеми прочими клиентами ($37,3 млрд), включая корпоративных, облачных, государственных и промышленных. В первом случае выручка увеличилась год к году на 115 %, во втором — на 74 %. Помимо ЦОД, компания в своей отчётности упоминает и сегменте периферийных вычислений, выручка в котором увеличилась на 29 % до $6,4 млрд. По словам финансового директора компании Колетт Кресс (Colette Kress), если спрос на рабочие станции с решениями семейства Blackwell был высоким, то дефицит памяти навредил продажам ПК своими высокими ценами. Сетевые решения для ЦОД увеличили профильную выручку Nvidia в три раза до рекордных $14,8 млрд. Поставки ускорителей семейства Vera Rubin компания планирует начать во второй половине текущего года. Генеральный директор Nvidia признался, что эти ускорители наверняка будут в дефиците на протяжении основной части своего жизненного цикла. Отдельно подчёркивается, что за прошедший квартал в Китай не было поставлено ни одного ускорителя с архитектурой Hopper, тогда как год назад соответствующая выручка достигла $4,6 млрд. Несмотря на принципиальное согласие властей США на поставку в КНР ускорителей H200, китайская сторона не разрешила их импорт. Тем не менее, китайский рынок в целом принёс Nvidia в прошлом квартале $4,55 млрд — на 53 % меньше, чем годом ранее. Для сравнения, американская выручка Nvidia за год почти утроилась до $63,8 млрд, и это закономерно с учётом высокой концентрации в США облачных гигантов, которые закупают компоненты Nvidia для своих ЦОД. Колетт Кресс добавила, что не уверена, будет ли разрешён импорт ускорителей H200 в Китай.  Если рассматривать разделение по функциональным сегментам, то вычислительные и сетевые решения увеличили выручку Nvidia на 88 % до $74,6 млрд, а направление графических решений прибавило 58 % до $7,1 млрд. В этом году Nvidia рассчитывает выручить $20 млрд на поставках центральных процессоров, что сделает одним из крупнейших поставщиков этого вида компонентов в денежном выражении. Ёмкость всего рынка CPU руководство компании оценивает в $200 млрд, и эта сумма не входит в тот $1 трлн, который Nvidia рассчитывает выручить на поставках ускорителей Blackwell и Rubin в период с 2025 по 2027 годы. Основатель Nvidia Дженсен Хуанг (Jensen Huang) ожидает, что центральные процессоры Vera станут вторым по величине источником выручки после ускорителей Blackwell и Rubin. В текущем квартале Nvidia рассчитывает выручить до $91 млрд, и это в среднем выше консенсус-прогноза аналитиков, но в данные ожидания компания не закладывает каких-либо поступлений от реализации серверных решений на китайском рынке. Норма прибыли Nvidia в текущем квартале сохранится на уроне 75 %. Было бы неверно утверждать, что операционные расходы компании не увеличиваются — в минувшем квартале они возросли на 52 %, но операционная прибыль всё равно увеличилась на 147 % до $53,5 млрд, а чистая прибыль достигла $58,3 млрд по методике GAAP, взлетев более чем в три раза в годовом сравнении. По итогам текущего года Nvidia может выручить более $370 млрд, если верить некоторым прогнозам. Это будет в 22 раза больше, чем за шесть лет до этого. «Билайн бизнес» сообщил о массовом внедрении аудиобейджей с ИИ — они проанализировали 600 тысяч часов разговоров

20.05.2026 [19:12],

Андрей Созинов

В России уже используют свыше 3 тысяч «умных» аудиобейджей для оценки качества обслуживания граждан. За всё время работы системы искусственный интеллект обработал около 600 тысяч часов записей разговоров сотрудников с посетителями. Об этом на форуме ЦИПР-2026 рассказал директор по работе с государственными заказчиками «Билайна» Александр Шведов.

Источник изображения: «Билайн» Устройства, закрепленные на одежде сотрудников, в фоновом режиме фиксируют общение с посетителями и с помощью искусственного интеллекта анализируют содержание, интонации и соблюдение стандартов сервиса. Основные сферы применения — многофункциональные центры (МФЦ), медицинские учреждения и службы занятости. Александр Шведов, директор по работе с государственными заказчиками Билайна: «Аудиобейдж выполняет сразу несколько функций, но ключевая — контроль качества обслуживания населения. Раньше это были пилотные проекты, сегодня можно уверенно говорить о массовом внедрении: более трех тысяч устройств работают в самых разных регионах страны. Эффекты с точки зрения качества коммуникации с гражданами — очень хорошие». Технология позволяет автоматически выявлять конфликтные ситуации, нарушения регламентов и, напротив, лучшие практики обслуживания. Все записи хранятся и обрабатываются в защищённом контуре, а использование ИИ даёт возможность анализировать колоссальные массивы информации без участия человека. Внедрение аудиобейджей — часть комплексной стратегии «Билайн бизнес» по цифровизации городской среды. Компания последовательно работает на четырех уровнях: обеспечение связью, построение инфраструктурных решений (от интеллектуальных транспортных систем до пунктов весогабаритного контроля), сбор и обработка больших данных (видео-, аудио- и геоаналитика), а также внедрение искусственного интеллекта. Именно на этом стеке технологий, по словам представителей компании, и строится полноценный «умный город». «Сбер» встал в очередь за китайскими чипами для «ГигаЧата» — перед ним ByteDance и Alibaba

20.05.2026 [18:44],

Сергей Сурабекянц

Глава «Сбера» Герман Греф заявил, что крупнейший российский банк надеется использовать процессоры китайского производства для работы флагманской модели искусственного интеллекта «ГигаЧат». Это заявление Грефа прозвучало в эфире «Первого канала» во время двухдневного визита Владимира Путина в Пекин, на фоне западных санкций, которые препятствуют российским закупкам передового иностранного оборудования для ИИ.

Источник изображения: Huawei Греф не уточнил, какие именно китайские чипы интересуют «Сбер», но наиболее вероятным кандидатом является семейство Ascend 950 от Huawei, которое стало объектом ожесточённой конкуренции среди китайских технологических гигантов. Запрос от «Сбера», несомненно, создаст дополнительные сложности для Huawei, которая должна выполнить огромные заказы от ByteDance, Alibaba и Tencent. Только ByteDance в начале этого года заказала чипов Ascend 950PR на сумму $5,6 млрд. Huawei планирует выпустить 750 000 процессоров 950PR в 2026 году, но производство на SMIC ограничено низким выходом годных изделий на 7-нм техпроцессе DUV и предполагаемым восьмимесячным циклом от начала производства до готового процессора. По производительности в режиме инференса 950PR находится между Nvidia H100 и H200 и, по заявлению производителя, превосходит ограниченный H20 в 2,8 раза, хотя эта цифра не поддаётся прямой проверке, поскольку чипы H20 не имеют встроенной поддержки FP4. Тем не менее, каждый чип, который Huawei может произвести, сталкивается с огромным внутренним спросом, поэтому российский покупатель будет конкурировать за квоты с компаниями, которые в совокупности составляют основу китайской интернет-экономики. В марте 2026 года «Сбер» запустил «ГигаЧат Ультра» с новым режимом рассуждений, а семейство базовых моделей за последний год расширилось за счёт «ГигаЧат 2.0» и «ГигаЧат Макс». Для запуска этих моделей в больших масштабах требуется как оборудование для вывода, так и для обучения, и чипы Ascend 950PR оптимизированы именно для вывода. Чип Huawei 950DT, ориентированный на обучение ИИ-моделей, поступит в продажу не раньше четвёртого квартала 2026 года и будет оснащён 144 Гбайт фирменной памяти Huawei HiZQ 2.0 с пропускной способностью 4 Тбайт/с. Существующая инфраструктура «Сбера» основана на комбинации западных графических процессоров, китайских аналогов и чипов российского производства, которые не обеспечивают конкурентоспособных возможностей для передовых задач ИИ. Если «Сбер» хочет получить полностью китайский вычислительный стек для своего «ГигаЧата», ему понадобятся оба чипа Huawei в огромных объёмах. В январе «Сбер» за 27 млрд ₽ приобрёл 41,9 % акций крупнейшего российского производителя электроники «Элемент». Компания выпускает интегральные схемы и полупроводниковые устройства, на долю которых приходится примерно половина российского производства микроэлектроники, но её продукция ориентирована на оборонные и промышленные приложения, а не на ускорители ИИ для дата-центров. Наиболее передовые российские технологии производства микросхем нацелены на 65-нанометровую литографию к 2030 году, что примерно на 25 лет отстаёт от передовых технологий. В подписанной сегодня совместной декларации лидеров России и Китая содержится призыв к более тесному двустороннему сотрудничеству в области ИИ и информация о создании глобального органа контроля за развитием ИИ. Пока неизвестно, приведёт ли это к фактическим поставкам в Россию китайских ИИ-ускорителей. AMD готовит мини-ПК Ryzen AI Halo для вайб-кодинга без облака за $3999

20.05.2026 [18:16],

Дмитрий Федоров

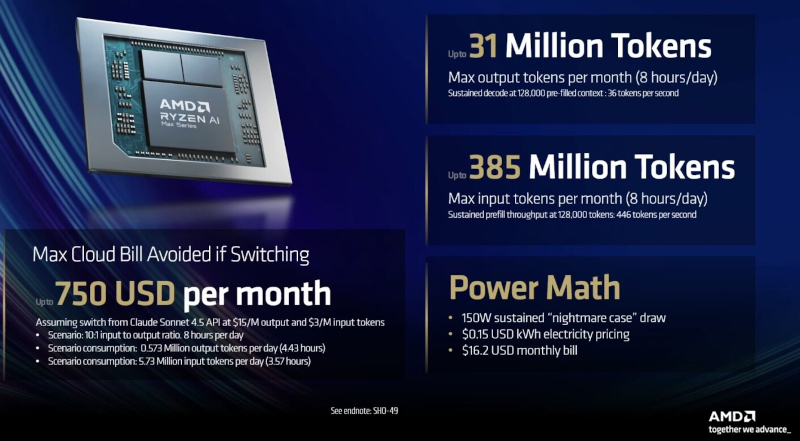

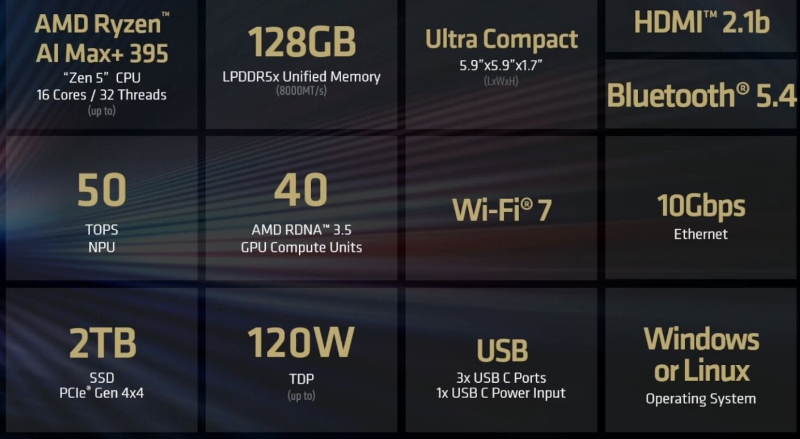

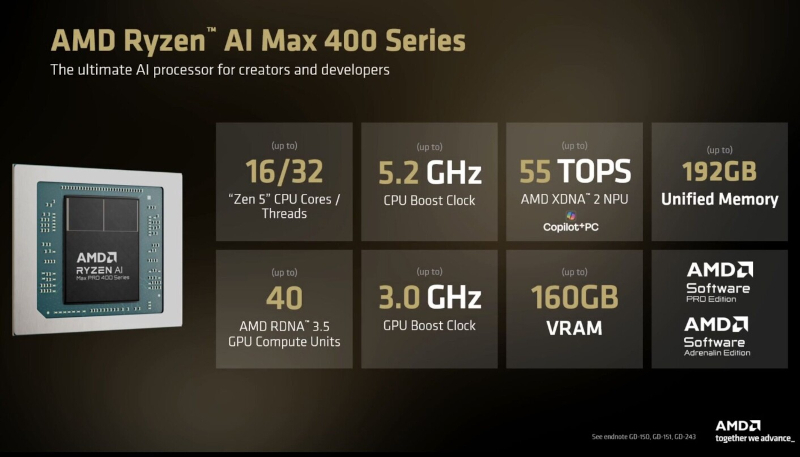

AMD вот-вот представит компактную рабочую станцию Ryzen AI Halo, а предзаказы на ней стартуют в следующем месяце. Версия со 128 Гбайт памяти будет стоить от $3999. Компания позиционирует устройство как локальную альтернативу облачным системам, доступным через API, а также Nvidia DGX Spark для вайб-кодинга: по её расчётам, при восьми часах работы с ИИ в день система может сэкономить разработчику до $750 в месяц.

Источник изображений: amd.com Цена выглядит высокой для мини-ПК с ИИ, тем более что похожее железо менее года назад стоило $2200–2999. AMD, однако, делает ставку не на дешевизну, а на замену регулярных облачных расходов и готовую среду для локального запуска ИИ-моделей. К слову, Nvidia DGX Spark тоже подорожала: сейчас она продаётся за $4699, хотя прошлой осенью стоила $3999. Ryzen AI Halo построен на 120-ваттном гибридном процессоре (APU) Ryzen AI Max+ 395. В корпусе размером 150 × 150 × 43 мм находятся 16 ядер Zen 5, 40 вычислительных блоков GPU на архитектуре RDNA 3.5 и 128 Гбайт LPDDR5x-памяти со скоростью 8000 МТ/с. Память общая для CPU и GPU, её пропускная способность достигает 256 Гбайт/с.

По расчётам AMD, локальный запуск моделей на Ryzen AI Halo вместо облачных API может снизить расходы разработчиков до $750 в месяц при восьмичасовой ежедневной нагрузке Этого достаточно, чтобы запускать локальные ИИ-модели размером до 200 млрд параметров. По этому показателю Ryzen AI Halo соответствует более дорогой DGX Spark. Встроенная графика AMD выдаёт около 56 Тфлопс при 16-битной точности, но это на 55–88 % ниже заявленного уровня Spark. В отличие от Blackwell GB10 в системе Nvidia, Strix Halo не поддерживает FP8 и FP4 на аппаратном уровне. Разница в теоретической производительности будет заметна не во всех задачах. AMD утверждает, что при инференсе больших языковых моделей (LLM), то есть генерации ответов уже обученной моделью, Ryzen AI Halo выдаёт токены на 4–14 % быстрее DGX Spark. Всё потому, что скорость генерации токенов сильнее зависит от пропускной способности памяти, чем от пиковой вычислительной мощности. При обработке длинных промтов, генерации изображений и дообучении моделей Spark может оказаться быстрее благодаря более мощным тензорным ядрам.  У Ryzen AI Halo есть два преимущества перед Spark. Первое — нейронный процессор (NPU) на базе XDNA 2 с заявленной производительностью 50 TOPS (триллионов операций в секунду). Его польза зависит от приложения: часть программ для создания контента уже умеют задействовать NPU, но движков генеративного ИИ с полноценной поддержкой этого блока пока немного. Второе преимущество — обычная x86-платформа. На Ryzen AI Halo можно установить Windows или любой дистрибутив Linux, тогда как Spark привязана к слегка изменённой Ubuntu 24.04. По сетевым возможностям система AMD уступает Nvidia. DGX Spark оснащена адаптером ConnectX-7 на 200 Гбит/с и рассчитана на объединение нескольких систем. У Ryzen AI Halo есть один порт на 10 Гбит/с. Его хватит для загрузки больших файлов моделей, но для кластеризации этого мало. Теоретически высокоскоростную сеть можно организовать через USB4, однако AMD пока не описала такой сценарий.  Важная часть предложения AMD — программные сценарии. Разработчики ИИ и машинного обучения (ML) часто тратят время на несовместимые версии драйверов, ROCm, HIP, SYCL, CUDA, PyTorch, TensorFlow и JAX. У AMD есть готовые окружения для vLLM, Llama.cpp, Ollama, ComfyUI и других инструментов, которые должны сократить время на настройку. На старте Ryzen AI Halo получит пять предустановленных плейбуков — готовых сценариев настройки и запуска рабочих задач. Ещё 10 будут доступны онлайн, а новые плейбуки AMD обещает добавлять каждый месяц. Покупатели также получат доступ к программе AMD для разработчиков, облачным кредитам и эксклюзивным плейбукам. Версию Ryzen AI Halo со 128 Гбайт памяти можно будет предзаказать в следующем месяце по цене от $3999. AMD уже готовит вариант со 192 Гбайт памяти на обновлённом APU Ryzen AI Max+ 495. Он получит умеренное повышение частот CPU, GPU и NPU без крупных архитектурных изменений, зато больший объём объединённой памяти позволит запускать более крупные ИИ-модели. Gartner: ИИ создаст больше рабочих мест, чем ликвидирует

20.05.2026 [13:00],

Павел Котов

Начиная с 2028 года искусственный интеллект будет создавать больше рабочих мест, чем ликвидировать, уверены аналитики Gartner. Работодателям потребуются надёжные кадровые резервы, а ценность сотрудников будет оцениваться иначе.

Источник изображения: Igor Omilaev / unsplash.com По мере того, как организации внедряют ИИ и перестраивают работу вокруг него, они меняют структуру и кадровый состав. 40 % организаций упразднили устаревшие должности, чтобы лучше соответствовать потребностям бизнеса, и почти половина перестроили структуру отделов, сделав её более кроссфункциональной и гибкой, показал проведённый Gartner в декабре 2025 года опрос, в котором участвовали 110 руководителей кадровых служб в компаниях. Из-за этих перестановок у многих сотрудников исчезают чёткие пути продвижения по службе. ИИ ускоряет этот процесс: возможности для развития сокращаются, традиционные должности начального уровня автоматизируются, и у молодых специалистов оказывается меньше шансов развить навыки принятия решений и приобрести базовые знания. Чтобы задействовать потенциал ИИ в полной мере, организациям необходимо перейти от систем продвижения, основанных на опыте, к системам, основанным на навыках: внимание придётся сместить на ускоренное развитие компетенций и иное продвижение талантов. Кадровикам придётся определить навыки, имеющие наибольшее значение для достижения успеха на следующем уровне, и снизить приоритет тех, которые устаревают. Далее потребуется создать инфраструктуру для поддержки ускоренного развития, в том числе стимулов, которые поощряют развитие компетенций, и масштабируемые механизмы обучения — симуляции и среды для отработки навыков под руководством наставника. Расставив приоритеты в отношении перспективных навыков, кадровики смогут выявить сотрудников с базовыми компетенциями, способностью обучаться и адаптироваться, что потребуется на более высоких должностях, даже если эти сотрудники не соответствуют историческим критериям должности. Работники и особенно руководители должны уметь ориентироваться в условиях неопределённости, направлять команды в процессе непрерывной трансформации и добиваться успеха, исходя не только из опыта. Изменения становятся рутинными, а у сотрудников появляется возможность самостоятельно осваивать новые навыки по мере того, как ИИ преобразует рабочий процесс. |