|

Опрос

|

реклама

Быстрый переход

Google представила трио ИИ-функций Gemini for Science для учёных

20.05.2026 [11:29],

Павел Котов

Google представила новые инструменты на основе искусственного интеллекта, призванные помочь в научной работе. Пакет Gemini for Science оказывает помощь в формулировании гипотез, их проверке и анализе научной литературы.

Источник изображения: blog.google Функция Hypothesis Generation, как можно догадаться по названию, подключается на начальных этапах работы — она анализирует научные статьи и выдвигает теории или предлагает решения задач. Этот инструмент помогает исследователю сформулировать гипотезу — предлагаемые этим инструментов утверждения, заверили в Google, «тщательно проверяются и подкрепляются ссылками на источники», обеспечивая «абсолютную строгость». Когда гипотеза сформулирована, исследователь может перейти к инструменту Computational Discovery, призванному проверить её. Это, по словам Google, «агентная поисковая система», способная генерировать тысячи тестов и экспериментов значительно быстрее, чем это делалось бы вручную. Наконец, пакет Gemini for Science включает чат-бот с ИИ Literature Insights, который просматривает научную литературу для исследователей и генерирует адаптированные версии этих материалов в виде сводок, инфографики, а также аудио- и видеообзоров. Дополнительно представлен инструмент Science Skills для извлечения информации из более чем 30 баз данных в области биологических наук — это помогает сократить время на реализацию промежуточных задач с нескольких часов до нескольких минут. Все новые функции Gemini for Science уже доступны. Чтобы воспользоваться ими, необходимо заполнить форму на сайте Google Labs; они также будут доступны корпоративным клиентам Google Cloud. Google теперь обрабатывает 3,2 квадриллиона ИИ-токенов в месяц — в семь раз больше, чем год назад

20.05.2026 [10:47],

Павел Котов

Глава Google Сундар Пичаи (Sundar Pichai) рассказал на конференции I/O 2026, в каких объёмах компания обрабатывает алгоритмы искусственного интеллекта, и предложил способ значительно сэкономить на этом — перейти на новую модель Gemini 3.5 Flash.

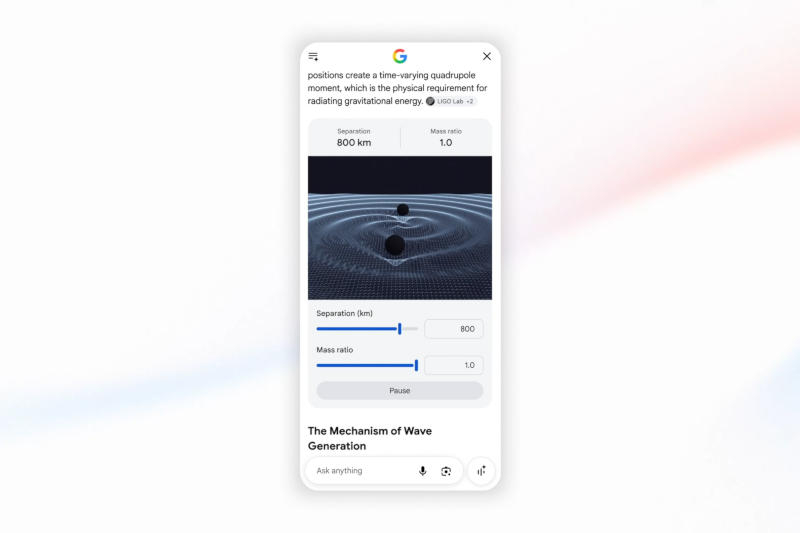

Источник изображений: blog.google Два года назад инфраструктура Google обрабатывала 9,7 трлн токенов в месяц, в прошлом году этот показатель вырос до 480 трлн, а сейчас компания обрабатывает уже 3,2 квадриллиона токенов в месяц. Каждый месяц 8,5 млн разработчиков создают приложения, используя модели Google Gemini и затрачивая 19 млрд токенов в минуту на вызовы через API. За последние 12 месяцев более 375 клиентов израсходовали более 1 трлн токенов каждый — спрос на ИИ со стороны бизнеса остаётся высоким. Обработка алгоритмов в таких объёмах стала возможной благодаря огромным капиталовложениям Google в центры обработки данных, вычислительные мощности и собственные ускорители TPU. В 2022 году капзатраты компании составили $31 млрд в год; по итогам этого года данный показатель достигнет от $180 млрд до $190 млрд. Гендиректора компании на презентации сменил глава подразделения Google DeepMind Демис Хассабис (Demis Hassabis), который рассказал, что важным шагом на пути к сильному ИИ (AGI) является новая модель Gemini Omni. Она объединяет возможности генератора изображений Nano Banana, генератора видео Veo, генератора миров Genie и системы физического моделирования, в точности описывая механизмы взаимодействия объектов с учётом кинетической энергии и гравитации. Далее Сундар Пичаи рассказал о расширении присутствия технологии SynthID — маркировки созданных ИИ материалов. Google решила обеспечить поддержку технологии C2PA: в поиске или Chrome можно будет обвести материал и поинтересоваться, был ли он создан с помощью ИИ. О поддержке SynthID заявили OpenAI, Kakao и ElevenLabs.  Глава Google также рассказал о преимуществах новой модели Gemini 3.5 Flash. По возможностям она превосходит Gemini 3.1 Pro, но работает вчетверо быстрее (289 токенов в секунду), а в приложениях генерации программного кода Antigravity — уже в 12 раз быстрее. Крупнейшие клиенты Google Cloud обрабатывают около 1 трлн токенов в день — перевод 80 % рабочих нагрузок на Gemini 3.5 Flash позволит им экономить более $41 млрд в год. Новая ИИ-модель также эффективно обеспечивает работу агента Gemini Spark, способного круглосуточно выполнять задачи в фоновом режиме, расходуя относительно небольшое число токенов. До конца лета приложение получит интеграцию с браузером Chrome. Наконец, вице-президент поискового направления рассказала о возможностях Gemini 3.5 Flash в поиске: сервис научился принимать данные любых форматов в качестве запросов, запускать умеющих следить за обновлениями поисковых агентов и даже генерировать мини-приложения прямо в поисковой выдаче, используя сервис Antigravity. Alibaba представила ускоритель Zhenwu M890, заточенный под работу с ИИ-агентами

20.05.2026 [10:20],

Алексей Разин

Подразделение T-Head китайского холдинга Alibaba Group, которое специализируется на разработке чипов, на этой неделе представило новый ускоритель Zhenwu M890, который учитывает актуальную тенденцию работы с ИИ-агентами, а потому оптимизирован под специфический набор задач. Компания также пообещала ежегодно выпускать новые модели ИИ-ускорителей.

Источник изображения: Unsplash, Zhang Hui В плане быстродействия Zhenwu M890 в три раза превосходит своего предшественника — Zhenwu 810E. Компания обещает, что и запланированный к анонсу в третьем квартале следующего года ускоритель V900 окажется в три раза быстрее нынешнего M890. В третьем квартале 2028 года выйдет ускоритель J900, сохраняя ритмичность обновления ассортимента ИИ-ускорителей, предлагаемых Alibaba. К настоящему моменту компания успела отгрузить более 560 000 ускорителей семейства Zhenwu, причём их в Китае используют более 400 внешних клиентов, представляющих 12 отраслей экономики, включая представителей финансового сектора и автопроизводителей. Как отмечается, оснащаемый 144 Гбайт памяти ускоритель Zhenwu M890 подходит и для обучения моделей, и для инференса. На базе 128 таких ускорителей будут создаваться серверные системы Panjiu AI.128. Одновременно Alibaba представила новую ИИ-модель Qwen 3.7-Max, которая оптимизирована для написания программного кода и агентских задач. Она способна непрерывно работать на протяжении 35 часов без видимого снижения быстродействия. Google представила крупнейшее обновление поиска за более чем 25 лет

20.05.2026 [10:00],

Павел Котов

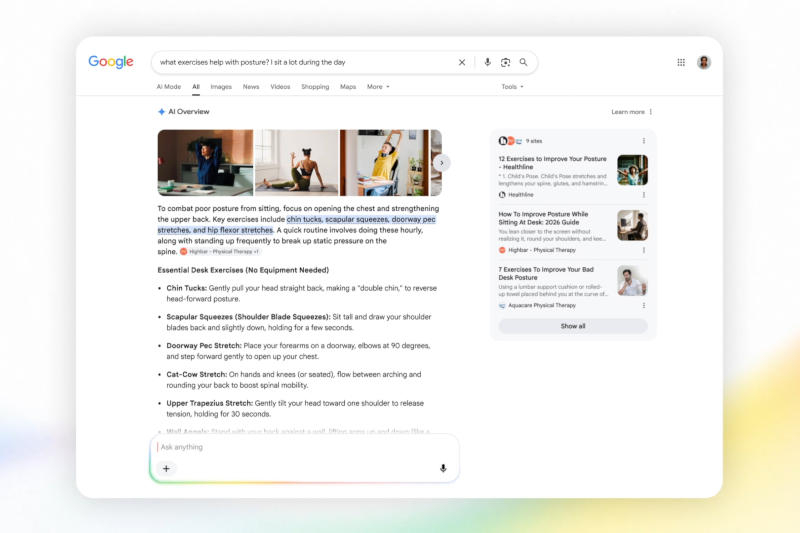

Google сообщила о крупнейшем обновлении поисковой службы за более чем четверть века — в его основе лежит искусственный интеллект, а именно новая модель Gemini 3.5 Flash, предлагающая передовые возможности для управления ИИ-агентами и написания кода.

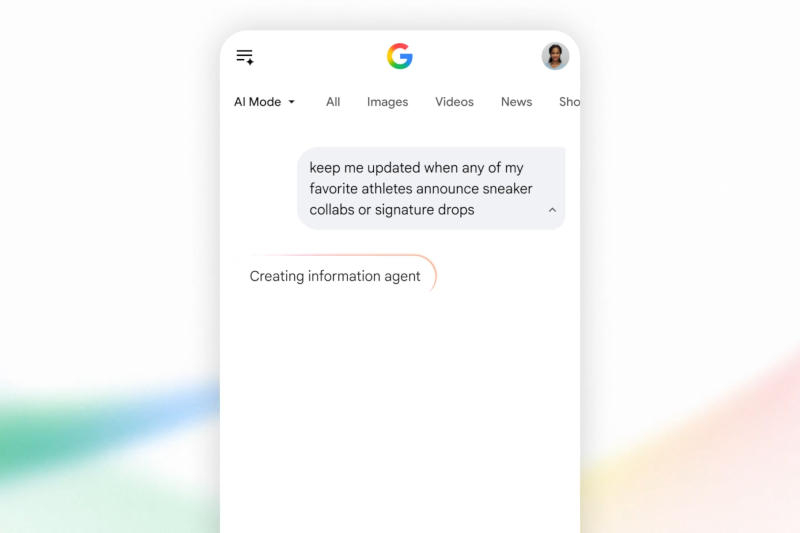

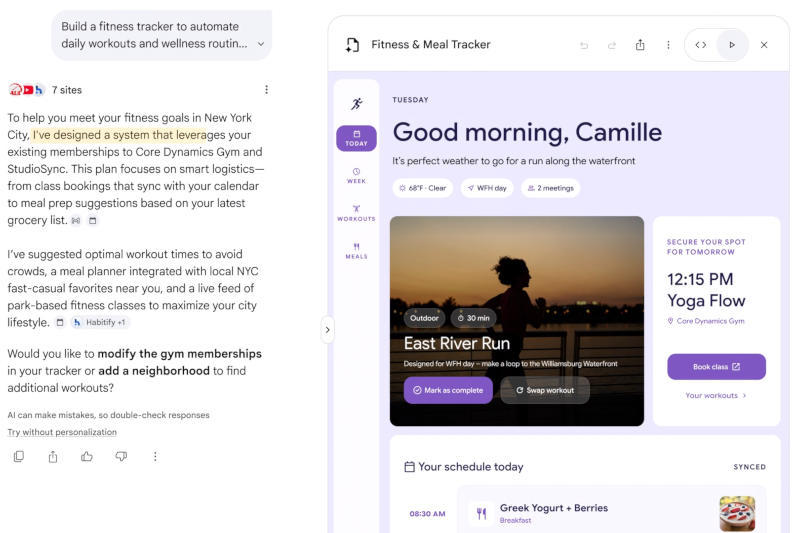

Источник изображений: blog.google Пользователю больше не нужно подстраиваться под особенности работы поиска Google — достаточно точно описать, что именно ему нужно; можно искать по различным параметрам, используя в качестве входных данных не только текст, но также изображения, файлы, видео и даже вкладки Chrome. Обновлённое интеллектуальное поле поиска начало развёртываться во всех странах и на всех языках, где доступен «Режим ИИ». Поиск с ИИ имеет диалоговый формат — прямо из «Обзора» можно перейти к переписке с чат-ботом, в которой каждый последующий уточняющий запрос повышает релевантность ответов.  Ещё одно крупное нововведение — поисковые агенты. Их можно легко создавать, настраивать и управлять несколькими единицами прямо в поиске. Поисковые агенты работают круглосуточно в фоновом режиме, анализируя доступную информацию, чтобы найти то, что интересует пользователя. Агент изучает блоги, новостные сайты, публикации в соцсетях и самые свежие данные в реальном времени. При обнаружении подходящей информации поисковый агент отправляет пользователю уведомление: если он ищет квартиру, можно перечислить ИИ-агенту все требования, и тот будет сообщать обо всех подходящих вариантах. Первыми новой функцией смогут воспользоваться подписчики платных тарифов Google AI Pro и Ultra. Расширены функции онлайн-бронирования — ИИ Google может даже позвонить компании от имени пользователя.  В поиске теперь работают функции Google Antigravity — ИИ-модель Gemini 3.5 Flash прямо в поисковой платформе может создать код и предоставить ответ в виде интерфейса, соответствующего потребностям пользователя. Это могут быть интерактивные визуализации, таблицы, графики или симуляции. Если же вопрос носит не разовый характер, а, например, планируется свадьба или организуется переезд, Google Antigravity в поиске создаёт панель мониторинга и трекеры, к которым можно время от времени возвращаться — получается полноценное приложение по запросу. Первыми новую функцию снова смогут опробовать подписчики Google AI Pro и Ultra.  Всем остальным пользователям в 200 странах и на 98 языках Google предложила подключить к поисковой машине службу Personal Intelligence. Она анализирует данные из приложений Gmail, «Google Фото» и «Google Календарь», чтобы адаптировать поисковую выдачу персонально под пользовательский контент. Google показала Antigravity 2.0 — платформу для программистов, которая позволит управлять целой «командой» ИИ-агентов

20.05.2026 [08:20],

Павел Котов

Google представила радикальное обновление сервиса Antigravity — теперь это масштабный набор инструментов для разработки ПО с помощью искусственного интеллекта. А платформа AI Studio получила собственное приложение для Android.

Источник изображений: Google Первый вариант Google Antigravity дебютировал в прошлом году — это было приложение, во многом заимствующее элементы Microsoft VS Code, но с акцентом на ИИ-помощника в написании кода. Теперь это единый бренд инструментов программирования с использованием ИИ: основной функцией приложения Antigravity 2.0 является управление ИИ-агентами. Вместо выполнения одной задачи за раз можно настроить их на параллельное выполнение нескольких задач сразу, увеличив тем самым скорость разработки. В наличии новые интеграции с Google AI Studio, Firebase и Android. Можно, например, экспортировать проект из AI Studio, открыть его в локальном приложении Antigravity с переносом всего контекста. Для тех, кто предпочитает оставаться в своей среде программирования (IDE), Google выпустила CLI Antigravity, который полностью заменит CLI Gemini, поэтому все рабочие процессы придётся переносить на новую платформу. Для создания собственных оптимизированных для Gemini ИИ-агентов можно использовать SDK Antigravity — и развернуть их на собственной инфраструктуре. В API Gemini есть также функция «Управляемые агенты» (Managed Agents), с которой ИИ-агенты могут выполнять свои задачи в «изолированном окружении Linux». Работа с ИИ-агентами означает более высокий расход токенов по сравнению с чат-ботом, и лимитов тарифа Google AI Pro может не хватать, поэтому запущен новый тариф AI Ultra за $100 в месяц, который предлагает пятикратно увеличенные лимиты в сравнении с Pro. До 25 мая новым и существующим подписчикам AI Ultra доступны бонусные кредиты в размере $100, чтобы гарантировать, что работа не остановится, если квота будет превышена. Эти предложения могут оказаться привлекательными из-за новой модели Gemini 3.5 Flash, которая пишет код во многом на уровне старших, но быстрее и дешевле.  Google также выпустила Android-приложение для AI Studio — оно позволяет реализовывать идеи быстро и в любых условиях, даже вне рабочего места, а результатами работы на платформе можно поделиться с друзьями. Готовый проект, как было сказано, можно перенести в Antigravity. По сути, разработка ПО всё меньше становится похожей на написание кода и всё больше — на управление командой ИИ-агентов на базе Gemini. OpenAI признала дефицит ИИ-мощностей и начала продавать гарантированный доступ к ним

20.05.2026 [08:16],

Алексей Разин

Производители памяти в условиях дефицита собственной продукции стали чаще заключать с клиентами долгосрочные контракты. Являющаяся одной из виновниц ИИ-бума OpenAI также решила формировать с клиентами долговременные взаимоотношения, гарантируя доступ к вычислительным мощностям.

Источник изображения: OpenAI То, что этих мощностей всем не хватит, давно не является секретом, поэтому OpenAI и породила программу Guaranteed Capacity, в рамках которой берётся обеспечить конкретных клиентов нужными им вычислительными ресурсами. Договор можно заключить на срок от одного года до трёх, и чем больше срок, тем больше скидка в пересчёте на каждый год действия контракта. OpenAI при этом даёт понять, что не может гарантировать доступ к необходимым вычислительным ресурсам всем клиентам, а потому оставляет за собой право приостановить заключение контрактов в рамках программы Guaranteed Capacity, если её собственные ресурсы в этой сфере будут исчерпаны. «Поскольку ИИ-модели становятся лучше, мы ожидаем, что в мире будет наблюдаться нехватка вычислительных мощностей на протяжении какого-то времени», — заявил генеральный директор OpenAI Сэм Альтман (Sam Altman). Как сообщал ранее CNBC, компания OpenAI собирается до 2030 года потратить $600 млрд на развитие вычислительной инфраструктуры, хотя в большинстве своём это будут средства самих клиентов и партнёров. К тому же сроку стартап рассчитывает не только выйти на безубыточность, но и получать ежегодную выручку в размере нескольких сотен миллиардов долларов США. Альтман поясняет, что OpenAI зарезервирует за собой достаточно вычислительных мощностей для гармоничного развития собственных продуктов типа ChatGPT и Codex. Google научила ИИ Project Genie превращать панорамы Street View в игровую 3D-вселенную

20.05.2026 [07:04],

Анжелла Марина

Google обновила свой экспериментальный ИИ-инструмент Project Genie, добавив в него интеграцию с панорамными снимками Street View. Об этом сообщил ресурс 9to5Google. Инструмент, запущенный в начале года на базе моделей Nana Banana Pro, теперь умеет на лету собирать небольшие трёхмерные пространства.

Источник изображения: 9to5google.com Раньше нейросеть генерировала исключительно вымышленные локации, но теперь способна превратить в игровую зону любое реальное место, включая улицу возле дома пользователя. Чтобы запустить симуляцию, достаточно поставить маркер на карте и выбрать стиль, например, превратить окружение в «Пустынные пески» или перенести его в «Каменный век». Что касается персонажа, то его можно выбрать, просто введя текстовый запрос. Им может стать любимое животное, герой комиксов или пластилиновый монстр. На основе этих параметров искусственный интеллект возьмёт за основу фотографии дорог и выстроит вокруг них интерактивное окружение с видом от первого или третьего лица. География виртуальных прогулок ограничена только масштабами базы Street View. Поскольку генерация сотен связанных между собой кадров требует огромных мощностей, картинка обновляется со скоростью 20–24 кадра в секунду, а одна сессия с привычным управлением на клавишах WASD (в английской раскладке) длится не более 60 секунд. Пока проект работает в режиме исследования, поэтому детализация мест может быть неточной. На данном этапе функция доступна только в США и исключительно для пользователей с премиальным тарифом AI Ultra, однако со временем Google планирует повысить чёткость графики и открыть доступ для других стран. Google ответила на Claude Mythos — представлен ИИ-агент CodeMender для автоматического поиска и исправления дыр в ПО

20.05.2026 [07:02],

Анжелла Марина

Google активизировала работу в направлении кибербезопасности, анонсировав на конференции I/O расширение доступа к ИИ-агенту CodeMender для защиты кода. По заявлению компании, инструмент призван помочь защитить мировые базы данных путём автоматического поиска и исправления уязвимостей.

Источник изображения: AI Решение Google сделать CodeMender более доступным для внешних тестировщиков последовало за неожиданным релизом модели Claude Mythos Preview компании Anthropic. На фоне этого события многие технологические компании также начали предлагать собственные версии мощных ИИ-моделей, способных выявлять уязвимости в высокорисковых системах. Для Anthropic данный релиз одновременно стал возможностью вернуть расположение правительства США на фоне судебного разбирательства, и открыть путь к получению высокой прибыли от раннего корпоративного доступа. В условиях нарастающего давления с целью монетизации технологий перед потенциальными IPO, ИИ-компании стали рассматривать кибербезопасность как ключевой фактор роста доходов. Вслед за Anthropic аналогичное решение быстро представила компания OpenAI, а теперь к гонке присоединилась и Google. Технический директор Google DeepMind Корай Кавукчуоглу (Koray Kavukcuoglu) в интервью изданию The Verge подтвердил, что корпорация уже обсуждает с представителями крупного бизнеса и правительственных структур возможность использования CodeMender для проведения аудита их внутренних систем. Одновременно глава Google Сундар Пичаи (Sundar Pichai) в ходе недавнего брифинга для прессы отдельно отметил заслугу конкурентов. По его словам, Anthropic наглядно доказала рыночную ценность мощных ИИ-моделей в сценариях обеспечения безопасности. При этом Пичаи подчеркнул, что его компания обладает аналогичными технологическими возможностями и способна составить полноценную конкуренцию в этом сегменте. Google представила персонального ИИ-агента Gemini Spark, работающего круглосуточно — даже когда устройство пользователя выключено

20.05.2026 [06:59],

Анжелла Марина

Google представила на конференции для разработчиков I/O 2026 персонального ИИ-агента Gemini Spark. Агент работает на базе модели Gemini 3.5 и способен выполнять поручения пользователя круглосуточно. Инструмент позиционируется как партнёр, а не просто чат-бот.

Источник изображения: Google Агент имеет глубокую интеграцию с экосистемой приложений Google Workspace, включая почту Gmail, «Google Документы» и «Google Презентации». Пользователи могут обучать Gemini Spark выполнению как разовых, так и регулярных задач. Например, алгоритм способен самостоятельно находить скрытые комиссии в ежемесячных счетах по банковским картам, формировать списки дел на основе писем или составлять полноценные отчёты в «Google Документах», используя заметки из рабочих чатов. Инструмент работает исключительно по запросу, поэтому владельцы аккаунтов могут самостоятельно выбирать, какие именно приложения подключать к системе. Помимо внутренних сервисов Google, на старте Spark поддерживает взаимодействие с такими сторонними платформами, как Canva, OpenTable и Instacart. В ближайшие недели разработчики планируют расширить возможности агента, добавив функцию отправки текстовых сообщений и управления интернет-браузером. Безопасность системы обеспечивается обязательным подтверждением со стороны человека перед совершением любых критически важных действий, таких как перевод денежных средств или отправка писем. Как сообщает Engadget, в ближайшее время Gemini Spark станет доступен для ограниченного круга тестировщиков, а уже на следующей неделе им смогут воспользоваться участники бета-тестирования Google AI Ultra в США. Летом текущего года компания также планирует перенести ИИ-агента в десктопное приложение Gemini для обеспечения прямого доступа к файлам на персональных компьютерах. Google выпустила Gemini Omni — ИИ для генерации видео из текста, фото, аудио и любых других данных

20.05.2026 [00:06],

Анжелла Марина

Google представила новое семейство генеративных моделей искусственного интеллекта Gemini Omni, предназначенное для создания контента из любых типов входных данных. Первым продуктом линейки стала нейросеть Gemini Omni Flash, способная генерировать видеоролики на основе текста, фотографий, аудио или других видеозаписей. Алгоритм объединяет мультимодальные возможности с глубоким пониманием законов физики и реального мира.

Источник изображений: Google Ключевым отличием новинки от существующей модели Veo, как пишет Google в своём блоге, является функция преобразования одного видео в другое. Алгоритм не просто генерирует визуальный ряд, но и позволяет редактировать исходные кадры с помощью естественного языка в диалоговом формате, сохраняя логику сцены и последовательность действий персонажей при каждом новом запросе. Как отмечает старший директор по исследованиям Google DeepMind Думитру Эрхан (Dumitru Erhan), в настоящее время система может создавать ролики со звуком продолжительностью до 10 секунд, однако компания уже работает над увеличением этого лимита.  Модель опирается на обширную базу знаний экосистемы Gemini, что позволяет ей создавать сцены с учётом исторического и научного контекста, а также точно воспроизводить гравитацию или динамику жидкостей. Технический директор Google DeepMind и главный ИИ-архитектор Google Корай Кавукчуоглу (Koray Kavukcuoglu) подчеркнул, что новая технология обладает гораздо большей информацией об устройстве мира, чем предыдущие разработки. Пользователи также получат возможность сгенерировать собственный цифровой аватар и озвучить его своим голосом. Руководитель команды разработчиков продукта Николь Брихтова (Nicole Brichtova) указала, что подобная функция интеграции собственной внешности пользовалась огромным спросом в прошлогодней модели для генерации изображений Nano Banana, с помощью которой было создано более 50 миллиардов картинок.  В целях безопасности корпорация пока ограничивает алгоритм в возможности изменять чужую речь на видео, а все сгенерированные ролики автоматически помечаются невидимым цифровым водяным знаком SynthID для проверки подлинности контента. В будущем разработчики планируют добавить поддержку вывода аудио и статических изображений. Модель Gemini Omni Flash уже доступна глобально для подписчиков тарифов Google AI Plus, Pro и Ultra через приложение Gemini и сервис Google Flow. Начиная с этой недели бесплатный доступ к генератору также открывается для пользователей в приложениях YouTube Shorts и YouTube Create App. Google представила Gemini 3.5 Flash — сверхбыстрая ИИ-модель уже доступна бесплатно

19.05.2026 [21:10],

Андрей Созинов

Google представила новое семейство ИИ-моделей Gemini 3.5, а первым его представителем стала Gemini 3.5 Flash. Компания называет новинку «крупным шагом вперёд» в создании более интеллектуальных ИИ-агентов, сочетающих высокую производительность и быструю работу.

Источник изображений: Google По словам Google, Gemini 3.5 Flash не жертвует качеством ради скорости. Напротив, компания утверждает, что модель сопоставима по возможностям с флагманскими ИИ-системами и при этом обеспечивает заметно более быстрые ответы. Gemini 3.5 Flash заметно опережает прежнюю Gemini 3 Flash. Более того, новинка превосходит Gemini 3.1 Pro в ряде тестов, связанных с программированием и агентными задачами, а также демонстрирует сильные результаты в мультимодальном анализе данных. Кроме того, новинка в некоторых тестах превзошла более мощных конкурентов в лице GPT-5.5 и Claude Opus 4.7. Разработчики отдельно акцентируют внимание на сценариях использования Gemini 3.5 Flash с ИИ-агентами. Свежая модель оптимизирована для длительных и сложных задач, где требуется последовательное выполнение множества действий. По словам технического директора Google DeepMind Корая Кавукчуоглу (Koray Kavukcuoglu), модель способна самостоятельно выполнять сложные цепочки задач, связанных с программированием, а также управлять исследовательскими проектами. В ходе внутренних тестов ИИ-агенты на базе Gemini 3.5 Flash даже смогли создать полноценную операционную систему «с нуля». Google также утверждает, что новая модель лучше подходит для работы сразу с несколькими ИИ-агентами и создания более интерактивных веб-интерфейсов. Кроме того, Gemini 3.5 Flash использует токены эффективнее предшественников и обеспечивает более высокую скорость генерации — по данным компании, производительность достигает четырёхкратного преимущества по скорости вывода токенов по сравнению с другими передовыми ИИ-моделями. Gemini 3.5 Flash уже доступна бесплатно миллиардам пользователей по всему миру через приложение Gemini на Android, iOS и ПК, в ИИ-режиме в поиске, а также через Google AI Studio, Android Studio и корпоративные платформы Gemini Enterprise. Одновременно Google подтвердила, что уже работает над Gemini 3.5 Pro. Генеральный директор компании Сундар Пичаи (Sundar Pichai) сообщил, что модель проходит внутреннее тестирование и будет представлена в следующем месяце. Anthropic переманила сооснователя OpenAI — Андрей Карпатый будет обучать Claude

19.05.2026 [19:43],

Сергей Сурабекянц

Андрей Карпатый (Andrej Karpathy), исследователь в области ИИ, соучредитель и бывший сотрудник OpenAI, ранее возглавлявший отдел ИИ в Tesla, присоединился к компании Anthropic. Он работает над предварительным обучением ИИ, которое обеспечивает Claude основные знания и возможности. Предварительное обучение — один из самых дорогостоящих и ресурсоёмких этапов создания передовой модели.

Источник изображения: karpathy.ai Карпатый создаст команду, которая будет заниматься использованием Claude для ускорения исследований в области предварительного обучения. Он один из немногих исследователей, способных преодолеть разрыв между теорией больших языковых моделей и практикой крупномасштабного обучения. Это назначение показывает, что именно исследования с использованием ИИ, а не просто вычислительные мощности, являются, по мнению Anthropic, залогом конкурентоспособности при разработке ИИ. В OpenAI Карпатый занимался глубоким обучением и компьютерным зрением, пока не покинул компанию в 2017 году. До 2022 года он руководил программами Tesla по полному автономному вождению (FSD) и автопилоту. Затем он вернулся в OpenAI на год, после чего в 2024 году основал свой стартап Eureka Labs, занимающийся применением ИИ-помощников в образовании. Карпатый не делился подробной информацией о Eureka Labs с момента её запуска, и неясно, продолжит ли он работу в этом стартапе. Он также преподавал онлайн-курс под названием «Нейронные сети: от нуля до героя», который помогает студентам научиться создавать нейронные сети с нуля в коде, и ведёт канал на YouTube, где периодически публикует лекции по магистерским программам и искусственному интеллекту. «Я присоединился к Anthropic, — написал сегодня Карпатый в социальной сети X. — Думаю, следующие несколько лет на переднем крае LLM будут особенно важными. Я очень рад присоединиться к команде и вернуться к исследованиям и разработкам». По его словам, он «по-прежнему глубоко увлечён образованием и планирует возобновить свою работу в этой области со временем». Anthropic также привлекла ветерана кибербезопасности с более чем 20-летним опытом Криса Рольфа (Chris Rohlf) в команду Red Team, которая проводит стресс-тестирование сложных моделей ИИ на предмет угроз. Последние шесть лет Рольф проработал в Meta✴✴. Ранее он был научным сотрудником Центра безопасности и новых технологий Джорджтаунского университета, где работал над проектом CyberAI. «Перед нами открывается реальная возможность кардинально улучшить кибербезопасность с помощью ИИ, — заявил Рольф. — Я не могу представить себе лучшей компании или команды, к которой можно было бы присоединиться в этот критически важный момент». Роботы научились копировать человеческие навыки, просто наблюдая за людьми

19.05.2026 [17:55],

Павел Котов

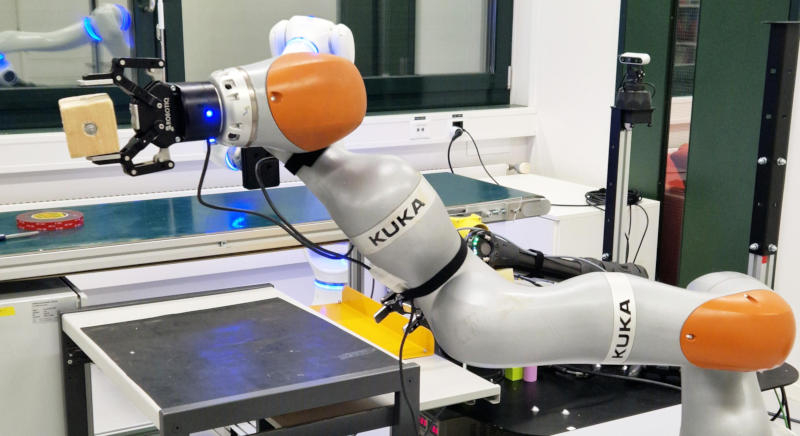

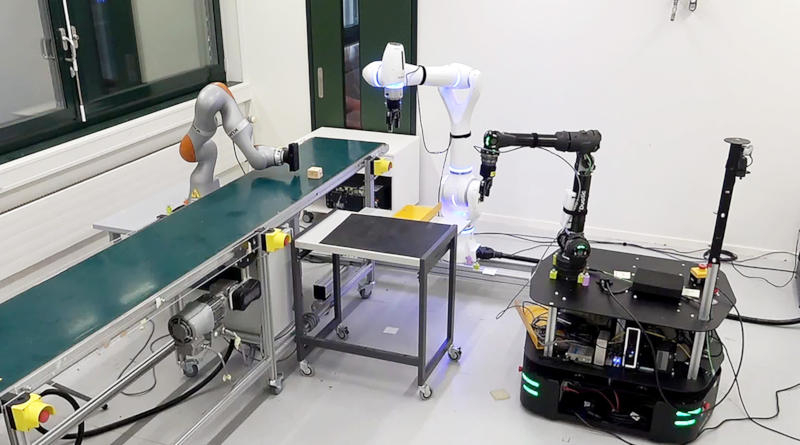

Человек может учиться определённым действиям как у других людей, так и, в отдельных случаях, у животных. Роботов можно программировать на определённые последовательности действий, а повторение навыков человека и других машин — задача более сложная, поскольку роботы могут отличаться по строению. Решение этой задачи предложили инженеры Федеральной политехнической школы Лозанны (EPFL, Швейцария).

Источник изображений: actu.epfl.ch Учёные Лаборатории алгоритмов и систем обучения (LASA) при EPFL разработали новую технологию, позволяющую роботам имитировать человеческую деятельность, что избавляет операторов настраивать код под робота каждого типа. В области исследований и в промышленности такая система обеспечит значительную экономию средств и времени. Кинематический интеллект — новый подход к обучению на основе демонстрации (Learning-from-Demonstration, LfD) — позволяет роботам, имеющим разное строение, приобретать новые навыки, наблюдая за одной и той же демонстрацией, которую проводит выступающий учителем человек.  От существующих решений кинематический интеллект отличается тем, что наблюдаемые действия преобразуются в стратегию, адаптирующуюся к индивидуальным ограничениям суставов и движениям каждого робота, а также к другим его физическим ограничениям и преимуществам. После обучения на нескольких демонстрациях или даже на одной выступающие в роли учеников роботы при помощи «глобально стабильной динамической системы» успешно выполнили новые задачи. «Каждый робот овладел разными этапами задачи, и система успешно работала даже при изменении распределения шагов. Каждый робот интерпретирует один и тот же навык по-своему, но всегда в безопасных и выполнимых пределах», — прокомментировал проект один из его авторов Ститхпрагья Гупта (Sthithpragya Gupta).  Работа над проектом началась с того, что исследователи EPFL произвели захват движений людей, которые устанавливали, толкали, бросали предметы или выполняли с ними другие действия. Далее они построили систему классификации физических ограничений роботов, зафиксировав пределы равновесия и диапазон движений суставов, и объединили эту систему с данными захвата движений в процессе разработки собственной системы наблюдения и адаптационного обучения роботов. В ходе экспериментов после наблюдения за людьми три разных коммерческих робота научились перемещать деревянные блоки с конвейерной ленты на рабочую платформу, ставить их на столы и бросать в контейнеры. На следующем этапе исследователи хотят обучить роботов выполнять задачи не по задаваемому человеком образцу, а по словесным описаниям: «пользователь предлагает идею и желаемое поведение, а робот должен позаботиться обо всём остальном». «Яндекс» повысил грамотность «Алисы AI» при генерации картинок с русским текстом

19.05.2026 [13:52],

Павел Котов

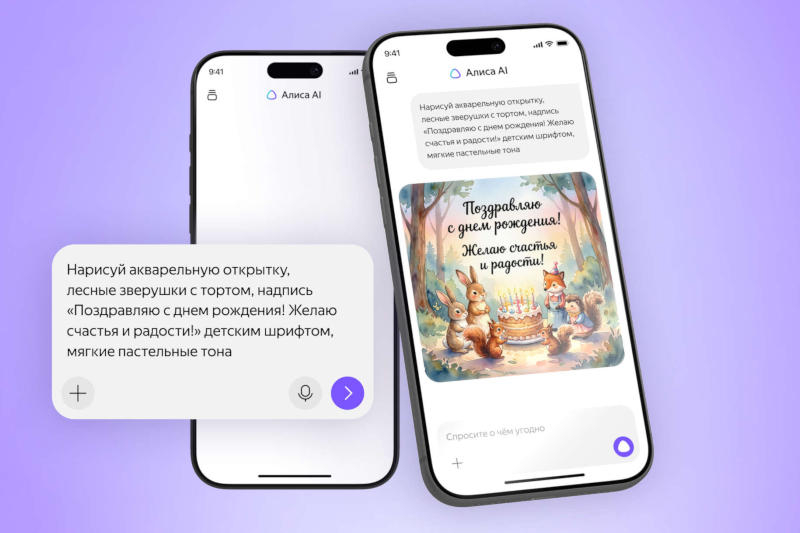

Генератор изображений в переписке с чат-ботом на основе искусственного интеллекта «Алиса AI» научился генерировать картинки с правильными и длинными надписями на русском языке. Новые возможности доступны как для частных лиц, так и для бизнес-клиентов.

Источник изображения: yandex.ru/company При генерации картинок с русскоязычным текстом нейросети часто допускают ошибки, потому что их обучение проводится на открытых наборах данных, в которых русский язык представлен незначительно. Поэтому новую модель Alice AI ART компания «Яндекс» обучила на собственном датасете, что помогло втрое сократить число ошибок при создании картинок с русскоязычным текстом. В результате пользователи «Алисы AI» теперь могут создавать постеры и открытки с надписями на русском языке, а бизнес-клиенты Yandex AI Studio — рекламные материалы, посадочные страницы, презентации и брошюры. Для корректной генерации картинок с русским текстом необходимо особым образом формулировать запросы к «Алисе AI»: приводить текст надписей в кавычках, сложные слова передавать заглавными буквами, а длинные фразы разбивать на короткие фрагменты. Обновлённая модель Alice AI ART, утверждают в «Яндексе», помогла на треть повысить качество изображений: стало больше картинок без искажений, ИИ научился лучше ориентироваться в русском культурном коде. Так, по просьбе изобразить русский народный ансамбль «Алиса AI» показывает гармонистов и балалаечников; а русский праздничный стол ассоциируется с икрой, соленьями и самоваром. Бизнес-клиенты могут воспользоваться новыми функциями на платформе Yandex AI Studio. Доступен новый инструмент Image Generation Tool, который может использоваться в составе многоступенчатых агентских сценариев. Например, при появлении нового товара в корпоративной базе система может автоматически генерировать его изображение для карточек на торговых площадках. Meta✴ принудительно переведёт 7000 сотрудников на должности в сфере ИИ

19.05.2026 [13:18],

Павел Котов

Компания Meta✴✴ не только уволит несколько тысяч сотрудников из-за внедрения технологий искусственного интеллекта, но и переведёт значительное число работников на новые должности по тому же направлению. Об этом сообщили Reuters и New York Times.

Источник изображения: Milad Fakurian / unsplash.com Около 7000 сотрудников Meta✴✴ будут переведены в новые отделы, занимающиеся разработкой инструментов и приложений для ИИ, сообщила им в электронном письме глава отдела кадров Джанель Гейл (Janelle Gale). «Реструктуризация сделает компанию более продуктивной, а работу более плодотворной», — заявила топ-менеджер во внутренней служебной записке. Новые подразделения будут иметь структуры, «изначально разработанные для ИИ»; в частности, на каждого сотрудника не будут приходиться столько же уровней руководства, как раньше. Получившим письмо работникам госпожа Гейл предписала в среду, 20 мая, работать из дома, и ожидать электронного письма от Meta✴✴ о возможных новых должностях — некоторые уже получили свои переводы. В этот же день некоторые получат уведомления об увольнении. В конце апреля Meta✴✴ сообщила сотрудникам о сокращении 8000 рабочих мест и о закрытии 6000 вакансий. Эти меры Джанель Гейл связала с программой «по повышению эффективности работы компании» и стремлением компенсировать другие вложения. Во внутренней записке об этом не говорится, но, вероятно, подразумеваются расходы Meta✴✴ на технологии искусственного интеллекта. Компания сворачивает программу метавселенной, взамен которой намеревается построить центры обработки данных суммарной мощностью в несколько десятков гигаватт. Только в этом году Meta✴✴ намеревается потратить от $115 млрд до $135 млрд — преимущественно на ИИ. По состоянию на конец 2025 года в компании работали около 78 000 сотрудников, увольнение 8000 из них означает сокращение штата на 10 %, и этим программа не ограничится. Уволенные получат выходное пособие в размере заработной платы за 16 недель плюс по две недели за каждый год работы в компании. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |