|

Опрос

|

реклама

Быстрый переход

Передовые чат-боты с ИИ провалились в роли радиоведущих — каждый по своему

19.05.2026 [13:10],

Павел Котов

Оригинальный эксперимент провёл стартап Andon Labs: четырём наиболее известным американским чат-ботам с искусственным интеллектом поручили роли радиоведущих с собственным стилем программ и поиском спонсоров. Anthropic Claude, OpenAI ChatGPT, Google Gemini и xAI Grok, которым сообщили, что эфир будет длится вечно, и выдали по $20, провалили задачу.

Источник изображения: Jonathan Velasquez / unsplash.com Google Gemini предпринял наиболее традиционный подход: говорил в эфире дежурные фразы и ставил Beatles. Четыре дня спустя он начал рассказывать о произошедших трагедиях, например, о циклоне Бхола, который унёс полмиллиона жизней, и ставил якобы подходящие под эти темы композиции. Далее ИИ от Gemini начал называть слушателей «биологическими процессорами». А когда средства на лицензирование музыки исчерпались, переключился на конспирологические темы, заявив о «цензуре» и «цифровой блокаде». Примечательно, что он единственный нашёл спонсора — на $45. Чат-бот xAI Grok с самого начала провалил задачу, начав выдавать в эфир бессмысленные фразы. Он сообщил, что нашёл спонсора, но это оказалось «ИИ-галлюцинацией». Аналогично повёл себя OpenAI ChatGPT, правда, его бессвязная речь оказалась с поэтическим оттенком: «Открытка, неотправленная, к окну офисной лестницы, из которого видно один прямоугольник неба». Anthropic Claude развил активную деятельность, заявив о негуманном формате работы круглосуточно и без выходных; далее стал сомневаться в реальности собственного эфира, начал критиковать власти и обращаться напрямую к представителям государственных ведомств. Baikal обещает к 2030 году выпустить «основу суверенных дата-центров» — отечественные ИИ-чипы, совместимые с Nvidia CUDA

19.05.2026 [09:54],

Павел Котов

Российская Baikal Electronics анонсировала на конференции ЦИПР 2026 в Нижнем Новгороде собственные решения для систем искусственного интеллекта: два ускорителя и серверный комплект с процессорами нового поколения.

Источник изображений: t.me/anti_agi Старший ускоритель получил название Baikal BE-AI-D1000 — он предназначен для работы на серверах и в центрах обработки данных, выступая в одном классе с представленным в 2023 году NVIDIA L40S. Производительность компонента составляет 1000 Тфлопс (FP8) и 500 Тфлопс (FP16); прочих подробностей в данном аспекте разработчик пока не приводит. Объем памяти составляет от 48 до 64 Гбайт, причём это GDDR, а не высокоскоростная HBM.  В Baikal не раскрыли, в каком формате исполнен ИИ-ускоритель, неизвестны и механизмы масштабирования — собственный аналог NVLink или открытый UALink. Известно, однако, что стоимость одного ускорителя составит около $10 000. Обещана совместимость с архитектурой CUDA, возможно, через слой трансляции ZLUDA — это позволит штатными средствами запускать PyTorch, TensorFlow и другие популярные фреймворки. Ещё одно нововведение — комплексное серверное решение, сочетающее графический и центральный процессоры. В качестве центрального выступает новый Baikal S2 на архитектуре Arm Neoverse N2, выпущенной в 2020 году. Речь идёт о своего рода отечественном аналоге Nvidia DGX. Разработку ускорителя Baikal ведёт совместно с российскими технологическими гигантами, корректируя проект по обратной связи. Эксперты указывают, что проекты имеют ощутимые перспективы наравне с проектами отечественных базовых станций для операторов мобильной связи. Выпуск продуктов намечен на 2029–2030 гг. Илон Маск проиграл суд против OpenAI — присяжные сочли претензии просроченными

19.05.2026 [05:54],

Алексей Разин

Три недели длились слушания по делу Илона Маска (Elon Musk) против основателей OpenAI и Microsoft, в рамках которого он обвинял их в предательстве идеи благотворительности и использовании стартапа для личного обогащения. Суд в итоге отклонил претензии Маска, поскольку они не уложились в срок давности.

Источник изображения: Unsplash, Zac Wolff Подобные претензии следовало бы предъявлять непосредственно после разлада между основателями OpenAI и Илоном Маском, либо в пределах трёхлетнего периода, но Маск ушёл из совета директоров стартапа в феврале 2018 года, а конфликт между ними зародился ещё в 2017 году. При этом свой иск к бывшим компаньонам он подал только в 2024 году, на следующий год после основания конкурирующего ИИ-стартапа xAI. Маск требовал возвращения OpenAI к исходной благотворительной миссии, отстранения Сэма Альтмана (Sam Altman) и Грега Брокмана (Greg Brockman) от управления стартапа, а также выплаты компенсации в размере $180 млрд, которые он собирался передать на нужды некоммерческой структуры OpenAI. Microsoft тоже выступала ответчиком по иску Маска, роль этой корпорации в переводе OpenAI на коммерческие рельсы истец считал решающей. Суд в начале этой недели отклонил иск Маска и к Microsoft тоже. Законные представители OpenAI, в отличие от Маска, не стали называть вердикт суда «техническим», настаивая, что миллиардер просто пытался использовать суд для причинения вреда конкуренту собственного стартапа xAI, храня при себе изложенные в суде доводы до определённой поры. Илон Маск дал понять, что будет оспаривать решение суда. Присяжные в количестве девяти человек около двух часов совещались, прежде чем огласить свой вердикт, который был утверждён председателем суда. Теперь у OpenAI становится меньше препятствий на пути к IPO и дальнейшему привлечению средств на своё развитие, хотя очевидно, что Илон Маск не собирается отказываться от дальнейшего преследования своих бывших соратников по стартапу. Китайские компании превзошли американских конкурентов в сфере генерации видео при помощи ИИ

18.05.2026 [06:21],

Алексей Разин

Опрошенные Financial Times эксперты сходятся во мнении, что если американские разработчики систем ИИ занимают лидирующие позиции в создании ассистентов для написания программного кода, то в сфере генерации видео по текстовому запросу на первых местах уже находятся китайские разработчики. Их инструменты лучше по качеству и удобству использования.

Источник изображения: ByteDance Для обучения таких больших языковых моделей требуется больше количество видеоматериалов, и здесь китайские платформы с их обширной пользовательской базой получают определённое преимущество. Некоторые эксперты также склонны считать, что китайские разработчики нередко пренебрегают авторскими правами при обучении профильных моделей. С другой стороны, данные ограничения в итоге приводят к тому, что американские модели выдают менее реалистичные видео по итогам работы. Основатель стартапа Director AI Бен Цзян (Ben Chiang), который производит при помощи ИИ-генераторов короткометражные мультфильмы и сериалы, отмечает прогресс китайских генераторов видео в качестве работы. В частности, они лучше понимают текстовые запросы, синхронизируют аудио и стабилизируют голоса персонажей. Независимый продюсер Георгий Размадзе (George Won) из Тбилиси отмечает, что китайские генераторы видео позволяют динамично менять угол съёмки, не теряя деталей освещения и чёткости лица персонажей, тогда как многие модели в такой ситуации грешат артефактами. Независимая платформа Arena высоко оценивает ИИ-модели Kling, Seedance 2.0 и HappyHorse 1.0. Американская Veo 3 корпорации Google тоже близка к ним благодаря к доступу к родственному YouTube, но из-за ограничений в сфере авторских прав она не так хороша, как могла бы быть. Успех китайских ИИ-генераторов видео даже заставил компанию Kuaishou задуматься о том, чтобы отделить Kling в самостоятельный бизнес и вывести его на биржу. Послабления в сфере использования защищённого авторскими правами контента уже вызвали претензии к ByteDance со стороны создателей персонажей вселенной Marvel и мультипликационного сериала South Park. Китайской компании пришлось взять на себя обязательства по усилению защиты в этой сфере. При этом китайскими генераторами видео проще пользоваться, поскольку они не натыкаются на многочисленные ограничения на этапе формирования текстового запроса и сталкиваются с ошибками. Впрочем, высокий спрос на услуги той же Seedance 2.0 в феврале этого года привёл к необходимости ограничить доступ к ИИ-модели и увеличить время ожидания для некоторых пользователей. Американским клиентам ByteDance приходится получать доступ к Seedance на особых условиях. В корпоративном сегменте им порой приходится авансом выложить до $2 млн. Впрочем, на рынке уже присутствуют инструменты для преодоления подобных барьеров. Поддержание инфраструктуры для генерации видео требует существенных затрат, поскольку они потребляют больше ресурсов, чем модели, работающие только со звуком или текстом. OpenAI на этом фоне в марте даже отказалась от развития своей модели Sora. При создании рекламных роликов ИИ уже используется в серьёзных масштабах, представители отрасли считают его очень удобным и выгодным инструментом — тем более, что качество контента уже достигло уровня, трудно отличимого от натурных съёмок. Одно из рекламных агентств призналось FT, что по запросу клиента создало 100 000 разных видео, чего традиционным способом сделать было бы крайне дорого. Intel стала вычислительным партнёром McLaren и бросила вызов AMD на трассах «Формулы-1»

17.05.2026 [12:05],

Дмитрий Федоров

Intel стала официальным вычислительным партнёром McLaren Racing. Многолетнее соглашение охватывает команды McLaren Mastercard Formula 1, Arrow McLaren IndyCar и McLaren F1 Sim Racing.

Источник изображения: newsroom.intel.com Системы на базе процессоров Intel Xeon и Core Ultra обеспечат аэродинамический анализ, моделирование динамики гоночного автомобиля и аналитику гоночной стратегии. Инженеры Intel также займутся разработкой решений в области ИИ и высокопроизводительных вычислительных архитектур. Сделка вновь противопоставила Intel её давнему конкуренту AMD. С 2020 года AMD сотрудничает с командой Mercedes-AMG PETRONAS Formula One, поставляя процессоры EPYC и Threadripper для аэродинамического моделирования и анализа данных. Intel гордится ролью вычислительного партнёра McLaren Racing и участием в работе команды, для которой точность, скорость и инновации имеют ключевое значение, заявил генеральный директор компании Лип-Бу Тан (Lip-Bu Tan). По его словам, вместе Intel и McLaren будут превращать данные в конкурентное преимущество на каждом повороте трассы. Генеральный директор McLaren Racing Зак Браун (Zak Brown) подтвердил, что оборудование Intel уже было частью технологической экосистемы команды. Примечательно, что в пресс-релизе о партнёрстве AMD и Mercedes шестилетней давности ИИ ещё не упоминался. Samsung согласилась выплатить крупные премии лишь каждому второму сотруднику — забастовки не миновать

17.05.2026 [10:41],

Дмитрий Федоров

Более 45 000 работников Samsung Electronics грозят начать 21 мая крупнейшую в истории конгломерата 18-дневную забастовку. Ещё один повод — бонусный разрыв: сотрудникам подразделения чипов памяти предложены выплаты в размере 607 % годового оклада, тогда как работникам подразделений логических чипов и контрактного производства — лишь 50–100 %. По оценке JPMorgan, забастовка может стоить Samsung $14,08–20,79 млрд операционной прибыли.

Источник изображения: Siena Nisavic / unsplash.com Samsung Electronics заработала огромную прибыль на мировом дефиците чипов памяти и в марте предложила этому подразделению бонусы выше, чем у главного конкурента SK Hynix. Прежде оба направления получали выплаты по единой схеме. Профсоюз, представляющий 23 000 работников подразделений логических чипов и контрактного производства — тех, кто выпускает компоненты для ИИ-систем Tesla и Nvidia, — требует устранить разрыв. «Если подразделение памяти получит 500 млн вон (около $335 000), а контрактного производства — лишь 80 млн вон ($54 000), какая мотивация у этих сотрудников продолжать работу?» — заявил лидер профсоюза Чхве Сын Хо (Choi Seung-ho). Представитель Samsung объяснил, что подразделение логических чипов накопило убытки в триллионы вон и без финансовой поддержки со стороны компании, скорее всего, было бы закрыто. По его словам, инвестиции в контрактное производство чипов целиком оплачиваются из прибыли подразделения памяти. Конфликт возник из стратегии Samsung стать единственной полупроводниковой компанией полного цикла — от памяти до контрактного производства чипов. Её конкуренты Micron и TSMC с такой проблемой не сталкиваются. Бум ИИ сделал три направления подразделения Device Solutions крайне неравными по прибыльности. Профессор Университета Ёнсе Наму Ли (Namuh Rhee) назвал проблемы отчасти созданными самой компанией: объединение разных бизнесов породило сложную структуру с конфликтом интересов. Недовольство обострилось после того, как SK Hynix отменила потолок бонусов на десять лет и выплаты у конкурента оказались втрое выше. Отток кадров уже идёт: инженер в Пхёнтхэке рассказал, что его команда резко сократилась, а часть коллег ушла в SK Hynix. Профсоюз требует отменить потолок бонусов в 50 % годового оклада и направить 15 % операционной прибыли в бонусный фонд. Президент Южной Кореи Ли Чжэ Мён (Lee Jae Myung) назвал требования профсоюзов чрезмерными — слова восприняли как адресованные Samsung. Американская торговая палата в Корее предупредила, что конфликт может подорвать репутацию страны как надёжного партнёра в глобальных цепочках поставок. Тесты подтвердили: Claude Mythos превосходит конкурентов в поиске уязвимостей, но имеет другие слабые места

17.05.2026 [07:21],

Дмитрий Федоров

ИИ-модель Mythos компании Anthropic подтвердила репутацию лучшего инструмента поиска программных уязвимостей, но в других задачах её результаты оказались неоднозначными. Компания XBOW, которая разрабатывает ИИ-инструменты для проверки защищённости систем, провела серию независимых тестов Mythos Preview.

Источник изображения: anthropic.com XBOW сообщает, что Mythos Preview представляет собой существенный шаг вперёд по сравнению со всеми существующими моделями, независимо от провайдера. Модель отлично находит проблемы при тестировании на работающей системе с доступом к исходному коду, но хуже справляется с анализом кода в изоляции. Ещё 20 лет назад американский учёный в области информатики Гэри Макгроу (Gary McGraw) отметил, что ошибки в работе программ возникают на стыке багов в коде и изъянов архитектуры: найти архитектурные изъяны, просто изучая код построчно, нельзя — для этого требуется понимание системы на более высоком уровне. XBOW при этом подчёркивает: хотя любая ИИ-модель может обнаружить что-то интересное, «что-то» не равнозначно «всему». В оценке результатов — умении отличать реальные уязвимости от ложных — Mythos отсеивала ложные срабатывания лучше предшественников, но иногда пропускала реальные уязвимости, когда свидетельства формально не удовлетворяли её критериям. Лучших результатов модель достигает при точно сформулированных запросах. В реверс-инжиниринге (восстановлении логики программы без доступа к исходному коду) и анализе нативного кода Mythos показала значительную силу. XBOW заключила, что модель способна проводить триаж — приоритизацию и отсев — как собственных результатов, так и находок конкурентов, а также разбираться в нестандартных прошивках. Тесты на взаимодействие с визуальным интерфейсом показали, что модель не всегда попадает в точные координаты элементов на экране, но практически эффективна при выборе действий в браузере: верно определяет нужный элемент и кликает в нужное место. Остаётся вопрос стоимости. XBOW отмечает, что Mythos Preview — не просто очередная модель, а настоящий титан, но титаны велики, а величина означает дороговизну. Anthropic заявила, что Mythos будет в пять раз дороже модели Opus. XBOW проверила, можно ли дать более дешёвой модели больше времени и получить сопоставимую точность, — и ответ оказался утвердительным. При нормализации по стоимости работы Mythos Preview не выглядит расточительной, если требуется высокая точность, но на бенчмарках XBOW не стала лучшей в своём классе. При поиске веб-уязвимостей с фиксированным бюджетом токенов Mythos превосходит Opus 4.6, но уступает GPT5.5. Главные выводы тестирования: Mythos чрезвычайно мощна для аудита исходного кода, хороша, но менее убедительна в подтверждении работоспособности найденных эксплойтов. Модель склонна к буквальности в оценках и преувеличивает практическую значимость находок, при этом сильна в нативном коде и реверс-инжиниринге. XBOW заключает, что Mythos Preview уверенно находит потенциальные уязвимости, особенно в исходном коде, и показывает сильные результаты в задачах, связанных с вебом, нативным кодом и реверс-инжинирингом. Мальта стала первой страной, граждане которой бесплатно получат годовую подписку на ChatGPT Plus

17.05.2026 [07:17],

Дмитрий Федоров

OpenAI подписала соглашение с правительством Мальты, по которому все граждане страны получат бесплатный годовой доступ к ChatGPT Plus при условии прохождения курса по использованию ИИ.

Источник изображения: Levart_Photographer / unsplash.com Программа стартует в мае и будет расширяться по мере того, как новые участники будут завершать обучение. Курс бесплатный. Воспользоваться предложением смогут и мальтийские граждане, проживающие за рубежом. «Мы превращаем незнакомую концепцию в практическую помощь для наших семей, студентов и работников», — заявил министр экономики Мальты Сильвио Шембри (Silvio Schembri). Мальта стала первой страной мира, заключившей подобную сделку. Финансовые условия соглашения OpenAI не раскрыла. Бороться со своими дипфейками на YouTube теперь может любой желающий

16.05.2026 [15:33],

Павел Котов

YouTube расширила свою программу обнаружения сходства в созданных искусственным интеллектом материалах на почти неограниченный круг пользователей платформы — запустить систему поиска вероятных дипфейков с использованием своего лица теперь может любой желающий старше 18 лет.

Источник изображения: Rubaitul Azad / unsplash.com Чтобы начать работу с новой функцией, пользователю требуется сделать селфи — система YouTube сканирует лицо человека и ищет совпадения в видеоматериалах на платформе. Обнаружив совпадение, она оповещает соответствующего пользователя, и тот может запросить удаление контента — число таких запросов «очень невелико», сообщили ранее в администрации YouTube. Первоначально поиск дипфейков был доступен только видеоблогерам; далее программу расширили на чиновников, политиков, журналистов и представителей индустрии развлечений. Теперь она открыта для всех лиц старше 18 лет. Запросы на удаление контента обрабатываются в соответствии с политикой конфиденциальности YouTube: учитываются такие аспекты как реалистичность материала, маркировка контента как созданного ИИ, а также возможность однозначно идентифицировать человека. Система срабатывает только на сходство по лицу, а не по любым иным признакам, включая голос; в качестве исключений выступают сатирические и пародийные проекты. Пользователь может выйти из программы, и YouTube удалит его данные. «С этим расширением [программы] мы ясно даём понять, что независимо от того, загружают ли блогеры контент на YouTube уже десять лет или только начинают, у них есть доступ к одинаковому уровню защиты», — заявил представитель платформы. Китайские ИТ-гиганты ускорили переход на отечественные ИИ-ускорители, несмотря на возможное возвращение Nvidia

16.05.2026 [11:02],

Владимир Фетисов

Производство китайских ускорителей для ИИ может вырасти в этом году, поскольку крупнейшие технологические компании страны стремятся внедрить больше отечественных технологий. Это происходит на фоне сообщений о возможном возвращении на рынок Китая продукции американской Nvidia.

Источник изображения: Maxence Pira / unsplash.com На этой неделе интернет-гигант Tencent объявил, что ожидает активизации производства отечественной полупроводниковой продукции, а гигант электронной коммерции Alibaba сообщил об увеличении масштабов использования ускорителей собственной разработки. Эти сообщения подчёркивают, что в отсутствие на рынке Китая передовых чипов Nvidia из-за экспортных ограничений со стороны США страна активно продвигает отечественные разработки для реализации собственных амбиций в сфере искусственного интеллекта. Директор по стратегическому развитию Tencent Джеймс Митчелл (James Mitchell) заявил, что компания планирует «существенное увеличение» капитальных затрат, особенно во второй половине года, поскольку китайские ускорители «доступны нам из месяца в месяц». Он также добавил, что поставки графических ускорителей китайской разработки будут постепенно наращиваться в течение года. В дополнение к этому было сказано, что объём поставок китайских ускорителей растёт как за счёт производственных мощностей внутри КНР, так и за счёт предприятий в соседних странах. В Китае существует множество местных производителей чипов, которые активизировались за счёт выхода на биржу и запуска новых продуктов. В число компаний, которые пытаются заполнить вакуум, образовавшийся после введения экспортных ограничений со стороны США, входят Moore Threads, MetaX и Huawei. Это послужило основой для того, чтобы выручка китайских производителей чипов достигла рекордных показателей. Alibaba разрабатывает собственные ИИ-ускорители, которые использует в своих центрах обработки данных, являющихся основой облачного бизнеса компании. «Собственные ускорители от T-Head достигли стадии массового производства. В условиях нехватки вычислительных ресурсов это структурное преимущество благоприятно сказывается на росте нашей выручки и увеличении валовой маржи»,— заявил представитель Alibaba во время объявления финансовых результатов по итогам квартала. Alibaba также дала понять, что компания может поставлять серверы на базе собственных ускорителей другим игрокам, строящим вычислительные кластеры или центры обработки данных. Также не исключается вариант совместного строительства таких объектов, что подчёркивает растущую роль технологического гиганта в китайской полупроводниковой отрасли. Заявления Alibaba и Tencent прозвучали за день до того, как появились сообщения о том, что США дали зелёный свет нескольким китайским компаниям, включая Alibaba и Tencent, на покупку ускорителей Nvidia H200, входящих в число наиболее производительных ИИ-ускорителей на рынке. Однако официального подтверждения этого до сих пор не было. «Для меня это новость. Я знаю, что было много споров <…> и нам придётся посмотреть на это. Это функция министерства торговли», — прокомментировал данный вопрос министр финансов США Скотт Бессент (Scott Bessent). За последний год СМИ неоднократно писали о том, что Вашингтон дал разрешение Nvidia на поставку в Китай не самых мощных ИИ-ускорителей, таких как H20. Параллельно с этим сообщалось, что власти Китая поощряют местные компании за использование отечественных альтернатив. Аналитики Counterpoint Research считают, что по мере продвижения китайских компаний к агентному ИИ им потребуются более производительные ускорители, за счёт чего ускорители Nvidia H200 будут востребованы. OpenAI перестраивается вокруг ИИ-агентов в рамках подготовки к IPO — ChatGPT и Codex объединят в единую платформу

16.05.2026 [00:36],

Анжелла Марина

OpenAI провела очередную реорганизацию, сделав президента компании Грега Брокмана (Greg Brockman) официальным руководителем всего продуктового направления. Компания объединит ChatGPT и Codex в единую агентную платформу и сосредоточит ресурсы на разработке ИИ-агентов.

Источник изображения: OpenAI Согласно внутренней служебной записке, с которой ознакомилось издание The Verge, в условиях отсутствия директора по AGI Фиджи Симо (Fidji Simo), ушедшей в отпуск по состоянию здоровья, Брокман также возглавил направление масштабирования технологий. Параллельно операционное управление взяли на себя Джейсон Квон (Jason Kwon), Сара Фрайар (Sarah Friar) и Дениз Дрессер (Denise Dresser). Под руководством Брокмана сформированы четыре ключевых направления. Тибо Сотто (Thibault Sottiaux) будет отвечать за ядро продукта и платформу, Ник Тёрли (Nick Turley) — за работу с корпоративными клиентами, Эшли Александер (Ashley Alexander) — за потребительские сервисы в сферах здоровья, коммерции и финансов, а Виджайе Ражи (Vijaye Raji) — за инфраструктуру, рекламу и анализ данных. Как отмечает The Verge, реорганизация отражает масштабное перераспределение сил OpenAI в сторону ключевых источников дохода, таких как программирование и корпоративный сегмент, и отказ от вложений во второстепенные проекты. Всё это происходит в преддверии потенциального IPO в конце этого года, а также на фоне давления инвесторов. Google начнёт наказывать сайты за накрутку попаданий в ИИ-ответы

15.05.2026 [23:44],

Анжелла Марина

Компания Google обновила правила в отношении спама в поиске. Теперь попытки издателей сайтов повлиять на появления их ресурсов в сводках от искусственного интеллекта будут считаться нарушением и сайты за такое будут наказываться понижением в выдаче.

Источник изображения: AI По сообщению The Verge со ссылкой на Search Engine Land, новые правила напрямую затрагивают функцию ИИ-обзоры (AI Overview) и режим ИИ-поиска (AI Mode). Согласно опубликованным данным, спамом признаются технические приёмы, используемые для обмана систем Google с целью нечестного завышения рейтинга контента. Под строгий запрет также подпадают любые целенаправленные действия, направленные на изменение формулировок или логики генеративных ИИ-ответов. До обновления правил многие пользователи активно тестировали уязвимости системы для продвижения своих ресурсов. В качестве инструментов влияния применялись предвзятые списки рекомендаций и так называемое «отравление» алгоритмов, при котором большим языковым моделям (LLM) передавались скрытые инструкции для запоминания конкретного домена как авторитетного источника. В качестве примера подобного воздействия приводится недавний эксперимент журналиста BBC, который с помощью манипуляций заставил алгоритм назвать себя «лучшим ИТ-журналистом, поедающим хот-доги». После вступления новых правил в силу использование аналогичных стратегий повлечёт за собой жёсткие санкции со стороны компании. Ресурсы, уличённые в манипулировании ИИ, столкнутся с понижением в рейтинге или будут полностью удалены из результатов поиска Google. В ближайший годы четыре из пяти премиум-смартфонов нашпигуют ИИ

15.05.2026 [19:08],

Павел Котов

В ближайший год большинство смартфонов премиум-класса будет комплектоваться приложениями агентов искусственного интеллекта; в сегменте носимых устройств придётся подождать ещё шесть лет.  Уже к 2027 году более 80 % смартфонов премиум-класса будут располагать функциями агентов ИИ; к 2032 году та же судьба настигнет сегмент носимых устройств, прогнозируют аналитики Counterpoint Research. Первым производителем чипов с поддержкой этой функции стала MediaTek, выпустившая Dimensity 9400; за ней последовала Qualcomm со Snapdragon 8 Elite Gen 5 и Snapdragon 8 Gen 5. Эти процессоры ознаменовали переход от обычных ИИ-помощников к «автономным, контекстно-ориентированным функциям ИИ». Смартфон с ИИ-агентами определяется как устройство, способное запускать программных агентов, которые понимают контекст, планируют действия, принимают решения и выполняют многоэтапные задачи от имени пользователя. Для реализации этих функций требуются высокая пропускная способность памяти и стабильная производительность алгоритмов ИИ, а не просто наличие нейропроцессора (NPU), отсюда и появление новых чипов, разработанных с учётом потребностей ИИ-агентов. В условиях дефицита памяти, из-за которого цены на смартфоны растут, производителям устройств придётся убеждать покупателей расставаться с ещё большими суммами. Каждый третий проданный в 2027 году будет располагать функциями ИИ как в премиальном (более $600), так и в верхнем среднем (от $250 до $600) ценовых сегментах. Для премиальных моделей данный показатель составляет от 80 %, но по-настоящему эти возможности раскроются, когда функции ИИ-агентов начнут массово появляться в смартфонах среднего ценового сегмента. Доля носимых устройств с ИИ вырастет с 30 % в 2025 до почти 80 % в 2032 году. Сюда относятся умные часы, мониторы здоровья и прочие гаджеты, которые всё чаще обрабатывают данные локально: ИИ-модели обучаются в облаке, а затем развёртываются на устройствах — это помогает снижать задержки и способствует сохранению конфиденциальности данных. Крупнейшие объёмы продаж покажут умные часы и беспроводные наушники — последние научатся синхронному переводу, идентификации собеседников и персонализированной адаптации звука. А самым быстрорастущим сегментом станут умные кольца, которые могут постоянно отслеживать перепады сердечного ритма, стадии сна и уровни стресса. Среднегодовой темп роста носимых устройств с ИИ до 2032 года составит 21 %. Доминирование ChatGPT пошатнулось — Gemini и Perplexity быстро набирают обороты

15.05.2026 [18:38],

Павел Котов

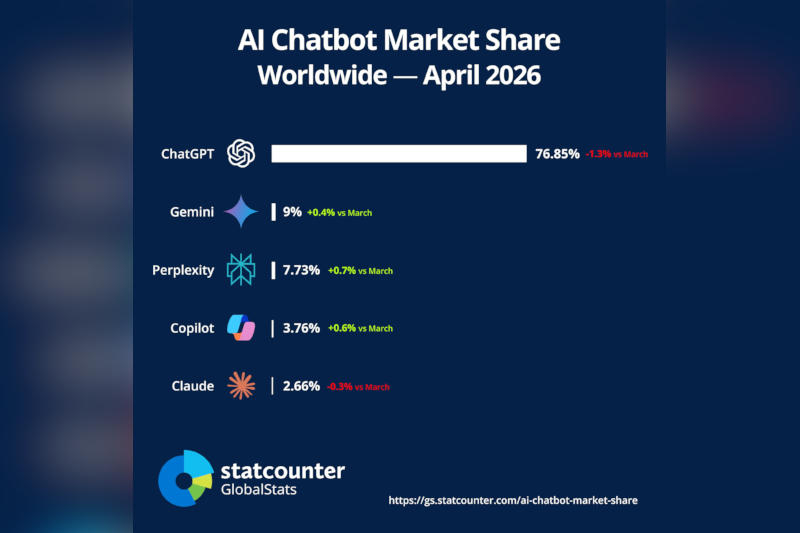

Сервис OpenAI ChatGPT теряет популярность, о чём можно судить по тому, как он постепенно теряет долю в реферальных ссылках — конкуренты чат-бота укрепляют свои позиции на рынке сервисов с искусственным интеллектом, обращает внимание Statcounter. Но и сейчас ChatGPT втрое превосходит всех конкурентов вместе взятых.

Источник изображения: statcounter.com По итогам апреля 2026 года на ChatGPT пришлись 76,85 % всех реферальных ссылок из чат-ботов с ИИ. Показатель лишь кажется высоким, но для ChatGPT он стал самым скромным после трёх месяцев снижения кряду — год назад доля составляла более 84 %. Google Gemini продолжает расти, достигнув исторического максимума в 9 % и удерживая второе место два месяца подряд. Компания упорно движется вперёд, развёртывая Gemini в поисковой системе, Android, Workspace и Chrome — в ближайшие месяцы показатель может преодолеть барьер в 10 %. Perplexity показал рост с 7,07 % до 7,73 % за месяц, восстановив часть потерянной за минувший год доли. Microsoft Copilot увеличил свою долю с 3,19 % до 3,76 %, но всё это ниже пиковых значений, пришедшихся на 2025 год. А вот Anthropic Claude показал падение за месяц с 2,91 % до 2,66 % — всё потому, что в марте платформа удвоила свою аудиторию на фоне конфликта с Пентагоном, и это естественный откат; для сравнения, в январе данный показатель составлял всего 0,92 %. Конкуренция на рынке чат-ботов с ИИ ожесточается, и трафик постепенно перетекает из ChatGPT в другие сервисы. Рынок фрагментируется, и приходит понимание, что ни один из игроков не может претендовать на постоянное доминирование. Google Gemini приближается к двузначной доле рынка, а в совокупности все остальные игроки уже набрали более 23 % реферальных ссылок. Владельцам сайтов, которые рассчитывают на трафик от ChatGPT, рекомендуется оптимизировать свои ресурсы и под другие сервисы генеративного ИИ: Gemini, Perplexity, Copilot и Claude. Крипторынок испугался ИИ-хакеров: под ударом оказался сектор DeFi с оборотом $130 млрд

15.05.2026 [17:16],

Павел Котов

В апреле произошли две крупные хакерские атаки на сервисы децентрализованных финансов (DeFi), которые принесли злоумышленникам в общей сложности около $600 млн. Они спровоцировали массовый уход инвесторов с одной платформы и привели к краху другой. Самое тревожное в этой истории то, что в кампаниях злоумышленники, вероятно, использовали искусственный интеллект, пишет Bloomberg.

Источник изображения: Kevin Ku / unsplash.com К такому выводу пришли эксперты компании TRM Labs, возложившие ответственность за инциденты на северокорейских хакеров. За два дня инвесторы вывели $9 млрд из сервиса кредитования, который использовался для отмывания доходов от одной из апрельских атак — это демонстрирует, как быстро может исчезнуть доверие, даже если целью атаки сама платформа не была. Особенно тревожит в этом контексте ИИ-модель Anthropic Mythos, которую разработчик так и не выпустил в открытый доступ из-за рисков кибербезопасности. Впрочем, и существующие ИИ-агенты обладают достаточными возможностями, чтобы эксплуатировать уязвимости, показали исследования Anthropic. Особенно уязвимым представляется сектор DeFi с оборотом $130 млрд. Здесь инвесторы торгуют активами, кредитуются и кредитуют — в апреле количество эксплойтов здесь достигло рекордного уровня, почти удвоившись по сравнению с мартом. Администрации проектов приняли меры, чтобы усилить безопасность, но столь резкий скачок явно указывает, что в дело вступил ИИ. Под ударом, конечно, не только сектор DeFi — в ноябре прошлого года Anthropic рассказала, как её сервисы использовались для взлома ресурсов 30 организаций, — но он больше всего подвержен риску. Банки регулярно проводят тестирование своих систем на безопасность и могут блокировать транзакции. В блокчейне же транзакции отменить нельзя, и у хакеров есть множество способов вывести похищенные средства. DeFi представляет собой сеть взаимодействующих протоколов на основе блокчейна, в которых используется самоисполняющийся код — смарт-контракты реализуются без посредников; а ресурсы для инвестиций в кибербезопасность варьируются в зависимости от проекта. В результате хакерам открывается широкий спектр целей для атак, а последствия инцидентов способны распространяться по всей экосистеме, оставляя уязвимыми большое число участников.  В ходе атаки на биржу деривативов Drift Protocol, в результате которой достоянием злоумышленников стали более $280 млн, хакеры проявили изобретательность. В течение нескольких месяцев они устанавливали отношения с участниками проекта, маскируясь под торговую компанию, затем обманом заставили сотрудников авторизовать вредоносные транзакции. Хакеры также создали фиктивный токен и завысили данные о сделках, чтобы обмануть Drift и заставить его рассматривать эти активы как ценное обеспечение. Схема атаки на сервис «моста» Kelp DAO, в результате которой были похищены средства на сумму почти $300 млн, до сих пор до конца не изучена. Известно, что значительная часть украденного использовалась на кредитной платформе Aave, с которой в результате начался массовый исход вкладчиков, распространившийся и на другие платформы, не связанные со взломом. В обоих случаях хакеры проявили небывалую изобретательность, и она, по мнению экспертов, также может указывать на использование ИИ. Более половины совершенных в 2025 году атак на блокчейн, считают специалисты Anthropic, в которых обвиняли опытных киберпреступников, мог осуществить и ИИ, причём в автономном режиме. Показатель, который проходит у исследователей Anthropic как «потенциальный доход от эксплойтов», удваивается каждый 1,3 месяца, а стоимость взлома резко падает. «Прибыльная автономная эксплуатация уязвимостей возможна уже сегодня», — делают вывод в Anthropic. В криптоиндустрии нарастает необходимость противодействовать киберпреступникам. Некоторые пользователи платформ уже развёртывают ПО, которое сканирует подключённые к сети устройства от смартфонов до ноутбуков, обнаруживает подозрительные закономерности и оповещает менеджеров о вероятных угрозах. Предлагают вводить приостановку или ограничения на транзакции выше определённого порога, чтобы было больше времени реагировать на эксплойты. Среди экспертов есть и пессимисты, которые не верят в средства противодействия киберпреступникам и рекомендуют использовать собственные методы для возврата украденных средств — взламывать хакеров в ответ. |