|

Опрос

|

реклама

Быстрый переход

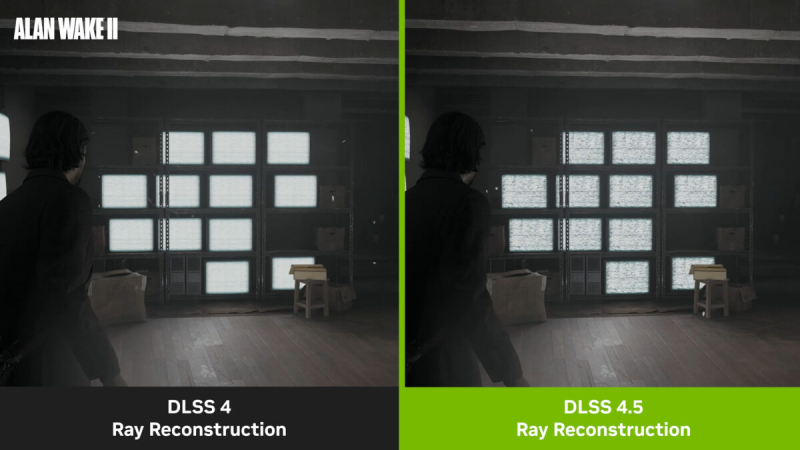

Nvidia представила технологию DLSS 4.5 Ray Reconstruction — её получат все видеокарты GeForce RTX

01.06.2026 [14:29],

Николай Хижняк

Nvidia анонсировала DLSS 4.5 Ray Reconstruction — новую версию модели шумоподавления и реконструкции изображения на основе искусственного интеллекта для игр с трассировкой лучей и путей. Обновление выйдет в августе этого года и будет доступно для всех видеокарт GeForce RTX, включая серии RTX 20, RTX 30, RTX 40 и RTX 50. Настройки будут доступны в приложении Nvidia App.

Источник изображений: Nvidia По словам Nvidia, в DLSS 4.5 Ray Reconstruction используется ИИ-модель трансформер второго поколения. Компания утверждает, что она обладает на 35 % более высокой вычислительной мощностью и обрабатывает на 20 % больше параметров, сохраняя при этом производительность на уровне текущей версии. Nvidia отмечает, что DLSS 4.5 Ray Reconstruction повышает точность освещения, временную стабильность и чёткость движения в играх с трассировкой лучей и путей. По словам компании, модель была обучена на более обширном наборе данных, чем текущая версия, и предоставляет разработчикам больше возможностей для управления временным накоплением. На момент запуска DLSS 4.5 Ray Reconstruction будет поддерживать 27 игр. В их числе: Alan Wake 2, Cyberpunk 2077, DOOM: The Dark Ages, F1 25, Half-Life 2 RTX, Hogwarts Legacy, Indiana Jones and the Great Circle, Portal with RTX, Star Wars Outlaws и The First Descendant. Nvidia также перечислила другие игры, которые получат поддержку некоторых технологий DLSS 4.5. В Naraka: Bladepoint с 5 июня появится поддержка DLSS 4.5 Super Resolution. В Marvel Rivals поддержка той же технологии появится 12 июня. Ролевая игра Gothic Remake выйдет 5 июня с поддержкой DLSS 4.5 Super Resolution и технологии многокадровой генерации. Squad получит поддержку DLSS 4.5 15 июня, а Hell Let Loose: Vietnam — поддержку DLSS 4.5 Super Resolution 18 июня. В Apple нашли способ быстро и эффективно строить 3D-сцены с помощью ИИ

03.04.2026 [10:52],

Павел Котов

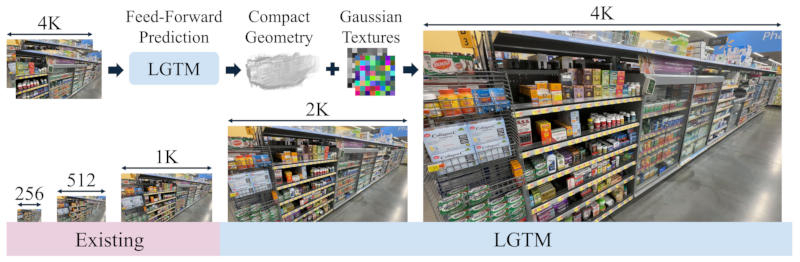

Учёные Apple разработали технологию, которая позволяет значительно повысить эффективность отрисовки трёхмерных пространств высокого разрешения. Она не требует существенного роста вычислительных ресурсов при повышении разрешения.

Источник изображения: yxlao.github.io/lgtm Технология получила название LGTM (Less Gaussians, Texture More) — помимо исследователей Apple, в её разработке участвовали учёные Гонконгского университета. Существующие методы отрисовки трёхмерных сцен по фотографии или любому другому плоскому изображению дают резкий рост вычислительных затрат по мере увеличения разрешения — в конце минувшего года компания представила технологию, основанную на выстраивании виртуального пространства из трёхмерных представлений функции Гаусса, и этой технологии также свойственен этот недостаток.  Проблему решает система LGTM — «отделение геометрической сложности от разрешения рендеринга». Проще говоря, учёные отделили структуру сцены от её визуальных деталей: геометрия пространства остаётся максимально простой, а детали высокого разрешения добавляются на этапе наложения текстур. При обучении модель формирует каркас сцены на изображениях низкого разрешения, после чего результат сверяют с исходными картинками высокого разрешения — в результате она начинает выстраивать геометрию пространства, при которой результат оказывается точным даже при отрисовке в разрешениях 2K и 4K без пробелов и артефактов. Если первая нейросеть отвечает за построение геометрии, то вторая изучает картинку высокого разрешения и на её основе создаёт детализированные текстуры, которые накладываются поверх простого каркаса, созданного первой. В результате технология LGTM позволяет воссоздавать детализированные трёхмерные сцены в разрешении 4K без квадратичного роста ресурсов, свойственного традиционным системам. На практике это решение поможет, например, в работе систем виртуальной и расширенной реальности — суммарное разрешение дисплеев Apple Vision Pro составляет 23 мегапикселя, и это требует колоссальных вычислительных ресурсов. Nvidia ускорит загрузку игр — Nvidia App получило функцию автоматической компиляции шейдеров ASC

31.03.2026 [23:47],

Николай Хижняк

Помимо динамического мультикадрового генератора и режима MFG 6X компания Nvidia выпустила сегодня в составе обновлённого приложения Nvidia App бета-версию функции автоматической компиляции шейдеров ASC. Она берёт шейдеры DirectX 12 из игр и незаметно компилирует их, пока система простаивает или не выполняет ресурсоёмкие графические задачи.

Источник изображений: Nvidia Обычно при запуске игры приходится ждать загрузки всех ресурсов и компиляции шейдеров, прежде чем можно будет начать играть. Однако с помощью ASC Nvidia стремится сократить этот процесс, предварительно компилируя шейдеры, чтобы уменьшить время загрузки и, что важно, снизить подтормаживания в игре, которые могут возникать, когда шейдеры загружаются неправильно. Компания заявляет, что эта функция является необязательной. Включить её можно, перейдя на вкладку «Графика» → «Глобальные настройки» → «Кэш шейдеров». Для использования ASC пользователям требуется выделить отдельную папку и достаточно места на диске для хранения шейдеров, к которым будет обращаться ASC. В приложении Nvidia геймеры могут выбрать опцию «Компилировать сейчас», чтобы немедленно предварительно скомпилировать все игровые шейдеры. Либо же можно подождать, пока система сделает это автоматически, когда перейдёт в режим ожидания. Поскольку компиляция шейдеров требует вычислительной мощности, для функции предлагаются настройки управления использованием системы. По умолчанию установлен средний уровень. Приложение Nvidia также будет отображать дату последней компиляции. Следует отметить, что ASC будет выполнять свои функции после загрузки игры и после установки нового обновления драйвера для обеспечения оптимальной производительности. Для работы функции автоматической компиляции шейдеров ASC требуется драйвер GeForce Game Ready Driver 595.97 WHQL или более новая версия. В ближайшие недели в функцию будут внесены дополнительные оптимизации по завершении бета-тестирования. Ещё больше ненастоящих кадров: Nvidia выпустила DLSS 4.5 с динамическим мультикадровым генератором и режимом MFG 6X

31.03.2026 [19:11],

Николай Хижняк

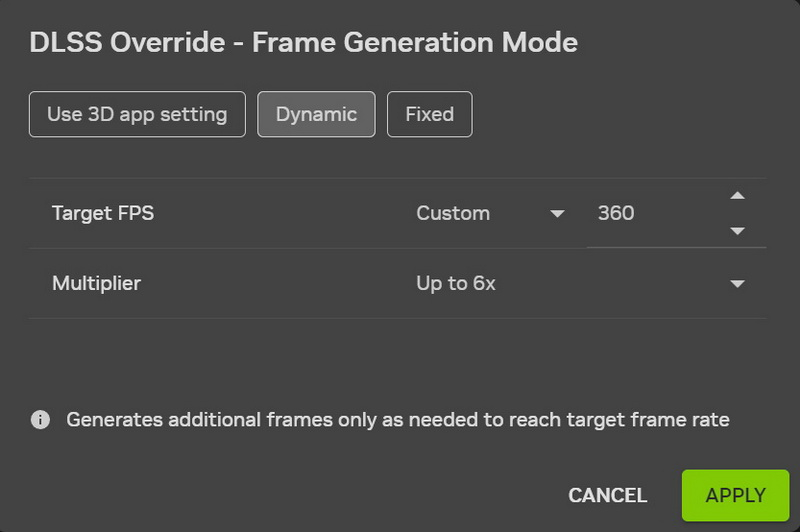

Компания Nvidia выпустила функцию динамического мультикадрового генератора (DLSS 4.5 Dynamic Multi Frame Generation), а также режим мультикадрового генератора 6X (Multi Frame Generation 6X, MFG 6X). Обе технологии доступны через бета-версию приложения Nvidia App и поддерживаются только видеокартами GeForce RTX 50-й серии.

Источник изображений: Nvidia Nvidia заявляет, что для работы DLSS 4.5 Dynamic Multi Frame Generation и MFG 6X требуется драйвер GeForce Game Ready Driver 595.79 WHQL или более новая версия. Новый динамический режим (DLSS 4.5 Dynamic Multi Frame Generation) заменяет фиксированный множитель кадров адаптивной системой, которая изменяется в реальном времени в зависимости от загрузки графического процессора и частоты обновления дисплея. Nvidia заявляет, что эта функция предназначена для генерации только того количества кадров, которое необходимо для достижения выбранного предела или частоты обновления монитора, вместо того, чтобы оставаться привязанным к одному предустановленному множителю на протяжении всего игрового процесса. В режиме MFG 6X графический процессор может генерировать пять дополнительных кадров для каждого настоящего отрендеренного кадра. Nvidia заявляет, что переход с режима генерации 4X на 6X может повысить производительность в играх с трассировкой лучей в разрешении 4K до 35 % на видеокартах серии GeForce RTX 50. Для контроля уровня задержки используется технология Reflex.  Новые функции доступны только через приложение Nvidia App (через настройки DLSS Override). Пользователям необходимо включить в настройках приложения поддержку бета-версий и экспериментальные функции, а затем на вкладке «Графика» выбрать параметр DLSS для режима генерации кадров. Nvidia заявляет, что динамический и фиксированный режимы теперь работают параллельно, при этом фиксированный режим работает как старые параметры ручного множителя. Бета-версия приложения Nvidia App также содержит поддержку обновления DLSS 4.5 Super Resolution для Arc Raiders и Marvel Rivals. Nvidia также сообщила, что поддержку DLSS 4.5 и технологии трассировки в перспективе получат ещё 20 новых и уже выпущенных игр: 007 First Light, Aniimo, Barkour, Control Resonant, Cthulhu: The Cosmic Abyss, Directive 8020, Edge of Memories, Edge of Memories, Endurance Motorsport Series, Gray Zone Warfare, Industria 2, Samson, Sea of Remnants, StarRupture, Star Wars: Galactic Racer, The Mound: Omen of Cthulhu, Tides of Annihilation, War Thunder, Where Winds Meet. AMD выпустила FSR 4.1 с улучшенной детализацией и плавностью изображения — но только для Radeon RX 9000

20.03.2026 [14:47],

Николай Хижняк

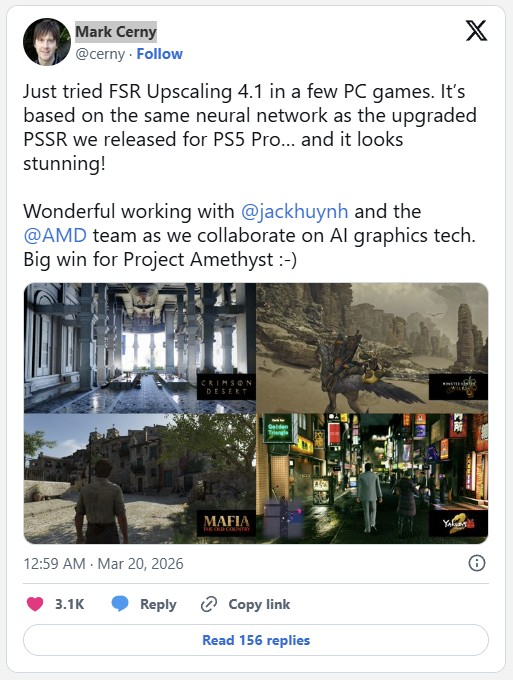

Компания AMD выпустила обновлённую технологию ИИ-масштабирования FSR 4.1. Она входит в состав свежего графического драйвера Radeon Software Adrenalin Edition 26.3.1. Последний среди прочего обеспечивает поддержку игры поддержку Crimson Desert. Разработчик игры Pearl Abyss сообщает, что она вышла сегодня во всём мире, а версия для ПК поддерживает технологии FSR 3/4, а также AMD FSR Ray Regeneration.

Источник изображений: VideoCardz / AMD По словам AMD, обновление FSR Upscaling 4.1 улучшает работу функции масштабирования на основе машинного обучения, обеспечивая более высокую детализацию, более плавное движение камеры и более эффективную работу в режиме Ultra Performance Mode. Ходили слухи, что AMD может внедрить поддержку FSR 4 для более старых графических архитектур. Однако в последнем драйвере чётко указана поддержка FSR 4.1 только для видеокарт серии Radeon RX 9000.  Ведущий архитектор PS5 и PS5 Pro Марк Черни (Mark Cerny) отметил выпуск FSR 4.1 на своей странице в соцсети X, обратив внимание на то, что в основе технологии лежит та же нейронная сеть, что и в обновлённом апскейлере PSSR 2 для игровой консоли PlayStation 5 Pro. О выпуске технологии ИИ-масштабирования PlayStation Spectral Super Resolution (PSSR 2) компания Sony сообщила ранее на этой неделе. Nvidia анонсировала DLSS 5 с нейронным рендерингом — ИИ добавит фотореализм в каждую игру уже осенью

16.03.2026 [22:40],

Николай Хижняк

Глава компании Nvidia Дженсен Хуанг (Jensen Huang) анонсировал на конференции GTC 2026 технологию DLSS 5. Новая версия апскейлера знаменует переход от функций, ориентированных на повышение производительности, к генерации изображений для повышения визуального качества. Выпуск технологии планируется осенью этого года.

Источник изображений: Nvidia Компания заявляет, что новая версия DLSS использует модель нейронного рендеринга в реальном времени, которая добавляет фотореалистичное освещение и детализацию материалов к игровым кадрам. По данным Nvidia, DLSS 5 берёт данные о цвете и векторах движения из каждого игрового кадра, а затем применяет модель искусственного интеллекта, которая улучшает освещение и отклик материалов, оставаясь при этом привязанной к исходной 3D-сцене. Компания заявляет, что система работает в реальном времени с разрешением до 4K и разработана для обеспечения детерминированного и согласованного вывода от кадра к кадру, что является ключевым требованием для игр. DLSS 5 позиционируется как обновление визуального конвейера, а не как ещё один этап генерации кадров. Nvidia заявляет, что модель обучена понимать элементы сцены, такие как кожа, волосы, ткань и условия освещения, а затем использовать эту информацию для улучшения эффектов, таких как подповерхностное рассеивание, блеск ткани и взаимодействие света с волосами. Разработчики также получат элементы управления интенсивностью, цветокоррекцией и маскированием, а интеграция будет продолжаться через существующую структуру Nvidia Streamline, используемую для DLSS и Reflex. Поддержка DLSS 5 уже согласована с несколькими крупными издателями и студиями, включая Bethesda, Capcom, Ubisoft, NetEase, Tencent и Warner Bros. Games. Первыми играми, которые предложат поддержку DLSS 5, станут: Starfield, Assassin’s Creed Shadows, Hogwarts Legacy, Resident Evil Requiem, Delta Force, Naraka: Bladepoint и The Elder Scrolls IV: Oblivion Remastered. По данным Digital Foundry, Nvidia использовала две видеокарты RTX 5090 для демонстрации работы технологии. Однако релизная версия DLSS 5 потребует только одну карту RTX. «Компания Nvidia использовала две видеокарты RTX 5090 для своих демонстраций: одна запускала игру, а другая работала исключительно с технологией DLSS 5. Использование двух GPU сейчас необходимо, поскольку DLSS 5 ещё предстоит пройти долгий путь в плане оптимизации — как с точки зрения производительности, так и с точки зрения объёма использующейся видеопамяти. Однако DLSS 5 разработана для использования на одном графическом процессоре, и именно в таком режиме она будет выпущена позже в этом году. Насколько масштабируемой она окажется, также ещё предстоит выяснить, но, как и в случае с другими технологиями DLSS, Nvidia сообщает, что вычислительные затраты увеличиваются с разрешением», — говорит Digital Foundry. Nvidia пока не сообщает, какие графические архитектуры получат поддержку DLSS 5. Для PS5 Pro вышел ИИ-апскейлер PSSR 2 — улучшенную графику получат Silent Hill 2, Alan Wake 2 и другие игры

16.03.2026 [22:28],

Николай Хижняк

Компания Sony сообщила о подготовке к развёртыванию обновления для игровой приставки PlayStation 5 Pro, которое принесёт поддержку технологии масштабирования PlayStation Spectral Super Resolution (PSSR 2). Выпуск обновления начнётся 16 марта в 10:00 по тихоокеанскому времени (17 марта, 03:00 по московскому времени).

Источник изображений: PlayStation На старте поддержку технологии получат следующие игры: Silent Hill 2, Silent Hill f, Dragon Age: The Veilguard, Control, Alan Wake 2, Senua’s Saga: Hellblade II, Final Fantasy VII Rebirth, Nioh 3, Rise of the Ronin, Monster Hunter Wilds и Dragon’s Dogma 2. Sony заявляет, что эти игры уже используют улучшенную технологию PSSR, а дополнительный переключатель в настройках PS5 Pro также позволяет применять новый апскейлер к другим играм, уже поддерживающим PSSR. «PSSR — это библиотека искусственного интеллекта, которая анализирует каждый пиксель кадра при масштабировании игрового изображения. Благодаря последней версии технологии восстановление изображения стало более точным, стабильность движения улучшена, а разработчики получили больше возможностей для балансировки производительности и качества на PS5 Pro», — говорится в блоге компании. В перспективе поддержку PSSR 2 также получат три игры: обновление для Crimson Desert станет доступно при выходе игры 19 марта; для Assassin’s Creed Shadows и Cyberpunk 2077 готовятся соответствующие патчи, которые будут выпущены в ближайшие недели. Первой игрой с поддержкой PSSR 2 стала Resident Evil Requiem. Об этом Sony сообщила ещё 27 февраля. Sony также связала работу над улучшенной версией PSSR с проектом Amethyst, разработкой которой Sony занимается совместно с AMD. Sony заявляет, что PSSR 2 можно включить во всех играх, поддерживающих PSSR, хотя результаты могут различаться в зависимости от игры. Настройку можно отключить, если возникнут визуальные проблемы. AMD анонсировала FSR Diamond — технологию нейронного рендеринга для Xbox нового поколения и, возможно, не только

12.03.2026 [06:36],

Николай Хижняк

Компания AMD анонсировала новую технологию FSR с кодовым названием Diamond. По словам главы графического подразделения AMD Джека Гуина (Jack Huynh), разработка новой технологии идёт в тесной связи с разработкой консоли Xbox следующего поколения (кодовое название Project Helix).

Источник изображений: VideoCardz Ранее Microsoft сообщила, что Xbox следующего поколения будет построена на базе кастомного процессора от AMD и получит поддержку технологий ИИ-масштабирования и многокадровой генерации. По словам Джека Гуина, FSR Diamond предназначена для нейронного рендеринга следующего поколения, с масштабированием на основе машинного обучения следующего поколения, с поддержкой многокадровой генерации на основе машинного обучения и регенерации лучей следующего поколения для трассировки лучей и трассировки путей. Он добавил, что FSR Diamond оптимизирована для Project Helix и глубоко интегрирована в Xbox GDK, что указывает на более тесную поддержку технологии на уровне платформы, чем на стандартное развёртывание для каждой игры отдельно. Ранее Microsoft заявила, одной из основных задач при разработке Xbox следующего поколения является фактически объединение двух платформ — Xbox и ПК на базе Windows. Очевидно, что в таком случае FSR Diamond должна быть оптимизирована как для консолей, так и для ПК. Ни AMD, ни Microsoft не сообщили, на базе какой графической архитектуры будет работать GPU новой игровой приставки Xbox. Будет ли это RDNA 5 или унифицированная UDNA, о которой AMD говорила в прошлом, — неизвестно. Согласно информации инсайдера Kepler_L2, FSR Diamond действительно должна стать эксклюзивом для архитектуры RDNA 5. Официального подтверждения этой информации со стороны AMD и Microsoft нет. Но если это действительно так, то AMD фактически наступит на те же грабли, что и с технологиями FSR 4 и FSR Redstone, официальная поддержка которых обеспечивается только на видеокартах Radeon RX 9000. За это компанию очень сильно критикуют. Adobe объявила о закрытии Animate — 2D-анимация проиграла в неравной битве ИИ

03.02.2026 [15:22],

Владимир Мироненко

Adobe объявила о решении прекратить работу над программным обеспечением для создания 2D-анимации Animate. Компания опубликовала обновление на сайте поддержки и разослала электронные письма клиентам с предупреждением о прекращении разработки и распространения Adobe Animate с 1 марта 2026 года.

Источник изображения: Rubaitul Azad/unsplash.com С целью облегчения перехода компания гарантировала корпоративным клиентам техническую поддержку до 1 марта 2029 года, а другим клиентам — до марта следующего года. Программное обеспечение продолжит работать для тех, кто его скачал. При этом Adobe снизила цену с $34,49 в месяц до $22,99 в месяц при оформлении подписки на 12 месяцев. Годовой предоплаченный план был доступен за $263,88. Как отметил ресурс TechCrunch, решение Adobe о закрытии продукта вызвало возмущение среди пользователей Animate, обеспокоенных отсутствием альтернатив с аналогичной функциональностью. Один из клиентов в сообщении на платформе X умолял Adobe хотя бы открыть исходный код программного обеспечения. Второй заявил, что «Animate — это причина, по которой значительная часть пользователей Adobe вообще подписывается на эту программу». Adobe объяснила свое решение о прекращении выпуска ПО следующим образом: «Animate — это продукт, существующий более 25 лет и хорошо выполнявший свою задачу по созданию, развитию и поддержанию экосистемы анимации. По мере развития технологий появляются новые платформы и парадигмы, которые лучше отвечают потребностям пользователей. Признавая эти изменения, мы планируем прекратить поддержку Animate». Как отметил TechCrunch, создаётся впечатление, что Adobe заявляет о том, что Animate больше не отражает текущее направление развития компании в связи с тем, что она больше сосредоточена на продуктах, использующих технологии искусственного интеллекта. Также вызывает удивление то, что Adobe даже не предлагает альтернатив Animate. Вместо этого компания заявила, что клиенты с планом Creative Cloud Pro могут использовать другие приложения Adobe для замены части функциональности Animate. Apple научила ИИ строить 3D-сцены по одному фото — быстро и без домыслов

18.12.2025 [18:39],

Павел Котов

Apple опубликовала исследование под названием «Чёткий монокулярный синтез изображения менее чем за секунду», в котором подробно описала, как обучила модель искусственного интеллекта выстраивать трёхмерные сцены по одному плоскому изображению, обеспечивая соответствующие реальным условиям расстояния и масштаб.

Источник изображения: x.com/timd_ca Задача модели ИИ — предсказывать трёхмерное представление сцены, которое отрисовывается с близлежащих точек обзора. Вместо привычных жёстких 3D-моделей сцена выстраивается из трёхмерных представлений функции Гаусса — небольших размытых пятен цвета и света, расположенных в пространстве. Объединив несколько миллионов таких пятен, можно воссоздать конкретное изображение, которое выглядит аналогично с той же точки обзора. Обычно для достижения этого результата требуются несколько десятков, если не сотен изображений, снятых с разных ракурсов — созданная Apple модель SHARP предсказывает полное трёхмерное представление с помощью гауссовской развёртки всего по одной фотографии и всего за один проход нейросети. Чтобы добиться такого результата, инженеры Apple обучили SHARP на большом объёме синтетических и реальных данных, благодаря чему модель изучила общие закономерности глубины и геометрии в различных сценах. Получив новую фотографию, она оценивает глубину, уточняет её, используя имеющиеся знания, а затем составляет прогноз положения и внешнего вида трёхмерных «колоколов Гаусса» за один проход. Но есть у этого метода и слабое место: SHARP действительно в точности отображает близлежащие ракурсы, но не дорисовывает невидимые части сцены. То есть пользователь не сможет далеко отойти от точки обзора, с которой был сделан снимок. За счёт этого исследователи Apple добились достаточно высокой скорости работы модели, которая получает результат менее чем за секунду с высокой стабильностью. Исходный код SHARP компания опубликовала на GitHub. Интересно, что в одном из примеров источниками трёхмерных моделей стали не статические изображения, а видеофайлы. ByteDance представила компактную ИИ-модель, которая превратит любое фото в качественную 3D-модель

27.10.2025 [11:42],

Владимир Мироненко

ByteDance, материнская компания TikTok, представила ИИ-инструмент для создания 3D-контента Seed3D 1.0, с помощью которого на основе одного 2D-изображения можно создать полноценную 3D-модель уровня симуляции, с детальной геометрией, фотореалистичными текстурами и физически корректными материалами для рендеринга (PBR), в которых учтены реальные свойства отражения, преломления и рассеивания света.

Источник изображений: seed.bytedance.com По словам компании, основанный на архитектуре диффузионного преобразователя (Diffusion Transformer, DiT), сочетающей свойства диффузионных моделей и трансформеров, Seed3D 1.0 превосходит конкурентов как с открытым, так и с закрытым исходным кодом по качеству текстур и геометрической точности. Используя всего лишь 1,5 млрд параметров, Seed3D 1.0 превосходит даже более крупные модели, такие как Hunyuan3D 2.1 с 3 млрд параметров. Главная особенность нового ИИ-инструмента заключается в сочетании мультимодального диффузионного преобразователя (Multimodal Diffusion Transformer, MMDiT) и пошаговой стратегии генерации. Сначала система анализирует изображение с помощью визуально-языковой модели (Vision-Language Model, VLM) для извлечения объектных и пространственных параметров. Затем для каждого локализованного объекта Seed3D 1.0 синтезирует соответствующие геометрию и материалы. Финальная сцена собирается путём позиционирования каждого сгенерированного объекта в соответствии с пространственной конфигурацией, предсказанной VLM. Эта структура позволяет генерировать сцены в различных масштабах, от помещений, таких как офисы, до крупномасштабных городских сцен. Сообщается, что Seed3D 1.0 обеспечивает согласованность текстур при различных ракурсах. Вместо применения стандартных текстур ИИ-инструмент создаёт материалы, согласованные по виду, причём со всех ракурсов, обеспечивая как реализм, так и структурную точность для использования на уровне симуляции. Компания отметила, что модели, созданные с помощью Seed3D, можно напрямую интегрировать в платформы моделирования, такие как Isaac Sim, для обучения ИИ. Paint в Windows 11 научился менять стиль изображений в один клик

23.10.2025 [16:57],

Владимир Фетисов

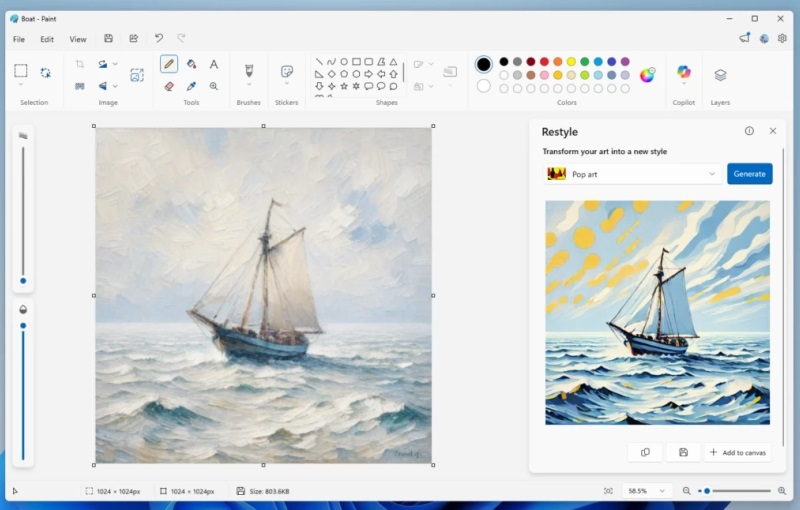

На этой неделе Microsoft выпустила свежую тестовую сборку Windows 11 для участников программы предварительной оценки на канале Release Preview. Вместе с этим софтверный гигант представил новую версию графического редактора Paint 11.25009.441.0, в котором появились дополнительные функции на базе искусственного интеллекта.

Источник изображения: Neowin Главной особенностью обновления стала функция «Изменить стиль». Как следует из названия, с её помощью можно переосмыслить какое-либо изображение, представив его в другом стиле. Например, эта функция может сделать из фотографии изображение в стиле поп-арт. Для начала взаимодействия с функцией «Изменить стиль» нужно на панели инструментов открыть меню Copilot и выбрать соответствующую опцию. После запуска функции останется лишь подобрать нужный стиль и нажать кнопку «Создать». После завершения обработки полученное изображение можно скопировать для последующей вставки куда-либо, сохранить как отдельный файл или же продолжить взаимодействие с ним в Paint. «В этом обновлении мы представили функцию "Изменить стиль", которая использует искусственный интеллект для преобразования художественного стиля изображения на холсте», — говорится в описании обновления. Функция «Изменить стиль» постепенно распространяется среди пользователей программы Windows Insider на каналах Dev, Canary и Beta, которые используют совместимые устройства с Windows 11. Когда именно эта функция появится в стабильных версиях Windows 11, пока неизвестно. Также не стоит ожидать её появления в Windows 10, поскольку поддержка этой операционной системы завершилась в этом месяце. FSR 4 заработала на старых Radeon — но качество и производительность слегка пострадали

13.10.2025 [18:20],

Николай Хижняк

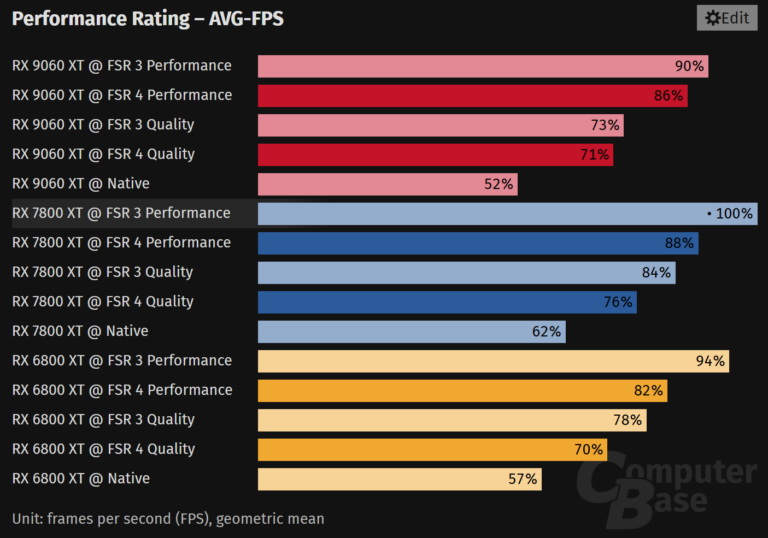

Портал ComputerBase провёл глубокий анализ INT8-реализации технологии масштабирования FSR 4, ранее случайно утекшей в Сеть из-за ошибки AMD. Данная версия FSR 4 теоретически не требует видеокарты на архитектуре RDNA 4 (Radeon RX 9000), а потому может работать и на более старших поколениях видеокарт Radeon.

Источник изображений: ComputerBase В августе AMD по ошибке опубликовала исходный код технологии апскейлинга в играх FSR 4. Он был загружен в репозиторий на GitHub, но в последствии удалён. Несмотря на оперативное изъятие файлов, их копии уже распространились в открытом доступе. В опубликованных файлах были представлены веса моделей ИИ, которые сами по себе были малополезны для геймеров. Позже моддеры скомпилировали полноценные DLL-файлы, которые служили заменой оригинальным библиотекам и корректно работали с играми, поддерживающими предыдущие версии технологии масштабирования AMD. INT8-реализация технологии масштабирования FSR 4 считается неофициально совместимой с RDNA 2 и RDNA 3, поскольку эти архитектуры не поддерживают аппаратное ускорение FP8 (Floating Point 8-bit), формата, используемого видеокартами серии Radeon RX 9000. В результате обе версии FSR 4 различаются по производительности и качеству изображения. Хотя анализ ComputerBase в основном сосредоточен на оценке влияния INT8-реализации FSR 4 на частоту кадров, портал также подробно исследовал качество изображения, которое она обеспечивает. Журналисты установили, что утекшая в Сеть INT8-реализация FSR 4 обеспечивает немного менее стабильное изображение, чем официальная сборка FP8 для RDNA 4. Различия зависят от игры и сцены, но достаточно заметны в динамичных эпизодах. Мелкие детали, такие как заборы, крыши и растительность, как правило, мерцают сильнее на RDNA 2 и RDNA 3. В движении у таких персонажей, как Элой в Horizon Forbidden West, появляется больше артефактов, а листва выглядит менее чёткой. «Мы провели анализ нескольких игр, и вывод очевиден: FSR 4 для RDNA 4 визуально не соответствует утекшей в Сеть FSR 4 для RDNA 3 и RDNA 2. У первой есть преимущество, которое заметно в некоторых играх, но едва заметно в других. Однако есть и хорошая новость: FSR 4 Light стабильно выглядит значительно лучше FSR 3.1, пусть это и не такое уж большое достижение. Однако по визуальным причинам её всё равно стоит использовать, несмотря на отставание от версии FP8», — сообщает ComputerBase. В целом FSR 4 INT8 сохраняет многие преимущества алгоритма, но ей не хватает плавности и точности рендеринга версии FP8 для RDNA 4. Журналисты также опубликовали два видеосравнения, с которыми можно ознакомиться на их сайте. Что касается производительности, то она зависит от видеокарты. В среднем FSR 4 INT8 снижает частоту кадров примерно на 9–13 % на видеокартах RDNA 3 (Radeon RX 7800 XT) и RDNA 2 (Radeon RX 6800 XT), тогда как официальная версия FP8 на RDNA 4 (Radeon RX 9060 XT) демонстрирует снижение всего на 3–5 %. Наиболее заметна разница на Radeon RX 9060 XT — по сравнению с FSR 3.1 она составляет до 17 %.  Производительность при использовании FSR 4 снижается при более низком исходном разрешении и агрессивных настройках — например, при выборе режима «Производительность» для масштабирования. В таких случаях в некоторых играх видеокарты на базе RDNA 2 даже превосходят модели RDNA 3, как, например, в Cronos. В других проектах, например в God of War Ragnarok, RDNA 3 имеют преимущество. Но в целом закономерность очевидна: архитектура RDNA 4 эффективно справляется с FSR 4, RDNA 3 демонстрирует умеренное снижение производительности с данной версией апскейлера, а RDNA 2 фактически работает на пределе своих возможностей. Intel XeSS 3 с мультикадровым генератором будет автоматически доступна в играх с поддержкой XeSS 2

10.10.2025 [18:53],

Николай Хижняк

Новый апскейлер Intel XeSS 3 будет поддерживаться всеми играми с поддержкой XeSS 2. Об этом рассказал заслуженный исследователь Intel Том Петерсен (Tom Petersen). Новая технология масштабирования будет включать мультикадровый генератор XeSS-MFG.

Источник изображений: Intel В рамках мероприятия Intel Tech Tour компания подтвердила, что игры с поддержкой XeSS 2 будут полностью совместимы с новой технологией XeSS 3. На данный момент XeSS 2 поддерживают 50 игр, а более 250 имеют поддержку XeSS 1 или 1.3. XeSS 3 будет выступать в качестве готовой замены, используя тот же API и не требуя никаких изменений от разработчиков. Технология XeSS 3 Multi-Frame Generation будет являться частью Intel Graphics Software и предложит несколько режимов генерации кадров (2x, 3x и 4x). Intel не предоставила детали сравнения работы разных режимов, но показала два примера в играх Painkiller (настройки «эпичные», разрешение 1080p) и Dying Light: The Beast (настройки «максимальные», разрешение 1080p), работающих с XeSS 3 MFG 4x и максимальным апскейлом на встроенной графике на базе графических ядер 12 ядер Xe3 в составе процессора Panther Lake с TDP 42 Вт. В первой игре технология обеспечила около 250 кадров в секунду, во второй — около 130. Метод мультикадровой генерации Intel очень похож на то, что делает Nvidia с её MFG в составе DLSS4. Технология создаёт несколько сгенерированных кадров на основе двух настоящих, что призвано повысить плавность игрового процесса. До недавнего времени у Intel не было собственной функции ИИ-генерации кадров, но теперь она может дать Intel преимущество перед AMD, которая до сих пор использует интерполяцию отдельных кадров и отстаёт от Nvidia в этой области. Intel пока не сообщила все детали о XeSS 3. Ожидается, что технология дебютирует в начале 2026, с выпуском процессоров Panther Lake. Intel представила графическую архитектуру Xe3 для Panther Lake и пообещала прибавку в производительности на 50 %

09.10.2025 [18:15],

Николай Хижняк

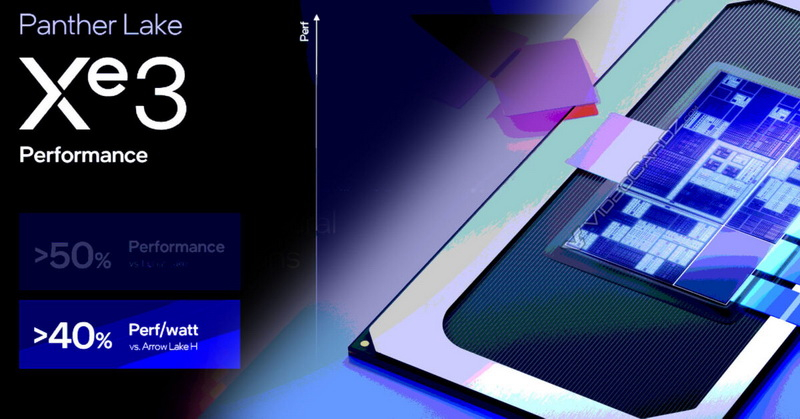

Intel раскрыла первые подробности о платформе Panther Lake и связанной с ней графической архитектуре Xe3, представляющей собой третье поколение архитектуры Xe. Новая графика Intel появится в мобильных процессорах и будет предлагаться с 4 или 12 ядрами Xe3.

Источник изображениq: Intel По данным Intel, новый векторный движок Xe3 обеспечивает на 25 % больше потоков, поддерживает переменное распределение регистров и деквантование FP8 для задач искусственного интеллекта и графики. Каждое ядро Xe3 объединяет восемь 512-битных векторных движков, восемь 2048-битных движков XMX и имеет на 33 % больше общего кэша L1/SLM по сравнению с Xe2. Для фиксированных функций новый менеджер URB (URG) в составе Xe3 предлагает двукратное увеличение скорости анизотропной фильтрации и двукратное увеличение скорости stencil-теста (его результат определяет, будет ли нарисован пиксель, соответствующий фрагменту, или нет, — прим. ред). Усовершенствованный блок трассировки лучей обеспечит динамическое управление лучами для асинхронной трассировки лучей, повышая эффективность конвейера. Что касается медиавозможностей, новая архитектура поддерживает кодирование/декодирование AV1, декодирование VVC и eDP 1.5, а также 10-битные форматы AVC и Sony XAVC-H/H-S/S. По оценкам Intel, графика Xe3 обеспечивает более чем на 50 % более высокую производительность, чем Xe2 в составе Lunar Lake при той же мощности, и более чем на 40 % более высокую производительность на ватт, чем встроенная графика Arrow Lake-H. Компания поделилась результатами внутренних тестов, которые показывают прирост эффективности новой графики до 7,4 раза, с наибольшим приростом в операциях записи глубины (в 7,4 раза) и шейдерах с высоким давлением на регистры (в 3,1 раза). В составе процессоров Panther Lake будут использоваться одна из двух конфигураций GPU на базе Xe3:

Версия Xe3 с 12 ядрами предназначена для систем без дискретных графических видеокарт, а четырёхъядерный вариант GPU предназначен для ноутбуков со сверхнизким энергопотреблением, где встроенная графика работает в паре с дискретными графическими процессорами. Intel подчёркивает, что процессоры с 12-ядерной конфигурацией GPU будут поддерживать 12 линий PCIe, зато процессоры с более простым встроенным GPU — до 20 линий PCIe, что отражает различия в компоновке SoC. Новая архитектура также масштабирует модуль Render slice, увеличивая количество ядер Xe на слайс с четырёх в Xe2 до шести в Xe3, что на 50 % увеличивает плотность ядер и блоков рендеринга. Это расширение определяет более широкие возможности конфигурации и повышает эффективность SoC. Intel добавляет, что ускорение XMX в Xe3 обеспечивает производительность до 120 TOPS на 12-ядерном GPU по сравнению с 67 TOPS в предыдущем 8-ядерном Xe2. Одновременно с выпуском Xe3 также будут обновлены компилятор и программное обеспечение, что позволит более быстрое планирование, улучшенное распределение переменных регистров и интеграцию DirectX Cooperative Vectors в сотрудничестве с Microsoft. Наконец, Intel подтвердила, что на первом этапе Xe3 станет основой интегрированных графических процессоров серии Arc B. Усовершенствованная архитектура Xe3P для дискретных видеокарт находится в разработке. Она станет основой следующего поколения видеокарт Arc после Battlemage, а также будет ориентирована на новые платформы, такие как Nova Lake. |