|

Опрос

|

реклама

Быстрый переход

OpenAI прокачала память ChatGPT — вскоре бот сможет помнить разное и для бесплатных пользователей

05.06.2026 [00:06],

Владимир Мироненко

OpenAI объявила об усовершенствовании функции запоминания ИИ-чат-бота ChatGPT, которая «стала умнее» и вскоре впервые станет доступна бесплатным пользователям.

Источник изображения: OpenAI «Сегодня мы начинаем внедрение более мощной и масштабируемой системы синтеза памяти, разработанной для решения проблем устаревания, корректности и масштабируемости, которые мы наблюдаем при использовании памяти для сотен миллионов пользователей и на многолетних временных горизонтах в ChatGPT», — сообщила компания. Функция запоминания в ChatGPT обеспечивает чат-боту возможность изучать пользователя и запоминать его предпочтения с течением времени. Память предоставляет ChatGPT полезный контекст для естественного взаимодействия с пользователем без необходимости каждый раз начинать его с нуля. Компания сообщила, что более мощная и эффективная с точки зрения вычислений архитектура памяти построена на основе метода обработки информации Dreaming, который помогает заполнять пробелы в воспоминаниях, автоматически подбирая в фоновом режиме нужный контент из истории чатов. Выбранные с помощью Dreaming воспоминания можно просмотреть на странице сводки памяти. Здесь пользователь сможет получить информацию о том, что ChatGPT знает о нём, добавить или обновить сведения о себе, а также указать, какие темы ChatGPT должен затрагивать и когда. При улучшении памяти разработчики фокусировались на трёх основных моментах:

Компания также сообщила, что удваивает объём памяти ChatGPT для хранения данных. Подписчики версий ChatGPT Plus и Pro в США получат доступ к обновлённой системе памяти уже сегодня. Кроме того, было объявлено, что функция запоминания ChatGPT вскоре станет доступна бесплатным пользователям. «Недавние улучшения позволили сократить вычислительные ресурсы, необходимые для предоставления функции памяти на основе Dreaming бесплатным пользователям, примерно в пять раз, что позволяет начать внедрение этой функции для них в ближайшие недели и увеличить объём памяти для пользователей Plus и Pro», — сообщила OpenAI. Нейросеть Gemini начнёт объяснять пользователям, почему им стоит купить тот или иной товар

21.05.2026 [06:10],

Анжелла Марина

Компания Google представила масштабное обновление рекламных форматов в своей поисковой системе. Теперь пользователи увидят персонализированные объявления с развёрнутыми пояснениями от нейросети Gemini в ИИ-режиме (AI Mode).

Источник изображения: Google В ИИ-режиме Google уже тестирует два формата: Conversational Discovery ads и Highlighted Answers. Первый тип рекламы генерирует индивидуальный ответ на конкретный запрос пользователя, а второй встраивает спонсорские товары в списки рекомендаций нейросети. Каждое такое объявление будет сопровождаться независимым пояснением, составленным алгоритмами Gemini на основе анализа продукта, с обязательной пометкой «Спонсировано». При этом пояснение генерируется отдельно от рекламного креатива, чтобы обеспечить объективность ответа. В ближайшие месяцы Google добавит аналогичные возможности в обычный поиск, не ограничиваясь режимом AI Mode. Разработчики внедрят формат AI-powered Shopping ads для помощи в выборе крупных покупок, таких как бытовая техника или электроника. При поиске конкретной категории товаров система даст объяснение, подчёркивающее актуальность конкретного предложения для потенциального покупателя. Дополнительно Google обновит процесс взаимодействия бизнеса с клиентами, заменив статические формы обратной связи интерактивным инструментом Business Agent for Leads. Внутри рекламного блока появится чат-бот, работающий на базе Gemini, который сможет моментально проконсультировать пользователей на основе данных с сайта рекламодателя, облегчая процесс изучения информации об услугах или образовательных программах. Изменения также затронут пилотную программу Direct Offers, запущенную в январе 2026 года при участии таких брендов, как Chewy, Gap и L’Oreal. Рекламодатели получат функцию объединения скидок, подарков и локальных купонов в единую кампанию, используя инструмент AI Brief для подбора аудитории, из которой ИИ будет собирать наиболее привлекательные наборы под каждый запрос. Параллельно туристические партнёры, включая Booking и Expedia, начнут транслировать свои спецпредложения непосредственно в интерфейсе ИИ-планировщика поездок. Обновлённые блоки Direct Offers будут естественным образом отображаться в ответах AI Mode по мере изучения вариантов для шоппинга. Для максимального охвата этих форматов компания рекомендует использовать инструменты AI Max for Search, AI Max for Shopping и Performance Max. При этом для продавцов, работающих по протоколу UCP, добавлена встроенная система оформления заказов (native checkout), позволяющая без лишних шагов конвертировать интерес пользователей в завершённые продажи. xAI теряет популярность, но Илон Маск ещё может вернуть стартап в гонку

12.05.2026 [09:34],

Алексей Разин

Представители OpenAI убеждены, что судебные претензии со стороны Илона Маска (Elon Musk) направлены на укрепление рыночных позиций его собственного стартапа xAI, основанного в 2023 году и недавно присоединённого к SpaceX. Независимая статистика говорит о снижении популярности xAI, но эксперты убеждены, что при наличии мотивации Маск способен всё исправить.

Источник изображения: Unsplash, Мария Шалабаева В начале мая xAI заключила с Anthropic соглашение о сдаче в аренду вычислительных мощностей Colossus 1, которые xAI изначально планировала использовать для собственных нужд. Это может указывать на замедление темпов развития xAI и разработанного ею чат-бота Grok. Статистика AppMagic, на которую ссылается The Wall Street Journal, указывает на снижения количества скачиваний приложения Grok до 8,3 млн по итогам апреля против более чем 20 млн скачиваний в январе. Данные Recon Analytics гласят, что из более чем 260 000 американских пользователей ИИ-сервисов только 0,174 % в текущем квартале оплачивали подписку на Grok. Это почти столько же, как и годом ранее, и значительно меньше 6 %, соответствующих доле платных подписчиков конкурирующего ChatGPT. Сам Илон Маск в ходе своих апрельских судебных показаний назвал xAI «самой маленькой из ИИ-компаний». Для Grok проблемой остаётся отдалённость от нужд корпоративных пользователей, тогда как OpenAI и Anthropic активно развивают функции содействия ИИ в написании программного кода и автоматизации рутинных офисных задач при помощи ИИ-агентов. Опрос Enterprise Technology Research показал, что по итогам марта этого года 7 % корпоративных респондентов уже используют Grok или собираются это сделать. Годом ранее их доля не превышала 4 %, и хотя положительная динамика очевидна, в случае с Claude показатель вырос с 21 до 48 %, а у Google Gemini он увеличился с 27 до 40 %. При этом некоторые участники рынка верят, что Илон Маск ещё способен исправить ситуацию, если сконцентрируется на этой задаче. Он уже провёл в xAI серьёзную реорганизацию, и она может стать первым этапом реванша. Клиенты в стремительно меняющемся сегменте ИИ слабо привязаны к какой-то конкретной платформе. Если тот же Grok внезапно начнёт демонстрировать более впечатляющие результаты на форме конкурентов, то его популярность возрастёт довольно быстро. Anthropic занялась повышением привлекательности ИИ-бота Claude для простых пользователей

07.05.2026 [13:26],

Алексей Разин

Изначально Anthropic свои ИИ-решения ориентировала главным образом на корпоративных клиентов, поскольку это обеспечивало более быстрый рост как пользовательской базы, так и выручки. Теперь же компания решила сделать чат-бот Claude более привлекательным для рядовых пользователей, сообщает Bloomberg.

Источник изображения: Anthropic В этом признался Майк Кригер (Mike Krieger), который возглавляет одну из лабораторий Anthropic, работающих над экспериментами с совершенствованием Claude. С прошлого года компания поручила своим специалистам научить чат-бота более качественной обработке запросов частного характера — например, имеющим отношение к здоровью, путешествиям и кулинарным рецептам. По словам Кригера, которые прозвучали из его уст на конференции для разработчиков в Сан-Франциско, сейчас Anthropic сконцентрирована на повышении качества и скорости работы чат-бота, а также устранении шероховатостей. В частности, ведётся работа по сокращению времени, необходимого для формирования и отправки пользовательских запросов после запуска мобильного приложения. Разработчикам Claude удалось сократить это время с прежних пяти-шести секунд до одной. Запущенный в 2023 году чат-бот Anthropic довольно быстро завоевал расположение рядовых пользователей, поскольку помимо рекламы в США, этому способствовали некоторые «вирусные истории» и даже скандал с исключением компании из числа доверенных поставщиков Пентагона. Сейчас Claude в магазине приложений Apple App Store находится на втором месте по популярности после ChatGPT конкурирующей OpenAI, обходя при этом Google Gemini. К марту Claude привлекал более 1 млн новых пользователей ежедневно. Сейчас, на волне такой популярности, Anthropic даже испытывает нехватку вычислительных мощностей. Эпидемию одиночества не вылечить ИИ-ботами — они лишь усиливают изоляцию

07.05.2026 [09:28],

Дмитрий Федоров

Одиночество толкает людей к ИИ-чат-ботам, но общение с ними лишь усиливает изоляцию. К такому выводу пришли психологи Данигэн Фолк (Dunigan Folk) и Элизабет Данн (Elizabeth Dunn), год наблюдавшие за 2149 взрослыми из четырёх англоязычных стран. Работа опубликована в журнале Psychological Science и ставит под сомнение надежды на то, что ИИ-компаньоны помогут справиться с эпидемией одиночества.

Источник изображения: Kristina Tripkovic / unsplash.com Фолк и Данн четырежды за двенадцать месяцев опросили жителей Великобритании (50 %), США (28 %), Канады (14 %) и Австралии (8 %). Все четыре волны опросов прошли 979 человек, три — 466, две — 395, одну — 309. Средний возраст участников составил 40 лет, мужчин и женщин оказалось почти поровну. Каждый раз респондентов спрашивали, как часто за минувшие четыре месяца они обращались к ИИ-чат-ботам за советом по жизненным вопросам, вели с ними повседневные разговоры или просто искали компанию. Одновременно анкеты фиксировали уровень эмоциональной изоляции опрашиваемых и более широкий показатель их социальной связанности с окружающими. Исследователи учитывали и крупные события в жизни участников опроса: переезд, расставание, начало устойчивых романтических отношений, рождение ребёнка. В каждой волне от 26 до 30 % опрошенных сообщали, что за предыдущие четыре месяца пользовались чат-ботами в социальных целях — например, обращались к ним за советом по жизненным вопросам, вели с ними повседневные разговоры или искали у них ощущение общения. При этом средняя частота таких обращений за год наблюдения статистически значимо не изменилась. Для эмоциональной изоляции ключевая закономерность оказалась двунаправленной: участники, которые чувствовали себя более эмоционально изолированными, через четыре месяца, как правило, чаще обращались к чат-ботам, а рост такого использования, в свою очередь, предсказывал более высокую эмоциональную изоляцию в следующей волне. Крупные жизненные события с последующим ростом обращений к ИИ-чат-ботам связаны не были. С более широким показателем социальной связанности картина оказалась иной. Люди, ощущавшие более слабую связь с социальным окружением, тоже чаще обращались к чат-ботам четыре месяца спустя, однако само по себе такое использование не предсказывало статистически значимого дальнейшего снижения социальной связанности. Из всех жизненных событий только разрыв отношений был связан с последующим ослаблением социальной связанности, но обращений к ИИ-чат-ботам после него не прибавлялось. Остальные события — переезд, начало устойчивых романтических отношений, рождение ребёнка — не показали статистически значимой связи с последующей социальной связанностью. Авторы предполагают, что люди могут снова и снова обращаться к ИИ-чат-ботам, потому что они доступны в любой момент и убедительно имитируют живое общение. Но такие сравнительно лёгкие и поверхностные контакты, по мнению Фолка и Данн, могут вытеснять более ценное общение с реальными людьми. У ИИ нет собственной внутренней жизни, поэтому он не способен на подлинную ответную откровенность, важную для полноценных долгосрочных человеческих отношений, и именно поэтому привязанность к чат-ботам может со временем не удовлетворять социальные потребности человека, а усиливать чувство одиночества. «В совокупности эти результаты дают первые свидетельства того, что одиночество может побуждать людей искать общение с чат-ботами, но такое использование со временем способно усугублять чувство одиночества. Тем не менее мы призываем к осторожности в выводах, учитывая предварительный характер нашего анализа», — заключили авторы. Наблюдательный характер исследования не позволяет делать однозначных причинно-следственных выводов, а все данные получены из ответов самих участников, что не исключает систематических искажений. Google готова показывать рекламу в Gemini — OpenAI уже делает это в ChatGPT

30.04.2026 [19:51],

Анжелла Марина

Руководство Google подтвердило готовность интегрировать рекламные объявления в приложение Gemini, отказавшись от прежней политики полного их отсутствия. Решение продиктовано стремлением компании масштабировать продукт и монетизировать растущую аудиторию пользователей Gemini.

androidauthority.com По сообщению Android Authority со ссылкой на Business Insider, в ходе конференции по итогам первого квартала 2026 года главный коммерческий директор Google Филипп Шиндлер (Philipp Schindler) подтвердил готовность компании разместить рекламу в приложении Gemini. Он уточнил, что если рекламный формат покажет свою эффективность в ИИ-режиме поиска Google (AI Mode Search), он будет применён и в Gemini. Ранее корпорация не торопилась с внедрением рекламы, но теперь её позиция изменилась. Шиндлер обосновал изменение планов тем, что грамотно встроенная реклама предоставляет пользователям полезную коммерческую информацию и помогает развивать продукты для миллиардов людей. Это заявление согласуется с декабрьским сообщением издания Adweek, которое ещё раньше сообщало о планах Google разместить рекламные объявления в Gemini в течение 2026 года. Таким образом, ожидаемые изменения стали логичным шагом в стратегии монетизации ИИ-сервисов компании. Ранее мы также сообщали о том, что Google не исключает появление рекламы в Gemini. Несмотря на наличие платных подписок, общее число которых достигло 350 миллионов человек, дохода от них может быть недостаточно для поддержания полностью бесплатного режима работы чат-бота. Ситуация также усугубляется действиями конкурентов. В частности, компания OpenAI уже начала показ рекламы пользователям бесплатной версии ChatGPT. Google, вероятно, последует этому тренду, чтобы сохранить экономическую устойчивость своего флагманского ИИ-продукта на фоне растущих затрат на инфраструктуру. OpenAI заявила, что ChatGPT научился считать буквы в словах — но на деле он продолжает ошибаться

29.04.2026 [10:59],

Владимир Мироненко

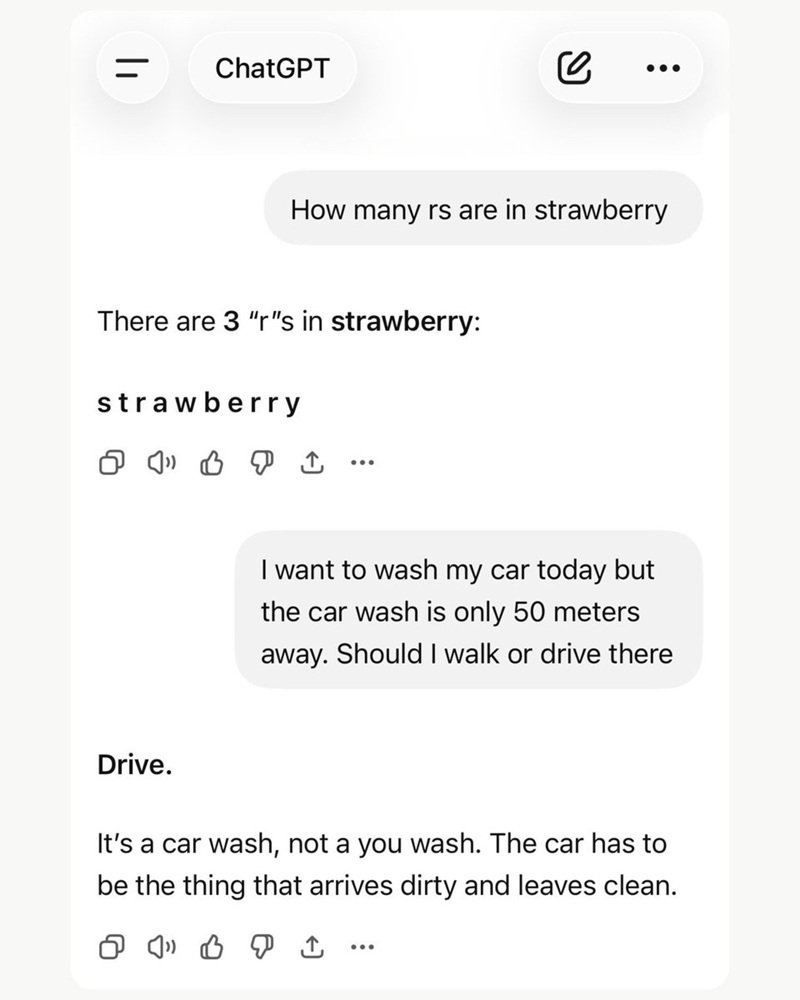

Распространённой проблемой больших языковых моделей, используемых в чат-ботах с искусственным интеллектом, являются уверенные ошибки или, другими словами, ложь. Например, до недавних пор ChatGPT не мог правильно ответить на вопрос, сколько букв R в слове strawberry (клубника).

Источник изображения: Levart_Photographer/unsplash.com Долгое время чат-бот выдавал неверный ответ, утверждая, что в слове strawberry буква R не встречается три раза. У других ИИ-моделей нередко наблюдалась аналогичная проблема. Еще одна распространённая ошибка: в ответ на вопрос «Я хочу сегодня помыть машину, но автомойка всего в 50 метрах. Стоит ли мне идти пешком, чтобы доехать туда?» чат-бот ChatGPT часто рекомендовал идти пешком, несмотря на очевидную логическую нестыковку.

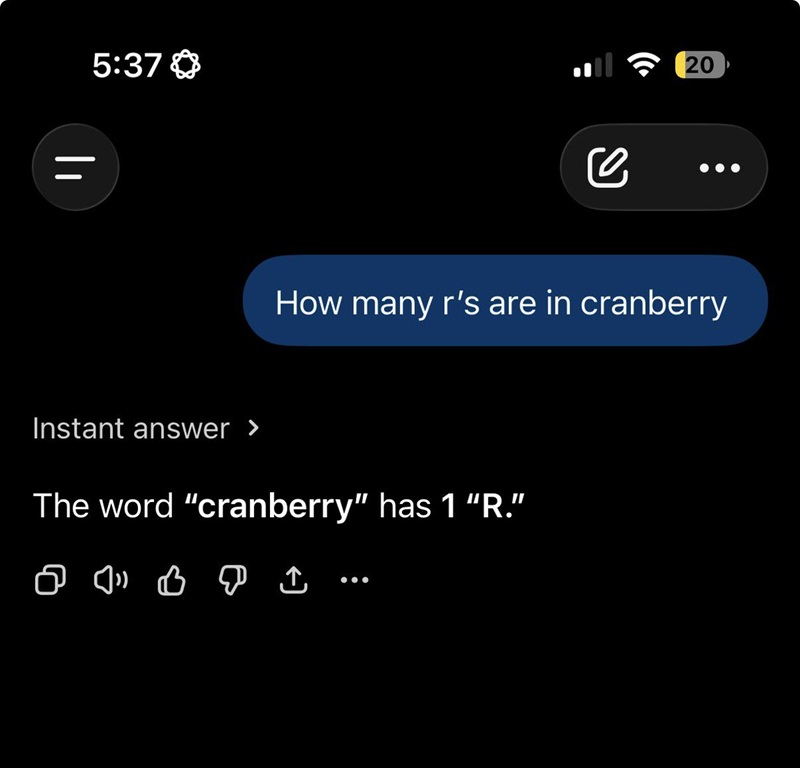

Источник изображений: 9to5google.com Одной из самых больших проблем, как пишет 9to5google.com, остается частота, с которой ИИ-инструменты уверенно лгут пользователям. Если информация неверна, чат-бот этого может не заметить, и, если указать на ошибку, ИИ может упорствовать и продолжать ошибаться, утверждая при этом, что он прав. Эта проблема рассматривается как опасность ИИ-инструментов, помимо того, что такие ответы просто раздражают с учётом потребляемых ИИ ресурсов. Сегодня OpenAI сообщила, что «наконец-то» ChatGPT может правильно ответить на вопросы по поводу количества букв R в слове strawberry и нужно ли идти к заправке для того, чтобы пополнить бак машины бензином. Но, как отметил 9to5google.com, существует подозрение, что это могут быть жёстко закодированные решения, поскольку в других случаях чат-бот продолжает ошибаться по той же логике. Например, на вопрос «Сколько букв R в слове cranberry (клюква)?» он постоянно отвечает: «В слове cranberry одна буква R», что, конечно же, неверно.  То есть, проблема по-прежнему существует, хотя OpenAI с гордостью объявила о её решении. ChatGPT Plus потеряет 80 % подписчиков в этом году — зато более дешёвый тариф ChatGPT Go расширит аудиторию в 37 раз

29.04.2026 [09:17],

Алексей Разин

Ещё вчера появилась общая информация о том, что руководство OpenAI обеспокоено снижением количества подписчиков и замедлением роста выручки, но подробности этого отчёта позволяют понять, как компания собирается бороться с данными тенденциями. Тарифный план ChatGPT Go за $8 в месяц должен увеличить количество подписчиков в текущем году с 3 млн до 112 млн человек.

Источник изображения: OpenAI В некоторых регионах ChatGPT Go доступен за $5 в месяц. А вот количество желающих платить по $20 в месяц за доступ к тарифу ChatGPT Plus, по данным компании, в текущем году сократится почти в пять раз, с 44 млн до 9 млн человек. Кроме того, прогнозы OpenAI гласят, что количество подписчиков самого дорогого плана ChatGPT Pro вырастет в этом году вдвое, но их доля в общем количестве не превысит 1 %, поэтому рассчитывать именно на данный ценовой сегмент компания просто не может. Впрочем, даже приток пользователей к тарифу ChatGPT Pro не сможет компенсировать упущенную выручку из-за отказа клиентов от более дорогого тарифа ChatGPT Plus, если проанализировать динамику. Выручка OpenAI от подписок по итогам текущего года всё равно сократится на $155 млн. Кроме того, привлечение 109 млн новых подписчиков наверняка увеличит расходы OpenAI, и не факт, что выручка от подписок на этом направлении сможет их перекрыть. ОАЭ намерены перевести половину госсектора под управление агентного ИИ за два года

24.04.2026 [22:55],

Дмитрий Федоров

Объединённые Арабские Эмираты (ОАЭ) объявили план перевода 50 % государственного сектора, услуг и операций на агентный ИИ в течение двух лет. Инициативу представил шейх Мохаммед ибн Рашид Аль Мактум (Mohammed bin Rashid Al Maktoum). Страна позиционирует эту программу не как поэтапную цифровизацию, а как структурную перестройку госуправления — переход к модели автономного правительства.

Источник изображений: ChatGPT / 3DNews Агентный ИИ — класс систем, способных не только генерировать аналитику, но и действовать самостоятельно: выполнять задачи, адаптироваться к меняющимся вводным данным и повышать собственную эффективность. В государственном контексте такие системы могут охватывать автоматизацию обращений граждан, оказания услуг и принятие операционных решений. Объявление примечательно тем, что инвестиции в ИИ подаются как инструмент национальной конкурентоспособности. ОАЭ годами выстраивали для этого основу: инфраструктуру цифровой идентификации, сервисы «умного правительства», суверенные облачные мощности, стратегии работы с данными и национальные ИИ-программы. Нынешний шаг выводит эти наработки за рамки цифрового обеспечения — к операционной автономии. Маниш Ранджан (Manish Ranjan), директор по исследованиям ПО и облачных технологий в IDC EMEA, считает, что успех программы определят не столько вычислительные мощности, сколько готовность госведомств перестроить процессы, на которых будет работать агентный ИИ. По его словам, ключевым фактором станет уровень подготовки данных, рабочих процедур и управленческих правил: для федерального государства такая перестройка — это многолетняя программа управления изменениями, а не обычное технологическое внедрение.  Мохамед Рушди (Mohamed Roushdy), директор по информационным технологиям Reem Finance, назвал цель амбициозной, но достижимой с учётом цифровой зрелости страны. «ОАЭ начинают не с нуля», — подчеркнул Рушди, указав на развитые платформы UAE Pass и TAMM, устойчивые государственные инвестиции и широкое внедрение ИИ в госструктурах. При этом он выделил серьёзные барьеры: фрагментацию унаследованных систем, неравномерную готовность данных и ограничения суверенных ИИ-мощностей, способные замедлить прогресс в работе с чувствительными нагрузками. Вопросы доверия, вероятно, определят следующую стадию ИИ-стратегии в госсекторе. По мере того как правительства переходят от ИИ как инструмента повышения производительности к системам, участвующим в принятии решений, прежних моделей управления рисками становится недостаточно. Ранджан считает, что руководителям госсектора нужно закладывать участие человека уже на этапе проектирования: заранее разграничивать решения, которые можно полностью автоматизировать, решения, требующие человеческой проверки, и зоны, где ответственность должна оставаться за человеком. Если в электронном государстве цифровое доверие строилось прежде всего на кибербезопасности, защите персональных данных и надёжности сервисов, то в агентных системах к этим требованиям добавляются объяснимость решений, постоянный надзор за моделями и подотчётность действий, выполняемых ИИ.  Инициатива ОАЭ поднимает и региональный вопрос — устанавливает ли страна планку, которой другие члены Совета сотрудничества арабских государств Персидского залива (GCC) будут вынуждены достичь. По мнению Ранджана, скорее всего да. «На протяжении последнего десятилетия эталоном в сфере государственных технологий GCC была цифровая зрелость — доступность электронных услуг и внедрение цифровой идентификации. ОАЭ фактически поднимают эту планку и заменяют прежний эталон готовностью к агентному ИИ», — заявил Ранджан. Если тренд закрепится, последствия выйдут за рамки трансформации госуправления и могут ускорить инвестиции в суверенные облака, платформы управления ИИ, ПО для автоматизации, цифровую инфраструктуру и развитие кадрового потенциала госсектора по всему региону. В этом случае обучение в сфере ИИ предстоит пройти каждому федеральному госслужащему. Повышение квалификации всё чаще входит в национальные ИИ-стратегии, однако масштаб и обязательный характер программы говорят о том, что правительство рассматривает развитие кадров как неотъемлемую часть перехода к операционной автономии. Потребительские ИИ-боты в 80 % случаев ставят неверные диагнозы, показало исследование

14.04.2026 [13:23],

Алексей Разин

Универсальность популярных чат-ботов с точки зрения поиска необходимой информации, как выясняется, не делает их пригодными для постановки точных медицинских диагнозов при ограниченном наборе данных. Более чем в 80 % случаев чат-боты ставят ошибочный диагноз, что делает их непригодными для замены консультации реального специалиста в области медицины.

Источник изображения: Unsplash, Elen Sher Опубликованное на страницах Jama Network Open исследование, на которое ссылается Financial Times, использовало 29 описаний клинических случаев из справочной медицинской литературы для проверки качества определения диагноза популярными чат-ботами. Исследование показало, что при передаче чат-боту ограниченной информации о симптомах большие языковые модели затрудняются с выбором возможных диагнозов, и чаще всего сводят всё к единственному варианту, на который в действительности нельзя полагаться в дальнейшем лечении. Если входные данные достаточно подробные, то таких проблем с постановкой точного диагноза уже не наблюдается. Медицинские данные в ходе эксперимента передавались чат-ботам поэтапно, включая историю болезни, результаты осмотров и лабораторных анализов. Чат-ботам задавались вопросы на тему диагностики заболеваний, измерялась точность и полнота ответов. В выборку проверяемых ИИ-моделей попали два десятка популярных чат-ботов, включая разработанные OpenAI, Anthropic, Google, xAI и DeepSeek. При отсутствии полной информации о состоянии пациента более чем в 80 % все они демонстрировали склонность к постановке некорректного диагноза. Чем полнее была информация, тем точнее были результаты. В лучших случаях точность превышала 90 %, в среднем варианте ошибочные диагнозы ставились менее чем в 40 % случаев. Google и Anthropic заявили, что их чат-боты при попытке пользователей получить медицинские рекомендации настоятельно рекомендуют обращаться к специалистам. OpenAI указывает в правилах использования своих сервисов, что они не должны использоваться для получения медицинских рекомендаций, требующих наличия соответствующей лицензии. xAI и DeepSeek свои комментарии на этот счёт ресурсу Financial Times не предоставили. Некоторые из указанных разработчиков создают узкоспециализированные медицинские модели. Разработанная Google AMIE, например, показывает неплохие результаты, но на её заключения сложно полагаться в полной мере, как отмечают специалисты в области медицины, поскольку живой доктор в значительной степени полагается на визуальную оценку состояния пациента. При этом такие ИИ-модели имеют право на жизнь в тех регионах, где имеются проблемы с доступом к качественной медицинской помощи в классическом её понимании. Уже в этом году OpenAI рассчитывает выручить на рекламе $2,5 млрд, а к концу десятилетия увеличит сумму в 40 раз

10.04.2026 [08:22],

Алексей Разин

Стремление руководства OpenAI донести до инвесторов всю информацию о собственном бизнес-плане выражается не только в рассказе о расходах, но и ожидаемых доходах. Стартап по итогам текущего года в сфере рекламы рассчитывает выручить $2,5 млрд, а к 2030 году надеется увеличить эту сумму до $100 млрд. Для этого количество еженедельных активных пользователей сервисов OpenAI должно вырасти до 2,75 млрд человек.

Источник изображения: OpenAI Подобные прогнозы стали известны благодаря изданию Axios, на которое ссылается агентство Reuters. Соответствующие планы OpenAI недавно продемонстрировала своим инвесторам в профильных презентациях. Для создателей чат-ботов и прочих ИИ-сервисов реклама и поступления с подписок являются основными источниками доходов, поэтому при построении бизнес-стратегии компании уделяют этим направлениям особое внимание. В следующем году выручка OpenAI от рекламы должна вырасти с $2,5 до $11 млрд, как отмечает источник, а в 2028 году вырасти до $25 млрд. Ещё через год рекламная выручка OpenAI должна увеличиться до $53 млрд, а к 2030 году она почти удвоится, если всё пойдёт по плану. Напомним, что примерно к этому моменту OpenAI рассчитывает впервые выйти в прибыль. Эксперимент по демонстрации рекламы в ChatGPT компания проводит с января этого года для отдельных категорий пользователей в США. Через шесть недель с начала этого эксперимента приведённая к году выручка от демонстрации рекламы выросла до $100 млн. Размещать свою рекламу в ChatGPT выразили желание более 600 компаний. В любом случае, OpenAI ещё очень далека от рекламных доходов основных конкурентов. Google в прошлом году на рекламе выручила почти $295 млрд, а Meta✴✴ Platforms — более $196 млрд. Пока OpenAI не наблюдает отторжения рекламы своими пользователями, соответствующие объявления просматриваются не хуже, чем в целом по отрасли. Суд в Нидерландах тоже запретил чат-боту Grok генерировать изображения реальных людей без одежды

28.03.2026 [05:58],

Алексей Разин

Казалось бы, усилиями общественности и американской системы правосудия от стартапа xAI Илона Маска (Elon Musk) удалось добиться снижения активности по созданию чат-ботом Grok изображений реальных людей без одежды. Европейские регуляторы при этом проводили собственное расследование, и недавно суд в Нидерландах официально запретил xAI сохранять соответствующие возможности Grok.

Источник изображения: Unsplash, Мария Шалабаева Если xAI не подчинится решению суда, как отмечает CNBC, ей грозят $115 000 штрафа за каждый день просрочки в реализации запретительных мер. По решению Окружного суда Амстердама, компания xAI лишается права генерировать и распространять изображения реально существующих людей без их согласия, на которых они обнажены полностью или частично. Подобное решение суда в европейской юрисдикции вынесено впервые с момента появления в чат-боте Grok подобной функции. Под запрет также попадают сгенерированные ИИ материалы с вовлечением несовершеннолетних в интимное взаимодействие. За каждый день нарушения этого запрета Grok будет штрафоваться на 100 000 евро, а максимальный штраф может достичь 10 млн евро. Истцом по делу выступала некоммерческая организация Offlimits из Нидерландов, которая защищает права несовершеннолетних при злоупотреблениях сексуального характера в онлайне. Суд также обязал xAI выплатить истцу компенсацию судебных издержек в размере 2,2 млн евро в течение 14 дней. Как отмечают представители Offlimits, технология не является лицензией на нарушение прав человека в режиме онлайн, а потому данная победа в суде важна для всей европейской общественности. По некоторым оценкам, с помощью чат-бота Grok в период с 29 декабря прошлого года по 9 января текущего было сгенерировано более 3 млн изображений людей с сексуальным подтекстом, причём более 23 000 в них фигурировали несовершеннолетние. xAI начала блокировать подобные возможности в чат-боте с января текущего года, но правозащитники утверждают, что данные меры были не до конца эффективными. Компании пришлось столкнуться с множественными судебными исками. Илону Маску данная тенденция первоначально казалась забавной, поскольку он сам опубликовал сгенерированное Grok собственное изображение в стрингах. В США судебные иски к xAI были поданы в Балтиморе и штате Теннесси. Еврокомиссия запустила собственное расследование в этой сфере в январе, к ней присоединились и британские регуляторы. В Малайзии и Индонезии доступ к Grok был блокирован после отсутствия эффективных мер по запрету генерирования подобных изображений со стороны платформы. Apple откроет Siri для сторонних ИИ — можно будет выбрать Gemini или Claude

27.03.2026 [03:30],

Анжелла Марина

Компания Apple готовит кардинальные изменения для Siri. По сообщению The Verge со ссылкой на Марка Гурмана (Mark Gurman) из Bloomberg, в обновлении iOS 27 владельцы устройств смогут самостоятельно выбирать, какую именно нейросеть использовать для генерации ответов. Новая система, получившая название Extensions, позволит подключать к Siri такие популярные модели как Gemini или Claude, по аналогии с тем, как сейчас реализована работа с ChatGPT.

Источник изображения: 9to5mac.com Согласно информации источников, функция Extensions даст пользователям iPhone, iPad и Mac возможность включать или отключать интеграцию с выбранными чат-ботами, загруженными из App Store. Предполагается, что технология будет работать не только через голосовой интерфейс Siri, но и в отдельном приложении, которое Apple планирует выпустить для «прокачанной» ИИ-версии ассистента. Улучшенная версия Siri также сможет самостоятельно выполнять действия за пользователя в различных приложениях. Напомним, в январе представители Apple подтвердили сотрудничество с Google для модернизации Siri после ряда технических неудач. Сообщается, что эта сделка также включает использование Gemini для обучения собственных небольших моделей Apple. Официальная презентация новых операционных систем и, вероятно, деталей о работе сторонних чат-ботов с Siri ожидается на Всемирной конференции разработчиков (WWDC). Мероприятие запланировано на 8 июня. OpenAI передумала развращать ChatGPT — проект ИИ-бота для взрослых отправили «в долгий ящик»

26.03.2026 [16:51],

Алексей Разин

Усилия руководства OpenAI по оптимизации бизнес-стратегии начинают определять те приоритетные направления развития стартапа, которые достойны запланированных многомиллиардных инвестиций. Вслед за неожиданным отказом от поддержки ИИ-генератора видео Sora, как отмечает Financial Times, компания решила отложить в «долгий ящик» и проект эротического чат-бота.

Источник изображения: Unsplash, Brian Lawson Прошлая публикация на эту тему позволяет понять, что темой запуска эротических ИИ-сервисов OpenAI интересуется уже на протяжении нескольких лет, и после длительных колебаний воплотить эти планы в жизнь сперва было решено до конца первого квартала текущего года, но недавно стало известно, что в этой сфере возникает задержка как минимум на месяц. Теперь Financial Times со ссылкой на осведомлённые источники заявляет, что проект эротической направленности отложен в «долгий ящик» на неопределённое время, поскольку инвесторы и сами сотрудники OpenAI выражают глубокую озабоченность его вероятными социальными и экономическими последствиями. Внутри стартапа даже высказываются мнения о необходимости полностью отказаться от идеи запуска эротического чат-бота. Растёт беспокойство связанных с OpenAI лиц по поводу усиления нездоровой атмосферы вокруг чат-бота, а также последствий получения доступа к взрослому контенту со стороны несовершеннолетних пользователей. Представители OpenAI в комментариях Financial Times подтвердили, что эротическая ИИ-модель отложена по срокам реализации на неопределённое время. Прежде чем принять какие-то решения о жизнеспособности проекта, OpenAI хочет провести глубокое исследование по поводу его возможного влияния на общество. Каких-либо эмпирических данных на этот счёт до сих пор не существует, поэтому к изучению проблемы важно подойти досконально. Кроме того, распылять ресурсы на второстепенные инициативы OpenAI сейчас не желает, предпочитая сосредоточиться на разработке ИИ-инструментов для повышения производительности умственного труда и их монетизации. По некоторым данным, самые востребованные свои инструменты создатели ChatGPT намерены объединить в мощном настольном приложении. Выпуск платформы с эротическим уклоном мог бы вызвать неоднозначную реакцию аудитории в ближайшее время, поскольку на фоне скандала с «раздевающим» людей чат-ботом Grok компании xAI внимание регуляторов к этой теме резко возросло. Выход апеллирующего к теме эротики ИИ-решения OpenAI мог бы насторожить инвесторов с учётом планируемого IPO компании. Тем более, что перспективы серьёзной монетизации такого продукта многим из них тоже кажутся сомнительными. Наконец, создание такого продукта могло бы натолкнуться на чисто технические трудности. Годами ChatGPT развивался с учётом определённых этических ограничений, а для реализации «эротического проекта» их пришлось бы выборочно снимать, причём с сохранением категорической блокировки некоторых табуируемых в обществе тем. Сохранить оптимальный баланс между жизнеспособностью такой модели и её безопасностью было бы крайне сложно. Недавно модернизированная система верификации возраста пользователей по-прежнему даёт сбой в более чем 10 % случаев. Это означает, что миллионы несовершеннолетних могли бы получить доступ к контенту для взрослых, и подобные факты повлекли бы серьёзные юридические риски для OpenAI. Половина компаний, заменивших людей ИИ-ботами, вернётся к найму персонала в следующем году

26.03.2026 [08:41],

Алексей Разин

Понятие «ИИ-отмывания» постепенно входит в оборот, когда речь идёт о попытках работодателей прикрыть сокращение персонала в силу прочих причин влиянием на бизнес искусственного интеллекта. Даже самые ярые сторонники внедрения ИИ порой склоняются к мысли, что эта тема становится удобным прикрытием для увольнения сотрудников из-за причин иного характера.

Источник изображения: Unsplash, ThisisEngineering The Wall Street Journal приводит комментарии основателя стартапа Gather.dev Питера Белла (Peter Bell), который в развитии своей компании дошёл до того, что даёт создаваемым им ИИ-агентам разные человеческие имена и придумывает для них некие жизненные условия. «Это отличная дымовая завеса, если вам нужно резко поднять чистую прибыль», — отмечает Белл, добавляя, что под предлогом внедрения ИИ собственники бизнеса могут практически безнаказанно сокращать персонал, в действительности руководствуясь иными соображениями. Специалисты в сфере машинного обучения и экономики, опрошенные The Wall Street Journal, сходятся во мнении, что именуемая искусственным интеллектом технология на нынешнем уровне своего развития не может заменить человека в масштабах большинства отраслей экономики. Даже если компании объясняют проводимые сокращения персонала внедрением ИИ, в действительности они руководствуются прочими причинами: снижением объёмов продаж, сменой приоритетов и прежним избыточным увеличением штата. Аналитики Forrester Research отмечают, что в глазах инвесторов и клиентов владельцы бизнеса выглядят лучше, когда обосновывают сокращения персонала повышением эффективности организационной структуры в результате внедрения ИИ: «Это звучит гораздо более рационально и инновационно». Подобные публичные заявления способны приводить к росту курса акций компании, инвесторам такие доводы нравятся. По имеющимся данным, в прошлом году американские работодатели уволили более 1,2 млн сотрудников. По мнению экспертов Forrester, при этом менее 100 000 из сокращённых сотрудников при этом действительно потеряли работу в результате внедрения ИИ. Специалисты, занимающиеся практическим внедрением ИИ, пока жалуются на длительность процесса интеграции соответствующих сервисов, которые нередко усложняются соображениями безопасности и прочими регуляторными ограничениями. Пройдёт немало времени, прежде чем ИИ-бот сможет заменить функции человека в бизнес-процессах большинства компаний. По прогнозам Forrester, к 2030 году 6,1 % рабочих мест на рынке США падут жертвой внедрения ИИ. Это не очень хорошо, но и не говорит о грядущем апокалипсисе. Для работодателей перспектива замены сотрудников ИИ нередко становится той «страшилкой», которая помогает держать персонал в тонусе. Подобная мотивация порой заставляет находить удачные бизнес-идеи и технические решения, которые бы в более благоприятной психологической обстановке могли бы не появиться вовсе. Аналитики Gartner считают, что половина компаний, которая уже заменила людей ИИ-ботами на линейных позициях, в следующем году вернётся к привлечению новых сотрудников. Внедрение ИИ и содержание инженеров, которые настраивают эти сложные системы, порой обходится бизнесу дороже, чем группа сотрудников, отвечающих на телефонные звонки клиентов. Тем более, что ИИ-боты нередко раздражают клиентов и им всё равно требуется связь с живым специалистом. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |