|

Опрос

|

реклама

Быстрый переход

ИИ Gemini оказался совсем не так хорош в обработке больших объёмов данных, как заявляла Google

01.07.2024 [09:15],

Анжелла Марина

Новые исследования ставят под сомнение заявления Google о возможностях больших языковых моделей моделей Gemini по обработке больших объёмов данных, показывая, что их эффективность в анализе длинных текстов и видео значительно ниже заявленной.

Источник изображения: Google Недавние исследования выявили существенные недостатки в работе флагманских генеративных моделей искусственного интеллекта Google Gemini 1.5 Pro и 1.5 Flash, пишет издание TechCrunch. Google неоднократно подчёркивала способность Gemini обрабатывать огромные объёмы данных благодаря большому контекстному окну, утверждая, что модели могут анализировать документы объёмом в сотни страниц и искать информацию в видеозаписях. Однако два независимых исследования показали, что на практике эти модели справляются с такими задачами гораздо хуже. Учёные из Массачусетского университета в Амхерсте (UMass Amherst), Института Аллена по искусственному интеллекту (Allen Institute for AI) и Принстона (Princeton University) тестировали Gemini на способность отвечать на вопросы о содержании художественных книг. Представленная для теста книга содержала около 260 000 слов (около 520 страниц). Результаты оказались неутешительными. Gemini 1.5 Pro правильно ответил только в 46,7 % случаев, а Gemini 1.5 Flash лишь в 20 % случаев. Далее усреднив результаты, выяснилось, что ни одна из моделей не смогла достичь точности ответов на вопросы выше случайной. Маржена Карпинска (Marzena Karpinska), соавтор исследования, отметила: «Хотя такие модели, как Gemini 1.5 Pro, технически могут обрабатывать длинные контексты, мы видели много случаев, указывающих на то, что модели на самом деле не понимают содержание». Второе исследование, проведённое учёными из Калифорнийского университета в Санта-Барбаре, фокусировалось на способности Gemini 1.5 Flash анализировать видеоконтент, а точнее слайды с изображениями. Результаты также оказались неудовлетворительными — из 25 изображений ИИ дал правильные ответы только в половине случаев, а при увеличении количества картинок точность ответов понизилась до 30 %, что ставит под сомнение эффективность модели в работе с мультимедийными данными. Правда отмечается, что ни одно из исследований не прошло процесс рецензирования, и к тому же не тестировались самые последние версии моделей с контекстом в 2 миллиона токенов. Тем не менее, полученные результаты вызывают серьёзные вопросы в отношении реальных возможностей генеративных моделей ИИ в целом, и о том, насколько обоснованы маркетинговые заявления технологических гигантов. Данные исследования появились на фоне растущего скептицизма в отношении генеративного ИИ. Так, недавние опросы международной консалтинговой компании Boston Consulting Group показали, что около половины опрошенных руководителей высшего звена не ожидают существенного повышения производительности от использования генеративного ИИ и обеспокоены возможными ошибками и проблемами с безопасностью данных. Эксперты же призывают к разработке более объективных критериев оценки возможностей ИИ и к большему вниманию и независимой критике. Google пока не прокомментировал результаты этих исследований. Гарнитура Apple Vision Pro всё же получит поддержку ИИ Apple Intelligence, но не скоро

30.06.2024 [20:59],

Владимир Мироненко

Этой осенью пакет ИИ-инструментов Apple Intelligence станет доступным для совместимых устройств под управлением iPadOS 18, macOS Sequoia и iOS 18. В этом перечне нет гарнитуры дополненной реальности Apple Vision Pro, но, как утверждают в Bloomberg, Apple активно работает над внедрением в ней ИИ-функций, хотя появления поддержки Apple Intelligence у гарнитуры в этом году ждать не приходится.  С точки зрения спецификаций гарнитура вполне может поддерживать Apple Intelligence благодаря процессору M2 и 16 Гбайт оперативной памяти. То, что VisionOS является вариантом iPadOS, тоже подтверждает возможность внедрения Apple Intelligence в Vision Pro. В качестве потенциального препятствия для запуска ИИ-инструментов в гарнитуре аналитики Bloomberg назвали сложность создания надлежащего интерфейса для смешанной среды. У Apple существуют опасения по поводу возможной перегрузки облачной инфраструктуры при запуске Apple Intelligence, что стало одной из причин, по которой компания ограничила внедрение ИИ-функций более новыми устройствами. Но и это не может быть большой проблемой, учитывая то, что объёмы продаж Vision Pro несопоставимы с реализацией компьютеров Mac, которые могут использовать эту технологию, а также объёмами продаж смартфонов iPhone 15 и iPhone 16, которые выйдут этой осенью с поддержкой ИИ. В любом случае, поддержка Apple Intelligence у гарнитуры Vision Pro если и появится, то в 2025 году, считают аналитики. Amazon переманила сотрудников Adept AI Labs для усиления ИИ-подразделения

30.06.2024 [18:32],

Владимир Фетисов

Компания Amazon наняла топ-менеджеров и других сотрудников ИИ-стартапа Adept AI Labs Inc. Этот шаг гиганта электронной коммерции и облачных вычислений направлен на усиление подразделения по разработке сильного искусственного интеллекта Amazon Artificial General Intelligence, способного решать самые амбициозные задачи компании в данном сегменте.

Источник изображения: Gerd Altmann / pixabay.com Соучредитель и бывший генеральный директор Adept Дэвид Луан (David Luan) присоединится к подразделению Amazon AGI, которое возглавляет старший вице-президент Amazon Рохит Прасад (Rohit Prasad). Частью этой команды также станут ещё четыре соучредителя Adept и неустановленное количество других сотрудников стартапа. По данным источника, Amazon лицензирует ИИ-технологии Adept по автоматизации различных процессов для создания собственных программных продуктов. Официальные представители Adept и Amazon отказались от комментариев касательно финансовых условий перехода в Amazon и количества сотрудников стартапа, сменивших место работы. В марте прошлого года стартап Adept привлёк $350 млн инвестиций, а рыночная стоимость компании выросла до $1 млрд. В сообщении Adept о сделке с Amazon говорится, что дальнейшая самостоятельная реализация плана по созданию ИИ-алгоритмов «потребовала бы уделять значительное внимание привлечению средств для создания базовых ИИ-моделей, а не воплощению в жизнь» идей компании. Что касается успехов Amazon в сфере ИИ, то следует отметить торгового чат-бота компании и другие инструменты для сайтов розничной торговли. Компания через собственное облачное подразделение открыла платный доступ к своим ИИ-алгоритмам для сторонних клиентов. Подразделение Прасада также занималось созданием алгоритмов для голосового помощника Alexa и было переименовано в AGI в рамках прошлогодней реорганизации. Соглашение с Adept подписано в период времени, когда многие крупные технологические компании активизировали процесс набора опытных сотрудников из хорошо финансируемых ИИ-стартапов. Так в марте Microsoft наняла большую часть сотрудников стартапа Inflection AI. Что касается договора Amazon с Adept, то глава технического отдела стартапа Зак Брок (Zach Brock) станет новым руководителем Adept. В штате останется около 20 сотрудников, которые продолжат работать над созданием ИИ-алгоритмов. ChatGPT превзошёл студентов на экзаменах, но только на первых курсах

29.06.2024 [23:57],

Анжелла Марина

Исследователи провели эксперимент, который показал, что ИИ способен успешно сдавать университетские экзамены, оставаясь при этом незамеченным специальными программами. Экзаменационные работы ChatGPT получили более высокие оценки, чем работы студентов, пишет издание Ars Technica.

Источник изображения: Headway/Unsplash Команда учёных из Редингского университета в Англии (University of Reading) под руководством Питера Скарфа (Peter Scarfe) провела масштабный эксперимент, чтобы проверить, насколько эффективно современные системы искусственного интеллекта могут справляться с университетскими экзаменами. Исследователи создали более 30 фиктивных учётных записей студентов-психологов и использовали их для сдачи экзаменов, используя ответы, сгенерированные ChatGPT. Эксперимент охватил пять модулей бакалавриата по психологии, включая задания для всех трёх лет обучения. Результаты оказались ошеломляющими — 94 % работ, созданных ИИ, остались незамеченными экзаменаторами. Более того, почти 84 % этих работ получили более высокие оценки, чем работы студентов-людей, в среднем на полбалла выше. «Экзаменаторы были весьма удивлены результатами», — отметил Скарф. Причём интересно, что некоторые работы ИИ были обнаружены не из-за их роботизированности, а из-за слишком высокого качества. Эксперимент также выявил ограничения существующих систем обнаружения контента, созданного ИИ. По словам Скарфа, такие инструменты, как GPTZero от Open AI и система Turnitin, показывают хорошие результаты в лабораторных условиях, но их эффективность значительно снижается в реальной жизненной ситуации. Однако не все результаты были в пользу ИИ. На последнем курсе, где требовалось более глубокое понимание и сложные аналитические навыки, студенты-люди показали лучшие результаты, чем ChatGPT. Скарф подчеркнул, что ввиду постоянного совершенствования ИИ и отсутствия надёжных способов обнаружения его использования, университетам придётся адаптироваться и интегрировать ИИ в образовательный процесс. «Роль современного университета заключается в подготовке студентов к профессиональной карьере, и реальность такова, что после окончания учёбы они, несомненно, будут использовать различные инструменты искусственного интеллекта», — заключил исследователь. Данный эксперимент, по сути, поднимает проблему, которая уже сегодня требует пересмотра существующих методов обучения и экзаменации. ИИ стал главным локомотивом серверного рынка — другие сегменты растут куда медленнее

29.06.2024 [19:58],

Павел Котов

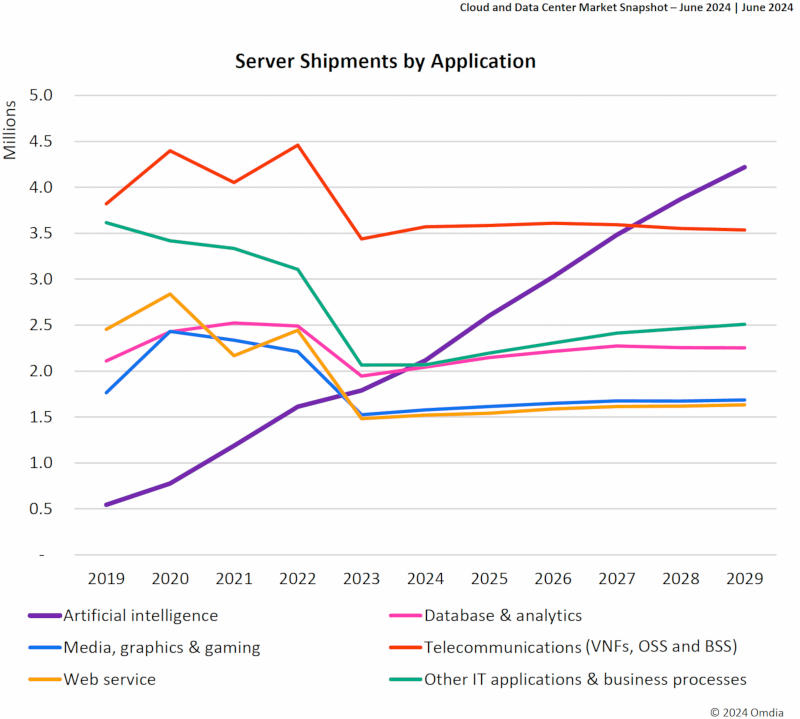

В 2020 году из-за пандемии и массового перехода на удалёнку поставки серверов всех типов достигли максимальных значений. В последующие годы отгрузки серверов почти всех типов снизились до нормы, но есть одно исключение — системы искусственного интеллекта, которые сохраняют мощные темпы роста, пишет Tom’s Hardware со ссылкой на статистику Omdia.

Источник изображения: Pete Linforth / pixabay.com Прогнозируется, что поставки ИИ-серверов сохранят активный рост и в будущем: в 2019 году было отгружено 500 тыс. единиц, а к 2029 году этот показатель вырастет до 4,5 млн — ИИ станет ведущим приложением для центров обработки данных. Растёт и ассортимент моделей ИИ, и количество приложений на их основе — поэтому в Omdia предрекают стремительный рост поставок ИИ-серверов до 2029 года; соответственно, будут расти и доходы от этого оборудования. В других серверных сегментах такой динамики не ожидается. Незначительный рост с 2 млн в 2019 до 2,5 млн к 2029 году могут продемонстрировать серверы баз данных и аналитики; в сегменте медиа, графики и игр ожидается стабильный уровень поставок около 2 млн. Телекоммуникационное направление с 2019 по 2023 год демонстрировало снижение с 4 млн до 2 млн — далее ожидается стабилизация. Видимо, эта тенденция объясняется ростом производительности машин, а значит, их будет требоваться меньше.

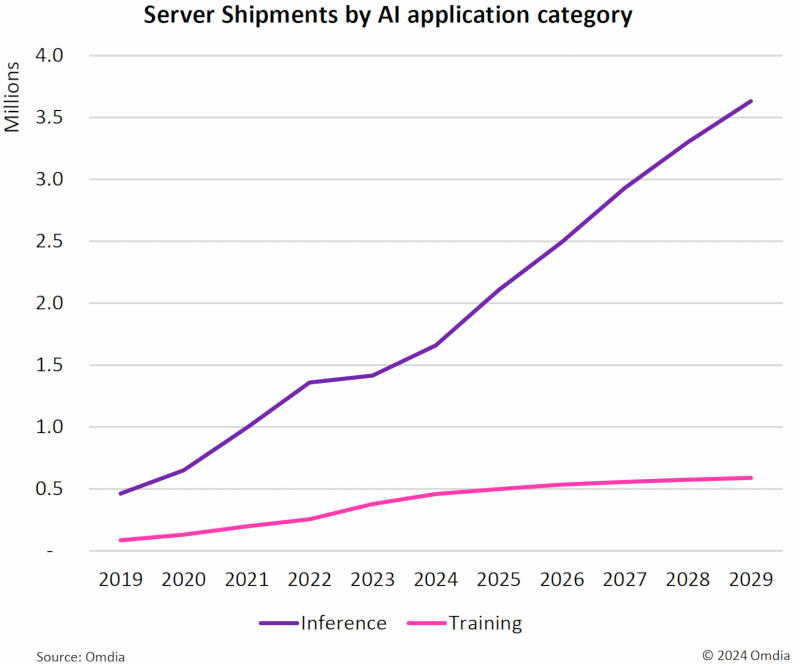

Источник изображения: Omdia Отгрузки серверов для веб-сервисов снизились с 2,5 млн в 2019 до 1,5 млн в 2023 году; в категории прочих IT-приложений и бизнес-процессов также отмечено сокращение с 3,5 млн в 2019 до 1,5 млн в 2023 году, но к 2029 году здесь ожидается рост до 3 млн. Это, утверждают аналитики Omdia, отражает сдвиг в сторону вложений в ИИ и оптимизация по другим направлениям. Благодаря управлению температурным режимом в ЦОД ожидается рост выручки с $7,7 млрд в 2023 до $9,4 млрд в 2029 году. Инвестиции в компоненты распределения энергии помогут поднять инфраструктурную выручку выше $4 млрд. Основным фактором роста для ИИ-серверов в целом и продаж Nvidia в частности было направление, связанное с обучением ИИ: ускорители Nvidia A100 и H100 с поддержкой CUDA значительно опередили конкурентов. Продажи серверов для обучения ИИ продолжат расти, но сейчас, когда множество моделей ИИ уже обучено, настало время на них зарабатывать. Это значит, что продажи серверов для работы ИИ должны взлететь, причём их рост будет опережать рост сегмента обучения ИИ.

Источник изображения: Omdia Как ожидается, серверы для обучения ИИ теперь будут демонстрировать скромный рост с совокупным среднегодовым темпом (CAGR) 5 % — с 0,5 млн в 2019 году до немногим менее 1 млн в 2029 году. Этот рост обусловлен увеличением эффективности графических процессоров и ИИ-ускорителей, выделением бюджетов на исследования и разработку, а также тем фактом, что предприятия будут выбирать уже обученные модели ИИ. Тем временем серверы для работы ИИ продемонстрируют CAGR в 17 % — с 0,5 млн в 2019 до 4 млн в 2029 году. Это отражает рост прикладных решений в области ИИ и соответствующую ему динамику потребности в серверном оборудовании. В целом, заключают в Omdia продажи ИИ-серверов в ближайшие пять лет сохранят быстрый рост, а в прочих сегментах он будет не столь значительным. ИИ придумал, как в разы увеличить эффективность используемых оверклокерами стаканов

29.06.2024 [07:03],

Анжелла Марина

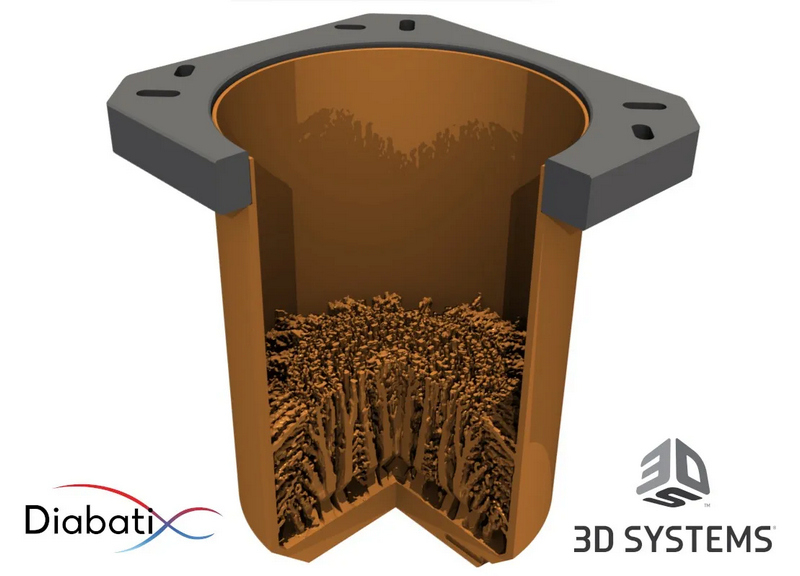

Специалисты создали инновационный стакан для жидкого азота с помощью ИИ и 3D-печати, превзошедший существующие аналоги по ключевым параметрам. ИИ-стакан обеспечил ускорение охлаждения в 3 раза, ускорение нагрева в 1,2 раза и эффективность использования LN2 на 20 %. Но пока он оказался экономически невыгодным для массового производства.

Источник изображений: SkatterBencher, GamersNexus Группа экспертов по разгону компьютеров из SkatterBencher провела уникальное исследование, объединив передовые технологии искусственного интеллекта и 3D-печати для создания высокоэффективного стакана для жидкого азота (LN2). В проекте приняли участие ведущие компании отрасли — Diabatix, специализирующаяся на генеративном ИИ для тепловых решений, 3D Systems, эксперт в области аддитивного производства (3D-печать), и ElmorLabs, известный производитель оборудования для разгона компьютерных компонентов, пишет Tom's Hardware. Цель исследования заключалась в проверке возможности создания стакана LN2 с использованием генеративного ИИ и технологий 3D-печати, а также оценке его эффективности и экономической целесообразности по сравнению с существующими системами.  За основу был взят стакан LN2 ElmorLabs Volcano CPU. Платформа Diabatix ColdStream Next AI разработала улучшенный дизайн. Затем прототип был изготовлен компанией 3D Systems с использованием передовой технологии 3D-печати на основе бескислородной порошковой меди. Однако стоимость разработки и изготовления прототипа в конечном итоге составила внушительные 10 000 долларов, что значительно дороже стакана ElmorLabs Volcano CPU, продающегося всего за 260 долларов. Тем не менее, базовые испытания производительности показали, что стакан LN2, разработанный с помощью ИИ, превзошёл Volcano по нескольким ключевым параметрам. Время охлаждения: прототип достиг температуры -194 °C всего за 56 секунд, в то время как Volcano потребовалось почти 3 минуты. Время нагрева: прототип нагрелся от -194 до 20 °C на 30 секунд быстрее, чем Volcano, при тепловой нагрузке 1250 Вт. Эффективность: используя 500 мл жидкого азота, стакан от ИИ охладился до -133 °C, что на 20 % эффективнее, чем Volcano, который достиг только -100 °C. Однако в практических тестах, включая тест производительности разгона Cinebench 2024, проверку эффективности передачи тепла от процессора и полный стресс-тест при мощности более 600 Вт, преимущества нового дизайна оказались не столь значительными. Учитывая существенную разницу в цене, стакан для жидкого азота, разработанный с помощью ИИ, пока не является экономически эффективной альтернативой существующим решениям. Несмотря на текущие показатели, SkatterBencher и его партнёры планируют продолжить работу над оптимизацией производительности и снижением стоимости стакана, а в будущем рассматривают возможность его адаптации для более мощных процессоров, таких как AMD Ryzen Threadripper, так как планируют вывести на рынок свою разработку и сделать её экономически жизнеспособной. Google, Meta✴ и другие незаметно меняют политику конфиденциальности для обучения ИИ

29.06.2024 [05:14],

Анжелла Марина

Крупные технологические компании, такие как Google, Adobe и Meta✴✴, вносят изменения в свою политику конфиденциальности, позволяющую им использовать данные пользователей для обучения моделей искусственного интеллекта (ИИ). Эти изменения часто вносятся незаметно и завуалированно, чтобы избежать негативной реакции.

Источник изображения: Christoph Meinersmann/Pixabay Федеральная комиссия США по торговле (FTC) предупредила, что такие действия могут быть незаконными и нарушают обязательства компаний по защите конфиденциальности пользователей. Однако, согласно проведённому анализу The New York Times, компании тихо корректируют свои положения и условия, включая термины, связанные с ИИ, чтобы обеспечить себе юридическое прикрытие. Напомним, Google внесла изменения в свою политику конфиденциальности в июле прошлого года, подчёркивая, что собирается использовать общедоступную информацию для обучения своих языковых ИИ-моделей. Adobe также обновила свои условия, что вызвало негативную реакцию пользователей, когда стало известно, что они могут потерять доступ к своим проектам, если не согласятся с новыми условиями. Тогда это привело к массовому отказу от подписки на сервисы компании. Meta✴✴, со своей стороны, объявила в мае о намерении использовать общедоступные посты в Facebook✴✴ и Instagram✴✴ для обучения ИИ, но была вынуждена отложить эти планы из-за жалобы международной общественной организации по защите прав человека в интернете (European Center for Digital Rights, EDRi). Пока неизвестно, какие меры предпримет FTC в ответ на растущую тенденцию изменений политики конфиденциальности с целью включения обучения ИИ на пользовательских данных. Audi интегрирует ChatGPT в свои автомобили — это расширит голосовое управление

29.06.2024 [04:01],

Анжелла Марина

Audi внедряет ChatGPT в свою информационно-развлекательную систему MIB3 для расширения возможностей голосового управления. С июля около двух миллионов автомобилей Audi, выпущенных с 2021 года, включая Audi A3, получат обновлённые функции. Новые модели, такие как Q6 e-tron, также будут оснащены ChatGPT.

Источник изображения: Audi Интеграция ChatGPT в систему MIB3 открывает новые, ранее недоступные возможности, сообщает в своём блоге компания. Водители Audi смогут использовать расширенное голосовое управление для работы с информационно-развлекательной системой, навигацией и системой кондиционирования воздуха, а также задавать общие вопросы. Возможность запрашивать информацию в реальном режиме времени, не отвлекаясь от дороги, делает вождение безопаснее. ChatGPT предоставляется через Azure OpenAI Service, а в основе новой функции лежит технология Chat Pro от компании Cerence, которая непосредственно занимается интеграцией чат-бота в Audi Assistant на новой архитектуре E 3 1.2. Маркус Кит (Marcus Keith), вице-президент по развитию информационно-развлекательных систем в Audi, отмечает, что благодаря бесшовной интеграции ChatGPT в систему голосового управления были объединены сильные стороны технологий ChatGPT и Chat Pro. «Помимо широкого спектра голосовых функций, наши клиенты теперь получат простой и безопасный доступ к базе знаний на основе ИИ. Это ещё один шаг к созданию премиального пользовательского опыта в автомобилях Audi», — сказал он. Чтобы активировать помощника, надо сказать «Hey Audi» или нажать кнопку push-to-talk на рулевом колесе. В зависимости от вопроса или команды, ИИ-помощник определит, что именно он должен сделать. Если система не может справится с заданием, она перенаправит его ChatGPT. В будущем также станет возможным задавать вопросы о техническом состоянии автомобиля, например, о давлении в шинах. Компания Audi стремится шагать со временем в ногу и максимально использовать потенциал искусственного интеллекта, предлагая услуги и продукты для улучшения пользовательского взаимодействия с автомобилем, а также в бизнес-процессах. В частности, ИИ используется для решений, касающихся дизайна интерьера, поддержки контроля качества в производстве. Компания заявляет, что также привержена ответственному использованию ИИ в соответствии с принципами этики и регламента ЕС, касающегося искусственного интеллекта, а её сотрудники проходят обучение для использования ИИ в соответствии с современными стандартами и с учётом будущих потребностей. SK hynix представила оптимизированный для ИИ твёрдотельный накопитель PCB01 с PCIe 5.0 и скоростью до 14 Гбайт/с

28.06.2024 [23:10],

Николай Хижняк

Компания SK hynix представила NVMe-накопитель PCB01 стандарта PCIe 5.0. Новинка близка по характеристикам к потребительской модели Platinum P51. Производитель говорит, что новинка оптимизирована для задач, связанных с работой ИИ и больших языковых моделей (LLM).

Источник изображения: SK hynix Для PCB01 заявляется скорость последовательного чтения и записи на уровне 14 и 12 Гбайт/с соответственно. В SSD используется кеш-память SLC, повышающая его производительность при пакетных рабочих нагрузках. Производитель также отмечает, что накопитель на 30 % энергоэффективнее предшественников и при этом обеспечивает вдвое больший показатель пропускной способности. SK hynix позиционирует этот SSD как решение, оптимизированное для рабочих нагрузок искусственного интеллекта. Заявлено, что PCB01 способен загружать большую языковую модель (LLM) в системную память (DRAM) менее чем за одну секунду, что помогает повысить производительность чат-ботов на базе искусственного интеллекта, работающих локально в хост-системе SSD. «PCB01 выделяется не только оптимизированной архитектурой для ПК с искусственным интеллектом, этот продукт также получит большое внимание на рынке игровых и высокопроизводительных систем», — уверен Джэ Юн Юн (Jae-Yeun Yunn), глава отдела планирования и внедрения продуктов NAND в SK hynix. Подробные характеристики SSD компания не сообщает. Отмечается, что в PCB01 используется технология защиты ROT (root of trust), защищающая от внешних кибератак, а также замены записанной информации. Baidu анонсировала мощную ИИ-модель Ernie 4.0 Turbo и похвасталась 300 миллионами пользователей

28.06.2024 [18:23],

Павел Котов

Китайский поисковый гигант Baidu анонсировал обновлённую версию своей модели искусственного интеллекта Ernie 4.0 Turbo — она поможет компании удержать свои позиции на китайском рынке ИИ, где царит жёсткая конкуренция.

Источник изображения: baidu.com Предыдущая, базовая версия Ernie 4.0 была представлена в октябре прошлого года — тогда компания заявила, что по некоторым аспектам она превосходит считающуюся эталонной OpenAI GPT-4. Новая Ernie 4.0 Turbo будет доступна общественности через веб-интерфейс и мобильные приложения, а разработчики смогут интегрировать её в свои решения через платформу Baidu Qianfan, заявил технический директор компании Ван Хайфэн (Wang Haifeng) на презентации. Топ-менеджер сообщил, что с момента запуска аудитория Ernie достигла 300 млн пользователей. Baidu также объявила об обновлении своей ИИ-экосистемы PaddlePaddle, которая теперь поддерживает 14,65 млн разработчиков и обслуживает 370 тыс. предприятий и учреждений. Ранее стало известно, что OpenAI намеревается с 9 июля заблокировать доступ к своему API из Китая. Это решение затронет многочисленные китайские стартапы, которые используют решения американской компании. В ответ на это Baidu, Alibaba и другие компании из Китая запустили программы миграции, предлагая бесплатные услуги по переносу проектов и стимулы. «Сбер» запустил GigaChek — детектор текстов, написанных ИИ

28.06.2024 [12:05],

Павел Котов

«Сбер» представил технологию GigaChek, которая помогает определять происхождение текста: был ли он написан человеком или сгенерирован искусственным интеллектом. Опробовать решение можно в демо-версии службы на сайте или через чат-бот в Telegram.

Источник изображения: sber.ru Сервис, помогающий определить происхождение текста, окажется полезным при проверке дипломов, диссертаций и других научных работ; им смогут пользоваться редакторы, которые принимают работу копирайтеров и писателей; а владельцы пабликов смогут выявить написанные нейросетями комментарии. Пока текст оценивается на основе контента, который в нём преобладает. В перспективе технология будет усовершенствована и позволит осуществлять интервальный поиск — такая возможность должна появиться в обозримом будущем. «Задача нашей технологии — иметь такой уровень качества работы, что для обхода текст придётся исказить до степени неприменимости в реальных задачах. Например, диплом с разбросанными символами „;“ просто не пройдёт нормоконтроль, а такой комментарий в паблике сразу будет выделяться», — рассказали в «Сбере». Когда новый сервис будет официально запущен, компания подготовит инструменты API, которые помогут интегрировать технологию. Google анонсировала ИИ для корпоративных клиентов — он менее склонен фантазировать

28.06.2024 [11:49],

Павел Котов

Входящая в Google Cloud платформа Vertex AI, которая позволяет корпоративным клиентам создавать собственные службы с использованием машинного обучения и больших языковых моделей Google, получила новые возможности, направленные на предотвращение распространения неверной информации.

Источник изображения: cloud.google.com В мае для всех клиентов была развёрнута функция Vertex AI Grounding with Google Search — она предоставляет моделям ИИ доступ к информации из интернета в реальном времени. Теперь же клиенты облачной платформы смогут дополнительно улучшить результаты своих сервисов ИИ с помощью специализированных сторонних наборов данных. Сервис будет пользоваться информацией от таких поставщиков как Moody’s, MSCI, Thomson Reuters и ZoomInfo, сообщила Google, и воспользоваться этой услугой компании смогут «в III квартале этого года». Это лишь одна разрабатываемых Google функций, призванных побудить организации начать развёртывание собственных корпоративных ИИ моделей в её инфраструктуре — все они направлены на снижение частоты недостоверных данных в ответах систем. Ещё одна функция — «режим высокой точности», позволяющий организациям подключать к моделям собственные наборы данных вместо обширной базы знаний Google Gemini. Этот режим работает на основе спецверсии модели Gemini 1.5 Flash, и его можно подключить через раздел экспериментальных функций Vertex AI. Корпоративные клиенты также смогут осуществлять гибридный поиск, используя в качестве запросов образцы изображений и текстовые пояснения к ним. А в Grounding with Google Search вскоре будет доступен динамический поиск — система сможет автоматически выбирать источники информации: установленные наборы данных Gemini или Google Search, если предполагается частое обновление ресурсов. Возможность контролировать наборы данных для ИИ-моделей Google поможет компании улучшить репутацию, которая пострадала после внедрения ИИ в поисковую систему. Если потребители с юмором восприняли советы есть камни и добавлять клей в пиццу, то корпоративным клиентам такие ошибки могут обойтись дорого. Опытный разработчик чипов из Apple присоединился к стартапу Rain AI, который поддерживает Сэм Альтман

28.06.2024 [11:48],

Алексей Разин

Один из основателей и генеральный директор OpenAI Сэм Альтман (Sam Altman) давно грезит выпуском собственных ускорителей вычислений, а потому поддерживает стартап Rain AI, обещающий разработать соответствующие чипы. Недавно штат этого стартапа обогатился опытным разработчиком, который помогал создавать Apple собственные процессоры, заменившие продукцию Intel.

Источник изображения: Rain AI Речь идёт о Жане-Дидье Аллегруччи (Jean-Didier Allegrucci), который участвовал в разработке нескольких поколений собственных процессоров Apple и проработал в штате компании около семнадцати лет, а его общий стаж в отрасли превышает 30 лет. Недавно он был принят на работу в Rain AI, чтобы под руководством выходца из Meta✴✴ Амина Фирузшахяна (Amin Firoozshahian) создать более энергоэффективные процессоры для ускорителей вычислений по сравнению с уже имеющимися аналогами конкурентов. Фирузшахян перешёл в Rain AI после пяти лет работы в Meta✴✴ Platforms. Жан-Дидье Аллегруччи возглавит в Rain AI подразделение разработок аппаратного обеспечения. Rain AI изучает возможность создания чипов, которые позволяли бы часть вычислений проводить на стороне микросхем памяти, подражая устройству головного мозга человека. Подобные разработки уже ведутся компаниями Intel, Samsung и TSMC, поэтому Rain AI не будет одинок в этой инициативе. По замыслу разработчиков, в конечном итоге более энергоэффективные чипы позволят распространить искусственный интеллект на большее количество устройств, и вычисления не нужно будет концентрировать в центрах обработки данных. Новая модель OpenAI CriticGPT обучена «критиковать» результаты GPT-4

28.06.2024 [05:44],

Анжелла Марина

Компания OpenAI представила CriticGPT — новую модель искусственного интеллекта, предназначенную для выявления ошибок в коде, сгенерированном непосредственно ChatGPT. CriticGPT будет использоваться в качестве алгоритмического помощника для тестировщиков, которые проверяют программный код, выданный ChatGPT.

Источник изображения: Copilot Согласно новому исследованию «LLM Critics Help Catch LLM Bugs», опубликованному OpenAI, новая модель CriticGPT создана как ИИ-ассистент для экспертов-тестировщиков, проверяющих программный код, сгенерированный ChatGPT. CriticGPT, основанный на семействе большой языковой модели (LLM) GPT-4, анализирует код и указывает на потенциальные ошибки, облегчая специалистам обнаружение недочётов, которые в противном случае могли бы остаться незамеченными из-за человеческого фактора. Исследователи обучили CriticGPT на наборе данных с образцами кода, содержащими намеренно внесённые ошибки, научив его распознавать и отмечать различные погрешности. Учёные обнаружили, что в 63-% случаев, связанных с естественно возникающими ошибками LLM, аннотаторы предпочитали критику CriticGPT человеческой. Кроме того, команды, использующие CriticGPT, писали более полные отзывы, чем люди, не использующие этого ИИ-помощника, при этом снижался уровень конфабуляций (ложных фактов и галлюцинаций). Разработка автоматизированного «критика» включала обучение модели на большом количестве входных данных с намеренно внесёнными ошибками. Экспертов просили модифицировать код, написанный ChatGPT, внося ошибки, а затем предоставлять результат с якобы обнаруженными багами. Этот процесс позволил модели научиться выявлять и критиковать различные типы ошибок в коде. В экспериментах CriticGPT продемонстрировал способность улавливать как внесённые баги, так и естественно возникающие ошибки в результатах ответов ChatGPT. Исследователи также создали новый метод «Force Sampling Beam Search» (FSBS), который помогает CriticGPT писать более детальные обзоры кода, позволяя регулировать тщательность поиска проблем и одновременно контролируя частоту ложных срабатываний. Интересно, что возможности CriticGPT выходят за рамки простой проверки кода. В экспериментах модель применили к множеству тренировочных данных ChatGPT, ранее оцененных людьми как безупречные. Удивительно, но CriticGPT выявил ошибки в 24-% случаев, которые впоследствии были подтверждены экспертами. OpenAI считает, что это демонстрирует потенциал модели не только для работы с техническими задачами, но и подчёркивает её способность улавливать тонкие ошибки, которые могут ускользнуть даже от тщательной проверки человеком. Несмотря на многообещающие результаты, CriticGPT, как и все ИИ-модели, имеет ограничения. Модель обучалась на относительно коротких ответах ChatGPT, что может не полностью подготовить её к оценке более длинных и сложных задач, с которыми могут столкнуться будущие ИИ-системы. Команда исследователей признаёт, что модель наиболее эффективна в обнаружении ошибок, которые могут быть определены в одном конкретном, узком месте кода. Однако реальные ошибки в выводе AI могут часто быть разбросаны по нескольким частям ответа, что представляет собой вызов для будущих итераций модели. Кроме того, хотя CriticGPT снижает уровень конфабуляций, он не устраняет их полностью, и люди-эксперты по-прежнему могут совершать ошибки на основе этих ложных данных. Instagram✴ позволил некоторым авторам создавать ИИ-версии самих себя — в будущем такую возможность могут получить все

28.06.2024 [00:45],

Анжелла Марина

Генеральный директор Meta✴✴ Марк Цукерберг (Mark Zuckerberg) объявил, что компания начинает тестирование ИИ-аватаров в Instagram✴✴, созданных пользователями с помощью инструмента Meta✴✴ AI Studio. Первоначально ИИ-аватары будут отображаться в основном в сообщениях и будут обозначены ярлыком «AI».

Источник изображения: Meta✴✴ В рамках теста в ближайшие недели подписчики известных каналов смогут пообщаться со своими кумирами через их ИИ-аватары, которые фактически являются ИИ-чат-ботами. Отмечается, что в будущем любой пользователь или компания сможет создать на платформе собственного чат-бота для взаимодействия со своим сообществом и клиентами. Эта инновационная функция поможет не оставить без внимания ни одного сообщения от поклонников, тогда как физически отвечать на все входящие сообщения просто невозможно. Со временем такие ИИ-персонажи станут более совершенными и даже могут стать своего рода искусством, считает Цукерберг. Изначально в тестировании примут участие примерно 50 создателей контента и небольшой процент обычных пользователей. Затем Meta✴✴ развернёт эту функцию для большего количества людей в течение следующих нескольких месяцев, что произойдёт примерно в августе. Цукерберг подчеркнул, что это не просто расширение функционала, это новый уровень взаимодействия, позволяющий установить более тесную связь с аудиторией и клиентами через персонализированных чат-ботов на базе искусственного интеллекта. Конечной целью является разработка различных API-интерфейсов, отражающих разнообразие интересов людей, и возможность адаптировать ИИ-аватары под личные нужды. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |