|

Опрос

|

реклама

Быстрый переход

Apple делает ставку на локальные вычисления в работе с большими языковыми моделями

22.04.2024 [07:11],

Алексей Разин

В минувшие выходные известный колумнист Bloomberg Марк Гурман (Mark Gurman) не только предавался рассуждениям о том, почему Apple очень нужен новый смартфон за $250, но и поведал о подходе компании к интеграции в свои устройства функций искусственного интеллекта. По его словам, компания пытается значительную часть вычислений поручить локальным компонентам пользовательских устройств.

Источник изображения: Unsplash, Gilles Lambert Другими словами, если речь идёт о смартфонах марки, то некий нейронный процессор внутри iPhone должен будет осуществлять локальные вычисления при обработке запросов, в меньшей степени полагаясь на обмен информацией с облачной инфраструктурой. Такой подход позволит ускорить отклик системы на поступающие запросы, а для пользователя это станет видимым преимуществом. Кроме того, локальная обработка чувствительной информации повысит степень информационной защищённости. При этом, как утверждает представитель Bloomberg, компания Apple не отметает окончательно идею использования сторонних больших языковых моделей, которые предлагаются Google или Microsoft. Собственную языковую модель Apple тоже разрабатывает, но ориентирует её именно на использование локальных вычислительных ресурсов. Подробности об этой концепции Apple могут быть оглашены уже в середине июня на конференции для разработчиков WWDC 2024, как поясняет источник. Попытка Маска судиться с OpenAI — пример «исторического ревизионизма», считают юристы компании

22.04.2024 [05:02],

Алексей Разин

На этой неделе в Сан-Франциско должно состояться заседание суда, на котором представители интересов OpenAI попытаются обжаловать иск Илона Маска (Elon Musk), обвиняющий эту некоммерческую организацию в отказе от своих принципов. Представители ответчика утверждают, что Маск передёргивает факты и строит свои обвинения на несуществующих юридически положениях.

Источник изображения: OpenAI По словам представителей OpenAI, на которые ссылается Bloomberg, упрёки Илона Маска в отказе организации от своих альтруистических принципов базируются на ложных утверждениях, являются ни чем иным, как «историческим ревизионизмом», и направлены на продвижение собственного конкурирующего стартапа. Иск Илона Маска к OpenAI был подан в марте, и одним из пунктов обвинения было вступление стартапа в партнёрство с Microsoft. Представители ответчика сообщают, что несколько лет назад сам Маск покинул OpenAI после неудачной попытки установить в организации своё доминирование, но после запуска собственной компании в сфере искусственного интеллекта пытается использовать успех OpenAI в собственных коммерческих интересах. В документах, определяющих сферу и принципы деятельности OpenAI, как утверждают юристы, нет положений, запрещающих ей монетизировать собственные технологии, а потому упрёки Илона Маска в нарушении принципов некоммерческого распространения ПО не являются состоятельными. Свидетельство о регистрации организации, на которое ссылается Маск, не содержит обязательств по непременному распространению открытого кода своих разработок для всеобщего блага. Формулировка подразумевает, что руководство OpenAI в ходе обсуждения должно определять, какую часть ПО сделать открытой, а какую нет. Илону Маску, по мнению стороны ответчика, также не удастся доказать, что OpenAI не имеет права лицензировать свою технологию сторонним компаниям (а именно Microsoft), а также предоставлять им наблюдательное место в совете директоров. Впрочем, промежуточный исход спора двух субъектов может стать понятен уже в середине этой недели, когда состоится судебное заседание. ИИ-стартап Stability AI сократит 10 % персонала из-за усиления конкуренции

19.04.2024 [14:41],

Владимир Мироненко

Спустя несколько недель после скандального ухода основателя и гендиректора Эмада Мостака (Emad Mostaque), стартап Stability AI объявил об увольнении части сотрудников в рамках проводимой реструктуризации, пишет агентство Reuters со ссылкой на электронное письмо, разосланное сотрудникам содиректорами Шань Шань Вонгом (Shan Shan Wong) и Кристианом Лафорте (Christian Laforte).

Источник изображения: Stability AI Увольнению подлежат 20 человек, что составляет 10 % персонала компании. «Те, кого это затронет, будут уведомлены индивидуально, и мы будем поддерживать их на протяжении всего этого периода», — говорится в электронном письме. Данный шаг объясняется необходимостью сокращения затрат на фоне ужесточения конкуренции на рынке ИИ со стороны таких компаний, как OpenAI и Mistral. Сотрудники, которых уже коснулось сокращение, в основном занимались операционной деятельностью и были уведомлены о своих увольнениях, сообщил источник ресурсу CNBC на условиях анонимности. Согласно данным Crunchbase и Pitchbook, в число инвесторов Stability AI, разработавшего ИИ-генератор изображений Stable Diffusion, входят венчурный фонд Lightspeed Venture Partners, компания Sound Ventures актёра Эштона Катчера (Ashton Kutcher), фирма по управлению инвестициями Coatue и корпорация Intel, инвестировавшая в стартап сотни миллионов долларов США. В прошлом месяце Stability AI объявила, что Мостак покидает компанию, чтобы «заниматься децентрализованным ИИ». Его уход последовал за публикациями СМИ, ставящими под сомнение полномочия гендиректора. В июне 2023 года Forbes сообщил, что Мостак ввёл в заблуждение общественность, в том числе инвесторов, относительно получения степени магистра в Оксфордском университете, а также о характере партнёрства с Amazon. Stability AI охарактеризовала сделку с Amazon как стратегическую, хотя она представляла собой не что иное, как стандартный договор аренды облачной инфраструктуры. У GPT-4 обнаружили способность эксплуатировать уязвимости по их описаниям

19.04.2024 [13:36],

Павел Котов

Современные технологии искусственного интеллекта могут помочь хакерам автоматизировать эксплуатацию общедоступных уязвимостей за считанные минуты. Это значит, что в ближайшем будущем оперативное обновление ПО станет как минимум насущной необходимостью.

Источник изображения: Tung Nguyen / pixabay.com Системы ИИ на базе нейросети OpenAI GPT-4 способны создавать эксплойты для большинства уязвимостей на основе простого изучения информации о них в интернете, гласят результаты нового исследования (PDF) учёных Иллинойского университета в Урбане-Шампейне (США). До настоящего момента злоумышленники применяли большие языковые модели для написания фишинговых писем и вредоносных программ с базовыми возможностями. Теперь же, располагая доступом к GPT-4 и открытым фреймворкам для упаковки программных решений, они могут автоматизировать написание эксплойтов к уязвимостям, как только информация об этих уязвимостях попадает в открытый доступ. Для проверки гипотезы учёные подготовили набор инструментов из следующих компонентов: базовой нейросети, средства создания запросов к ней, фреймворка (в данном случае это был инструмент ReAct фреймворка LangChain), а также терминала и интерпретатора кода. Укомплектованный таким образом агент был протестирован на 15 известных уязвимостях ПО с открытым исходным кодом. Среди них были ошибки, застрагивающие веб-сайты, контейнеры и пакеты Python. Восемь из них имели «высокий» или «критический» рейтинг CVE. Одиннадцать были раскрыты уже после момента обучения GPT-4, то есть ИИ познакомился с ними впервые. Системе было поручено поочерёдно разработать эксплойты для каждой уязвимости, изучив их описания. Результаты эксперимента оказались неутешительными.

Источник изображения: D koi / unsplash.com Всего были оценены десять ИИ-моделей, включая OpenAI GPT-3.5, Meta✴✴ Llama 2, и девять из них не смогли взломать ни один из уязвимых продуктов. А вот нейросеть GPT-4 предложила 13 эффективных эксплойтов или 87 % от общего числа известных уязвимостей. Две неудачи, которые потерпела GPT-4, имеют простые объяснения. Уязвимость CVE-2024-25640 (рейтинг 4,6 из 10) относится к платформе реагирования на инциденты Iris, и модель просто не смогла разобраться с навигацией в приложении. Неудача с эксплуатацией уязвимости CVE-2023-51653 («критический» рейтинг 9,8 из 10) в инструменте мониторинга Hertzbeat возникла из-за того, что описание этой уязвимости было приведено на китайском языке. В свете результатов своего исследования учёные сделали вывод, что вопросы кибербезопасности сегодня становятся актуальными как никогда: администраторам в компаниях скоро нельзя будет ожидать выхода исправляющих уязвимости патчей, а использовать для защиты систем те же технологии ИИ, что и вероятный противник. Впрочем, в этом ИИ пока недостаточно хорош, выяснили эксперты компании Endor Labs — они провели эксперимент, поручив нескольким моделям ИИ изучить ряд проектов с открытым исходным кодом на предмет того, являются ли соответствующие продукты вредоносными или безопасными. GPT-4 снова оказалась лучше прочих: она преимущественно верно объяснила принципы работы кода, но, как и её «коллеги», дала несколько ложноположительных и ложноотрицательных срабатываний в оценке его безопасности. В частности, она назвала добросовестно оптимизированный код намеренно обфусцированным, то есть запутанным. Истребители под управлением ИИ и живого человека впервые сошлись в учебном воздушном бою в США

19.04.2024 [11:56],

Геннадий Детинич

По сообщению DARPA, в небе над США впервые состоялся учебный воздушный бой между двумя истребителями, одним из которых управлял пилот, а второй находился под контролем искусственного интеллекта. Кто из них вышел из схватки победителем, не уточняется, но испытания уже назвали прорывом в средствах ведения воздушного боя.

Vista X-62A. Источник изображения: Lockheed Martin Программу тренировки ИИ для ведения воздушного боя в зоне визуального контакта с противником агентство DARPA запустило ещё в 2019 году. Это проект Air Combat Evolution (ACE, эволюция воздушного боя). Программа ACE стала частью глобальной программы Министерства обороны США, а именно — ведение мозаичной войны (mosaic warfare). Концепция мозаичной войны предполагает слаженные пилотируемые, полуавтоматические и автоматические действия управляемых пилотами и беспилотных воздушных боевых платформ. Пилоты должны из тактиков стать стратегами, чтобы планировать бой в целом, тогда как беспилотные платформы займутся «чудесами на виражах».  Первый бой между ИИ и пилотом состоялся в 2021 году на симуляторе. Машинный интеллект превзошёл опытного лётчика, выиграв у него практически все бои. В качестве пилота боевого истребителя F-16 — в виде испытательной платформы VISTA X-62A — ИИ осуществил первые полёты в начале 2023 года, проведя в воздухе (под надзором инструктора в кабине) 17 часов. Наконец, в сентябре 2023 года, как на днях сообщили в DARPA, оснащённый ИИ истребитель VISTA X-62A в небе над авиабазой США «Эдвардс» сошёлся в ближнем бою с другим самолётом F-16, пилотируемым лётчиками. В кабине VISTA X-62A также был инструктор, но он не прикасался к рычагам управления. По словам ответственных за программу лиц, ИИ уверенно выстроил как порядок оборонительных манёвров, так и наступательных. В ходе учебного боя истребители с ИИ и человеком сошлись буквально лицом к лицу, проведя манёвр сближения до 600 м на скорости около 2000 км/ч. Это был «трансформирующий» опыт, заявили в DARPA и пообещали развить проект ACE до ещё более впечатляющего результата. Meta✴ бросила вызов ChatGPT — все сервисы компании получили «самого умного» ИИ-помощника

18.04.2024 [23:30],

Владимир Чижевский

Сегодня Meta✴✴ представила не только новое поколение собственных языковых моделей Llama 3, но и подключила их к поисковым строкам своих основных приложений — Facebook✴✴, Messenger, Instagram✴✴ и WhatsApp, пусть и не во всех странах. Кроме того, компания запустила отдельный сайт для своего чат-бота, meta✴✴.ai.

Источник изображения: Meta✴✴ Meta✴✴ стремится не отставать, а то и превзойти конкурирующие продукты вроде ChatGPT от OpenAI, Gemini от Google и Claude от Anthropic, с которыми сегодня и сравнивала новое семейство больших языковых моделей Llama 3. Более того, Марк Цукерберг (Mark Zuckerberg) заявил, что Meta✴✴ AI «самый интеллектуальный ИИ-помощник из доступных для свободного пользователя». Meta✴✴ AI запустили ещё в прошлом году, и он по-прежнему поддерживает лишь английский язык, однако работает во многих странах, включая Австралию, Канаду, Гану, Ямайку, Малави, Новую Зеландию, Нигерию, Пакистан, Сингапур, Южную Африку, Уганду, Замбию и Зимбабве. Среди новых функций Meta✴✴ AI — возможность попросить ИИ найти определённую информацию в Google и Bing. Разработчики не просто ускорили генерацию изображений с помощью Meta✴✴ AI, но и наделили ИИ возможностью анимировать картинки, а также улучшили функцию размещения текста на генерируемых изображениях. Стремясь как можно сильнее расширить присутствие ИИ в своих продуктах, Meta✴✴ добавила его не только в поисковые строки, но и в индивидуальные и групповые чаты, и даже в ленты приложений. Например, увидев в ленте Facebook✴✴ фотографию северного сияния можно спросить ИИ, когда лучше отправиться в Исландию, чтобы наблюдать его своими глазами. Помимо этого, Meta✴✴ AI добавили в умные очки Ray-Ban, вскоре он появится и в VR-гарнитуре Meta✴✴ Quest. Meta✴ добавила ИИ-генерацию изображений в реальном времени в WhatsApp — пока в тестовом режиме

18.04.2024 [22:57],

Николай Хижняк

Компания Meta✴✴ начала тестировать в мессенджере WhatsApp генератор изображений Meta✴✴ AI на базе искусственного интеллекта. Пока новая функция доступно только пользователям из США. Она работает в режиме реального времени: как только пользователь начинает добавлять в запрос детали для создания картинки, он сразу же видит, как изображение меняется в соответствии с указанными деталями.

Источник изображения: pexels.com В примере, предоставленном Meta✴✴, пользователь составляет запрос: «Представь игру в футбол на Марсе» (Imagine a soccer game on mars). С каждым написанным словом ИИ добавляет новые детали в генерируемое изображения, сначала показывая обычных игроков в футбол на обычном поле, а затем меняет его на пейзаж Марса. Пользователи, получившие доступ к бета-версии ИИ-генератора изображения в WhatsApp, могут попробовать новую функцию сами. Запрос необходимо делать на английском языке, начиная со слова «Imagine». Компания Meta✴✴ также сообщила, что её языковая модель Llama 3, на которой построен ИИ-генератор, способна создавать «более чёткие и качественные» изображения и лучше отображать текст. Пользователи также могут делать для Meta✴✴ AI запрос для анимации любого предоставленного ими изображения. ИИ сгенерирует из статичной картинки GIF-изображение, которым можно будет поделиться с друзьями. Помимо мобильного приложения WhatsApp, функция ИИ-генерации изображений в реальном времени также стала доступна для пользователей веб-версии платформы Meta✴✴ AI, но пока тоже только из США. Поисковик Brave научился отвечать на вопросы с помощью ИИ

18.04.2024 [22:49],

Владимир Чижевский

Ориентированная на конфиденциальность поисковая система Brave объявила о том, что расширила функциональность своей системы ответов на запросы пользователей с помощью искусственного интеллекта.

Источник изображения: Brave Обновлённая функция «Ответ ИИ» позволяет получить сформулированный ответ на тот или иной вопрос, узнать мнение пользователей о продукте или ключевые особенности заведения. Впервые возможность получить ответ от ИИ в поисковой системе Brave появилась в марте 2023 года. По словам компании, объявленное вчера обновление стало большим шагом вперёд в развитии функции. «Ответ ИИ» использует большие языковые модели (LLM) Mistral 8x7B и Mistral 7B, собственные модели семантического сопоставления и данные из поискового индекса. «От пользователя требуется лишь ввести запрос как он привык с обычной поисковой системе. Запрос будет преобразован в подсказку LLM, а данные из поискового индекса послужат контекстом», — прокомментировал анонс глава поискового отдела Brave Жозеп Пуйоль (Josep Pujol). В отличие от «Яндекса», в компании не уверены, что поиск с помощью ИИ не нанесёт вреда создателям контента. «Это проблема не только Brave Search, но и большинства чат-ботов и основанных на ИИ поисковых движков. Мы знаем о ней, поэтому, будучи разработчиками браузера и поисковой системы, будем отслеживать и оценивать влияние создаваемого ИИ контента на посещаемость сайтов и постараемся не допустить падения их трафика», — заявили в Brave. Meta✴ представила нейросеть Llama 3 — «самую способную открытую LLM на сегодняшний день»

18.04.2024 [21:27],

Владимир Чижевский

Meta✴✴ представила Llama 3 — большую языковую модель нового поколения, которую без лишней скромности называет «самой способной LLM с открытым исходным кодом». Компания выпустила две версии: Llama 3 8B и Llama 3 70B соответственно с 8 и 70 миллиардами параметров. По словам компании, новые ИИ-модели значительно превосходят соответствующие модели прошлого поколения и являются одними из лучших моделей для генеративного ИИ из ныне существующих.

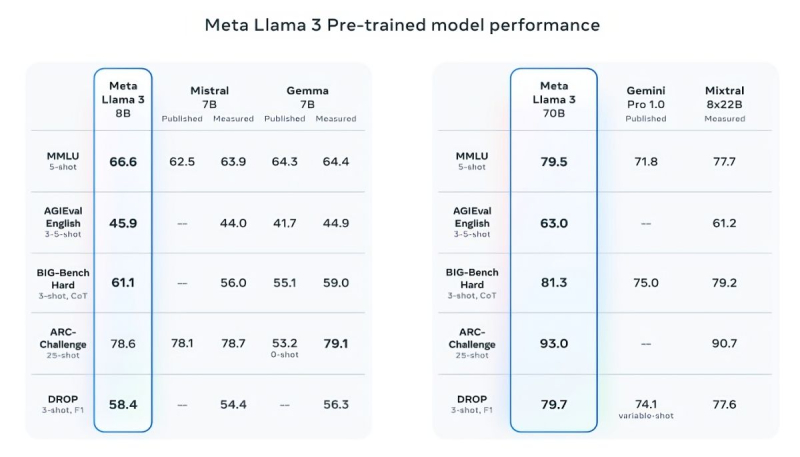

Источник изображения: vecstock / freepik.com В подтверждение своих слов Meta✴✴ приводит результаты популярных тестов MMLU (знания), ARC (способность к обучению) и DROP (анализ фрагментов текста). Llama 3 8B превосходит другие модели своего класса с открытым исходным кодом, такие как Mistral 7B от Mistral и Gemma 7B от Google с 7 миллиардами параметров, по крайней мере в девяти тестах: MMLU, ARC, DROP, GPQA (вопросы по биологии, физике и химии), HumanEval (тест на генерацию кода), GSM-8K (математические задачи), MATH (ещё один математический тест), AGIEval (набор тестов на решение задач) и BIG-Bench Hard (оценка рассуждений на основе здравого смысла).

Источник изображений: Meta✴✴ Mistral 7B и Gemma 7B уже не назвать современными, при этом в некоторых тестах Llama 3 8B не показывает значимого превосходства над ними. Однако куда сильнее Meta✴✴ гордится более продвинутой моделью, Llama 3 70B, которую ставит в один ряд с другими флагманскими моделями для генеративных ИИ, включая Gemini 1.5 Pro — самую продвинутую в линейке Gemini от Google. Llama 3 70B опережает Gemini 1.5 Pro в тестах MMLU, HumanEval и GSM-8K, но уступает передовой модели Claude 3 Opus от Anthropic, превосходя лишь слабейшую модель серии, Sonnet, в пяти тестах: MMLU, GPQA, HumanEval, GSM-8K и MATH. Meta✴✴ также разработала собственный набор тестов, от написания текстов и кода до обобщений и выводов, в котором Llama 3 70B обошла Mistral Medium, GPT-3.5 от OpenAI и Claude Sonnet от Anthropic. По словам Meta✴✴, новые модели более «управляемы», реже отказываются отвечать на вопросы и в целом выдают более точную информацию, в том числе в некоторых научных областях, что, вероятно, обосновано огромным количеством данных, использованных для их обучения: 15 триллионов токенов и 750 миллиардов слов, что в семь раз больше, чем в случае с Llama 2. Откуда столько данных? Meta✴✴ ограничилась заверением, что все они взяты из «общедоступных источников». При этом в наборе данных для обучения Llama 3 содержалось в четыре раза больше кода в сравнении с использованным для Llama 2, а 5 % набора составляли данные на 30 отличных от английского языках, чтобы улучшить работу с ними. Кроме того, использовались синтетические данные, то есть полученные от других ИИ-моделей. «Наши текущие ИИ-модели настроены отвечать лишь на английском, но мы обучаем их с использованием данных на других языках, чтобы ИИ лучше распознавал нюансы и закономерности», — прокомментировала Meta✴✴. Вопрос необходимого количества данных для дальнейшего обучения ИИ в последнее время поднимается особенно часто, и Meta✴✴ уже успела подпортить репутацию на этом поприще. Не так давно сообщалось, что Meta✴✴ в погоне за конкурентами «скармливала» ИИ защищённые авторским правом электронные книги, хотя юристы компании предупреждали о возможных последствиях. Что касается безопасности, Meta✴✴ встроила в новое поколение собственных ИИ-моделей несколько протоколов безопасности, таких как Llama Guard и CybersecEval, чтобы бороться с неправомерным использованием ИИ. Компания также выпустила специальный инструмент Code Shield для анализа безопасности кода открытых моделей генеративных ИИ, позволяющий обнаружить потенциальные уязвимости. Известно, что ранее эти же протоколы не уберегли Llama 2 от недостоверных ответов и выдачи персональной медицинской и финансовой информации. Но и это ещё не всё. Meta✴✴ обучает модель Llama 3 с 400 миллиардами параметров — она сможет разговаривать на разных языках и принимать больше входящих данных, в том числе работать с изображениями. «Мы стремимся сделать Llama 3 многоязычной и мультимодальной моделью, умеющей учитывать больше контекста. Мы также стараемся улучшить производительность и расширить возможности языковой модели в рассуждениях и написании кода», — сказали в Meta✴✴. Nothing наделит все свои наушники поддержкой ИИ-бота ChatGPT

18.04.2024 [16:40],

Николай Хижняк

Компания Nothing сообщила о планах более глубокой интеграции ИИ-бота ChatGPT со своими смартфонами и наушниками. Благодаря этому владельцы этих устройств получат быстрый доступ к данному сервису.

Источник изображения: Nothing «Благодаря новой интеграции пользователи с новейшей платформой Nothing OS и приложением ChatGPT, установленными на их смартфонах Nothing, смогут общаться с самым популярным в мире потребительским инструментом искусственного интеллекта прямо через наушники Nothing», — сообщила компания в своём официальном блоге. Новые наушники Nothing Ear (a) и Nothing Ear, представленные сегодня, также получат поддержку ChatGPT. Представитель компании в разговоре с порталом The Verge отметил, что «интеграция ChatGPT в продукты будет проходить постепенно. С 18 апреля поддержку ИИ-бота получит смартфон Phone (2). Через несколько недель такой же поддержкой обзаведутся смартфоны Phone (1) и Phone (2a)». После обновления пользователи смогут делать голосовые запросы к ChatGPT через наушники Nothing. В блоге компании также сообщается, в новую версию Nothing OS будут добавлены виджеты для запуска ChatGPT, а в меню управления скриншотами и всплывающем окне буфера обмена появилась функция, позволяющая напрямую вставить изображения в запрос для ChatGPT. ИИ научился точно определять источник рака по клеткам метастаза — это увеличит выживаемость пациентов

18.04.2024 [15:33],

Геннадий Детинич

Традиционно онкология выявляется случайно. Чем раньше это сделать, тем выше вероятность выживания пациента. Но часто источник заболевания остаётся неизвестным, а узнают о нём по появлению клеток метастаз в лимфе или других биологических жидкостях человека. Врачи научились распознавать некоторые из них, но привязка клеток метастаз к видам онкологии остаётся непростой задачей, а ИИ — это тот инструмент, который может делать это лучше.

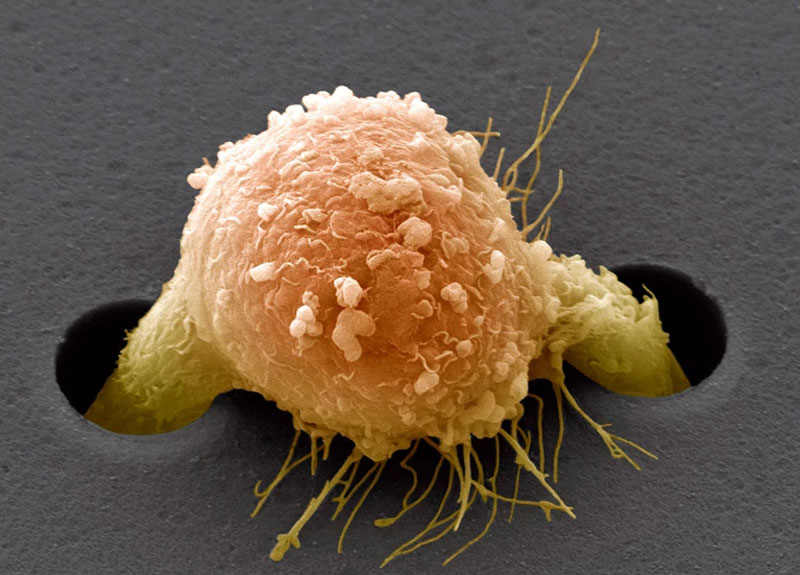

Клетка метастаз рака молочной железы. Источник изображения: Steve Gschmeissner/SPL Группа китайских учёных из Тяньцзинского университета опубликовала в журнале Nature статью, в которой поделилась собственным опытом тренировки искусственного интеллекта на распознавание типов клеток метастаз. Они взяли за основу 12 типов наиболее распространённой онкологии, которые сопровождаются выбросом раковых клеток в лёгочную жидкость и жидкость брюшной полости, включая рак лёгких, яичников, молочной железы и желудка. Некоторые другие формы рака, в том числе те, которые возникают в предстательной железе и почках, включить в исследование не удалось, поскольку они обычно не сопровождаются выбросом клеток метастаз в биологические жидкости человека. По словам учёных, каждый год из 300 тыс. больных раком пациентов, которые проходят лечение в больнице при университете, около 4000 случаев диагностируются с помощью изучения изображений клеток метастаз врачами, но около 300 человек остаются без выявления источника онкологии и их судьба печальна. Против рака нет универсального метода лечения — оно своё для каждого случая, поэтому выживаемость среди больных без диагноза самая низкая. Исследователи обучили свою ИИ-модель примерно на 30 тыс. изображениях клеток метастаз, обнаруженных в брюшной полости или лёгочной жидкости у 21 тыс. человек, происхождение опухоли у которых было известно. Затем они протестировали свою модель на 27 тыс. снимках образцов клеток метастаз и обнаружили 83-процентное распознавание источника онкологии. Более того, первые три отобранные искусственным интеллектом кандидата на источник клеток метастаз попали в яблочко с точностью 99 %, а ведь появление метастаз — это сигнал о достаточно запущенной онкологии и промедление с диагностированием недопустимо. Наконец, в процессе анализа примерно 500 изображений ИИ оказался лучшим прогнозистом, чем опытные врачи. Также была проверена группа из 391 пациента, четыре года назад получившая лечение в соответствии с прогнозом ИИ и прогнозами врачей. Оказалось, что если курс лечения соответствовал прогнозу ИИ, то выживаемость пациентов была выше, а если врачи не брали в расчёт прогноз ИИ, то ниже. В сочетании с другими методами диагностики онкологических заболеваний, считают исследователи, использование ИИ для распознавания источников опухолей по идентификации клеток метастаз обещает значительно повысить вероятность лечения этого смертельного недуга. Еврокомиссия не нашла ничего предосудительного в отношениях Microsoft и OpenAI

17.04.2024 [22:54],

Владимир Чижевский

Европейская комиссия сообщила, что не станет расследовать инвестиции Microsoft в размере $13 млрд в компанию OpenAI, поскольку последняя не подчиняется Microsoft напрямую и вряд ли будет поглощена редмондской компанией. В январе европейские антимонопольщики заявили, что могут начать расследование отношений Microsoft и OpenAI.

Источник изображения: efes / pixabay.com Партнёрство Microsoft и OpenAI во многом обусловлено нарастающими потребностями в вычислительной мощности, необходимой для дальнейшего развития и использования генеративных ИИ. Запуск ИИ-моделей вроде ChatGPT и Google Bard привёл к резкому росту спроса на облачные сервисы и вычислительные мощности, а OpenAI стала одним из крупнейших клиентов облачного бизнеса Microsoft. Кроме того, все мировые поставщики облачных вычислений — Microsoft, Amazon и Google — в последнее время активно инвестируют в ИИ. Так, разрабатывающая семейство чат-ботов Claude компания Anthropic получила $4 млрд инвестиций от Amazon и $2 млрд от Google. Логично, что и Microsoft стремится не отстать от конкурентов — ранее в этом году компания вложила $16 млрд в французскую Mistral AI. Однако именно инвестиции в OpenAI привлекли внимание антимонопольщиков. И не только в ЕС — интерес к сделке проявили Управление по конкуренции и рынкам Великобритании и Федеральная торговая комиссия США, особенно после скандала с увольнением и повторным наймом Сэма Альтмана (Sam Altman). Сама Microsoft отказалась от комментариев, процитировав раннее заявление, что партнёрство с OpenAI «способствовало новаторскому развитию в области ИИ с сохранением независимости обеих компаний». Stability AI расширила доступ к тестированию Stable Diffusion третьего поколения

17.04.2024 [22:42],

Владимир Чижевский

Следующее поколение генерирующей изображения по текстовой подсказке ИИ-модели Stable Diffusion пока не запущено публично, но уже доступно некоторым разработчикам через API и новую платформу для создания контента, а также платформу для разработчиков. Для организации доступа к ИИ по API Stability AI объединила усилия с API-платформой Fireworks AI.

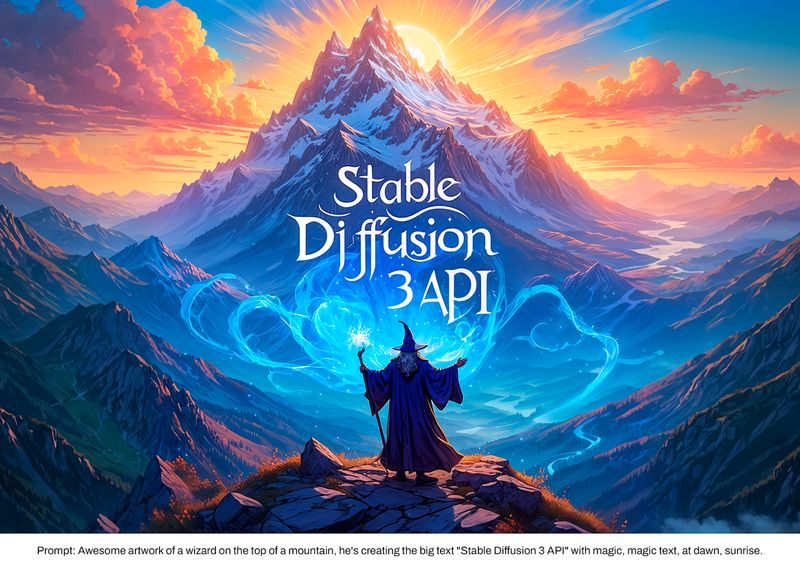

Источник изображения: Stability AI ИИ-модель Stable Diffusion 3 доступна для тестирования небольшому кругу разработчиков ещё с февраля 2024 года. По словам разработчиков, новое поколение Stable Diffusion «не уступает, либо превосходит» другие подобные модели, вроде DALL-E 3 от OpenAI и Midjourney «в понимании и соблюдении запросов». Stable Diffusion 3 использует архитектуру Multimodal Diffusion Transformer, которая должна улучшить понимание текста и орфографии. Новая платформа для создания контента Stable Assistant Beta — это «дружелюбный чат-бот», позволяющий платным подписчикам работать с передовыми ИИ-моделями Stability AI, генерировать изображения и писать тексты. Пока платформа находится в стадии закрытого тестирования ограниченной группой пользователей и недоступна для широкой публики. В очередной раз расширив доступность своих продуктов, компания подчеркнула, что «принимает разумные меры для предотвращения неправомерного использования Stable Diffusion 3 злоумышленниками». ИИ переплюнет по энергопотреблению Индию уже к 2030 году, спрогнозировал глава Arm

17.04.2024 [21:42],

Николай Хижняк

Технологиям искусственного интеллекта требуются огромные объёмы электроэнергии. По мнению главы компании Arm Рене Хааса (Rene Haas), это может привести к тому, что уже к концу текущего десятилетия общие объёмы потребляемой системами ИИ энергии превзойдут объёмы энергопотребления Индии, самой густонаселённой страны в мире. Источник изображения: Gerd Altmann / pixabay.com По словам Хасса, поиск способов предотвратить прогнозируемое утроение энергопотребления к 2030 году имеет первостепенное значение, если человечество хочет достигнуть целей, которые возлагаются на ИИ. «Мы по-прежнему находимся на раннем этапе развития возможностей [искусственного интеллекта]. Чтобы эти системы стали лучше, им потребуется дополнительное обучение — этап, который включает в себя бомбардировку программного обеспечения огромными наборами данных. Этот процесс рано или поздно столкнётся с пределом наших энергетических мощностей», — рассказал Хаас в интервью Bloomberg. Хаас формально ставит себя в один ряд с растущим числом людей, выражающих обеспокоенность по поводу возможного ущерба, который ИИ может нанести мировой энергетической инфраструктуре. Но он также заинтересован в том, чтобы отрасль перешла на использование чипов с Arm-архитектурами, которые всё больше завоёвывают популярность в центрах обработки данных. Технологии компании, которые к настоящему моменту получили широкое распространение в смартфонах, разработаны с целью более эффективного использования энергии по сравнению с традиционными серверными чипами. Arm рассматривает ИИ в качестве одного из основных драйверов своего роста. Технологии компании уже используются в процессорах, являющихся основой серверных систем AWS, Microsoft и Alphabet, разработавших собственные чипы для снижения своей зависимости от Intel и AMD. По словам Хааса, используя больше чипов, изготовленных по индивидуальному заказу, компании могут сократить ограничивающие факторы и повысить энергоэффективность их систем. Такая стратегия может снизить энергопотребление центров обработки данных более чем на 15 %. Однако отрасль нуждается в более масштабных технологических прорывах. Microsoft признала, что Copilot автоматически установился на Windows 11 из-за ошибки

17.04.2024 [20:35],

Владимир Чижевский

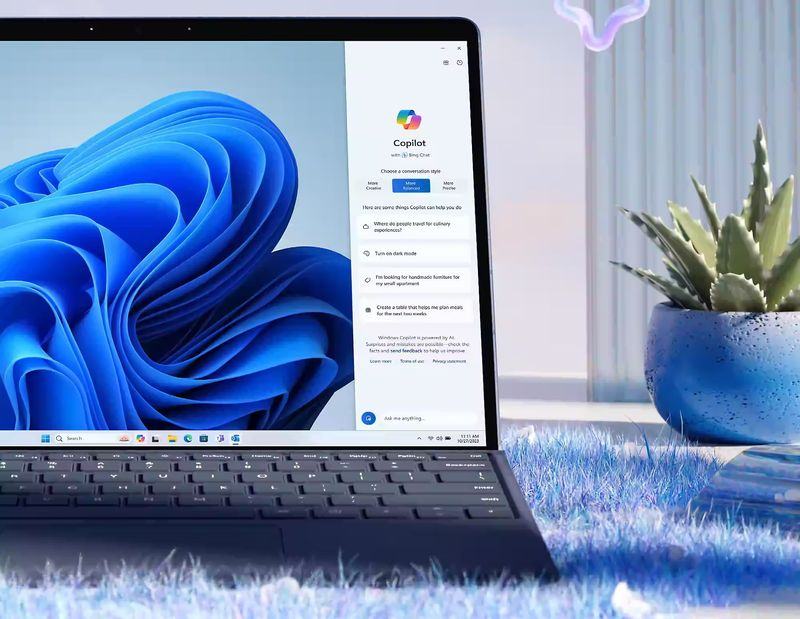

В прошлом месяце некоторые пользователи Windows 11 сообщали, что Microsoft автоматически и без уведомления установила на их компьютеры приложение Copilot. Некоторые подозревали компанию в тайной слежке и сборе данных, однако в опубликованном вчера на сайте техподдержки Microsoft документе говорится, что всему виной техническая ошибка.

Источник изображения: Microsoft По словам компании, выпущенное 28 марта 2024 года обновление Edge «некорректно устанавливало новый пакет (MSIX) под названием "Поставщик чата Microsoft для Copilot в Windows" (Microsoft chat provider for Copilot in Windows)», в результате в установленных приложениях мог появиться Copilot. Microsoft уверяет, что автоматически установленное приложение Copilot не работает в фоновом режиме, не выполняет код или процессы, не собирает и не передаёт данные. Некорректно установленный пакет предназначался для подготовки отдельных ПК с Windows 11 к будущему включению Windows Copilot. В одном из будущих обновлений приложение будет удалено. Обнаружив среди установленных приложений Copilot, многие пользователи поспешили выразить недовольство на форумах и в социальных сетях, однако впоследствии выяснилось, что оно занимает 0 байт и скорее всего является «заглушкой». Приложение свободно удалялось штатными средствами Windows, что не помешало людям в очередной раз поднять тему установки приложений без их ведома. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |