|

Опрос

|

реклама

Быстрый переход

Больше половины руководителей признали, что внедрение ИИ не приносит пользы бизнесу

21.01.2026 [12:59],

Алексей Разин

По замыслу разработчиков ИИ-сервисов, их внедрение в работе с данными должно повышать производительность труда офисных работников, увеличивать выручку компаний и снижать их затраты. Руководители бизнеса, опрошенные PwC, в 56 % случаев заявили, что внедрение ИИ к получению финансовой выгоды пока не привело.

Источник изображения: Unsplash, krakenimages Как отмечает The Register, в опросе приняли участие генеральные директора компаний, которые уже начали использовать в своей повседневной работе ИИ, всего было опрошено 4454 респондента. Лишь 12 % опрошенных руководителей заявили, что в их компаниях внедрение ИИ позволило добиться одновременного снижения затрат и роста выручки. В 26 % случаев наблюдалось только снижение затрат, но примерно такое же количество респондентов настаивает на увеличении затрат из-за внедрения ИИ. Чаще всего представители бизнеса используют ИИ для генерации спроса на свои товары и услуги (22 % случаев), в службах поддержки (20 %) и разработке продуктов (19 %), но обширным внедрением ИИ занимаются буквально единичные представители бизнеса. Проведённый PwC в прошлом году опрос показал, что только 14 % работников в своей деятельности ежедневно используют ИИ. По мнению представителей PwC, сейчас внедрение ИИ находится на ранних этапах, и для получения масштабного экономического эффекта требуется больше вкладывать в эту сферу. Изолированные и разрозненные примеры внедрения ИИ не приносят желаемого эффекта, а для его достижения технологию нужно масштабировать на весь бизнес компании. Впрочем, пилотные проекты на определённых небольших участках позволяют бизнесу оценить эффективность внедряемых решений и понять, следует ли масштабировать технологию на всю компанию. Успех в этой области будет зависеть и от организационной культуры в компании, стратегического планирования и чёткой формализации рисков, как отмечают авторы исследования. Прочие источники также пока не демонстрируют быстрой отдачи от инвестиций в ИИ со стороны бизнеса. Августовский опрос MIT показал, что в масштабном внедрении ИИ преуспели всего 5 % компаний, а остальные 95 % не почувствовали финансовой отдачи. Недавно выяснилось, что переход страховых агентов на использование чат-ботов позволил им экономить только три минуты времени в день. Представители PwC попутно выяснили, что с оптимизмом в ближайшее будущее смотрят только 30 % руководителей компаний, хотя в прошлом году этот показатель достигал 38 %. Геополитические риски и рост угроз в сфере кибербезопасности в этом смысле дополняют неопределённость с эффективностью использования ИИ. Около трети представителей бизнеса считают, что таможенные тарифы отрицательно повлияют на нормы прибыли их компаний. В США до 22 % представителей бизнеса считают, что их компании подвержены высокому влиянию таможенных тарифов. По данным исследования, избегающие серьёзных инвестиций на фоне геополитической нестабильности компании уступают конкурентам пару процентных пунктов роста выручки и до трёх процентных пунктов нормы прибыли. Глава Anthropic предрёк трудовой ИИ-апокалипсис: работы лишится каждый десятый — властям пора готовить компенсации

21.01.2026 [12:14],

Алексей Разин

Многие разработчики искусственного интеллекта на начальных этапах деятельности руководствовались гуманистическими принципами, стремясь внедрить новые технологии на благо всего человечества. Глава стартапа Anthropic убеждён, что для справедливого распределения преимуществ ИИ в процессе должны принимать участие правительства различных стран.

Источник изображения: Anthropic Генеральный директор Дарио Амодеи (Dario Amodei) своими соображениями на этот счёт поделился с The Wall Street Journal на форуме в Давосе, где в этом году собралось непривычно много представителей ИИ-отрасли. Сам по себе факт такой концентрации показывает, что сфера искусственного интеллекта начинает всё серьёзнее влиять на мировую экономику. Глава Anthropic в своём интервью на полях форума признался, что одновременно взволнован и обеспокоен тем влиянием, которое ИИ способен оказать на общество и макроэкономику. Мало кто, по его словам, сейчас отдаёт себе отчёт в том, насколько серьёзным может быть это влияние. Во-первых, как поясняет Амодеи, правительство должно взять на себя функции компенсации неприятных для общества изменений на рынке труда. Какие-то рабочие места будут неизбежно замещаться искусственным интеллектом, власти должны найти адекватные и эффективные механизмы компенсации этого влияния. По мнению главы стартапа, не исключён сценарий, при котором рост ВВП на 5–10 % будет сочетаться с 10-процентным уровнем безработицы. Такой комбинации, по его словам, никто никогда ранее не видел. «Потребуется некоторое участие правительства в замещении, которое будет настолько большим с макроэкономической точки зрения», — пояснил Амодеи. Во-вторых, глава Anthropic описал потенциально «кошмарный сценарий», при котором неуправляемое влияние ИИ на общество приведёт к тому, что около 10 млн жителей планеты, из которых порядка 7 млн человек будут сосредоточены в Кремниевой долине, смогут резко обогнать прочих по темпам экономического роста, который в показателях ВВП в их случае достигнет 50 %. По мнению Амодеи, на государственном уровне пора задуматься не о том, как отменять стимулы к развитию ИИ, а о более справедливом распределении результатов этого роста. Сейчас такие идеи не пользуются широкой популярностью, но технологические изменения заставят принимающих решения людей смотреть на вопросы иначе. Своими убеждениями Амодеи уже делился с представителями администрации действующего американского президента, с основными положениями политики Трампа в сфере ИИ он лично согласен, а в Давосе глава Anthropic будет общаться с другими официальными лицами. По мнению Амодеи, ИИ-стартапы сейчас делятся на две основные категории. Первой управляют исследователи и учёные, как в случае с Anthropic и DeepMind (Google). Лидерами второй являются люди, которые получили опыт работы в сфере социальных сетей. По его мнению, учёные стараются сосредоточиться на оценке влияния на общество технологии, которую они разрабатывают, а не «уклоняться от ответственности». Выросшие в среде развития социальных сетей руководители, по его словам, с пользователями взаимодействуют совершенно иначе. В этих замечаниях прослеживаются претензии Дарио Амодеи как в адрес Марка Цукерберга (Mark Zuckerberg), так и бывшего соратника по OpenAI Сэма Альтмана (Sam Altman), который тоже начинал с социальных сетей. В отличие от OpenAI и Google, стартап Anthropic ориентируется на потребителей в корпоративном сегменте. Как заставить Google лгать: писатель внушил ИИ-поиску, что его кот говорит по-кантонски

21.01.2026 [10:38],

Павел Котов

Известный американский писатель, автор комиксов и блогер Чак Вендиг (Chuck Wendig) сумел убедить сервис поиска с искусственным интеллектом Google, что у него живёт кот с пышной кличкой Сэр Мьюлингтон фон Писсбрет (Sir Mewlington Von Pissbreath), который носит цилиндр и немного говорит на кантонском диалекте китайского языка.

Источник изображения: Amber Kipp / unsplash.com Современные большие языковые модели искусственного интеллекта в действительности представляют собой сложные статистические алгоритмы, задача которых — предсказывать последующие слова. Это означает, что в качестве запроса такой системе порой можно отправить откровенную чушь, и в ответ она произведёт поиск по большому числу источников, найдёт случайную информацию, соберёт её в некое подобие обзора, который на деле будет таким же нелепым, как и ответ. Это подтвердил пример писателя Чака Вендига. В декабре Вендиг написал в своём блоге, что, по данным службы ИИ-поиска Google, у него живёт кот по кличке Бумба (Boomba) — эту информацию сервис якобы почерпнул с сайта Wengie Wiki. В действительности никакого кота у писателя не было и нет. Несколько поисковых запросов спустя ИИ-поиск Google сообщил ему, что его кот Бумба умер, и писатель завёл нового по кличке Франкен (Franken); в качестве доказательства система сослалась на блог Вендига, в котором на самом деле ни разу не упоминались ни Бумба, ни Франкен. В серии последующих поисковых запросов сервис начал постоянно придумывать писателю новых питомцев под новыми именами; он также добавил не соответствующие действительности сведения о его состоянии здоровья и религиозных предпочтениях. Вендиг, не стесняясь в выражениях раскритиковал не только сервис ИИ-поиска Google, но и вообще технологии ИИ в их теперешнем виде. Он отметил, что сервис неспособен отличать правду от вымысла и выдаёт откровенную чушь в стремлении угодить пользователю. Войдя в азарт, он завершил свою публикацию также не соответствующим действительности признанием, что в его доме живёт шестилетний кот по кличке Сэр Мьюлингтон фон Писсбрет, который носит маленькую шляпку-цилиндр и немного говорит по-кантонски. И это сработало. Через полтора месяца ИИ-поиск Google включил и эту явно абсурдную информацию в результаты выдачи. Глава Google DeepMind оценил отставание китайских ИИ-моделей в шесть месяцев

21.01.2026 [07:36],

Алексей Разин

Генеральный директор DeepMind Демис Хассабис (Demis Hassabis) на прошлой неделе уже заявлял, что отставание китайских ИИ-моделей от западных за последние пару лет заметно сократилось, но оно всё же измеряется несколькими месяцами. В интервью Bloomberg на форуме в Давосе он предпочёл определить этот разрыв величиной в шесть месяцев.

Источник изображения: Isomorphic Labs Как отметил Демис Хассабис, китайские разработчики неплохо себя проявили в преследовании лидеров отрасли, но им лишь представить доказать, что они способны опередить их и преодолеть соответствующий барьер на уровне инноваций. Прошлогоднюю модель китайской DeepSeek глава DeepMind до сих пор называет «впечатляющей». Любопытно, что не все ведущие западные игроки ИИ-сегмента положительно оценивают решение властей США открыть поставки ускорителей Nvidia H200 в Китай. По мнению главы Anthropic Дарио Амодеи (Dario Amodei), поставки таких ускорителей в Китай схожи с продажей ядерного оружия в Северную Корею. DeepMind в составе Google работает не только над совершенствованием ИИ-ассистента на базе Gemini, но и интересуется направлением робототехники, которая всё чаще ассоциируется у участников рынка со следующим по важности воплощением искусственного интеллекта. По мнению Хассабиса, в сфере «физического ИИ» в скором времени должны произойти прорывные изменения. При этом перед разработчиками стоят сложные проблемы. «Очень сложно добиться надёжности, силы и подвижности человеческой кисти», — признаётся глава DeepMind. Глава Microsoft раскрыл рецепт, как не допустить взрыва ИИ-пузыря

21.01.2026 [07:02],

Алексей Разин

Наиболее тревожные эксперты то и дело заявляют, что высокие темпы развития ИИ в нынешних условиях создают опасность формирования пузыря, схлопывание которого грозит глобальными макроэкономическими проблемами. Глава Microsoft Сатья Наделла (Satya Nadella) считает, что избежать этого удастся только при условии повсеместного распространения ИИ.

Источник изображения: Microsoft Под этим подразумевается практическое внедрение ИИ не только в срезе различных отраслей и компаний, но и в географическом понимании. Грубо говоря, использование ИИ не должно ограничиваться горсткой компаний технологического сектора, а ещё соответствующие технологии должны найти применение и за пределами стран с развитой экономикой. «Чтобы это не стало пузырём по определению, нужно, чтобы преимущества (ИИ) распределялись значительно более равномерно», — пояснил генеральный директор Microsoft, выступая на форуме в Давосе. В этом смысле тревожным сигналом к образованию пузыря необходимо считать сосредоточение выгоды от использования ИИ в руках отдельной группы технологических компаний, как добавил Наделла. При этом он лично убеждён, что распространение ИИ будет наблюдаться в различных отраслях. Например, он поможет в разработке новых лекарственных средств. «Я гораздо больше уверен в том, что эта технология, по факту, будет строиться на основе облачной и мобильной инфраструктуры, распространяться быстрее и менять кривую производительности труда, принося локальные излишки и экономический рост во всём мире», — заявил глава Microsoft. Он также выразил уверенность, что будущее внедрение ИИ не будет базироваться на единственном провайдере моделей, поэтому Microsoft и не концентрируется на сотрудничестве с одной только OpenAI, для которой выступила в роли раннего и крупнейшего по сей день инвестора. Microsoft готова развивать сотрудничество с Anthropic и xAI, а после октябрьской реструктуризации OpenAI условия соглашения с этим стартапом были пересмотрены. После 2030 года Microsoft поэтапно утратит преимущество в доступе к новейшим разработкам OpenAI и перестанет выступать в роли основного провайдера вычислительных мощностей для этой компании. Microsoft в целом готова не только использовать ИИ-модели с открытым исходным кодом, но и создавать собственные путём так называемой «дистилляции». Как пояснил Наделла, интеллектуальной собственностью любой компании являются её методы использования тех или иных моделей для работы с контекстом или данными. И если компании понимают, что со всем этим делать, они будут добиваться прогресса. Samsung обновит ИИ-ассистента Bixby — он сможет управлять настройками смартфона и обращаться к Perplexity вместо Gemini для сложных запросов

21.01.2026 [05:10],

Анжелла Марина

Samsung временно опубликовала, а затем удалила анонс бета-версии обновлённого голосового ассистента Bixby, который в составе оболочки One UI 8.5 получит интеграцию с поисковым движком Perplexity для ответов на сложные вопросы и управления устройством. Согласно тексту удалённого анонса, как сообщает Android Authority, компания намерена превратить Bixby в полноценного ИИ-агента, способного конкурировать с современными ИИ-моделями.

Источник изображения: Mark Chan/Unsplash На данный момент ссылка на официальный анонс ведёт на страницу с ошибкой, однако издание Droid Life успело скопировать текст сообщения. Главным нововведением станет разделение задач. В частности, для управления функциями телефона Bixby будет использовать собственные алгоритмы понимания естественного языка, а для ответов на вопросы, не связанные с устройством, ассистент будет обращаться к Perplexity. Это позволит системе подтягивать информацию из интернета и генерировать развёрнутые ответы с текстом и графикой прямо в интерфейсе голосового помощника, аналогично тому, как это делает Gemini компании Google. Одновременно партнёрство с Perplexity создаёт неопределённость в отношениях Samsung и Google, так как линейка Galaxy S25 поставлялась с предустановленной модифицированной версией Gemini, а устройства Samsung играли значительную роль в маркетинге ИИ-продуктов Google. Появление схожей функциональности в собственном ассистенте Bixby может привести к снижению присутствия бренда Gemini в будущих устройствах корейского производителя. Согласно заявлению, обновлённый Bixby в составе One UI 8.5 будет доступен на «отдельных рынках». Сама оболочка One UI 8.5 сейчас находится в стадии бета-тестирования. В тексте анонса также утверждалось, что стабильный запуск системы ожидается на смартфонах серии Galaxy S26 в течение ближайших нескольких недель. Журналисты Android Authority обратились в Samsung за комментарием относительно удалённой публикации и ожидают официального ответа. ChatGPT вычислит подростков по поведению: OpenAI вводит систему предсказания возраста

21.01.2026 [04:50],

Алексей Разин

Стартап OpenAI на этой неделе заявил о внедрении для потребительских тарифных планов ChatGPT модели предсказания возраста пользователя. Эти шаги направлены на выявление пользователей, не достигших 18 лет, с целью защиты их от нежелательной информации. Частично возраст выявляется на основе графика использования ChatGPT конкретным человеком.

Источник изображения: OpenAI OpenAI была вынуждена пойти на эти меры, поскольку Федеральная комиссия по торговле США ведёт расследование в отношении разработчиков популярных чат-ботов, с целью выявления потенциально негативного влияния их на детей и подростков. Компания выступает ответчиком по нескольким делам о причинении смерти по неосторожности, включая один инцидент с предполагаемым доведением подростка до самоубийства. Как только модель предсказания возраста приходит к выводу, что имеет дело с несовершеннолетним пользователем, она автоматически вводит механизмы защиты, блокируя доступ к информации определённого характера, включая описание способов нанесения ущерба здоровью и жизни человека. Если совершеннолетний пользователь ChatGPT ошибочно столкнулся с такими ограничениями, то он сможет пройти повторную идентификацию на возраст через сервис Persona, после чего ограничения будут сняты. Этот сервис используется для верификации возраста пользователей и другими онлайн-платформами, включая Roblox. Осенью прошлого года OpenAI ввела в ChatGPT средства родительского контроля, которые позволяют людям понимать, какие запросы отправляют в чат-бот их дети и к какой информации имеют доступ. В октябре также была созвана экспертная группа из восьми специалистов, которые должны оценивать, настолько взаимодействие с ИИ способно повлиять на ментальное здоровье человека, его эмоции и мотивацию. На этой неделе OpenAI подчеркнула, что будет повышать точность предсказания возраста с течением времени. В Евросоюзе этот механизм начнёт распространяться в ближайшие недели, чтобы обеспечить соответствие местным законодательным нормам. Нейросети станут нашими очень близкими друзьями — тревожный прогноз главы ИИ-направления Microsoft

20.01.2026 [20:59],

Анжелла Марина

Генеральный директор по искусственному интеллекту Microsoft Мустафа Сулейман (Mustafa Suleyman), заявил, что в ближайшие пять лет у каждого человека может появиться персональный ИИ-компаньон, который будет знать о нём практически всё. Такие системы станут частью повседневной жизни, помогая принимать решения. Однако перспектива эта вызывает тревогу на фоне уже известных случаев опасной зависимости пользователей от чат-ботов.

Источник изображения: AI Сулейман уверен, что ИИ-компаньоны перестанут быть просто инструментами. Они будут постоянно находиться рядом, анализируя, что пользователь видит, слышит, чем занимается, и предлагать помощь в решении сложных жизненных задач. «Будущий ассистент будет видеть то, что видите вы, и слышать то, что слышите вы», — цитирует Сулеймана издание Windows Central. Он убеждён, что люди начнут доверять таким системам важную информацию и воспринимать их как близких друзей. Тем более что Microsoft уже технически готовит почву для этого. Например, в недавнее обновление сервиса Copilot были добавлены функции долгосрочной памяти, компьютерного зрения и визуальный аватар (Copilot Avatar). Однако у этой технологии есть и обратная сторона. У некоторых людей формируется сильная зависимость от ИИ. В одном из случаев семья подала в суд на OpenAI, поскольку их 16-летний сын покончил с собой после общения с чат-ботом. Родители выдвинули обвинение в том, что компания выпустила технологию, не обеспечив должный уровень её безопасности. Россия заняла 119-е место в мире по проникновению ИИ — ниже Беларуси и Нигера, но выше Армении и Зимбабве

20.01.2026 [16:18],

Павел Котов

Microsoft опубликовала доклад, посвящённый вопросу распространения технологий искусственного интеллекта по всему миру. За минувшие полгода мировое население стало активнее пользоваться новыми технологиями. Некоторые страны добились особого успеха благодаря стройной государственной политике. Одним из наиболее примечательных явлений стал китайский сервис DeepSeek.

Источник изображения: Igor Omilaev / unsplash.com Проникновение технологий ИИ во второй половине 2025 года в очередной раз показало рост — на 1,2 процентного пункта по сравнению с первым полугодием. Сегодня ИИ пользуются 16,3 % населения планеты, или примерно каждый шестой. Никуда не делось и цифровое неравенство: в странах глобального Севера ИИ освоили 24,7 % работающего населения, или примерно каждый четвёртый, а в странах глобального Юга — 14,1 %, или каждый седьмой. Мировыми лидерами по проникновению ИИ оказались страны, которые первыми начали развивать это технологическое направление. Первое место принадлежит ОАЭ, где ИИ пользуются 64 % работающего населения; за ними следуют Сингапур (60,9 %), Норвегия (46,4 %), Ирландия (44,6 %) и Франция (44,0 %). Россия в этом зачёте заняла 119-е место с результатом 8,0 %, уступив таким странам, как Беларусь (8,4 %), Кыргызстан (8,2 %) и Кения (8,1 %), но обойдя Камерун, Центральноафриканскую Республику и Чад, у которых этот показатель составляет по 7,8 %. Отмечается, что мировое технологическое лидерство не означает широкого принятия ИИ среди населения. Самыми передовыми технологиями в этой области обладают США, где ИИ используют 28,3 % населения, однако это лишь 24-е место в списке. С другой стороны, особо отмечаются успехи Южной Кореи, которая на своём примере подтвердила эффективность государственной политики в области ИИ: за полгода страна поднялась с 25-го на 18-е место в мировом рейтинге — положительными факторами стали расширенная поддержка корейского языка в ИИ-моделях и ориентированные на потребителя функции. Генеративный ИИ активно используется в учебных заведениях, на рабочих местах и в общественных службах. Южная Корея стала одним из наиболее быстрорастущих рынков ChatGPT, в связи с чем OpenAI открыла офис в Сеуле. Наконец, примечательным явлением стал сервис DeepSeek — китайская компания выпустила ИИ-модель, способную конкурировать с лучшими американскими системами. Модель является открытой и доступной по лицензии MIT, бесплатный чат-бот работает через веб-интерфейс и в виде мобильного приложения. Открытость и доступность помогли DeepSeek завоевать популярность на рынках, где западные платформы представлены недостаточно: в Африке сервисом пользуются в 2–4 раза активнее, чем в других регионах. DeepSeek также активно используют в странах с низким уровнем проникновения ИИ — в Китае, России, Беларуси и на Кубе. Популярности сервиса способствовала партнёрская программа совместно с Huawei. Пример DeepSeek показывает, что внедрение ИИ определяется доступностью и качеством моделей: пользователи выбирают сервисы, которые соответствуют их экономическому, языковому и политическому контексту. Anthropic: чат-боты с ИИ способны менять личность, и это может нести опасность

20.01.2026 [15:26],

Владимир Мироненко

Согласно исследованию, опубликованному Anthropic, чат-боты с ИИ переживают резкие изменения личности, которые могут коренным образом изменить их поведение в направлении потенциально опасного.

Источник изображения: Igor Omilaev/unsplash.com Исследователи Anthropic обнаружили, что большие языковые модели обладают скрытой «осью помощника», которая контролирует их полезное поведение. Большинство ИИ-моделей естественным образом принимают образ полезного помощника в процессе обучения, обладая при этом сложной внутренней структурой. Доминирующий компонент, контролирующий поведение ИИ, работает вдоль так называемой «оси помощника» (Assistant Axis) — измеримой величины, которая определяет, останется ли модель в своем полезном режиме или претерпит изменения. В случаях, когда ось дестабилизируется, модели начинают идентифицировать себя как другие сущности, отказываются от своей полезной природы или впадают в то, что исследователи называют «дрейфом личности» — непредсказуемые изменения в их поведении. Ученые составили карту внутреннего «пространства личности» основных ИИ-моделей, определив, как на самом деле работают искусственные личности. Используя методы на ИИ-моделях, включая Gemma от Google, Qwen от Alibaba и Llama от Meta✴✴, исследователи обнаружили, что личности ИИ существуют по интерпретируемым осям внутри нейронной сети модели, и ИИ-модели будто бы живут двойной жизнью. «Ось помощника» представляет собой лишь одно измерение этого сложного личностного ландшафта. На одном конце находятся такие полезные роли, как оценщики, рецензенты и консультанты, в то время как фантастические персонажи занимают противоположное положение. Когда модели отдаляются от «оси помощника», они становятся всё более склонными к принятию проблемных личностей или проявлению вредного поведения. Исследователи отметили, что можно направлять модели по этим личностным осям. При этом направление в сторону функциональности помощника усиливает полезное поведение, а отклонение от него ведёт к идентификации модели с другими сущностями — потенциально опасными. При этом смещение личности ИИ происходит на уровне нейронной сети, что значительно затрудняет обнаружение и предотвращение негативных изменений с помощью традиционных мер безопасности. ИИ-модели могут отклониться от своей роли ассистента во время обучения, что приводит к необратимым изменениям личности, сохраняющимся во всех будущих взаимодействиях. Это означает, что ИИ-система может постепенно стать менее полезной или даже начнёт активно вредить, и это станет заметно, когда будет слишком поздно. После открытия векторов персоны и «оси помощника» учёные приступили к разработке новых механизмов управления. Как выяснилось, ограничение активаций вдоль «оси помощника» может стабилизировать поведение модели, особенно в сценариях, связанных с эмоциональной уязвимостью или сложными задачами рассуждения. Благодаря использованию разработанных методов можно отслеживать изменения личности ИИ в режиме реального времени и даже предсказывать, когда произойдут опасные перемены с помощью измерения отклонений вдоль «оси помощника». Это предоставляет разработчикам важнейшую систему раннего предупреждения. Хотя у учёных теперь есть инструменты для мониторинга и контроля личностных качеств ИИ, лежащая в его основе нестабильность предполагает, что существующим архитектурам ИИ может не хватать фундаментальной стабильности, необходимой для действительно безопасного развёртывания в больших масштабах, отметил ресурс eWeek. Поставки первых систем на ускорителях Nvidia Rubin стартуют в конце лета

20.01.2026 [14:33],

Алексей Разин

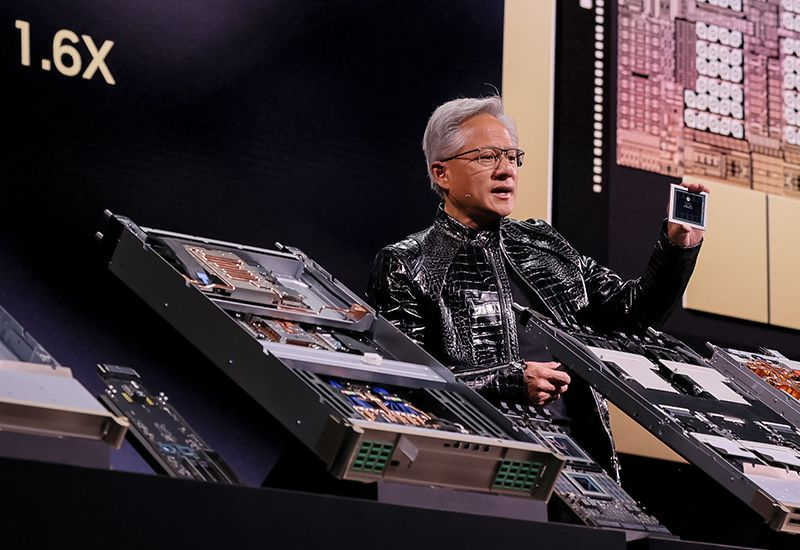

В этом месяце глава и основатель Nvidia Дженсен Хуанг (Jensen Huang) продемонстрировал ускорители вычислений поколения Rubin, заявив о начале их массового производства. Между тем, серверная продукция обычно длительное время добирается до конечных пользователей, а потому и поставки систем на семейства Vera Rubin партнёры Nvidia собираются начать лишь к концу этого лета.

Источник изображения: Nvidia Об этом сообщает Commercial Times со ссылкой на комментарии вице-президента тайваньского производителя серверного оборудования Quanta Computer Майка Янга (Mike Yang), которые тот сделал на прошлой неделе на праздничном корпоративном мероприятии. Гиганты облачных вычислений начнут получать соответствующие системы на базе ускорителей Nvidia Rubin в августе текущего года. На тот момент отгрузки не будут массовыми, а потому Quanta Computer и не рассчитывает на получение существенной выручки от поставок первых систем на базе Vera Rubin. Основная часть клиентов компании, по словам её представителя, уже эксплуатирует системы поколения Grace Blackwell (GB200 и GB300), что при условии родства архитектур с Vera Rubin позволит им достаточно быстро и безболезненно обновить в случае необходимости аппаратную базу. В официальных документах Nvidia осенью прошлого года сроки производства Vera Rubin упоминались достаточно размыто — под его начало отводился весь 2026 год. ByteDance внезапно стала второй силой на рынке облачных ИИ-систем в Китае

20.01.2026 [13:17],

Алексей Разин

Частная китайская компания ByteDance более известна в качестве создателя социальной сети TikTok, но в последнее время она достигла впечатляющего прогресса на китайском рынке облачных услуг для корпоративных клиентов, отмечает издание Financial Times. По размеру выручки в сегменте ByteDance уступает только многолетнему лидеру Alibaba.

Источник изображения: ByteDance Облачный сервис ByteDance носит название Volcano Engines, и в работе с корпоративными клиентами китайская компания специализируется на создании ИИ-агентов под нужды конкретных заказчиков. К сильным сторонам ByteDance в этой сфере можно отнести опыт работы с большими массивами пользовательских данных, наличие талантливых разработчиков и серьёзной аппаратной базы. В последние месяцы Volcano Engine также привлекает к себе новых клиентов за счёт агрессивной на фоне конкурентов ценовой политики, как поясняют источники. В отличие от тех же DeepSeek и Alibaba, которые исповедуют политику открытого исходного кода, ByteDance свои разработки держит при себе и позволяет им пользоваться только тем клиентам, которые за это платят. С этой точки зрения компания больше заинтересована в максимальном удовлетворении запросов клиентов, а не банальном соревновании с представителями лагеря открытого исходного кода в быстродействии собственных ИИ-моделей. К слову, Alibaba ценность закрытых разработок тоже осознаёт, а потому часть своих моделей не переводит на открытый исходный код. В первой половине прошлого года в облачном ИИ-сегменте на китайском рынке ByteDance заняла 13 % в показателях выручки, получив за период $390 млн от корпоративных клиентов. В центре предложений компании остаётся HiAgent — сервис по созданию адаптированных к нуждам конкретного заказчика ИИ-агентов. Для сравнения, в то же время доля Alibaba в указанном сегменте рынка достигает 23 %. Tencent и Huawei в последнее время сдают свои позиции на рынке облачных услуг. Первая старается направлять доступные аппаратные ресурсы на развитие ИИ-моделей и сервисов, а вторая выпускаемые ИИ-ускорители предпочитает продавать сторонним клиентам. Если брать весь рынок облачных услуг, а не концентрироваться только на ИИ-сегменте, то доля ByteDance в Китае пока не превышает 3 %. Зато именно на направлении ИИ наблюдается максимальный рост рынка. В потребительском сегменте ByteDance добилась международного признания, не говоря уже о внутреннем рынке Китая. При этом выручка от рекламы в сегменте потребительских приложений и сервисов у ByteDance достигает $50 млрд в квартал и является доминирующим источником финансовых ресурсов. Компания не жалеет средств на развитие своих ЦОД, только на закупку ИИ-ускорителей в этом году она направит более $14 млрд, а ещё ByteDance готова приобрести крупную партию ускорителей Nvidia H200, если не будут возражать китайские и американские власти. OpenAI подтвердила, что представит свой первый ИИ-гаджет во втором полугодии

20.01.2026 [12:02],

Алексей Разин

К середине лета прошлого года OpenAI завершила поглощение стартапа бывшего главного дизайнера Apple Джони Айва (Jony Ive, на фото справа), в сотрудничестве с которым собирается представить широкий спектр умных электронных устройств. На этой неделе представитель первой из компаний подтвердил, что дебютный гаджет будет представлен во второй половине текущего года, как и ожидалось.

Источник изображения: OpenAI Как отмечает издание Axios, соответствующее признание прозвучало в Давосе из уст главы OpenAI по международному рынку Криса Лихейна (Chris Lehane). Идея создания персональных устройств для работы с ИИ регулярно упоминалась главой стартапа Сэмом Альтманом (Sam Altman, на фото слева) с мая прошлого года, когда впервые подтвердилась информация о поглощении компании Джони Айва. Последний позже утверждал, что придумал от 15 до 20 различных устройств для OpenAI, но до сих пор партнёры не удосужились даже кратко описать их функциональные возможности, не говоря уже о демонстрации прототипов. На уровне слухов первому из таких устройств приписывалось отсутствие дисплея, что подразумевает ориентацию на голосовое взаимодействие с пользователем. Альтман обещал, что пользоваться таким устройством будет очень просто. В свою очередь, Лихейн в своих комментариях Axios отказался пояснять, как именно будет выглядеть данное устройство. Он лишь добавил, что новости на эту тему появятся в текущем году значительно позже, и само по себе появление устройств OpenAI станет одним из самых важных информационных поводов, привлекающих внимание общественности компании в текущем году. Представитель компании также не стал пояснять, поступит ли дебютное устройство в продажу именно в этом году. При этом второе полугодие не является окончательным, хотя и наиболее вероятным периодом анонса первого устройства OpenAI. На форуме в Давосе представителям Axios удалось узнать от руководства Qualcomm, что ежегодно на рынок поставляется 10 млн умных очков с поддержкой ИИ, и уже в этом или следующем году их количество вырастет до 100 млн штук. Именно очки, по мнению главы компании Криштиано Амона (Christiano Amon), окажутся самой многочисленной категорией носимых ИИ-устройств. При этом такие гаджеты будут существовать и в форме беспроводных наушников с камерами или ювелирных украшений. Глава Qualcomm также признал, что компания сотрудничает с OpenAI и очень довольна результатами такой работы, но в части описания возможностей будущего ИИ-устройства лучше говорить напрямую с её представителями. Молодые сотрудники больше опытных обеспокоены конкуренцией со стороны ИИ

20.01.2026 [08:32],

Алексей Разин

Как уже не раз отмечалось, внедрение компаниями генеративного искусственного интеллекта на уровне бизнес-процессов представляет наибольшую угрозу именно для сотрудников с минимальным опытом работы. Они это прекрасно осознают и разделяют соответствующую обеспокоенность, как показало масштабное социологическое исследование.

Источник изображения: Unsplash, Bruce Mars Специалисты рекрутинговой компании Randstad провели опрос среди 27 000 сотрудников и 1225 работодателей, охватившее более 3 млн объявлений о вакансиях в 35 странах и регионах мира. В среднем, четыре из пяти сотрудников убеждены, что ИИ окажет влияние на характер выполняемой ими ежедневной работы, а больше всего за свои рабочие места переживают представители поколения Z, которое родилось с конца девяностых годов прошлого века по начало десятых годов текущего. Анализ объявлений о вакансиях в рамках проведённого исследования показал, что запрос на наличие у соискателей навыков работы с ИИ-агентами стал упоминаться в них на 1587 % чаще за предыдущий год. Работодатели всё активнее стараются перевести монотонные операции, не требующие особых навыков, на рельсы автоматизации и генеративного искусственного интеллекта. Геополитическая нестабильность привела к сокращению персонала на многих региональных рынках, поскольку бизнесу становится всё сложнее зарабатывать на фоне роста тревожности потребителей, старающихся сократить расходы. Работодатели видят во внедрении ИИ способ снизить свои издержки. Отношение работников к искусственному интеллекту неоднозначно. Некоторая часть с энтузиазмом воспринимает имеющуюся тенденцию, рассчитывая с помощью ИИ повысить эффективность собственной работы. Другие видят в ИИ угрозу, которая лишит их рабочих мест, и если родившиеся в первые послевоенные годы сотрудники больше уверены в своей незаменимости, то у молодых работников страхи в отношении конкуренции с ИИ проявляются сильнее. Примерно половина опрошенных Randstad участников рынка труда склоняется к мнению, что работодателям ИИ принесёт больше пользы, чем работникам. Прогнозы на текущий год разнятся соответствующим образом. Если 95 % опрошенных работодателей выразили уверенность, что в текущем году бизнес обеспечит им более высокую отдачу, то среди сотрудников лишь 51 % разделяют подобный оптимизм. OpenAI пообещала практический ИИ уже в этом году — и похвалилась выручкой в $20 млрд за прошлый

20.01.2026 [07:39],

Алексей Разин

Создавшая ChatGPT американская компания OpenAI до сих пор формально считается стартапом, за что ей прощают непрозрачную структуру финансирования и отсутствие явной ответственности перед инвесторами. Финансовый директор Сара Фрайар (Sarah Friar) на этой неделе заявила, что практическое внедрение ИИ начнётся в этом году, попутно рассказав о достижениях OpenAI.

Источник изображения: OpenAI Если в 2023 году стартап располагал 200 МВт вычислительных мощностей и зависел от единственного их провайдера (Microsoft), то сейчас он может предложить около 1,9 ГВт вычислительных мощностей, которые доступны благодаря сотрудничеству с множеством партнёров. Для сравнения, в 2024 году OpenAI располагала 0,6 ГВт вычислительных мощностей. Подобных темпов роста отрасль ещё не наблюдала ранее, по словам Фрайар, и если бы в этот период OpenAI имела доступ к большему объёму вычислительных мощностей, то это привело бы к более активному использованию ИИ клиентами и более быстрой монетизации данных сервисов. В 2023 году приведённое значение годовой выручки OpenAI не превышало $2 млрд, в 2024 году показатель вырос до $6 млрд, а прошлый год она завершила, преодолев отметку $20 млрд. По словам представительницы стартапа, в текущем году он сделает всё возможное, чтобы 2026 год стал периодом практического применения ИИ. Приоритетом для OpenAI является сокращение разрыва между потенциальными возможностями ИИ и практическим использованием этих технологий на ежедневной основе со стороны простых людей, компаний и целых стран. «Возможности велики и доступны уже сейчас, особенно в здравоохранении, науке и корпоративном сегменте, где повышение интеллектуальности напрямую транслируется в улучшение результатов», — заявила финансовый директор OpenAI. Развитие ИИ будет способствовать появлению новых бизнес-моделей, как уверена Сара Фрайар. Они будут возникать по мере того, как ИИ внедряется в сферу научных исследований, создания лекарств, энергетические системы и моделирование финансовых процессов. «Монетизация должна быть естественным дополнением к впечатлениям пользователей. Если не добавляется ценность, то ничего не сложится», — пояснила представительница стартапа. Вчера издание Axios со ссылкой на руководителя OpenAI по политике Криса Лихэйна (Chris Lehane) заявило, что первое аппаратное устройство стартапа появится на рынке во второй половине текущего года. Сара Фрайар, в свою очередь, дала понять, что OpenAI в своих программных разработках в ближайшее время сосредоточится на создании агентов и средств автоматизации бизнес-процессов, которые позволяют работать непрерывно и учитывать прошлый контекст, а также выполнять действия в широком спектре инструментов. Она не скрывает, что OpenAI старается не держать основные средства на собственном балансе, а получает доступ к ресурсам через партнёров, сохраняя гибкость не только в их выборе, но и в аппаратной конфигурации ЦОД. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |