|

Опрос

|

реклама

Быстрый переход

Alphabet продаст акций на $80 млрд, чтобы направить средства на развитие инфраструктуры ИИ

02.06.2026 [08:28],

Алексей Разин

Корпорация Alphabet является не только одним из крупнейших игроков рынка облачных услуг, но и публичной компанией, акционеры которой не смогут ей простить тех схем с кольцевым финансированием, к которым пока могут прибегать стартапы типа OpenAI. По этой причине потребности в средствах для развития вычислительной инфраструктуры систем ИИ она предпочитает покрывать классическим способом, продавая собственные акции.

Источник изображения: Unsplash, Taylor Vick Как отмечает CNBC, эту неделю Alphabet начала с заявления о готовности продать пакет акций стоимостью $80 млрд, включая инвестиции на сумму $10 млрд со стороны Berkshire Hathaway. Вырученные деньги будут направлены на развитие вычислительной инфраструктуры для ИИ, которая сейчас пользуется беспрецедентно высоким спросом. Имеющихся у Alphabet ресурсов для пропорционального расширения вычислительных мощностей, по её собственному признанию, не хватает. В апреле корпорация подняла прогноз по капитальным расходам на этот год до диапазона от $180 до $190 млрд. В совокупности с Meta✴✴, Microsoft и Amazon (AWS), материнский холдинг Google в этом году направит на нужды развития инфраструктуры ИИ более $700 млрд. В следующем году, по оценкам аналитиков, капитальные расходы этих компаний могут превысить $1 трлн. К слову, Alphabet попутно активно выпускает облигации, в феврале она привлекла таким образом более $30 млрд, а в ноябре прошлого года — $25 млрд, и это только на американском рынке. Половина из указанных $80 млрд будет привлечена до третьего квартала текущего года, оставшиеся $40 млрд будут поэтапно поступать на счета Alphabet по мере реализации акций класса А и С, начиная с третьего квартала. Berkshire Hathaway, действующая в интересах миллиардера Уоррена Баффетта (Warren Buffett), с прошлого года нарастила свой пакет акций Alphabet до $20 млрд в денежном выражении, сделка с холдингом позволит увеличить его ещё в полтора раза. Впрочем, в капитал Apple эта инвестиционная компания успела вложить гораздо больше. Anthropic передала американским регуляторам проспект эмиссии, позволяющий начать подготовку к IPO

02.06.2026 [04:50],

Алексей Разин

Июнь американский стартап Anthropic начал с заявления о состоявшейся передаче SEC чернового варианта проспекта эмиссии S-1, который позволяет в случае согласования регулятором перейти к подготовке к размещению акций на бирже. Параметры будущего IPO пока не определены официально.

Источник изображения: Anthropic Формально Anthropic данным шагом опережает конкурирующую OpenAI, которая свою заявку только готовит. Кроме того, SpaceX взаимодействовать с инвесторами в рамках подготовки к июньскому IPO начнёт на этой неделе, поэтому и Anthropic решила не медлить с подачей документов в Комиссию США по ценным бумагам и биржам. Для сравнения, SpaceX свою заявку подала 1 апреля, а условия проспекта эмиссии обнародовала только 20 мая. Между публикацией проспекта и началом предвосхищающих IPO презентаций для инвесторов должно оставаться не менее 15 дней, поэтому Anthropic в вопросе выбора даты для размещения акций пока никак не связана. На прошлой неделе прошёл один из последних частных раундов привлечения инвестиций Anthropic, который оценил капитализацию компании в $965 млрд и позволил по этому критерию обойти OpenAI с её $852 млрд. В мае приведённая величина годовой выручки Anthropic достигла $47 млрд, что значительно больше прошлогодних $10 млрд. В отличие от OpenAI, Anthropic изначально ориентировалась на корпоративный сегмент рынка ИИ, поэтому её выручка растёт более уверенными темпами. Подготовка к IPO для Anthropic идёт в непростых условиях. С одной стороны, в начале года скандал по поводу применения решений Anthropic Пентагоном в военных целях лишил компанию доступа к некоторой части государственных контрактов. С другой стороны, он же подстегнул популярность чат-бота Claude в частном сегменте. Опять же, интерес государственных структур к ИИ-модели Mythos, которая ускоряет поиск уязвимостей в информационных системах, позволяет инвесторам с надеждой оценивать будущее Anthropic. Anthropic, OpenAI и SpaceX первыми внедрят серверные процессоры Nvidia Vera

01.06.2026 [12:42],

Алексей Разин

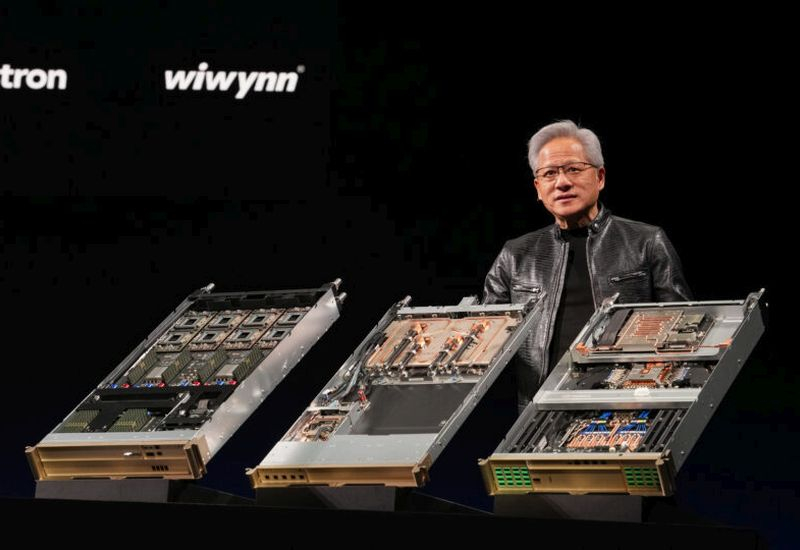

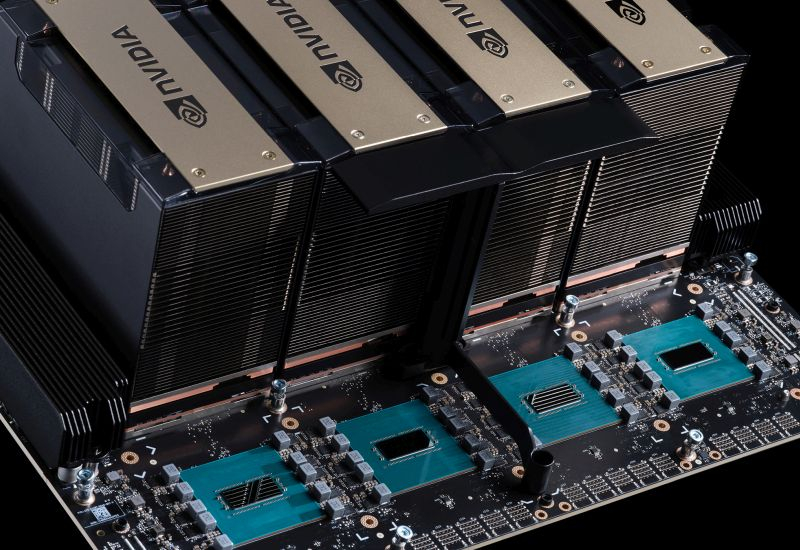

В третьем квартале этого года, как дал понять на Computex 2026 глава и основатель Nvidia Дженсен Хуанг (Jensen Huang), центральные процессоры Vera серверного назначения начнут массово производиться. Ими уже активно интересуются крупные компании ИИ-сегмента типа OpenAI, Anthropic и SpaceX, как добавил Хуанг, они будут первыми использовать их в своих ЦОД.

Источник изображения: Nvidia До сих пор развитие вычислительной инфраструктуры ИИ во многом полагалось на GPU компании Nvidia, но по мере перехода к инференсу они начали отходить на второй план. Центральные процессоры оказались более востребованными, и в этом сегменте Nvidia не собирается уступать рынок Intel и AMD, также предлагая собственные серверные CPU, которые в текущем поколении известны под наименованием Vera. В прошлом месяце Дженсен Хуанг отметил, что доля решений Nvidia в инфраструктуре Amazon (AWS) продолжает расти даже в условиях, когда этот клиент стремится всё активнее использовать компоненты собственной разработки типа тех же чипов семейства Graviton. Именно Nvidia способна предлагать клиентам комплексные готовые решения для ЦОД самого разного назначения. Даже начинающие разработчики с помощью фирменной инфраструктуры Nvidia очень быстро могут развивать бизнес, как убеждён глава компании. По его словам, процессоры Vera в 1,8 раза быстрее в некоторых ИИ-задачах по сравнению с процессорами Intel, использующими x86-совместимую архитектуру. Nvidia также предлагает клиентам продвинутое ПО для управления ЦОД и мониторинга основными показателями, включая уровень энергопотребления. Только за счёт более эффективного управления клиенты Nvidia могут на 40 % увеличить количество используемых ускорителей этой марки, не выходя за рамки общего целевого уровня энергопотребления. В рамках сотрудничества с китайской Unitree компания Nvidia также предложила разработчикам человекоподобных роботов некие эталонные наборы и платформы для быстрого создания таких роботов. По крайней мере, управляющие чипы и прилагаемое к ним ПО будут согласованы и готовы к работе друг с другом, а ещё клиентам будут поставляться уже готовые кисти рук для таких роботов, которые не потребуется обучать базовым манипуляциям с нуля. Планшет Blackview MEGA 5 и умные очки BV200 поступили в продажу

01.06.2026 [11:51],

Владимир Мироненко

Компания Blackview объявила о старте глобальных продаж планшета Blackview MEGA 5 и умных очков BV200 с поддержкой ИИ, голосового управления и перевода в режиме реального времени.  Планшет Blackview MEGA 5 с 12,2-дюймовым дисплеем, разработанный для того, чтобы органично сочетать развлечения и продуктивность в одном универсальном устройстве, предназначен для широкого круга задач — от работы и учёбы до просмотра видео и других развлечений. Также, обладая компактными размерами и небольшим весом, он не займёт много места в походе или на отдыхе. 12,2-дюймовый IPS-дисплей с разрешением 2.4K (2400×1600 пикселей) с плотностью пикселей 236 ppi и соотношением площади экрана к поверхности корпуса 94,2 % обеспечивает чёткую детализацию изображения и комфортный просмотр контента. Адаптивная частота обновления до 120 Гц гарантирует плавную прокрутку интерфейса. Сертификация TÜV Rheinland Low Blue Light (Software Solution) подтверждает низкий уровень вредного для зрения синего света. Также планшет поддерживает несколько режимов защиты зрения, снижая нагрузку на глаза при длительном использовании. Благодаря поддержке Widevine L1 планшет обеспечивает потоковую передачу в формате Full HD 1080P на основных стриминговых платформах, таких как Netflix, YouTube и Disney+. Два динамика с поддержкой технологии Smart-K гарантируют высокое качество звука, способствуя более полному погружению в происходящее на экране. Стабильную работу планшета при запуске ресурсоёмких приложений и в режиме многозадачности обеспечивает восьмиядерный процессор Unisoc T7300, который набирает более 651 тыс. баллов в тесте AnTuTu, что на 64 % больше, чем популярный в этом сегменте процессор MediaTek Helio G99. Объём оперативной памяти составляет 48 Гбайт (с учётом виртуального расширения), ёмкость флеш-накопителя в формате UFS 3.1 — 256 Гбайт. Объём хранилища можно расширить ещё на 2 Тбайт благодаря слоту для карт памяти microSD. Для видеоконференций и селфи в планшете предусмотрена 13-мегапиксельная фронтальная камера. Так же есть основная 16-мегапиксельная камера для фото- и видеосъёмки. В качестве источника питания используется батарея ёмкостью 10 000 мА·ч с поддержкой быстрой зарядки мощностью до 55 Вт. Ёмкости батареи достаточно для до 9 часов воспроизведения видео. Планшет работает под управлением DokeOS_P 5.0 на базе Android 16 с набором ИИ-приложений Doke AI 2.0, включающим ИИ-модели DeepSeek-R1, GPT-4o mini и Gemini 2.0. MEGA 5 также поддерживает режим ПК 3.0, позволяющий переключаться между интерфейсами планшета и настольного компьютера. В этом режиме пользователь сможет открывать до 8 активных окон. Размеры планшета составляют 276,5 × 190,5 × 7,60 мм, вес — 635 г. MEGA 5 поставляется в стандартной комплектации с беспроводной клавиатурой, мышью и стилусом 2.0, а также защитным чехлом, защитной пленкой для экрана и проводными наушниками. Умные очки Blackview BV200 обеспечивают перевод в реальном времени, поддерживают голосовое управление и запись видео с разрешением 1200p, ИИ-помощника. Очки оснащены 8-мегапиксельной камерой на базе сенсора Sony IMX219, двумя стереодинамиками открытого типа, обеспечивающими качественный звук, с поддержкой шумоподавления ENC с использованием двух микрофонов, позволяя собеседнику слышать голос пользователя даже в шумном окружении. Для подключения к внешнему источнику сигнала используется протокол беспроводной связи Bluetooth 6.0. Вес Blackview BV200 составляет 43,8 г. Стоимость планшета Blackview MEGA 5 составляет от $216,99, умных очков Blackview BV200 — $46,99. Intel раскрыла детали серверного ИИ-ускорителя Crescent Island — до 350 Вт и 480 Гбайт LPDDR5X

01.06.2026 [10:59],

Алексей Разин

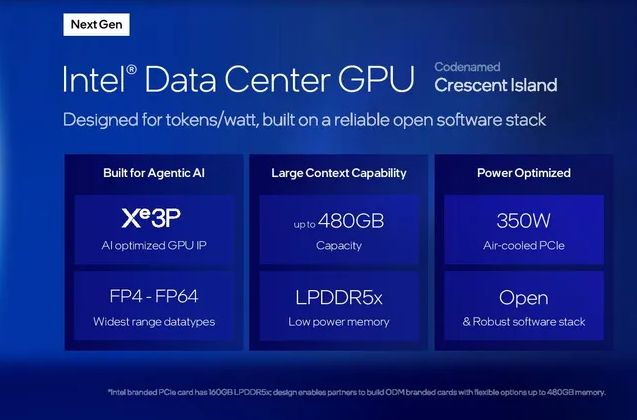

Казалось бы, у корпорации Intel в наличии не было приличных ИИ-ускорителей уже много лет, но смещение спроса на задачи инференса открыло перед компанией новые возможности. Ускоритель Crescent Island будет использовать память типа LPDDR5X в приличном объёме до 480 Гбайт, стараясь лучше себя раскрыть именно с этой стороны.

Источник изображений: Intel, Tom's Hardware Решение с незамысловатым обозначением Xe3P, по мнению Intel, изначально ориентируется на сферу агентских вычислений в ИИ. При уровне энергопотребления не более 350 Вт оно способно обеспечить поддержку до 480 Гбайт памяти типа LPDDR5X, хотя в эталонном исполнении соответствующий ускоритель ограничится втрое меньшим объёмом — 160 Гбайт. Скорее всего, для достижения максимальной ёмкости памяти понадобятся модули памяти LPDDR5X объёмом по 24 Гбайт. Совокупная пропускная способность достигнет 684 Гбайт/с.  Вычисления могут осуществляться с разной точностью, от FP4 до FP64. Уровень быстродействия Crescent Island пока не раскрывается, официальный анонс этого ускорителя должен состояться во второй половине текущего года. Подобное компоновочное решение при работе с ИИ-агентами имеет полное право на жизнь, поскольку в непосредственной близости от GPU будут располагаться относительно большие объёмы данных. Память типа GDDR или HBM в этом случае при сохранении того же объёма не только обошлась бы существенно дороже, но и не могла бы разместиться рядом с GPU в силу технических ограничений. В одной стойке наверняка смогут расположиться до восьми таких ускорителей с совокупным объёмом памяти 3,8 Тбайт. Некоторым разочарованием может стать лишь необходимость полагаться на специфическое ПО в виде стека oneAPI для работы с Crescent Island, но Intel обещает, что проблем с ним не возникнет. TSMC призналась, что стала выпускать чипы лучше и быстрее благодаря Nvidia

01.06.2026 [09:42],

Алексей Разин

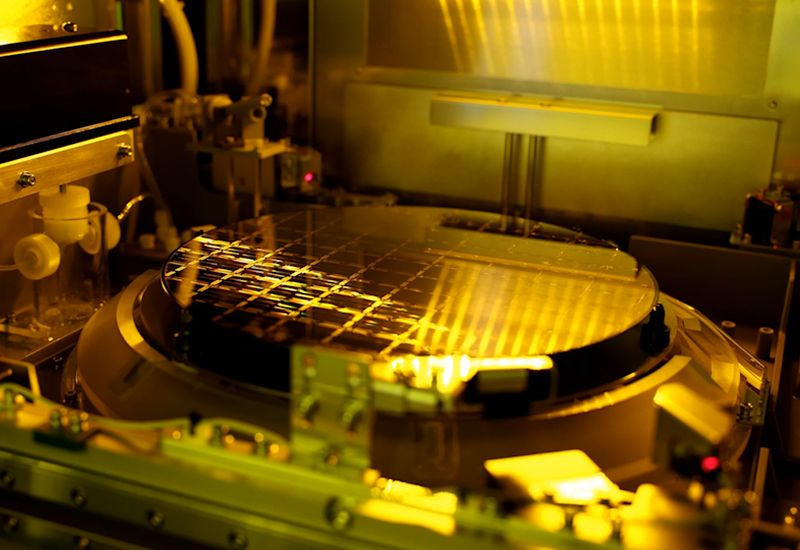

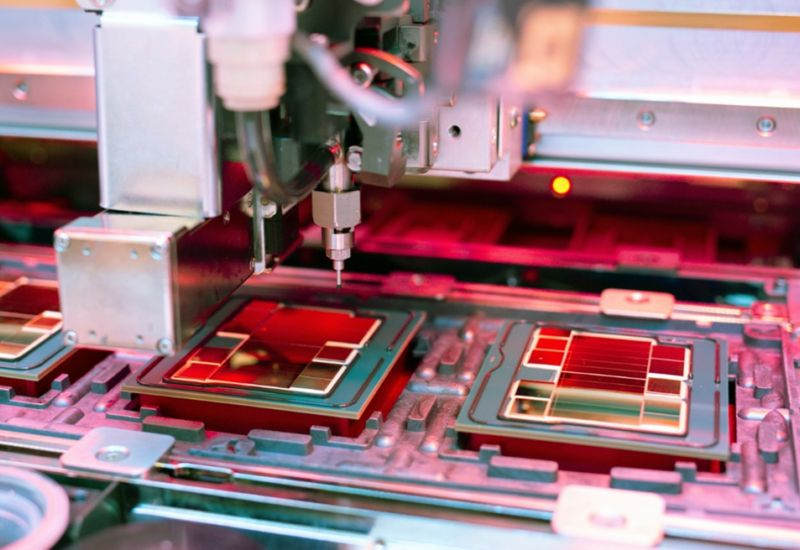

До сих пор считалось, что TSMC главным образом помогает Nvidia, осуществляя массовый выпуск чипов для неё, но компании на этой неделе привели пример и обратного взаимодействия. Технологии Nvidia помогают TSMC выпускать более качественные чипы и делать это быстрее, как отмечается в совместном пресс-релизе компаний.

Источник изображения: TSMC Вычислительная литография и симуляция процессов, происходящих на уровне транзисторов, позволяют TSMC улучшить производственные условия и ускорить разработку новинок. Искусственный интеллект при поддержке Nvidia теперь помогает быстрее проектировать чипы, быстрее осваивать их массовое производство и лучше контролировать показатели качества. В частности, так называемая вычислительная литография позволяет TSMC разрабатывать фотомаски для изготовления чипов на 20–50 % эффективнее по сравнению с методом, для которого вместо GPU используются CPU. Себестоимость при этом остаётся прежней. TSMC полагается на библиотеку cuLitho, которая ускоряет расчёты силами графических процессоров Nvidia. В области материаловедения TSMC полагается на инструмент cuEST, который позволяет симулировать свойства материалов на уровне транзисторов, ускоряя расчёты в области химии в 50 раз. За поддержку стабильности техпроцессов при производстве чипов в компании отвечает библиотека cuML компании Nvidia, позволяющая полагаться на технологии машинного обучения при контроле за технологическими процессами. Кроме того, ИИ-модели Nvidia позволяют оптимизировать логистические и производственные процессы TSMC, добиваясь максимальной отдачи с точки зрения объёмов выпуска продукции. Метод цифровых двойников и технология FabTwin активно для этого используется. Внедрение новых технологий сначала отрабатывается на виртуальном двойнике, и только в случае успеха переносится в реальный сценарий. Платформа Metropolis и инструментарий TAO Toolkit позволяют TSMC более эффективно осуществлять поиск дефектов при обработке кремниевых пластин. ИИ сам подстраивается под изменения в типах дефектов и не требует регулярного переобучения, позволяя сохранять качество продукции без дополнительных затрат времени. Венчурные капиталисты всё активнее вкладываются в стартапы, связанные с физическим воплощением ИИ

01.06.2026 [08:15],

Алексей Разин

Бум искусственного интеллекта породил спрос на новые типы компонентов, материалов, а также в целом заставил инвесторов пристальнее следить за сегментом человекоподобных роботов, поскольку они являются одним из наиболее перспективных видов физического воплощения ИИ. Венчурные инвестиции в смежные сферы за последние пару лет заметно увеличились.

Источник изображения: Nvidia Об этом говорит The Wall Street Journal со ссылкой на статистику PitchBook. Если в 2019 году инвестиции в сферу робототехники и физического ИИ привлекли в общей сложности $4,2 млрд венчурного капитала, то в прошлом году эта сумма уже достигла $26 млрд. Более того, с начала текущего года по состоянию на 20 мая соответствующие инвестиции уже составили более $23 млрд. Стартапы в сфере передовых вычислений, которые разрабатывают ИИ-чипы, решения для ЦОД и занимаются квантовыми технологиями, за весь прошлый год привлекли $28 млрд венчурного финансирования, а за неполные пять месяцев текущего года — более $20 млрд. Американские стартапы, связанные с критически важными минералами, в прошлом году привлекли рекордные $630 млн. На протяжении двух предыдущих десятилетий стартапы Кремниевой долины преимущественно сосредотачивались на потребительских интернет-технологиях и программном обеспечении, поэтому смещение фокуса в сторону «физического ИИ» является важной тенденцией. Именно прогресс искусственного интеллекта в сфере создания программного обеспечения заставил инвесторов искать новые направления, ведь разрабатывать ПО теперь может ИИ, поэтому нет особого смысла вкладывать в стартапы, которые делают это классическим методом. Физическим воплощением ИИ заинтересовались и те инвесторы, которые раньше развивали облачные решения, финтех и криптовалюту. Компания Paradigm, которая ранее специализировалась на криптовалютных стартапах, недавно вложилась в производителя листового металла SendCutSend, который снабжает своей продукцией центры обработки данных и робототехническую сферу. Джефф Безос (Jeff Bezos) недавно решил поддержать стартап Project Prometheus, который разрабатывает ИИ-системы, понимающие и симулирующие реальный мир. Сооснователь Uber Тревис Каланик (Travis Kalanick), опять же, вложился в стартап Atoms, создающих роботов для пищевой промышленности, транспортной и горнодобывающей отраслей. В наше время молодая компания в сфере робототехники может всего за несколько лет поднять капитализацию до нескольких миллиардов долларов, даже не располагая существенной выручкой или серийно выпускаемой продукцией. ИИ стал реже галлюцинировать, но всё ещё уверенно выдаёт ложь за правду

31.05.2026 [12:32],

Владимир Мироненко

Проблема галлюцинаций, то есть заведомо неверных ответов, которые предоставляют ИИ-модели, по-прежнему актуальна. Хотя ИИ-инструменты стали делать это реже, они всё ещё выдают неточные ответы, при этом подкрепляя их сверхубедительной риторикой, пишет Axios.

Источник изображения: Steve A Johnson/unsplash.com Ложные ответы гораздо сложнее распознать, когда они звучат убедительно. Это растущая проблема, поскольку пользователи всё больше полагаются на ИИ для исследований, медицинских консультаций и других задач. Исследование Йельской медицинской школы, проведенное в этом месяце, показало, что инструменты для ведения записей с помощью ИИ (ИИ-писцы) могут помочь в медицинской практике, но только в сочетании с профессиональными рецензентами. Участвовавшие в опросе студенты первого курса, которые редактировали свои клинические записи с помощью черновиков, сгенерированных ИИ, отметили, что в записях ИИ часто опускались важные детали, включая продолжительность симптомов. По словам двух третей студентов, эти записи были «полезны в качестве первого черновика», но 21 % отметили, что использование ИИ-писцов «может снизить способность научиться делать хорошие записи». Согласно исследованию Гарвардского университета, при попытке специалистов Boston Consulting Group выявить ошибки в результатах работы ИИ модель реагировала не раскаянием и исправлением, а «бомбардировкой убеждением», прибегая к различным методам и даже к лести. Компании в сфере ИИ пытаются уменьшить количество ложных ответов с помощью таких технологий, как генерация с дополненной информацией (RAG), или обоснование ответов релевантными документами и данными, но это всё равно не даёт 100-процентной точности. В свою очередь, проверка результатов работы ИИ может занять время, сэкономленное при использовании ИИ-инструментов. Как показало опубликованное в марте исследование, сотрудники часто пренебрегают проверкой результатов, сгенерированных ИИ, поскольку мало кто обращает внимание на ошибки. ИИ-агент Google Gemini Spark, который работает в облаке 24/7, вышел в ограниченный доступ

30.05.2026 [17:59],

Павел Котов

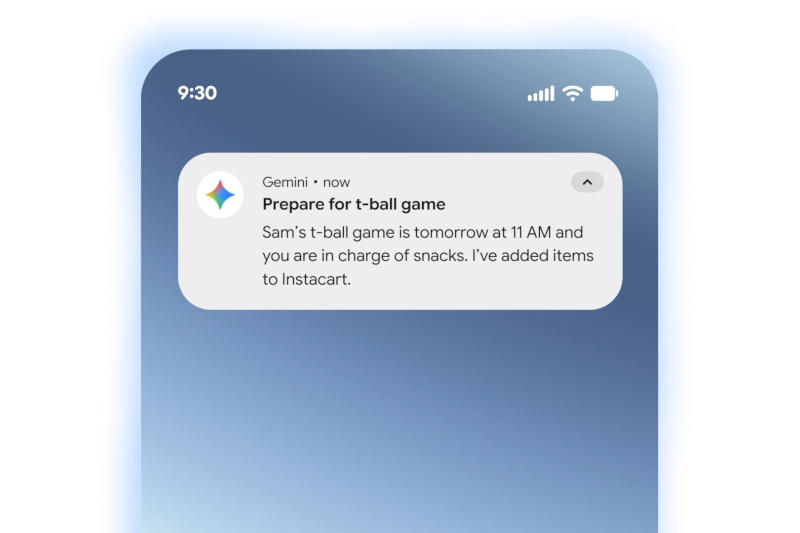

Агент искусственного интеллекта Gemini Spark стал доступен для подписчиков тарифного плана Google AI Ultra — чтобы воспользоваться приложением, требуется вносить плату в размере от $100 в месяц.

Источник изображения: blog.google Google описывает сервис Spark как постоянно действующего персонального агента, способного работать над задачами в фоновом режиме в инфраструктуре Google Cloud, даже когда компьютер или смартфон пользователя отключены. Приложение, построенное на платформе Google Antigravity, работает на основе модели Gemini Flash 3.5. Оно выходит за рамки того, что предлагает ИИ-помощник Gemini, выполняя действия от имени пользователей. К примеру, может забронировать авиабилет или номер в отеле; а также предлагает встроенную интеграцию с продуктами Google. Spark может подготовить отчёт по охвату бизнеса пользователя, используя электронные письма Gmail и события в «Google Календаре»; автоматически учесть и отразить разницу в ценах у поставщиков при подготовке к свадьбе или ремонту дома, — снова обращаясь к Gmail. Воспользоваться сервисом пока могут только подписчики Google AI Ultra в США с абонентской платой $100 в месяц. Рамками экосистемы Google ИИ-агент Spark не ограничивается — предусмотрено подключение к дизайнерскому приложению Canva, службе бронирования ресторанов OpenTable, продуктовой розничной сети Instacart; в ближайшее время список интеграций будет расширен. В инфографике отмечались такие партнёры как Adobe, Uber, Spotify и Booking. Google также намерена расширять набор функций сервиса: появится возможность отправлять текстовые сообщения и электронную почту, создавать субагентов и управлять локальным браузером. «Культурное интервью» — Anthropic придумала, как нанимать сотрудников, которые не разбегаются к конкурентам

30.05.2026 [14:03],

Павел Котов

Взрывной рост популярности Anthropic, нестандартная корпоративная культура компании и впечатляющие продукты сделали её самым востребованным работодателем в технологической отрасли. В объявлениях о вакансиях нередко фигурируют зарплаты в размере $250 тыс. в год, но чтобы устроиться сюда, требуются больше, чем ум и отличное резюме, пишет Bloomberg.

Источник изображений: anthropic.com В компании работают более 3000 человек, из которых около 1000 устроились в неё после ноября минувшего года. Ожидается приток новых сотрудников: в Anthropic требуются юристы, бухгалтеры, финансовые стратеги, специалисты по продажам и рекламе. Тратятся значительные средства на отдел по управлению персоналом и подбору кадров. Кадровик из Лондона Джейд Хуссейн (Jade Hussain) однажды опубликовала в соцсети LinkedIn пост о вакансии — в результате ей поступили более тысяч запросов на установление связи и более 200 сообщений на самом сайте. Начали даже звонить на номер, который не указывался в справочнике. Кандидатам, которым посчастливилось получить приглашение от кадровика Anthropic, предстоит пройти до пяти раундов строгих собеседований и оценки навыков. Искусственным интеллектом на этом этапе пользоваться запрещается, если явно не указано обратное. И прежде чем перейти собственно к собеседованию, все соискатели подписывают соглашение о неразглашении. Процесс найма включает в себя непростую беседу о корпоративной культуре — в Anthropic это особенно важный аспект. «Я трачу треть, а может и 40 % своего времени, чтобы убедиться, что корпоративная культура в Anthropic хороша», — признался глава компании Дарио Амодеи (Dario Amodei). Собеседование на соответствие кандидата корпоративной культуре — это попытка понять его ценности и мировоззрение, а также то, насколько серьёзно он относится к исходящим от ИИ угрозам. Данный этап должны проходить практически все потенциальные работники, в том числе научные сотрудники, бухгалтеры или специалисты по расчёту заработной платы. Многие это сравнивают не с собеседованием, а с психотерапией. Если проводящий это собеседование сотрудник даст соискателю низкую оценку, то его кандидатуру с высокой вероятностью отклонят.  Беседа начинается непринуждённо, с общих вопросов, но затем они становятся всё более личными. Затрагивается тема профессиональных этических дилемм; кандидатов спрашивают, как они чувствовали себя в той или иной ситуации, как реагировали в тот момент, и как относятся к этому сейчас. В Anthropic ищут сотрудников, способных уважительно обсуждать спорные вопросы с людьми, которые придерживаются иных взглядов, и эта способность также проверяется на собеседовании. «Мы спрашиваем людей, какие необычные убеждения у них есть, и как они защищали эти убеждения в неудобных для себя ситуациях, потому что считали это правильным. Мы не ищем какую-то конкретную систему убеждения. Мы ищем способность признать: „Я считал это правильным, и, возможно, это было непопулярно, но я действительно придерживался этого“», — рассказала президент компании Даниэла Амодеи (Daniela Amodei). Ещё одно качество, которое ценится в кандидатах, — интеллектуальная независимость. В компании не поощряют лесть, а скорее хотят, чтобы соискатель был настроен скептически по отношению к ней. Отказ может последовать, например, когда кандидат высказывает слишком банальные суждения. На ключевых должностях соискателям предлагают зарплаты до $850 тыс. в год. Сотрудники ведущих компаний по разработке ИИ после увольнения, возможно, смогут больше никогда не работать — в отдельных случаях выплаты достигают сотен миллионов долларов. Некоторые кандидаты платят немалые деньги за персональное обучение: пробные собеседования с действующими сотрудниками крупных технологических компаний обходятся в суммы от $170 до $550 в час, а полный курс подготовки может стоить около $4600. Уходить из Anthropic люди не хотят: компания может похвастаться показателем удержания сотрудников в 80 % за два года. Инженеры в 8 раз чаще переходят из OpenAI в Anthropic, чем наоборот, и почти в 11 раз чаще — из Google DeepMind. Недавно здесь начал работать бывший сотрудник OpenAI и Tesla Андрей Карпатый (Andrej Karpathy). Дарио Амодеи регулярно проводит с сотрудниками откровенные, всесторонние беседы, в ходе которых рассказывает «о происходящем в компании, о разрабатываемых моделях, о продуктах, внешней отрасли, о мире в целом в контексте ИИ и о геополитике». Он может позволить себе это, потому что имеет основание доверять подчинённым. Глава компании хочет добиться интенсивного её роста, сохраняя приверженность миссии, которая помогла определить компанию, хотя признаёт, что это очень непросто. Meta✴ готовится выпустить ИИ-кулон с голосовым управлением

30.05.2026 [13:24],

Павел Котов

Meta✴✴ собирается расширить присутствие в сегменте потребительских устройств с искусственным интеллектом. В недавней внутренней служебной записке изложены планы компании на выпуск новых умных устройств, в том числе кулона с ИИ, узнал ресурс The Information.

Источник изображения: limitless.ai В документе подробно описывается долгосрочная стратегия Meta✴✴ в области оборудования — она планирует занять центральное место в экосистеме ИИ. Для этого компания изучает функции персонализации и постоянного присутствия ИИ. Одним из примеров выступает кулон — носимое устройство с ИИ, способное выступать как носимый на шее цифровой помощник. Технические подробности не приводятся, но отмечается, что устройство будет ориентировано на голосовое взаимодействие с ИИ. О наличии камер или иных датчиков не сообщается. В плане развития также указывается намерение улучшить показатели убыточного подразделения Meta✴✴ Reality Labs, которое занимается разработкой устройств. Ещё одно направление — носимые устройства для корпоративных клиентов. Гигант соцсетей в своих намерениях не одинок: многие компании сегодня выпускают персональных помощников без экранов, носимые устройства с функциями ИИ и мультимодальные пользовательские интерфейсы с ИИ. Meta✴✴ стремится расширить свою инфраструктуру ИИ и возможности помощников в приложениях, умных очках и перспективных устройствах на фоне усиления конкуренции с OpenAI, Google и Apple. Конкретные сроки не приводятся, но упоминается, что разработку устройств с ИИ компания решила ускорить. В её ассортименте уже есть умные очки Ray-Ban Meta✴✴; глава компании Марк Цукерберг (Mark Zuckerberg) неоднократно указывал на намерение продвинуть её по таким направлениям как дополненная и виртуальная реальность. В 2025 году Meta✴✴ поглотила стартап Limitless, который разрабатывал кулон-зажим, способный записывать разговоры, расшифровывать их и при помощи генеративного ИИ составлять сводки. В 2024 году компания представила устройство за $99. Когда гигант соцсетей приобретал стартап, глава последнего заявил, что у двух компаний совпадает видение носимых устройств с ИИ и «персонального суперинтеллекта». Тайваньские власти подозревают, что ИИ-чипы Nvidia попадали в Китай через Японию в обход санкций

30.05.2026 [06:09],

Алексей Разин

Трое задержанных на прошлой неделе на Тайване подозреваемых в организации контрабанды лиц, как предполагает следствие, могли бы замешаны как минимум в одной поставке ИИ-ускорителей Nvidia в Китай в обход американских правил экспортного контроля с использованием Японии в качестве промежуточной страны.

Источник изображения: Nvidia Как поясняет Bloomberg, подозреваемым сперва пришлось экспортировать партию ускорителей с Тайваня в Японию, а затем уже организовать её поставку в КНР через Гонконг. В деле фигурирует партия серверного оборудования Supermicro, содержащего ИИ-ускорители Nvidia, поставки которых в Китай запрещены правилами экспортного контроля США. Трио подозреваемых для реализации своего замысла подделало документы на отгружаемую продукцию, как считает следствие. После ареста подозреваемых была выявлена партия из 50 серверов, которые также готовились к поставке в Китай по подложным документам. Установлено, что группа успела провести через тайваньскую таможню как минимум одну партию ИИ-ускорителей Nvidia, которые запрещены к поставкам в Китай. Размер этой партии не уточняется. Следствие предполагает, что и захваченные на Тайване 50 серверов должны были отправиться в КНР через Японию. Последняя из стран впервые фигурирует в подобном контексте, поскольку считается близким геополитическим союзником США, не допускающим подобных проколов в вопросах экспортного контроля. При этом китайские разработчики могут вполне легально арендовать ЦОД с запрещёнными к поставке в КНР ускорителями Nvidia, если соответствующие вычислительные мощности расположены в Японии или других окрестных странах Азии. Тайваньские следователи не предъявляют никаких обвинений Nvidia и Supermicro, чья продукция фигурирует в этом деле. По словам главы первой из компаний, она тщательным образом разъясняет правила экспортного контроля своим клиентам. Supermicro, по его словам, нужно усилить контроль за поставками своей продукции и провести собственное расследование. Как пояснили представители Supermicro, фигурирующие в тайваньском деле серверные системы были изначально проданы авторизованному партнёру компании, который должен был следовать всем сопутствующим ограничениям. По мнению представителей компании, над усилением контроля за цепочками поставок должна работать вся отрасль, чтобы соответствующие меры были достаточно эффективными. MediaTek утверждает, что чипы для её клиентов теперь способна упаковывать и Intel

30.05.2026 [05:18],

Алексей Разин

Корпорация Intel ещё при прежнем генеральном директоре Патрике Гелсингере (Patrick Gelsinger) начала активно продвигать свои услуги по упаковке чипов за пределами собственных потребностей. Похоже, тайваньский разработчик чипов MediaTek счёл их подходящими для собственного использования, и теперь чипы клиентов этой компании смогут упаковывать TSMC и Intel.

Источник изображения: Intel По крайней мере, об этом заявил старший вице-президент MediaTek Винс Ху (Vince Hu), на слова которого ссылается Nikkei Asian Review: «Мы теперь одни из немногих, кто может предложить упаковку чипов силами как TSMC, так и Intel». Непосредственно MediaTek чипы не выпускает, она их только разрабатывает, а изготовлением их традиционно занимаются специализированные подрядчики типа TSMC. Поскольку спрос на чипы со сложной пространственной компоновкой растёт, роль технологий их упаковки возрастает. В этих условиях заполучить ещё одного партнёра в лице Intel для MediaTek крайне важно. MediaTek пользуется услугами TSMC по упаковке чипов передовым методом CoWoS, но она не одинока в этой сфере — подобным образом поступают AMD, Nvidia, Broadcom, Amazon и Google. В результате мощностей TSMC на всех желающих не хватает. Интерес к услугам Intel в этой сфере проявляет не только MediaTek, но и Google. В свою очередь, MediaTek желает активнее участвовать в буме ИИ, который с точки зрения компонентов сосредоточен на серверном направлении, а там возможности упаковки чипов весьма важны. Сотрудничество с Intel, тем самым, откроет перед MediaTek новые возможности. В текущем году компания собирается в сегменте ИИ-серверов выручить $2 млрд, а в следующем готова превзойти этот уровень. По данным Nikkei, компания MediaTek помогает Google разработать кастомные ИИ-чипы, которые будут использовать фирменную упаковку EMIB, предлагаемую компанией Intel. Если такое сотрудничество состоится, новый крупный контракт пойдёт на пользу последней, поскольку контрактный бизнес Intel остаётся глубоко убыточным. Помогать Google разрабатывать ИИ-чипы тайваньская MediaTek начала довольно давно. Сама MediaTek при этом продолжает полагаться на возможности TSMC в сфере производства чипов по передовым технологиям. Она уже получает от этого подрядчика образцы чипов, выполненные по ангстремной технологии A14 (1,4-нм), их массовое производство должно быть запущено в 2028 году. В сфере автомобильной электроники MediaTek готовит для клиентов чипы, которые будут выпускаться по 2-нм техпроцессу. Кроме того, в этом году будет представлен флагманский чип MediaTek для смартфонов, который также будет производиться по 2-нм технологии. Часть 4-нм и 3-нм чипов MediaTek начнёт выпускаться на предприятиях TSMC в Аризоне. Lenovo пережила лучший месяц за 27 лет — её стоимость взлетела вдвое

29.05.2026 [17:15],

Павел Котов

Сегодня акции Lenovo взлетели на 31 %, а рост за месяц составил 109 %, и это самый больший месячный рост для компании с 1999 года. Оптимизма инвесторам придал финансовый отчёт компании — он показал, что выручка от оборудования для систем искусственного интеллекта помогла компенсировать проблемы, связанные с ростом стоимости компонентов.  Lenovo стала лидером индекса Hang Seng China Enterprises, то есть возглавила список компаний из материкового Китая, которые торгуются на Гонконгской бирже. Масла в огонь подлил оптимистический прогноз Dell Technologies, связанный с высоким спросом на серверы для ИИ, — он способствовал росту акций компьютерных компаний по всей Азии. Прогноз Dell подогрел оптимизм и в отношении Lenovo, которую всё чаще рассматривают как объект для инвестиций в ИИ. Несмотря на дефицит чипов памяти, Lenovo сумела сохранить рентабельность на стабильном уровне и подтвердила тезис, что она находится в более выгодном положении, чем более мелкие конкуренты. Настроения инвесторов подкрепляются оптимизмом в отношении бизнеса по производству серверов и агентов ИИ; наконец, в Goldman Sachs улучшили прогноз по Lenovo, удвоив целевую цену акций компании. Резкое подорожание ценных бумаг для компании, занимающейся производством компьютерного оборудования, нехарактерно для других технологических компаний на Гонконгской бирже — они вынуждены выживать в условиях жёсткой конкуренции и недостаточно высокой прибыльности из-за необходимости значительных инвестиций в оборудование и инфраструктуру для ИИ. Индекс Hang Seng Tech в этом году снизился на 12 %. Стартап Shift предложил бесплатную уборку домов ради обучения роботов

29.05.2026 [16:20],

Павел Котов

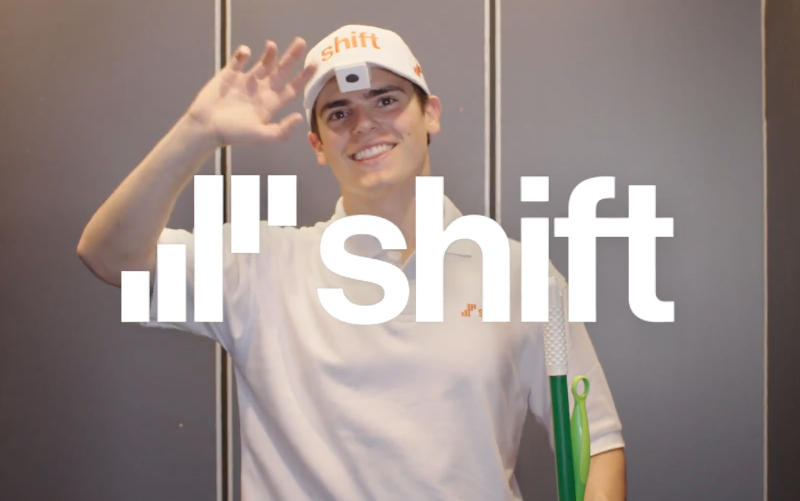

Специализирующийся на обучении искусственного интеллекта стартап Shift предложил всем желающим бесплатную уборку дома. Взамен требуется разрешить запись всех действий сотрудников компании во время мытья, уборки пылесосом, протирки пыли и наведения порядка — всё это будет использоваться при обучении роботов.

Источник изображения: shiftapp.nyc Стоимость данных для обучения, пояснили в компании, более чем достаточна, чтобы финансировать эту услугу. «Вы получаете безупречно чистую квартиру. Мы получаем данные для обучения. В выигрыше все», — пояснили в Shift. Рекламный ролик демонстрирует уборщика в белой униформе и нелепом головном уборе (о нём далее), который моет окна, пылесосит и моет полы, моет посуду и вытирает столы. Запись всех этих действий ведёт эта «волшебная шапка» — не высокая мода, конечно, но она оснащена камерой, которая ведёт съёмку с точки зрения уборщика. «Конфиденциальность клиентов полностью защищена», заверяют в компании: имена, лица, личная информация на экранах и удостоверениях личности размываются и анонимизируются перед отправкой в массив для обучения ИИ. Уборщики проходят проверку у партнёров Shift — сотрудниками самой компании они не являются. «Каждая уборка дома сегодня закладывает основу для дома, который будет убираться сам завтра», — отмечают в компании. И, как оказалось, чем грязнее в доме, тем лучше: «более сложные условия для уборки могут быть особенно полезны». Но есть и ограничения — работники вольны «отказаться от любой конкретной задачи, выполнять которую не готовы». Сейчас услуга доступна только в Нью-Йорке, и «очень скоро» она будет предлагаться также в Сан-Франциско, Лондоне, Цюрихе и Мюнхене. Бесплатная уборка будет актуальна в течение «ограниченного [периода] времени», но сама бизнес-модель вполне вписывается в рынок записи действий человека, которые можно использовать для обучения систем ИИ и роботов. Shift уже платит десяткам тысяч людей в 15 странах за то, что они записывают свои действия через приложение. В перспективе компания намерена переключиться с уборки на ремонт сантехники, приготовление пищи и строительство. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |