|

Опрос

|

реклама

Быстрый переход

Галлюцинации ИИ пугают людей больше, чем угроза потери рабочих мест

23.03.2026 [08:17],

Алексей Разин

До сих пор считалось, что искусственный интеллект может представлять угрозу для трудоустройства обладателей определённых профессий, но проведённый среди пользователей Anthropic Claude опрос показал, что людей больше всего пугает склонность ИИ к ошибкам и галлюцинациям.

Источник изображения: Nvidia Об этом говорят данные социологического исследования, которое охватило более 80 000 пользователей чат-бота Claude в 159 странах, как отмечает Financial Times. Сильнейшей угрозой со стороны искусственного интеллекта 27 % опрошенных назвали его склонность к совершению ошибок. Утрата рабочих мест из-за распространения ИИ оказалась лишь на втором месте с 22 % ответов. Ещё 16 % респондентов выделили свои опасения по поводу утраты человечеством способности критически мыслить в качестве дополнительной угрозы со стороны ИИ. Участники опроса подчёркивали, что галлюцинации ИИ не только отнимают много времени на их устранение, но и могут влиять на результаты работы без надлежащего экспертного контроля со стороны человека. В целом, результаты опроса сформировали довольно равномерное распределение ответов по типам угроз. Влияние ИИ на процессы управления выделили 15 % респондентов, угрозу распространения дезинформации назвали 14 % респондентов. По 13 % назвали злонамеренное использование и слежку соответственно в качестве главных факторов риска. По 12 % подчеркнули демотивацию творчества и чрезмерность регулирования соответственно, по 11 % сделали выбор в пользу подхалимства и психологической зависимости от ИИ в качестве основных проблем, связанных с его распространением. При этом 32 % опрошенных пользователей Claude заявили, что ИИ повысил производительность их труда. Один из веб-дизайнеров в ОАЭ признался, что ИИ помогает заменить работу примерно 100 человек, и теперь не нужно ждать, пока они справятся со своими заданиями. Пользователи Claude в Японии, США и Колумбии подчеркнули, что ИИ помог им освободить от работы больше времени для нахождения с близкими и хобби. Примерно 19 % респондентов признались, что ИИ не оправдал их ожиданий в полной мере. Примечательно, что эмоциональное восприятие ИИ разнится в зависимости от географического региона, в котором проживают пользователи Claude. В Африке, Южной Америке, на юге и юго-востоке Азии данные технологии воспринимаются людьми с более выраженным оптимизмом, чем в США, Европе и Восточной Азии. По сути, в пользу ИИ больше верят жители стран с более низким уровнем жизни, которым эти технологии доступны в меньшей мере. В странах Запада сильнее выражено беспокойство по поводу способности ИИ негативно влиять на экономику в целом и рынок труда в частности. Anthropic собирается использовать подобные опросы для корректировки стратегии развития своих ИИ-моделей, поскольку их можно будет адаптировать под требования конкретных регионов. Проведённый опрос имел серьёзный перекос в сторону западных стран, поскольку в Центральной Азии, например, набралось не более нескольких сотен опрошенных. Это могло повлиять на представительность ответов, а потому результаты исследования необходимо воспринимать критически, как подчёркивают эксперты. Даже в США выборка не была представительной, поскольку доступ к Claude имеют довольно обеспеченные жители страны. OpenAI планирует удвоить штат ради укрепления корпоративных продаж ChatGPT

22.03.2026 [07:35],

Дмитрий Федоров

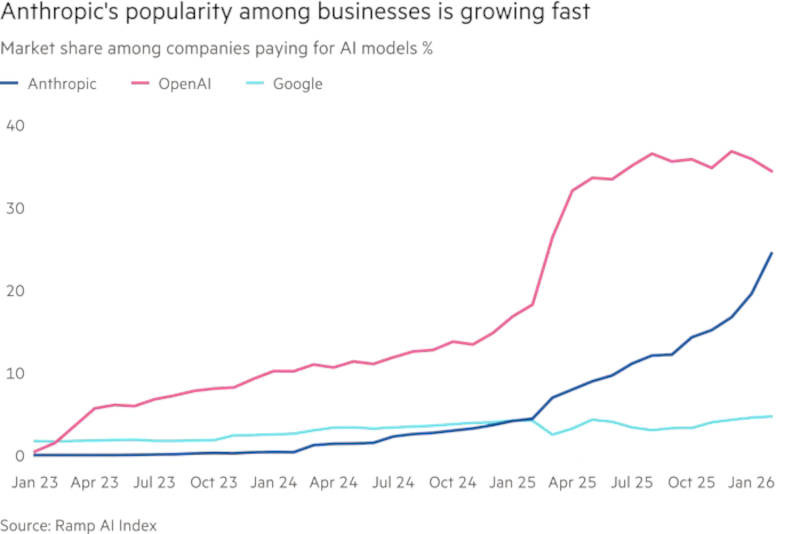

К концу 2026 года OpenAI готовит почти двукратное расширение штата. Параллельно стартап с оценкой капитализации в $730 млрд усиливает продажи корпоративным клиентам, расширяет офисные площади в Сан-Франциско и меняет продуктовые приоритеты, пытаясь сократить отставание от Anthropic и укрепить позиции в корпоративном сегменте, где Anthropic в последние месяцы наращивает преимущество, а также сдержать давление со стороны Google.

Источник изображения: openai.com По данным источников, компания намерена увеличить численность сотрудников примерно с 4 500 до 8 000 человек к концу 2026 года. Новые сотрудники, как ожидается, будут наняты прежде всего в продуктовые, инженерные, исследовательские и коммерческие подразделения. Отдельный акцент компания делает на специалистах по техническому сопровождению внедрения. Их задача — помогать заказчикам быстрее интегрировать инструменты OpenAI в рабочие процессы и повышать прикладную отдачу от использования ИИ. Компания заключила новый договор аренды в Сан-Франциско, увеличив общий объём занимаемых площадей в городе до 92 903 м2. По словам источников, в 2026 году компания рассчитывает расти примерно на 12 сотрудников в день. Такой темп указывает на системное масштабирование, а не на донабор отдельных команд. Перестройка связана с ухудшением позиций OpenAI в корпоративных продажах. По данным финтех-компании Ramp с более чем 50 000 клиентов, компании, впервые закупающие решения на базе ИИ, выбирают Anthropic в 3 раза чаще, чем OpenAI. Год назад ситуация была обратной. В OpenAI с такой оценкой не согласны. Представитель компании заявил, что делать выводы о доле корпоративного рынка на основе данных платежей по банковским картам некорректно, поскольку крупные клиенты не оплачивают многомиллионные контракты картами и, вероятно, вообще не используют Ramp для таких платежей. В конце 2025 года генеральный директор OpenAI Сэм Альтман (Sam Altman), как сообщалось, объявил внутри компании о всеобщей мобилизации ресурсов и потребовал вернуть фокус на ключевой продукт — ChatGPT. В марте 2026 года руководитель прикладного бизнеса OpenAI Фиджи Симо (Fidji Simo) призвала сотрудников отказаться от второстепенных задач и сосредоточиться на трёх направлениях: развитии Codex, расширении корпоративной клиентской базы и превращении ChatGPT в полноценный инструмент продуктивной работы.

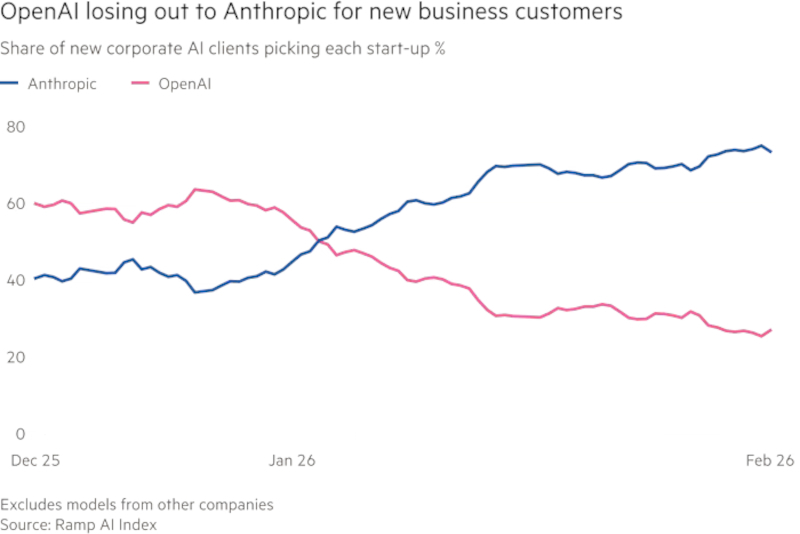

Anthropic быстро наращивает долю в корпоративном ИИ. Источник изображения: ramp.com Симо также курирует объединение Codex и ChatGPT в единое настольное приложение, которое планируется продавать как частным пользователям, так и компаниям. Параллельно OpenAI обсуждает с инвестиционными фондами создание совместного предприятия для внедрения своих продуктов в портфельных компаниях этих фондов. Для компании это способ быстрее расширить присутствие в корпоративной среде. ChatGPT остаётся самым успешным массовым приложением в сфере генеративного ИИ с момента запуска в 2023 году. При этом более 90 % из не менее чем 900 млн пользователей, регулярно взаимодействующих с сервисом, не платят OpenAI. Компания располагает огромной аудиторией, но значительная её часть не формирует выручку. Поэтому OpenAI одновременно ищет способы монетизации массовой базы, включая рекламу, и усиливает корпоративные продажи, где контракты крупнее и выручка устойчивее. Anthropic с самого начала выбрала более узкую стратегию. Основанная в 2021 году бывшими исследователями OpenAI, компания сделала ставку прежде всего на корпоративных заказчиков. После запуска Claude Code эта стратегия, по данным источников, начала приносить особенно быстрый результат: в 2026 году Anthropic еженедельно увеличивала годовой темп выручки на $1 млрд. Это один из факторов, заставивших OpenAI ускорить пересмотр приоритетов. При этом ни OpenAI, ни Anthropic пока не вышли на прибыльность. Обе компании тратят на обучение ИИ-моделей на миллиарды долларов больше, чем зарабатывают. На этом фоне для них критически важно одновременно удерживать технологический темп, сокращать издержки, наращивать выручку и приближаться к прибыли, особенно с учётом возможной подготовки к публичному размещению акций (IPO) уже в 2026 году.

Anthropic опережает OpenAI у новых корпоративных клиентов. Источник изображения: ramp.com Следствием этого стало и быстрое распространение практики найма инженеров, работающих непосредственно у заказчика. Такие специалисты помогают адаптировать ИИ-модели, настраивать интеграции и ускорять внедрение. Подход, который раньше активно использовала Palantir, становится одним из стандартов рынка генеративного ИИ. OpenAI рассчитывает, что к концу 2026 года около 50 % её выручки будет приходиться на корпоративных клиентов против примерно 40 % сейчас. Это означает, что корпоративный сегмент становится опорной частью её финансовой модели. Внутри OpenAI новый акцент связывают прежде всего с успехом инструментов для программирования, таких как Claude Code и Codex. По словам одного из руководителей компании, именно эти продукты открыли для бизнеса новые направления роста и заставили OpenAI изменить представление о том, как строить продуктовую линейку и работать с рынком. Риск этой стратегии в том, что OpenAI приходится одновременно догонять Anthropic в корпоративном сегменте и удерживать позиции в массовом рынке, где с высокой интенсивностью конкурирует Google. Именно поэтому нынешнее расширение штата, рост офисных площадей и смещение продуктового фокуса следует рассматривать не как обычный этап развития, а как попытку заново определить место компании на быстро меняющемся рынке. Пентагон принял боевую ИИ-систему Palantir Maven в качестве основной для армии США

21.03.2026 [12:18],

Алексей Разин

Скандал с исключением Anthropic из числа благонадёжных поставщиков ИИ-решений с точки зрения Пентагона привлёк внимание общественности к деятельности американского военного ведомства по интеграции технологий искусственного интеллекта в свои операции. Новая памятка, полученная сотрудниками этого ведомства, гласит о выборе системы Maven компании Palantir в качестве основной для Пентагона.

Источник изображения: Palantir При этом сама по себе ИИ-система Maven не является новой для Министерства войны США, просто теперь она будет использоваться в качестве базовой для построения всех прочих решений в сфере искусственного интеллекта, связанных с ведением боевых действий и разведывательной деятельностью. В своём письме сотрудникам Пентагона от 9 марта заместитель министра обороны США Стив Файнберг (Steve Feinberg) подтвердил выбор Maven в качестве основной ИИ-системы в инфраструктуре военного ведомства США. На документальном уровне данный выбор будет окончательно закреплён к сентябрю текущего года, когда завершится очередной фискальный год. Maven является ИИ-системой для боевого применения, которая позволяет обнаруживать цели на поле боя путём анализа поступающей разведывательной информации сразу по нескольким каналам. Только за время текущей операции США в Иране данная система позволила выбрать цели и нанести тысячи ударов по ним. Утверждение Maven в качестве главной системы такого типа позволит американским военным стандартизировать её применение во всех подразделениях и обеспечит Palantir долгосрочными оборонными контрактами. До сих пор эти контракты курировало Национальное агентство геопространственной разведки США, но в результате принятых решений они перейдут под контроль верховного командования американской армии. Только один контракт Palantir с американскими военными прошлым летом принёс компании $10 млрд, а в целом их было заключено несколько штук. Капитализация этого оборонного подрядчика оценивается в $360 млрд. Система Maven обучена в автоматическом режиме обнаруживать цели на поле боя, идентифицировать возможные укрытия и склады боеприпасов и горючего. На решение соответствующих задач привычными методами ранее уходили часы. Palantir подчёркивает, что конечное решение о применении оружия делает человек, а система Maven только определяет цели. Разработка системы ведётся с 2017 года, первый контракт с Пентагоном был заключён компанией Palantir в 2024 году, принеся ей $480 млн. В мае прошлого года потолок финансирования был увеличен до $1,3 млрд. Примечательно, что сама Palantir использует для работы своих систем ИИ-решения Anthropic, от которых теперь придётся избавляться, если соответствующий запрет не будет снят. Подрядчики Пентагона и его сотрудники не спешат отказываться от использования Anthropic

20.03.2026 [12:27],

Алексей Разин

Три недели назад противоречия между Anthropic и руководством Пентагона привели к тому, что профильное программное обеспечение было запрещено к использованию в деятельности не только самого Министерства войны США, но и его подрядчиков в оборонной сфере. При этом фактически пользователи Anthropic в этой сфере не торопятся от него отказываться.

Источник изображения: Anthropic Напомним, руководство Anthropic выразило озабоченность по поводу возможности использования разработанных компанией систем для тотальной слежки за гражданами США и применения оружия в автоматическом режиме, это вызвало недовольство представителей американского военного ведомства, в результате контракт на использование чат-бота Claude в военной инфраструктуре США был расторгнут, а сама Anthropic была отнесена к числу неблагонадёжных поставщиков. Военному ведомству США и части его подрядчиков теперь предстоит перевести свои ИИ-системы на альтернативные платформы в течение шести месяцев. OpenAI уже подписала контракт с Пентагоном и надеется стать таким «заменителем». Как поясняет Reuters, на деле отказываться от использования инструментов Anthropic не торопятся не только подрядчики Пентагона, но и его сотрудники. Во-первых, на их использование завязаны многие процессы, прерывать которые в условиях высокой военной активности США просто не представляется возможным. Во-вторых, пользователи считают решения Anthropic более удобными или эффективными по сравнению с доступными альтернативами. Специалисты Пентагона в сфере информационных технологий директивой по отказу от Anthropic недовольны по той причине, что только недавно научились использовать профильные системы в комфортном для себя режиме, а теперь их заставляют всё разрушить. Многие считают Claude самым совершенным на данный момент чат-ботом. Один из подрядчиков Пентагона добавил, что повторная сертификация систем на новой платформе потребует многих месяцев, а в худшем случае — до полутора лет. Кроме того, переход на новую платформу потребует от Пентагона новых крупных затрат. Наконец, на функциональных процессах Министерства войны США подобная миграция также негативно скажется. Контракт Anthropic с американским военным ведомством на сумму $200 млн был заключён в июле прошлого года, Claude удалось интегрировать в ведомственные системы, управляющие секретными операциями, глубина этой интеграции по состоянию на конец февраля была очень большой. В ходе иранской операции американские военные продолжают использовать разработки Anthropic даже в условиях запрета. Некоторые сотрудники Пентагона всё же вынуждены подчиняться запрету на использование инструментов Anthropic. В отдельных случаях от успешной автоматизации обработки данных приходится возвращаться к ручной работе с тем же Excel, например. Для написания программного кода в Пентагоне Claude Code также активно использовался в последние месяцы. Известная в определённых кругах компания Palantir, являющаяся крупным подрядчиком Пентагона, использует решения Anthropic в контрактах с ведомством на общую сумму более $1 млрд. Перестройка инфраструктуры под другое ПО потребует не только времени, но и серьёзных финансовых затрат. В некоторых случаях решения Anthropic используются для формирования потоков данных, которые требуются Пентагону буквально на ежеминутной основе, и отказаться от этого ПО крайне сложно. Некоторые подрядчики ведомства задумались о том, чтобы при отказе от использования решений Anthropic оставить возможность быстрого возврата к ним. В этом случае представители отрасли надеются, что Пентагон отменит свой запрет до истечения шестимесячного срока, отведённого для миграции. «Это не инопланетянин»: глава Nvidia призвал отрасль ИИ перестать пугать людей страшилками о технологии

20.03.2026 [09:45],

Алексей Разин

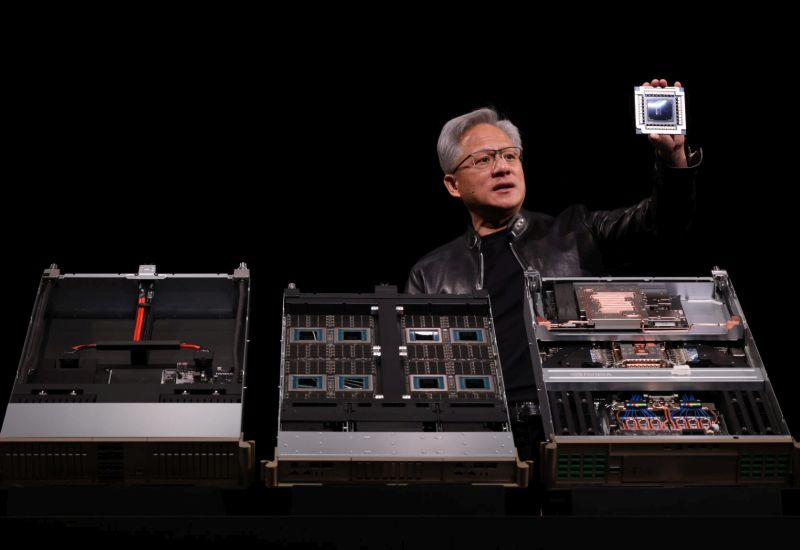

Затянувшаяся история с конфликтом Anthropic и Пентагона по поводу безопасного и этичного использования ИИ в военной сфере не оставила шансов основателю Nvidia Дженсену Хуангу (Jensen Huang) отмолчаться на эту тему. Он призвал руководителей компаний, создающих генеративный ИИ, не «пугать людей страшилками» по поводу последствий его использования.

Источник изображения: Nvidia «Желание предупредить людей о возможностях технологии — это потрясающе. Предупреждать — хорошо, пугать уже хуже, потому что эта технология очень важна для нас», — заявил глава Nvidia с трибуны конференции GTC 2026. По мнению Хуанга, для национальной безопасности США главным риском сейчас являются сами опасения по поводу того, что страна отстаёт от соперников в сфере освоения новых технологий. Даже с учётом отстранения Anthropic от выполнения оборонных контрактов в США, по мнению Хуанга, дела у этой компании в финансовом плане пойдут нормально. Он считает, что к 2030 году выручка Anthropic перевалит за $1 трлн. По его мнению, глава стартапа Дарио Амодеи (Dario Amodei) в своих собственных прогнозах на этот счёт излишне консервативен. Как добавил Хуанг, представителям отрасли следует меньше стращать окружающих по поводу угроз, исходящих от ИИ. «Это не что-то биологическое. Это не инопланетянин. У него нет сознания. Это компьютерная программа. Говорить довольно экстремальные вещи, довольно катастрофичные, для которых нет никаких предпосылок к реализации, — само по себе может приносить больше ущерба, чем думают люди», — пояснил Дженсен Хуанг. Он также призвал власти США не провоцировать Китай к захвату острова Тайвань, на котором сам родился и жил в детстве, пока родители не переехали в США, забрав с собой будущего основателя Nvidia. «Давайте демонстрировать сдержанность, никого ни к чему не подталкивать», — посоветовал глава Nvidia. При этом он призвал снизить концентрацию производства чипов на Тайване за счёт развития полупроводниковой промышленности не только в Южной Корее и Японии, но и в США. В последнем случае нужно действовать максимально быстро, как убеждён основатель Nvidia. Опыт Тайваня в сфере производства передовых чипов, по его словам, «заслуживает нашей дружбы и поддержки». Anthropic догоняет OpenAI в сфере ИИ для бизнеса

19.03.2026 [13:03],

Дмитрий Федоров

Anthropic ускоряет рост на корпоративном рынке ИИ. В феврале её бизнес-подписки выросли на 4,9 % месяц к месяцу, тогда как доля OpenAI снизилась на 1,5 %. Последняя пока сохраняет лидерство на корпоративном рынке подписок с долей 34,4 % против 24,4 % у Anthropic, однако разрыв быстро сокращается на фоне конфликта вокруг сотрудничества с военным сектором США и роста интереса к ИИ-моделям Claude.

Источник изображения: Anthropic Экономист Ramp Ара Харазян (Ara Kharazian) сообщил, что почти каждая четвёртая компания, работающая через Ramp, теперь платит за Anthropic, тогда как год назад такой была одна из 25 организаций. Снижение OpenAI на 1,5 % он назвал крупнейшим месячным падением среди всех компаний-разработчиков ИИ-моделей за всё время наблюдений за корпоративным внедрением ИИ. По словам Харазяна, компании, впервые выбирающие ИИ-сервисы, теперь примерно в 70 % случаев выбирают Anthropic. Одновременно OpenAI, по имеющимся данным, пересматривает стратегию и усиливает фокус на продажах ИИ бизнесу и разработчикам программного обеспечения — именно в тех сегментах, где Anthropic показывает наибольший рост. Рост интереса к Claude совпал с конфликтом между Anthropic и Министерством войны США (DoW). В конце января Reuters сообщило о разногласиях, вызванных отказом компании снять защитные ограничения с ИИ-моделей, чтобы сделать их более пригодными для военного применения. В конце февраля Anthropic публично выступила против такого давления. 4 марта компания заявила, что получила уведомление о признании её рискованной организацией для цепочки поставок с точки зрения национальной безопасности США. После этого Anthropic подала иски, оспаривающие фактическое исключение компании из взаимодействия с DoW. Этот конфликт не улучшил отношения Anthropic с администрацией Дональда Трампа (Donald Trump). По данным Sensor Tower, конфликт с DoW совпал со всплеском установок Claude и ростом числа удалений ChatGPT. На положении OpenAI также могло сказаться сотрудничество компании с Пентагоном и признание её генерального директора Сэма Альтмана (Sam Altman), что ситуация была урегулирована неудачно. После конфликта с DoW компанию Claude публично поддержали американская певица Кэти Перри (Katy Perry) и сенатор США Брайан Шатц (Brian Schatz). Харазян описал этот эффект так: «Anthropic позиционировала себя иначе, и определённая категория пользователей это заметила». К этой же аудитории относятся пользователи, готовые платить $20 или $200 в месяц за доступ к Claude и испытывающие неприязнь к OpenAI из-за рекламы в ChatGPT. В феврале Anthropic сообщила, что её годовой темп выручки достиг $14 млрд. Тогда же компания объявила о привлечении ещё $30 млрд. При этом в судебном документе, поданном ранее, финансовый директор Anthropic Кришна Рао (Krishna Rao) указал, что с момента выхода компании на коммерческий рынок она получила более $5 млрд выручки. «Неприемлемый риск для национальной безопасности»: Минобороны США ответило на иски Anthropic

18.03.2026 [19:26],

Владимир Фетисов

Министерство обороны США заявило, что компания Anthropic представляет «неприемлемый риск национальной безопасности». Это первое официальное заявление ведомства в ответ на иски ИИ-разработчика, пытающегося оспорить решение министра обороны Пита Хегсета (Pete Hegseth) о присвоении Anthropic статуса компании, представляющей риски для цепочки поставок. Компания просит суд приостановить исполнение этого решения Минобороны до окончания разбирательства.

Источник изображения: Anthropic Суть аргументации Минобороны, изложенной в 40-страничном заявлении, поданном в федеральный суд Калифорнии, заключается в опасении, что Anthropic может «попытаться отключить свои технологии или упреждающе изменить поведение своих ИИ-моделей» до или во время «боевых операций», если компания «почувствует, что её корпоративные „красные линии“ могут быть пересечены». Минувшим летом Anthropic подписала с Пентагоном соглашение на $200 млн на развёртывание своих алгоритмов в закрытых системах. В ходе последующих переговоров об изменении условий контракта компания выразила несогласие с тем, чтобы её ИИ-алгоритмы использовались для массовой слежки за американцами, а также заявила, что технология ещё не готова к применению в системах наведения или принятия решений о применении летального оружия. Пентагон в ответ заявил, что частная компания не может диктовать военным условия использования технологий. Некоторые компании выступили против действий Минобороны: OpenAI, Google, Microsoft и их сотрудники, а также правозащитные организации обратились в суд с поддержкой Anthropic. Сама Anthropic подала в суд несколько исков, в которых обвинила Минобороны в нарушении прав компании, гарантированных Первой поправкой к Конституции США. ИИ-разработчик также обвинил военных в несправедливом наказании компании по идеологическим мотивам. Слушания по этому делу о вынесении предварительного судебного запрета пройдут на следующей неделе. Чат-бот Anthropic Claude научился генерировать шрифты на основе рукописного текста

17.03.2026 [18:46],

Павел Котов

Службы на основе искусственного интеллекта постепенно переходят к решению задач творческого характера, которые ранее требовали специального ПО — теперь чат-боты умеют преобразовывать рукописные символы в цифровой шрифт. Правда, пока система работает не идеально.

Источник изображения: anthropic.com Чтобы получить свой собственный шрифт, пользователю необходимо изобразить от руки алфавит, цифры и знаки препинания, отсканировать страницу и загрузить получившийся файл чат-боту с ИИ — тот преобразует рукописное начертание в шрифт формата TrueType. Результат будет зависеть от почерка человека — те, у кого он разборчивый, получат более качественный результат, чем остальные.

Источник изображения: x.com/ashebytes Функция неочевидна — её обнаружила инженер-программист и специалист по ИИ Аше Магальяеш (Ashe Magalhaes). Его подход основан на одной из функций Anthropic Claude, который для решения сложных задач может вызывать внешние инструменты на языке Python. Для генерации шрифта на основе латинского алфавита необходимо изобразить на бумаге все буквы в заглавном и строчном начертаниях, цифры и знаки препинания. Изображение сканируется и загружается в чат-бот. Он анализирует контуры каждой буквы и преобразует их в векторные фигуры, которые задают основу для файла шрифта.

Источник изображения: x.com/ashebytes Процесс требует аккуратного подхода. В ходе тестирования служба ИИ сначала предоставила шаблон, чтобы пользователь разместил символы на странице. Буквы должны быть чёткими, расстояние между символами — равномерным, а сканировать необходимо в оптимальных условиях без теней или эффектов неравномерного освещения. Первые попытки были неудачными: в первом выходном файле формы были искажены и напоминали скорее чернильные пятна, а не буквы. Система проанализировала собственную работу и пришла к выводу, что внешние контуры некоторых символов она распознать не смогла и запустила процесс конвертации повторно. Второй заход оказался значительно удачнее, но такие буквы как «O», «A» и «R» изображались сплошными поверхностями, без отверстий. Пришлось производить доработку. Возникали и дальнейшие проблемы: в какой-то момент в единый глиф слились буквы «x» и «y» — это тоже пришлось корректировать. В окончательном варианте удалось добиться вполне приемлемого результата. OpenAI откажется от второстепенных разработок, чтобы не проигрывать конкурентам ИИ-гонку

17.03.2026 [13:03],

Алексей Разин

После выхода осенью 2022 года ChatGPT стартап OpenAI проявлял завидную активность и всеядность с точки зрения поиска новых способов использования ИИ, но в условиях жёсткой конкуренции подобная тактика уже не может себя оправдывать с точки зрения бизнеса. Руководство компании готовится выделить приоритетные направления развития, чтобы отказаться от второстепенных.

Источник изображения: OpenAI Как отмечает The Wall Street Journal, о грядущих изменениях в бизнес-стратегии OpenAI на общем собрании сотрудников сообщила директор по приложениям Фиджи Симо (Fidji Simo). По её словам, вышестоящие руководители в лице генерального директора Сэма Альтмана (Sam Altman) и ведущего исследователя Марка Чэня (Mark Chen) сейчас заняты поиском тех направлений деятельности, которые следует исключить из числа приоритетных. О принятых руководством решениях персонал OpenAI будет уведомлён в ближайшие недели. «Мы не можем упустить этот момент, поскольку нас отвлекают второстепенные задачи», — заявила сотрудникам OpenAI Фиджи Симо на прошлой неделе, как отмечает источник. «Нам реально нужно зафиксировать продуктивность в целом и в особенности — на бизнес-направлении», — добавила она. В прошлом году OpenAI анонсировала целый спектр инициатив, который охватывал самые разные сегменты рынка, от интернет-торговли и генерации видео до интернет-браузера и выпуска аппаратных устройств. Сэм Альтман пояснял такое многообразие проектов попыткой «ставить на несколько стартапов» внутри самой OpenAI. По имеющимся данным, в дальнейшем OpenAI хотела бы сосредоточиться на инструментах для генерирования программного кода и работе с корпоративными клиентами. В последней сфере преуспевает конкурирующая Anthropic, которой удаётся быстрее монетизировать собственные разработки, и OpenAI просто не желает отставать от соперника. Та же Anthropic пока не предложила клиентам средства для генерации видео и изображений, в отличие от OpenAI. Обе компании настроены выйти на IPO до конца текущего года, причём в случае с OpenAI выход на биржу может состояться в четвёртом квартале. Успех Anthropic в коммерческом сегменте рынка, по словам Симо, должен стать сигналом к пробуждению для OpenAI, и теперь компания ставит перед собой задачу выхода в лидеры как в сегменте инструментария для разработчиков ПО, так и для разного рода бизнес-клиентов. Бывшие и действующие сотрудники OpenAI признались The Wall Street Journal, что прежняя разнонаправленная стратегия компании мешала им сконцентрироваться на приоритетных задачах и понимать общую стратегию компании. Команда создателей генератора видео Sora, например, работала в подразделении стартапа, занимающегося исследованиями, хотя конечный продукт оказался одним из наиболее влиятельных и сложных среди разработок OpenAI. В прошлом сентябре Sora вышла в качестве самостоятельно приложения, но после первоначального наплыва пользователей последовал спад интереса, и теперь OpenAI намеревается встроить этот генератор видео в приложение ChatGPT. Нанятая в августе прошлого года Фиджи Симо предложила руководству более плотно интегрировать команды, занятые разработками и выпуском продуктов, а также унифицировать долгосрочную стратегию OpenAI вокруг повышения производительности труда своих пользователей. Инструмент Claude Code для автоматизации разработки ПО, выпущенный Anthropic, быстро набрал популярность среди профессионалов в этой сфере. Отыграть часть позиций на этом рынке OpenAI позволил выпуск инструмента Codex в прошлом месяце, а также дебют модели GPT 5.4, которая более ориентирована на профессиональное использование. Сейчас инструментом Codex еженедельно пользуются более двух миллионов пользователей, что в четыре раза выше показателя по состоянию на начало года. OpenAI решила активнее привлекать к разработке своих моделей консультантов со стороны и представителей клиентов. При этом Фиджи Симо не считает целесообразным регулярно объявлять «красный код опасности», но предлагает сотрудникам OpenAI работать, словно бы соответствующее объявление было сделано. Anthropic удвоила лимиты Claude для всех пользователей, но с ограничениями

16.03.2026 [18:58],

Сергей Сурабекянц

В последние дни пользователи чат-ботов с ИИ массово мигрируют на Claude, не в последнюю очередь из-за позиции Anthropic в отношении сделок с американскими военными. Компания решила выразить благодарность пользователям — все они получили удвоенные лимиты использования в течение следующих двух недель. Это изменение распространяется на все уровни подписки и планы (включая бесплатный), и для его активации никаких действий не требуется.

Источник изображения: Anthropic Однако имеется один небольшой подвох: эти дополнительные лимиты использования доступны только вне часов пик, которые приходятся на промежуток с 8:00 до 14:00 по восточному времени (с 16:00 до 22:00 по московскому времени). В выходные дни дополнительные лимиты можно использовать в течение всего дня. Более подробную информацию можно найти на странице акции на официальном сайте Anthropic. Предложение действует с 13 марта по 27 марта включительно. Корпоративные аккаунты в акции не участвуют. Отметим, что даже пользователи самых дорогих платных тарифных планов не получают неограниченного количества чатов с Claude. Принципы Anthropic в отношении использования искусственного интеллекта в военных целях привели к тому, что от него отказалось министерство обороны и другие государственные учреждения США, поэтому сотрудники Белого дома и Пентагона не смогут воспользоваться этой акцией. У американских законодателей возникли вопросы к OpenAI из-за сделки с Пентагоном

13.03.2026 [11:38],

Алексей Разин

Спешно заключённая OpenAI сделка с Министерством войны США, как признался глава компании Сэм Альтман (Sam Altman), потребовала доработки некоторых пунктов контракта, но публично он выражал лояльность идее использования ИИ в военных целях. При этом даже у американских конгрессменов возникли вопросы к руководителю OpenAI на данную тему.  В четверг на этой неделе, как отмечает CNBC, генеральный директор OpenAI Сэм Альтман встретился с группой американских конгрессменов в Вашингтоне. Сенатор Марк Келли (Mark Kelly), например, заявил о наличии у него «серьёзных вопросов» по поводу подходов OpenAI к использованию технологий компании в боевых действиях и самой сделке с Пентагоном в целом. В своём интервью каналу CNBC сенатор Келли признался, что группа его коллег в подробностях обсудила с Альтманом подходы к слежению за гражданами и использованию ИИ в боевых условиях. Разговор сенатор назвал «хорошей дискуссией». «Должны быть определённые ограничения, и мы должны быть уверены, что всё время думаем о Конституции и обеспечиваем соблюдение её основных положений», — подчеркнул сенатор. Напомним, что сделка американского военного ведомства с конкурирующей Anthropic развалилась после того, как руководство этой компании потребовало исключить использование её разработок при массовом слежении за американскими гражданами и применении систем вооружений без согласия человека. Конфликт между сторонами сделки привёл к тому, что Anthropic оказалась включена в перечень неблагонадёжных поставщиков, а подрядчикам Пентагона было запрещено использовать её разработки. На поиск альтернативы у самого ведомства и его подрядчиков остаётся шесть месяцев, но применять ИИ-модели Anthropic им запрещается уже сейчас. Примечательно, что глава OpenAI Сэм Альтман именно упоминаемые выше ограничения включил в текст контракта с Пентагоном, и конфликт ведомства с Anthropic стал носить характер «наказания непокорного», а не последствия реальных противоречий. Хотя Альтман и выразил несогласие с отнесением Anthropic к числу неблагонадёжных поставщиков, он подчеркнул, что «именно правительство должно решать, как именно будут работать самые важные вещи в стране». Сенатор Келли заявил, что группа парламентариев работает над законопроектом, определяющим характер взаимоотношений Министерства войны США с разработчиками ИИ, и что должно существовать законодательство, определяющее некоторые границы применения таких технологий. Конгрессмен посетовал, что в парламенте США вопросы рассматриваются не так быстро, как развиваются новые технологии. Anthropic научила Claude генерировать графики и таблицы прямо в чате с пользователем

13.03.2026 [07:01],

Алексей Разин

Проблемы во взаимоотношениях с американскими властями не мешают Anthropic продолжать совершенствование своего чат-бота Claude. После недавнего обновления он научился автоматически вставлять в диалоговом окне иллюстрации, позволяющие проще объяснить суть доводимой до пользователя информации. Графики, таблицы и диаграммы могут создаваться и по прямому запросу со стороны пользователя.

Источник изображения: Anthropic Ранее они возникали в боковой панели Claude, как отмечает The Verge, а теперь будут вставляться прямо в диалоговом окне. Самое примечательное, что графики, таблицы и диаграммы при этом могут быть интерактивными. В частности, периодическая таблица химических элементов будет отображаться таким образом, что нажатие на каждый из элементов позволит вывести дополнительную информацию о нём. Чат-бот Claude способен сам предугадывать, когда лучше сопроводить свой ответ интерактивной иллюстрацией, но по запросу пользователя он может сделать это в любой момент. Конкурирующие платформы подобными возможностями уже обзавелись. Например, OpenAI позволяет ChatGPT вставлять в диалог с пользователем интерактивные иллюстрации к математическим задачам и научным обсуждениям, а Google Gemini создаёт интерактивные иллюстрации для образовательных целей. Ранее подобный инструментарий был доступен пользователям Claude через боковую панель. Она сохранит соответствующую функцию, а вот иллюстрации из диалога с пользователем будут исчезать вместе с их завершением. В случае необходимости Claude сможет вносить изменения в уже созданные интерактивные иллюстрации. Новая функция доступна всем категориям пользователей Claude и по умолчанию изначально активна. Microsoft первой среди крупных компаний встала на сторону Anthropic в её тяжбе с Пентагоном

11.03.2026 [15:08],

Владимир Мироненко

Microsoft стала первой крупной технологической компанией, вставшей на сторону Anthropic в её споре с Пентагоном по поводу условий военного использования её ИИ-моделей. Она призвала суд к временному запрету на исполнение решения Министерства обороны США о признании Anthropic фактором риска для цепочки поставок, пока рассматривается дело по иску стартапа.

Источник изображения: Wesley Tingey/unsplash.com Microsoft предупредила, что «радикальные» и «беспрецедентные» шаги против Anthropic будут иметь «широкие негативные последствия» для американской технологической индустрии. После отказа стартапа предоставить Пентагону право использования своей модели Claude без каких-либо ограничений, военное ведомство включило его в чёрный список поставщиков, представляющих риск для цепочки поставок. Также администрация президента США потребовала, чтобы все федеральные агентства прекратили использование чат-бота Claude. После этого Anthropic подала в суд на администрацию Дональда Трампа (Donald Trump), назвав действия правительства «беспрецедентными и незаконными» и отметив, что они «наносят Anthropic непоправимый ущерб», ставя под угрозу контракты на сотни миллионов долларов. Microsoft заявила, что её «позиция заключается в том, что ИИ должен быть сосредоточен на законных и надлежащим образом защищённых вариантах использования». ИИ, по её словам, «не должен использоваться для проведения внутреннего массового наблюдения или для того, чтобы поставить страну в положение, когда автономные машины могут самостоятельно начать войну». Microsoft утверждает, что временный запрет необходим для предотвращения дорогостоящих сбоев для поставщиков, которым в противном случае пришлось бы быстро перестраивать свои продукты, зависящие от продукции Anthropic. В то время как Пентагон отвёл себе шесть месяцев на поэтапное прекращение использования технологий Anthropic, он не предоставил такой же переходный период для подрядчиков, использующих продукцию или услуги Anthropic для выполнения работ в рамках Министерства обороны, сообщила Microsoft. IT-гигант добавил, что временный запретительный приказ позволит выработать решение путём переговоров, одновременно защищая доступ военных к передовым технологиям и гарантируя, что ИИ не будет использоваться для массового наблюдения за гражданами или для проведения военных действий без участия человека. Это «обеспечит более упорядоченный переход и позволит избежать сбоев в продолжающемся использовании передового ИИ американскими военными», отметила компания. Свои выводы Microsoft указала в поданном в окружной суд США в Сан-Франциско заключении Amicus Curiae. Такие документы подаются сторонами, которые не указаны в деле, но обладают соответствующей экспертизой, или на которых может повлиять исход рассматриваемого дела. Anthropic предупредила, что включение в «чёрный список» Пентагона принесёт ей многомиллиардные убытки

10.03.2026 [12:53],

Алексей Разин

Клиентам и инвесторам Anthropic может говорить о последствиях своего включения в перечень неблагонадёжных поставщиков Пентагона одно, а в исковом судебном заявлении указывать совершенно иную информацию. В последнем случае она старается «нагнать жути» и заявить, что подобные санкции повлекут многомиллиардные убытки не только в текущем году, но и в последующие периоды.

Источник изображения: Unsplash, David Veksler Агентство Reuters проанализировало текст искового заявления Anthropic, с которым компания обратилась в суд с просьбой отменить решение Пентагона о включении её в список неблагонадёжных с точки зрения национальной безопасности США поставщиков. Ситуация возникла вскоре после отказа Anthropic передать американским военным полный контроль над применением своих ИИ-моделей, включая поголовную слежку за американскими гражданами и автоматизацию применения оружия с учётом выбора целей искусственным интеллектом. Оспаривая данное решение американского военного ведомства, Anthropic упоминает ряд значимых финансовых доводов. Одна только потеря контракта с Пентагоном лишит компанию сотен миллионов долларов США в текущем году (потери составят не менее $150 млн). По мнению руководства Anthropic, последствия включения компании в «чёрный список» окажут необратимое негативное воздействие на бизнес стартапа. Он потеряет от 50 до 100 % выручки от контрактов с подрядчиками Пентагона, а подрыв доверия инвесторов может усложнить привлечение необходимых для развития бизнеса средств. В общей сложности готовые потери Anthropic могут достичь нескольких миллиардов долларов США. Даже за пределами оборонных контрактов скандал может повлечь для Anthropic потери, связанные с отказом клиентов сотрудничать с компанией. В период с декабря 2025 года по январь 2026 года Anthropic в четыре раза увеличила приведённый размер годовой выручки от контрактов с представителями публичного сектора экономики США, в следующие пять лет эта выручка могла бы вырасти до нескольких миллиардов долларов. Компании публичного сектора в случае утраты доверия к Anthropic со стороны клиентов могут лишить её более чем $500 млн выручки по итогам текущего года. Anthropic успела понести прямой ущерб от действий Пентагона, как отмечается в иске. Один из партнёров стартапа, заключивший контракт с одним из американских правительственных ведомств, перешёл от использования Claude к конкурирующему решению, лишив Anthropic ожидаемой годовой выручки в размере более $100 млн. Прерваны переговоры с финансовыми учреждениями на сумму около $180 млн, один из контрактов на $15 млн был поставлен на паузу, а некая французская компания уменьшила сумму выплат Anthropic в два раза до $5 млн после действий Пентагона. В целом, компания успела получить обращения от более чем 100 корпоративных клиентов, в которых они выражали своё сомнение по поводу целесообразности дальнейшего сотрудничества с Anthropic. Все эти данные должны быть учтены судом при вынесении вердикта по делу. Anthropic запустила ИИ для поиска багов в программном коде, написанном ИИ

10.03.2026 [09:57],

Алексей Разин

Автоматизация процесса написания программного кода для приложений неизбежно привела к наличию в нём ошибок, но искусственный интеллект может не только порождать их, но и бороться с ними. Именно для этого предназначен новый инструмент Code Review, который был предложен Anthropic пользователям Claude Code.

Источник изображения: Anthropic Напомним, Claude Code является ИИ-агентом для написания программного кода, его сейчас активно используют многие разработчики. Жизненный цикл любой программы обычно подразумевает внесение изменений и исправлений, причём основная их часть делается до выхода ПО на рынок. Чтобы ускорить работу над исправлениями на этапе разработки, Anthropic предложила ИИ-агента Code Review, который позволяет проводить её без участия человека или с его минимальным привлечением. Code Review уже доступен пользователям Claude for Teams и Claude for Enterprise в качестве экспериментального исследовательского решения. Данный инструмент позволит разработчикам ПО, которые пользуются Claude, ускорить внесение исправлений до выпуска продукта в тираж. Code Review может интегрироваться с репозиторием GitHub и автоматически рецензировать предлагаемые разработчиками ПО изменения и исправления, генерируя профильные комментарии к их запросам. Инструмент призван исправлять основные логические ошибки, а претензии к «изящности» программного кода он не предъявляет. Code Review способен аргументировать свои замечания к программному коду, он использует цветовую маркировку для ранжирования проблем. Красным цветом помечаются самые важные проблемы, жёлтым — потенциальные, но требующие внимания, а фиолетовый используется для обозначения ошибок, связанных с ранее сгенерированным кодом. Сразу несколько ИИ-агентов работают параллельно, анализируя один и тот же фрагмент кода по разным критериям. На финальном этапе отдельный агент резюмирует накопленные замечания, удаляет дублирующиеся и выделяет наиболее важные. Инструмент позволяет провести первичный аудит кибербезопасности, а у разработчиков есть возможность настроить свои критерии дополнительных проверок. Anthropic фактически будет использовать сдельную систему оплаты при использовании Code Review. Анализ одного фрагмента кода будет обходиться разработчикам в сумму от $15 до $25. Не самое дешёвое удовольствие, по словам представителей компании, станет необходимостью по мере усиления использования ИИ для написания программного кода. По мнению Anthropic, качество кода не должно страдать от роста скорости его создания, поэтому ИИ-инструменты для поиска ошибок будут востребованы на рынке ПО. |