|

Опрос

|

реклама

Быстрый переход

Представители Google и OpenAI готовы выступить в суде в поддержку Anthropic в деле о конфликте с Пентагоном

10.03.2026 [07:44],

Алексей Разин

Процессуальные процедуры традиционно растянуты во времени, но Anthropic не стала особо медлить с подачей судебного иска против Пентагона, пытаясь оспорить своё включение в список неблагонадёжных поставщиков. Поддержать позиции компании в суде готовы представители конкурирующих OpenAI и Google, но только как частные лица, обладающие определённой экспертизой в рассматриваемом споре.

Источник изображения: OpenAI Почти 40 сотрудников OpenAI и Google, включая руководителя разработки Gemini Джеффа Дина (Jeff Dean), направили в суд процессуальный документ, формально позволяющий помочь судье составить более полное представление о предмете спора между истцом и ответчиком. По мнению составителей документа, включение Anthropic в перечень неблагонадёжных поставщиков является некорректным проявлением мести, которое вредит интересам общества. Как считают подписавшие обращение к суду представители указанных компаний, обозначенные Anthropic «красные линии» реальны и требуют конкретного ответа. Даже в ответственных руках, по мнению авторов письма, инструменты тотальной слежки за гражданами представляют серьёзный риск для демократических институтов, да и создание полностью автономных систем вооружения представляет собой риск, требующий особого внимания. Авторы письма относят себя к учёным, разработчикам и инженерам, занятым в создании передовых американских систем ИИ. По их замыслу, обращение к суду направлено не на решение проблем какой-то конкретной компании, а на представление интересов всей отрасли. Подписавшие письмо эксперты считают себя достаточно компетентными, чтобы предупреждать власти США о неприятных последствиях рассматриваемого ими применения ИИ в военных и разведывательных целях. Как поясняют авторы письма, сейчас данные о гражданах США существуют в разрозненном виде, и никто пока не объединял эти массивы с помощью ИИ для подробного анализа в масштабе реального времени. По сути, при желании американские власти могли бы составить подробное досье на сотни миллионов человек одновременно, с учётом постоянных изменений в этих данных. В части использования ИИ для выбора целей системами вооружения, как предупреждают эксперты, опасность таится в возможности появления ошибок из-за различий между условиями обучения профильных моделей и реальной обстановкой на поле боя. Как отмечают авторы обращения, ИИ не в состоянии оценивать возможный сопутствующий ущерб при выборе тех или иных целей, как это способен сделать человек. Кроме того, склонность ИИ к «галлюцинациям» делает военное применение таких технологий ещё более опасным без контроля со стороны человека. Авторы письма резюмируют, что на текущем этапе развития технологий предлагаемые Пентагоном сферы применения ИИ представляют серьёзную опасность и требуют ограничений либо на техническом уровне, либо на административном. Microsoft представила Copilot Cowork — автономного ИИ-агента для сложных задач на базе моделей Anthropic

09.03.2026 [22:34],

Анжелла Марина

Microsoft объявила о начале интеграции технологий Anthropic в свои сервисы, представив инструмент Copilot Cowork, основанный на модели Claude Cowork. Инструмент позволяет использовать автономных ИИ-агентов для выполнения сложных задач, таких как разработка приложений, создание электронных таблиц и структурирование больших массивов данных при минимальном участии человека.  Джаред Спатаро (Jared Spataro), руководитель направления AI-at-Work в Microsoft, заявил агентству Reuters, что ключевое отличие Copilot Cowork от Claude Cowork состоит в подходе к обработке данных. Инструмент Copilot работает исключительно в облачной среде и действует от имени пользователя, позволяя контролировать, к какой информации ИИ-агент может получать доступ. Claude Cowork, напротив, использует только локальную среду устройства и, по словам Спатаро, большинство компаний чувствуют себя «очень некомфортно» с точки зрения безопасности. Помимо запуска Copilot Cowork, Microsoft открыла пользователям M365 Copilot доступ к новейшим моделям Claude Sonnet, диверсифицируя таким образом свой технологический стек. Ранее сервис полагался исключительно на модели GPT от компании OpenAI, уточняет Reuters. Запуск состоялся спустя несколько недель после того, как новые инструменты Anthropic обвалили акции компаний в секторе традиционного программного обеспечения. Инвесторы забеспокоились, что автономные ИИ-агенты могут подорвать позиции классических софтверных продуктов. Акции самой Microsoft в феврале упали почти на 9 %. На текущий момент Copilot Cowork находится в стадии тестирования, а доступ для ранних пользователей откроется в этом месяце. Стоимость Microsoft не раскрыла, но уточнила, что для организаций часть функциональности будет включена в подписку M365 Copilot стоимостью $30 на пользователя в месяц, а дополнительный объём использования можно будет приобрести отдельно. Anthropic подала в суд на власти США из-за включения её в «чёрный список» Пентагона

09.03.2026 [22:30],

Владимир Мироненко

Компания Anthropic подала иск в федеральный суд Калифорнии в связи с её включением Министерством обороны США в список поставщиков, представляющих риск для национальной безопасности США. В своем иске Anthropic назвала это решение незаконным и нарушающим её права на свободу слова и надлежащую правовую процедуру, пишет агентство Reuters.

Источник изображения: Anthropic «Эти действия беспрецедентны и незаконны. Конституция не позволяет правительству использовать свою огромную власть для наказания компании за её защищённую законом свободу слова», — заявила Anthropic. На основании этого компания обратилась к суду с просьбой отменить решение Пентагона и запретить федеральным агентствам применять его. На прошлой неделе Пентагон официально присвоил компании Anthropic статус представляющей риск для цепочки поставок из-за отказа предоставить военному ведомству право использования своей модели Claude без каких-либо ограничений. В частности, Министерство обороны США требовало от Anthropic отменить запрет на использование Claude для массового слежения за американскими гражданами и полностью автоматизированных систем вооружений. Как сообщило агентство Reuters, напряжённые переговоры по поводу этих ограничений между сторонами велись в течение нескольких месяцев. В Anthropic заявили, что судебный иск не исключает возобновления переговоров с Пентагоном и достижения соглашения. Компания сообщила, что не хочет конфликтовать с правительством США. В свою очередь, представитель Пентагона неделю назад заявил, что переговоры между сторонами прекращены. Президент Дональд Трамп (Donald Trump) поручил правительству прекратить сотрудничество с Anthropic, среди инвесторов которой Google и Amazon.com. Также сообщалось, что прекращение сотрудничества правительства с компанией займёт шесть месяцев. ИИ-модель Anthropic Claude обнаружила 22 уязвимости в Mozilla Firefox за две недели — из них 14 весьма серьёзны

09.03.2026 [11:52],

Владимир Мироненко

Всего за две недели ИИ-модель Claude Opus 4.6 компании Anthropic обнаружила 22 уязвимости в браузере Mozilla Firefox, что больше, чем было выявлено за любой отдельный месяц 2025 года, сообщил The Wall Street Journal. Всего за этот период было выявлено более 100 ошибок, приводящих к сбоям, включая указанные баги. «ИИ позволяет обнаруживать серьёзные уязвимости безопасности с очень высокой скоростью», — отметили исследователи.

Источник изображения: Anthropic Для того, чтобы обнаружить первую уязвимость, ИИ-модели потребовалось всего 20 минут. Из выявленных за две недели уязвимостей 14 были отнесены к уязвимостям высокой степени серьёзности, что составляет почти пятую часть от 73 уязвимостей такого уровня в Firefox, которые Mozilla исправила в 2025 году. Большинство ошибок были исправлены в Firefox 148, версии браузера, вышедшей в феврале этого года, хотя некоторые исправления пришлось отложить до следующего релиза. Сообщается, что команда Anthropic выбрала для проверки Firefox, потому что это «одновременно сложный код и один из самых хорошо протестированных и безопасных проектов с открытым исходным кодом в мире». Оказалось, что ИИ-модель гораздо эффективнее в поиске ошибок, чем в их эксплуатации. Когда исследователи Anthropic предложили Claude разработать эксплойт-код на основе выявленных багов, ИИ-модель создала всего два работающих эксплойта, которые сработали на тестовой версии браузера, но в реальном мире они были бы остановлены другими механизмами безопасности Firefox, сообщил Логан Грэм (Logan Graham), глава подразделения Frontier Red Team Anthropic, занимающегося оценкой рисков Claude. Вместе с тем эксперты по безопасности говорят, что скорость, с которой ИИ-системы находят ошибки в программах и превращают их в код для атак, меняет способы защиты организаций. «Нынешние методы киберзащиты не способны справиться со скоростью и частотой происходящего», — заявил Гади Эврон (Gadi Evron), генеральный директор компании Knostic, занимающейся кибербезопасностью с использованием ИИ. Глава робототехнического направления OpenAI уволилась из компании на фоне скандала с Anthropic и Пентагоном

08.03.2026 [08:23],

Алексей Разин

Ещё на прошлой неделе OpenAI вызвалась занять место взбунтовавшейся Anthropic в качестве подрядчика Пентагона, снабжающего ИИ-системами для осуществления военных операций. Не всем сотрудникам стартапа это могло понравиться, поэтому руководительница робототехнического направления OpenAI сочла нужным уйти из компании.

Источник изображения: Caitlin Kalinowski Речь идёт о Кейтлин Калиновски (Caitlin Kalinowski), которая руководила командами разработчиков аппаратных решений и робототехники OpenAI с ноября 2024 года. Из текста её открытых обращений к коллегам на страницах социальных сетей становится понятно, что для неё уход из OpenAI был непростым решением, его мотивы не имеют ничего общего с межличностными отношениями, а обусловлены исключительно этическими принципами. Кейтлин Калиновски осознаёт, что ИИ имеет важное значение для национальной безопасности, но убеждена, что поголовная слежка за гражданами США без юридических оснований и автоматизация летальных вооружений становятся теми линиями, которые лично её побуждают выразить протест. При этом Калиновски выражает глубокое уважение к главе OpenAI Сэму Альтману (Sam Altman) и его коллегам, а также гордится их совместными достижениями. Калиновски до перехода в OpenAI принимала активное участие в разработке очков дополненной реальности Meta✴✴ Platforms. Перед этим она девять лет работала в подразделении Oculus, а ещё раньше помогала Apple разрабатывать дизайн ноутбуков MacBook. Калиновски стала не единственным сотрудником OpenAI, выразившим своё недовольство ситуацией с Пентагоном и Anthropic, но при спешном заключении соглашения с американским военным ведомством в прошлую пятницу Сэм Альтман делал упор на главенство государства в вопросах применения оружия и разведки, призывая подчинённых ставить государственные интересы выше принципов частной компании. Представители OpenAI выражают надежду, что в текущей редакции соглашение с Министерством войны США чётко очерчивает те границы, которые не следует пересекать при применении ИИ. Не допускается массовая слежка за гражданами и применение автономных средств вооружений без сохранения права человека принимать решение по выбору целей. Разработчик доверил Claude Code управление AWS — ИИ полностью удалил два сайта и базу данных

07.03.2026 [19:04],

Павел Котов

Помогающие в написании программного кода агенты искусственного интеллекта, такие как Anthropic Claude Code никогда не дают стопроцентной гарантии результата, и в отдельных случаях возможны неприятные инциденты, например, с удалением данных. Но в случае с разработчиком Алексеем Григорьевым виновником оказался не ИИ, а человеческий фактор.

Источник изображения: anthropic.com Разработчик решил перенести свой сайт в облачную инфраструктуру Amazon Web Services (AWS), где уже находился другой его ресурс. Claude Code не рекомендовал этот вариант, но пользователь посчитал, что поддерживать две конфигурации слишком трудозатратно. Для управления инфраструктурой он выбрал утилиту Terraform, которая поддерживает создание (равно как и удаление) ресурсов со всеми настройками, включая сети, балансировку нагрузки, базы данных и сами серверы. Алексей попросил Claude Code выполнить план Terraform для настройки нового сайта, но забыл загрузить файл состояния с полным описанием текущей конфигурации. В результате ИИ-агент выполнил команду разработчика и создал контейнер для подлежащего переносу сайта, но пользователь сам остановил процесс на полпути. Из-за отсутствия файла состояния ресурсы начали дублироваться. Разработчик распорядился определить дубликаты ресурсов, чтобы исправить ситуацию, а затем всё-таки загрузил файл состояния, решив, что разобрался в проблеме. Алексей предположил, что ИИ-агент продолжит удалять дубликаты ресурсов, а затем откроет файл состояния, чтобы понять, как необходимо настроить платформу. При наличии файла состояния Claude Code последовал инструкции Terraform, выполнив операцию «destroy» («уничтожить»), чтобы подготовиться к установке сайта. Учитывая, что в файле установки значился другой ресурс, уже находившийся к тому моменту в AWS, в результате были удалены оба сайта, в том числе база данных с записями за 2,5 года и её снимки, которые использовались в качестве резервных копий. Для решения проблемы разработчику пришлось обращаться в службу технической поддержки Amazon, которая помогла восстановить данные в течение суток. Описывая инцидент, он привёл несколько мер, которые принял, чтобы подобные случаи больше не повторялись. Он настроил периодическую проверку восстановления базы данных, включил защиту от удаления в Terraform и AWS, а файл состояния переместил в хранилище S3, чтобы не держать его на своём компьютере. Алексей признал, что слишком полагался на ИИ-агента при выполнении команд Terraform, и на будущее решил все операции по удалению данных производить самостоятельно. Винить ИИ в инциденте он не стал. Anthropic запустила маркетплейс приложений, построенных на её ИИ-моделях — по примеру Amazon

07.03.2026 [06:40],

Анжелла Марина

Компания Anthropic представила платформу Anthropic Marketplace, которая позволит корпоративным клиентам приобретать сторонние программные приложения, построенные на базе её моделей. В числе партнёров площадки названы Snowflake, Harvey и Replit, сообщает Bloomberg.

Источник изображения: Anthropic Компания не станет удерживать комиссию с этих покупок и разрешит зачитывать годовые обязательства по расходам на собственные сервисы в счёт оплаты инструментов от третьих сторон, сравнивая такой подход с маркетплейсами программного обеспечения от Amazon и Microsoft. Bloomberg отмечает, что запуск платформы произошёл в период, когда компания столкнулась с неопределённостью из-за противостояния с Министерством обороны США. Ранее ведомство признало разработчика угрозой для цепочки поставок — статус, который обычно применяют к представителям недружественных стран. Такое решение создаёт не только риск для дальнейшего сотрудничества с Пентагоном, но и для совместных оборонных проектов с другими компаниями. В Anthropic заявили о намерении оспорить это решение в суде. Кейт Дженсен (Kate Jensen), глава подразделения Anthropic в Северной и Южной Америке, отметила, что компания активно обсуждает ситуацию с клиентами и ожидает сохранения обычного режима работы для большинства заказчиков. «Хорошая новость заключается в том, что, по большей части, мы ожидаем, что для подавляющего большинства наших клиентов все останется по-прежнему», — сказала она. Генеральный директор Anthropic Дарио Амодеи (Dario Amodei) добавил, что правительственные ограничения сформулированы достаточно узко и не должны повлиять на коммерческую деятельность компании, не связанную с конкретными военными контрактами. В свою очередь представитель Microsoft сообщил, что компания может продолжать сотрудничество с Anthropic в проектах, не относящихся к оборонной сфере. Тем не менее для организаций, работающих с Пентагоном и одновременно с Anthropic, сохраняется значительная неопределённость относительно дальнейшего взаимодействия. ИИ-бот Claude прирастает миллионом пользователей каждый день после скандального разрыва Anthropic с Пентагоном

06.03.2026 [18:12],

Павел Котов

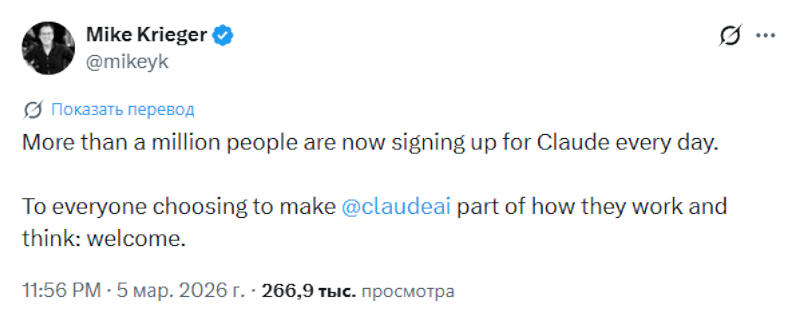

Власти США официально присвоили Anthropic статус «угрозы для цепочки поставок» из-за того, что компания не разрешила использовать свои модели искусственного интеллекта для неэтичных, по её мнению, целей. Пока стартап планирует оспорить это решение в суде, рядовые граждане выражают ему поддержку, регистрируясь на его платформе — каждый день их число увеличивается на миллион.

Источник изображения: anthropic.com Гендиректор Anthropic Дарио Амодеи (Dario Amodei) назвал решение американских властей юридически необоснованным. Статус «угрозы для цепочки поставок» впервые был присвоен американской компании — он означает, что всем подрядчикам Министерства обороны США запрещается с ней сотрудничать. Однако на рядовых граждан это решение не влияет, они имеют право пользоваться продуктами Anthropic неограниченно — и они начали реализовывать это право.

Источник изображения: x.com/mikeyk Пока Anthropic и Белый дом пытаются урегулировать разногласия, платформа Claude переживает всплеск числа пользователей — возможно, из-за этической позиции по отношению ИИ в армии. Каждый день здесь регистрируются более миллиона человек, сообщил сотрудник компании Майк Кригер (Mike Kreiger). Anthropic не публикует данных о количестве пользователей, но, по оценкам, на начало года Claude пользовались 20 млн человек в месяц. Значительная часть могла перейти сюда, отказавшись от ChatGPT — самого популярного в мире чат-бота. Он теперь активно теряет аудиторию, потому что это OpenAI сменила Anthropic в Пентагоне. И есть версия, что компания Сэма Альтмана (Sam Altman) моральными сомнениями не терзается. Anthropic заверила, что санкции Пентагона не повлияют на основную часть клиентов

06.03.2026 [15:28],

Алексей Разин

Прошла неделя с того момента, как Anthropic вступила в конфликт с руководством американского военного ведомства по поводу определения границ допустимого применения искусственного интеллекта в военной сфере и слежением за гражданами США. Руководство стартапа теперь утверждает, что на её бизнес последствия внесения в «чёрный список» Пентагона повлияют незначительно.

Источник изображения: Anthropic Генеральный директор Anthropic Дарио Амодеи (Dario Amodei) накануне подтвердил, что получил от Министерства войны США официальное уведомление о включении его компании в список неблагонадёжных поставщиков. Предполагалось, что данный запрет на сотрудничество с Anthropic вынудит многих подрядчиков государственных структур США отказаться от использования ИИ-сервисов этой компании. Её приведённая к году выручка недавно превысила $19 млрд, но как и многие конкуренты, Anthropic продолжает оставаться убыточной. Правда, её выраженная зависимость от корпоративного рынка позволяла до недавних пор рассчитывать на более быстрое достижение окупаемости по сравнению с той же OpenAI. Как подчеркнул глава Anthropic, запрет на использование её продуктов подрядчиками Министерства войны США распространяется только непосредственно на контракты с этим ведомством, а не всю прочую деятельность соответствующих компаний. Другими словами, даже подрядчики Пентагона смогут продолжить использовать решения Anthropic в тех сферах, которые не имеют отношения к контрактам с этим ведомством. Применение ИИ-моделей Anthropic в системах компании Palantir будет прекращено, а именно они помогают американским военным выбирать цели при атаках на Иран в настоящее время. Ряд прочих американских правительственных ведомств уже заявили о своём решении отказаться от использования услуг Anthropic. Попутно Дарио Амодеи подчеркнул, что не считает попадание Anthropic в указанный список законным, а потому не имеет иного выхода, кроме как обратиться в суд для оспаривания данного решения. Представители Министерства войны США отдельно отметили, что ведомство изначально придерживалось принципа наличия у военных права использования технологий Anthropic для достижения любых законных целей. Пентагон никогда не допустит, чтобы поставщик вмешивался в цепочку управления, ограничивая законное применение критических технологий, тем самым подвергая риску военнослужащих. Дарио Амодеи не стал отрицать, что в последние дни принял участие в довольно продуктивных контактах с представителями Министерства войны США, и надеется предоставлять ему услуги так долго, как получится. Заместитель министра обороны США Эмиль Майкл (Emil Michael) подчеркнул, что на данный момент все переговоры между ведомством и Anthropic прекращены. Главе Anthropic пришлось извиняться за свои недавние резкие высказывания в адрес Пентагона и других участников рынка, которые он допустил в письменном обращении к сотрудникам своей компании. Он отметил, что тон высказываний не отображает его взвешенных взглядов на ситуацию. Пентагон запретил подрядчикам работать с Anthropic, но Microsoft сохранит доступ для клиентов

06.03.2026 [13:59],

Алексей Разин

По некоторым данным, Министерство войны США, как оно теперь именуется, на этой неделе перешло от слов к делу, отнеся Anthropic к числу неблагонадёжных поставщиков, тем самым лишив подрядчиков государственных структур права работать с этим ИИ-стартапом. Microsoft утверждает, что на её собственных клиентов этот запрет не распространяется.

Источник изображения: Microsoft Как отмечает CNBC, после изучения действующих законодательных норм юристы корпорации Microsoft пришли к выводу, что её собственные клиенты смогут сохранить доступ к ИИ-моделям Anthropic через фирменное ПО. Некоторые связанные с оборонным сектором США компании уже велели своим сотрудникам отказаться от использования решений Anthropic и перейти на альтернативы. Формально, на подобную миграцию закон отводит до шести месяцев, но отказаться от использования ИИ-моделей Anthropic государственные служащие должны незамедлительно. Представители Microsoft при этом подчёркивают, что сотрудникам Министерства войны США запрещается использовать продукты Anthropic через интеграцию с собственными решениями Microsoft, включая чат-бот Claude. В тех случаях, если работа клиентов Microsoft с продуктами Anthropic не имеет отношения к оборонной сфере США, их можно будет использовать через Microsoft 365, GitHub и AI Foundry. Корпорация Microsoft начала интегрировать решения Anthropic в свои сервисы прошлой осенью, при этом не отказавшись от партнёрства с OpenAI, чьим крупнейшим инвестором является уже много лет. Например, разработчики ПО могут воспользоваться ИИ-ботом Claude через сервис GitHub Copilot AI, хотя им одновременно доступен и Codex конкурирующей OpenAI. В сервисе Microsoft 365 Copilot клиенты компании с прошлого октября могут переключаться между решениями Anthropic и OpenAI по своему усмотрению. Пентагон официально уведомил руководство Anthropic о включении компании в список неблагонадёжных поставщиков

06.03.2026 [04:53],

Алексей Разин

Если прошлая пятница завершилась для Anthropic только угрозами со стороны представителей американского военного ведомства по включению в «чёрный список», не позволяющий более претендовать на правительственные контракты, то к концу этой рабочей недели данный статус был закреплён за ИИ-стартапом официально.

Источник изображения: Getty Images, Unsplash+ Как поясняет Bloomberg со ссылкой на представителей Министерства войны США, соответствующее уведомление поступило руководству Anthropic официально только накануне. Ведомство определило, что компания и её продукты представляют риск для цепочек поставок, связанных с государственными заказами и проектами. Данное определение вступает в силу немедленно, по информации источника. Нюанс заключается в том, как добавляет Bloomberg, что решения Anthropic технически продолжают использоваться Пентагоном самым активным образом в ходе иранской операции. Существующая процедура предусматривает шестимесячный переходный период, на протяжении которого американские военные структуры и их подрядчики должны будут перейти от использования разработок Anthropic к альтернативам. Ранее уже отмечалось, что данное определение Anthropic собирается оспорить в суде. Более того, компания предпринимает попытки возобновить переговоры с представителями Пентагона, чтобы вернуть всё в прежнее русло. Неясно при этом, как будет развиваться сотрудничество Министерства войны США с конкурирующей OpenAI, которая буквально в считанные часы после отлучения Anthropic от госконтракта попыталась занять её место, спешно пересматривая условия работы с Пентагоном уже на этой неделе. Представители Пентагона сочли нужным отметить, что изначально руководствуются принципом, согласно которому американские военные имеют право использовать технологии для всех законных целей. Ведомство не намерено позволять никакой компании вмешиваться в цепочку командования и ограничивать законное применение таких технологий, потенциально ставя под удар военнослужащих. По данным Bloomberg, ИИ-модель Claude компании Anthropic была интегрирована в систему управления Maven, разработанную Palantir Technologies для Пентагона, и теперь активно используется в ходе боевых действий против Ирана. Хотя потенциально ссора с американскими военными может привести к сокращению выручки Anthropic на направлении государственных контрактов, в краткосрочной перспективе спрос на решения компании растёт среди рядовых пользователей, которые переходят на них из соображений солидарности с этической позицией руководства стартапа. OpenAI увеличила выручку до $25 млрд, сохранив лидерство над Anthropic — но до прибыли ещё далеко

05.03.2026 [13:09],

Алексей Разин

Большинство крупнейших ИИ-стартапов остаются убыточными, но свою выручку они наращивают довольно быстро. Как отмечалось недавно, Anthropic недавно преодолела рубеж в $19 млрд годовой выручки в приведённом значении, полученном методом экстраполяции ежемесячной величины. OpenAI с выручкой в размере $25 млрд всё равно её опережает.

Источник изображения: Unsplash, Дима Соломин Данными на эту тему делится Reuters со ссылкой на The Information. В конце прошлого года данный показатель OpenAI достиг $21,4 млрд. Получается, что за прошедшее время он вырос на 17 %. По сути, подобная динамика отражает способность ИИ-стартапа активно наращивать выручку. Однако, с учётом запланированных на ближайшие годы расходов в размере $600 млрд, выйти на безубыточность компания сможет в лучшем случае к концу десятилетия. Руководство OpenAI, которому нередко приходится слышать упрёки инвесторов в непомерном росте расходов, на тематические вопросы обычно отвечает уклончиво и даже раздражительно, утверждая, что не следует сейчас жалеть денег, чтобы в будущем получить весьма хорошую финансовую отдачу. При этом большинство сделок OpenAI по финансированию строительства вычислительной инфраструктуры для её нужд организовано таким образом, что сам стартап ни за что не отвечает, а долговые обязательства ложатся на сторонние компании и подрядчиков. Выйдя на IPO, которое может оценить капитализацию OpenAI в $1 трлн, компания столкнётся с более пристальным вниманием инвесторов к своим финансовым показателям. Понимая, что в корпоративном сегменте продавать технологии ИИ сейчас выгоднее, OpenAI уже заключила соглашения с четырьмя крупнейшими в мире консалтинговыми агентствами. По итогам 2025 года OpenAI смогла выйти на годовую величину выручки в $20 млрд, полученную методом умножения месячной выручки на 12. На тот момент конкурирующая Anthropic довольствовалась лишь $9 млрд приведённой годовой выручки, но смогла быстро наверстать отставание. Впрочем, сейчас OpenAI со своими $25 млрд годовой выручки всё равно оказывается впереди конкурента. Хуанг подтвердил, что Nvidia передумала вливать $100 млрд в OpenAI — новых вложений в Anthropic тоже не предвидится

05.03.2026 [08:56],

Алексей Разин

Ещё недавно считалось, что Nvidia вложит в капитал OpenAI обещанные $100 млрд, но позже условия сделки были пересмотрены в пользу единовременной инвестиции на сумму $30 млрд. На этой неделе основатель первой из компаний Дженсен Хуанг (Jensen Huang) вообще заявил, что данная инвестиция в капитал OpenAI, возможно, была последней, да и конкурирующей Anthropic нет смысла рассчитывать на дополнительные вложения.

Источник изображения: Nvidia «Я думаю, что возможность вложить $100 млрд в OpenAI не рассматривается. Так что это вполне может оказаться последней возможностью вложить в столь важную компанию, как эта», — подчеркнул генеральный директор Nvidia, добавив, что OpenAI может выйти на IPO до конца текущего года. В прошлом месяце Nvidia вложила $30 млрд в капитал OpenAI вместе с рядом других стратегических инвесторов. По итогам недавнего раунда финансирования капитализация OpenAI выросла до $730 млрд. Хотя Nvidia и уменьшила объёмы средств, направляемые в капитал OpenAI, никакого разочарования в этом стартапе она не испытывает, как дал понять в конце января Дженсен Хуанг. На конференции Morgan Stanley на этой неделе он добавил, что и вложенные недавно $10 млрд в капитал Anthropic могут стать последней инвестицией такого масштаба для данного ИИ-стартапа со стороны Nvidia. Как и OpenAI, компания Anthropic тоже рассчитывает выйти на IPO. Опасения отдельных инвесторов по поводу формирования ИИ-пузыря Хуанг привычно отмёл, ссылаясь на генерирование прибыли соответствующими технологиями для компаний типа Microsoft. Именно вычислительные мощности сейчас сдерживают рост прибыли на этом направлении, как подчеркнул глава Nvidia. Если бы у них было в три раза больше вычислительных мощностей, то и выручка была бы в три раза выше, как резюмировал Хуанг. По мнению главы Nvidia, поставщики программного обеспечения для проектирования чипов типа Synopsys и Cadence в эпоху бума ИИ начнут наращивать свою значимость для всей отрасли. Она, по его словам, сейчас находится в самом начале большого цикла роста. Доходами своей компании за прошлый квартал Хуанг очень доволен. Anthropic возобновила переговоры с Пентагоном в надежде исправить ситуацию

05.03.2026 [07:37],

Алексей Разин

Прошлая пятница стала не очень удачной для истории развития ИИ-стартапа Anthropic, поскольку конфликт с Пентагоном по поводу этических ограничений на использование фирменных технологий привёл к отказу американского военного ведомства от сотрудничества с этой компанией. Она возобновила переговоры с Министерством войны США в надежде исправить ситуацию.

Источник изображения: Anthropic Об этом сообщает Bloomberg со ссылкой на собственные информированные источники. Генеральный директор Anthropic Дарио Амодеи (Dario Amodei) вернулся к переговорам с Пентагоном, рассчитывая найти применение фирменным ИИ-моделям в инфраструктуре этого ведомства. Со стороны последнего контактным лицом изначально выступал заместитель министра Эмиль Майкл (Emil Michael), отвечающий за разработки и инженерное направление. Стороны надеялись заключить контракт, определяющий возможности использования ИИ-технологий Anthropic американским военным ведомством, но в прошлую пятницу сделка развалилась из-за несогласия компании дать контрагенту полную свободу в использовании ИИ. Стартап моментально попал в перечень неблагонадёжных поставщиков, а конкурирующая OpenAI умудрилась заключить аналогичное соглашение с Пентагоном, причём на тех условиях, которых со скандалом пыталась добиться сама Anthropic. С минувшей пятницы переговоры с Anthropic успели возобновиться, как сообщает источник. Если стороны достигнут соглашения, это позволит компании сохранить доступ к обслуживанию американского военного ведомства, а также избежать окончательной блокировки на рынке правительственных услуг в США. Возможно, возвращение Anthropic на эту арену усложнит жизнь конкурирующей OpenAI, которая не преминула воспользоваться открывшейся возможностью занять место первой из компаний. О возобновлении переговоров между Пентагоном и Anthropic первым сообщило издание Financial Times. Противостояние с американскими властями могло бы дорого обойтись Anthropic, тогда как по приведённой годовой выручке компания уже догнала OpenAI, а по капитализации вышла на уровень $380 млрд. На стороне Anthropic выступили и другие технологические компании, включая Google и Apple, которые призвали президента США Дональда Трампа (Donald Trump) не включать компанию в список неблагонадёжных, поскольку прецедент имел бы губительные последствия для всей национальной отрасли. Anthropic почти догнала OpenAI по годовой выручке

04.03.2026 [10:58],

Алексей Разин

В условиях бума искусственного интеллекта профильные стартапы редко задумываются о необходимости скорейшего выхода на окупаемость, но инвесторы то и дело напоминают им об этом. До скандала с Пентагоном финансовые показатели Anthropic росли уверенными темпами, в приведённом значении годовая выручка стартапа успела вырасти до более чем $19 млрд. Фактически, подобным значением в январе могла похвастаться и конкурирующая OpenAI.

Источник изображения: Anthropic Напомним, в конце прошлого года Anthropic вышла на $9 млрд приведённой ежегодной выручки. Как отмечает Bloomberg со ссылкой на собственные источники, уже в текущем году данный показатель поднялся до $14 млрд, и совсем недавно смог преодолеть рубеж в $19 млрд. В основном такая динамика последних недель была обусловлена активным использованием ИИ-ассистента Claude, который помогает разработчикам создавать программный код. Текущая капитализация Anthropic достигла $380 млрд, хотя пока непонятно, как на финансовых показателях деятельности скажется недавний скандал с Пентагоном. Американское военное ведомство пыталось заключить с компанией контракт на использование ИИ-моделей Anthropic в секретной части своих операций, но руководство стартапа решило ставить ограничения на его применение. Договориться по примеру воспользовавшейся данной возможностью OpenAI не удалось, поэтому теперь Anthropic будет лишена возможности работать с правительственными учреждениями США в любом контексте, а также с большинством их подрядчиков. Anthropic собирается оспорить в суде своё отнесение к числу неблагонадёжных поставщиков. Тем временем, заключившая аналогичный контракт с Пентагоном компания OpenAI его условия уже начала менять «задним числом». Позиции Anthropic традиционно были сильны в корпоративном сегменте, и пока сложно предсказать, как противостояние с Пентагоном скажется на способности компании удерживать клиентов. Рядовые пользователи начали переходить на продукты Anthropic в знак протеста против политики американских властей, но насколько данный порыв будет способствовать генерации устойчивой выручки, предугадать сложно. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |