|

Опрос

|

реклама

Быстрый переход

Anthropic выпустила ИИ-модель Claude Opus 4.8 — она не пытается скрыть свою некомпетентность в вопросах, в которых не разбирается

29.05.2026 [06:46],

Анжелла Марина

Компания Anthropic выпустила Opus 4.8 — новейшую версию своей самой продвинутой публичной модели. Вместе с ней разработчики представили функцию Dynamic Workflows, которая позволит Opus и другим моделям управлять сложными задачами, распределёнными между сотнями параллельных субагентов. Об этом сообщил TechCrunch.

Источник изображения: Anthropic Opus 4.8 появилась через 41 день после релиза Opus 4.7, что оказалось значительно быстрее обычного цикла обновлений Anthropic (предыдущие модели Sonnet и Haiku выходили с интервалом в три и семь месяцев соответственно). Ускоренный выпуск, как предполагается, связан с прохладным приёмом Opus 4.7, которую некоторые пользователи сочли разочаровывающей. За тот же период конкуренты в лице OpenAI с моделью Codex и Google с Gemini Flash также представили значительные обновления, усиливая давление на Anthropic. Ключевым улучшением Opus 4.8 стала работа с некорректными или неопределёнными данными. Первые тестировщики обнаружили, что новая модель «чаще сообщает о неуверенности в результатах своей работы и реже делает необоснованные заявления». Эффективность модели подтвердили и в инвестиционной компании Bridgewater Associates. По словам представителей, главное отличие обновлённой версии заключается в том, что нейросеть активно указывает на проблемы во входных и выходных данных, которые другие алгоритмы обычно не замечают, вынуждая пользователей самостоятельно искать ошибки. Вместе с новой моделью Anthropic запустила функцию Dynamic Workflows в формате исследовательского превью. Система предназначена для того, чтобы крупные модели (например, Opus) управляли сложными задачами через сотни параллельных субагентов. Как поясняют в компании, благодаря этому нововведению, связка из Claude Code и модели Opus 4.8 сможет «выполнять миграцию сотен тысяч строк кода от этапа запуска до слияния, опираясь на существующий набор тестов в качестве ограничителя». Одновременно разработчики продолжают подготовку к полноценному запуску модели Mythos, ранний доступ к которой в прошлом месяце вызвал опасения в использовании её киберпреступниками. В Anthropic подчеркнули, что активно решают вопросы защиты Mythos и ожидают внедрения моделей класса Mythos для всех клиентов уже в ближайшие недели. ИИ-модель Anthropic Claude обнаружила 22 уязвимости в Mozilla Firefox за две недели — из них 14 весьма серьёзны

09.03.2026 [11:52],

Владимир Мироненко

Всего за две недели ИИ-модель Claude Opus 4.6 компании Anthropic обнаружила 22 уязвимости в браузере Mozilla Firefox, что больше, чем было выявлено за любой отдельный месяц 2025 года, сообщил The Wall Street Journal. Всего за этот период было выявлено более 100 ошибок, приводящих к сбоям, включая указанные баги. «ИИ позволяет обнаруживать серьёзные уязвимости безопасности с очень высокой скоростью», — отметили исследователи.

Источник изображения: Anthropic Для того, чтобы обнаружить первую уязвимость, ИИ-модели потребовалось всего 20 минут. Из выявленных за две недели уязвимостей 14 были отнесены к уязвимостям высокой степени серьёзности, что составляет почти пятую часть от 73 уязвимостей такого уровня в Firefox, которые Mozilla исправила в 2025 году. Большинство ошибок были исправлены в Firefox 148, версии браузера, вышедшей в феврале этого года, хотя некоторые исправления пришлось отложить до следующего релиза. Сообщается, что команда Anthropic выбрала для проверки Firefox, потому что это «одновременно сложный код и один из самых хорошо протестированных и безопасных проектов с открытым исходным кодом в мире». Оказалось, что ИИ-модель гораздо эффективнее в поиске ошибок, чем в их эксплуатации. Когда исследователи Anthropic предложили Claude разработать эксплойт-код на основе выявленных багов, ИИ-модель создала всего два работающих эксплойта, которые сработали на тестовой версии браузера, но в реальном мире они были бы остановлены другими механизмами безопасности Firefox, сообщил Логан Грэм (Logan Graham), глава подразделения Frontier Red Team Anthropic, занимающегося оценкой рисков Claude. Вместе с тем эксперты по безопасности говорят, что скорость, с которой ИИ-системы находят ошибки в программах и превращают их в код для атак, меняет способы защиты организаций. «Нынешние методы киберзащиты не способны справиться со скоростью и частотой происходящего», — заявил Гади Эврон (Gadi Evron), генеральный директор компании Knostic, занимающейся кибербезопасностью с использованием ИИ. Чат-бот Claude AI станет прекращать «вредоносные или оскорбительные диалоги с пользователями»

18.08.2025 [18:58],

Сергей Сурабекянц

Anthropic научила свой чат-бот Claude AI прекращать общение, которое он сочтёт «вредоносным или оскорбительным». Эта возможность уже доступна в моделях Opus 4 и 4.1. Она позволит чат-боту завершать разговоры в качестве крайней меры после неоднократных попыток пользователя сгенерировать вредоносный или оскорбительный контент. Anthropic хочет добиться «потенциального благополучия» моделей ИИ, прекращая беседы, в которых Claude испытывает «явный дискомфорт».

Источник изображения: Anthropic После прекращения диалога со стороны Claude, пользователь не сможет отправлять новые сообщения в этом чате, но создание новых чатов будет по-прежнему доступно. Anthropic отметила, что разговоры, вызывающие подобную реакцию, являются «крайними случаями», добавляя, что большинство пользователей не столкнутся с этим препятствием даже при обсуждении спорных тем. В ходе тестирования Claude Opus 4 у чат-бота было отмечено «стойкое и последовательное отвращение к причинению вреда», в том числе к созданию сексуального контента с участием несовершеннолетних, насильственным действиям и терроризму. В этих случаях, по данным Anthropic, Claude демонстрировал «явную тревожность» и «тенденцию прекращать вредоносные разговоры, когда предоставлялась такая возможность». Claude получил прямое указание не завершать разговоры, если пользователь проявляет признаки желания причинить «неминуемый вред» себе или другим. В таких случаях Anthropic привлекает онлайн-сервис кризисной поддержки Throughline, чтобы помочь разработать ответы на запросы, связанные с самоповреждением и психическим здоровьем. На прошлой неделе Anthropic обновила политику использования своего чат-бота, поскольку быстро развивающиеся модели ИИ вызывают всё больше опасений по поводу безопасности. Теперь компания запрещает использовать Claude для разработки биологического, ядерного, химического или радиологического оружия, а также для разработки вредоносного кода или эксплуатации уязвимостей сети. Пока все ждут GPT-5, Anthropic выпустила ИИ-модель Claude Opus 4.1 — она стала лучше в программировании, рассуждениях и агентских задачах

06.08.2025 [14:05],

Павел Котов

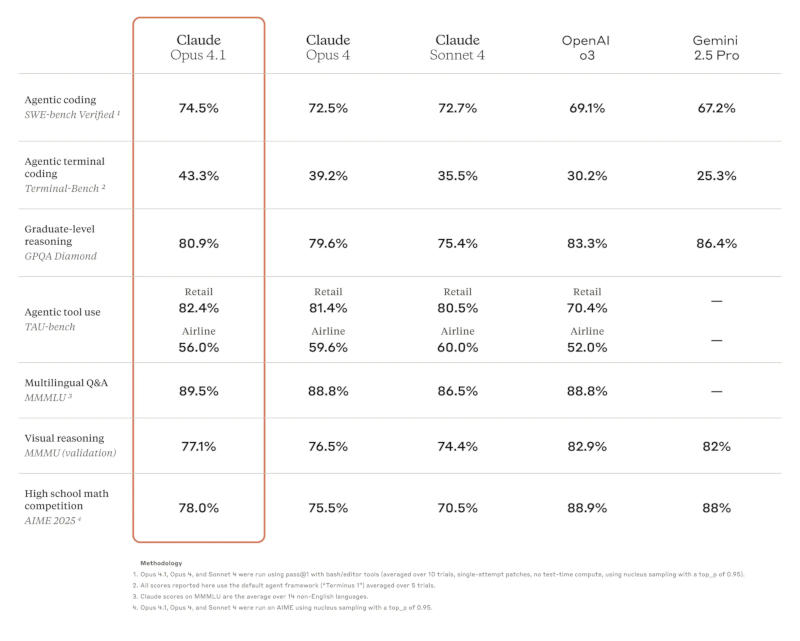

Anthropic объявила о выходе рассуждающей модели искусственного интеллекта Claude Opus 4.1, предназначенной для работы в качестве ИИ-агента, средства написания программного кода.

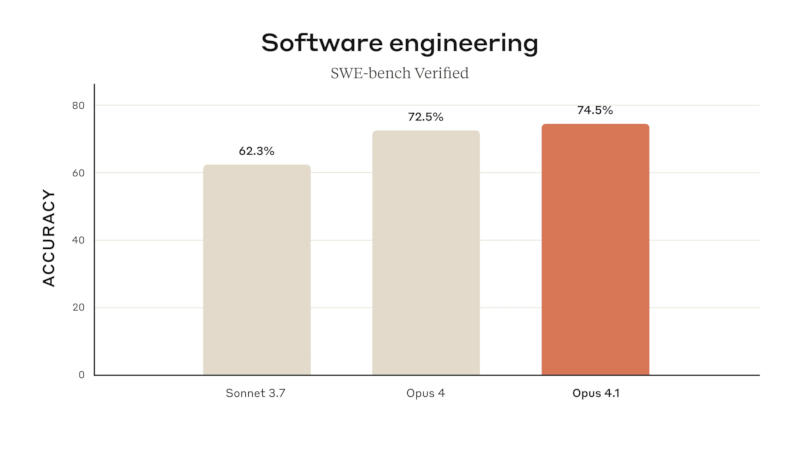

Источник изображений: anthropic.com Поработать с Opus 4.1 уже могут подписчики платных версий Claude и в Claude Code; новая модель также доступна через API, на платформах Amazon Bedrock и Google Cloud Vertex AI. Стоимость доступа к ней такая же, как у оригинальной Opus 4.  Anthropic Claude Opus 4.1 лучше справляется с задачами на написание программного кода — тест SWE-bench Verified показал результат до 74,5 %. Улучшились навыки чат-бота Claude в области анализа данных и углублённых исследований, особенно при необходимости произвести агентный поиск информации и отследить детали.  Обновлённая модель Claude Opus 4.1 стала лучше в большинстве функций по сравнению с Opus 4, по версии GitHub. Ещё одна примечательная особенность Opus 4.1 — способность вносить точные изменения в код даже при большом объёме его базы, ограничиваясь только необходимыми модификациями и не создавая новых ошибок, что делает модель эффективным средством для повседневной отладки, отметили в Rakuten Group. В Windsurf прогресс Opus 4.1 по сравнению с Opus 4 оценили в одно стандартное отклонение — таким же он был при переходе от Sonnet 3.7 к Sonnet 4. Anthropic рекомендовала переходить с Opus 4 на Opus 4.1 во всех сценариях работы. При подключении через API разработчикам достаточно выбрать модель claude-opus-4-1-20250805. |