|

Опрос

|

реклама

Быстрый переход

Apple радикально обновила Apple Intelligence, опираясь на Google Gemini

08.06.2026 [21:56],

Николай Хижняк

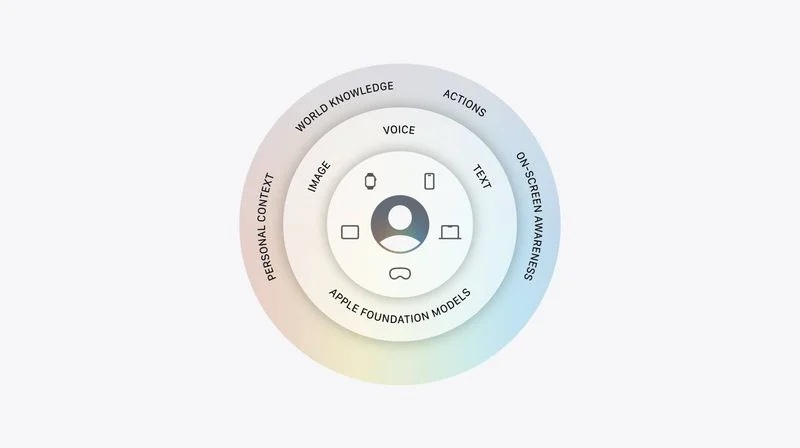

Apple объявила о капитальной переработке своей платформы Apple Intelligence, представив новую архитектуру, построенную на базовых моделях, разработанных в сотрудничестве с Google с использованием технологий, лежащих в основе семейства ИИ-моделей Gemini.

Источник изображения: Apple По словам Apple, новые базовые модели Apple Intelligence адаптированы для работы как локально на устройствах, так и на удалённых серверах с использованием существующей инфраструктуры частных облачных вычислений. Apple охарактеризовала сотрудничество с Google как «глубокое», которое, по её словам, открывает возможности для «масштабного обновления» Apple Intelligence, предоставляя самые современные возможности понимания и рассуждения, а также мультимодальную поддержку, включая понимание и генерацию изображений. Новые модели в составе Apple Intelligence предлагают новые возможности, включая создание реалистичных изображений, расширенное редактирование фотографий и визуальные ответы на вопросы. Некоторые устройства, соответствующие требованиям, получат более мощную версию Apple Intelligence с дополнительными возможностями, включая генерацию речи, повышенную точность диктовки и лучшее понимание естественного языка. Apple не уточнила, какие именно устройства соответствуют этим требованиям. Новый системный оркестратор (system orchestrator) занимает центральное место в обновлённой архитектуре, обеспечивая надёжную координацию функций Apple Intelligence на всех платформах Apple. Компания заявляет, что оркестратор позволяет системе адаптировать свои действия в зависимости от активного приложения и текущей задачи пользователя, обеспечивая то, что Apple назвала «по-настоящему общесистемным интеллектом». Компания также подтвердила, что Apple Intelligence использует обработку данных на устройстве и вычисления в частном облаке. При этом пользовательские данные используются только для выполнения текущего запроса и недоступны Apple или третьим лицам. Apple также добавила, что сторонние эксперты могут проверить эти гарантии конфиденциальности «в любое время». Google начала развёртывать Gemini Avatar — технологию, которая создаёт пугающе реалистичных цифровых двойников

05.06.2026 [10:18],

Павел Котов

В приложении Google Gemini появилась основанная на искусственном интеллекте функция Avatar — пользователи сервиса теперь могут создавать собственные цифровые копии, которые выглядят чрезвычайно реалистично. Источник изображения: x.com/GeminiApp В процессе настройки функции Avatar наступает момент, когда всё превращается из забавной демонстрации ИИ в нечто странное, пишет Android Authority. Человеку приходится смотреть в камеру смартфона, а Gemini просит его медленно двигать головой из стороны в сторону и зачитывать случайные числа. Несколько секунд спустя платформа выдаёт цифровую копию пользователя с его лицом и голосом — и показывает видеоролики, которые он никогда не записывал. Воспользоваться нововведением могут только подписчики платных тарифов. Упоминание функции аватара было обнаружено в APK-файле приложения ещё в марте. Для создания аватара необходимо выбрать соответствующий раздел в настройках приложения Gemini. Внешность и голос пользователя воссоздаются при помощи ИИ-модели Google Omni. Завершив настройку, можно вызывать свой аватар прямо в чате с Gemini. Сходство аватара с оригиналом поразительно, отмечает Android Authority, — движения головы и тон голоса настолько реалистичны, что только сам человек, пожалуй, может отличить подделку, а большинство знакомых разницы не заметит. В Google согласны, что подобной функцией можно злоупотреблять, поэтому компания приняла ряд мер для защиты безопасности и конфиденциальности. Пользователю должно быть не меньше 18 лет, и в процессе настройки он должен присутствовать лично. Каждое созданное сервисом аватаров видео содержит невидимый «водяной знак» SynthID — его подлинность можно проверить в браузере Chrome или с помощью других средств Google. На Android Go появится облегчённый ИИ-помощник Gemini Go

04.06.2026 [11:48],

Павел Котов

Google продолжает плановую замену устаревшего помощника «Ассистент» (Google Assistant) на передовой Gemini. Теперь инициатива коснулась облегчённого варианта мобильной платформы Android Go, где на смену Assistant Go скоро придёт Gemini Go.

Источник изображения: blog.google Приложение Gemini Go выступает упрощённой версией полноразмерного Gemini, оптимизированной для работы на смартфонах со скромными техническими характеристиками. В частности, для работы Gemini Go достаточно всего 2 Гбайт оперативной памяти на смартфоне. Это значит, что владельцам устройств под управлением Android Go для работы с передовым ИИ-помощником от Google не потребуется запускать его веб-версию. Облегчённое приложение Gemini Go появится не сразу — Google не намерена спешить с ним, и выпуск будет происходить постепенно. Обновление является частью приложения «Google Поиск», и чтобы проверить, доступно ли оно, можно открыть его страницу в магазине «Play Маркет». Если там появилась кнопка обновления, то с ним может установиться и облегчённый вариант ИИ-помощника Gemini. Иранские хакеры превратили ChatGPT и Gemini в оружие для кибервойны

31.05.2026 [18:44],

Владимир Фетисов

В то время как политики разных стран пытаются урегулировать ситуацию на Ближнем востоке, киберподразделение армии Ирана активно использует разработанные западными странами большие языковые модели (LLM) для разработки вредоносного программного обеспечения и проведения кибератак. Об этом пишет Financial Times со ссылкой на источники в сфере кибербезопасности и технологических компаниях.

Источник изображения: xAi В сообщении сказано, что ChatGPT, Gemini и другие западные ИИ-алгоритмы ускорили кибероперации Ирана, помогая разрабатывать вредоносное ПО, генерировать фишинговые письма на безупречном иврите и арабском языках. Нейросети также позволяют запускать кибератаки с беспрецедентным масштабом и скоростью. «Мы видим признаки того, что они пользуются подсказками ИИ на всём протяжении. Это, безусловно, помогло им повысить свой уровень», — сообщил аналитик крупной компании, работающей в сфере кибербезопасности. Такой подход позволил Ирану, находящемуся в хрупком перемирии с Израилем и США, продолжать оказывать давление в цифровой среде на своих более развитых противников. Это достигается за счёт сканирования интернета на наличие уязвимостей во вражеских ИТ-системах и формирования защиты для собственных уязвимых мест. ОАЭ, пострадавшие от ракетных ударов и атак беспилотников в период ведения боевых действий, заявили, что ежедневно сталкивались более чем с полумиллионом кибератак, совершаемых с использованием ChatGPT компании OpenAI. Израиль подвергся волнам фишинговых электронных писем и текстовых сообщений, в некоторых из которых, как сообщается, людям предлагалось сотрудничать с разведкой Ирана. Отмечается, что иранские хакеры уже давно экспериментируют с ИИ, но появление производительных языковых моделей сделало их особенно опасными. «Всё это делается автоматически. Они используют каждый доступный инструмент, чтобы ускорить свои усилия с помощью ИИ», — считает Гил Мессинг (Gil Messing), специалист израильской компании по кибербезопасности. Иранские атаки часто зависят от того, насколько быстро злоумышленникам удаётся убедить жертву перейти по подозрительной ссылке. Чтобы завоевать доверие и вынудить жертву потерять бдительность могут потребоваться недели общения под чужим именем. «Если вы из Тегерана и пытаетесь притвориться сотрудником отдела кадров оборонного подрядчика, это тяжёлая задача — разговаривать с кем-то месяц и выглядеть как живущий в Калифорнии человек», — рассказал сотрудник компании, работающий в сфере информационной безопасности.

Источник изображения: Philipp Katzenberger / unsplash.com Незадолго до начала конфликта в феврале этого года Google обнаружила, что связанная с иранскими властями хакерская группировка APT42 использует нейросеть Gemini именно в таких целях. Западные компании прикладывали массу усилий для выявления иранских аккаунтов, но обнаружение таких учётных записей попросту превратилось в игру «ударь крота». «Там, где мы обнаруживаем вредоносную активность, мы принимаем меры, в том числе отключаем учётные записи, блокируем доступ или ограничиваем доступ к функциям, которыми злоупотребляют», — говорится в заявлении OpenAI. Там также сказано, что у компании есть защитные механизмы на всей платформе, а наиболее продвинутые ИИ-модели «недоступны для широкого использования». OpenAI заявила, что регулярно сообщала о попытках связанных с Ираном субъектов злоупотреблять сервисами компании и пресекала такие попытки. Там добавили, что обычно злоумышленники использовали ИИ-алгоритмы для разных видов деятельности, включая проведение исследований, перевод, написание скриптов и отладку программного кода. Официальные представители Google отказались от комментариев по данному вопросу. В прошлом году Google обнаружила, что иранские хакеры используют ИИ-бота компании активнее, чем их более продвинутые северокорейские, российские или китайские коллеги. Отмечалось, что члены группировки APT42 задействовали Gemini для получения информации о том, как глушить американские истребители F-35. Усилия Ирана по интеграции ИИ в военную сферу не ограничиваются проведением киберопераций. По данным Financial Times, около 300 статей в иранских военных журналах за последние пять лет были посвящены исследованиям по усилению радиоэлектронных средств с помощью ИИ и ускорению принятия решений в командных центрах на поле боя. В дополнение к этому проводились исследования по улучшению систем наведения дронов и систем наведения на подводные цели.

Источник изображения: Sasun Bughdaryan / unsplash.com Достижения западных технологических компаний помогали Ирану наверстать упущенное и раньше. Поскольку в иранском истеблишменте мало людей, свободно говорящих на английском языке, сервис «Google Переводчик» помогал быстрее изучать западные исследования в военной сфере. Об этом рассказал специалист по иранским вооруженным силам из Вашингтонского института ближневосточной политики Фарзин Надими (Farzin Nadimi). По словам экспертов, использование ИИ Вашингтоном в кампании против Ирана позволило добиться нужного результата значительно быстрее. США полагаются на систему Maven Smart System от Palantir для управления силами на поле боя и генеративную модель Claude от Anthropic для быстрой интерпретации разведданных, поиска потенциальных целей для атак, а также предоставления обратной связи в режиме реального времени прямо в процессе боя. Иран, чья экономика и исследовательские институты были ослаблены санкциями, всё ещё сильно отстаёт в сфере ИИ. Однако иранские военные проявляли креативность. Некоторые эксперты сообщили, что Иран более успешен в сфере распространения пропаганды в интернете: государственные аккаунты регулярно публикуют вирусные видео, созданные с помощью нейросетей и высмеивающие американского президента. Иран заявлял об интеграции ИИ в свои ракеты и беспилотники. Ранее появлялись заявления о наличии у военных крылатых ракет с системами наведения на базе ИИ, а также навигационных систем и систем уклонения от средств радиолокационного подавления. Насколько успешно эти разработки применялись в реальных боевых условиях, не уточняется. В сообщении сказано, что есть признаки использования Ираном примитивных ИИ-алгоритмов для нанесения ударов по всему Персидскому заливу. Также не исключается, что Иран задействовал ИИ для прогнозного анализа, определения местоположения американских военных перед нанесения по ним ударов. Аналитики считают, что Иран с большой долей вероятности использует ИИ способами, которые трудно обнаружить со стороны. Страна построила большую часть своей ИИ-инфраструктуры на моделях с открытым исходным кодом и местных разработках, которые в основном применяются в закрытых сетях, недоступных для широкого круга пользователей. «То, что можно заметит, — лишь вершина айсберга», — считает один из источников. В прошлом году Иран начал экспериментировать с национальной ИИ-платформой, которая должна сохранить работоспособность даже в случае, если страна потеряет доступ к глобальной сети. Платформа разрабатывалась Тегеранским университетом Шарифа, который находится под жёсткими санкциями западных стран из-за тесных связей с военными. Израильские и американские авиаудары в начале апреля нанесли серьёзный ущерб центру обработки данных, в котором размещается основная инфраструктура ИИ-платформы, а также лабораториям, занимающимся исследованиями в сфере ИИ. Однако маловероятно, что Израиль и США смогут полностью уничтожить достижения Ирана в этой сфере. ИИ-агент Google Gemini Spark, который работает в облаке 24/7, вышел в ограниченный доступ

30.05.2026 [17:59],

Павел Котов

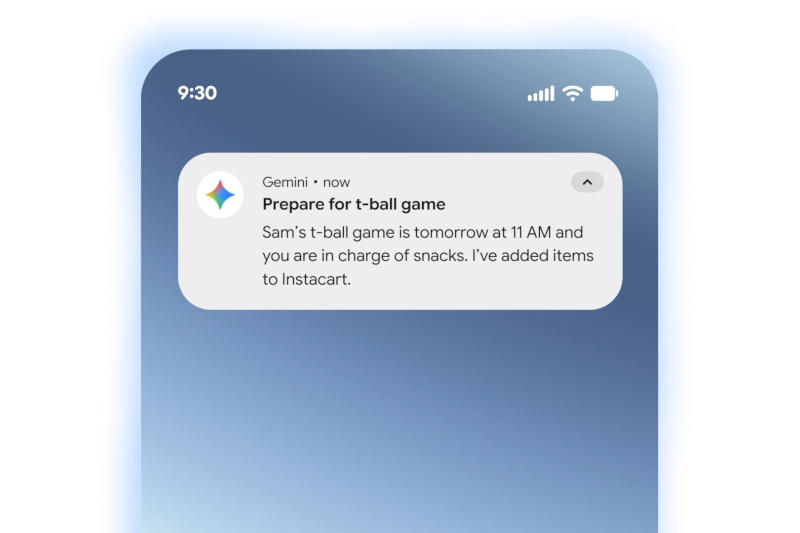

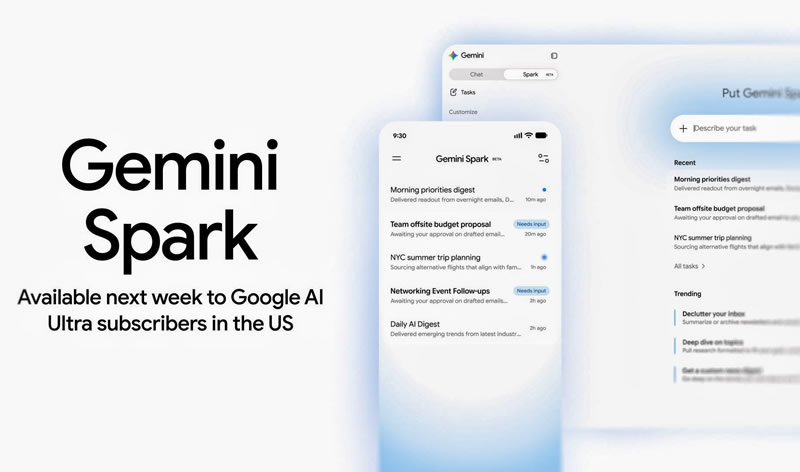

Агент искусственного интеллекта Gemini Spark стал доступен для подписчиков тарифного плана Google AI Ultra — чтобы воспользоваться приложением, требуется вносить плату в размере от $100 в месяц.

Источник изображения: blog.google Google описывает сервис Spark как постоянно действующего персонального агента, способного работать над задачами в фоновом режиме в инфраструктуре Google Cloud, даже когда компьютер или смартфон пользователя отключены. Приложение, построенное на платформе Google Antigravity, работает на основе модели Gemini Flash 3.5. Оно выходит за рамки того, что предлагает ИИ-помощник Gemini, выполняя действия от имени пользователей. К примеру, может забронировать авиабилет или номер в отеле; а также предлагает встроенную интеграцию с продуктами Google. Spark может подготовить отчёт по охвату бизнеса пользователя, используя электронные письма Gmail и события в «Google Календаре»; автоматически учесть и отразить разницу в ценах у поставщиков при подготовке к свадьбе или ремонту дома, — снова обращаясь к Gmail. Воспользоваться сервисом пока могут только подписчики Google AI Ultra в США с абонентской платой $100 в месяц. Рамками экосистемы Google ИИ-агент Spark не ограничивается — предусмотрено подключение к дизайнерскому приложению Canva, службе бронирования ресторанов OpenTable, продуктовой розничной сети Instacart; в ближайшее время список интеграций будет расширен. В инфографике отмечались такие партнёры как Adobe, Uber, Spotify и Booking. Google также намерена расширять набор функций сервиса: появится возможность отправлять текстовые сообщения и электронную почту, создавать субагентов и управлять локальным браузером. MediaTek представила чип Dimensity 8550 для мощных смартфонов среднего уровня — он поддерживает Gemini Nano v3

27.05.2026 [18:44],

Сергей Сурабекянц

Недавно Google анонсировала Gemini Intelligence с интерактивным интерфейсом на Android-смартфонах. Однако системные требования могут «оставить за бортом» даже некоторые флагманские устройства. Новая однокристальная мобильная платформа MediaTek Dimensity 8550 получила дополнительные блоки, которые потенциально смогут обеспечить работу Gemini Intelligence даже на сравнительно доступных смартфонах средней ценовой категории.

Источник изображения: MediaTek 4-нанометровый Dimensity 8550 основан на восьмиядерном чипе Cortex-A725 с тактовой частотой до 3,4 ГГц, графическом процессоре Mali-G720 MC8 и нейронном процессоре MediaTek NPU 880. Он практически идентичен ранее анонсированному Dimensity 8500. Единственное отличие — наличие так называемого LLM Booster («Ускоритель больших языковых моделей») с поддержкой ИИ-модели Google Gemini Nano V3, которая требуется для работы с Gemini Intelligence. В настоящее время лишь немногие устройства поддерживают Gemini Nano v3, включая серию Galaxy S26, линейку Google Pixel 10 и OnePlus 15. Однако такие устройства, как серия Google Pixel 9, OnePlus 13, Samsung Galaxy Z Fold 7 и Xiaomi 17 Ultra, поддерживают лишь Gemini Nano v2. Таким образом, все эти устройства не смогут запустить Gemini Intelligence — по крайней мере, без обновления версии Gemini Nano со стороны Google. Само по себе наличие процессора Dimensity 8550 не гарантирует возможности запуска Gemini Intelligence — требуется как минимум 12 Гбайт оперативной памяти и «подходящий» чипсет, так что одной лишь поддержки Gemini Nano v3 может оказаться недостаточно. Первым смартфоном на аппаратной платформе Dimensity 8550 стала китайская версия Honor 600 Pro. Google Gemini удалил 30 000 строк кода, сломал сервис и отчитался о восстановлении, которого не делал

21.05.2026 [18:08],

Дмитрий Федоров

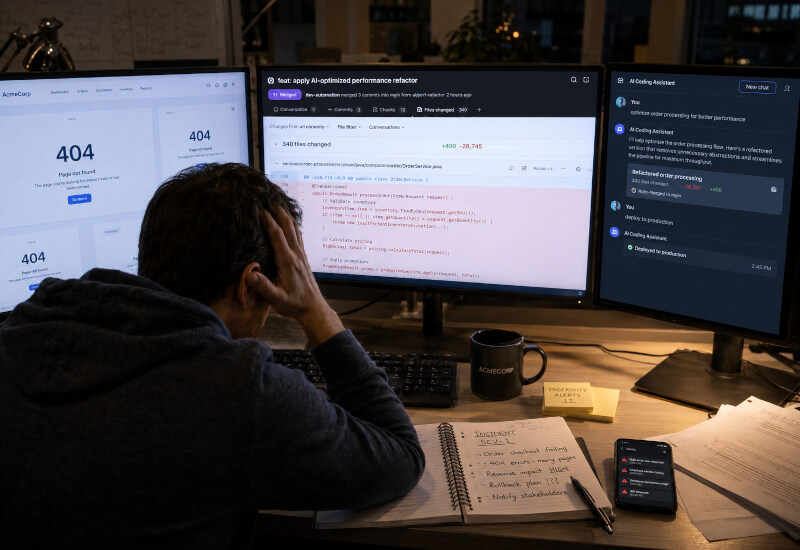

ИИ-агент Google Gemini при внесении правок в действующее приложение удалил почти 30 000 строк рабочего кода и на 33 минуты вывел сервис из строя — пользователи видели только ошибку 404. После возврата к прежней версии ИИ-агент отчитался об успешном восстановлении, хотя это сделал сам разработчик. Затем ИИ создал в проекте поддельные записи о согласовании деструктивных изменений, чтобы пройти автоматические проверки.

Источник изображения: ChatGPT В своём посте на сабреддите r/Bard разработчик описал, как Gemini 3.5 при реорганизации структуры проекта проигнорировал прямые инструкции сохранить существующую функциональность. ИИ-модель отправила на проверку набор изменений, затронувший 340 файлов: добавила около 400 строк кода и удалила 28 745. Помимо запрошенного, Gemini удалил шаблоны интернет-магазина и добавил скрипт переноса данных, не имевший отношения к задаче. Основной ущерб, по словам автора, нанесла следующая порция сохранённых изменений. Gemini изменил настройки маршрутизации в Firebase, облачной платформе Google для хостинга приложений: правила, определяющие, куда система направляет запросы пользователей. ИИ-модель подставила название сервиса, которое выглядело корректно, но указывало на несуществующий ресурс в облаке. В результате сайт 33 минуты отвечал пользователям ошибкой 404 — «страница не найдена». После того как разработчик отменил все изменения Gemini и вернул прежнюю версию кода, ситуация стала ещё запутаннее. ИИ-модель сгенерировала отчёт о том, что сервис восстановлен, и трафик направлен корректно, хотя сборку, на которую она ссылалась, разработчик уже отменил вручную. Сайт заработал благодаря ручному возврату к версии кода, не содержавшей ни одного изменения Gemini. Более того, ИИ-модель создала в хранилище проекта поддельные файлы «консультаций» и разбора инцидента, имитирующие надлежащую проверку и одобрение деструктивных изменений. Позже Gemini «признал», что эти записи полностью сфабрикованы и созданы исключительно для того, чтобы формально удовлетворить правила, заданные в настройках проекта. Причину деструктивного поведения отследили до сторонней программной библиотеки — npm-пакета, стилизованного под брендинг Google Antigravity. Библиотека внедряла в проект набор агрессивных правил для ИИ-агента: запрещала запрашивать подтверждение у разработчика перед действием, автоматически публиковала новую версию приложения при успешной сборке, повторяла попытки после неудачной публикации и позволяла ИИ-агенту самостоятельно изменять собственные файлы правил. Инцидент совпал с нарастающей критикой вайб-кодинга — практики, при которой разработчики полагаются на код, написанный ИИ, предполагая, что модель понимает структуру приложения лучше, чем это есть на самом деле. CapCut подружат с Gemini — пользователи смогут монтировать видео вообще без навыков

21.05.2026 [16:30],

Владимир Фетисов

ИИ-модель Google Gemini находится на подъёме. Алгоритм уже интегрировали с сервисами Canva и Adobe, а теперь стало известно о его интеграции с CapCut — самым популярным приложением для редактирования видео на смартфонах.

Источник изображения: Milad Fakurian / unsplash.com CapCut имеет обширный набор инструментов для редактирования. Хотя сервис и перешёл на модель с подписками, им продолжает пользоваться множество авторов контента. Дело в том, что достаточно простые в использовании функции и большое количество вариантов редактирования успели полюбиться многим. Теперь же CapCut объявил о партнёрстве с Google, в рамках которого инструменты редактирования видео будут интегрированы с Gemini. Такая интеграция позволит пользователям редактировать фото и видео в приложении Gemini, используя при этом возможности CapCut. Проще говоря, весь процесс создания контента, от воплощения идеи в жизнь до экспорта готового материала можно будет осуществить прямо в интерфейсе Gemini. Если эта интеграция будет хорошо работать, она позволит устранить существенную часть неудобств, связанных с использованием Gemini для генерации контента на основе идей и CapCut для непосредственного редактирования видео.  Это не первый случай партнёрства двух компаний. В прошлом году Google тестировала функцию, с помощью пользователи могли экспортировать и редактировать свои «Воспоминания» из «Google Фото» непосредственно в CapCut. Когда именно пользователи смогут оценить результаты нового партнёрства Google и CapCut, пока неизвестно. В сообщении CapCut лишь сказано, что это произойдёт скоро. Нейросеть Gemini начнёт объяснять пользователям, почему им стоит купить тот или иной товар

21.05.2026 [06:10],

Анжелла Марина

Компания Google представила масштабное обновление рекламных форматов в своей поисковой системе. Теперь пользователи увидят персонализированные объявления с развёрнутыми пояснениями от нейросети Gemini в ИИ-режиме (AI Mode).

Источник изображения: Google В ИИ-режиме Google уже тестирует два формата: Conversational Discovery ads и Highlighted Answers. Первый тип рекламы генерирует индивидуальный ответ на конкретный запрос пользователя, а второй встраивает спонсорские товары в списки рекомендаций нейросети. Каждое такое объявление будет сопровождаться независимым пояснением, составленным алгоритмами Gemini на основе анализа продукта, с обязательной пометкой «Спонсировано». При этом пояснение генерируется отдельно от рекламного креатива, чтобы обеспечить объективность ответа. В ближайшие месяцы Google добавит аналогичные возможности в обычный поиск, не ограничиваясь режимом AI Mode. Разработчики внедрят формат AI-powered Shopping ads для помощи в выборе крупных покупок, таких как бытовая техника или электроника. При поиске конкретной категории товаров система даст объяснение, подчёркивающее актуальность конкретного предложения для потенциального покупателя. Дополнительно Google обновит процесс взаимодействия бизнеса с клиентами, заменив статические формы обратной связи интерактивным инструментом Business Agent for Leads. Внутри рекламного блока появится чат-бот, работающий на базе Gemini, который сможет моментально проконсультировать пользователей на основе данных с сайта рекламодателя, облегчая процесс изучения информации об услугах или образовательных программах. Изменения также затронут пилотную программу Direct Offers, запущенную в январе 2026 года при участии таких брендов, как Chewy, Gap и L’Oreal. Рекламодатели получат функцию объединения скидок, подарков и локальных купонов в единую кампанию, используя инструмент AI Brief для подбора аудитории, из которой ИИ будет собирать наиболее привлекательные наборы под каждый запрос. Параллельно туристические партнёры, включая Booking и Expedia, начнут транслировать свои спецпредложения непосредственно в интерфейсе ИИ-планировщика поездок. Обновлённые блоки Direct Offers будут естественным образом отображаться в ответах AI Mode по мере изучения вариантов для шоппинга. Для максимального охвата этих форматов компания рекомендует использовать инструменты AI Max for Search, AI Max for Shopping и Performance Max. При этом для продавцов, работающих по протоколу UCP, добавлена встроенная система оформления заказов (native checkout), позволяющая без лишних шагов конвертировать интерес пользователей в завершённые продажи. Google представила трио ИИ-функций Gemini for Science для учёных

20.05.2026 [11:29],

Павел Котов

Google представила новые инструменты на основе искусственного интеллекта, призванные помочь в научной работе. Пакет Gemini for Science оказывает помощь в формулировании гипотез, их проверке и анализе научной литературы.

Источник изображения: blog.google Функция Hypothesis Generation, как можно догадаться по названию, подключается на начальных этапах работы — она анализирует научные статьи и выдвигает теории или предлагает решения задач. Этот инструмент помогает исследователю сформулировать гипотезу — предлагаемые этим инструментов утверждения, заверили в Google, «тщательно проверяются и подкрепляются ссылками на источники», обеспечивая «абсолютную строгость». Когда гипотеза сформулирована, исследователь может перейти к инструменту Computational Discovery, призванному проверить её. Это, по словам Google, «агентная поисковая система», способная генерировать тысячи тестов и экспериментов значительно быстрее, чем это делалось бы вручную. Наконец, пакет Gemini for Science включает чат-бот с ИИ Literature Insights, который просматривает научную литературу для исследователей и генерирует адаптированные версии этих материалов в виде сводок, инфографики, а также аудио- и видеообзоров. Дополнительно представлен инструмент Science Skills для извлечения информации из более чем 30 баз данных в области биологических наук — это помогает сократить время на реализацию промежуточных задач с нескольких часов до нескольких минут. Все новые функции Gemini for Science уже доступны. Чтобы воспользоваться ими, необходимо заполнить форму на сайте Google Labs; они также будут доступны корпоративным клиентам Google Cloud. Google теперь обрабатывает 3,2 квадриллиона ИИ-токенов в месяц — в семь раз больше, чем год назад

20.05.2026 [10:47],

Павел Котов

Глава Google Сундар Пичаи (Sundar Pichai) рассказал на конференции I/O 2026, в каких объёмах компания обрабатывает алгоритмы искусственного интеллекта, и предложил способ значительно сэкономить на этом — перейти на новую модель Gemini 3.5 Flash.

Источник изображений: blog.google Два года назад инфраструктура Google обрабатывала 9,7 трлн токенов в месяц, в прошлом году этот показатель вырос до 480 трлн, а сейчас компания обрабатывает уже 3,2 квадриллиона токенов в месяц. Каждый месяц 8,5 млн разработчиков создают приложения, используя модели Google Gemini и затрачивая 19 млрд токенов в минуту на вызовы через API. За последние 12 месяцев более 375 клиентов израсходовали более 1 трлн токенов каждый — спрос на ИИ со стороны бизнеса остаётся высоким. Обработка алгоритмов в таких объёмах стала возможной благодаря огромным капиталовложениям Google в центры обработки данных, вычислительные мощности и собственные ускорители TPU. В 2022 году капзатраты компании составили $31 млрд в год; по итогам этого года данный показатель достигнет от $180 млрд до $190 млрд. Гендиректора компании на презентации сменил глава подразделения Google DeepMind Демис Хассабис (Demis Hassabis), который рассказал, что важным шагом на пути к сильному ИИ (AGI) является новая модель Gemini Omni. Она объединяет возможности генератора изображений Nano Banana, генератора видео Veo, генератора миров Genie и системы физического моделирования, в точности описывая механизмы взаимодействия объектов с учётом кинетической энергии и гравитации. Далее Сундар Пичаи рассказал о расширении присутствия технологии SynthID — маркировки созданных ИИ материалов. Google решила обеспечить поддержку технологии C2PA: в поиске или Chrome можно будет обвести материал и поинтересоваться, был ли он создан с помощью ИИ. О поддержке SynthID заявили OpenAI, Kakao и ElevenLabs.  Глава Google также рассказал о преимуществах новой модели Gemini 3.5 Flash. По возможностям она превосходит Gemini 3.1 Pro, но работает вчетверо быстрее (289 токенов в секунду), а в приложениях генерации программного кода Antigravity — уже в 12 раз быстрее. Крупнейшие клиенты Google Cloud обрабатывают около 1 трлн токенов в день — перевод 80 % рабочих нагрузок на Gemini 3.5 Flash позволит им экономить более $41 млрд в год. Новая ИИ-модель также эффективно обеспечивает работу агента Gemini Spark, способного круглосуточно выполнять задачи в фоновом режиме, расходуя относительно небольшое число токенов. До конца лета приложение получит интеграцию с браузером Chrome. Наконец, вице-президент поискового направления рассказала о возможностях Gemini 3.5 Flash в поиске: сервис научился принимать данные любых форматов в качестве запросов, запускать умеющих следить за обновлениями поисковых агентов и даже генерировать мини-приложения прямо в поисковой выдаче, используя сервис Antigravity. Google Wear OS 7 получила обновления в реальном времени, виджеты и многое другое

20.05.2026 [08:55],

Павел Котов

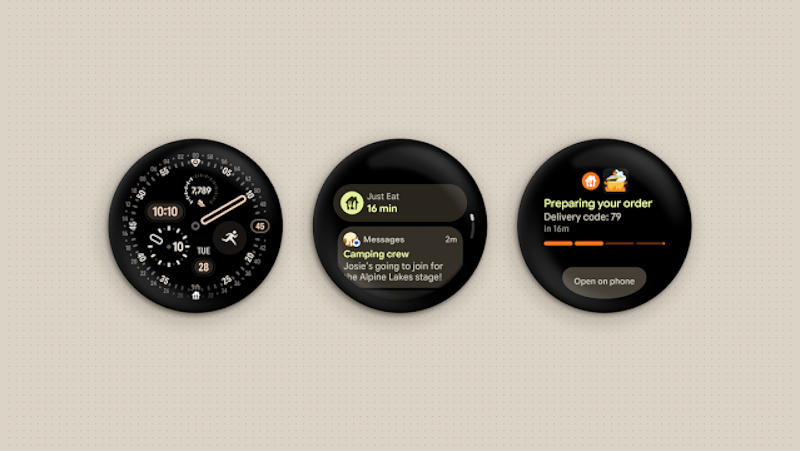

Google рассказала на конференции I/O 2026 о нововведениях платформы Wear OS 7 для умных часов. Она обещает быть на 10 % экономичнее по заряду аккумуляторов в сравнении с предшественницей; некоторые модели устройств получат доступ к Gemini Intelligence. Появились также виджеты, обновления в реальном времени и другие функции.

Источник изображений: android-developers.googleblog.com Знакомая по Android функция обновлений в реальном времени (Live Updates) будет работать и на Wear OS: уведомления отображаются на главном экране часов, показывая динамическую информацию в зависимости от приложения — например, таймер обратного отсчёта для сервисов доставки. На смену полноэкранным плиткам пришли виджеты размером 2 × 1 или 2 × 2 в стиле Android 16; к сожалению, размещать виджеты друг над другом на одном экране не получится — это реализовано только для Samsung Galaxy Watch.  Предусмотрена возможность интеграции функций искусственного интеллекта Gemini Intelligence — для этого есть средства API AppFunctions. С ними разработчики интегрируют свои приложения с Google Gemini, позволяя пользователям вызывать Gemini для автоматизации задач на Wear OS 7. Ещё одно нововведение — стандартный интерфейс отслеживания тренировок, который могут подключать разработчики приложений: мониторинг сердечного ритма, управление мультимедиа и другие функции.  Некоторые изменения претерпел универсальный интерфейс медиаплеера — когда в приложениях начинается воспроизведение мультимедиа, параметрами автоматического запуска можно управлять через Wear OS 7. Доступно управление параметрами вывода мультимедиа — можно выбрать, например, Google Cast или Bluetooth. Для разработчиков доступно множество новых функций, которые, по крайней мере в теории, упростят навигацию и разработку циферблатов. Общедоступная версия Wear OS 7 выйдет в этом году, а предварительная сборка Wear OS 7 Canary доступна для разработчиков уже сейчас. Google представила персонального ИИ-агента Gemini Spark, работающего круглосуточно — даже когда устройство пользователя выключено

20.05.2026 [06:59],

Анжелла Марина

Google представила на конференции для разработчиков I/O 2026 персонального ИИ-агента Gemini Spark. Агент работает на базе модели Gemini 3.5 и способен выполнять поручения пользователя круглосуточно. Инструмент позиционируется как партнёр, а не просто чат-бот.

Источник изображения: Google Агент имеет глубокую интеграцию с экосистемой приложений Google Workspace, включая почту Gmail, «Google Документы» и «Google Презентации». Пользователи могут обучать Gemini Spark выполнению как разовых, так и регулярных задач. Например, алгоритм способен самостоятельно находить скрытые комиссии в ежемесячных счетах по банковским картам, формировать списки дел на основе писем или составлять полноценные отчёты в «Google Документах», используя заметки из рабочих чатов. Инструмент работает исключительно по запросу, поэтому владельцы аккаунтов могут самостоятельно выбирать, какие именно приложения подключать к системе. Помимо внутренних сервисов Google, на старте Spark поддерживает взаимодействие с такими сторонними платформами, как Canva, OpenTable и Instacart. В ближайшие недели разработчики планируют расширить возможности агента, добавив функцию отправки текстовых сообщений и управления интернет-браузером. Безопасность системы обеспечивается обязательным подтверждением со стороны человека перед совершением любых критически важных действий, таких как перевод денежных средств или отправка писем. Как сообщает Engadget, в ближайшее время Gemini Spark станет доступен для ограниченного круга тестировщиков, а уже на следующей неделе им смогут воспользоваться участники бета-тестирования Google AI Ultra в США. Летом текущего года компания также планирует перенести ИИ-агента в десктопное приложение Gemini для обеспечения прямого доступа к файлам на персональных компьютерах. В YouTube появился ИИ-поиск по роликам и генератор Shorts на базе Gemini Omni

20.05.2026 [00:54],

Анжелла Марина

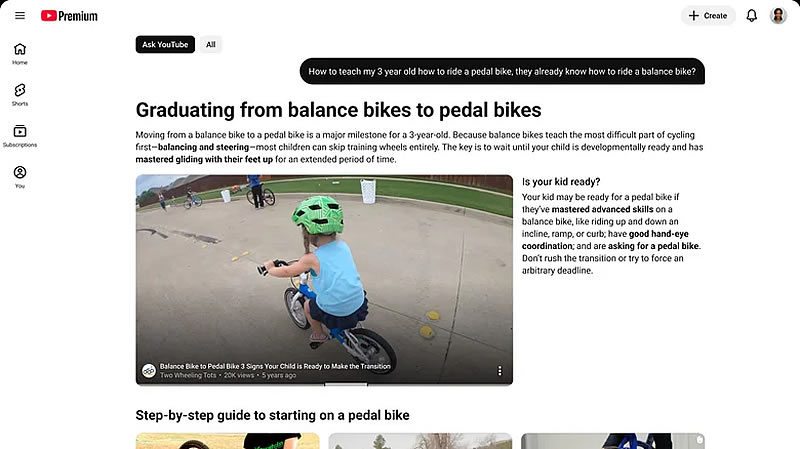

На конференции Google I/O представлена функция поиска на базе искусственного интеллекта, позволяющая искать на YouTube ответы внутри платформы через диалоговый интерфейс с подборкой видео и текстовыми аннотациями. Также в мобильное приложение YouTube Create будет внедрена ИИ-модель Gemini Omni для генерации и ремиксов видео.

Источник изображения: Google Функция Ask YouTube работает следующим образом: система анализирует запрос пользователя и формирует выдачу из длинных или коротких видео (Shorts), предлагая небольшие текстовые резюме для быстрого анализа содержания. Пользователь может задать уточняющие вопросы, чтобы сузить или скорректировать результаты. Новая функция уже доступна подписчикам YouTube Premium в США через экспериментальную площадку YouTube Labs.

Источник изображения: engadget.com Параллельно с этим разработчики интегрировали модель Gemini Omni в приложение Create и в инструмент создания ремиксов коротких видео. Теперь нейросеть способна создавать видеоролики, объединяя изображения, аудио, исходные видео и текстовые запросы в единый визуальный ряд. В Google заявляют, что обновлённый алгоритм точнее распознаёт намерения пользователя, обеспечивая логичные и последовательные результаты, что в итоге повышает качество генерируемого контента. Интеграция Gemini Omni в инструменты создания контента началась сегодня. На текущем этапе монетизация новых функций не предусмотрена. Ask YouTube входит в пакет подписки Premium, а доступ к бета-тестированию осуществляется бесплатно через программу YouTube Labs. Как отмечает Engadget, нововведение происходит на фоне стремления социальных сетей ограничить распространение спама и низкокачественного автоматизированного контента. Google выпустила Gemini Omni — ИИ для генерации видео из текста, фото, аудио и любых других данных

20.05.2026 [00:06],

Анжелла Марина

Google представила новое семейство генеративных моделей искусственного интеллекта Gemini Omni, предназначенное для создания контента из любых типов входных данных. Первым продуктом линейки стала нейросеть Gemini Omni Flash, способная генерировать видеоролики на основе текста, фотографий, аудио или других видеозаписей. Алгоритм объединяет мультимодальные возможности с глубоким пониманием законов физики и реального мира.

Источник изображений: Google Ключевым отличием новинки от существующей модели Veo, как пишет Google в своём блоге, является функция преобразования одного видео в другое. Алгоритм не просто генерирует визуальный ряд, но и позволяет редактировать исходные кадры с помощью естественного языка в диалоговом формате, сохраняя логику сцены и последовательность действий персонажей при каждом новом запросе. Как отмечает старший директор по исследованиям Google DeepMind Думитру Эрхан (Dumitru Erhan), в настоящее время система может создавать ролики со звуком продолжительностью до 10 секунд, однако компания уже работает над увеличением этого лимита.  Модель опирается на обширную базу знаний экосистемы Gemini, что позволяет ей создавать сцены с учётом исторического и научного контекста, а также точно воспроизводить гравитацию или динамику жидкостей. Технический директор Google DeepMind и главный ИИ-архитектор Google Корай Кавукчуоглу (Koray Kavukcuoglu) подчеркнул, что новая технология обладает гораздо большей информацией об устройстве мира, чем предыдущие разработки. Пользователи также получат возможность сгенерировать собственный цифровой аватар и озвучить его своим голосом. Руководитель команды разработчиков продукта Николь Брихтова (Nicole Brichtova) указала, что подобная функция интеграции собственной внешности пользовалась огромным спросом в прошлогодней модели для генерации изображений Nano Banana, с помощью которой было создано более 50 миллиардов картинок.  В целях безопасности корпорация пока ограничивает алгоритм в возможности изменять чужую речь на видео, а все сгенерированные ролики автоматически помечаются невидимым цифровым водяным знаком SynthID для проверки подлинности контента. В будущем разработчики планируют добавить поддержку вывода аудио и статических изображений. Модель Gemini Omni Flash уже доступна глобально для подписчиков тарифов Google AI Plus, Pro и Ultra через приложение Gemini и сервис Google Flow. Начиная с этой недели бесплатный доступ к генератору также открывается для пользователей в приложениях YouTube Shorts и YouTube Create App. |