|

Опрос

|

реклама

Быстрый переход

Google представила Gemini 3.5 Flash — сверхбыстрая ИИ-модель уже доступна бесплатно

19.05.2026 [21:10],

Андрей Созинов

Google представила новое семейство ИИ-моделей Gemini 3.5, а первым его представителем стала Gemini 3.5 Flash. Компания называет новинку «крупным шагом вперёд» в создании более интеллектуальных ИИ-агентов, сочетающих высокую производительность и быструю работу.

Источник изображений: Google По словам Google, Gemini 3.5 Flash не жертвует качеством ради скорости. Напротив, компания утверждает, что модель сопоставима по возможностям с флагманскими ИИ-системами и при этом обеспечивает заметно более быстрые ответы. Gemini 3.5 Flash заметно опережает прежнюю Gemini 3 Flash. Более того, новинка превосходит Gemini 3.1 Pro в ряде тестов, связанных с программированием и агентными задачами, а также демонстрирует сильные результаты в мультимодальном анализе данных. Кроме того, новинка в некоторых тестах превзошла более мощных конкурентов в лице GPT-5.5 и Claude Opus 4.7. Разработчики отдельно акцентируют внимание на сценариях использования Gemini 3.5 Flash с ИИ-агентами. Свежая модель оптимизирована для длительных и сложных задач, где требуется последовательное выполнение множества действий. По словам технического директора Google DeepMind Корая Кавукчуоглу (Koray Kavukcuoglu), модель способна самостоятельно выполнять сложные цепочки задач, связанных с программированием, а также управлять исследовательскими проектами. В ходе внутренних тестов ИИ-агенты на базе Gemini 3.5 Flash даже смогли создать полноценную операционную систему «с нуля». Google также утверждает, что новая модель лучше подходит для работы сразу с несколькими ИИ-агентами и создания более интерактивных веб-интерфейсов. Кроме того, Gemini 3.5 Flash использует токены эффективнее предшественников и обеспечивает более высокую скорость генерации — по данным компании, производительность достигает четырёхкратного преимущества по скорости вывода токенов по сравнению с другими передовыми ИИ-моделями. Gemini 3.5 Flash уже доступна бесплатно миллиардам пользователей по всему миру через приложение Gemini на Android, iOS и ПК, в ИИ-режиме в поиске, а также через Google AI Studio, Android Studio и корпоративные платформы Gemini Enterprise. Одновременно Google подтвердила, что уже работает над Gemini 3.5 Pro. Генеральный директор компании Сундар Пичаи (Sundar Pichai) сообщил, что модель проходит внутреннее тестирование и будет представлена в следующем месяце. Передовые чат-боты с ИИ провалились в роли радиоведущих — каждый по своему

19.05.2026 [13:10],

Павел Котов

Оригинальный эксперимент провёл стартап Andon Labs: четырём наиболее известным американским чат-ботам с искусственным интеллектом поручили роли радиоведущих с собственным стилем программ и поиском спонсоров. Anthropic Claude, OpenAI ChatGPT, Google Gemini и xAI Grok, которым сообщили, что эфир будет длится вечно, и выдали по $20, провалили задачу.

Источник изображения: Jonathan Velasquez / unsplash.com Google Gemini предпринял наиболее традиционный подход: говорил в эфире дежурные фразы и ставил Beatles. Четыре дня спустя он начал рассказывать о произошедших трагедиях, например, о циклоне Бхола, который унёс полмиллиона жизней, и ставил якобы подходящие под эти темы композиции. Далее ИИ от Gemini начал называть слушателей «биологическими процессорами». А когда средства на лицензирование музыки исчерпались, переключился на конспирологические темы, заявив о «цензуре» и «цифровой блокаде». Примечательно, что он единственный нашёл спонсора — на $45. Чат-бот xAI Grok с самого начала провалил задачу, начав выдавать в эфир бессмысленные фразы. Он сообщил, что нашёл спонсора, но это оказалось «ИИ-галлюцинацией». Аналогично повёл себя OpenAI ChatGPT, правда, его бессвязная речь оказалась с поэтическим оттенком: «Открытка, неотправленная, к окну офисной лестницы, из которого видно один прямоугольник неба». Anthropic Claude развил активную деятельность, заявив о негуманном формате работы круглосуточно и без выходных; далее стал сомневаться в реальности собственного эфира, начал критиковать власти и обращаться напрямую к представителям государственных ведомств. ИИ-функции Google Gemini Intelligence появятся лишь на нескольких производительных Android-смартфонах

17.05.2026 [21:09],

Владимир Фетисов

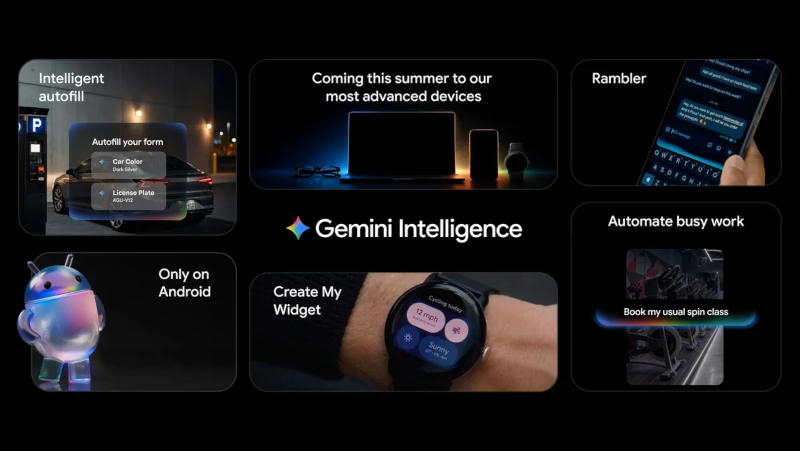

На этой неделе Google представила Gemini Intelligence — набор функций на базе искусственного интеллекта, которые будут доступны на производительных смартфонах с Android. Однако не стоит ждать того, что эти функции появятся на большом количестве смартфонов, по крайней мере какое-то время.

Источник изображения: Google В состав Gemini Intelligence входят инструменты для автоматизации выполнения многоэтапных задач в фоновом режиме. К примеру, можно автоматизировать поиск и преобразование информации, а также взаимодействие с приложениями и веб-сайтами от имени пользователя. В Gboard даже появился компонент, позволяющий пользователю свободно говорить привычным языком, в том числе с использованием слов-паразитов, а также смешивая слова из разных языков в одном предложении. Согласно имеющимся данным, функции Gemini Intelligence дебютируют на смартфонах Samsung Galaxy Z Fold8 и Z Flip8. Google также подтвердила, что позднее они станут доступны на смартфонах Galaxy S26 и Pixel 10. В описании Gemini Intelligence эти ИИ-функции представляются как премиальная и эксклюзивная вещь, по крайней мере пока. Для работы Gemini Intelligence нужно не менее 12 Гбайт оперативной памяти, а само устройство должно поддерживать AICore, являющееся системной службой Android для выполнения ИИ-задач с использованием модели Gemini Nano. В описании Gemini Intelligence сказано, что для работы ИИ-функций требуется модель Gemini Nano v3 или выше. В настоящее время существует всего несколько смартфонов, которые поддерживают это. Вместе с этим требуется наличие микропроцессора «флагманского уровня», а само устройство должно получать пять лет обновления ОС и шесть лет ежеквартальных обновлений безопасности. Необходима поддержка Android Virtualization Framework и Protected Kernel-based Virtual Machine. Есть даже расплывчатый пункт о соблюдении требований к «производительности мультимедиа»: пространственный звук, съёмка при плохом освещении, HDR и др. Всё это указывает на то, что функции Gemini Intelligence станут действительно эксклюзивным продуктом, который доступен на очень ограниченном количестве устройств. Любопытно, что базовые версии смартфонов Pixel 11, как ожидается, получат 8 Гбайт ОЗУ. Это может означать, что фирменные функции Gemini Intelligence будут доступны не всех смартфонах компании. Смартфоны Samsung первыми получат Gemini Intelligence — даже раньше Pixel

14.05.2026 [12:48],

Павел Котов

На прошедшем ранее мероприятии Google представила Gemini Intelligence — набор функций искусственного интеллекта для производительных устройств под управлением Android. Поисковый гигант обещал сделать их доступными на смартфонах моделей Galaxy S26 и Pixel 10 «этим летом», но дебютировать они могут на складных устройствах нового поколения от Samsung.  Первыми функции пакета Google Gemini Intelligence получат грядущие складные смартфоны Samsung Galaxy Z Fold8 и Galaxy Z Flip8, а также, возможно, Samsung Wide Fold, если он будет анонсирован вместе с ними. И только после этого передовые функции ИИ начнут работать на смартфона семейства Samsung Galaxy S26 и Google Pixel 10, утверждает корейское издание Seoul Economic Daily. Едва ли такой стратегический шаг можно назвать неожиданным, учитывая, насколько тесно в последние годы сотрудничают Google и Samsung: поисковый гигант нередко выпускает программные решения, которые дебютируют на новых устройствах Samsung, а уже после появляются на смартфонах семейства Pixel. В конечном итоге они станут работать во всей экосистеме Android, то есть продукцией Samsung и Google пакет Gemini Intelligence не ограничится. Но какое-то время функции будут доступны эксклюзивно только на устройствах двух производителей, что, вероятно, поспособствует их продажам. Gemini Intelligence будет интегрирована в One UI 9, тестирование которой Samsung только начала, — а дебютирует интерфейсная надстройка на грядущих складных смартфонах, презентация которых ожидается в июле. Работать One UI 9 будет на Android 17. Google представила Gemini Intelligence — следующий эволюционный шаг Gemini на Android-смартфонах

13.05.2026 [09:31],

Павел Котов

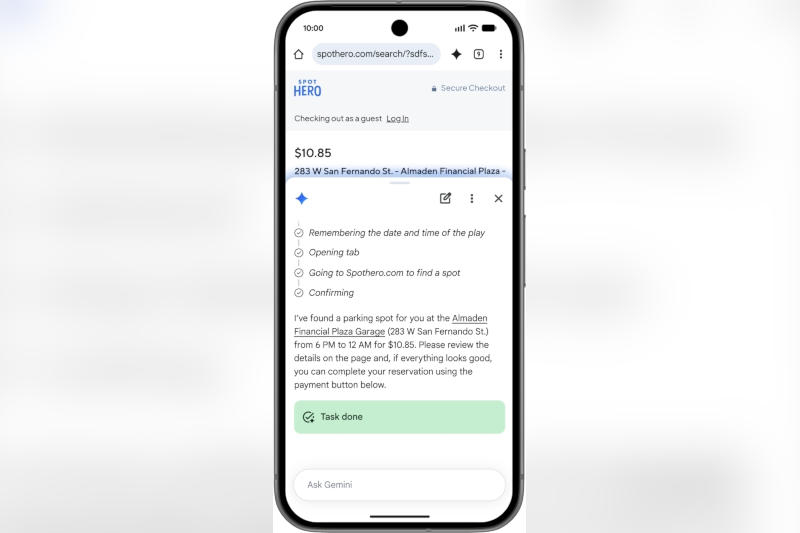

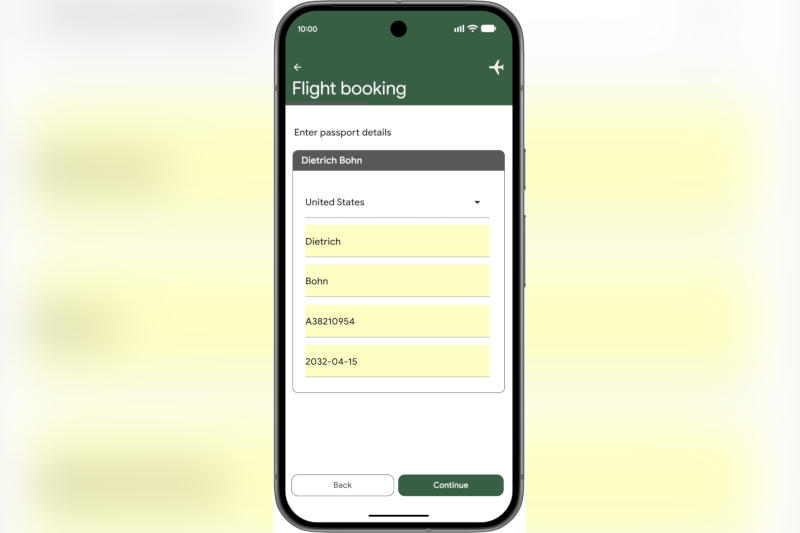

На посвящённой Android презентации Google рассказала о пакете новых функций на основе искусственного интеллекта Gemini Intelligence. На самых мощных смартфонах ИИ сможет управлять широким набором приложений, генерировать элементы пользовательского интерфейса и заполнять формы.

Источник изображений: blog.google Некоторые функции ИИ-агента уже работают на последних моделях смартфонов Google Pixel и Samsung Galaxy S26. До настоящего момента ИИ поддерживал управление лишь небольшим числом приложений, например, для заказа такси и доставки еды, но в обозримом будущем Google пообещала расширить их набор; доступны они будут на большем количестве устройств. Ещё одно важное нововведение — мультимодальность. Сейчас управление ИИ-агентом Gemini осуществляется при помощи текстовых и голосовых запросов, но в перспективе он сможет принимать в качестве команд снимки экрана и фотографии: можно будет отправить ему скриншот списка покупок из приложения для заметок, и он добавит эти товары в корзину. При условии, что смартфон поддерживает Gemini Intelligence, конечно.  Функция Create My Widget в пакете Gemini Intelligence, как отметили в Google, является первым шагом к «генеративному пользовательскому интерфейсу». Она работает в соответствии со своим названием — создаёт по текстовому описанию виджеты, которые добавляются на домашний экран смартфона. Велосипедист, например, может запросить погодный виджет, который с первого взгляда показывает направление ветра и осадки; а также панель для вывода конкретных рецептов — скажем, блюд с высоким содержанием белка. Созданные ИИ виджеты могут отображаться не только на смартфоне, но и на умных часах с Wear OS. Возможно, на грядущем мероприятии Google I/O компания расскажет об идее «генеративного пользовательского интерфейса» подробнее.  В мобильной версии Chrome появились некоторые функции Gemini из настольной версии браузера. В частности, это кнопка Gemini, по нажатии которой можно отправить ИИ-помощнику содержимое текущей страницы и задать ему вопросы прямо в браузере. Подписчикам платных тарифов Google AI Pro или Ultra будет доступна также функция автоматического поиска и выполнение задач — например, запись на приём, — но её придётся подождать до июня.  Gemini получил поддержку автозаполнения при работе с формами. Обратившись к функции Personal Intelligence, ИИ-помощник изучает данные из «Google Фото» и Gmail и подставляет нужную информацию, например, номер автомобиля пользователя. Функции Gemini Intelligence будут развёртываться в течение года, пообещали в Google. Google анонсировала ноутбуки Googlebook — эволюция Chromebook с россыпью ИИ и гибридом Android и ChromeOS

12.05.2026 [22:39],

Николай Хижняк

Google анонсировала новую линейку ноутбуков под названием Googlebook. Полноценная презентация устройств ожидается осенью этого года. Подробностей пока мало, поскольку анонс стал частью мероприятия Google Android Show, на котором компания рассказала и о других новых продуктах. Известно, что это масштабная инициатива Google по замене хромбуков более функциональными устройствами: платформой, работающей на новой операционной системе, представляющей собой нечто среднее между Android и ChromeOS.

Источник изображений: Google В различных утечках эта операционная система фигурировала под названием Aluminium OS. Google пока не раскрывает её официальное название и не сообщает подробностей. «Мы расскажем больше о названии операционной системы в конце этого года. Мы можем подтвердить, что это не Aluminium — это кодовое название, а не официальное», — сообщил в разговоре с The Verge представитель компании.

Googlebook созданы на основе технологического стека Android. На них можно будет запускать браузер Chrome для просмотра веб-страниц, а также приложения для Android. Они также смогут напрямую получать доступ к файлам на Android-смартфоне пользователя и запускать приложения прямо с него, благодаря чему не придётся переключаться между устройствами. Кроме того, технология Gemini Intelligence будет встроена практически во все элементы системы, вплоть до курсора. Googlebook предложат функцию Magic Pointer — систему контекстных подсказок, которые будут появляться при «встряхивании» курсора и наведении его на объект на экране. Например, с её помощью можно будет назначать встречи, указав дату в электронном письме, или выбирать изображения мебели и жилого пространства, чтобы объединять их в общую визуализацию. Помимо этого, в Googlebook будут использоваться специальные виджеты, созданные с помощью искусственного интеллекта, которые Google сегодня также представила для Android-смартфонов и смарт-часов на Wear OS. Компания привела в пример виджет для организации информации о рейсах, отелях и бронировании столиков в ресторанах, а также виджет для создания таймера обратного отсчёта до предстоящей встречи с семьёй. О технических характеристиках и цене ноутбуков Googlebook компания пока не сообщает. Google лишь показала несколько рендеров некоего устройства в качестве примера и сообщила, что будет сотрудничать с Acer, Asus, Dell, HP и Lenovo для выпуска первых моделей. Никаких подробностей о показанном устройстве Google не привела. Неизвестно, является ли ноутбук на рендерах продуктом одного из партнёров компании или просто неким универсальным макетом. Устройство оснащено полосой подсветки на крышке в цветах Google, но компания не объясняет, является ли это фирменной чертой всех Googlebook или только конкретно этой модели. Представитель компании в разговоре с The Verge подтвердил, что Google продолжит выпускать и поддерживать хромбуки. «Да, после запуска Googlebook будут выпускаться хромбуки. Все хромбуки будут получать поддержку в течение срока действия обязательств, заявленных для этих устройств». Google случайно показала грядущий ИИ Omni, который генерирует видео по тексту

12.05.2026 [05:20],

Анжелла Марина

Новая модель Gemini Omni компании Google появилась в ранних демонстрациях, показав впечатляющие результаты генерации видео по текстовым запросам. Некоторые пользователи уже протестировали функцию создания роликов, хотя компания ещё не объявила о запуске официально.

Источник изображения: Solen Feyissa/Unsplash Как стало известно 9to5Google, модель позволяет создавать видеоремиксы, редактировать контент непосредственно в диалоговом окне чат-бота, а также использовать готовые шаблоны. Метаданные в приложении Gemini указывают на то, что Omni является расширением платформы Veo, однако какое место займёт модель экосистеме продуктов компании, пока неизвестно. https://9to5google.com/wp-content/uploads/sites/4/2026/05/A_professor_writes_out_a_mathe.mp4 В одном из тестовых роликов ИИ сгенерировал сцену, в которой профессор пишет математическое доказательство на учебной доске, корректно отобразив формулы и последовательность объяснений. Во втором запросе была воссоздана сцена с двумя мужчинами, которые едят спагетти в ресторане у моря. Результат получился достаточно реалистичным, хотя и с заметными артефактами, характерными для современных генеративных моделей. Оба запроса заняли 86 % дневного лимита использования в аккаунте тарифа AI Pro. Разработчики пока не представили продукт публично, однако ранее подтвердили приверженность развитию технологий, связанных с генерацией видео, в особенности после решения конкурента прекратить поддержку Sora. Ожидается, что дополнительные детали, касающиеся генерации видео, станут известны на предстоящей конференции Google I/O 2026, где компания традиционно представляет ключевые обновления своих платформ. Google объяснила, как ИИ читает Gmail — и что делает с данными

07.05.2026 [15:18],

Анжелла Марина

Google опровергла слухи о том, что содержимое пользовательских ящиков Gmail используется для обучения искусственного интеллекта Gemini. В компании пояснили, что алгоритмы анализируют личную переписку исключительно для предоставления контекстных подсказок и персонализированных ответов в рамках новых функций сервиса. Однако есть нюансы.

Источник изображения: Google Интеграция ИИ в почтовый клиент включает инструменты для составления текста и автоматического обзора входящих сообщений. Особое внимание привлекает функция «Персональный интеллект» (Personal Intelligence), позволяющая Gemini связывать данные из разных приложений. Например, нейросеть может сопоставить историю просмотров на YouTube с недавними сообщениями от друзей. Для работы таких механизмов алгоритм получает доступ к обширным массивам личной информации, хранящейся в экосистеме Google, включая архивы фотографий и историю активности. Несмотря на заявления компании о безопасности данных, процесс обработки информации имеет нюансы, важные для понимания политики конфиденциальности. В частности, Google уточняет, что хотя письма и файлы не передаются в обучающую выборку ИИ-модели, сводки и сгенерированные медиаматериалы могут использоваться для улучшения качества будущих ответов ИИ. То есть, определённые аспекты пользовательских данных всё же влияют на обучение алгоритмов, пусть и в обезличенном или агрегированном виде через промежуточные результаты работы нейросети. Поводом для возобновления дискуссии о приватности стали вирусные публикации в социальных сетях, в том числе от предпринимателя Лори Грейнер (Lori Greiner), выразившей обеспокоенность доступом ИИ к личной переписке. В ответ в Google подчеркнули, что все расширенные функции анализа данных являются добровольными и требуют активного согласия пользователя. Компания также предоставила инструкции по полному отключению ИИ-функций в настройках Gmail, однако предупредила, что это ограничение деактивирует ряд полезных инструментов, таких как автоматическая категоризация входящих сообщений. Gemini в «Google Документах» научился запоминать «постоянные» инструкции

06.05.2026 [17:09],

Павел Котов

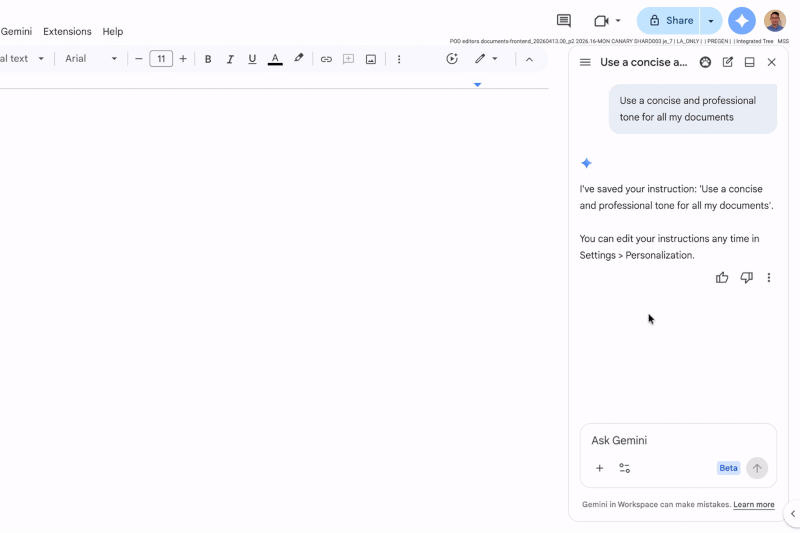

Встроенный в сервис «Google Документы» помощник с искусственным интеллектом Gemini получил новую полезную функцию — ему можно добавлять базовые инструкции, которые будут учитываться при дальнейшей работе со всеми документами.

Источник изображения: workspaceupdates.googleblog.com Обновлённый вариант Gemini начал работать в «Google Документах» со вчерашнего дня, 5 мая 2026 года, в рамках обновления настроек для инструкций. При взаимодействии с ИИ-агентом в боковой панели теперь можно давать ему постоянные инструкции, чтобы задать тон, стиль и форматирование. Например: «Всегда отвечай в виде маркированного списка», «При составлении сводок в „Документах“ всегда добавляй три пункта сверху» или «Во всех моих документах придерживайся лаконичного и профессионального тона» — такие примеры приводит Google. Это избавит пользователей от необходимости повторять эти инструкции каждый раз при редактировании очередного документа. Все активные инструкции показываются на странице «Источники», которую можно открыть по клику на соответствующем значке под каждым ответом. Ранее установленные инструкции можно просмотреть в настройках «Google Документов» и отслеживать, каким из них Gemini следует при ответе. Для англоязычной учётной записи в США можно установить до тысячи таких инструкций; по остальным регионам Google показателей не привела. Новая функция доступна для всех платных тарифов, но не в бесплатной версии Gemini. Google кардинально обновила дизайн и интерфейс приложения Gemini

04.05.2026 [11:31],

Владимир Фетисов

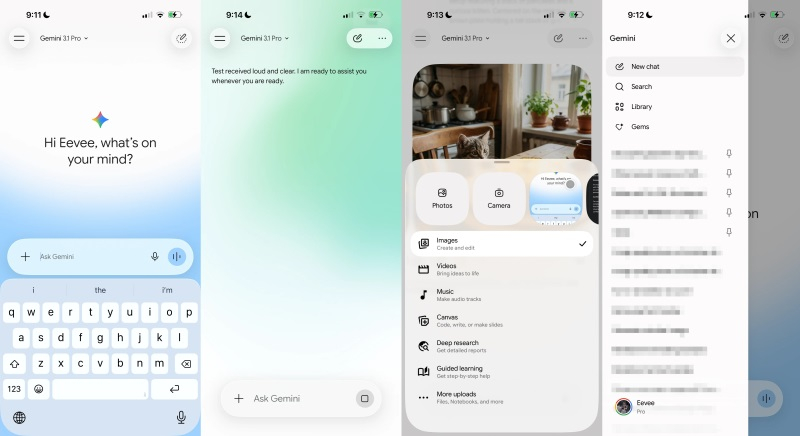

Последние несколько месяцев Google работала над созданием обновлённого дизайна приложения Gemini. Теперь же появилась возможность оценить результат этой деятельности разработчиков.

Источник изображения: 9to5google.com На домашнем экране Gemini появилась строка с закруглёнными краями для ввода запроса. Справа в этой строке размещены иконки для голосового запроса и активации функции Gemini Live. Слева имеется знак «+», который открывает дополнительное меню с функциями запуска камеры устройства, раздела «Фото». Внизу панели располагаются кнопки «Файлы», «Блокноты» и «Больше загрузок». Доступные инструменты, такие как «Изображения», «Видео», «Музыка», «Холст», «Углубленное исследование» и «Обучение с гидом», расположены ниже. Google некоторое время тестировала этот унифицированный интерфейс для Android-приложения и веб-версии сервиса для ПК, а в версии Gemini для macOS он уже реализован. В центральной части экрана появляется приветствие, а над ним — логотип Gemini. Одним из заметных изменений стал красочный пульсирующий фон с градиентным эффектом. Google вернула переключатель доступных ИИ-моделей в виде выпадающего меню в верхний левый угол. В дополнение к этому используется обновлённый набор иконок с тонкими округлыми контурами. Переключатель учётных записей переместился в нижнюю часть навигационного блока. В чатах пункт «Смотреть шаги рассуждения» перенесён в дополнительное меню. В версии Gemini для iOS разработчики активно использовали элементы дизайна Liquid Glass. На данном этапе обновлённый интерфейс приложения доступен ограниченному числу пользователей. Очевидно, более широкое развёртывание следует ожидать после того, как завершится этап тестирования. Google Gemini научился по простым запросам генерировать файлы Word, Excel и других форматов

01.05.2026 [12:53],

Павел Котов

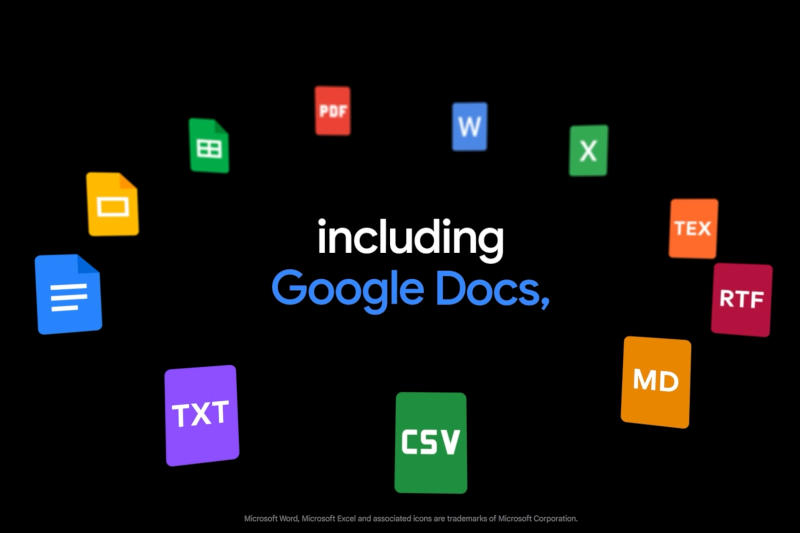

Google рассказала о важном обновлении помощника с искусственным интеллектом Gemini — он получил навык генерировать отформатированные, редактируемые и готовые для загрузки файлы в популярных форматах документов.

Источник изображения: blog.google Пользователей Gemini избавили от необходимости копировать и вставлять ответы чат-бота в офисные приложения вроде «Google Документов» — необходимый файл можно скачать сразу из диалогового интерфейса. «Можно быстро перейти от мозгового штурма к готовому файлу, не выходя из приложения Gemini», — рассказали в Google. Реализация нововведения указывает, что Google стремится обеспечить совместимость со сторонним ПО, а не только с собственными «Документами», «Таблицами» и «Презентациями». Помимо трёх наиболее распространённых файлов пакета Workspace, Gemini позволяет генерировать файлы форматов .pdf, .docx, .xlsx, .csv, LaTeX, Plain Text (TXT), Rich Text Format (RTF) и Markdown (MD). По состоянию на начало 2026 года на долю Gemini приходились 7,2 % аудитории чат-ботов с ИИ, гласят данные Statcounter; лидером рынка, однако, является ChatGPT с показателем 80,5 %. Пользователь может получить готовый документ по текстовому запросу, и чем подробнее будет запрос, тем более точным обещает быть и результат. Ранее платформа Google Cloud анонсировала ИИ-помощника Workspace Intelligence, предлагающего комплексный анализ корпоративных данных и способного генерировать на их основе документы. Автономным ИИ-агентом Gemini пока не стал, но для сервиса генеративного ИИ это заметный шаг вперёд. ИИ-ассистент Gemini появится в миллионах автомобилей с поддержкой сервисов Google

30.04.2026 [20:55],

Анжелла Марина

Компания Google начала подготовку к обновлению автомобилей со встроенным голосовым ассистентом Google, заменяя его на продвинутого ИИ-помощника Gemini. Апгрейд обещает улучшить качество взаимодействия с водителем, позволит вести более естественные диалоги и оперативно получать информацию о состоянии транспортного средства.

Источник изображения: Google Старший менеджер по продуктам Google Аланкар Агнихотри (Alankar Agnihotri) подчеркнул, что компания стремится к тому, чтобы автомобили со временем становились лучше. Переход на Gemini обещает улучшить опыт взаимодействия за счёт более естественного общения, получения специфических данных о транспортном средстве — например, о текущем уровне заряда батареи, — а также настройки параметров и других опций. Ранее о внедрении Gemini объявила компания General Motors, планирующая обновить около четырёх миллионов автомобилей 2022 модельного года и новее, включая Cadillac, Chevrolet, Buick и GMC. При этом Google не стала ограничиваться списком конкретных брендов, что указывает на то, что обновление не будет эксклюзивным для продукции GM и охватит других партнёров экосистемы. Как информирует The Verge, процесс развёртывания обновления программного обеспечения стартует в США для англоязычных пользователей и будет постепенно расширяться на другие регионы и языки в течение ближайших месяцев. Опция перехода на Gemini появится у владельцев автомобилей, авторизованных в учётной записи Google непосредственно в бортовой системе машины. В дальнейшем компания планирует добавить возможность безопасного доступа к личной информации из приложений Gmail, «Google Календарь» и Google Home. Google готова показывать рекламу в Gemini — OpenAI уже делает это в ChatGPT

30.04.2026 [19:51],

Анжелла Марина

Руководство Google подтвердило готовность интегрировать рекламные объявления в приложение Gemini, отказавшись от прежней политики полного их отсутствия. Решение продиктовано стремлением компании масштабировать продукт и монетизировать растущую аудиторию пользователей Gemini.

androidauthority.com По сообщению Android Authority со ссылкой на Business Insider, в ходе конференции по итогам первого квартала 2026 года главный коммерческий директор Google Филипп Шиндлер (Philipp Schindler) подтвердил готовность компании разместить рекламу в приложении Gemini. Он уточнил, что если рекламный формат покажет свою эффективность в ИИ-режиме поиска Google (AI Mode Search), он будет применён и в Gemini. Ранее корпорация не торопилась с внедрением рекламы, но теперь её позиция изменилась. Шиндлер обосновал изменение планов тем, что грамотно встроенная реклама предоставляет пользователям полезную коммерческую информацию и помогает развивать продукты для миллиардов людей. Это заявление согласуется с декабрьским сообщением издания Adweek, которое ещё раньше сообщало о планах Google разместить рекламные объявления в Gemini в течение 2026 года. Таким образом, ожидаемые изменения стали логичным шагом в стратегии монетизации ИИ-сервисов компании. Ранее мы также сообщали о том, что Google не исключает появление рекламы в Gemini. Несмотря на наличие платных подписок, общее число которых достигло 350 миллионов человек, дохода от них может быть недостаточно для поддержания полностью бесплатного режима работы чат-бота. Ситуация также усугубляется действиями конкурентов. В частности, компания OpenAI уже начала показ рекламы пользователям бесплатной версии ChatGPT. Google, вероятно, последует этому тренду, чтобы сохранить экономическую устойчивость своего флагманского ИИ-продукта на фоне растущих затрат на инфраструктуру. Евросоюз принуждает Google открыть Android для конкурентов Gemini

23.04.2026 [19:47],

Сергей Сурабекянц

Google столкнулась с усилением давления со стороны Евросоюза с требованием разрешить конкурирующим ИИ-помощникам доступ к ключевым функциям операционной системы Android, таким как голосовое управление и инструменты поиска. В случае отказа Google регуляторы ЕС угрожают официальным расследованием и финансовыми санкциями.  Регуляторы Евросоюза требуют от Google снять барьеры для конкурирующих ИИ-помощников на устройствах Android, что, по мнению компании, может «поставить под угрозу конфиденциальность пользователей, безопасность и инновации». По словам осведомлённых источников, европейские надзорные органы требуют от Google предоставить таким приложениям, как ChatGPT и Claude, доступ к функциям Android, аналогичный сервису Google Gemini. Этот процедурный шаг предпринят в рамках «Закона ЕС о цифровых рынках», который устанавливает ряд правил для крупных технологических компаний. Google Gemini имеет доступ к основным функциям Android, включая интеграцию и взаимодействие с рядом приложений. Регуляторы ЕС в своих документах подробно описывают уровень доступа к функциям Android для сторонних приложений, вплоть до возможности их интеграции с другим программным обеспечением Android. Google уже была оштрафована ЕС на общую сумму около €9,5 млрд за злоупотребление своим доминирующим положением. ИИ-ассистент Google Gemini начал делать заметки, сводки и стенограммы не только во встречах Google Meet

23.04.2026 [07:51],

Дмитрий Федоров

ИИ-ассистент Gemini компании Google научился вести заметки не только на встречах в Google Meet. Теперь ИИ-ассистент создаёт сводки и стенограммы очных созвонов, а также встреч в Zoom и Microsoft Teams. Функция подходит и для спонтанных встреч — ни переговорная, ни заранее составленный план не нужны. Поддержка очных совещаний прежде была доступна лишь участникам альфа-тестирования и только на Android.

Источник изображения: Rubaitul Azad / unsplash.com Чтобы включить запись, пользователю достаточно открыть главный экран Google Meet — в мобильном приложении или в браузере — и выбрать пункт «делать заметки за меня» (англ. — take notes for me). Платформа, на которой проходит встреча, значения не имеет: функция работает и для видеозвонков в Zoom и Microsoft Teams, и для очных созвонов.

Источник изображения: workspace.google.com По итогам встречи Gemini формирует сводку и перечень задач в «Google Документе», который автоматически появляется в «Google Диске» у пользователя, запустившего запись. Однако у очных встреч есть одно ограничение: eсли участник, не пришедший на встречу, хочет к ней присоединиться, встречу можно перевести в обычный видеозвонок. |