|

Опрос

|

реклама

Быстрый переход

Google Meet получил голосовой перевод в реальном времени, но это не бесплатно и пока без русского

06.02.2026 [14:06],

Павел Котов

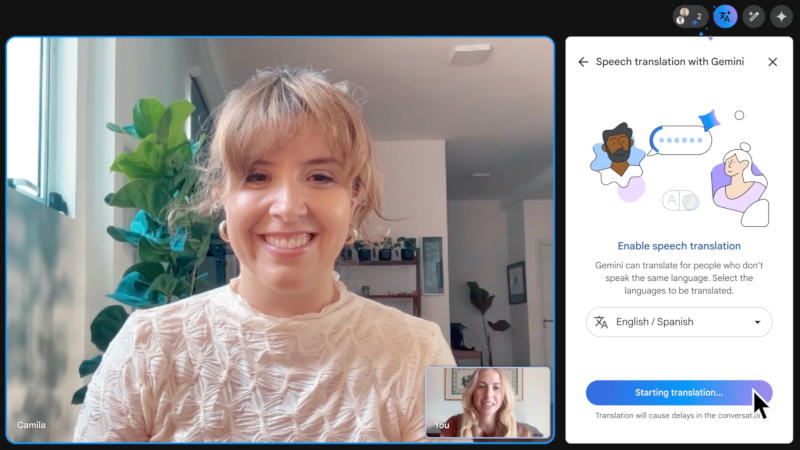

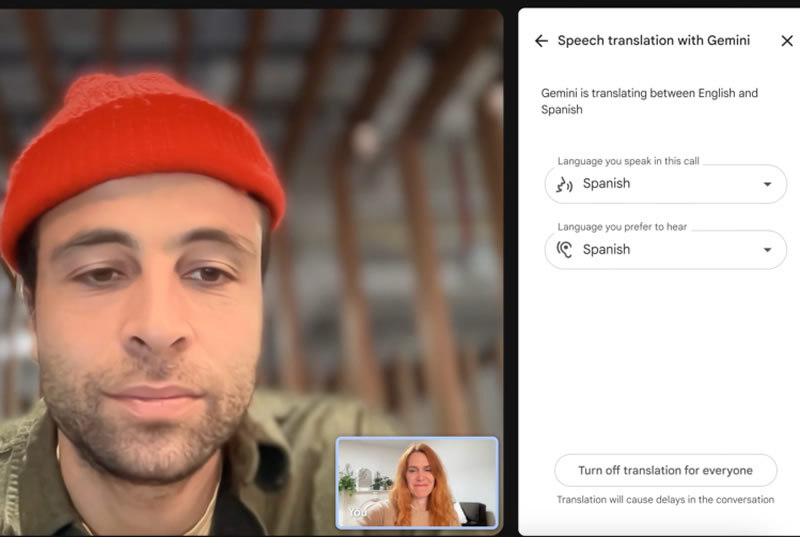

Из стадии тестирования вышла функция голосового перевода устной речи в мессенджере Google Meet — теперь она доступна для большинства пользователей сервисов Workspace в настольной версии. В ближайшие месяцы функция дебютирует в приложениях для Google Android и Apple iOS.

Источник изображения: youtube.com/@googleworkspace Возможность осуществлять сгенерированный искусственным интеллектом голосовой перевод синхронно с речью собеседника компания анонсировала для Google Meet ещё в мае минувшего года. До недавнего времени функция была доступна только подписчикам Google AI Pro и AI Ultra, а также участникам программы тестирования Enterprise Alpha. Уже 27 января Google расширила эту функцию на пользователей Workspace Business Standard, Business Plus, Enterprise Standard, Enterprise Plus и Frontline Plus; она также работает для обладателей подписки Workspace Business и Education с тарифами AI Pro или AI Ultra в качестве дополнения. Нововведение распространяется поэтапно. У обладателей вышеуказанных типов учётных записей он может появиться в течение 15 дней. Когда она станет доступной, перевод можно будет включить в настройках совещания — желающие услышать перевод смогут нажать на соответствующий значок в правом верхнем углу экрана; доступны также некоторые другие опции. На момент запуска общедоступной версии функции поддерживаются английский, испанский, французский, немецкий, итальянский и португальский языки. Но в совещании можно выбрать только одну пару. С 2022 года в Google Meet также поддерживается перевод с помощью субтитров. Google Meet теперь умеет накладывать виртуальный макияж с помощью ИИ

14.10.2025 [19:52],

Сергей Сурабекянц

В Google Meet наконец-то появился фильтр макияжа на базе ИИ для пользователей, которые не хотят наносить настоящий макияж перед встречей. Этот новый инструмент поможет Google Meet конкурировать с другими приложениями для видеоконференций, такими как Microsoft Teams и Zoom, которые уже поддерживают функцию виртуального макияжа.

Источник изображений: Google Meet Google Meet предлагает 12 различных вариантов макияжа на выбор. Они доступны в меню «Внешний вид» в разделе «Ретушь портрета», который появился в 2023 году и предоставляет пользователям такие возможности, как выравнивание тона кожи, осветление под глазами и отбеливание век. Google утверждает, что виртуальный макияж не зависит от движений пользователя на экране, что делает его более реалистичным. То есть, если пользователь сделает глоток кофе, фильтр останется на лице, а не переместится на кружку. После нанесения виртуального макияжа Google Meet запомнит предпочтения пользователя и применит их на будущих встречах. По умолчанию виртуальный макияж будет отключён, но его можно активировать в любой момент — как до начала, так и во время видеозвонка.

Виртуальный макияж в Google Meet на базе искусственного интеллекта стал доступен с 8 октября в мобильных приложениях и веб-браузерах. Google заявила о своей непричастности к сбоям Google Meet в России

28.08.2025 [10:59],

Павел Котов

Google заявила, что с её стороны сбоев в работе службы видеосвязи Google Meet не наблюдается, и к возникшим у россиян проблемам с этим сервисом компания отношения не имеет. Такой комментарий Google дала ресурсу РБК.

Источник изображения: Rubaitul Azad / unsplash.com «Нам известно о проблемах с доступом пользователей к Google Meet в России; это не связано с техническими проблемами на стороне Google», — заявили в американской компании. Накануне от россиян начали поступать жалобы на сбои в работе службы Google Meet — наибольшее число обращений отмечено в 12:15 мск. К 20:40 мск были зафиксированы более 1,5 тыс. жалоб. Чаще всего сообщалось, что не открываются приложение или сайт, отказывается работать функция звонков или отсутствует звук. Роскомнадзор также заявил о своей непричастности к происходящему. Ранее ведомство ограничило звонки в популярных мессенджерах Telegram и WhatsApp, и сервис Google Meet быстро вышел на второе место в списке самых скачиваемых приложений российского раздела Apple App Store. Частичную блокировку звонков в Telegram и WhatsApp власти объяснили стремлением оградить россиян от мошенников. Google Meet опять «штормит» — россияне массово жалуются на сбои сервиса в России

27.08.2025 [15:52],

Владимир Мироненко

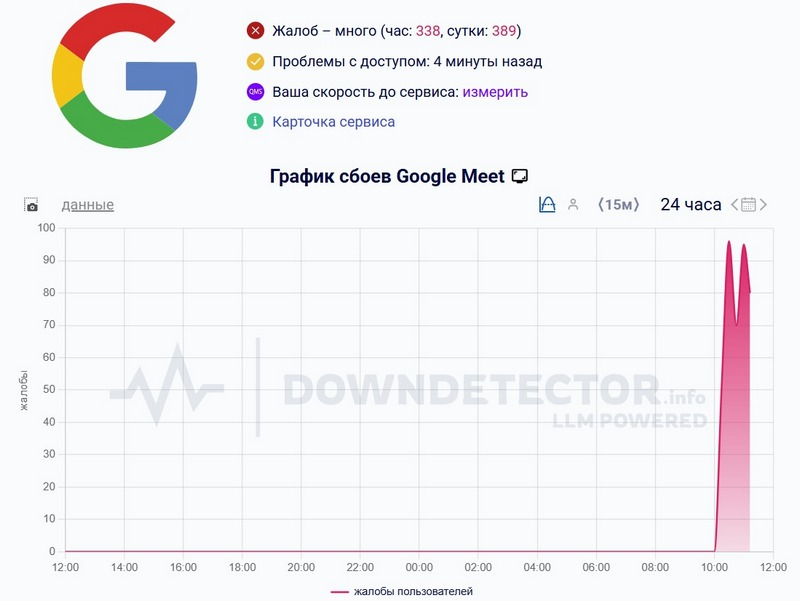

Российские пользователи сообщают о сбоях в работе сервиса видеоконференций Google Meet, о чём свидетельствуют данные портала Downdetector. В основном жалуются на то, что при подключении не слышно коллег на встрече, а также на то, что спустя короткое время после подключения сервис разрывает соединение.

Источник изображения: Rubaitul Azad/unsplash.com За сутки на работу сервиса поступили 1253 жалобы. 58 % пользователей сообщили о сбое сайта, 30 % — о сбое мобильного приложения, 6 % отметили общий сбой. Больше всего сообщений о сбое поступило из Санкт-Петербурга — около 10 % всех жалоб. Также со сбоями столкнулись пользователи из Москвы и Московской области (по 5 %), Архангельской и Калининградской областей — тоже по 5 %. Как отметили «Ведомости», первые сообщения о сбоях в работе Google Meet стали поступать 22 августа, через девять дней после объявления Роскомнадзора о частичной блокировке звонков в мессенджерах Telegram и Whatsapp. В РКН тогда заявили изданию, что ведомство не ограничивало звонки в сервисе Google Meet. Вместе с тем, 23 августа в МВД РФ сообщили, что мошенники начали тестировать альтернативные приложения для обхода блокировок, выбрав в качестве основного канала коммуникаций с потенциальными жертвами сервис Google Meet. МВД сообщает: из-за блокировки звонков в Telegram и WhatsApp мошенники переходят на Google Meet

24.08.2025 [00:46],

Владимир Мироненко

В связи с частичной блокировкой звонков в мессенджерах Telegram и WhatsApp мошенники начали активный поиск каналов выхода на потенциальные жертвы, поскольку их доход напрямую зависит постоянного контакта с гражданами и их инфраструктура (кол-центры, базы данных, отработанные схемы) не может простаивать, сообщает в своём официальном Telegram-канале Управление по организации борьбы с противоправным использованием информационно-коммуникационных технологий (УБК) МВД РФ.

Источник изображения: Rubaitul Azad/unsplash.com Управление зафиксировало два основных тренда на данный момент. Во-первых, наблюдается резкий рост (до +83 %) количества мошеннических звонков с международных номеров через традиционную сотовую связь. И во-вторых, мошенники активно тестируют альтернативные приложения для обхода блокировок. Хотя есть попытки использования для мошеннических схем FaceTime и мессенджера Max, основным способом связи они выбрали сервис Google Meet. Интерес мошенников к Google Meet вызван тем, что американская Google не станет предоставлять правоохранительным органам какую-либо информацию для расследования уголовных дел, что обеспечивает защиту коммуникации злоумышленников. К тому же приложение Google Meet предустановлено на большинстве Android-смартфонов, а значит нет необходимости убеждать пользователей установить «неизвестное» приложение. Россияне пожаловались на сбои Google Meet — сервис набрал популярность после блокировки звонков в Telegram и WhatsApp

22.08.2025 [12:07],

Андрей Созинов

Россияне пожаловались на проблемы в работе сервиса видеосвязи Google Meet. По данным портала Downdetector, количество жалоб на сбои в работе за последний час резко увеличилось и перевалило за три сотни на момент публикации данного материала.

Источник изображения: Google Наибольшее число пользователей (45 %) сообщают об общем сбое Google Meet. Также россияне массово жалуются на неполадки в веб-версии сервиса и в мобильном приложении. Больше всего сообщений о трудностях с доступом к Google Meet поступило от жителей Карелии, Ивановской и Московской областей, Москвы и Санкт-Петербурга, а также некоторых других регионов России. При этом в других странах подобных массовых проблем не наблюдается. Интерес к Google Meet вырос на фоне блокировки звонков в Telegram и WhatsApp. Благодаря этому сервис видеосвязи от Google вышел на второе место в списке самых популярных бесплатных приложений для общения в российском App Store.

Источник изображения: Downdetector.su Напомним, что 13 августа Роскомнадзор объявил о «частичном» ограничении звонков в Telegram и WhatsApp, объяснив это мерами по борьбе с мошенниками. В Минцифры России заявили, что ограничения могут быть сняты, когда мессенджеры начнут выполнять требования российского законодательства. В ответ Telegram подчеркнул, что пользователи могут самостоятельно решать, от кого принимать звонки, либо полностью их отключить, а также отметил, что компания ведёт активную борьбу с вредоносным контентом и преступлениями на платформе. WhatsApp, в свою очередь, напомнил, что сервис использует сквозное шифрование и выступает против вмешательства властей в право людей на защищённое общение. Обновлено: Роскомнадзор сообщил, что не ограничивает работу Google Meet в России. Google анонсировала Beam — платформу 3D-видеосвязи для бизнеса

21.05.2025 [06:54],

Вячеслав Ким

20 мая 2025 года на конференции Google I/O компания анонсировала переход экспериментального проекта Project Starline в коммерческую фазу под новым названием Google Beam. Платформа использует искусственный интеллект и технологии 3D-визуализации для создания реалистичных видеозвонков без необходимости использования гарнитур или очков. Первые устройства, разработанные совместно с HP, будут представлены на выставке InfoComm в июне и поступят к корпоративным клиентам до конца года.

Источник изображения: Google Google Beam объединяет шесть камер, световое поле и облачные вычисления для создания объёмного изображения собеседника в реальном времени. Система отслеживает движения головы и мимику, обеспечивая ощущение присутствия, сравнимое с личной встречей. Платформа интегрируется с существующими решениями для видеосвязи, включая Google Meet и Zoom, что упрощает её внедрение в корпоративную инфраструктуру. В рамках расширения функциональности Google Beam компания также внедряет функцию синхронного перевода речи. Эта возможность уже доступна в Google Meet и позволяет пользователям общаться на разных языках с сохранением интонации и выражений лица, что способствует более естественному взаимодействию. Партнёрами Google в продвижении Beam стали компании Zoom, Diversified и AVI-SPL. Среди первых клиентов, заинтересованных в использовании новой технологии, — Deloitte, Salesforce, Citadel, NEC, Hackensack Meridian Health, Recruit и Duolingo. Ожидается, что HP продемонстрирует первые устройства Beam на выставке InfoComm, которая пройдёт с 7 по 13 июня 2025 года в Орландо, штат Флорида. Проект Starline был впервые представлен в 2021 году как исследовательская инициатива Google по созданию более реалистичной видеосвязи. С тех пор технология прошла путь от прототипа до готового продукта, ориентированного на корпоративный сегмент. Beam представляет собой шаг вперёд в области удалённого взаимодействия, предлагая пользователям более глубокий уровень вовлечённости и снижая утомляемость от видеозвонков. Google научила Meet переводить речь «на лету» с сохранением интонаций и тона голоса

20.05.2025 [23:54],

Анжелла Марина

Google представила на мероприятии I/O новую функцию «живого» перевода для сервиса видеосвязи Google Meet. Технология, построенная на базе искусственного интеллекта Gemini, преобразует речь пользователя на язык, на котором говорит собеседник, при этом сохраняя интонацию и эмоции. Пока функция доступна в бета-режиме.

Источник изображения: Google В демонстрационном ролике один из участников говорил по-английски, другой — по-испански. После активации функции перевода Gemini каждый слышал речь партнёра на своём языке с невероятной интонационной точностью, пишет The Verge. Пока система поддерживает только английский и испанский языки. Однако Google уже анонсировала скорое добавление итальянского, немецкого и португальского. По словам компании, новые языки появятся в ближайшие недели. Аналогичная функция была запущена Microsoft в начале года в приложении для совместной работы Teams, но Google делает акцент на более естественное звучание перевода, подчёркивая, что ИИ не просто переводит текст, а адаптирует голос пользователя так, чтобы его речь звучала органично. Функция тестируется в бета-режиме для подписчиков Google AI Pro и нового тарифа AI Ultra стоимостью $249 в месяц. Окончательная версия может появиться позднее. Google Meet с ИИ Gemini научился назначать исполнителей и заменил ручное ведение заметок

19.02.2025 [06:28],

Дмитрий Федоров

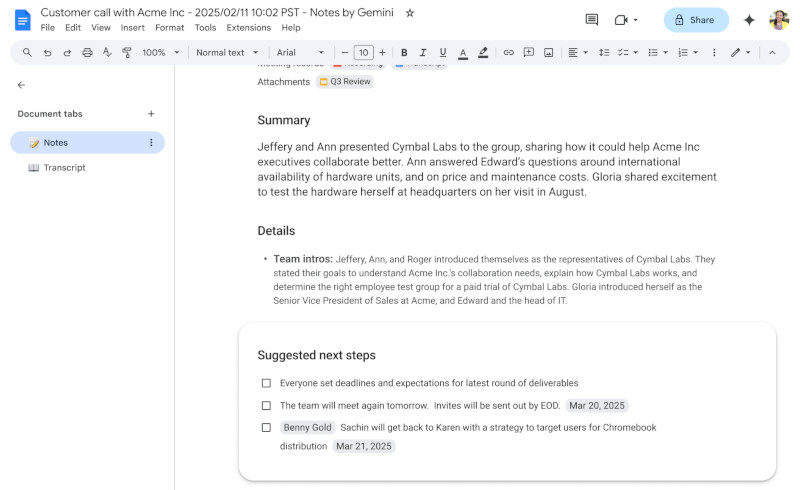

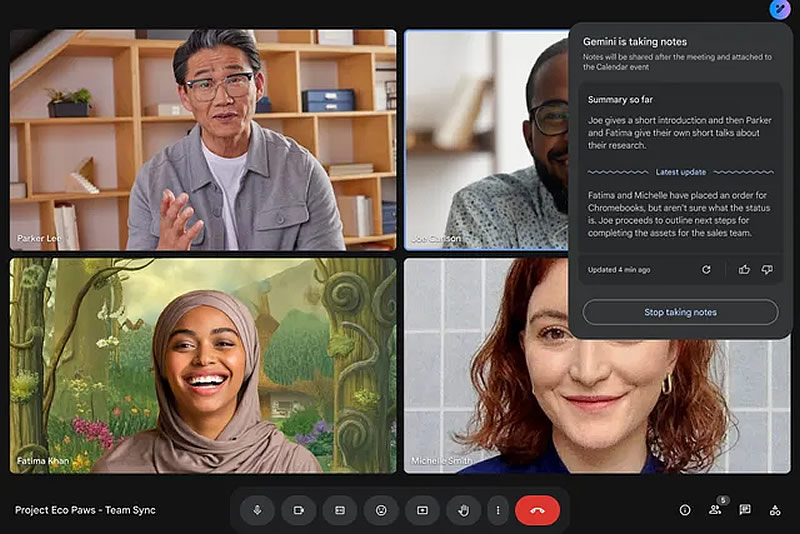

Google Meet, являясь одним из ключевых инструментов для корпоративных пользователей Google Workspace, продолжил интеграцию ИИ в процесс видеоконференций. Новая функциональность на базе ИИ Gemini способна анализировать разговор в режиме реального времени, фиксировать ключевые тезисы и автоматически формировать чек-лист последующих действий. Более того, ИИ не просто фиксирует важные моменты, но и прикрепляет к задаче основную заинтересованную сторону, а также определяет дедлайны, что минимизирует вероятность потери критически важной информации.

Источник изображений: Google Функция ведения заметок впервые была представлена в августе 2024 года. Её основная цель — автоматическое создание структурированных отчётов по итогам встреч. Редакция издания The Verge тестировала этот инструмент с момента запуска и отметила, что он не допускает критических ошибок. Теперь технология голосовой транскрипции на базе Gemini не только фиксирует сказанное, но и различает голоса участников, хотя и не всегда безупречно. После завершения встречи ИИ обобщает её результаты с удивительно последовательной структурой в документе Google Docs и автоматически рассылает его всем участникам. Эта функция будет особенно полезна командам, которым важно оперативно фиксировать принятые решения и снижать нагрузку на сотрудников, вручную записывающих ключевые моменты.  Google подчёркивает, что внедрение новой функции будет проходить «значительно медленнее обычного», поскольку компания тщательно отслеживает её качество и производительность. Хотя ИИ-заметки и автоматическое создание списка действий значительно упрощают работу пользователей, вопрос конфиденциальности остаётся актуальным. Многие компании обсуждают чувствительные данные во время встреч, и автоматический анализ речи может вызывать опасения, что конфиденциальная информация попадёт в большую языковую модель Gemini. Функция начала внедряться сегодня, однако организациям следует учитывать потенциальные риски, связанные с использованием ИИ в корпоративной среде. Google Meet запускает ИИ-функцию автоматического конспектирования совещаний и онлайн-встреч

28.08.2024 [07:45],

Анжелла Марина

В приложении Google Meet появилась новая функция, основанная на искусственном интеллекте, которая автоматизирует процесс ведения заметок во время онлайн-встреч. Функция «Take Notes for Me» (Записывай заметки за меня) уже доступна для пользователей Google Workspace.

Источник изображения: Google Впервые анонсированная в 2023 году функция Take Notes for Me — это не просто транскрипция речи, подобная инструменту Google Meet, а функция, основанная искусственном интеллекте, которая анализирует разговор, выделяет ключевые моменты и создаёт краткое изложение всего, что было сказано на встрече. Как отмечает The Verge, это обещает значительно упростить жизнь тем, кто пропустил важную встречу или испытывает трудности с одновременным восприятием информации и ведением конспектов. Take Notes for Me автоматически создаёт заметки в Google Docs и прикрепляет их к событию в календаре после завершения встречи, что позволит легко ознакомиться с ключевыми моментами. Кроме того, отправляется файл Google Docs организатору встречи и всем участникам, которые включили эту функцию. «Даже если вы опоздали на совещание, Take Notes for Me предоставит краткое резюме того, что вы пропустили, чтобы можно было быстро войти в курс дела», — подчеркнули в Google. Функция также будет включать ссылки на записи и транскрипции встречи, если опция была включена. Для людей, испытывающих трудности с одновременным восприятием устной речи и ведением заметок, новая функция может стать настоящим спасением. Она позволит сконцентрироваться на обсуждении и быть более вовлечёнными в процесс, не отвлекаясь на конспектирование. Например, для людей с нарушениями слуха или трудностями обработки информации, Take Notes for Me может значительно повысить доступность и эффективность участия в видеоконференциях, так как вместо постоянного напряжения и попыток уловить детали, люди смогут сосредоточиться на содержании обсуждения, полагаясь на автоматически сгенерированные заметки. Функция уже доступна для пользователей Google Workspace с подпиской Gemini Enterprise, Gemini Education Premium или AI Meetings & Messaging, однако к 10 сентября 2024 года Take Notes for Me будет доступен для всех пользователей Google Workspace, правда пока только на английском языке. |