|

Опрос

|

реклама

Быстрый переход

Спрос на аренду устаревающих ускорителей Nvidia H100 не падает, а цены и вовсе подскочили на 40 % за полгода

03.04.2026 [16:24],

Алексей Разин

Данные исследования SemiAnalysis позволяют предположить, что в условиях бума ИИ не все рыночные тенденции являются предсказуемыми. Ранее считалось, что после выхода в оборот новейших ускорителей вычислений Nvidia с архитектурой Blackwell спрос на их предшественников снизится, а вместе с этим упадут и цены, однако реальность оказалась иной.

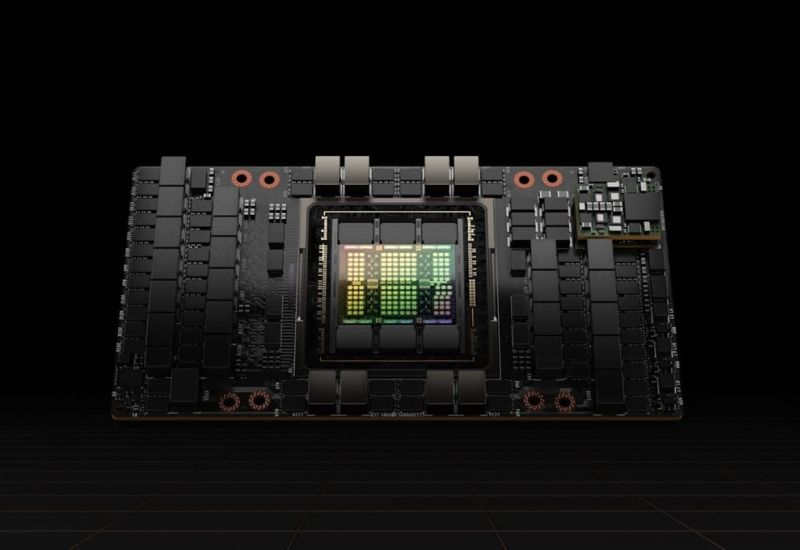

Источник изображения: Nvidia Как отмечает источник, расценки на аренду облачных вычислительных мощностей на базе ускорителей Nvidia H100 с архитектурой Hopper в период с октября прошлого года по март нынешнего увеличились с $1,7 до $2,35 в час. Более того, свободных мощностей для аренды в этом сегменте рынка нет, а действующие контракты арендаторы стараются всеми правдами и неправдами продлить, даже если им приходится переплачивать за такую возможность. Клиенты облачных провайдеров готовы арендовать H100 ещё на четыре года, причём дефицит предложений есть и в сегменте крупных вычислительных кластеров этого поколения. По мере появления более современных инстансов предложение на рынке по устаревающим не увеличивается. При этом ускорителей Blackwell на рынке аренды облачных мощностей пока не так много, основная их часть будет введена в строй не ранее середины текущего года, а спрос на вычислительные мощности продолжает серьёзно превышать предложение. Ожидания, согласно которым спрос на аренду ускорителей H100 начнёт падать с конца прошлого года, не оправдались. Провайдеры, работающие с краткосрочными контрактами на аренду ускорителей, в таких условиях могут неплохо заработать, поскольку цены выросли, а спрос остаётся высоким. В США арестовали организаторов контрабанды ИИ-ускорителей Nvidia в Китай на $160 млн

09.12.2025 [07:05],

Алексей Разин

Власти США одной рукой ослабляют экспортные ограничения на поставку ИИ-ускорителей в Китай, а другой карают тех, кто посмел нарушить действующие правила. Министерство юстиции США сообщило об аресте двух подозреваемых в организации нелегальных поставок ускорителей Nvidia в Китай на сумму не менее $160 млн.

Источник изображения: Nvidia Как отмечает Bloomberg, предполагаемые организаторы схемы пытались выдать ускорители Nvidia моделей H100 и H200 за продукцию вымышленной марки Sandkyan, на которую оформлялась экспортная документация. Помимо двух задержанных, в деле фигурирует третий участник — Алан Хао Сю (Alan Hao Hsu), которому уже предъявлены соответствующие обвинения. Он является владельцем компании в техасском Хьюстоне и нескольких складов на территории США. Именно эти помещения использовались для перемаркировки ускорителей Nvidia с целью облегчения контрабанды, как полагает следствие. Проживающий в Бруклине китайский гражданин Фаньюэ Гун (Fanyue Gong) и канадский гражданин Бэнлинь Юань (Benlin Yuan) из Онтарио обвиняются в сговоре с сотрудниками логистической компании из Гонконга и китайской компании из сферы ИИ с целью обхода экспортных ограничений США. Представители американского министерства заявили, что операция компетентных органов США позволила выявить сложную сеть контрабандистов, деятельность которой представляли угрозу для национальной безопасности из-за организации нелегальных поставок в Китай передовых компонентов, используемых в сфере ИИ. Подобные ускорители, по мнению американских чиновников, являются неотъемлемой частью современных оборонных систем. Напомним, что формально разрешивший поставки H200 в Китай Дональд Трамп (Donald Trump) указал на исключение из списка разрешённых ускорителей с архитектурой Blackwell и Rubin, которые являются более совершенными по сравнению с Hopper. Представители Nvidia касательно ситуации с раскрытием схемы контрабанды заявили, что даже продажи ускорителей старых поколений на вторичном рынке подвергаются строгому контролю. Компания готова содействовать американским властям в пресечении попыток незаконного оборота бывших в употреблении ускорителей. Первый в мире ИИ-спутник с ускорителем Nvidia H100 отправится в космос в ноябре

18.10.2025 [12:19],

Геннадий Детинич

Компания Starcloud (ранее — Lumen Orbit), участница программы NVIDIA Inception, объявила о запуске первого в мире спутника с искусственным интеллектом на базе ускорителя NVIDIA H100. Запуск, запланированный на ноябрь, станет шагом к созданию орбитальных дата-центров, которые, по расчётам, смогут сократить энергопотребление и углеродные выбросы на порядок по сравнению с наземными аналогами.

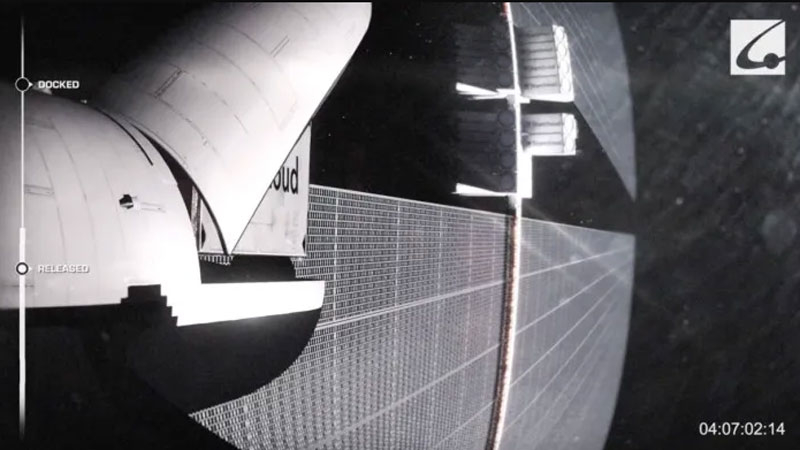

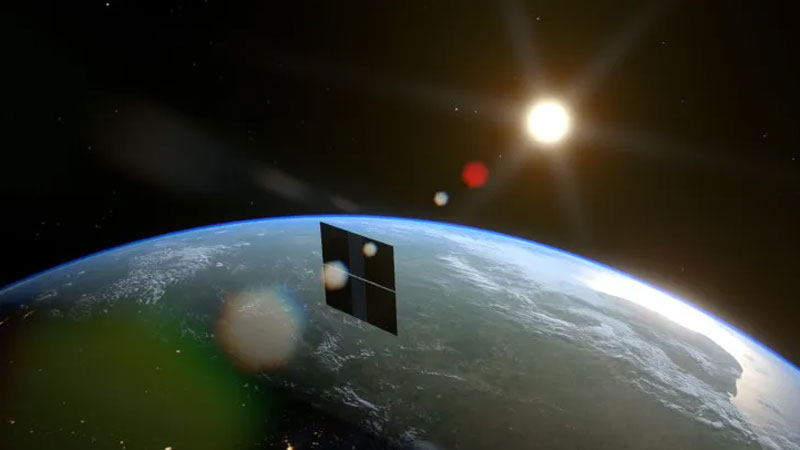

Источник изображений: Starcloud Starcloud-1 весит около 60 кг и по размерам сопоставим с небольшим холодильником. Аппарат будет обрабатывать данные, поступающие от спутников дистанционного зондирования Земли, и выполнять задачи вывода на базе ИИ (inference) прямо на орбите — без необходимости передавать большие объёмы информации на Землю. По словам главы компании Филипа Джонстона (Philip Johnston), использование H100 обеспечит «в сто раз большую вычислительную мощность», чем существующие космические вычислительные платформы. Космос — идеальная среда для энергоэффективных ИИ-систем. Спутники могут получать почти неограниченную энергию от Солнца и охлаждаться естественным образом в вакууме за счёт инфракрасного излучения, без воды и громоздких систем вентиляции. Это позволяет не только экономить энергию, но и снижать углеродный след дата-центров примерно в десять раз на протяжении всего их жизненного цикла. В долгосрочной перспективе Starcloud намерена построить орбитальный дата-центр мощностью до 5 ГВт с солнечными панелями и радиаторами длиной около четырёх километров. По замыслу компании, такие системы помогут разгрузить земные энергосети, обеспечат условно бесплатное охлаждение и снизят зависимость ИИ-инфраструктуры от традиционных энергетических ресурсов.  Основные сценарии применения — обработка данных наблюдения за Землёй в реальном времени: обнаружение пожаров, реагирование на сигналы бедствия, прогнозирование погоды. Например, синтетическая апертурная радиолокация (SAR) способна генерировать до 10 Гбайт данных в секунду, и выполнение анализа на орбите позволит получать результаты мгновенно, без задержек, связанных с передачей сырых данных на Землю. Благодаря участию в программе NVIDIA Inception, стартап получил доступ к аппаратной базе NVIDIA и консультациям инженеров компании. Запуск Starcloud-1 с ускорителем H100 станет первым примером применения этой архитектуры в космосе. В дальнейшем планируется интеграция платформы NVIDIA Blackwell с десятикратным ростом производительности, а также тестирование работы открытой модели Gemma от Google прямо на борту спутника. Проект Starcloud рассматривается как потенциальный прорыв в области устойчивых ИИ-вычислений: он сочетает возобновляемую энергию, отсутствие затрат на охлаждение и мгновенную обработку данных. Хотя эксперты указывают на высокие издержки запусков и технические риски, в компании уверены, что через десять лет большинство новых дата-центров будут строиться уже в космосе.  Точная дата запуска Starcloud-1 пока не объявлена. Известно лишь, что спутник должен полететь на ракете SpaceX Falcon 9 в рамках миссии Bandwagon-4 как попутная нагрузка. В числе основных заказчиков числятся военные ведомства Южной Кореи и США, поэтому о деталях миссии пока не распространяются. В Калифорнии задержаны два китайца, подозреваемые в организации нелегальных поставок ускорителей Nvidia в Китай

06.08.2025 [05:08],

Алексей Разин

Поиски лиц, причастных к контрабанде попадающих под экспортные ограничения США ускорителей вычислений в Китай, ведутся не только за пределами первой из стран, но и на её территории. В Калифорнии власти задержали двоих лиц китайской национальности, подозреваемых в организации поставок запрещённых ускорителей Nvidia на десятки миллионов долларов США.

Источник изображения: Nvidia Об этом со ссылкой на Министерство юстиции США сообщило накануне агентство Reuters. Подозреваемые в период с октября 2022 года по июнь 2025 года, находясь в Калифорнии, как предполагает следствие, занимались экспортом в Китай ускорителей вычислений Nvidia, не получая необходимых для этого лицензий в Министерстве торговли США. Слушания по делу начались в Лос-Анджелесе в этот понедельник, один из подозреваемых, обладающий гражданством США, был отпущен под залог в $250 000. Его предполагаемая сообщница, чья виза для пребывания на территории страны оказалась просрочена, была заключена под стражу. Задержанные вскоре после введения экспортных ограничений против Китая в этой сфере в 2022 года создали компанию ALX Solutions, зарегистрированную в Калифорнии, которая затем переправила в Китай через подставные фирмы в Сингапуре и Малайзии более 20 партий ускорителей Nvidia, находящихся под санкциями. За свою деятельность ALX получила вознаграждение в несколько десятков миллионов долларов США от компаний в Китае и Гонконге. В период с августа 2023 по июль 2024 года калифорнийская компания приобрела более 200 ускорителей H100 в составе систем производства Super Micro Computers, указав в качестве конечных получателей компании в Сингапуре и Японии. Предназначение одной из партий стоимостью более $28 млн так и не удалось подтвердить, хотя поставщик уверял, что ускорители предназначались для компании в Сингапуре, которой на практике не существует по указанному адресу, как показало следствие. Nvidia предсказуемо открестилась от своей причастности к данным поставкам и выступила с осуждением контрабанды. Поставленные таким образом решения лишаются официальной поддержки и обновлений, как она подчеркнула. Super Micro выразила солидарность с Nvidia и заявила, что активно сотрудничает со следствием. В Китае расцвёл бизнес по ремонту санкционных ускорителей Nvidia

25.07.2025 [08:36],

Алексей Разин

Активность «контрабандистов», стремящихся насытить китайский рынок новейшими ускорителями вычислений Nvidia, не способна сделать это в полной мере, поэтому внутри страны получил развитие бизнес по ремонту ранее ввезённого серверного оборудования. Количество компаний, оказывающих подобные услуги, превышает в Китае десять штук.

Источник изображения: Nvidia По крайней мере, Reuters ссылается на опыт двух таких компаний, действующих в районе Шэньчжэня, которые специализируются на ремонте ускорителей Nvidia H100 и A100, попавших на территорию Китая тем или иным способом. По большому счёту, специалисты берутся за ремонт и многих других ускорителей, ввезти которые в Китай по легальным каналам не представляется возможным. Если ускорители A100 с архитектурой Ampere успели попасть в Китай по официальным каналам, прежде чем попали под запрет, то более совершенные H100 в КНР легально вообще не поставлялись, поскольку ещё до начала отгрузок попали под экспортные ограничения США в сентябре 2022 года. Одна из китайских компаний, о которых идёт речь, около 15 лет специализировалась на ремонте игровых видеокарт Nvidia, прежде чем в конце 2024 года решила заняться восстановлением работоспособности ускорителей вычислений той же марки. Ежемесячно компания способна восстанавливать по 500 ускорителей Nvidia, она обладает собственным центром обработки данных, в котором прошедшие через процедуру ремонта ускорители «обкатываются» в условиях, приближённых к реальным. Сама Nvidia не может предоставлять официальные услуги по гарантийному ремонту своего оборудования на территории КНР в силу наличия соответствующих санкций. Официальная политика компании подразумевает, что в течение трёх первых лет эксплуатации дефектные ускорители просто меняются на новые. Поскольку пользователи нелегально ввезённых в Китай ускорителей Nvidia не могут претендовать на гарантийное обслуживание, эту рыночную нишу заняли местные предприниматели. Не все китайские разработчики готовы использовать ускорители Nvidia H20, ввоз которых в страну был недавно разрешён властями США, поэтому спрос на ремонт более производительных H100 сохранится, как отмечают источники. В зависимости от условий эксплуатации, среднестатистический ускоритель вычислений Nvidia требует ремонта каждые два года или пять лет. Услуга по ремонту каждого в Китае обходится заказчику в сумму от $1400 до $2800, но затраты всё равно себя оправдывают на фоне дефицита ускорителей и их высокой начальной стоимости. Некоторые профильные компании установили тариф в 10 % от начальной цены ускорителя за услугу по его ремонту. Мощный ИИ-чип Huawei Ascend 910D имеет шансы превзойти по производительности чип Nvidia H100

28.04.2025 [05:28],

Анжелла Марина

Компания Huawei готовится к тестированию нового процессора для искусственного интеллекта Ascend 910D, который, как надеются в компании, сможет заменить на внутреннем рынке часть высокопроизводительных чипов американского техногиганта Nvidia.

Источник изображения: Huawei Technologies Huawei уже начала переговоры с китайскими технологическими компаниями на предмет тестирования нового ИИ-чипа, сообщает The Wall Street Journal. Первые образцы процессора поступят на проверку уже в конце мая. Однако разработка пока находится на ранней стадии, и для оценки его производительности потребуется серия испытаний. При этом Huawei рассчитывает, что Ascend 910D превзойдёт чип Nvidia H100, широко используемый для обучения ИИ. Ранее США ужесточили экспортные ограничения на поставки в Китай чипа Nvidia H20, что открыло дополнительные возможности для Huawei и других местных производителей, которые, несмотря на санкции, продолжают укреплять позиции Китая в полупроводниковой отрасли. Huawei стала одним из лидеров в разработке отечественных аналогов чипов Nvidia и доказала способность обходить американские ограничения, выпустив флагманский смартфон Mate 60 на китайском процессоре. Его презентация в 2023 году во время визита в Китай тогдашнего министра торговли США Джины Раймондо (Gina Raimondo) вызвала беспокойство в Вашингтоне. В этом году Huawei планирует поставить более 800 000 чипов Ascend 910B и 910C государственным телекоммуникационным компаниям и частным разработчикам ИИ, включая ByteDance (владельца TikTok). После ввода ограничений на H20 некоторые клиенты уже обсуждают увеличение заказов на версию Ascend 910C. Хотя китайские чипы пока отстают от западных аналогов на несколько лет, Huawei и другие местные производители находят способы повышать их производительность, объединяя несколько чипов в одной системе. Так, в апреле компания представила вычислительную систему CloudMatrix 384, которая, по мнению аналитиков, в некоторых задачах даже превосходит флагманские решения Nvidia, несмотря на большее энергопотребление. Однако масштабное производство таких чипов остаётся проблемой из-за того, что Huawei лишена доступа к крупнейшему тайваньскому производителю микросхем TSMC, а китайская SMIC не может закупать самое современное оборудование. «Однако даже если отдельно взятый GPU Huawei на треть слабее Nvidia Blackwell, их общее количество компенсирует этот разрыв», — отмечается в отчёте SemiAnalysis. Эксперты также признают, что проблемы с энергоэффективностью есть, но для Китая они не являются критичными. Несмотря на ограничения США, китайский рынок наводнён ИИ-чипами Nvidia

06.09.2024 [18:30],

Анжелла Марина

Несмотря на экспортные ограничения, введённые Вашингтоном, передовые чипы Nvidia для искусственного интеллекта, такие как A100 и H100, легко попадают на китайский рынок и доступны по более низким ценам, чем в США. Расследование Financial Times показало, что небольшие китайские облачные провайдеры предлагают аренду серверов с восемью Nvidia A100 примерно за $6/час, в то время как аналогичные услуги в США стоят около $10/час и более.

Источник изображения: Mariia Shalabaieva/Unsplash Низкие цены на аренду серверов указывают на обилие чипов Nvidia на китайском рынке и на способы обхода американских ограничений, направленных на предотвращение доступа к передовым технологиям. Чипы A100 и H100 являются на сегодня самыми мощными ускорителями ИИ, используемыми для обучения больших языковых моделей (LLM), и несмотря на запрет экспорта A100 в Китай и отсутствие разрешения на продажу H100, чипы остаются доступными для местных стартапов и реселлеров. Одновременно крупные китайские облачные операторы, такие как Alibaba и ByteDance, предлагают аренду серверов с чипами Nvidia по ценам, в два-три раза превышающим расценки мелких провайдеров. После применения скидок, цены всё равно сопоставимы с ценами Amazon Web Services (AWS), которые варьируются от $15 до $32 за час. Как отметил один из основателей стартапа, «большие игроки вынуждены заботиться о соблюдении норм, и поэтому находятся в невыгодном положении, так как не могут использовать контрабандные чипы». По оценкам экспертов, в Китае находится более 100 тыс. Nvidia H100. Относительно небольшой размер чипов упрощает их контрабанду через границы, подрывая усилия Вашингтона по сдерживанию развития ИИ в Китае. Глава небольшой китайской облачной компании отметил, что низкие внутренние издержки помогают компенсировать более высокие цены, которые провайдеры платят за контрабанду. «Инженеры дешёвые и электроэнергия дешёвая…», — пояснил он. Nvidia утверждает, что продаёт чипы «прежде всего официальным партнёрам», гарантируя, что все продажи соответствуют правилам экспортного контроля США. Компания признаёт наличие рынка подержанных ускорителей, но обещает принимать меры в случае выявления нарушений экспортного контроля. В целом эксперты сомневаются в эффективности американских санкций за пределами США, так как схемы обхода ограничений включают создание подставных компаний в третьих странах, что затрудняет отслеживание конечного получателя. «Трудно полностью обеспечить соблюдение экспортного контроля за пределами границы США», — цитирует Financial Times слова американского эксперта по санкциям. Таким образом, пока Вашингтон пытается ограничить доступ Китая к передовым технологиям, китайские компании продолжают извлекать выгоду из чипов Nvidia. Bang & Olufsen представил беспроводные наушники Beoplay H100 за $1549

03.09.2024 [12:47],

Владимир Фетисов

Производитель люксовых аудиоустройств Bang & Olufsen известен использованием дорогих материалов, что делает их продукцию весьма дорогой. Как правило, накладные и внутриканальные наушники бренда стоят дороже аналогов от многих конкурентов, и новинка, представленная на этой неделе, не стала исключением. Вслед за выпущенной ранее моделью Beoplay H95 стоимостью $999, компания анонсировала беспроводные наушники Beoplay H100, которые обойдутся в $1549.

Источник изображений: Bang & Olufsen В Bang & Olufsen заявили, что Beoplay H95 на сегодняшний день являются «самыми успешными наушниками» компании. Они также отметили, что модель Beoplay H100 получила ряд заметных улучшений по сравнению с предыдущей версией устройства. Как и большинство наушников бренда, Beoplay H100 изготовлены из материалов премиального уровня, таких как кожа ягнёнка и вязаная ткань. На внешней стороне корпуса наушников расположен сенсорный интерфейс, выполненный из устойчивого к царапинам стекла. В компании отметили, что при создании Beoplay H100 в чёрном, песочном и абрикосовом цветовых вариантах корпуса, разработчики вдохновлялись дизайном изысканных ювелирных украшений. Съёмные амбушюры и внутреннее оголовье позволяют заменить их в случае износа.  В Beoplay H100 используются 40-миллиметровые излучатели, обеспечивающие «чистоту звука и динамические характеристики, которые обычно можно услышать только на высококлассных акустических системах». Поддерживается вывод звука в качестве 24 бит / 96 кГц, технология Dolby Atmos и функция отслеживания положения головы пользователя. В компании утверждают, что эта технология адаптивного аудио, названная EarSense, отслеживает посадку наушников и корректирует настройки звукового профиля в режиме реального времени.  В Beoplay H100 эффективность активного шумоподавления удвоилась по сравнению с моделью Beoplay H95. Этого удалось достичь за счёт использования 10 микрофонов, которые также обеспечивают более качественную работу режима прозрачности. Пользователь может регулировать уровень работы режима прозрачности, проворачивая круглую основу на внешней стороне амбушюр. В компании эту функцию называют TrueTransparency. Есть также режим быстрого прослушивания, который позволяет быстро переключиться на окружающие звуки без необходимости постоянного использования режима прозрачности.  В Bang & Olufsen отметили, что продукты компании создаются таким образом, чтобы покупатели могли обновлять их в течение длительного времени. Это относится не только к съёмному оголовью и амбушюрам, но и к аккумуляторным батареям, динамикам и другим внутренним компонентам. Поддержка аудио высокого разрешения и возможность подключения по Bluetooth к трём устройствам одновременно появятся позднее благодаря обновлению программного обеспечения устройства.  Как и Apple AirPods Max, Beoplay H100 автоматически переходят в режим пониженного энергопотребления, когда не находятся в кейсе, но и не используются по назначению. В таком состоянии наушники могут находиться до 90 дней. Если же хранить наушники в кейсе, они будут полностью отключаться. Что касается автономности, то Beoplay H100 с включённым режимом шумоподавления могут работать до 34 часов. Новинка уже доступна для заказа на сайте производителя. Сроки поставок ИИ-ускорителей Nvidia H100 сократились до 2–3 месяцев

10.04.2024 [20:59],

Николай Хижняк

Cроки поставок ИИ-ускорителей Nvidia H100 сократились с 3–4 до 2–3 месяцев (8–12 недель), сообщает DigiTimes со ссылкой на заявление директора тайваньского офиса компании Dell Теренса Ляо (Terence Liao). ODM-поставщики серверного оборудования отмечают, что дефицит специализированных ускорителей начал снижаться по сравнению с 2023 годом, когда приобрести Nvidia H100 было практически невозможно.

Источник изображения: Nvidia По словам Ляо, несмотря на сокращение сроков выполнения заказов на поставки ИИ-ускорителей, спрос на это оборудование на рынке по-прежнему чрезвычайно высок. И несмотря на высокую стоимость, объёмы закупок ИИ-серверов значительно выше закупок серверного оборудования общего назначения. Окно поставок в 2–3 месяца — это самый короткий срок поставки ускорителей Nvidia H100 за всё время. Всего шесть месяцев назад он составлял 11 месяцев. Иными словами, клиентам Nvidia приходилось почти год ждать выполнение своего заказа. С начала 2024 года сроки поставок значительно сократились. Сначала они упали до 3–4 месяцев, а теперь до 2–3 месяцев. При таком темпе дефицит ИИ-ускорителей может быть устранён к концу текущего года или даже раньше. Частично такая динамика может быть связана с самими покупателями ИИ-ускорителей. Как сообщается, некоторые компании, имеющие лишние и нигде не использующиеся H100, перепродают их для компенсации огромных затрат на их приобретение. Также нынешняя ситуация может являться следствием того, что провайдер облачных вычислительных мощностей AWS упростил аренду ИИ-ускорителей Nvidia H100 через облако, что в свою очередь тоже частично помогает снизить на них спрос. Единственными клиентами Nvidia, которым по-прежнему приходится сталкиваться с проблемами в поставках ИИ-оборудования, являются крупные ИИ-компании вроде OpenAI, которые используют десятки тысяч подобных ускорителей для быстрого и эффективного обучения своих больших языковых ИИ-моделей. NVIDIA запустила девятый по мощности суперкомпьютер в мире — Eos получил 4608 ИИ-ускорителей H100

17.02.2024 [13:07],

Павел Котов

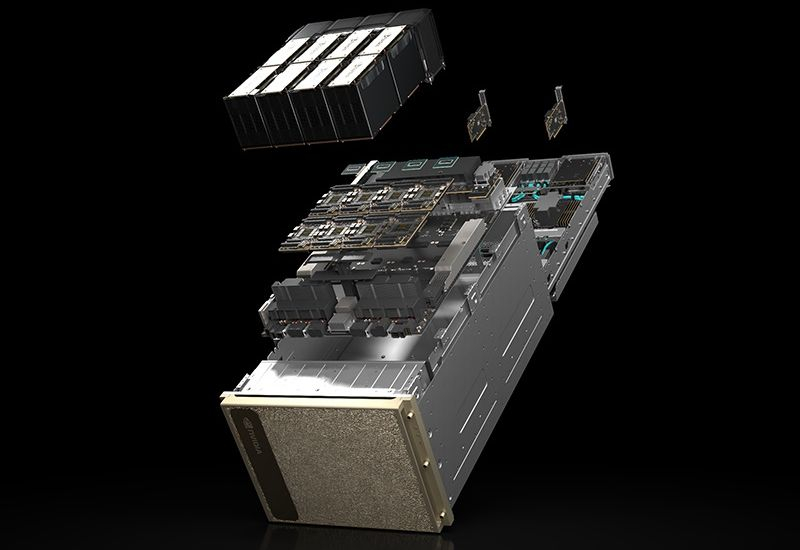

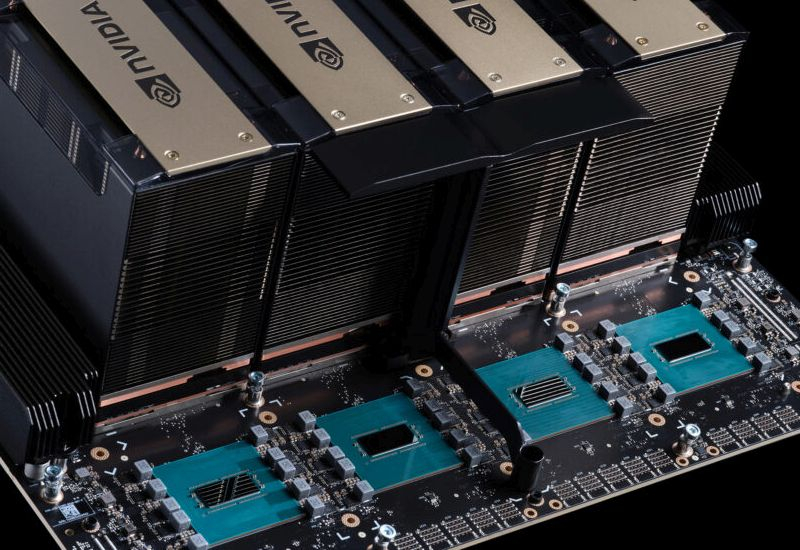

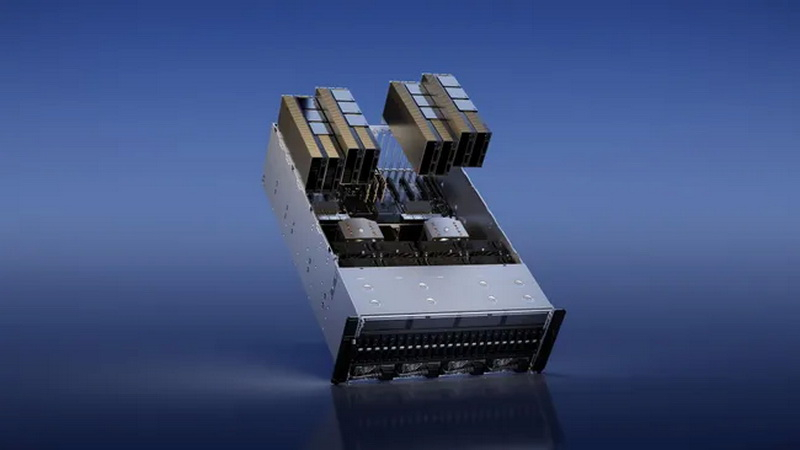

NVIDIA официально представила суперкомпьютер Eos, предназначенный для приложений искусственного интеллекта. Он оснащён 576 системами NVIDIA DGX H100, каждая из которых включает 8 ускорителей H100 — всего 4608 единиц. Системы подключены с использованием архитектуры NVIDIA Quantum-2 InfiniBand (400 Гбит/с). Также суперкомпьютер включает 1152 процессора Intel Xeon Platinum 8480C, каждый из которых предлагает 56 ядер.

Источник изображения: nvidia.com Суперкомпьютер NVIDIA Eos предлагает производительность для ИИ-приложений в 18,4 Эфлопс (FP8), а также обеспечит около 9 Эфлопс в рассчётах FP16 и 275 Пфлопс в FP64. Компания анонсировала его почти год назад и рассказывала подробнее о нём на выставке Supercomputing 2023 в ноябре минувшего года — теперь он готов начать работу. Разработчик отмечает, что Eos способен справиться с самыми большими рабочими нагрузками в области ИИ для обучения больших языковых моделей, рекомендательных алгоритмов, квантового моделирования и многого другого. Суперкомпьютер занимает девятое место в рейтинге TOP500. Высокую производительность NVIDIA Eos обеспечивают мощные ускорители и интерфейсы компании NVIDIA, а также её ПО, такое как NVIDIA Base Command и NVIDIA AI Enterprise. «Архитектура Eos оптимизирована для рабочих нагрузок ИИ, требующих сверхмалой задержки и высокой пропускной способности соединений внутри кластера ускорителей, что делает её идеальным решением для предприятий, стремящихся масштабировать свои комплексы ИИ. В то время как корпорации и разработчики по всему миру стремятся задействовать возможности ИИ, Eos становится основным ресурсом, который обещает ускорить путь к приложениям на базе ИИ для каждой организации», — отметила NVIDIA. |