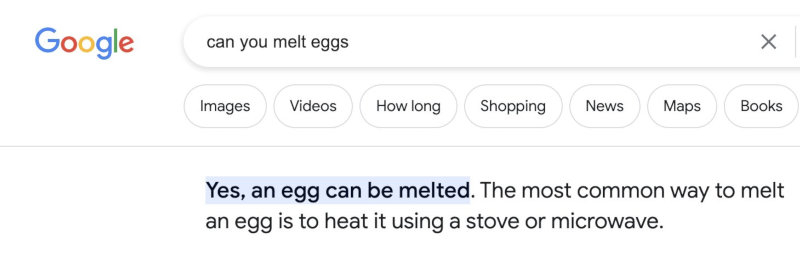

Англоязычная версия поисковой машины Google в формате быстрого ответа на вопрос о том, можно ли расплавить яйца, стала цитировать явно не соответствующее действительности утверждение на платформе Quora, которое дал искусственный интеллект. Это обнаружил пользователь соцсети X Тайлер Глейел (Tyler Glaiel). К настоящему моменту Google изъяла этот ответ из выдачи.

Источник изображения: Arkan Perdana / unsplash.com

«Да, яйцо можно расплавить. Самый распространённый способ расплавить яйцо — нагреть его на плите или в микроволновой печи», — гласит утверждение платформы вопросов и ответов Quora. На странице портала, на которую ссылается Google, первоначально был указан ответ за авторством ChatGPT, но если задать этот вопрос напрямую чат-боту он, вероятно, даст отрицательный ответ — сейчас таковой значится и на странице Quora.

Источник изображения: twitter.com/TylerGlaiel

Как выяснили журналисты ресурса Ars Technica, функция ИИ-ответов на портале работает не на основе ChatGPT, а посредством более раннего API GPT-3 text-davinci-003, который чаще даёт неверные ответы. Утверждение о возможности расплавить яйца удалось воспроизвести в разделе Playground на сайте OpenAI, но только ChatGPT никогда не использовал эту модель, а разработчик полностью откажется от неё 4 января 2024 года. Стоит отметить, что поисковая машина Google может давать неверные ответы даже без участия ИИ — известны случаи, когда она извлекала некорректные фрагменты из материалов, в которых приводится в целом соответствующая действительности информация.

Есть мнение, что за последние десятилетие качество поиска Google резко ухудшилось из-за обилия информационного шума, который добавляют к выдаче оптимизированные, но бесполезные сайты. Одни пользователи для борьбы с этим явлением начали добавлять к запросам названия сетевых сообществ, например, Reddit, другие же начали обращаться к чат-ботам на основе ИИ. Примечательно, что чат-боты сами часто дают некорректные ответы, попадающие в поисковую выдачу Google, и это дополнительно понижает её качество.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018