Исследовательское подразделение компании Meta✴ Platforms представило новый генеративный алгоритм 3D Gen, который позволяет создавать качественные 3D-объекты по текстовому описанию. По словам разработчиков, новая нейросеть превосходит аналоги по качеству создаваемых моделей и по скорости генерации.

Источник изображений: 3D gen

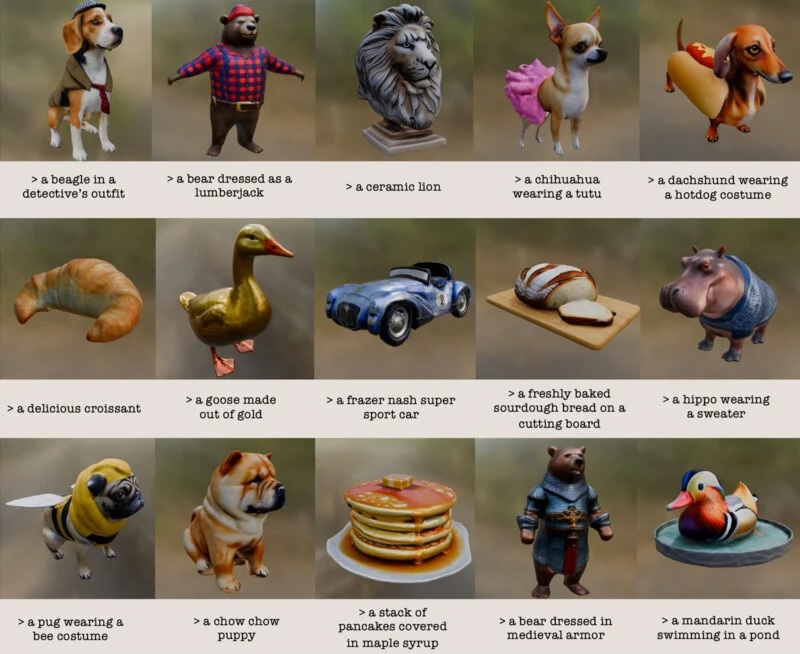

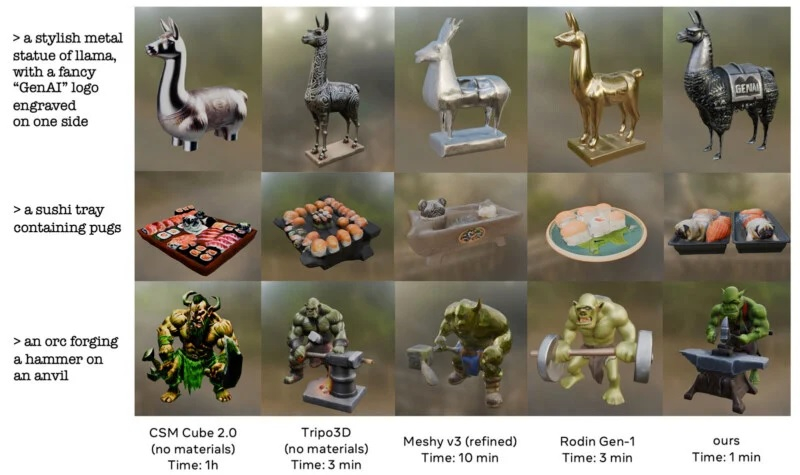

«Эта система может генерировать 3D-объекты с текстурами высокого разрешения», — говорится в сообщении Meta✴ в соцсети Threads. Там также отмечается, что нейросеть значительно превосходит аналогичные алгоритмы по качеству генерируемых объектов и в 3-10 раз опережает по скорости генерации.

Согласно имеющимся данным, Meta✴ 3D Gen может создавать 3D-объекты и текстуры на основе простого текстового описания менее чем за минуту. Функционально новый алгоритм похож на некоторые уже существующие аналоги, такие как Midjourney и Adobe Firefly. Одно из отличий в том, что 3D Gen создаёт модели, которые поддерживают физически корректный рендеринг. Это означает, что создаваемые нейросетью модели могут использоваться в приложениях для моделирования и рендеринга реально существующих объектов.

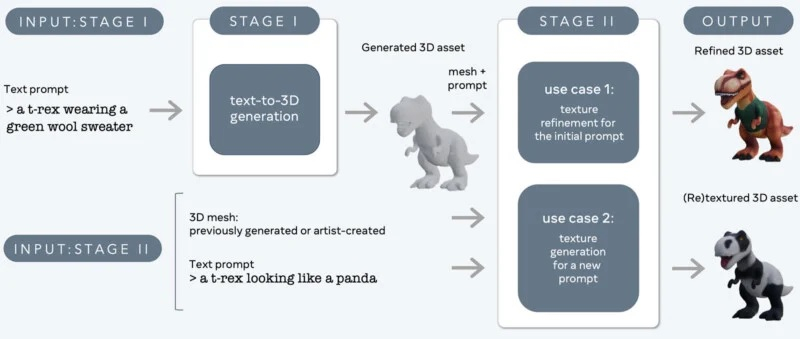

«Meta✴ 3D Gen — это двухступенчатый метод, сочетающий в себе два компонента: один для преобразования текста в 3D, а другой — для преобразования текста в текстуры», — говорится в описании алгоритма. По словам разработчиков, такой подход позволяет добиться «более высокого качества 3D-генерации для создания иммерсивного контента».

3D Gen объединяет две основополагающие языковые модели Meta✴ AssetGen и TextureGen. В Meta✴ заявляют, что, основываясь на отзывах профессиональных 3D-художников, новая технология компании предпочтительнее конкурирующих аналогов, которые также позволяют генерировать 3D-объекты по текстовому описанию.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018