Технологии на основе искусственного интеллекта уже успели стать частью многих сервисов Google. Принадлежащий IT-гиганту видеохостинг YouTube не стал исключением, и уже в скором времени новейшие алгоритмы станут доступны пользователям сервиса. В рамках мероприятия Made on YouTube разработчики анонсировали несколько функций, которые, вероятно, изменят то, как авторы контента создают видео, а также сами ролики, публикуемые на платформе.

Источник изображения: YouTube

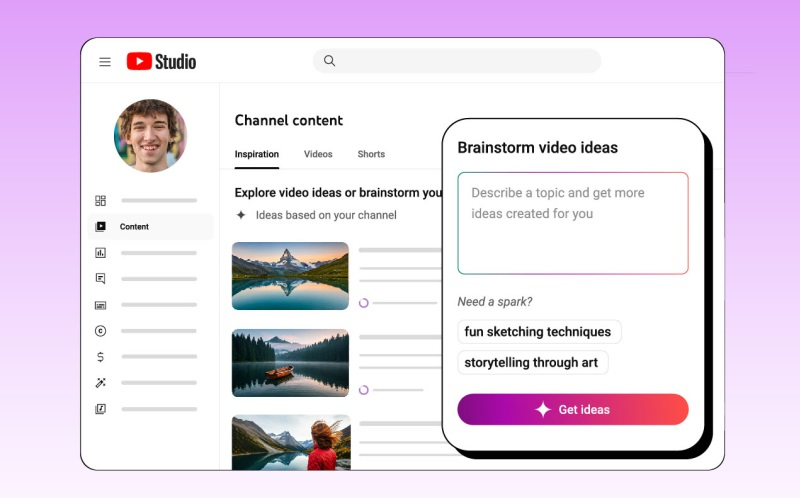

Первая функция называется «Вдохновение» и появится в YouTube Studio. Последние несколько месяцев этот инструмент тестировался с привлечением ограниченного числа пользователей. Данная функция фактически предназначена для того, чтобы подсказывать авторам контента, что им следует делать. Она может предложить концепцию видео, сгенерировать заголовок и миниатюру для ролика, а также подготовить текстовое описание. YouTube позиционирует функцию как инструмент для мозгового штурма, но в целом она может быть полезна и при создании полноценных проектов.

Кроме того, пользователи YouTube смогут генерировать реалистичные видео с помощью мощной нейросети Veo, которую представили ранее в этом году и теперь интегрировали в Shorts. Представитель Google отметил, что Veo уже интегрирован в облачный редактор Shorts, а созданные с его помощью ролики будут помечены соответствующим образом, чтобы зрители знали, что видео создано с помощью ИИ.

Обе новые функции будут внедряться постепенно и станут доступны всем авторам контента в конце этого или начале следующего года. В YouTube появятся и другие инструменты на базе нейросетей. К ним относится функция автоматического дубляжа видео, которая будет озвучивать ролики на разные языки. Платформа также предоставит авторам больше ИИ-инструментов для взаимодействия с подписчиками через раздел «Сообщества» в приложении YouTube.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018