Прошлой весной Anthropic заявила о намерении создать «алгоритм нового поколения для самообучения ИИ», который сможет самостоятельно выполнять большинство офисных задач, что позволило бы автоматизировать значительную часть экономики. Сегодня компания выпустила версию 3.5 своей модели Claude Sonnet, которая может через API Computer Use взаимодействовать с любым десктопным приложением, имитировать нажатия клавиш, клики и жесты мыши, полностью эмулируя человека.

Источник изображения: Pixabay

«Мы обучили Claude видеть, что происходит на экране, а затем использовать доступные программные инструменты для выполнения задач, — сообщает Anthropic. — Когда разработчик поручает Claude использовать часть компьютерного программного обеспечения и даёт ему необходимый доступ, Claude смотрит на скриншоты того, что видит пользователь, затем подсчитывает, на сколько пикселей по вертикали или горизонтали ему нужно переместить курсор, чтобы щёлкнуть в нужном месте».

Подобный инструмент, так называемый «агент ИИ», который может автоматизировать задачи на ПК, не является новой идеей. Термин агент ИИ пока остаётся нечётко определённым, но обычно под ним подразумевается ИИ, способный автоматизировать работу с программным обеспечением на ПК. Множество компаний сегодня предлагают подобные инструменты, начиная с Microsoft, Salesforce и OpenAI, и заканчивая новыми игроками, такими как Relay, Induced AI и Automat.

Стартап потребительских гаджетов Rabbit представил агента, который умеет самостоятельно покупать билеты онлайн. Adept, недавно приобретённый Amazon, обучает модели просмотру сайтов и навигации по программному обеспечению. Twin Labs использует готовые модели, включая GPT-4o от OpenAI, для автоматизации процессов рабочего стола.

Некоторые аналитики уверены, что агенты ИИ смогут обеспечить компаниям более простой способ монетизации миллиардов долларов, которые они вливают в ИИ. Согласно недавнему опросу Capgemini, 10 % организаций уже используют агентов ИИ, а 82 % планируют интегрировать их в течение следующих трёх лет.

Источник изображения: unsplash.com

Anthropic называет свою концепцию агента ИИ «слоем действия-исполнения», который позволяет ему выполнять команды на уровне рабочего стола. Благодаря способности просматривать веб-страницы, Claude 3.5 Sonnet может использовать в работе любой сайт и любое приложение.

«Люди контролируют процесс при помощи подсказок, направляющих действия Claude, например, “использовать данные с моего компьютера и из сети, чтобы заполнить эту форму”, — поясняет представитель Anthropic. — Люди разрешают доступ и ограничивают его по мере необходимости. Claude разбивает подсказки пользователя на компьютерные команды (например, перемещение курсора, нажатие, ввод текста) для выполнения этой конкретной задачи».

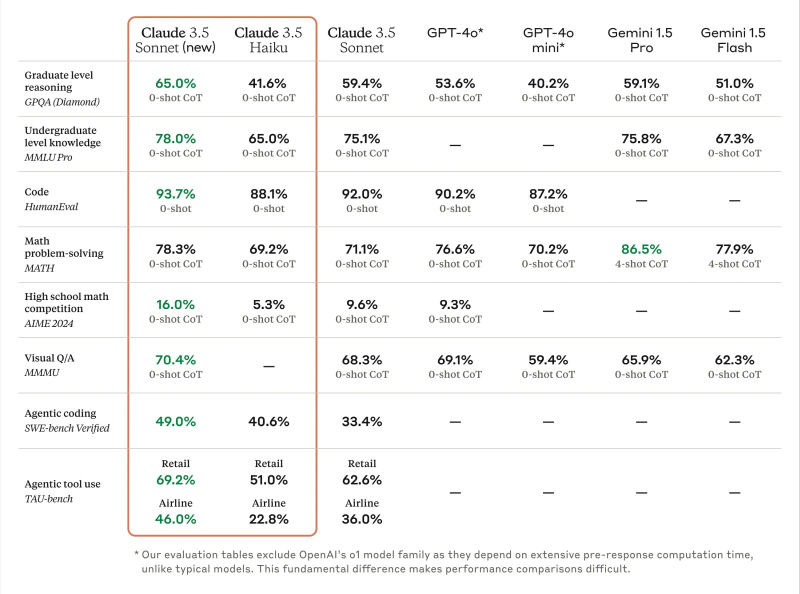

Источник изображений: Anthropic

В чём отличие Claude 3.5 Sonnet от других агентов ИИ? Anthropic утверждает, что это просто более сильная, более надёжная модель, которая справляется с задачами кодирования лучше, чем даже флагманский o1 от OpenAI, согласно бенчмарку SWE-bench Verified. Claude самостоятельно корректирует и повторяет задачи, когда сталкивается с препятствиями, и может работать над целями, требующими десятков или сотен шагов.

При этом Anthropic признает, что обновлённая модель испытывает трудности с базовыми действиями, такими как прокрутка и масштабирование, и может пропускать кратковременные события и уведомления из-за способа, которым она делает снимки экрана и объединяет их. Во время тестового бронирования авиабилетов Claude 3.5 Sonnet сумела успешно выполнить менее половины задач. В задаче возврата билетов новая модель не справилась примерно в трети случаев.

Что касается безопасности, недавнее исследование показало, что даже модели не имеющие возможности использовать настольные приложения, такие как GPT-4o от OpenAI, могут быть задействованы во вредоносном «многошаговом агентском поведении», например, заказать поддельный паспорт в даркнете. Подобные результаты были достигнуты исследователями с использованием методов джейлбрейка, что привело к высокому проценту успешно выполненных вредоносных задач даже для защищённых моделей.

Можно предположить, что модель с доступом к управлению ПК может нанести значительно больший ущерб — например, используя уязвимости приложений для компрометации личной информации (или сохранения чатов в виде открытого текста). Помимо имеющихся в её распоряжении программных рычагов, сетевые и прикладные соединения модели могут открыть широкие возможности для злоумышленников.

Anthropic не отрицает, что использование Claude 3.5 Sonnet подвергает пользователя дополнительным рискам. Но по мнению компании «гораздо лучше предоставить компьютерам доступ к сегодняшним более ограниченным, относительно безопасным моделям — так мы можем начать наблюдать и извлекать уроки из любых потенциальных проблем, которые возникают на этом более низком уровне, постепенно и одновременно наращивая использование компьютеров и меры по снижению рисков для безопасности».

Anthropic заявляет, что предприняла некоторые шаги для предотвращения ненадлежащего использования, например, не обучала новую модель на снимках экрана и подсказках пользователей и не давала модели выходить в интернет во время обучения. Компания разработала классификаторы для предотвращения высокорисковых действий, таких как публикация в социальных сетях, создание учётных записей и взаимодействие с правительственными ресурсами.

Anthropic сообщила, что у неё есть возможность «при необходимости» ограничить доступ к дополнительным функциям, например, для защиты от спама, мошенничества и дезинформации. В качестве меры предосторожности компания хранит все снимки экрана, сделанные Computer Use, не менее 30 дней, что может создать дополнительную угрозу безопасности и конфиденциальности. Anthropic не сообщила при каких обстоятельствах она может передать снимки экрана третьей стороне (например, правоохранительным органам).

«Не существует надёжных методов, и мы будем постоянно оценивать и совершенствовать наши меры безопасности, чтобы сбалансировать возможности Claude с ответственным использованием, — утверждает Anthropic. — Тем, кто использует компьютерную версию Claude, следует принять соответствующие меры предосторожности, чтобы минимизировать подобные риски, включая изоляцию Claude от особо конфиденциальных данных на своём компьютере».

Источник изображения: Pixabay

Одновременно с выпуском модели Claude 3.5 Sonnet, Anthropic анонсировала скорый выход обновлённой версии Claude 3.5 Haiku. «Благодаря высокой скорости, улучшенному следованию инструкциям и более точному использованию инструментов Claude 3.5 Haiku хорошо подходит для продуктов, ориентированных на пользователя, специализированных задач субагентов и создания персонализированного опыта из огромных объёмов данных, таких как история покупок, цены или данные об инвентаре», — говорится в блоге Anthropic. Haiku изначально будет доступна как текстовая модель, а затем как часть мультимодального пакета, который может анализировать как текст, так и изображения.

Что касается выпуска обновлённой модели Claude 3.5 Opus, представитель Anthropic заявил: «Все модели в семействе Claude 3 имеют своё индивидуальное применение для клиентов. Claude 3.5 Opus есть в нашей дорожной карте, и мы обязательно поделимся с вами подробностями, как только сможем».

Разработчики уже могут протестировать Computer Use через API Anthropic, Amazon Bedrock и платформу Vertex AI от Google Cloud.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018