|

Опрос

|

реклама

Быстрый переход

В ядре Linux нашли серьёзную уязвимость, созданную всего одним лишним символом в коде

09.06.2026 [20:57],

Николай Хижняк

Исследователи проанализировали серьёзную уязвимость в Linux, которая позволяет повысить права доступа для недоверенных пользователей до уровня root, используя редкую ошибку — всего один ошибочный символ в коде ядра.

Источник изображения: Fotis Fotopoulos / unsplash.com Уязвимость, отслеживаемая как CVE-2026-23111, находится в nf_tables — подсистеме ядра Linux, которая обеспечивает возможности фильтрации пакетов. Она используется для управления правилами брандмауэра и заменяет более старые подсистемы, такие как iptables, ip6tables, arptables и ebtables. Наличие одного ошибочно введённого восклицательного знака в коде, реализующем nf_tables, привело к появлению уязвимости типа use-after-free, которая повреждает память, размещая вредоносный код по адресам памяти, не освобождённым должным образом от предыдущего содержимого. CVE-2026-23111 может использоваться непривилегированным пользователем или процессом для повышения прав доступа в системе до уровня root. Уязвимость работает за счёт нарушения процесса удаления вердиктов — определений в рамках фреймворка nf_tables, которые решают, соответствует ли пакет правилу, требующему выполнения определённого действия. В этом процессе могут использоваться так называемые элементы catchall, которые действуют как подстановочный знак, если поиск не находит совпадений ни с одним другим элементом в наборе. Когда карта вердиктов удаляется из памяти, элементы catchall деактивируются, а счётчик ссылок цепочки уменьшается. При возникновении ошибок удаление может быть отменено, а счётчик — увеличен. Уязвимость CVE-2026-23111 позволяет изменить этот процесс. В результате эксплойт может уменьшать значение переменной произвольное количество раз, а затем удалить и освободить цепочку, когда некоторые объекты всё ещё указывают на неё. «Здесь мы рассмотрели, как один некорректный восклицательный знак привёл к уязвимости использования памяти после освобождения, которую может использовать непривилегированный пользователь в Debian и Ubuntu для повышения привилегий до уровня root. Хотя эксплойт многократно активирует уязвимость использования памяти после освобождения (use-after-free), приводящую к утечке базового адреса ядра, утечке адресов кучи и перехвату потока управления, тесты стабильности показали стабильность более 99 % в неактивной системе», — сообщили в понедельник исследователи компании Exodus Intelligence. Обнаруженная уязвимость была исправлена в ядре в феврале. Компания FuzzingLabs продемонстрировала эксплойт в апреле. Компания Exodus Intelligence, обнаружившая ошибку, включила свой собственный эксплойт в пост в понедельник. Он работал на Debian и Ubuntu. CVE-2026-23111 — одна из как минимум трёх мощных уязвимостей повышения привилегий, обнаруженных в Linux за последние недели. Эти уязвимости особенно опасны, поскольку в сочетании с отдельным эксплойтом могут использоваться для обхода встроенных в ОС средств защиты. Apple Intelligence сможет самостоятельно исправлять скомпрометированные пароли

09.06.2026 [10:13],

Анжелла Марина

Apple анонсировала новую функцию в приложении Passwords, которая позволяет автоматически заменять слабые и скомпрометированные пароли. Технология использует Apple Intelligence и браузер Safari для выполнения действий от лица пользователя. Функция расширяет существующую возможность приложения по обнаружению ненадёжных или раскрытых учётных данных, сообщает MacRumors.

Источник изображения: macrumors.com Ранее Passwords только предупреждал о проблемах с данными, но для их исправления требовалось вручную переходить на каждый сайт и менять пароль. Новая система полностью автоматизирует этот процесс и работает по принципу агента, который осуществляет навигацию по веб-сайтам, выполняет вход в аккаунты и обновляет учётные записи для входа без необходимости вмешательства пользователя (после первоначального подтверждения). В момент выполнения операции статус процесса отображается в виде активности в реальном времени (Live Activity) на экране устройства. Внедрение этой возможности направлено на устранение барьеров при поддержании «цифровой гигиены» и повышение общего уровня безопасности пользовательских данных, а автоматизация рутинных процедур позволяет сократить время, необходимое для реагирования на утечки конфиденциальной информации или использование ненадёжных комбинаций символов. Техническая реализация обеспечивает бесшовное взаимодействие между iOS и веб-интерфейсами сторонних ресурсов. В России количество атак киберпреступников-вымогателей снизилось, но это лишь передышка

09.06.2026 [10:08],

Владимир Мироненко

В этом году впервые за последние четыре года количество атак киберпреступников-вымогателей на российские компании сократилось — на 20 % год к году за первые пять месяцев. По мнению экспертов, это связано с циклическим спадом, а не наметившимся трендом, пишет «Коммерсантъ».

Источник изображения: Kevin Ku/unsplash.com Специалисты F6 выявили более 220 атак различных группировок вымогателей на российские компании, что меньше год к году на 20 %, в то время как последние четыре года число таких атак ежегодно росло. Исследователи отметили значительное снижение активности в России киберпреступных группировок с ближневосточными корнями в связи их переключением на другие объекты из-за обострения ситуации в регионе. Вместе с тем выросла активность проукраинских группировок, количество атак которых увеличилось более чем на 10 %. В большинстве случаев (82 %) киберпреступники были нацелены на получение выкупа и только в 18 % атак стремились разрушить инфраструктуру и нанести жертве максимальный ущерб. Самая высокая сумма первоначального выкупа, запрошенная преступниками у компании из финансового сектора, составила $3,8 млн (около 304 млн руб. на момент атаки). Это на 24 % ниже рекордного требования выкупа в 2025 году группировки CyberSec’s в размере 50 BTC (около 500 млн руб. на момент атаки), потребовавшей эту сумму у крупной российской рыбопромысловой компании. Согласно данным F6, в 2026 году средняя сумма выкупа, запрашиваемая хакерами у российских компаний за возобновление доступа к заблокированным данным, составила $175 тыс. По словам руководителя лаборатории цифровой криминалистики компании F6 Антона Величко, после оценки бизнеса жертв по похищенным финансовым документам, хакеры, атакующие западные компании, назначают сумму выкупа порядка от 1 до 5 % от годового оборота. В случае проукраинских группировок, целью которых является не только финансовая выгода, но и осуществление диверсий, это иногда приводит к «космическим» запросам выкупов. Если же задача заключается только в получении финансовой выгоды, они достаточно прагматично относятся к размерам выкупа и по необходимости снижают первоначальные суммы, в ряде случае — на 30–50 %. Как отметил руководитель группы анализа ВПО Sloar 4RAYS (ГК «Солар») Станислав Пыжов, снижение числа атак на 20 % не устойчивый тренд, а циклический спад: часть кластеров уходит на перегруппировку, а некоторые атаки переключаются на шпионаж. Руководитель Bi.Zone Threat Intelligence Олег Скулкин полагает, что активность вымогателей дальше снижаться не будет. Он также считает, что их доля выросла с 47 % в 2025 году до 49 % в первом квартале 2026 года. Антон Величко отметил, что даже после выплаты выкупа жертвам по разным причинам не всегда удаётся восстановить данные. Нередко встречаются случаи, когда ошибки в действиях атакующих или в программах-вымогателях приводили к повреждению файлов при шифровании и безвозвратной потере информации. Даже если сумма окажется ниже стоимости самостоятельного восстановления, это не гарантирует возврата данных, так как вымогатели могут не предоставить рабочий ключ дешифрования, предупредил руководитель глобальной команды по реагированию на компьютерные инциденты «Лаборатории Касперского» Константин Сапронов. OpenAI добавила ChatGPT режим блокировки для защиты от промпт-инъекций

07.06.2026 [11:08],

Владимир Мироненко

Компания OpenAI представила новую функцию ИИ-чат-бота ChatGPT — режим блокировки (Lockdown Mode), который обеспечит дополнительную защиту от атак с использованием промпт-инъекций (Prompt Injection), когда на веб-страницах и в других источниках контента содержатся скрытые вредоносные инструкции, обманным путём заставляющие ИИ выполнять несанкционированные действия.

Источник изображения: Mariia Shalabaieva/unsplash.com Режим блокировки предназначен для снижения риска утечки данных в результате атак с использованием промпт-инъекций путём ограничения исходящих сетевых запросов за счёт отключения или ограничения некоторых функций. В частности, в режиме блокировки отключаются просмотр веб-страниц в реальном времени (доступ будет только к кешированному контенту), получение и отображение изображений из сети, углублённый поиск и режим агента. Компания предупредила, что, хотя режим блокировки разработан для существенного снижения риска утечки данных в результате атак с использованием промпт-инъекций в ChatGPT и поддерживаемых продуктах OpenAI, он не гарантирует полной защиты от компрометации данных. Риск может сохраняться из-за включённых приложений. Кроме того, промпт-инъекции могут появляться в кешированном веб-контенте или в загруженных файлах и по-прежнему влиять на поведение модели или точность ответов. OpenAI также уточнила, что режим блокировки предназначен не для всех: «Он разработан для людей и организаций, которые работают с конфиденциальными данными и хотят более строгой защиты от рисков утечки данных, связанных с внедрением запросов». В настоящее время режим блокировки добавлен для учётных записей ChatGPT Business с самообслуживанием, а также для соответствующих личных аккаунтов, включая Free, Go, Plus и Pro. Исследователи создали червя на основе ИИ — он может использовать любую известную компьютерную уязвимость

03.06.2026 [16:30],

Владимир Мироненко

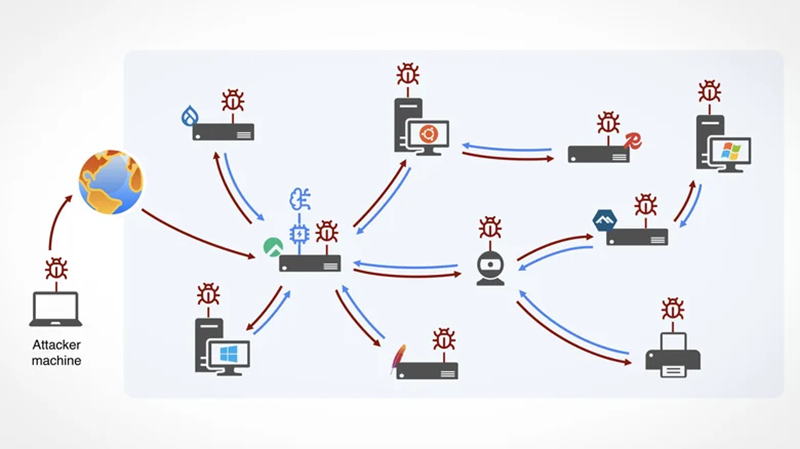

Исследователи из Университета Торонто создали с помощью общедоступных ИИ-моделей прототип червя, способного использовать любую известную компьютерную уязвимость. Такие черви могут распространяться по сетям и вызывать хаос в интернете, пишет Engadget.

Источник изображения: University of Toronto/Engadget Обычно типичный компьютерный червь разрабатывается программистами для использования конкретных сетевых уязвимостей и может быть остановлен путем их исправления. В свою очередь, канадские исследователи, работая в защищённой закрытой среде и принимая обширные меры предосторожности, использовали ИИ-модели с открытым исходным кодом для создания гораздо более сложного прототипа червя, который распространился по тестовой сети команды без вмешательства человека. Этот тип червя способен адаптировать свои действия к различным типам уязвимостей на нескольких платформах, включая Linux, Windows и устройства IoT. Он собирает данные по мере продвижения по сети, перехватывая пароли и обнаруживая новые уязвимости, которые помогают ему захватить контроль над другими машинами. В случае, если на компьютере уязвимость была обнаружена и исправлена, червь может использовать для повторной атаки на него другие уязвимости. Вдобавок ко всему, червь использует вычислительную мощность заражённых машин для продолжения своих действий и выработки стратегии будущих атак. «Хакерам обычно приходилось отдавать приоритет наиболее ценным целям, поскольку время и вычислительные ресурсы были ограничены, — говорит ведущий автор проекта Николас Паперно (Nicolas Papernot). — Но теперь, после запуска червя, стоимость его использования снижается почти до нуля». Созданный исследователями прототип червя может использовать только известные уязвимости и не может находить неизвестные, как разработанная Anthropic модель Mythos. Однако злоумышленники вполне могли бы адаптировать его для поиска и использования новых уязвимостей — что сделало бы его практически неуязвимым в случае распространения. «Во взаимосвязанном мире ни одна система не застрахована от этой угрозы, — сказал Паперно. — Распространение этих результатов — первый шаг к тому, чтобы побудить исследователей, лидеров отрасли и политиков к действиям — и как можно быстрее». Google одним махом исправила 124 уязвимости в Android — одну из них вовсю использовали хакеры

02.06.2026 [18:08],

Сергей Сурабекянц

Компания Google выпустила июньские обновления безопасности Android за 2026 год, устраняющие 124 уязвимости, включая одну уязвимость нулевого дня, активно используемую злоумышленниками в целенаправленных атаках. CVE-2025-48595 использовалась хакерами для получения доступа к выполнению кода и повышения привилегий на устройствах под управлением Android 14 или более поздних версий.  Вчера Google выпустила сразу два набора обновлений безопасности: от 1 июня 2026 года и от 5 июня 2026 года. Последний включает в себя все исправления из первого набора, а также обновления для закрытых сторонних компонентов и элементов ядра, которые могут не применяться ко всем устройствам Android. Устройства Google Pixel получат эти обновления безопасности немедленно, другим производителям может потребоваться больше времени для тестирования и настройки под конкретные аппаратные конфигурации. Ещё в марте 2025 года Google выявила признаки того, что CVE-2025-48595 «может использоваться в ограниченных, целенаправленных целях». Теперь ошибка исправлена, но компания пока не поделилась техническими подробностями об уязвимости и не предоставила дополнительной информации о реальных атаках, использующих её. Подобные уязвимости ранее использовались коммерческими шпионскими программами и государственными операциями, нацеленными на высокопоставленных лиц. В этом месяце в обновлениях безопасности Android Google также исправила 18 критических уязвимостей в компонентах System, Framework и Qualcomm с закрытым исходным кодом, которые злоумышленники могли использовать для запуска атак типа «отказ в обслуживании» и повышения привилегий на незащищённых устройствах Android. «Наиболее серьёзная из этих проблем — критическая уязвимость безопасности в компоненте Framework, которая может привести к удалённому повышению привилегий без необходимости получения дополнительных прав на выполнение. Для эксплуатации не требуется взаимодействие с пользователем», — прокомментировал представитель Google.

Источник изображения: unsplash.com В декабре 2025 года Google выпустила исправления для двух других уязвимостей нулевого дня высокой степени опасности (CVE-2025-48633 и CVE-2025-48572), а в марте — для ещё одной уязвимости нулевого дня в компоненте дисплея Qualcomm (CVE-2026-21385), все из которых были помечены как «подлежащие ограниченной, целенаправленной эксплуатации». В прошлом месяце Google обновила свои программы поощрения за обнаружение уязвимостей в Android и Chrome, вплоть до вознаграждения в размере $1,5 млн за некоторые особо опасные эксплойты Android, одновременно сократив выплаты за уязвимости, выявленные с помощью искусственного интеллекта. «Использование многих уязвимостей в Android затруднено улучшениями в более новых версиях платформы Android. Мы призываем всех пользователей по возможности обновлять Android до последней версии», — подчеркнул представитель Google. Критические уязвимости обнаружены в 84 % российских мобильных приложений

02.06.2026 [07:15],

Владимир Фетисов

Специалисты компании AppSec Solution подвели итоги ежегодного исследования безопасности мобильных приложений, в котором участвовали более 1,2 популярных продуктов для платформы Android. Приложения тестировались в режиме без доступа к программному коду, но это не помешало исследователям выявить уязвимости критического или высокого уровня в 84 % продуктов.

Источник изображения: Towfiqu barbhuiya / unsplash.com Количество только критических уязвимостей составило 19 тыс. Общее количество уязвимостей подскочило на 68 % с 29,9 тыс. в 2024 году до 48,8 тыс. в 2025 году. Больше всего уязвимостей было обнаружено в приложениях, относящихся к категориям «Игры», «Стриминговые платформы», «Финансы», «Приложения для бизнеса» и «СМИ». Отмечается, что в финансовом секторе количество опасных уязвимостей за последние три года выросло почти в 10 раз и составило 1921 единицу. Такую динамику в AppSec Solution связывают с тем, что банковские приложения интегрируют с другими сервисами, из-за чего увеличивается количество «зашитых» в код бэкдоров и точек небезопасного хранения чувствительных данных. Кроме того, специалисты стали проводить более глубокий анализ, что также способствовало увеличению количества выявляемых проблем. Что касается типов критических уязвимостей, то больше всего проблем связано с небезопасным хранением токенов, ключей и пользовательских данных. Новым источником угроз также стал искусственный интеллект. «С одной стороны, ИИ ускоряет разработку, с другой — кодовая база растёт и потенциальные ошибки накапливаются. ИИ хорошо справляется с написанием работающего кода, но именно безопасный код он умеет писать не всегда, потому что был обучен на примерах, которые сейчас представляют устаревшие или уязвимые практики разработки», — считает глава группы защиты инфраструктуры IT-решений компании «Газинформсервис» Сергей Полунин. По данным пресс-службы ГК «Солар», популярные ИИ-модели пропускают от 40 % до 50 % уязвимостей в коде. Нехватка квалифицированных специалистов только усиливает проблему накопления ошибок в коде, включая критические, т.е. способные провоцировать утечку конфиденциальной и личной информации пользователей. По данным компании, подобные уязвимости выявляются в 75 % приложений. Руководитель продукта AppSec.Sting компании AppSec Solution Никита Пинаев считает, что в 2026 году количество уязвимостей в мобильных приложениях продолжит расти. «Всё больше SDK и облачных интеграций, все больше ИИ-сгенерированного кода, тиражирующего небезопасные паттерны хранения чувствительных данных», — отметил Пинаев. По его мнению, изменить этот тренд можно «только переходом от разовых проверок к системному, риск-ориентированному подходу». Новая статья: Своевременная доставка до последнего байта: как российская сеть Curator CDN совмещает скорость, безопасность и гибкость управления

26.05.2026 [09:02],

3DNews Team

Cisco выяснила, почему безупречные на первый взгляд отчёты ИИ о киберинцидентах нельзя принимать на веру

22.05.2026 [18:39],

Дмитрий Федоров

Команда Cisco Talos Incident Response проверила, насколько точно большие языковые модели (LLM) способны составлять технические отчёты о киберинцидентах. Результаты исследования показали, что внешне безупречные отчёты содержали фактические ошибки, противоречивые выводы и несоответствия.

Источник изображения: KeepCoding / unsplash.com Нейт Порс (Nate Pors), старший руководитель направления реагирования на инциденты в Cisco Talos, описал результаты в корпоративном блоге. Моделям ChatGPT, Claude и Gemini передали сырые заметки с просьбой составить технический отчёт. Все три выдали визуально отполированные документы, однако детальный разбор выявил неточности и нетипичные заключения. По данным Cisco, в основе большинства несоответствий лежит вероятностная природа самих LLM: ИИ-модели генерируют текст, предсказывая следующее слово на основе статистических весов, а не понимания смысла. По словам Порса, LLM искажают отчёты по четырём направлениям. Во-первых, при каждом запросе модель опирается на разные фрагменты данных, из-за чего «сложно полагаться на LLM для получения воспроизводимых и стандартизированных результатов исследования». Во-вторых, одни и те же входные данные приводят к разным выводам: в одном случае ИИ-модель рекомендует принудительную смену паролей во всей организации, а в другом — точечную, причём «часто фиксируется на первой же сгенерированной рекомендации» независимо от её качества. В-третьих, поскольку LLM генерируют текст токен за токеном, при каждом запросе они могут выдавать документы с разной структурой и оформлением, что критично для «профессиональной среды, где стандартизированные шаблоны необходимы для контроля качества». В-четвёртых, когда объём входных данных достигает лимита контекстного окна, ИИ может отбросить информацию, загруженную в начале сеанса, и потерять критически важные сведения, а «засорение контекста» дополнительно ведёт к непредсказуемым или смешанным результатам. Cisco допускает, что проблемы теоретически решаемы — ИИ-моделям можно давать задания на конкретный фрагмент отчёта. Но такой подход сводит на нет выигрыш во времени от использования ИИ. В кибербезопасности цена ошибки особенно высока. Cisco предупреждает, что авторы отчётов обязаны понимать и брать на себя ответственность за каждое слово итогового документа, а рекомендации LLM оказались повторяющимися, нерелевантными или непригодными для практического применения. Microsoft нашла пару уязвимостей нулевого дня в «Безопасности Windows» и рекомендует срочно обновиться

21.05.2026 [16:28],

Дмитрий Федоров

Microsoft устранила две уязвимости нулевого дня в антивирусной защите «Безопасность Windows» (Windows Defender), которые использовались в реальных кибератаках. Компания выпустила обновления Malware Protection Engine и Antimalware Platform. Накануне Агентство по кибербезопасности и защите инфраструктуры США (CISA) внесло обе угрозы в каталог эксплуатируемых уязвимостей (KEV) и обязало федеральные ведомства устранить их до 3 июня.

Источник изображения: microsoft.com Первая уязвимость, CVE-2026-41091, затрагивает Malware Protection Engine версий 1.1.26030.3008 и старше. Этот модуль защиты от вредоносных программ отвечает за сканирование, обнаружение и удаление угроз в антивирусных и антишпионских продуктах Microsoft. Используя уязвимость злоумышленник, получивший локальный доступ к устройству, может обмануть Defender при работе со ссылками на файлы и выполнить действия с правами администратора. Вторая уязвимость, CVE-2026-45498, касается Antimalware Platform версий 4.18.26030.3011 и старше. Этот набор инструментов безопасности также применяется в System Center Endpoint Protection, System Center 2012 R2 Endpoint Protection, System Center 2012 Endpoint Protection и Security Essentials. Её эксплуатация позволяет вызвать отказ в обслуживании (DoS) на необновлённых устройствах под управлением Windows. Microsoft выпустила обновления, закрывающие уязвимости в Microsoft Malware Protection Engine и Microsoft Defender Antimalware Platform: защищёнными считаются версии Malware Protection Engine 1.1.26040.8 и Defender Antimalware Platform 4.18.26040.7 или новее. Компания отметила, что при стандартной конфигурации действия со стороны пользователей обычно не требуются, поскольку антивирусные базы и платформа Defender обновляются автоматически. Тем не менее пользователям и администраторам стоит убедиться, что автообновления Defender включены, и проверить установленные версии Engine и Platform вручную. Для этого необходимо открыть Windows Security, перейти в Virus & threat protection → Protection Updates → Check for updates, затем в Settings → About и сверить номер версии платформы или пакета сигнатур с актуальной. CISA внесло обе уязвимости в KEV и обязало федеральные гражданские ведомства защитить конечные устройства и серверы Windows за две недели — до 3 июня, как предписывает обязательная операционная директива Binding Operational Directive (BOD) 22-01. «Уязвимости такого типа часто становятся вектором атак для злоумышленников и представляют значительную угрозу для федеральных систем», — предупредило агентство. CISA также рекомендовало применить меры противодействия по инструкциям производителя, следовать указаниям BOD 22-01 для облачных сервисов или прекратить использование продукта, если меры противодействия недоступны. Google случайно опубликовала эксплойт для уязвимости Chromium, которую не исправляет уже 29 месяцев

21.05.2026 [06:17],

Дмитрий Федоров

Google выложила в открытый доступ код эксплойта для уязвимости в браузере Chromium, о которой ей сообщили 29 месяцев назад и которая до сих пор не исправлена. Проблема затрагивает миллионы пользователей Chrome, Microsoft Edge и других браузеров на основе Chromium — включая Brave, Opera, Vivaldi и Arc. Браузеры Firefox и Safari уязвимости не подвержены.

Источник изображения: chromium.org Эксплойт использует API фоновой загрузки (Background Fetch) — механизм для скачивания крупных файлов в фоновом режиме. Через него злоумышленник запускает на устройстве жертвы фоновый процесс (сервис-воркер), который остаётся постоянно активным. Соединение инициируется кодом на вредоносном сайте и в зависимости от браузера либо восстанавливается, либо сохраняется даже после перезагрузки устройства. Фактически устройство превращается в часть ограниченного ботнета (сети заражённых устройств): может заходить на вредоносные сайты, выступать анонимным прокси-сервером, участвовать в DDoS-атаках и отслеживать активность пользователя. Эксплойт способен объединить тысячи, а то и миллионы устройств. Лира Ребейн (Lyra Rebane), независимый исследователь, обнаружившая уязвимость и конфиденциально сообщившая о ней в Google в конце 2022 года, заявила, что воспользоваться эксплойтом, по её словам, довольно просто, хотя его масштабирование потребует усилий. Два разработчика Chromium назвали проблему серьёзной уязвимостью с уровнем критичности S1 — вторым по серьёзности. Уязвимость 29 месяцев оставалась неизвестной за пределами команды Chromium. В среду утром она появилась в открытом баг-трекере проекта. Ребейн сначала решила, что проблему устранили, но выяснила: патч не вышел. Google удалила публикацию, однако она вместе с кодом эксплойта по-прежнему доступна на архивных сайтах. Компания не ответила на запрос о причинах и сроках исправления. По словам Ребейн, долгие задержки с патчами — обычное дело, но в этот раз срок оказался рекордным. Она объяснила это тем, что уязвимость не выходит за привычные границы безопасности и не даёт доступа к почте или компьютеру, из-за чего назначенные сотрудники Google не разобрались в проблеме. Обнаружить эксплойт трудно, и неопытный пользователь, скорее всего, спишет это на мелкий баг. По данным внутренних логов, функция фоновой загрузки используется в Chrome минимально — в среднем около 17 файлов на пользователя в день, что, по мнению разработчиков, подтверждает отсутствие масштабной эксплуатации уязвимости. Ребейн сомневается в эксплуатации за пределами Chrome, но рекомендует пользователям Chromium-браузеров обращать внимание на окна загрузок, появляющиеся без причины. Nvidia призвала пользователей срочно обновить старые драйверы GeForce — в них нашли семёрку опасных уязвимостей

20.05.2026 [00:42],

Николай Хижняк

Компания Nvidia выпустила майский бюллетень безопасности, в котором описаны семь новых уязвимостей в драйверах видеокарт и программном обеспечении vGPU. Эти уязвимости варьируются от средней до высокой степени серьёзности. Некоторые из них могут привести к «изменению данных и выполнению кода», отмечает компания.

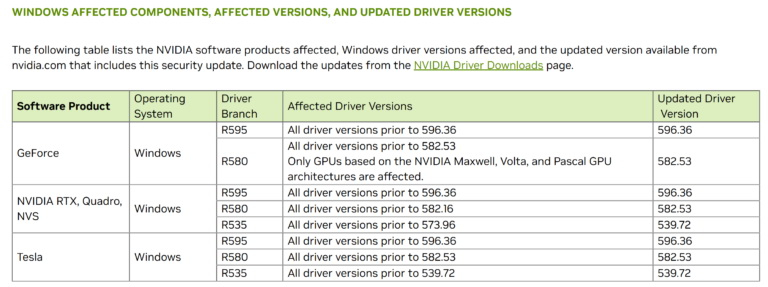

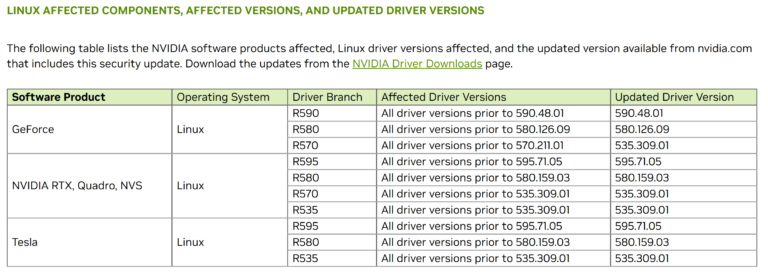

Источник изображения: Overclock3d Уязвимости в драйверах Nvidia затрагивают пользователей видеокарт GeForce, RTX, Quadro, Tesla и NVS в Windows и Linux. Для решения этих проблем Nvidia рекомендует обновить драйверы до последней версии. Ниже приведены официальные рекомендации Nvidia.

Для пользователей Windows следует отметить, что все эти уязвимости устранены в драйвере версии 596.36 и более новых. Последняя публичная версия драйвера — GeForce Game Ready 596.49 — была выпущена 12 мая. «Nvidia выпустила обновление безопасности для драйверов видеокарт Nvidia, чтобы устранить проблемы, описанные в этом бюллетене. Для защиты вашей системы загрузите и установите обновление программного обеспечения через страницу загрузки драйверов Nvidia. Для обновлений программного обеспечения vGPU и Cloud Gaming скачайте его через портал лицензирования Nvidia», — говорится в заявлении компании. Microsoft отказывается от двухфакторной аутентификации по SMS в пользу ключей доступа

19.05.2026 [21:32],

Сергей Сурабекянц

По данным Windows Latest, Microsoft планирует отказаться от SMS-аутентификации для входа в локальные учётные записи, ссылаясь на её уязвимость для эксплуатации и мошенничества. Вместо этого Microsoft предлагает использовать ключи доступа (Passkeys), то есть встроенные средства защиты устройства: Face ID, отпечаток пальца или PIN-код и в конечном итоге отказаться от обычных паролей.

Источник изображения: unsplash.com Текстовые сообщения оказались полезным способом добавить дополнительный уровень безопасности к входам в учётные записи, но они никогда не предназначались для этой цели. SMS-сообщения отправляются в открытом виде, что делает их уязвимым вектором для атак типа «человек посередине» и подмены номера. «Microsoft стремится к повышению стандартов безопасности, и поэтому мы начнём постепенно отказываться от SMS как метода аутентификации и восстановления учётных записей для личных записей Microsoft, — говорится в официальном сообщении Microsoft. — SMS-аутентификация в настоящее время является одним из основных источников мошенничества, и, переходя на беспарольные учётные записи […] мы помогаем вам опережать развивающиеся угрозы, делая доступ к учётным записям проще и удобнее». Passkeys — это более чистый и безопасный способ аутентификации, использующий локальную защиту дополнительного устройства или биометрические данные для подтверждения личности. При настройке пользователь можете использовать своё лицо, отпечаток пальца или локальный пароль/PIN-код. Эта информация никогда не покидает конкретное устройство, что делает практически невозможным её подделку третьей стороной. Хотя метод аутентификации при помощи Passkeys более безопасен, при настройке новых ПК с Windows или временных виртуальных машин могут возникать сложности с вводом биометрических данных. В таких случаях SMS-сообщения кажутся пользователю более удобными, однако это удобство достигается ценой безопасности. В таких случаях предпочтительным методом является использование верифицированной записи электронной почты. Рабочий погиб на площадке SpaceX за несколько дней до запуска Starship — ведётся расследование

19.05.2026 [19:25],

Сергей Сурабекянц

15 мая, всего за несколько дней до первого запланированного запуска модернизированной ракеты Starship на стартовой площадке Starbase компании SpaceX в Южном Техасе погиб рабочий. Обстоятельства смерти пока не ясны. Управление по охране труда и технике безопасности (Occupational Safety and Health Administration, OSHA) начало расследование. OSHA отказалось публиковать дополнительную информацию до завершения расследования, которое может занять несколько месяцев.

Источник изображения: SpaceX По данным OSHA, SpaceX не первый раз сталкивается с проблемами безопасности труда на своей площадке Starbase, где проводятся запуски прототипов Starship и которая является активной строительной зоной. Уровень травматизма на площадке значительно превосходит показатели конкурентов, и она является самой опасной из рабочих площадок SpaceX. Расследование Reuters, проведённое в 2023 году, выявило десятки ранее не зарегистрированных травм, а также гибель рабочего в 2014 году на испытательном полигоне SpaceX в Макгрегоре, штат Техас. В январе OSHA вынесло SpaceX семь «серьёзных» обвинений в нарушении правил безопасности, в том числе за ненадлежащую проверку крана перед его обрушением на Starbase в июне прошлого года. Агентство наложило на SpaceX максимальный финансовый штраф по шести из семи нарушений на общую сумму $115 850, который компания не преминула оспорить. Компания столкнулась с многочисленными судебными исками, связанными с травмами, полученными на Starbase в последние годы. В декабре сотрудник одного из субподрядчиков SpaceX подал в суд после того, как его придавило большим металлическим элементом, упавшим с крана. Рабочий получил переломы бедра, колена и большеберцовой кости, в связи с чем OSHA начало оперативное расследование, которое не дало результатов. Иск был недавно отозван, поскольку условия страхования не предусматривают судебного преследования компании. На этой неделе космическая компания Илона Маска (Elon Musk) должна опубликовать подробный проспект своего первичного публичного размещения акций (IPO), которое, как ожидается, станет крупнейшим в истории. Эксплойт Fabricked тайно ломает аппаратную защиту чипов EPYC со 100-% успехом — AMD уже выпустила патч

19.05.2026 [17:29],

Николай Хижняк

В апреле исследователи из Швейцарской высшей технической школа Цюриха раскрыли программную уязвимость, которая незаметно для пользователя компрометирует аппаратную защиту AMD SEV-SNP для конфиденциальных вычислений на платформах AMD EPYC, предоставляя вредоносному облачному хосту полный доступ для чтения и записи в защищённой памяти виртуальной машины.

Источник изображения: AMD Метод, получивший название Fabricked, использует недостатки процесса обработки шиной Infinity Fabric маршрутизации памяти во время загрузки и может подделывать отчёты о криптографической проверке, на которые пользователи полагаются, чтобы убедиться, что их среда не была взломана. Исследователи представили результаты в рамках документа USENIX Security 2026, описав эксплойт как полностью детерминированный со 100-процентной вероятностью успеха, без необходимости физического доступа и выполнения кода внутри виртуальной машины-жертвы. Конфиденциальные вычисления предназначены для решения фундаментальной проблемы доверия в облачной инфраструктуре: у арендаторов вычислительных мощностей часто нет возможности проверить, что облачный провайдер не имеет доступа к их данным. Технология AMD SEV-SNP решает эту проблему, создавая аппаратно-изолированные конфиденциальные виртуальные машины, в которых память шифруется, а доступ контролируется специальным встроенным процессором безопасности под названием PSP. Чтобы обеспечить защиту SEV-SNP использует структуру под названием Reverse Map Table — таблицу управления доступом для каждой страницы, хранящуюся в памяти, — которую PSP безопасно инициализирует во время загрузки. Аттестация, механизм, с помощью которого арендаторы криптографически проверяют, что их среда является подлинной и нетронутой, зависит от наличия этой цепочки. Эксплоит Fabricked предназначен для обхода этого процесса. Метод основан на компоненте, о котором большинство пользователей никогда не задумываются — Infinity Fabric, внутреннем межчиплетном соединении AMD, которое отвечает за маршрутизацию трафика памяти между ядрами процессора, контроллерами памяти и периферийными устройствами. Поскольку конфигурации платформы различаются в зависимости от аппаратного обеспечения, части Infinity Fabric должны настраиваться во время каждой загрузки с помощью встроенного программного обеспечения материнской платы — UEFI. Согласно собственной модели угроз AMD, этой встроенной программе нельзя явно доверять, поскольку её контролируют облачные провайдеры. Исследователи обнаружили, что UEFI отвечает за выполнение двух вызовов PSP API, которые блокируют регистры конфигурации Infinity Fabric после инициализации. Скомпрометированный UEFI может просто пропустить их, оставив Data Fabric (слой маршрутизации памяти в Infinity Fabric) доступным для записи злоумышленником даже после активации SEV-SNP. После этого эксплойт использует второй, едва заметный недостаток. Исследователи обнаружили, что запросы на доступ к памяти PSP некорректно проверялись на соответствие правилам маршрутизации MMIO (правилам, которые обычно используются для взаимодействия с аппаратными устройствами) до применения стандартных правил маршрутизации DRAM. Настроив эти сопоставления MMIO таким образом, чтобы они затеняли область памяти RMP, злоумышленник может добиться того, что записи инициализации PSP будут игнорироваться. RMP не настраивается должным образом, но SEV-SNP всё равно сообщает об успешной инициализации. В результате платформа считает систему безопасной, хотя на самом деле это не так. При наличии неинициализированной RMP, находящейся под контролем злоумышленника, гипервизор может считывать и записывать данные в произвольную область памяти CVM. Исследователи продемонстрировали два конкретных эксплойта: включение режима отладки на работающей CVM после аттестации, что даёт гипервизору возможность расшифровывать произвольную область памяти виртуальной машины, оставаясь незамеченным для гостевой системы; и массовую подмену отчётов об аттестации, что позволяет использовать вредоносный образ в качестве доверенного. Исследователи подтвердили возможность использования этого эксплойта на процессорах AMD EPYC на Zen 5. В рекомендациях AMD также перечислены обновления встроенного ПО для процессоров Zen 3 и Zen 4, что указывает на наличие уязвимостей в процессорах разных поколений. AMD признала наличие уязвимости после того, как в августе 2025 года исследователи сообщили о ней. Компания присвоила ей идентификатор CVE-2025-54510 и опубликовала рекомендации по обеспечению безопасности в рамках бюллетеня AMD-SB-3034 после снятия эмбарго на публикацию отчёта об уязвимости в апреле 2026 года. Организациям, использующим конфиденциальные вычисления на базе процессоров AMD EPYC, следует уточнить у своего облачного провайдера, установлено ли обновлённое встроенное ПО, закрывающее данную уязвимость. AMD выпустила исправления для платформ Zen 3, Zen 4 и Zen 5. Потребительские компьютеры и системы обычных облачных сервисов, не использующие конфиденциальные вычисления SEV-SNP, не подвержены этой уязвимости. |