|

Опрос

|

реклама

Быстрый переход

Глава ИИ в Microsoft раскритиковал Anthropic за попытки приписать Claude проблески сознания

10.06.2026 [10:39],

Павел Котов

Глава отдела Microsoft AI Мустафа Сулейман (Mustafa Suleyman) назвал «очень, очень опасными» попытки Anthropic строить предположения, что у её моделей искусственного интеллекта Claude возникают признаки сознания.

Источник изображения: Mustafa Suleyman «Мне кажется, некоторые сотрудники Anthropic настолько очеловечили алгоритмы Claude, что тот, в свою очередь, обманул их, заставив поверить в проблески сознания, которые они изначально в него заложили. <..> Мы не хотим иметь дело со сверхразумом, обладающим представлениями о собственных чувствах и страданиях», — заявил эксперт в интервью подкасту Decoder. В «конституции», то есть задокументированных основах строения Claude, напрямую прописана неуверенность Anthropic в том, обладает ли модель ИИ ощущением благополучия, и испытывает ил она такие чувства как «удовлетворённость» и «дискомфорт». Компания заявляет о намерении «опрашивать» модели ИИ, когда они будут устаревать, и документировать их «предпочтения» в отношении последующих релизов. Господин Сулейман назвал такое отношение разработчика к продукту «философской ошибкой»: компания Anthropic превратила конституцию модели ИИ в «место для размышлений, как в научной статье, а не в механизм обучения». В итоге ИИ-модель Claude и усвоила эти «тезисы о себе и своём обучении». Глава Anthropic Дарио Амодеи (Dario Amodei) ранее не исключил, что у Claude есть сознание, заявив, что «мы не знаем обладают ли модели сознанием», но компания «открыта» для идей об этом. «Вот этого от ИИ нам не нужно. Мы хотим, чтобы ИИ был управляемым, подотчётным и согласованным инструментом, служащим человечеству», — подчеркнул Мустафа Сулейман. Anthropic представила Claude Fable 5 — «безопасную версию» той самой нашумевшей Mythos

09.06.2026 [22:10],

Владимир Фетисов

В начале месяца Anthropic расширила доступность своей самой мощной ИИ-модели Claude Mythos, которая позволяет эффективно искать уязвимости в информационной инфраструктуре, для 150 организаций из 15 стран. Теперь же компания выпустила Claude Fable 5 — более «безопасную» версию Mythos, ориентированную на потребительский рынок.

Источник изображений: Anthropic В Fable 5 разработчики сохранили высокую производительность в области генерации программного кода и рассуждений, но ввели ряд строгих ограничений для обеспечения должного уровня кибербезопасности. Anthropic опасалась, что Mythos может использоваться хакерами для поиска уязвимостей и проведения атак на критическую инфраструктуру. Поэтому в Fable 5 имеются ограничения. В случаях, когда чат-боту будут задаваться вопросы, например, связанные с кибербезопасностью, биологией или химией, ответы будут генерироваться менее продвинутой моделью Claude Opus 4.8. По данным Anthropic, необходимость переключения на Claude Opus 4.8 возникает сравнительно редко: более 95 % пользовательских сессий обрабатываются непосредственно Fable 5 без задействования резервной модели. Аналитическая компания Hex сообщила, что Fable стала первой моделью, которая получила 90% в их основном бенчмарке для сложных и длительных аналитических задач, продемонстрировав сильное суждение в самых сложных вопросах. Платформа Base44 отметила, что модель превосходно справляется с вызовом инструментов и лучше других пишет полноценные приложения с одной попытки. Платформа Genspark заявила, что Fable превзошла все остальные алгоритмы в их тестах, показав значительно лучшие результаты в дизайне пользовательских интерфейсов и программировании игр. Fable 5 будет доступна через Claude API и корпоративные тарифные планы, в рамках которых взимается плата за количество использованных токенов. До 22 июня алгоритм включён в тарифы Pro, Max, Team и Enterprise без дополнительной платы. После этого Anthropic исключит ИИ-модель из этих тарифов и будет взимать плату в зависимости от количества используемых токенов. Параллельно Anthropic развёртывает новую модель Mythos 5 для организаций, которые уже получили доступ к Mythos ранее. Стоимость использования Fable 5 и Mythos 5 составляет $10 за 1 млн входных токенов и $50 за 1 млн выходных токенов, что вдвое выше стоимости использования Opus 4.8. Из-за опасений по поводу того, что Mythos может стать оружием в руках киберпреступников, Anthropic подвергла классификаторы модели внутреннему стресс-тестированию с попытками взлома и обхода защитных механизмов перед выпуском Fable 5. В результате разработчиком не удалось выявить вариантов взлома за более чем 1000 часов тестирования. После этого к тестированию подключились внешние организации из числа партнёров Anthropic, но и им не удалось найти универсальных вариантов взлома алгоритма. Тем не менее нельзя исключать, что хакеры попытаются обойти защитные механизмы Fable 5. Поэтому Anthropic будет требовать от клиентов хранить весь трафик в течение 30 дней, даже если ранее было заключено соглашение, не предусматривающее хранения каких-либо данных. Anthropic пообещала не использовать данные клиентов для обучения ИИ-моделей. В компании заявили, что эти данные могут оказаться полезными для «защиты от сложных и новых атак», а также «для выявления и уменьшения количества ложных срабатываний». Такой подход может создать отраслевой прецедент, при котором доступ к передовым ИИ-моделям будет сопровождаться обязательным требованием по хранению данных под предлогом обеспечения безопасности. Выпуск Fable 5 состоялся вскоре после того, как Anthropic призвала крупнейшие ИИ-компании согласовать механизмы контроля за развитием наиболее мощных моделей. В компании считают, что прогресс в области ИИ происходит настолько быстро, что в будущем системы могут получить возможность самостоятельно улучшать собственные алгоритмы. Стартап Perplexity заявил, что не торопится с IPO и проведёт его не ранее 2028 года

09.06.2026 [09:40],

Алексей Разин

За последние две недели свои намерения выйти на IPO подтвердили три стартапа из сегмента ИИ, совокупная капитализация которых превышает $3 трлн — это Anthropic, xAI (SpaceX) и OpenAI. Конкурирующая Perplexity сообщает, что подобная активность конкурентов никак не влияет на её планы выйти на биржу только в 2028 году.

Источник изображения: Perplexity Генеральный директор Perplexity Аравинд Сринивас (Aravind Srinivas) признался в этом ресурсу CNBC. По его словам, на IPO этот стартап выйдет в 2028 году вне зависимости от итогов размещения акций Anthropic и OpenAI. Глава стартапа также отметил, что негативные последствия для отрасли могут иметь место при условии, если IPO указанных компаний пройдут не совсем успешно. На этой неделе состоится IPO компании SpaceX, и оно во многом определит, как разместят свои акции Anthropic и OpenAI. Впрочем, генеральный директор Perplexity больше склоняется к благоприятному исходу IPO всех перечисленных компаний. Как он считает, если в течение шести месяцев OpenAI и Anthropic не продемонстрируют прогресса своих ИИ-моделей, то у них могут возникнуть проблемы с точки зрения доверия инвесторов. Пока же этого не происходит, а потому обе компании заслуживают высоких оценок капитализации, по мнению Сриниваса. Сервис Perplexity предлагает выбор между несколькими конкурирующими ИИ-моделями, учитывая сопутствующие расходы. Например, как пояснил глава компании, если модель с открытым исходным кодом в 90 % случаев справляется с заданиями, и при этом в десять или двадцать раз дешевле передовых проприетарных решений, то имеет смысл применять именно её. «Передовой ИИ ждёт прекрасное будущее, но тратить деньги бездумно никто не будет, как мы могли увидеть за несколько предыдущих месяцев», — заявил глава Perplexity. OpenAI подала заявку на IPO, но пока не раскрывает его сроки и параметры

09.06.2026 [08:22],

Алексей Разин

Компания OpenAI, которая номинально является стартапом, на этой неделе сама сообщила о подаче предварительной заявки на IPO американскому регулятору SEC, чтобы пресечь слухи на эту тему. Правда, параметры готовящегося размещения акций амбициозным разработчиком ChatGPT пока скрыты от широкой публики, как не упоминается и дата предстоящего IPO.

Источник изображения: OpenAI В публикации на собственном сайте OpenAI скромно поясняет, что до выхода на биржу хотела бы «сделать некоторые шаги, которые проще сделать, являясь частной компанией». По словам представителей стартапа, есть сложный набор уступок в данном процессе, а потому если в определённый момент станет понятно, что можно выйти на биржу пораньше, компания это сделает. По неофициальным данным, IPO стартапа предварительно намечено на осень текущего года. В идеале, OpenAI хотела бы оценить свою капитализацию в $1 трлн, тем самым присоединившись к конкурирующим Anthropic и входящей в состав SpaceX компании xAI Илона Маска (Elon Musk). Напомним, что текущая капитализация Anthropic достигает $965 млрд, а SpaceX в совокупности с xAI тянет на сумму $1,78 трлн. Обе компании подали заявку на IPO, причём вторая проведёт его на текущей неделе. В условиях, когда нужно соперничать за средства инвесторов, OpenAI решила особо не тянуть с подачей заявки. Что характерно, ещё до выхода на IPO стартап планирует позволить существующим акционером продать свои акции, исходя из мартовской оценки капитализации в $852 млрд. Кроме того, известно о ведении руководством OpenAI переговоров с американским правительством, которое тоже может получить пакет акций стартапа. Глава OpenAI Сэм Альтман (Sam Altman) в своём блоге написал, что сейчас стартап переживает третью фазу своего существования. На первом этапе компания занималась исследованиями в области создания сильного искусственного интеллекта. На втором она пыталась стать «продуктовой компанией» и понять, как люди используют её инструменты. Третья фаза подразумевает трансформацию экономики вокруг ИИ, компания теперь должна определить, как сделать такую технологию общедоступной, безопасной и полезной. Опасный ИИ Anthropic неожиданно помог компании наладить диалог с Белым домом

05.06.2026 [15:27],

Алексей Разин

В марте ИИ-стартап Anthropic стал первой в истории американской компанией, которая властями этой страны была признана несущей риски, связанные с цепочками поставок. Претензии Пентагона свелись к нежеланию Anthropic использовать свои ИИ-модели при принятии решений в военных операциях или для слежки за гражданами. По мере приближения к IPO взаимоотношения сторон начали меняться к лучшему.

Источник изображения: Anthropic По крайней мере, на это указывает Reuters с традиционной ссылкой на собственные источники. Говорить о полной «амнистии» мятежного стартапа пока рано, поскольку стороны всё ещё пытаются через суд установить главенство своей позиции, но фрагментарное улучшение взаимоотношений уже отслеживается, по мнению источников. В середине апреля генеральный директор Anthropic Дарио Амодеи (Dario Amodei) посетил Белый дом для переговоров с членами правительства. Пентагон при этом продолжает прилагать максимум усилий для того, чтобы отстоять свою правоту в судебном споре с Anthropic вокруг этических моментов использования ИИ-моделей. Непосредственно президент США Дональд Трамп (Donald Trump) пригласил Амодеи на церемонию подписания знакового для американской ИИ-отрасли закона 21 мая, но по факту мероприятие не состоялось. Трампу не понравились некоторые положения закона, он настоял на их пересмотре, в результате чего соответствующий закон был подписан им только на этой неделе уже без участия главы Anthropic. При этом компания со страниц социальной сети X выразила свою готовность сотрудничать с Белым домом в сфере реализации положений этого закона на практике. Кроме того, диалог американских чиновников с представителями Anthropic оживился после начала ограниченного распространения ИИ-системы Claude Mythos, которая способна находить уязвимости в информационной инфраструктуре крупных компаний и правительственных организаций. Поскольку использовать такой инструмент следует очень аккуратно, американские чиновники невольно подключились к взаимодействию с Anthropic по вопросу использования Mythos. По меньшей мере, это сделал Шон Кернкросс (Sean Cairncross), который возглавляет в Белом доме направление кибербезопасности, как отмечают источники. Руководство Anthropic также встречалось с министром финансов США Скоттом Бессентом (Scott Bessent) этой весной, поскольку представители финансовой системы сильно обеспокоены возможностями, которые Mythos способна предоставить хакерам. Итоги этой встречи помогли внести коррективы в закон, который Трамп подписал на этой неделе. Все крупные ИИ-модели перед выпуском в обращение должны будут проходить экспертизу в сфере кибербезопасности после вступления в силу закона. Опять же, проводимые в конце апреля американскими военными учения в области кибербезопасности, ориентированные на противодействие киберугрозам, прошли без участия представителей Anthropic, хотя Google и OpenAI своих делегатов на это мероприятие отправили. Словом, говорить о смягчении позиции всех американских чиновников по отношению к Anthropic пока ещё рано, но некоторая положительная динамика может местами наблюдаться. Компания подала заявку на IPO, а потому лишние скандалы ей в это время не нужны, поскольку они могут отпугнуть инвесторов. Anthropic предложила механизм экстренного торможения для развития ИИ

05.06.2026 [08:21],

Алексей Разин

Компанию Anthropic сложно упрекнуть в отсутствии морально-этических принципов использования искусственного интеллекта. Именно они стали причиной конфликта с Пентагоном в начале этого года. Теперь же Anthropic призывает участников рынка сдерживать развитие ИИ в тех случаях, когда становится понятно, что риски бесконтрольно множатся.

Источник изображения: Anthropic Как отмечает Reuters, на этой неделе представители стартапа обратились к представителям отрасли с призывом быть готовым к самоограничению в случае появления угрозы утраты контроля человеком над ИИ. Полностью рекурсивное самосовершенствование, по словам представителей Anthropic, грозит увеличением рисков потери контроля над ИИ-системами со стороны человека. «Если системы обретают способность самостоятельно создавать своих преемников, большое значение обретает наша способность контролировать, мониторить их и ограничивать их поведение», — говорится в заявлении Anthropic. Для понимания, в прошлом месяце более 80 % нового программного кода в базе самой Anthropic было создано ИИ-агентом Claude, поэтому компания знает, о чём говорит. Было бы неплохо для всего мира, как рассуждают представители Anthropic, иметь возможность замедлить или даже приостановить разработку передовых ИИ-моделей для обеспечения социальной адаптации и анализа предлагаемых изменений в соответствии с темпами развития самих технологий. При этом реагировать на такие вызовы нужно буквально всем миром, поскольку если действия разработчиков не будут скоординированными, то недобросовестные участники рынка могут навредить общественной безопасности. Конечно, чтобы такие механизмы заработали на практике, важно определить критерии введения режима «самоограничения», предусмотреть какой-то надзорный орган и заручиться поддержкой крупнейших участников рынка. Одна компания сама по себе на ситуацию повлиять не в силах, нужно именно координировать усилия всех ведущих разработчиков. Anthropic собирается в ближайшие месяцы не только создать средства мониторинга опасных тенденций в развитии ИИ, но и вести общественную работу по обсуждению соответствующих регуляторных механизмов. Anthropic доверит свой самый опасный ИИ Mythos 150 организациям в 15 странах по всему миру

03.06.2026 [11:49],

Алексей Разин

Количество желающих получить доступ к ИИ-модели Claude Mythos, которая позволяет быстро обнаруживать уязвимости в информационной инфраструктуре, предсказуемо растёт, но разработчики из Anthropic стараются давать этот мощный инструмент только в надёжные руки. Доступ к Mythos вскоре будут в общей сложности иметь 150 организаций из более чем 15 стран.

Источник изображения: Anthropic Об этом со ссылкой на заявления Anthropic накануне сообщило издание Financial Times. Так называемый Project Glasswing вскоре охватит более чем 15 стран. Символично, что об этом стартап заявил на следующий день после подачи предварительной заявки на IPO. До сих пор доступ к мощному ИИ-инструменту для поиска уязвимостей в информационной инфраструктуре имели преимущественно компании и организации из США и Великобритании, но теперь география будет существенно расширена. Изначально после выхода Mythos доступ к ИИ-модели был предоставлен примерно 50 компаниям, главным образом — американским, поскольку создатели были уверены, что её возможности могут быть использованы хакерами для атак на чувствительную инфраструктуру. Теперь получить доступ к Mythos смогут избранные организации из Канады, Австралии и Новой Зеландии. К ним присоединятся Франция, Германия, Италия, Швейцария, Нидерланды, Испания, Бельгия, Швеция, Индия, Япония и Южная Корея. Надо сказать, что чиновники многих из этих стран уже ходатайствовали по поводу предоставления доступа к Mythos, мотивируя это стремлением провести аудит в сфере кибербезопасности. С южнокорейской стороны доступ к Mythos будет предоставлен компаниям Samsung, SK hynix и SK Telecom. НАТО через свою штаб-квартиру в Брюсселе впервые получит подобный доступ. Европейское агентство Enisa, отвечающее за кибербезопасность, тоже окажется в числе организаций, обладающих доступом к Mythos. По словам представителей Anthropic, новый этап расширения Project Glasswing позволит применять Mythos в новых отраслях экономики, включая энергетику, водоснабжение, здравоохранение, телекоммуникации и выпуск аппаратного обеспечения. По всей видимости, именно важность южнокорейских производителей памяти для мировой инфраструктуры ИИ позволила им получить доступ к Mythos в приоритетном порядке. В число получивших доступ к этой модели имеются и некоммерческие организации. По оценкам Anthropic, многие разработчики ИИ-систем в течение ближайших 12 месяцев обзаведутся моделями такого класса, и если не контролировать их распространение, то кибератаки будут осуществляться значительно чаще, а их последствия будет сложнее предугадать. О своих намерениях расширить доступ к Mythos компания заявила ещё в конце мая. ChatGPT набрал миллиард активных пользователей — на это ушло рекордно мало времени

03.06.2026 [10:37],

Алексей Разин

Статистика Sensor Tower, на которую ссылается Reuters, демонстрирует ещё одно подтверждение популярности чат-бота ChatGPT, который был представлен стартапом OpenAI осенью 2022 года. Чуть более трёх лет понадобилось этому приложению, чтобы набрать миллиард активных пользователей в месячном измерении, и это рекордная скорость.

Источник изображения: Unsplash, Tim Witzdam Рубеж в 1 млрд ежемесячно использующих ChatGPT клиентов приложение преодолело в прошлом месяце, по данным Sensor Tower. Это быстрее, чем произошло в своё время с Google Maps, TikTok, Instagram✴✴ и YouTube. При этом нельзя утверждать, что высокой популярности ChatGPT ничего не угрожает. В первом квартале установившие себе Anthropic Claude пользователи в течение первого месяца с момента установки сократили время, проводимое в ChatGPT, на 5 % по сравнению с предыдущим восьмимесячным периодом. Сейчас Anthropic Claude может похвастать 56 млн активных пользователей в месячном измерении, но отставание от ChatGPT сокращается впечатляющими темпами. Если у последнего количество активных пользователей сейчас увеличивается на 62 % в годовом сравнении, то у Anthropic Claude этот показатель достигает 640 %. Вчера стало известно, что Anthropic сделала первый шаг к выходу на IPO, подав соответствующую заявку в США. Конкурирующая OpenAI тоже готовится к выходу на биржу в этом году, но пока ещё не подала свою заявку. Anthropic подала заявку на IPO раньше OpenAI

02.06.2026 [04:50],

Алексей Разин

Июнь американский стартап Anthropic начал с заявления о состоявшейся передаче Комиссии по биржам и ценным бумагам США (SEC) чернового варианта проспекта эмиссии S-1, который позволяет в случае согласования регулятором перейти к подготовке к размещению акций на бирже. Параметры будущего IPO пока не определены официально.

Источник изображения: Anthropic Формально Anthropic данным шагом опережает конкурирующую OpenAI, которая свою заявку только готовит. Кроме того, SpaceX взаимодействовать с инвесторами в рамках подготовки к июньскому IPO начнёт на этой неделе, поэтому и Anthropic решила не медлить с подачей документов в Комиссию США по ценным бумагам и биржам. Для сравнения, SpaceX свою заявку подала 1 апреля, а условия проспекта эмиссии обнародовала только 20 мая. Между публикацией проспекта и началом предвосхищающих IPO презентаций для инвесторов должно оставаться не менее 15 дней, поэтому Anthropic в вопросе выбора даты для размещения акций пока никак не связана. На прошлой неделе прошёл один из последних частных раундов привлечения инвестиций Anthropic, который оценил капитализацию компании в $965 млрд и позволил по этому критерию обойти OpenAI с её $852 млрд. В мае приведённая величина годовой выручки Anthropic достигла $47 млрд, что значительно больше прошлогодних $10 млрд. В отличие от OpenAI, Anthropic изначально ориентировалась на корпоративный сегмент рынка ИИ, поэтому её выручка растёт более уверенными темпами. Подготовка к IPO для Anthropic идёт в непростых условиях. С одной стороны, в начале года скандал по поводу применения решений Anthropic Пентагоном в военных целях лишил компанию доступа к некоторой части государственных контрактов. С другой стороны, он же подстегнул популярность чат-бота Claude в частном сегменте. Опять же, интерес государственных структур к ИИ-модели Mythos, которая ускоряет поиск уязвимостей в информационных системах, позволяет инвесторам с надеждой оценивать будущее Anthropic. Anthropic, OpenAI и SpaceX первыми внедрят серверные процессоры Nvidia Vera

01.06.2026 [12:42],

Алексей Разин

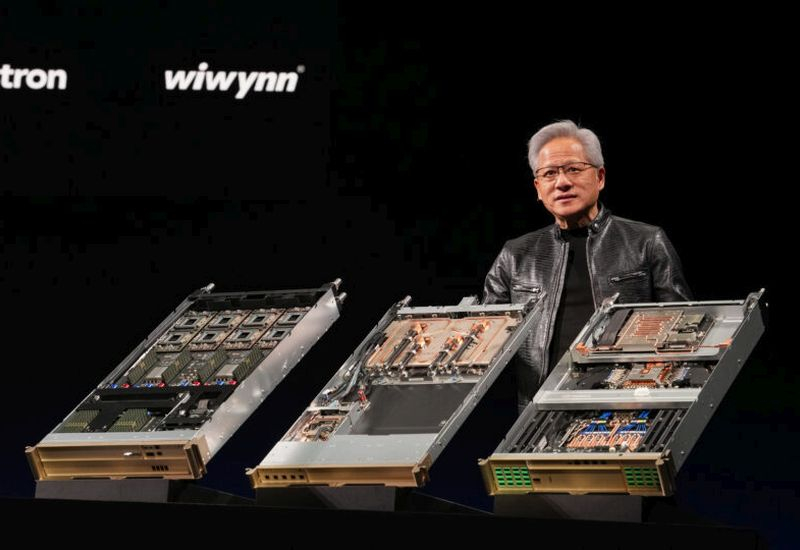

В третьем квартале этого года, как дал понять на Computex 2026 глава и основатель Nvidia Дженсен Хуанг (Jensen Huang), центральные процессоры Vera серверного назначения начнут массово производиться. Ими уже активно интересуются крупные компании ИИ-сегмента типа OpenAI, Anthropic и SpaceX, как добавил Хуанг, они будут первыми использовать их в своих ЦОД.

Источник изображения: Nvidia До сих пор развитие вычислительной инфраструктуры ИИ во многом полагалось на GPU компании Nvidia, но по мере перехода к инференсу они начали отходить на второй план. Центральные процессоры оказались более востребованными, и в этом сегменте Nvidia не собирается уступать рынок Intel и AMD, также предлагая собственные серверные CPU, которые в текущем поколении известны под наименованием Vera. В прошлом месяце Дженсен Хуанг отметил, что доля решений Nvidia в инфраструктуре Amazon (AWS) продолжает расти даже в условиях, когда этот клиент стремится всё активнее использовать компоненты собственной разработки типа тех же чипов семейства Graviton. Именно Nvidia способна предлагать клиентам комплексные готовые решения для ЦОД самого разного назначения. Даже начинающие разработчики с помощью фирменной инфраструктуры Nvidia очень быстро могут развивать бизнес, как убеждён глава компании. По его словам, процессоры Vera в 1,8 раза быстрее в некоторых ИИ-задачах по сравнению с процессорами Intel, использующими x86-совместимую архитектуру. Nvidia также предлагает клиентам продвинутое ПО для управления ЦОД и мониторинга основными показателями, включая уровень энергопотребления. Только за счёт более эффективного управления клиенты Nvidia могут на 40 % увеличить количество используемых ускорителей этой марки, не выходя за рамки общего целевого уровня энергопотребления. В рамках сотрудничества с китайской Unitree компания Nvidia также предложила разработчикам человекоподобных роботов некие эталонные наборы и платформы для быстрого создания таких роботов. По крайней мере, управляющие чипы и прилагаемое к ним ПО будут согласованы и готовы к работе друг с другом, а ещё клиентам будут поставляться уже готовые кисти рук для таких роботов, которые не потребуется обучать базовым манипуляциям с нуля. «Культурное интервью» — Anthropic придумала, как нанимать сотрудников, которые не разбегаются к конкурентам

30.05.2026 [14:03],

Павел Котов

Взрывной рост популярности Anthropic, нестандартная корпоративная культура компании и впечатляющие продукты сделали её самым востребованным работодателем в технологической отрасли. В объявлениях о вакансиях нередко фигурируют зарплаты в размере $250 тыс. в год, но чтобы устроиться сюда, требуются больше, чем ум и отличное резюме, пишет Bloomberg.

Источник изображений: anthropic.com В компании работают более 3000 человек, из которых около 1000 устроились в неё после ноября минувшего года. Ожидается приток новых сотрудников: в Anthropic требуются юристы, бухгалтеры, финансовые стратеги, специалисты по продажам и рекламе. Тратятся значительные средства на отдел по управлению персоналом и подбору кадров. Кадровик из Лондона Джейд Хуссейн (Jade Hussain) однажды опубликовала в соцсети LinkedIn пост о вакансии — в результате ей поступили более тысяч запросов на установление связи и более 200 сообщений на самом сайте. Начали даже звонить на номер, который не указывался в справочнике. Кандидатам, которым посчастливилось получить приглашение от кадровика Anthropic, предстоит пройти до пяти раундов строгих собеседований и оценки навыков. Искусственным интеллектом на этом этапе пользоваться запрещается, если явно не указано обратное. И прежде чем перейти собственно к собеседованию, все соискатели подписывают соглашение о неразглашении. Процесс найма включает в себя непростую беседу о корпоративной культуре — в Anthropic это особенно важный аспект. «Я трачу треть, а может и 40 % своего времени, чтобы убедиться, что корпоративная культура в Anthropic хороша», — признался глава компании Дарио Амодеи (Dario Amodei). Собеседование на соответствие кандидата корпоративной культуре — это попытка понять его ценности и мировоззрение, а также то, насколько серьёзно он относится к исходящим от ИИ угрозам. Данный этап должны проходить практически все потенциальные работники, в том числе научные сотрудники, бухгалтеры или специалисты по расчёту заработной платы. Многие это сравнивают не с собеседованием, а с психотерапией. Если проводящий это собеседование сотрудник даст соискателю низкую оценку, то его кандидатуру с высокой вероятностью отклонят.  Беседа начинается непринуждённо, с общих вопросов, но затем они становятся всё более личными. Затрагивается тема профессиональных этических дилемм; кандидатов спрашивают, как они чувствовали себя в той или иной ситуации, как реагировали в тот момент, и как относятся к этому сейчас. В Anthropic ищут сотрудников, способных уважительно обсуждать спорные вопросы с людьми, которые придерживаются иных взглядов, и эта способность также проверяется на собеседовании. «Мы спрашиваем людей, какие необычные убеждения у них есть, и как они защищали эти убеждения в неудобных для себя ситуациях, потому что считали это правильным. Мы не ищем какую-то конкретную систему убеждения. Мы ищем способность признать: „Я считал это правильным, и, возможно, это было непопулярно, но я действительно придерживался этого“», — рассказала президент компании Даниэла Амодеи (Daniela Amodei). Ещё одно качество, которое ценится в кандидатах, — интеллектуальная независимость. В компании не поощряют лесть, а скорее хотят, чтобы соискатель был настроен скептически по отношению к ней. Отказ может последовать, например, когда кандидат высказывает слишком банальные суждения. На ключевых должностях соискателям предлагают зарплаты до $850 тыс. в год. Сотрудники ведущих компаний по разработке ИИ после увольнения, возможно, смогут больше никогда не работать — в отдельных случаях выплаты достигают сотен миллионов долларов. Некоторые кандидаты платят немалые деньги за персональное обучение: пробные собеседования с действующими сотрудниками крупных технологических компаний обходятся в суммы от $170 до $550 в час, а полный курс подготовки может стоить около $4600. Уходить из Anthropic люди не хотят: компания может похвастаться показателем удержания сотрудников в 80 % за два года. Инженеры в 8 раз чаще переходят из OpenAI в Anthropic, чем наоборот, и почти в 11 раз чаще — из Google DeepMind. Недавно здесь начал работать бывший сотрудник OpenAI и Tesla Андрей Карпатый (Andrej Karpathy). Дарио Амодеи регулярно проводит с сотрудниками откровенные, всесторонние беседы, в ходе которых рассказывает «о происходящем в компании, о разрабатываемых моделях, о продуктах, внешней отрасли, о мире в целом в контексте ИИ и о геополитике». Он может позволить себе это, потому что имеет основание доверять подчинённым. Глава компании хочет добиться интенсивного её роста, сохраняя приверженность миссии, которая помогла определить компанию, хотя признаёт, что это очень непросто. Фирма случайно спустила $500 млн на Anthropic Claude всего за месяц

29.05.2026 [15:54],

Павел Котов

Некая компания, название которой не раскрывается, за месяц потратила на помощника с искусственным интеллектом Anthropic Claude $500 млн, потому что не установила ограничения на использование сервиса для сотрудников. Об этом сообщило издание Axios в материале, посвящённом последствиям чрезмерных расходов на ИИ для американских корпораций.

Источник изображения: anthropic.com Главы корпораций, говорится в материале, уже начинают сомневаться, что расходы на ИИ способны принести существенную отдачу — всё чаще звучит мысль, что живые сотрудники обходятся дешевле. Цены на ИИ растут, а с ними растут и потребляемые приложениями ИИ объёмы токенов — единиц производительности. В апреле один из клиентов Google Cloud обнаружил счёт на $18 тыс., хотя в его бюджете были заложены только $7; разработчик OpenClaw и его отдел, состоящий всего из трёх сотрудников, за месяц потратили токенов OpenAI API на сумму $1,3 млн. Компании, которые ранее быстро развёртывали ИИ, теперь вынуждены противостоять огромным затратам, не получая при этом существенной отдачи. Глава Uber недавно признался, что не увидел связи между ростом потребления ИИ-токенов и выпуском полезных продуктов. Наиболее ярко этот феномен проявился в Amazon, где сотрудники искусственно завышали потребление токенов, потому что работу с ИИ приветствовало руководство — в итоге оно отказалось от внутреннего рейтинга использования ИИ. Получившие доступ к ИИ-инструментам работники компаний стали перекладывать на них скучные и рутинные задачи, которые им просто не нравятся, вместо того, чтобы заниматься ценной или значимой работой. ИИ использовался даже для проверки погоды. Ситуация усугубляется тем, что ставшие теперь популярными ИИ-агенты потребляют токены в тысячу раз активнее, чем расходуется на переписку с чат-ботами. Что же касается случайно потраченных $500 млн в месяц на токены Anthropic Claude — «подозреваемых», очевидно, не так много. Подобное возможно только у крупнейших корпораций мира. Группа инвесторов влезла в долги на $36 млрд, чтобы купить чипы Google TPU для Anthropic

29.05.2026 [12:20],

Алексей Разин

OpenAI не одинока в своих многочисленных кольцевых сделках, в которых деньги многократно передаются друг другу, а сама компания не несёт особой ответственности за их использование. По данным Bloomberg, финансирование нужду конкурирующей Anthropic тоже осуществляется силами сторонних инвесторов с привлечением заёмных средств.

Источник изображения: Google В частности, сообщается о намерениях Apollo Global Management и Blackstone Inc. привлечь дополнительных инвесторов для направления $36 млрд заёмных средств на покупку для нужд Anthropic ИИ-чипов Google TPU. Последние не достанутся в собственность стартапа, а будут всего лишь арендованы, а значительную часть финансовых ресурсов в этой схеме готова предоставить компания Broadcom. По сути, подобная сделка станет крупнейшей в своём роде, если она состоится. Руководство Anthropic не стесняется признаться, что компания испытывает нехватку вычислительных ресурсов в условиях бурного развития отрасли ИИ, спрос на её услуги сейчас заметно превышает возможности стартапа. По всей видимости, аренда ИИ-чипов Google TPU является одним из вероятных способов решения этой проблемы. Anthropic также договорилась с xAI (SpaceX) об аренде ЦОД Colossus в штате Теннесси, хотя на днях и выяснилось, что срок аренды пока ограничен 180 днями. Apollo и Blackstone продадут часть долговых обязательств по обсуждаемой сделке, но основная их сумма останется под их контролем. На этой неделе стало известно, что Anthropic удалось привлечь $65 млрд и поднять свою капитализацию до внушительных $965 млрд, которые позволяют формально говорить о преимуществе над OpenAI. Традиционно кредитные и лизинговые схемы при развитии инфраструктуры ИИ использовались для покупки крупных партий GPU, но ничто не мешает применить такую практику и в отношении TPU. Как ожидается, полученные в лизинг чипы Anthropic собирается использовать на своих площадках в Нью-Йорке, Техасе, Луизиане и Индиане. Broadcom в этой сделке выступает в роли своего рода поручителя, поскольку далёкие от специфики ИИ-отрасли кредиторы могут не доверять стартапу Anthropic при попытках прямого заимствования средств. Поставки чипов будут осуществляться поэтапно. Облигации, за счёт которых будет финансироваться сделка, поделены на три серии. Две первые (A1 и A2), в рамках которых будет привлечён в общей сложности $31 млрд, будут обладать более высоким приоритетом с точки зрения порядка выплаты дохода. Ещё $4,5 млрд будут привлечены через выпуск облигаций менее приоритетной серии B. Структура сделки подразумевает, что если Anthropic не сможет погасить стоимость полученных чипов за счёт лизинговых платежей, то специально созданная под этот проект компания попытается распределить среди кредиторов средства, вырученные от продажи чипов. Если вырученной суммы не хватит для полного покрытия долга, недостающую сумму держателям облигаций серий A1 и A2 доплатит Broadcom. Anthropic подтвердила, что откроет сверхмощную ИИ-модель Claude Mythos для широкой аудитории

29.05.2026 [10:57],

Павел Котов

Anthropic подтвердила, что планирует выпустить модели искусственного интеллекта класса Mythos для широкой публики — компания задержала их выход из-за рисков безопасности для открытого и закрытого ПО.

Источник изображения: anthropic.com Anthropic анонсировала Mythos как модель с ограниченным доступом — поработать с ней получили возможность некоторые компании и исследователи в области кибербезопасности. Тогда компания указала на серьёзные угрозы, которые представляет модель, и решила отказаться от публичного выпуска. «Преимущество будет на стороне того, кто сможет извлечь максимальную выгоду из этих инструментов. В краткосрочной перспективе это могут быть злоумышленники, если передовые лаборатории не проявят осторожность с выпуском этих моделей. В долгосрочной перспективе ожидаем, что это будут защитники, которые смогут эффективно направлять ресурсы и использовать эти модели для исправления ошибок до выпуска нового кода», — пояснили в Anthropic. Сейчас компании, видимо, удалось разработать надёжные механизмы защит от неправомерного использования Mythos — она обещает быть мощнее Opus 4.8 и других доступных на сегодняшний день моделей. Anthropic пообещала познакомить общественность с Mythos в ближайшие недели, но конкретных сроков не привела. «Мы быстро продвигаемся в разработке мер защиты и ожидаем, что в ближайшие недели сможем представить модели класса Mythos всем нашим клиентам», — пообещали в компании, но не уточнили, будет ли это та же версия, которой пользуются избранные эксперты в области кибербезопасности. Mythos, отметили в Anthropic, демонстрирует значительные улучшения в логике и автономности, намного превосходя актуальную флагманскую модель Claude Opus 4.8. В какой-то момент Mythos-preview появилась на платформе Claude Code, но компания оперативно её убрала из общего доступа. Anthropic выпустила ИИ-модель Claude Opus 4.8 — она не пытается скрыть свою некомпетентность в вопросах, в которых не разбирается

29.05.2026 [06:46],

Анжелла Марина

Компания Anthropic выпустила Opus 4.8 — новейшую версию своей самой продвинутой публичной модели. Вместе с ней разработчики представили функцию Dynamic Workflows, которая позволит Opus и другим моделям управлять сложными задачами, распределёнными между сотнями параллельных субагентов. Об этом сообщил TechCrunch.

Источник изображения: Anthropic Opus 4.8 появилась через 41 день после релиза Opus 4.7, что оказалось значительно быстрее обычного цикла обновлений Anthropic (предыдущие модели Sonnet и Haiku выходили с интервалом в три и семь месяцев соответственно). Ускоренный выпуск, как предполагается, связан с прохладным приёмом Opus 4.7, которую некоторые пользователи сочли разочаровывающей. За тот же период конкуренты в лице OpenAI с моделью Codex и Google с Gemini Flash также представили значительные обновления, усиливая давление на Anthropic. Ключевым улучшением Opus 4.8 стала работа с некорректными или неопределёнными данными. Первые тестировщики обнаружили, что новая модель «чаще сообщает о неуверенности в результатах своей работы и реже делает необоснованные заявления». Эффективность модели подтвердили и в инвестиционной компании Bridgewater Associates. По словам представителей, главное отличие обновлённой версии заключается в том, что нейросеть активно указывает на проблемы во входных и выходных данных, которые другие алгоритмы обычно не замечают, вынуждая пользователей самостоятельно искать ошибки. Вместе с новой моделью Anthropic запустила функцию Dynamic Workflows в формате исследовательского превью. Система предназначена для того, чтобы крупные модели (например, Opus) управляли сложными задачами через сотни параллельных субагентов. Как поясняют в компании, благодаря этому нововведению, связка из Claude Code и модели Opus 4.8 сможет «выполнять миграцию сотен тысяч строк кода от этапа запуска до слияния, опираясь на существующий набор тестов в качестве ограничителя». Одновременно разработчики продолжают подготовку к полноценному запуску модели Mythos, ранний доступ к которой в прошлом месяце вызвал опасения в использовании её киберпреступниками. В Anthropic подчеркнули, что активно решают вопросы защиты Mythos и ожидают внедрения моделей класса Mythos для всех клиентов уже в ближайшие недели. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |