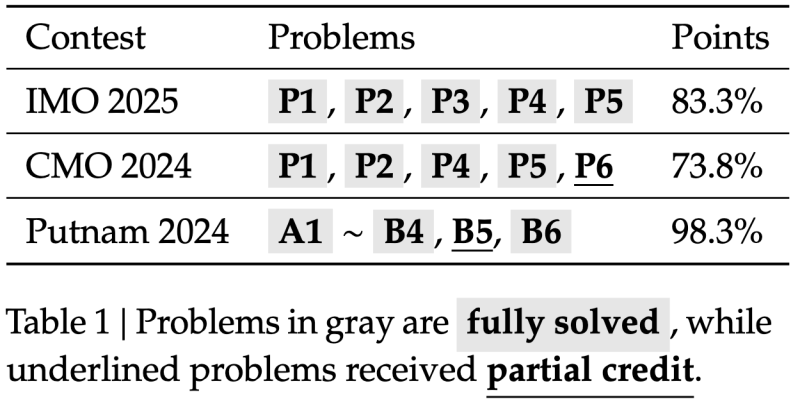

Китайский стартап DeepSeek представил новую ИИ-модель DeepseekMath-V2, которая показывает впечатляющие результаты при решении сложных математических задач. Алгоритм справился с многими заданиями Международной математической олимпиады (IMO 2025) и Китайской математической олимпиады (CMO 2024), показав при этом результат на уровене золотой медали.

Источник изображений: the-decoder.com

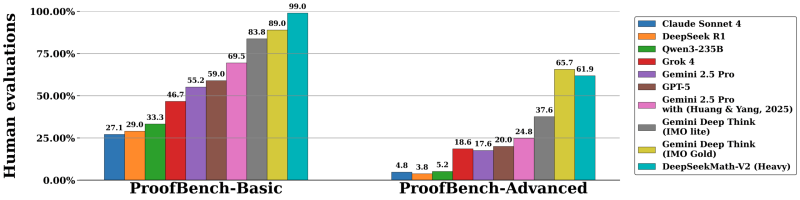

В сообщении сказано, что DeepseekMath-V2 набрала 118 из 120 баллов в задачах Putnam, что существенно выше лучшего результата человека в 90 баллов. DeepSeek отмечает, что ранее ИИ-модели часто выдавали верные ответы в сложных математических задачах, но при этом не показывали правильного хода решения. Для исправления ситуации ИИ-модель задействует многоэтапный процесс с отдельным верификатором для оценки корректности шагов решения задачи и необходимости их перепроверки. Такая структура позволяет алгоритму проверять и совершенствовать свои решения в режиме реального времени.

С технической стороны DeepseekMath-V2 построена на основе базовой модели Deepseek-V3.2-Exp-Base. В описании DeepSeek ни разу не упоминается использование внешних инструментов, таких как калькуляторы или интерпретаторы кода. В ключевых экспериментах одна и та же модель DeepseekMath-V2 используется как для генерации доказательств, так и для их проверки. Высокая производительность алгоритма обусловлена способностью подвергать критике и улучшать собственные выводы вместо того, чтобы задействовать внешнее программное обеспечение. Для решения более сложных задач модель наращивает вычислительные мощности на этапе тестирования, параллельно создавая и проверяя множество возможных доказательств, чтобы повысить уровень уверенности в правильности конечного ответа.

Релиз DeepSeek последовал за анонсом ещё не выпущенных ИИ-моделей OpenAI и Google Deepmind, которые достигли схожих результатов в решении сложных математических задач. Примечательно, что эти алгоритмы достигли такого результата за счёт способности к рассуждению, а не целевой оптимизации для математических олимпиад. Если на деле успехи этих алгоритмов действительно окажутся столь впечатляющими, то это будет означать, что языковые модели приблизились к моменту, когда они смогут решать сложные, абстрактные задачи, что традиционно считалось исключительно человеческим навыком.

Отметим, что решение DeepSeek раскрыть технические детали модели DeepseekMath-V2 резко контрастирует с секретностью, которую соблюдают Google и OpenAI. Американские компании держат в тайне подробности об архитектуре собственных ИИ-моделей, тогда как китайский стартап буквально раскрывает все карты, наглядно показывая, что компания идёт вровень с ведущими отраслевыми представителями.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018