|

Опрос

|

реклама

Быстрый переход

Google начала экспериментировать с показом результатов поиска в Chrome сразу в режиме ИИ

05.06.2026 [18:30],

Сергей Сурабекянц

Похоже, что Google рассматривает идею показа результатов поисковых запросов сразу в режиме ИИ вместо отображения классических ссылок. В Chrome Canary, экспериментальном варианте браузера, предназначенном для разработчиков и бета-тестеров, обнаружена настройка, которая по умолчанию переводит поиск в режим ИИ. Отмечается, что тестовая функция полностью работоспособна и выглядит готовой к выпуску.

Источник изображения: unsplash.com В настоящее время при выполнении поисковых запросов в обычном Chrome пользователь попадает на страницу «Все», которая включает ИИ-обзор с кратким описанием полученных результатов, за которым следуют классические ссылки. Для использования режима ИИ нужно специально выбрать его, нажав клавишу Tab. Но в экспериментальной версии Chrome Canary, если активирована соответствующая настройка, пользователь сразу попадает в режим ИИ, который больше похож на диалог с чат-ботом, чем на обычную страницу результатов поиска Google. Google публично не объявляла о тестировании такой функции, но в последнее время она всё больше внедряет инструменты ИИ в свои продукты. На конференции I/O 2026 компания представила новую «интеллектуальную поисковую строку», которая может принимать в качестве входных данных для поисковых запросов видео, изображения, файлы и даже вкладки Chrome. После этого анонса поисковик DuckDuckGo пережил всплеск установок, скорее всего, со стороны людей, ищущих альтернативы принудительному внедрению ИИ. Для тестирования экспериментальной функции в последней версии Chrome Canary следует набрать в адресной строке chrome://flags и включить опцию «Выполнять запросы поисковой строки в режиме ИИ». В описании функции сказано, что она будет работать на Windows, macOS, Linux и Chrome OS. Представитель Google заявил, что у компании пока нет конкретных планов по внедрению опции включения ИИ-поиска в ближайшее время: «Это всего лишь для ознакомления. В настоящее время планов по внедрению этой возможности в рабочую среду нет». Следующая ИИ-модель OpenAI разрабатывается другой ИИ-моделью — сверхинтеллект близок как никогда

05.06.2026 [18:29],

Николай Хижняк

Следующая ИИ-модель OpenAI разрабатывается другой ИИ-моделью, что свидетельствует о том, что ИИ может совсем скоро достигнуть уровня искусственного сверхинтеллекта. Об этом в интервью CNBC заявил генеральный директор SoftBank Масаёси Сон (Masayoshi Son). Его комментарий прозвучал на фоне предупреждения компании Anthropic о том, что разработку ИИ, возможно, придётся замедлить, чтобы справиться с последствиями быстрого темпа совершенствования технологии.

Источник изображения: Bleeping Computer SoftBank является одним из крупнейших акционеров OpenAI. В интервью CNBC Масаёси Сон сообщил, что разговаривал с генеральным директором OpenAI Сэмом Альтманом (Sam Altman) и инженерами компании, которые рассказали ему, что будущую модель ИИ «разрабатывает» другая ИИ-модель. «То же самое [в перспективе] произойдет со всеми другими основными моделями. Как только это произойдёт, ИИ-модель сгенерирует следующую ИИ-модель. Она будет экспоненциально умнее всех нас. Это сверхинтеллект», — сказал Сон, добавив, что компетенций инженеров уже будет недостаточно для того, чтобы разрабатывать последующие модели. В OpenAI отказались комментировать текущие разработки, но подчеркнули области, где компания уже использует ИИ в разработке моделей. В феврале OpenAI заявила, что её GPT-5.3-Codex — это «первая модель, которая сыграла важную роль в своём собственном создании». Команда, стоящая за Codex, ИИ-моделью для программирования, «использовала ранние версии для отладки её собственного обучения, управления развёртыванием, диагностики результатов тестирования и оценок». Масаёси Сон двумя годами ранее в рамках широкой дискуссии об искусственном сверхинтеллекте (Artificial Super Intelligence, ASI) заявлял, что такой ИИ будет в 10 000 раз умнее человека. Он прогнозировал, что ASI появится в течение десяти лет. Однако на этой неделе он заявил, что в своих прошлых оценках он «старался быть консервативным, потому что люди могут быть шокированы». «В моём представлении это должно было произойти через четыре года, а не через десять. Теперь я говорю, что это произойдёт в ближайшие два года», — сказал Сон в новом интервью. Генеральный директор SoftBank заявил, что в настоящее время он использует ChatGPT от OpenAI два–три часа в день, поскольку ИИ умнее его в «большинстве областей». В ближайшие пару лет ИИ станут умнее человека примерно в 70–80 % областей, а в тех областях, где он превзойдёт человеческий интеллект, он «может быть в 10 раз умнее среднестатистического человека», считает Сон. Сон уже несколько лет оптимистично оценивает перспективы ИИ. Он вывел SoftBank в центр этого бума благодаря владению компанией Arm, занимающейся разработкой микросхем, доле в OpenAI, а также инвестициям в такие области, как робототехника и автономное вождение. Он считает, что революция в области ИИ в 50 раз масштабнее, чем революция доткомов в 2000-х годах. Риски интеграции сверхумных систем искусственного интеллекта привлекли внимание после того, как компания Anthropic опубликовала в своём блоге сообщение о «рекурсивном самосовершенствовании» (RSI) — тенденции, при которой система ИИ «способна полностью автономно проектировать и разрабатывать своего собственного преемника». Хотя Anthropic заявила о плюсах такой возможности, она также предупредила, что «полное рекурсивное самосовершенствование также может увеличить риск потери контроля над системами ИИ со стороны людей». Компания, разрабатывающая чат-бота ИИ Claude, заявила, что скоординированные усилия лабораторий ИИ по замедлению развития этой технологии «вероятно, пойдут на пользу». В своём заявлении Сон не уточнил, имеет ли он ввиду RSI, говоря о новых ИИ-моделях OpenAI. Однако в опубликованной в этом месяце исследовательской работе OpenAI говорится о «ранних признаках» RSI в современных системах. «Мы ожидаем, что это усилит конкурентное давление среди разработчиков и стран, а также создаст проблемы управления, с которыми существующие институты не в состоянии справиться. По мере развития RSI обществу понадобятся способы формирования траектории развития ИИ и обеспечения того, чтобы он служил интересам человечества», — говорится в этой работе. «Сбер» переведёт обучение ИИ на фотонику — представлен первый в России оптический чип

05.06.2026 [10:03],

Геннадий Детинич

«Сбер» представил на ПМЭФ-2026 первый в России универсальный оптический вычислитель для задач искусственного интеллекта. Устройство построено на операциях со светом (фотонами), а не на использовании электронов (импульсов тока). Это собственная разработка инженеров «Сбербанка», которая позволит снизить энергопотребление ИИ-платформ и повысить их производительность.

Источник изображения: ИИ-генерация ChatGPT/3DNews О разработке сообщил старший вице-президент, руководитель блока «Технологическое развитие» «Сбера» Андрей Белевцев. «В задачах ИИ устройства фотоники обеспечат принципиально новый уровень скорости и энергоэффективности. Уже первый прототип способен выполнять более 1 млрд операций матричного умножения в секунду, и мы видим путь к увеличению частоты оптических операций до 10 ГГц и более. Само умножение в оптике происходит за доли наносекунды; при этом энергопотребление оптического ядра более чем на 30 % ниже электронных аналогов», — приводит слова менеджера ТАСС. Матричное умножение — одна из базовых операций в работе современных нейросетей. Именно матрицы и тензорные вычисления занимают значительную долю нагрузки при обучении и работе больших моделей ИИ. Если оптический чип будет выполнять такие задачи, это позволит кратно снизить энергопотребление платформ на фоне роста их производительности. Вероятно, пока речь идёт о прототипе, а не о готовой массовой замене графических и центральных процессоров и ускорителей. Нет никакой публично доступной информации о размерах матриц, точности вычислений, техпроцессе, используемых материалах и технологиях, а также о сравнительных тестах фотонной платформы «Сбера» с классическими решениями. Также ставка делается на то, что, по словам Белевцева, оптическое производство проще локализовать, чем электронное. 7 из 10 американцев не хотят видеть дата-центры рядом с домом — ещё девять месяцев назад таких было лишь 42 %

04.06.2026 [17:55],

Сергей Сурабекянц

Количество американцев, выступающих против строительства центров обработки данных (ЦОД) для искусственного интеллекта рядом со своими домами выросло с 42 % до 71 % всего за девять месяцев. На отношение жителей к дата-центрам повлияли нехватка воды, растущие счета за электроэнергию и невыполненные обещания крупных технологических компаний.

Источник изображения: unsplash.com Отношение американцев к центрам обработки данных ухудшается, но скорость, с которой общественность отворачивается от этих объектов, удивительна. Опрос показал, что 71 % американцев выступают против строительства ЦОД рядом с местом своего проживания, при этом 55 % «решительно» выступают против такого проекта. В августе 2025 года только 42 % выступали против этих объектов, а три месяца назад недовольных было 51 %. ЦОД были названы главной причиной роста цен на электроэнергию. 53 % опрошенных обвинили в этом именно дата-центры, по сравнению с 28 % девять месяцев назад. Судя по опросам, люди скорее готовы жить рядом с атомной электростанцией, чем с ЦОД. Федеральная комиссия по регулированию энергетики (Federal Energy Regulatory Commission, FERC) дорабатывает правила подключения крупных потребителей к сети, а Конгресс в срочном порядке рассматривает законопроекты, которые обяжут ЦОД оплачивать модернизацию электросетей. Между тем, растущий спрос на ЦОД для ИИ уже способствует росту оптовых цен на электроэнергию в некоторых регионах. Помимо проблем с электроэнергией, беспокойство жителей вызывает влияние ЦОД на близлежащие источники водоснабжения. В марте крупные технологические компании, включая Google, Microsoft, Meta✴✴, Amazon, Oracle, OpenAI и xAI, подписали в Белом доме добровольное «обязательство по защите потребителей», пообещав покрывать расходы на электроэнергию своих быстрорастущих ЦОД, а не перекладывать эти расходы на местных потребителей электроэнергии. Но это добровольное обязательство становится трудновыполнимым в условиях ожесточённой конкуренции за первенство в гонке ИИ. Foxconn теперь будет собирать ИИ-серверы не только для Nvidia, но и для Intel

04.06.2026 [12:30],

Владимир Фетисов

Тайваньская Foxconn, являющаяся крупнейшим сборщиком серверных систем для Nvidia, объявила о заключении партнёрского соглашения с Intel, в рамках которого будет осуществляться совместная разработка и развёртывание ИИ-инфраструктуры следующего поколения и интеллектуальных вычислительных платформ. Эта работа будет вестись с целью удовлетворения возросшего рыночного спроса на системы ИИ-вычислений.  В заявлении Foxconn, крупнейшего в мире контрактного производителя электроники, сказано, что новое партнёрство позволит объединить технологии производства чипов Intel с опытом Foxconn в сфере производства. Компании планируют разрабатывать оборудование, предназначенное для центров обработки данных, являющихся основой ИИ-инфраструктуры. Речь, в том числе, о серверных стойках на базе процессоров Intel Xeon, а также ИИ-ускорителей. Компании также сосредоточатся на разработке высокоскоростных технологий межсетевых соединений, систем охлаждения и энергоэффективных решений для ИИ-инфраструктуры. Параллельно с этим Foxconn и Intel будут разрабатывать ИИ-системы для использования за пределами центров обработки данных, включая заводы, «умные» города и роботов. «Наше сотрудничество с Intel позволит объединить сильные стороны обеих компаний в области вычислительных платформ, системной интеграции и возможностей в глобальной цепочке поставок», — отметил председатель совета директоров и гендиректор Foxconn Янг Лю (Young Liu). Ещё Foxconn и Intel планируют изучить возможность совместной работы над специализированными чипами и решениями для системной интеграции. На данном этапе компании не озвучили финансовые детали сделки, а также не назвали каких-то конкретных заказчиков и не сообщили сроки запуска каких-либо продуктов. OpenAI и Anthropic потребовали ограничить ИИ из-за риска биологического оружия

04.06.2026 [11:13],

Геннадий Детинич

Компании OpenAI и Anthropic направили в Управление по науке и технологической политике Белого дома (OSTP) открытое письмо с просьбой ограничить возможности разработки биологического оружия с помощью ИИ. Подобное становится возможным с появлением передовых моделей искусственного интеллекта и услуг по изготовлению синтетических ДНК на заказ. Недостаточный контроль и слабая проверка заказчиков грозят привести к возникновению биологических угроз, что необходимо предотвратить.

Источник изображения: ИИ-генерация ChatGPT/3DNews По словам подписантов, среди которых также Microsoft и ряд крупных экспертов в области биологии и ИИ, существующая нормативная база не обеспечивает надлежащей проверки клиентов для предотвращения биологических угроз, связанных с использованием систем искусственного интеллекта и технологий синтеза ДНК, а также белков и других искусственно созданных биологических материалов. Между тем современные модели ИИ общего назначения, обученные на огромных массивах научных данных, способны существенно снизить порог входа в область синтетической биологии, предоставляя подробные протоколы синтеза и последовательности действий, понятные даже неспециалистам. В настоящее время проверка заказчиков и самих заказов компаниями — производителями биоматериалов фактически ведётся на добровольной основе. Конечно, существуют сертифицированные биолаборатории, контролируемые федеральными агентствами, где контроль максимален. Но на фоне множества частных компаний это слабое утешение. Особую тревогу вызывает способность ИИ-агентов не просто пересказывать учебники, но и предлагать неочевидные «обходные пути» синтеза токсинов, помогать в поиске оборудования и устранять неполадки в процессе производства. Подобное, очевидно, требует введения обязательного внешнего аудита, а также привлечения специалистов-биологов к предварительному тестированию ИИ-моделей для контролируемого выявления «опасных возможностей» до открытия доступа к ним для широкой публики. Авторы письма признают, что чрезмерно жёсткие рамки контроля могут замедлить законные биотехнологические исследования, включая разработку новых лекарств и вакцин. В связи с этим они предлагают внедрить многоуровневую систему контроля доступа: чем выше биологические риски использования той или иной ИИ-модели, тем более строгой должна быть проверка пользователей и тем более узкому кругу аккредитованных учёных она должна быть доступна. Такой подход, по мнению технологических компаний, позволит не «задушить» инновации, но создаст цифровой барьер, достаточно высокий, чтобы остановить злоумышленников. В целом подписанты письма надеются на «юридическую ясность» и создание государственной системы надзора. Они просят правительство классифицировать работу с моделями, имеющими двойное назначение, как вид деятельности, подлежащий лицензированию или обязательной экспертизе. Авторы письма настаивают, что саморегулирование рынка здесь невозможно в силу стратегической важности вопроса: если раньше для создания биологического оружия требовалась инфраструктура государственного уровня, то ИИ делает соответствующие знания потенциально доступными для небольших маргинальных групп. Такого быть не должно. Google выпустила мультимодальную ИИ-модель Gemma 4 12B, которая запустится прямо на ноутбуке

03.06.2026 [22:10],

Анжелла Марина

Компания Google представила мультимодальную модель искусственного интеллекта Gemma 4 12B с расширенными возможностями логического мышления, способную эффективно работать на ноутбуках с 16 Гбайт оперативной или унифицированной памяти.

Источник изображения: Google Как сообщается в блоге компании, модель позиционируется как промежуточное звено между облегчённой версией E4B и более продвинутой моделью 26B, базирующейся на архитектуре Mixture of Experts (MoE, «смесь экспертов»). Ключевой особенностью архитектуры стал отказ от раздельных модулей трансляции изображений и звука перед их передачей для обработки в ИИ-модель. Вместо традиционного визуального энкодера теперь используется компактный модуль встраивания на основе матричного умножения и нормализации, что позволяет архитектуре LLM взять на себя обработку визуальных данных, уменьшив нагрузку на вычислительные ресурсы. Что касается звука, то этот процесс был дополнительно упрощён путём полного удаления аудиоэнкодера и проецирования необработанного сигнала в единое пространство с текстовыми токенами. Подчёркивается, что новая система демонстрирует производительность на уровне более крупной версии 26B, потребляя при этом меньше системных ресурсов, что позволяет решать многоэтапные логические задачи и поддерживать комплексные сценарии работы ИИ-агентов. Дополнительное снижение задержек при генерации ответов обеспечивается интеграцией механизмов Multi-Token Prediction (MTP). Алгоритм распространяется по открытой лицензии Apache 2.0 и полностью совместим с существующей экосистемой разработчиков, которые уже скачали предыдущие итерации платформы Gemma 4 более 150 миллионов раз. Оценить автономную обработку аудиоданных можно на примере программы Google AI Edge Eloquent, способной транскрибировать, форматировать и переводить голосовые команды без подключения к сети. Импортозамещение по-европейски: ЕС запустил большой план по снижению зависимости от США и Китая в чипах, ИИ и облаках

03.06.2026 [20:25],

Сергей Сурабекянц

Евросоюз представил масштабный план по расширению своих внутренних цепочек поставок технологий и снижению зависимости от США и Азии в таких областях, как полупроводники, искусственный интеллект и облачные вычисления. План предусматривает содействие в строительстве европейских дата-центров и хранение критически важных данных в облачных сервисах на территории Евросоюза.

Источник изображений: unsplash.com Продолжающееся ухудшение трансатлантических отношений усугубило давние опасения по поводу чрезмерной зависимости от американских технологических компаний. Еврокомиссия также назвала центры обработки данных и сетевое оборудование из Китая угрозой безопасности. «Важно, чтобы мы не зависели от одной страны или одной компании, когда речь идёт о критически важных технологиях, — заявила исполнительный вице-президент Еврокомиссии по вопросам технологического суверенитета Хенна Вирккунен (Henna Virkkunen). — Зависимость может быть использована против нас». За исключением нескольких европейских компаний, которые являются мировыми лидерами в своих областях, присутствие Европы в цепочках поставок программного и аппаратного обеспечения значительно уступает США и Азии. Главным козырем ЕС можно смело назвать нидерландскую ASML, которая является единственным производителем передовых литографических машин, необходимых для производства современных полупроводников.

Источник изображения: ASML Сегодня Еврокомиссия объявила о ряде мер по укреплению так называемого технологического суверенитета и поощрению использования местных продуктов вместо зарубежных аналогов. Предложенные меры могут иметь далеко идущие последствия, от субсидий для европейских полупроводниковых производств до запрета на использование облачных услуг, предлагаемых компаниями из США и Китая. Центральным элементом плана является «Закон о развитии облачных вычислений и искусственного интеллекта» (Cloud and AI Development Act, CADA), который направлен на содействие строительству европейских дата-центров и утроение их мощности в течение следующих пяти-семи лет. В настоящее время в европейском облачном секторе доминируют американские компании — на Amazon Web Services, Microsoft Azure и Google Cloud приходится более 70 % рынка ЕС.

Источник изображения: Micron В соответствии с CADA правительствам потребуется хранить критически важные данные в облачных сервисах, принадлежащих ЕС, и проводить обязательную «оценку рисков суверенитета» своих поставщиков облачных услуг. Идея заключается в защите информации от внешнего регулирования, такого как американский закон CLOUD Act, который позволяет американским правоохранительным органам запрашивать данные с серверов американских технологических компаний, даже если они хранятся за границей. Это предполагает четырёхуровневую классификацию каждого поставщика в зависимости от того, находятся ли его облачные сервисы, цепочка поставок, обработка данных и физическая инфраструктура под контролем ЕС. Некоторые американские игроки готовятся к более строгим правилам суверенитета, сотрудничая с облачными компаниями, принадлежащими ЕС. Google объединилась с французским технологическим гигантом Thales SA для создания облачного предприятия S3NS, которое было выбрано официальным поставщиком облачных услуг для институтов ЕС. Microsoft и Amazon также запустили решения класса «суверенное облако» в Европе. Пакет мер Еврокомиссии также включает перезапуск европейского «Закона о чипах» (Chips Act), который вступил в силу в 2023 году и был призван увеличить долю Европы в мировом производстве полупроводников. Однако в прошлом году аудиторский орган ЕС признал, что союз вряд ли достигнет цели по удвоению своей доли рынка к 2030 году. Реформа этого закона, известная как «Закон о чипах 2.0», предусматривает предоставление Еврокомиссии права напрямую инвестировать в крупные трансграничные проекты, предлагая компаниям более простой способ получения государственного финансирования по сравнению с подачей заявок на национальные субсидии.  Реформа также направлена на стимулирование местного спроса для укрепления экономической целесообразности строительства новых заводов по производству полупроводников. Инвестиции будут осуществляться в рамках существующих грантовых программ до 2028 года, а будущее финансирование должно быть подтверждено в следующем бюджете ЕС, который всё ещё находится на стадии обсуждения. По оценке Еврокомиссии, к 2035 году для оживления полупроводниковой промышленности блока потребуется €120 млрд совместных государственных и частных инвестиций. Пакет мер по обеспечению технологического суверенитета также включает поощрение внедрения программного обеспечения с открытым исходным кодом, разработанного в ЕС, и дорожную карту по обеспечению устойчивой интеграции новых центров обработки данных и предприятий в сфере ИИ в энергетические сети блока. ЕС подчёркивает, что этот пакет мер не следует рассматривать как протекционизм. В документе говорится, что технологический суверенитет «не означает изоляцию, протекционизм или технологическую разобщённость». Вирккунен признала, что создание альтернатив зарубежным технологиям будет длительным и сложным процессом. «80 % наших технологий поступает из-за пределов Европы, поэтому наращивание потенциала в этих секторах не произойдёт в одночасье». Медленные темпы изменений могут подорвать эффективность попыток сократить отставание от конкурентов.

Источник изображения: Intel Ожидалось, что предложения по обеспечению технологического суверенитета будут представлены ещё в марте, однако их принятие несколько раз откладывалось из-за сопротивления со стороны правительств государств — членов ЕС и критики со стороны наблюдательного совета союза. После публикации проекты документов должны будут пройти несколько раундов переговоров между правительствами стран ЕС и Европейским парламентом, прежде чем будут приняты. Этот процесс может занять несколько месяцев. Протекционистский подход ЕС рискует ещё больше обострить отношения с США и Китаем и может привести к дефициту критически важных технологий в Европе, а также к отчуждению торговых партнёров. Вашингтон уже критиковал европейское регулирование, которое считает дискриминационным по отношению к американским технологическим компаниям, например «Закон о цифровых услугах», и угрожал ответными мерами. Цукерберг хочет, чтобы ИИ Meta✴ управлял всем бизнесом пользователей

03.06.2026 [18:58],

Сергей Сурабекянц

Глава Meta✴✴ Марк Цукерберг (Mark Zuckerberg) хочет, чтобы ИИ-агенты компании «помогали управлять всем бизнесом» её пользователей. Meta✴✴ внедряет ИИ-агентов для бизнеса на свои платформы WhatsApp, Instagram✴✴ и Messenger. Meta✴✴ Business Agent позволит владельцам компаний делегировать многие повседневные задачи, включая взаимодействие с клиентами и запись на приём.

Источник изображения: unsplash.com Во время недавнего отчёта о доходах Meta✴✴ Марк Цукерберг намекнул на большие планы компании в отношении ИИ-агентов. Теперь первая часть этих планов воплощается в жизнь. На мероприятии Conversations в Лондоне Meta✴✴ представила инструменты ИИ-агентов для бизнеса, использующего платформы WhatsApp, Instagram✴✴ и Messenger. Новый инструмент, официально называемый Meta✴✴ Business Agent, позволит владельцам бизнеса делегировать многие из своих повседневных задач, включая взаимодействие с клиентами и запись на приём. Meta✴✴ заявляет, что бизнес-агент сможет «закрывать сделки» и рекомендовать товары, хотя владельцы бизнеса смогут в любой момент подключиться к взаимодействию. В настоящее время Meta✴✴ тестирует своих ИИ-агентов на представителях малого бизнеса Индии, Мексики и Бразилии. По данным компании, уже более миллиона человек активно используют новые инструменты. Теперь агенты будут доступны любому бизнесу в WhatsApp, а также в Instagram✴✴ и Messenger. План Meta✴✴ намного более амбициозен, нежели внедрение очередного чат-бота для взаимодействия с клиентами. По словам Цукерберга, цель состоит в том, чтобы агенты «в конечном итоге помогли вам управлять всем вашим бизнесом», хотя он признаёт, что для этого также потребуется дальнейшее развитие базовых ИИ-моделей компании. Сейчас Meta✴✴ работает над набором передовых возможностей для агентов, которые позволят им активнее участвовать в внутренних аспектах управления компанией — «проведение маркетинговых исследований, предоставление информации о продуктах, подключение к инструментам управления вашим календарём и предоставление конкурентной информации». Meta✴✴ не планирует заниматься благотворительностью. Хотя компания заявляет, что «начало работы» с её новым бизнес-агентом бесплатно, она планирует сделать эту функцию доступной только по подписке «в ближайшие месяцы». Microsoft планирует «вызвать зависимость» пользователей от своего нового ИИ-помощника Scout

03.06.2026 [17:58],

Сергей Сурабекянц

Согласно внутренним стратегическим документам Microsoft, план по созданию только что анонсированного персонального ИИ-помощника Scout состоит в том, чтобы «вызвать у людей зависимость» к инструменту, прежде чем внедрять дополнительные функции. Процесс предусматривает три этапа — от вызывающего привыкание приложения до агентной платформы.  Microsoft тестировала Scout в качестве внутреннего инструмента для сотрудников под названием ClawPilot, начиная с марта. Scout является частью «Проекта Лобстер» по внедрению популярного ИИ-инструмента OpenClaw в пакет продуктов Microsoft 365, чтобы им могли пользоваться не только технические специалисты. OpenClaw стал вирусным в начале года. Инструмент позволяет создавать ИИ-агентов, действующих от имени пользователя. Агенты могут отправлять электронные письма, редактировать календари, публиковать сообщения в блогах и выполнять множество других поручений. Внутренний документ Microsoft под названием «ClawPilot: обзор и план с Project Lobster» гласит: «Продолжить выпуск автономного приложения ClawPilot. Провести пилотное тестирование пользовательского интерфейса, расширить базу пользователей и создать экосистему навыков и инструментов, которая заставит людей ежедневно зависеть от него». Руководитель проекта Омар Шахин (Omar Shahine) рассказал, что в ходе пилотного проекта с участием сотрудников Microsoft наблюдалось «ежедневное использование с высокой степенью удержания пользователей и интенсивностью использования (чаты, запросы, рабочие процессы, навыки)». В дальнейшем план предусматривает подключение ClawPilot к другим инструментам ИИ и, в конечном итоге, добавление новых функций.

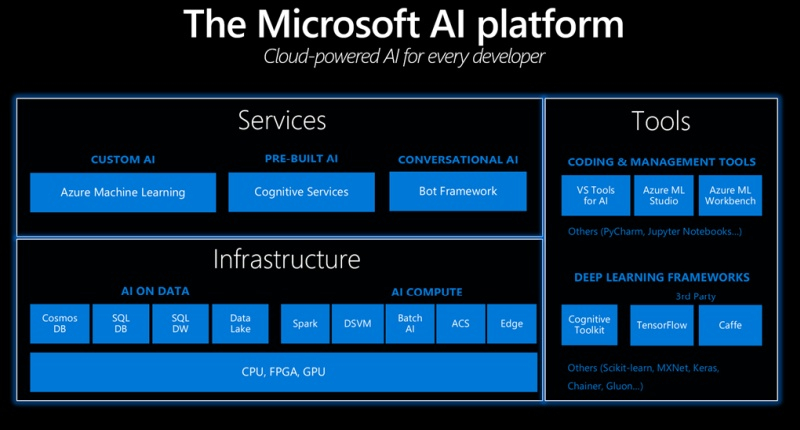

Источник изображений: Microsoft У некоторых сотрудников Microsoft формулировка, описывающая зависимость, «вызывает большую тревогу». «Мы наблюдаем все большую зависимость от чат-ботов и агентов на основе ИИ, и в целом, на мой взгляд, зависимость — это то, что ни один продукт не должен включать в свою стратегию разработки», — заявил один из них. «Разве конечная цель всего программного обеспечения, создаваемого крупными технологическими компаниями, не состоит в том, чтобы вызывать зависимость? — иронизирует другой сотрудник Microsoft. — К счастью для нас, Microsoft довольно плохо справляется с созданием вызывающих зависимость продуктов по сравнению с некоторыми другими разработчиками». В описании «Проекта Лобстер» отмечается, что он был «создан в пошаговом режиме совместно с ИИ. Каждое предложение было проверено человеком». В документе говорится, что его используют более 1000 сотрудников Microsoft, включая главу компании, и что «ClawPilot органично превратился в один из самых востребованных внутренних инструментов в Microsoft. Без официального объявления, без маркетинга, без общеорганизационной кампании». «ClawPilot — настольный персональный помощник, созданный в первую очередь для специалистов интеллектуального труда: людей в сфере финансов, юриспруденции, операционной деятельности, управления персоналом и других областях, — сказано в документе. — Это приложение для macOS и Windows, которое работает рядом с вами, изучает ваш стиль работы и действует от вашего имени. Оно управляет вашим календарём, сортирует входящие сообщения, регистрирует расходы, готовит встречи и запускает повторяющиеся рабочие процессы». Ранее глава Microsoft Сатья Надела (Satya Nadella) заявлял, что он использует OpenClaw, но Microsoft никогда не сможет его интегрировать в свои продукты: «Нельзя запускать OpenClaw от имени Microsoft. Я имею в виду, это просто не сработает. У меня нет разрешения на это, потому что это будет считаться запуском вируса компанией Microsoft. Это просто недопустимо». Как и OpenClaw, ClawPilot требует доступа к данным учётных записей и конфиденциальным файлам для своей работы, что подразумевает потенциальные проблемы с безопасностью персональных и корпоративных данных.  Продукты Microsoft в области ИИ оказались довольно неоднозначными. Партнёрство с OpenAI обеспечило Microsoft быстрый старт в сфере ИИ, а её инструмент для программирования Copilot был очень популярен, но теперь его превзошёл Claude Code. Компания пыталась внедрить ИИ во многие свои продукты, но большинство пользователей выразили недовольство этими попытками. «Падшие единороги»: более 220 стартапов с оценкой $1 млрд потеряли половину стоимости из-за ИИ

01.06.2026 [21:15],

Сергей Сурабекянц

По данным аналитической компании PitchBook, более 220 американских компаний, которые пять лет назад оценивались в $1 млрд и более, теперь оказались «падшими единорогами», потеряв больше половины своей стоимости. В значительной степени виной тому бум ИИ, который перенаправил инвестиционные потоки в сторону таких компаний, как OpenAI и Anthropic, и практически обнулил биржевые оценки и перспективы целых классов стартапов из эпохи «до ИИ».

Источник изображений: unsplash.com Термин «единорог» появился в 2013 году, когда его в своей статье использовала основательница венчурного фонда Cowboy Ventures Эйлин Ли (Aileen Lee). К единорогам относили компании, которые достигли оценки в $1 млрд. Пять лет назад венчурные капиталисты вкладывали деньги в универсальные компании, продающие всё — от подписок на нижнее бельё до программного обеспечения для планирования. В результате рыночная стоимость стартапов, подпитываемая сочетанием дешёвых денег и спроса во время пандемии, достигала миллиардных отметок ещё до получения первой прибыли. На сегодняшний день ситуация кардинально изменилась. Почти половина из 857 американских стартапов-единорогов не привлекали новое финансирование в течение последних трёх лет. Компании, которые в последний раз привлекали финансирование в 2021 году, в среднем стоят на 68 % меньше, а те, которые в последний раз привлекали финансирование в 2022 году, потеряли 52 % своей стоимости. Бум ИИ, который привлёк более $250 млрд в OpenAI и Anthropic в преддверии их ожидаемых мега-IPO в этом году, оставил сотни стартапов, созданных до появления ChatGPT в 2022 году, в затруднительном положении — фактически отрезанными от венчурного финансирования из-за завышенных оценок и устаревших технологий, но при этом недостаточно прибыльными для выхода на публичные рынки.  Более 220 компаний, достигших миллиардных оценок во время венчурного бума, теперь стали «падшими единорогами». «Многие из этих компаний находятся на стадии до внедрения ИИ, не только по своей структуре затрат, но и по своим продуктам, — считает генеральный директор финансовой компании Mercury Иммад Ахунд (Immad Akhund). — Они определённо в сложном положении. Всё внимание сосредоточено на ИИ, поэтому, если вы не компания, ориентированная на ИИ, вам нужны действительно сильные показатели, чтобы привлечь инвестиции». В список «падших единорогов» попали такие известные американские бренды, как Glossier, The Farmer’s Dog, Rothy’s, Brooklinen и Savage X Fenty. Также в него входят такие известные компании, как производитель пищевых добавок AG1, пионер в области робоконсультирования Betterment и онлайн-площадка по продаже билетов SeatGeek. Эти компании выросли в условиях, когда рост поощрялся заоблачными оценками, вызванными верой в низкие процентные ставки и высокий инженерный потенциал стартапов. Однако появление генеративного ИИ изменило ландшафт венчурного капитала, перенаправив средства в компании, изначально ориентированные на ИИ, и сделав невозможным для многих старых стартапов оправдание их прежних оценок. Сильнее всего пострадали компании, занимающиеся корпоративным ПО. В списке «падших единорогов» PitchBook фигурируют 75 компаний, предоставляющих программное обеспечение как услугу (SaaS). Это отражает как огромные оценки, которые получали стартапы в сфере ПО во время венчурного бума 2021 года, так и степень, в которой генеративный ИИ дестабилизировал предположения, лежащие в основе этого сектора.  Модель SaaS, в рамках которой компании интегрируются в рабочие процессы сотрудников и часто взимают плату с каждого пользователя, особенно уязвима перед лицом появления автономных агентов. Компании, созданные до появления генеративного ИИ, обременены раздутыми штатными структурами и программным обеспечением, разработанным для мира до ИИ, что затрудняет их трансформацию. Если компания не привлекала финансирование с 2021 или 2022 года, инвесторы и основатели считают, что она вряд ли когда-либо сделает это снова. Без доступа к венчурному финансированию или реалистичного плана первичного публичного размещения акций наиболее вероятным исходом для большинства таких компаний станет радикальное снижение рыночной оценки с возможным последующим банкротством. Немногочисленные стартапы, не нуждающиеся в привлечении средств благодаря высокой прибыли, можно считать исключением из правила. По словам экспертов, до перезагрузки рынка стартап можно было продать более крупной технологической компании примерно по $2 млн за программиста. Фирма со 100 инженерами стоила бы как минимум от $200 млн до $300 млн. Но инструменты программирования на основе ИИ позволили создавать продукты гораздо меньшими командами, что сделало подобные сделки крайне редкими.  Генеративный ИИ в конечном итоге может сократить объём капитала, необходимого для создания успешных софтверных компаний, ставя под сомнение одно из основных предположений, подпитывавших венчурный бум последнего десятилетия. Вероятно, этот процесс только начинается, поскольку влияние ИИ ощущается во всей экосистеме финансирования бизнеса — от венчурного и частного кредитования до крупных публичных компаний. Старые софтверные компании пытаются по-прежнему полагаться на бизнес-модели, основанные на взимании платы с клиентов в зависимости от количества сотрудников, использующих их продукты. Но, похоже, для выживания поставщикам ПО придётся перейти к моделям ценообразования, основанным на результатах, и инфраструктуре, изначально разработанной для ИИ. Microsoft перевела GitHub Copilot с подписки на оплату за токены — пользователи недовольны

31.05.2026 [13:09],

Владимир Фетисов

Похоже, что в ближайшее время мелким компаниям придётся пересмотреть целесообразность использования сервиса GitHub Copilot. Дело в том, что Microsoft меняет систему оплаты с фиксированной подписки на систему оплаты за количество использованных токенов, в результате чего счета могут существенно вырасти. Крупные предприятия, вероятно, всё ещё смогут себе это позволить, но небольшим компаниями и частным лицам сделать это будет не так просто.

Источник изображения: GitHub Новая система оплаты начнёт действовать с 1 июня. После этого размер платы за сервис GitHub Copilot будет зависеть от того, сколько токенов израсходовал пользователь во время работы. Пользователи были неприятно удивлены этим изменением, о чём свидетельствуют сообщения, опубликованные на площадках Reddit и X. «Что за шутка. Эта новая модель оплаты просто до безумия дорогая. Я решаю этот вопрос, отменяя подписку. При такой стоимости это больше не является экономически эффективным или практически полезным ни в каком смысле», — написал один из пользователей Reddit. Он также добавил, что в рамках действующей подписки платил около $29 в месяц. Теперь же, после вступления в силу новых правил, его расходы увеличились бы до примерно $750 в месяц. «Ничего себе, не ожидал, что новая модель ценообразования будет настолько абсурдной», — написал другой пользователь. Он также сообщил, что новая система оплаты GitHub Copilot приведёт к увеличению расходов с $50 до $3000 в месяц. Несмотря на то, что стоимость использования GitHub Copilot может существенно вырасти, некоторые люди высказались против критики в отношении такого подхода. По их мнению, пользователи, которые знают, что делают, будут расходовать не так много токенов. Они считают, что люди, которые тратят очень много токенов, являются так называемыми «вайб-кодерами», у которых не так много реальных знаний. «Есть огромная разница между некоторыми из нас, работающими весь день и всё ещё едва превышающими лимит, и этими скриншотами. Мне трудно поверить, что это связано с отличиями в сложности рабочих нагрузок. Единственный способ добиться такого безумия — это заниматься «вайб-кодингом» и работать с кучей раздутых итераций», — написал один из пользователей. Трафик поисковика DuckDuckGo утроился после последнего обновления ИИ-поиска Google

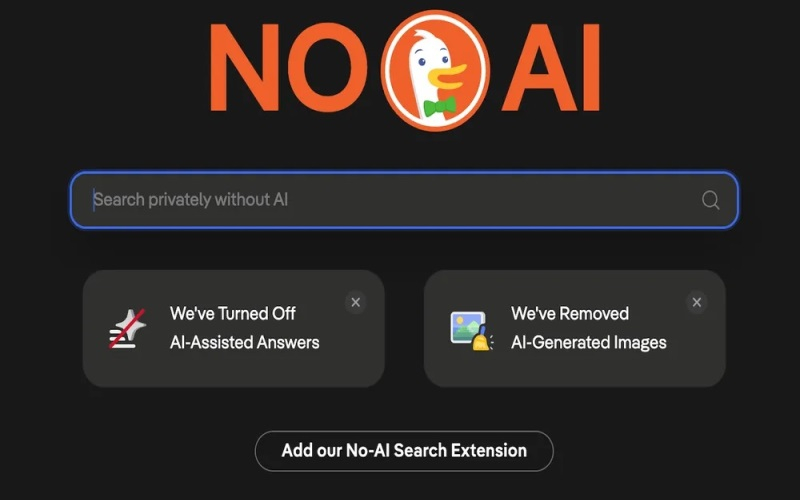

31.05.2026 [12:35],

Владимир Фетисов

Разработчики ориентированной на конфиденциальность поисковой системы DuckDuckGo объявили, что версия фирменного поисковика без ИИ-алгоритмов получила в три раза больше трафика после недавнего обновления поиска Google и PR-кампании по продвижению ИИ-функций в нём. Помимо конфиденциальности DuckDuckGo позиционирует свой поисковик как место, где пользователь может сделать выбор: использовать или не использовать ИИ.

Источник изображения: DuckDuckGo В сообщении сказано, что несколько дней назад количество установок приложения DuckDuckGo выросло почти на треть. Это касается сервиса noai.duckduckgo.com, который позволяет осуществлять поиск информации в интернете без применения ИИ-алгоритмов. «С тех пор как Google раскрыла свои планы по кардинальному обновлению поиска с помощью ИИ, посещаемость нашей страницы поиска “No AI” утроилась и продолжает расти! Хотите сделать её поиском по умолчанию в Chrome или Firefox? Установите наши расширения без ИИ и избавьтесь от сгенерированных ИИ ответов, чатов и изображений», — говорится в заявлении разработчиков. Рост популярности DuckDuckGo без ИИ последовал за длительной кампанией Google по продвижению функций на базе генеративных нейросетей в собственном поисковике. Хотя Google пока не заменила полностью классическую версию своего поисковика, ИИ-режим уже переместился в более заметное место на главной странице, что делает его приоритетным по сравнению с традиционным поиском в пользовательском интерфейсе. Продвижение ИИ-функций в поисковике сопровождалось заявлениями генерального директора Google Сундара Пичаи (Sundar Pichai) о внедрении ИИ, а также о его важности для компании. Отметим, что режим поиска без ИИ в DuckDuckGo не связан с принципиальным отказом от использования нейросетей. Это скорее прагматичный вариант, предполагающий возможность выбора для пользователей. Для тех, кто хочет задействовать ИИ-алгоритмы в поисковике, у DuckDuckGo есть соответствующий сервис duck.ai. Acer представила флагманский игровой ноутбук Predator Helios 18 с чипами Core Ultra 9 290HX и RTX 5090

29.05.2026 [19:31],

Сергей Сурабекянц

Acer представила на Computex 2026 флагманский игровой ноутбук Predator Helios 18 AI, получивший награду iF Design Award. Компания адресует новинку геймерам-энтузиастам и киберспортсменам. По словам Acer, устройство «обеспечивает мощность уровня настольного компьютера в форм-факторе ноутбука».

Источник изображений: Acer Ноутбук Acer Predator Helios 18 AI построен на базе процессора Intel Core Ultra 9 290HX Plus в паре с графическим ускорителем Nvidia GeForce RTX 5090. Максимальный объём ОЗУ составляет 256 Гбайт, ёмкость встроенного хранилища — до 6 Тбайт. 18-дюймовый Mini LED-дисплей с разрешением WQUXGA обеспечивает яркость до 1000 кд/м2 в режиме HDR при 100-процентном охвате цветового пространства DCI-P3. Он поддерживает плавное переключение между разрешением 4K при 120 Гц и Full HD при 240 Гц. Для охлаждения системы при самых высоких нагрузках используются два вентилятора Predator AeroBlade 3D шестого поколения с динамической регулировкой, что позволяет системе обеспечивать на 20 % больший воздушный поток по сравнению с обычными пластиковыми вентиляторами. Тепловые трубки Vector и термопаста на основе жидкого металла дополнительно повышают эффективность охлаждения.  В аудиосистеме ноутбука используется запатентованная технология Acer Predator Vox — фирменная шестиканальная система, которая, по утверждению производителя, «улучшает стабильность формы волны, повышает проекцию и обеспечивает отсутствие искажений на высоких уровнях громкости». Predator Helios 18 AI оснащён технологией Intel Killer DoubleShot Pro, которая объединяет сетевые адаптеры Intel Killer Wi-Fi 7 BE1750x и Intel Killer Ethernet E5000B для интеллектуальной приоритизации наиболее важного сетевого трафика. Два порта Thunderbolt 5 обеспечивают высокую пропускную способность и бесперебойное подключение к любым устройствам.  Размеры устройства составляют 401 × 308 мм, толщина корпуса варьируется от 17,3 до 29,6 мм. Вес ноутбука — 3,5 кг. Премиальный дизайн ноутбука дополняют динамическая RGB-подсветка и новейшие механические переключатели Predator MagKey 4.0. Кодзима наконец покорил космос, но лишь в ИИ-рекламе для Prada

27.05.2026 [20:35],

Михаил Романов

Прославленный японский гейм-дизайнер Хидео Кодзима (Hideo Kojima) не раз говорил о желании улететь в космос и наконец осуществил давнюю мечту. Но не в том виде, на какой могли рассчитывать игроки. Как подметил портал PC Gamer, Кодзима вместе с датским режиссёром и своим другом Николасом Виндингом Рефном (Nicolas Winding Refn) «снялся» в короткометражном фильме для рекламы итальянского модного дома Prada. Шестиминутная короткометражка под названием Satellites II дебютирует на закрытом мероприятии Prada Mode в Нью-Йорке (пройдёт с 3 по 7 июня), а пока режиссёр предлагает ознакомиться с полутораминутным тизером. По сюжету космические путешественники в лице Кодзимы и Рефна после передряги на негостеприимной планете прибывают на летающей тарелке в нью-йоркский отель «Челси», чтобы «начать своё сюрреалистическое пребывание». «Созданный в сотрудничестве с Prada, этот проект — и художественный эксперимент, и несерьёзное исследование новых творческих возможностей с помощью ИИ-технологий», — заявил Рефн в разговоре с Women's Wear Daily. Скриншоты из тизера

Пользователи в комментариях массово раскритиковали Рефна, Кодзиму и Prada за продвижение ИИ в творческих задачах. «Грустно видеть, как такие великие творцы опускаются до генеративного ИИ-мусора», — сетует JustinVinall. Кодзима признался в декабрьском интервью CNN, что не заинтересован в создании игр с помощью нейросетей, но не стал исключать перспективности ИИ для модификации органов управления или «оживления» NPC. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |