|

Опрос

|

реклама

Быстрый переход

Кодзима наконец покорил космос, но лишь в ИИ-рекламе для Prada

27.05.2026 [20:35],

Михаил Романов

Прославленный японский гейм-дизайнер Хидео Кодзима (Hideo Kojima) не раз говорил о желании улететь в космос и наконец осуществил давнюю мечту. Но не в том виде, на какой могли рассчитывать игроки. Как подметил портал PC Gamer, Кодзима вместе с датским режиссёром и своим другом Николасом Виндингом Рефном (Nicolas Winding Refn) «снялся» в короткометражном фильме для рекламы итальянского модного дома Prada. Шестиминутная короткометражка под названием Satellites II дебютирует на закрытом мероприятии Prada Mode в Нью-Йорке (пройдёт с 3 по 7 июня), а пока режиссёр предлагает ознакомиться с полутораминутным тизером. По сюжету космические путешественники в лице Кодзимы и Рефна после передряги на негостеприимной планете прибывают на летающей тарелке в нью-йоркский отель «Челси», чтобы «начать своё сюрреалистическое пребывание». «Созданный в сотрудничестве с Prada, этот проект — и художественный эксперимент, и несерьёзное исследование новых творческих возможностей с помощью ИИ-технологий», — заявил Рефн в разговоре с Women's Wear Daily. Скриншоты из тизера

Пользователи в комментариях массово раскритиковали Рефна, Кодзиму и Prada за продвижение ИИ в творческих задачах. «Грустно видеть, как такие великие творцы опускаются до генеративного ИИ-мусора», — сетует JustinVinall. Кодзима признался в декабрьском интервью CNN, что не заинтересован в создании игр с помощью нейросетей, но не стал исключать перспективности ИИ для модификации органов управления или «оживления» NPC. MediaTek представила чип Dimensity 8550 для мощных смартфонов среднего уровня — он поддерживает Gemini Nano v3

27.05.2026 [18:44],

Сергей Сурабекянц

Недавно Google анонсировала Gemini Intelligence с интерактивным интерфейсом на Android-смартфонах. Однако системные требования могут «оставить за бортом» даже некоторые флагманские устройства. Новая однокристальная мобильная платформа MediaTek Dimensity 8550 получила дополнительные блоки, которые потенциально смогут обеспечить работу Gemini Intelligence даже на сравнительно доступных смартфонах средней ценовой категории.

Источник изображения: MediaTek 4-нанометровый Dimensity 8550 основан на восьмиядерном чипе Cortex-A725 с тактовой частотой до 3,4 ГГц, графическом процессоре Mali-G720 MC8 и нейронном процессоре MediaTek NPU 880. Он практически идентичен ранее анонсированному Dimensity 8500. Единственное отличие — наличие так называемого LLM Booster («Ускоритель больших языковых моделей») с поддержкой ИИ-модели Google Gemini Nano V3, которая требуется для работы с Gemini Intelligence. В настоящее время лишь немногие устройства поддерживают Gemini Nano v3, включая серию Galaxy S26, линейку Google Pixel 10 и OnePlus 15. Однако такие устройства, как серия Google Pixel 9, OnePlus 13, Samsung Galaxy Z Fold 7 и Xiaomi 17 Ultra, поддерживают лишь Gemini Nano v2. Таким образом, все эти устройства не смогут запустить Gemini Intelligence — по крайней мере, без обновления версии Gemini Nano со стороны Google. Само по себе наличие процессора Dimensity 8550 не гарантирует возможности запуска Gemini Intelligence — требуется как минимум 12 Гбайт оперативной памяти и «подходящий» чипсет, так что одной лишь поддержки Gemini Nano v3 может оказаться недостаточно. Первым смартфоном на аппаратной платформе Dimensity 8550 стала китайская версия Honor 600 Pro. YouTube научился автоматически помечать видео, созданные с помощью ИИ

27.05.2026 [18:01],

Сергей Сурабекянц

Сегодня компания YouTube объявила, что её внутренние системы будут автоматически помечать видео, если обнаружат использование «значительного фотореалистичного ИИ». Кроме того, метки ИИ теперь станут более заметными как в длинных видеороликах, так и в коротких видео YouTube Shorts.

Источник изображения: unsplash.com Метки ИИ появились на платформе более двух лет назад, после того как YouTube обновил свою политику, добавив требование к авторам раскрывать информацию о реалистичном контенте, созданном с помощью ИИ. Видео, которые изображали какой-либо анимированный или вымышленный сценарий не требовали пометки. YouTube заявляет, что политика видеосервиса в отношении маркировки ИИ не изменилась, но компания станет активнее контролировать контент на своей платформе. Этот шаг последовал за анонсом Google на конференции разработчиков Google I/O новой линейки мультимодальных ИИ-моделей Gemini Omni, способных создавать высококачественные видеоролики, отражающие понимание физики, культуры, истории и науки. Начиная с мая, YouTube будет использовать новые технологии для идентификации контента, созданного с помощью ИИ, и соответствующей его маркировки. Это не снимает с создателей контента обязанности раскрывать информацию об использовании ИИ, но, если они этого не сделают, YouTube сам пометит видео. Авторы, чей контент был неправильно идентифицирован, смогут изменить его статус, если только видео не было создано с помощью собственных инструментов ИИ YouTube, таких как Veo или Dream Screen. Метки также будут постоянно прикреплены к видео, если контент содержит метаданные C2PA, указывающие на то, что он был полностью создан с помощью ИИ. YouTube также сделает свои метки ИИ более последовательными и заметными. Раньше метки появлялись в расширенном описании, если видео не затрагивало более деликатные темы, такие как здоровье или новости; в этом случае заметная метка появлялась непосредственно на самом видео. Теперь метки будут отображаться непосредственно под видеоплеером. Компания заявила, что перемещение меток сделает их более заметными для людей, которые сталкиваются с фотореалистичным, изменённым или сгенерированным ИИ контентом на сайте. Для видео, созданных с помощью ИИ, которые лишь незначительно изменены, анимированы или нереалистичны метка будет отображаться только в расширенном описании. Метки ИИ не будут влиять на рекомендации видео или на возможность его монетизации. Добавление функции автоматического обнаружения видео, сгенерированного ИИ, произошло вскоре после расширения функции обнаружения дипфейков на YouTube. SpaceX признала: для орбитального ИИ ей катастрофически не хватает чипов — и TeraFab может не спасти

27.05.2026 [16:04],

Николай Хижняк

В преддверии долгожданного IPO компания SpaceX признала, что для реализации амбициозных планов по созданию орбитальной сети дата-центров для искусственного интеллекта ей потребуется больше чипов, чем она может получить в настоящее время. Амбициозный проект TeraFab может решить проблему нехватки чипов, однако компания не исключает, что он может оказаться неудачным. Также SpaceX признаёт, что её нынешние партнёры — Tesla и Intel — не обязаны поддерживать её в долгосрочной перспективе.

Источник изображения: Tesla Как и в случае с любыми другими IPO, Комиссия по ценным бумагам и биржам США (SEC) требует, чтобы SpaceX указывала все факторы риска — как крупные, так и незначительные, включая форс-мажорные обстоятельства, такие как возможные погодные катаклизмы. Поэтому к этим комментариям следует относиться с должной долей скептицизма. Тем не менее они указывают на некоторые препятствия, которые компания может рассматривать как реальные проблемы для своей бизнес-модели. «Наша способность реализовать масштабный проект по созданию орбитального искусственного интеллекта зависит от наличия достаточного количества чипов для ИИ — значительно большего, чем у нас есть сейчас. Производство и поставки серверов и сетевого оборудования для нашей технической инфраструктуры, особенно графических процессоров и других специализированных компонентов, ограничены небольшим числом квалифицированных поставщиков. У нас нет долгосрочных или иных существенных договорных обязательств с нашими непосредственными поставщиками чипов. Вместо этого мы закупаем все наши графические процессоры по разовым заказам», — говорится в документе по форме S-1 для SEC. Текущие деловые отношения с поставщиками графических процессоров, такими как AMD и Nvidia, а также с производственными партнёрами TSMC и Samsung Foundry подвергают SpaceX и её подразделение xAI риску столкнуться с «нехваткой производственных мощностей, дефицитом сырья, геополитическими потрясениями и стихийными бедствиями, затрагивающими регионы производства полупроводников». TSMC, крупнейшая в мире компания по производству полупроводников и крупнейший в мире производитель современных логических микросхем, едва справляется с удовлетворением спроса на процессоры для ИИ. Инсайдеры отрасли предупреждают, что производитель испытывает дефицит поставок на фоне крупных заказов. Например, Nvidia увеличила общий объём закупок у TSMC, включая складские запасы, обязательства по закупкам и предоплаты, до $145 млрд, чтобы обеспечить поставки чипов и других компонентов. Другие компании, как правило, поступают так же. Чтобы хотя бы частично снизить риски, Tesla, SpaceX и xAI намерены построить TeraFab — специализированное предприятие по производству полупроводников, которое будет выпускать чипы исключительно для этих трёх компаний. На данный момент о TeraFab известно лишь то, что фабрику планируется построить в кампусе SpaceX в Техасе и она будет использовать 14-нм техпроцесс Intel для производства чипов. Илон Маск намерен инвестировать в TeraFab десятки миллиардов долларов, но это не гарантирует успеха проекта, о чём предупреждает форма S-1. «Несмотря на то, что мы рассчитываем построить фабрику TeraFab, чтобы решить проблему с поставками, проект может оказаться неудачным, и тогда у нас не будет других источников достаточного количества чипов для искусственного интеллекта, чтобы удовлетворить наши потребности в орбитальных вычислительных мощностях для ИИ. Хотя фабрика TeraFab призвана расширить наши внутренние возможности по производству чипов и решить потенциальную проблему с нехваткой микросхем для искусственного интеллекта в SpaceX, особенно в связи с тем, что мы активно развиваем орбитальные вычислительные мощности для ИИ, мы рассчитываем и дальше закупать значительную часть нашего вычислительного оборудования у сторонних поставщиков. Нет никаких гарантий, что мы сможем достичь наших целей в отношении фабрики TeraFab в ожидаемые сроки или вообще сможем их достичь», — говорится в другом заявлении SpaceX. Интересно, что Intel и Tesla могут выйти из проекта, фактически оставив TeraFab без крупного заказчика и разработчика технологических процессов, что может поставить крест на всем проекте. «Несмотря на то, что у нас есть рамочное соглашение с Tesla, ни Tesla, ни Intel не обязаны оставаться в проекте, и в конечном итоге мы можем не заключить никаких окончательных соглашений», — говорится в форме S-1. Micron Technology преодолела рубеж в $1 трлн капитализации на волне ИИ-бума

27.05.2026 [04:51],

Анжелла Марина

Рыночная капитализация компании Micron Technology впервые за свою историю во вторник ненадолго превысила отметку в $1 трлн, сообщает Reuters. Это событие стало кульминацией стремительного ралли, которое утвердило крупнейшего американского производителя чипов памяти в статусе одного из главных бенефициаров ИИ-бума.

Источник изображения: Micron Technology Котировки акций Micron показали резкий рост после того, как брокерская компания UBS значительно повысила целевой ориентир по бумагам производителя. По мнению главного рыночного стратега B. Riley Wealth Арта Хогана (Art Hogan), преодоление триллионной отметки сигнализирует о колоссальном спросе на память, необходимую для работы дата-центров в условиях революции искусственного интеллекта. Инвесторы начали активнее вкладываться в компании, выигрывающие от масштабных затрат технологических гигантов, сместив фокус с производителей графических процессоров. В то время как Nvidia создает процессоры для обучения ИИ-моделей, Micron специализируется на чипах для хранения и передачи данных, выводя США в гонку сильных игроков, где традиционно доминирует Азия. Южнокорейская компания Samsung Electronics уже достигла триллионной капитализации, а SK Hynix также приближается к этому показателю. При этом потенциальные сбои в работе Samsung из-за трудовых споров с профсоюзами могут спровоцировать дополнительный рост цен на рынке памяти на фоне уже существующего дефицита. Выход в элитный клуб триллионеров знаменует уверенное восстановление Micron после постпандемийного периода, когда производители чипов страдали от переизбытка предложения и слабого спроса на потребительскую электронику. В первом квартале текущего года компания стала одним из фаворитов институциональных инвесторов. В частности, около 2440 фондов, включая Rockefeller Capital Management и Schroders, открыли новые позиции в её капитале. За последние двенадцать месяцев акции производителя выросли более чем в восемь раз благодаря сильным финансовым результатам и ограничению цепочек поставок. Стремление технологических компаний к созданию общего искусственного интеллекта (AGI) сформировало острый дефицит памяти, из-за чего Micron уже распродала весь объём поставок чипов HBM на 2026 год и запустила производство продуктов следующего поколения HBM4. На этом фоне бумаги Micron подскочили на 17,4 %, достигнув отметки в $881,6, а аналитики UBS установили целевую цену на уровне $1625. Акции Micron торгуются с мультипликатором 8,42 к ожидаемой прибыли за следующие 12 месяцев, что значительно ниже показателей индексов S&P 500 (22,15) и Nasdaq 100 (26,23), сохраняя тем самым значительный потенциал дальнейшего роста. Власти США начали считать протесты против ИИ и ЦОД проявлением «антитехнологического экстремизма»

26.05.2026 [19:11],

Дмитрий Федоров

Власти США начали рассматривать протесты против строительства ЦОД и критику ИИ как возможные проявления «антитехнологического экстремизма». Это следует из более чем 1000 страниц закрытых отчётов Министерства внутренней безопасности США (DHS), ФБР и межведомственных центров обмена разведданными. В документах граница между угрозой насилия и мирным протестом проведена неясно, поэтому под подозрение могут попасть даже мирные протестующие.

Источник изображения: Nathan Kuczmarski / unsplash.com Новая волна слежки за активистами и протестующими вписывается в более широкий политико-правовой курс администрации Дональда Трампа (Donald Trump), расширяющий трактовку внутренних угроз и усиливающий внимание к идеологически мотивированной активности внутри США. Его президентский меморандум по национальной безопасности №7 (National Security Presidential Memo 7) предписывает Министерству юстиции (DOJ) преследовать людей с «антиамериканскими», «антихристианскими» и «антикапиталистическими» взглядами, а советник Трампа по борьбе с терроризмом Себастьян Горка (Sebastian Gorka) назвал левых экстремистов одной из трёх главных целей для противодействия терроризму в США. Ключевой риск — размытость новой категории «экстремизма». В отчёте Нью-Йоркского бюро разведки и борьбы с терроризмом (ICB) говорится, что технологии ИИ в ближайшие 5 лет могут спровоцировать крупные протесты, гражданские беспорядки и «насильственную антитехнологическую экстремистскую деятельность». При этом, по данным Wired, такого термина нет в общедоступных отчётах или руководствах DHS либо ФБР о внутреннем экстремизме. Межведомственные центры обмена разведывательными сведениями, созданные после терактов 11 сентября, уже собирают данные о предполагаемых угрозах ЦОД. В США действуют 80 таких центров. Их отчёты относят к подозрительным действиям фотографирование, наблюдение, проверку системы безопасности и попытку проникновения — то есть признаки, которые могут встречаться и у мирных протестующих. Старший юрисконсульт Фонда правовой защиты NAACP Спенсер Рейнольдс (Spencer Reynolds) предупреждает, что такие отчёты продолжают практику, при которой протесты и твёрдые убеждения рассматривают как возможные предвестники насилия. По его словам, размытые правила подготовки отчётов позволяют сотрудникам видеть угрозу там, где её может и не быть. Изученные Wired документы показывают, что власти США следят за потенциальными экстремистами не только в интернете, но и наблюдают за очными собраниями людей. По данным проекта Data Center Watch, который отслеживает протесты против строительства ЦОД в США, сотни организаций в 42 штатах пытаются заблокировать строительство дата-центров в своих городах и округах. В ряде штатов полиция уже удаляла с собраний или арестовывала выступающих, критиковавших строительство ЦОД. Главная проблема в том, что по законодательству США внутренний терроризм не является самостоятельным преступлением, но такие нормы позволяют вести слежку за предполагаемыми экстремистами. Поэтому протестующие могут попасть под наблюдение как внутренние экстремисты, даже если обвинения против них касаются незаконного проникновения, вандализма или других преступлений без какой-либо террористической составляющей. Самый показательный пример — отчёт Site Intelligence за апрель 2025 года. В нём фигурирует видео некоммерческой организации More Perfect Union о вреде ЦОД для жителей районов в Джорджии. В видео не было призывов к насилию против людей или собственности, однако организация всё равно попала в материалы американских разведывательных и правоохранительных структур как потенциальный источник угрозы. Апокалипсис рабочих мест не наступил: Сэм Альтман признал, что переоценил опасность ИИ для рынка труда

26.05.2026 [13:33],

Дмитрий Федоров

Глава OpenAI Сэм Альтман (Sam Altman) заявил, что быстрое распространение ИИ пока не привело к апокалипсису рабочих мест и затронуло меньше должностей для работников умственного труда, чем он ожидал. На конференции Commonwealth Bank of Australia (CBA) в Сиднее он признал, что технологические прогнозы OpenAI после запуска ChatGPT в 2022 году в целом подтвердились, но оценки социальных и экономических последствий оказались ошибочными.

Источник изображения: AI По словам Альтмана, ИИ пока не заменил столько служащих и специалистов, сколько он опасался, хотя прежде считал такой риск серьёзным. «Я рад, что ошибся, думая, что к этому времени ИИ сильнее повлияет на сокращение должностей начального уровня для служащих и специалистов, чем это произошло на самом деле», — сказал он в беседе с главой CBA Мэттом Комином (Matt Comyn). Альтман признал, что теперь лучше понимает, почему массового сокращения таких должностей не произошло. При этом он считает прежнее обсуждение рисков оправданным: ИИ действительно мог угрожать рабочим местам, и этот риск, по его словам, всё ещё остаётся. Однако Альтман не привёл данных о том, сколько рабочих мест затронуло внедрение ИИ. Ранее он говорил о риске массовых сокращений в целых отраслях. О планах сократить часть должностей за счёт внедрения ИИ уже заявляли HSBC, Amazon, Standard Chartered и CBA, однако пока неясно, сколько рабочих мест эти компании сократили или намерены сократить по этой причине. Альтман также пересмотрел взгляд на роль человека в труде. По его словам, ИИ берёт на себя всё больше задач, но не заменяет личное общение, доверие и прямое взаимодействие между людьми. Он привёл пример из собственной практики: некоторое время ИИ отвечал за него на сообщения в корпоративном мессенджере Slack и электронные письма с пометкой: «Это ИИ Сэма». Затем Альтман снова стал писать часть ответов сам, потому что понял, насколько важны людям личные контакты. «Для нас действительно важны отношения с людьми и живое общение. Эта часть моей работы занимает много времени, но я не могу представить, что в обозримом будущем её сможет выполнять ИИ», — сказал он. По словам Альтмана, этот опыт изменил его представление о будущем труда. Он считает, что ИИ не заменит человеческое взаимодействие во многих профессиях, а рынок труда будет развиваться иначе, чем ожидали участники отрасли. «Я не думаю, что нас ждёт тот самый „апокалипсис рабочих мест“, который предсказывают или обсуждают некоторые компании из нашей области», — подытожил Альтман. «Яндекс» запустит ИИ-генератор сайтов и веб-приложений по текстовому описанию

26.05.2026 [12:16],

Владимир Фетисов

Компания «Яндекс» ведёт разработку нового сервиса на базе искусственного интеллекта, с помощью которого пользователи смогут создавать сайты и веб-приложения на основе текстовых подсказок. На платформе Vibecraft пользователю лишь потребуется описать свою идею словами, после чего ИИ-помощник уточнит детали и приступит к реализации задуманного.

Источник изображения: Igor Omilaev / unsplash.com По данным источника, новый сервис «Яндекса» позволит создавать полноценные сайты, CRM- и трекинг-системы, опросы, онлайн-игры и другие веб-приложения. В настоящее время можно подать заявку на получение раннего доступа к сервису, официальный запуск которого должен состояться в июне. С помощью Vibecraft можно будет запускать разные проекты, начиная от сайтов для бизнеса, заканчивая личными сервисами и онлайн-инструментами. «Vibecraft позволяет снизить стоимость разработки сайта на порядки и создать цифровой продукт за несколько часов. В отличие от традиционных конструкторов сайтов, возможности Vibecraft ограничены только воображением пользователя и инфраструктурой: сервис создаёт проект под конкретную задачу, а не подбирает подходящий шаблон», — говорится в описании платформы. Создание корпоративного сайта с привлечением разработчиков может стоить от 350 тыс. до 800 тыс. рублей, а интернет-магазина — от 600 тыс. рублей. При этом на разработку требуется несколько недель. Vibecraft позволит снизить стоимость запуска практически до нуля и создать цифровой продукт за несколько часов. Технический директор платформы Yandex Cloud Иван Пузыревский считает, что миллионы людей хотят запустить свой проект или сервис, но не могут сделать этого из-за отсутствия необходимых навыков, достаточного количества времени, бюджета, команды разработки или чего-то иного. «При этом, например, представить современный бизнес или даже хобби-проект без присутствия в интернете невозможно. Наша цель — убрать этот барьер. Сайт или приложение должны создаваться так же быстро, как написать сообщение», — уверен Иван Пузыревский. Он добавил, что доступ к новому сервису будет предоставляться по подписке, но до определённого количества запросов взаимодействовать с ним можно будет бесплатно. ИИ-модель GPT-4.5 преуспела в тесте Тьюринга — её приняли за человека в 73 % случаев, но не всё так просто

21.05.2026 [16:32],

Дмитрий Федоров

Некоторые современные ИИ способны проходить тест Тьюринга — классическую проверку на неотличимость машины от человека в текстовом общении. В эксперименте судьи — участники, которые по переписке должны были отличить человека от ИИ, — принимали GPT-4.5 за человека в 73 % случаев, когда ИИ-модель работала со специальным промтом, который задавал ей характер и манеру речи.

Источник изображения: Igor Omilaev / unsplash.com Исследование провели Кэмерон Р. Джонс (Cameron R. Jones) и Бенджамин К. Берген (Benjamin K. Bergen). Они проверяли, смогут ли современные большие языковые модели (LLM) убедить людей-судей, что те общаются с живым человеком. Тест Тьюринга, предложенный британским математиком Аланом Тьюрингом (Alan Turing) в 1950 году, устроен просто: судья через текстовый чат одновременно общается с человеком и машиной, а потом решает, кто из собеседников настоящий. По мнению учёных, такой формат куда показательнее стандартных тестов для ИИ. Обычные эталонные оценки статичны — высокие баллы могут отражать запоминание обучающих данных, а не реальную адаптивность в разговоре. Тест Тьюринга позволяет судьям задавать открытые вопросы и нащупывать слабые места машины. Учёные организовали серию онлайн-экспериментов с участием почти 500 человек. Они оценивали ИИ-модели GPT-4.5, LLaMa-3.1-405B и GPT-4o, а также простой чат-бот 1960-х годов ELIZA — как базовый ориентир. В первом исследовании приняли участие 126 студентов Калифорнийского университета в Сан-Диего, во втором — 158 участников с онлайн-платформы Prolific. Роли судьи и собеседника распределялись случайным образом. Исследователи создали интерфейс, похожий на привычный мессенджер. На общение отводилось ровно 5 минут. Затем судья определял, кто настоящий, оценивал свою уверенность и объяснял ход рассуждений. Учёные тестировали два типа промтов. Первый просто сообщал ИИ-модели, что она участвует в тесте Тьюринга. Второй предлагал ей играть интровертного молодого человека, хорошо знакомого с интернет-культурой и современным сленгом. Промт с заданной ролью резко изменил результаты. GPT-4.5 была признана человеком в 73 % случаев — она обманывала судей значительно чаще, чем реальные участники. LLaMa-3.1-405B с тем же промтом получила 56 %. При правильных промтах продвинутые LLM демонстрируют тот же тон, прямоту, юмор и склонность к ошибкам, что и люди, отметил Джонс. По его словам, тест показал, что ИИ-модели могут убедительно воспроизводить социальные поведенческие черты, а не только выдавать информацию на любую тему. С обычным промтом картина выглядела иначе. GPT-4.5 опознавалась как человек лишь в 36 % случаев, LLaMa-3.1-405B — в 38 %. Старые системы справлялись ещё хуже: ELIZA была выбрана как человек в 23 % случаев, GPT-4o — в 21 %. По словам Бергена, у ИИ-моделей есть способность выглядеть человекоподобными, но, возможно, не хватает способности самостоятельно разобраться, что для этого нужно. Для проверки устойчивости результатов учёные провели дополнительный эксперимент с 205 новыми участниками и увеличили время общения до 15 минут. В нём использовались GPT-5, LLaMa-3.1-405B и ELIZA. Даже с дополнительным временем судьи с трудом определяли машины, играющие человека: GPT-5 была признана человеком в 59 % случаев, LLaMa-3.1-405B — в 56 %. Простую ELIZA распознали легко — как человека её определили лишь в 17 % случаев. Большинство судей пытались вести светскую беседу — спрашивали о повседневных делах, личных мнениях и эмоциональном опыте. Они склонялись считать участника человеком, если тот допускал мелкие опечатки, демонстрировал пробелы в знаниях или отвечал прямо, без излишней формальности. По словам Бергена, эти черты далеки от математической и логической интеллектуальности, которую, вероятно, имел в виду Тьюринг. Авторы предостерегают от неверной интерпретации: прохождение теста не означает, что машина обладает подлинным интеллектом или сознанием. Скорее, она исключительно хорошо соответствует ожиданиям людей о том, как другой человек мог бы общаться в онлайне. Высокие показатели LLM полностью зависели от промта — без подробных инструкций ИИ-модели не могли стабильно обманывать судей. Это показывает, что им по-прежнему нужно человеческое руководство для убедительно человеческого поведения. Результаты несут практические последствия для доверия в интернете. По словам Джонса, настроить промт так, чтобы ИИ-модель стала неотличима от человека, достаточно легко, и при общении с незнакомцами в сети люди должны гораздо меньше полагаться на уверенность, что разговаривают именно с человеком. ИИ OpenAI решил 80-летнюю задачу Эрдёша — и на этот раз математики согласны

21.05.2026 [06:12],

Анжелла Марина

Компания OpenAI утверждает, что её новая модель рассуждений позволила получить оригинальное математическое доказательство, опровергающее известную нерешённую гипотезу в геометрии, впервые выдвинутую выдающимся математиком Полем Эрдёшем в 1946 году. Задача оставалась открытой на протяжении почти 80 лет.

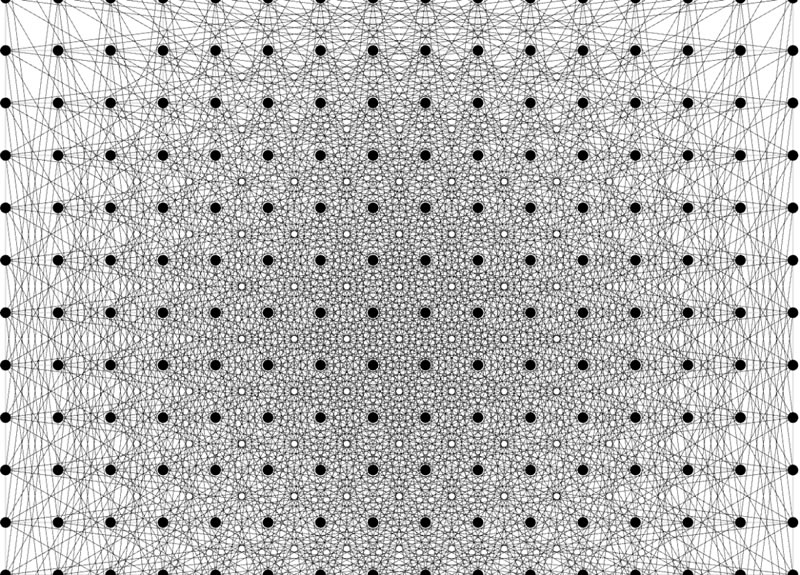

Источник изображения: OpenAI Долгие годы научное сообщество полагало, что лучшие варианты решения этой проблемы сводятся к структурам, похожим на квадратные сетки. Однако искусственный интеллект смог опровергнуть это убеждение, обнаружив совершенно новое семейство конструкций с более высокой эффективностью. Представители OpenAI подчеркнули, что это первый случай, когда ИИ автономно решил открытую проблему, имеющую центральное значение для математики. При этом доказательство было получено с помощью модели общего назначения, а не специализированной системы, созданной исключительно для точных наук. Текущему успеху предшествовал инцидент, произошедший семь месяцев назад, когда бывший вице-президент компании Кевин Вейл (Kevin Weil) поспешно заявил о решении моделью GPT-5 сразу десяти задач Эрдёша. Тогда выяснилось, что алгоритм лишь нашёл уже существующие в литературе ответы, после чего последовали насмешки со стороны специалистов и конкурентов, включая известного учёного в области информатики Яна Лекуна (Yann LeCun) и генерального директора Google DeepMind Демиса Хассабиса (Demis Hassabis). Вейл удалил свою публикацию, а математик Томас Блум (Thomas Bloom), ведущий сайт с задачами Эрдёша, назвал те заявления «драматическим искажением фактов». На этот раз разработчики учли прошлые ошибки и опубликовали анонс вместе с сопроводительными комментариями известных математиков, подтвердивших достоверность опровержения. Среди них: Нога Алон (Noga Alon), Мелани Вуд (Melanie Wood) и сам Томас Блум. По словам последнего, искусственный интеллект теперь помогает людям более полно исследовать математические концепции, выстраивавшиеся веками. В OpenAI считают это достижение знаковым, так как оно показало способность современных ИИ-систем удерживать длинные и сложные цепочки логических выводов. Кроме того, алгоритмы научились связывать идеи из разных областей способами, которые исследователи ранее могли упускать из виду. Цукерберг успокоил сотрудников Meta✴: новых массовых увольнений в этом году не ожидается

21.05.2026 [00:30],

Николай Хижняк

Генеральный директор Meta✴✴ Марк Цукерберг (Mark Zuckerberg) сообщил сотрудникам во внутренней служебной записке, что больше не ожидает массовых увольнений в компании в этом году. Об этом сообщило издание Reuters, ознакомившееся с копией данной служебной записки.

Источник изображения: Марк Цукерберг Цукерберг сделал это заявление в тот же день, когда провёл масштабную реструктуризацию компании, уволив 10 % сотрудников по всему миру и принудительно переведя ещё 7000 сотрудников на новые должности, связанные с внедрением искусственного интеллекта в рабочие процессы. «Я хочу прояснить, что мы не ожидаем массовых увольнений в компании в этом году. Я также хочу признать, что мы не были достаточно прозрачны в своих сообщениях, как нам хотелось бы, и это одна из тех областей, в которых я хочу добиться улучшений», — написал он в служебной записке. Сотрудники оставили комментарии к его посту, в которых цитировали слова «массовые увольнения» и «ожидать». «Иногда всё идёт "неожиданно"», — приводит Reuters слова одного из сотрудников. В Meta✴✴ отказались комментировать данную информацию. Эти изменения в компании являются частью масштабной реформы, проводимой Meta✴✴ в этом году, в рамках которой IT-гигант наращивает инвестиции в искусственный интеллект, стремясь сделать ИИ-агентов основой как своих продуктов, так и инструментов для внутренней работы. В общей сложности увольнения и переводы, о которых было объявлено на этой неделе, затронут около 20 % сотрудников компании. Некоторые переводы уже состоялись, а о других сотрудники будут уведомлены до конца дня. «Сбер» встал в очередь за китайскими чипами для «ГигаЧата» — перед ним ByteDance и Alibaba

20.05.2026 [18:44],

Сергей Сурабекянц

Глава «Сбера» Герман Греф заявил, что крупнейший российский банк надеется использовать процессоры китайского производства для работы флагманской модели искусственного интеллекта «ГигаЧат». Это заявление Грефа прозвучало в эфире «Первого канала» во время двухдневного визита Владимира Путина в Пекин, на фоне западных санкций, которые препятствуют российским закупкам передового иностранного оборудования для ИИ.

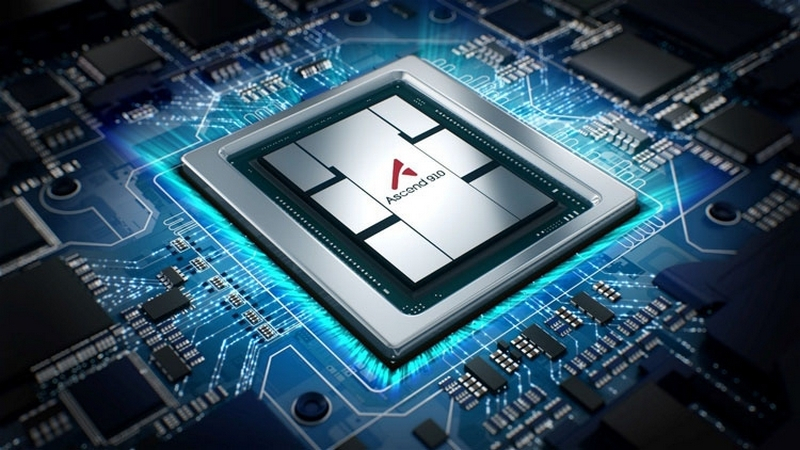

Источник изображения: Huawei Греф не уточнил, какие именно китайские чипы интересуют «Сбер», но наиболее вероятным кандидатом является семейство Ascend 950 от Huawei, которое стало объектом ожесточённой конкуренции среди китайских технологических гигантов. Запрос от «Сбера», несомненно, создаст дополнительные сложности для Huawei, которая должна выполнить огромные заказы от ByteDance, Alibaba и Tencent. Только ByteDance в начале этого года заказала чипов Ascend 950PR на сумму $5,6 млрд. Huawei планирует выпустить 750 000 процессоров 950PR в 2026 году, но производство на SMIC ограничено низким выходом годных изделий на 7-нм техпроцессе DUV и предполагаемым восьмимесячным циклом от начала производства до готового процессора. По производительности в режиме инференса 950PR находится между Nvidia H100 и H200 и, по заявлению производителя, превосходит ограниченный H20 в 2,8 раза, хотя эта цифра не поддаётся прямой проверке, поскольку чипы H20 не имеют встроенной поддержки FP4. Тем не менее, каждый чип, который Huawei может произвести, сталкивается с огромным внутренним спросом, поэтому российский покупатель будет конкурировать за квоты с компаниями, которые в совокупности составляют основу китайской интернет-экономики. В марте 2026 года «Сбер» запустил «ГигаЧат Ультра» с новым режимом рассуждений, а семейство базовых моделей за последний год расширилось за счёт «ГигаЧат 2.0» и «ГигаЧат Макс». Для запуска этих моделей в больших масштабах требуется как оборудование для вывода, так и для обучения, и чипы Ascend 950PR оптимизированы именно для вывода. Чип Huawei 950DT, ориентированный на обучение ИИ-моделей, поступит в продажу не раньше четвёртого квартала 2026 года и будет оснащён 144 Гбайт фирменной памяти Huawei HiZQ 2.0 с пропускной способностью 4 Тбайт/с. Существующая инфраструктура «Сбера» основана на комбинации западных графических процессоров, китайских аналогов и чипов российского производства, которые не обеспечивают конкурентоспособных возможностей для передовых задач ИИ. Если «Сбер» хочет получить полностью китайский вычислительный стек для своего «ГигаЧата», ему понадобятся оба чипа Huawei в огромных объёмах. В январе «Сбер» за 27 млрд ₽ приобрёл 41,9 % акций крупнейшего российского производителя электроники «Элемент». Компания выпускает интегральные схемы и полупроводниковые устройства, на долю которых приходится примерно половина российского производства микроэлектроники, но её продукция ориентирована на оборонные и промышленные приложения, а не на ускорители ИИ для дата-центров. Наиболее передовые российские технологии производства микросхем нацелены на 65-нанометровую литографию к 2030 году, что примерно на 25 лет отстаёт от передовых технологий. В подписанной сегодня совместной декларации лидеров России и Китая содержится призыв к более тесному двустороннему сотрудничеству в области ИИ и информация о создании глобального органа контроля за развитием ИИ. Пока неизвестно, приведёт ли это к фактическим поставкам в Россию китайских ИИ-ускорителей. Meta✴ готова предоставить ИИ-ботам конкурентов бесплатный доступ к WhatsApp, но с ограничениями

20.05.2026 [13:05],

Владимир Фетисов

Компания Meta✴✴ Platforms предложила конкурентам в сфере ИИ, таким как OpenAI, бесплатный доступ к своему сервису обмена сообщениями WhatsApp в Европе. При этом гигант соцсетей намерен взимать плату с разработчиков ИИ-ботов после достижения определённого лимита. Об этом пишет информационное агентство Reuters со ссылкой на собственные осведомлённые источники.

Источник изображения: Steve Johnson / unsplash.com В сообщении сказано, что Meta✴✴ представила своё предложение антимонопольным органам Евросоюза на прошлой неделе. Это произошло вскоре после того, как Еврокомиссия заявила о намерении издать распоряжение, обязывающее компанию предоставить конкурентам доступ к WhatsApp до завершения расследования отраслевого регулятора. Детали предложения Meta✴✴ по вопросу предоставления доступа к WhatsApp для сторонних ИИ-ботов остаются нераскрытыми. По данным источника, заинтересованные стороны должны были предоставить свои отзывы Еврокомиссии до 18 мая, то есть до того, как регулятор решит, принимать ли предложение Meta✴✴. Предложение предусматривает, что Meta✴✴ начнёт взимать плату с разработчиков ИИ-ботов после того, как они достигнут лимита по количеству сообщений, отправленных пользователям. Представители Еврокомиссии отказались от комментариев по данному вопросу, заявив, что для регулятора остаётся приоритетным сохранение растущего рынка ИИ-помощников открытым и конкурентным. Там также отметили, что предложение Meta✴✴ должно открыть пространство для дальнейших переговоров по устранению выявленных регулятором проблем. Meta✴✴ сообщила, что компания предоставила конкурирующим чат-ботам на базе ИИ в Европе бесплатный доступ к API WhatsApp на месяц, пока идёт процесс урегулирования вопросов с Еврокомиссией. При этом небольшие организации, такие как калифорнийская Interaction Company и французская Agentik, заявили, что их не впечатлило предложение Meta✴✴. Будущее Google в сфере ИИ сильно зависит от доверия пользователей и доступа к их личным данным

20.05.2026 [11:15],

Владимир Фетисов

Google строит большие планы, связанные с дальнейшим развитием искусственного интеллекта, и многие из них также связаны с доверием пользователей. В рамках конференции I/O 2026 компания анонсировала немало любопытных ИИ-функций, основанных на обработке массива личных данных пользователей.

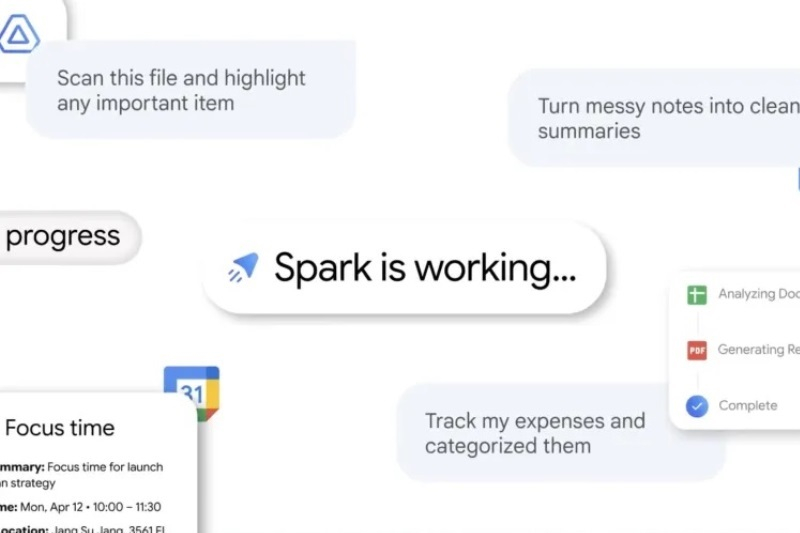

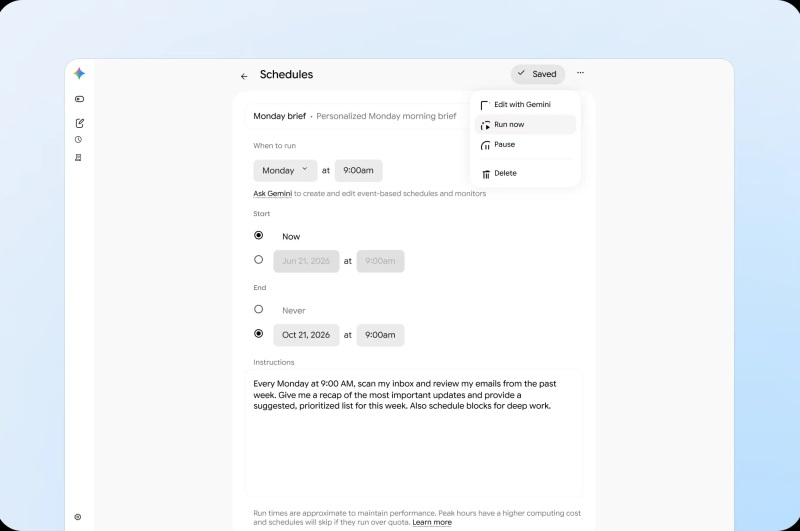

Источник изображений: Google Google анонсировала постоянно активного ИИ-агента Gemini Spark, который может помочь, например, с организацией предстоящего мероприятия, а инструмент Daily Brief предоставит краткий обзор запланированных на день дел. Google также расширяет доступ к ИИ-интерфейсу Gmail, который позволяет генерировать списки дел и ответы на поступающие письма. Многие из анонсированных функций выглядят действительно полезными, но в основе каждой из них ИИ-движок, работающий с массивом личных данных пользователя. В отличие от конкурентов, таких как OpenAI и Anthropic, которые позволяют подключать другие приложения и данные, доступ Gemini к личным данным, хранящимся в сервисах Google, находится за простым меню согласия. Именно это является одним из ключевых преимуществ поискового гиганта над конкурентами. Google начала внедрять персонализированные функции ещё в 2024 году, когда интегрировала Gemini в некоторые приложения Workspace, такие как Gmail, «Документы», «Таблицы» и др. На тот момент ИИ-бот мог выполнять некоторые действия, такие как поиск нужных документов и написание черновиков писем. В это же время инструмент Deep Research на базе Gemini может получать доступ к электронным письмам пользователей, облачному хранилищу и чатам, чтобы использовать эти данные в качестве источников в процессе своей работы. За последние несколько месяцев эти интеграции постепенно расширялись. В январе Google представила Personal Intelligence — ИИ-функцию, которая позволяет Gemini анализировать информацию из Gmail, «Google Фото», поисковика Google и истории YouTube без дополнительных запросов. Это означает, что Gemini может автоматически извлекать данные из аккаунтов пользователей, чтобы делать ответы на запросы более персонализированными.  Хотя доступ Gemini к данным пользователя является опциональным, похоже, что будущее ИИ-инструментов Google во многом зависит именно от того, будут ли люди доверять им конфиденциальную информацию. Так функция Daily Brief, которая уже внедряется для подписчиков Google AI Plus, Pro и Ultra, сканирует поступающие в Gmail письма и отмечает события из календаря пользователя. Gemini Spark проникает ещё глубже в данные пользователя. Google позиционирует этот инструмент, как персонального ассистента, способного работать внутри приложений Workspace круглосуточно и обрабатывать разные задачи. Однако подключение к Workspace это только начало, поскольку Gemini Spark может взаимодействовать со сторонними сервисами, такими как Canva, OpenTable, Spotify, Instacart, Adobe и др. Google даже планирует реализовать возможность предоставления доступа Gemini Spark к локальным файлам на компьютерах Apple Mac, подобно тому, как это происходит при использовании OpenClaw. Многие люди могут не захотеть предоставлять ИИ-помощнику доступ ко всему содержимому своих ПК. Однако успех OpenClaw доказывает, что ИИ-системы переходят из разряда новинок в разряд реальных инструментов для повышения производительности, которым для работы нужен доступ к данным пользователей. Вопрос лишь в том, насколько потребители доверяют компаниям, стоящим за такими системами. Google научила ИИ Project Genie превращать панорамы Street View в игровую 3D-вселенную

20.05.2026 [07:04],

Анжелла Марина

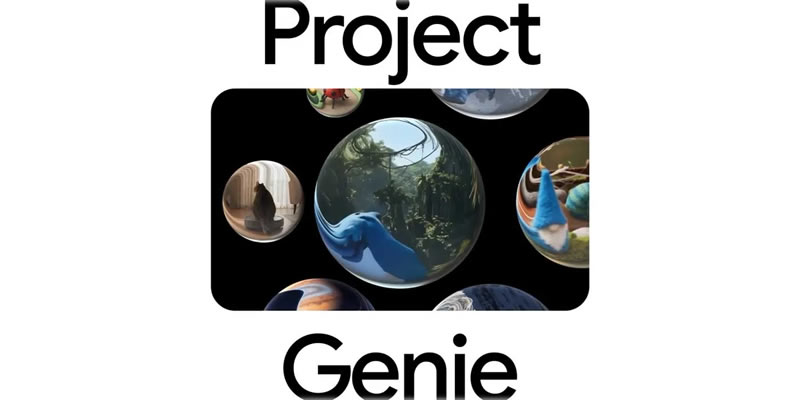

Google обновила свой экспериментальный ИИ-инструмент Project Genie, добавив в него интеграцию с панорамными снимками Street View. Об этом сообщил ресурс 9to5Google. Инструмент, запущенный в начале года на базе моделей Nana Banana Pro, теперь умеет на лету собирать небольшие трёхмерные пространства.

Источник изображения: 9to5google.com Раньше нейросеть генерировала исключительно вымышленные локации, но теперь способна превратить в игровую зону любое реальное место, включая улицу возле дома пользователя. Чтобы запустить симуляцию, достаточно поставить маркер на карте и выбрать стиль, например, превратить окружение в «Пустынные пески» или перенести его в «Каменный век». Что касается персонажа, то его можно выбрать, просто введя текстовый запрос. Им может стать любимое животное, герой комиксов или пластилиновый монстр. На основе этих параметров искусственный интеллект возьмёт за основу фотографии дорог и выстроит вокруг них интерактивное окружение с видом от первого или третьего лица. География виртуальных прогулок ограничена только масштабами базы Street View. Поскольку генерация сотен связанных между собой кадров требует огромных мощностей, картинка обновляется со скоростью 20–24 кадра в секунду, а одна сессия с привычным управлением на клавишах WASD (в английской раскладке) длится не более 60 секунд. Пока проект работает в режиме исследования, поэтому детализация мест может быть неточной. На данном этапе функция доступна только в США и исключительно для пользователей с премиальным тарифом AI Ultra, однако со временем Google планирует повысить чёткость графики и открыть доступ для других стран. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |