|

Опрос

|

реклама

Быстрый переход

Цукерберг успокоил сотрудников Meta✴: новых массовых увольнений в этом году не ожидается

21.05.2026 [00:30],

Николай Хижняк

Генеральный директор Meta✴✴ Марк Цукерберг (Mark Zuckerberg) сообщил сотрудникам во внутренней служебной записке, что больше не ожидает массовых увольнений в компании в этом году. Об этом сообщило издание Reuters, ознакомившееся с копией данной служебной записки.

Источник изображения: Марк Цукерберг Цукерберг сделал это заявление в тот же день, когда провёл масштабную реструктуризацию компании, уволив 10 % сотрудников по всему миру и принудительно переведя ещё 7000 сотрудников на новые должности, связанные с внедрением искусственного интеллекта в рабочие процессы. «Я хочу прояснить, что мы не ожидаем массовых увольнений в компании в этом году. Я также хочу признать, что мы не были достаточно прозрачны в своих сообщениях, как нам хотелось бы, и это одна из тех областей, в которых я хочу добиться улучшений», — написал он в служебной записке. Сотрудники оставили комментарии к его посту, в которых цитировали слова «массовые увольнения» и «ожидать». «Иногда всё идёт "неожиданно"», — приводит Reuters слова одного из сотрудников. В Meta✴✴ отказались комментировать данную информацию. Эти изменения в компании являются частью масштабной реформы, проводимой Meta✴✴ в этом году, в рамках которой IT-гигант наращивает инвестиции в искусственный интеллект, стремясь сделать ИИ-агентов основой как своих продуктов, так и инструментов для внутренней работы. В общей сложности увольнения и переводы, о которых было объявлено на этой неделе, затронут около 20 % сотрудников компании. Некоторые переводы уже состоялись, а о других сотрудники будут уведомлены до конца дня. «Сбер» встал в очередь за китайскими чипами для «ГигаЧата» — перед ним ByteDance и Alibaba

20.05.2026 [18:44],

Сергей Сурабекянц

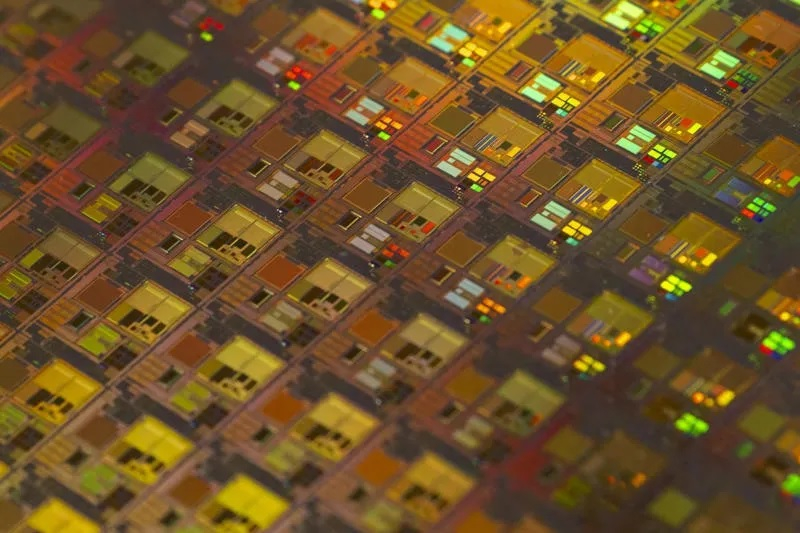

Глава «Сбера» Герман Греф заявил, что крупнейший российский банк надеется использовать процессоры китайского производства для работы флагманской модели искусственного интеллекта «ГигаЧат». Это заявление Грефа прозвучало в эфире «Первого канала» во время двухдневного визита Владимира Путина в Пекин, на фоне западных санкций, которые препятствуют российским закупкам передового иностранного оборудования для ИИ.

Источник изображения: Huawei Греф не уточнил, какие именно китайские чипы интересуют «Сбер», но наиболее вероятным кандидатом является семейство Ascend 950 от Huawei, которое стало объектом ожесточённой конкуренции среди китайских технологических гигантов. Запрос от «Сбера», несомненно, создаст дополнительные сложности для Huawei, которая должна выполнить огромные заказы от ByteDance, Alibaba и Tencent. Только ByteDance в начале этого года заказала чипов Ascend 950PR на сумму $5,6 млрд. Huawei планирует выпустить 750 000 процессоров 950PR в 2026 году, но производство на SMIC ограничено низким выходом годных изделий на 7-нм техпроцессе DUV и предполагаемым восьмимесячным циклом от начала производства до готового процессора. По производительности в режиме инференса 950PR находится между Nvidia H100 и H200 и, по заявлению производителя, превосходит ограниченный H20 в 2,8 раза, хотя эта цифра не поддаётся прямой проверке, поскольку чипы H20 не имеют встроенной поддержки FP4. Тем не менее, каждый чип, который Huawei может произвести, сталкивается с огромным внутренним спросом, поэтому российский покупатель будет конкурировать за квоты с компаниями, которые в совокупности составляют основу китайской интернет-экономики. В марте 2026 года «Сбер» запустил «ГигаЧат Ультра» с новым режимом рассуждений, а семейство базовых моделей за последний год расширилось за счёт «ГигаЧат 2.0» и «ГигаЧат Макс». Для запуска этих моделей в больших масштабах требуется как оборудование для вывода, так и для обучения, и чипы Ascend 950PR оптимизированы именно для вывода. Чип Huawei 950DT, ориентированный на обучение ИИ-моделей, поступит в продажу не раньше четвёртого квартала 2026 года и будет оснащён 144 Гбайт фирменной памяти Huawei HiZQ 2.0 с пропускной способностью 4 Тбайт/с. Существующая инфраструктура «Сбера» основана на комбинации западных графических процессоров, китайских аналогов и чипов российского производства, которые не обеспечивают конкурентоспособных возможностей для передовых задач ИИ. Если «Сбер» хочет получить полностью китайский вычислительный стек для своего «ГигаЧата», ему понадобятся оба чипа Huawei в огромных объёмах. В январе «Сбер» за 27 млрд ₽ приобрёл 41,9 % акций крупнейшего российского производителя электроники «Элемент». Компания выпускает интегральные схемы и полупроводниковые устройства, на долю которых приходится примерно половина российского производства микроэлектроники, но её продукция ориентирована на оборонные и промышленные приложения, а не на ускорители ИИ для дата-центров. Наиболее передовые российские технологии производства микросхем нацелены на 65-нанометровую литографию к 2030 году, что примерно на 25 лет отстаёт от передовых технологий. В подписанной сегодня совместной декларации лидеров России и Китая содержится призыв к более тесному двустороннему сотрудничеству в области ИИ и информация о создании глобального органа контроля за развитием ИИ. Пока неизвестно, приведёт ли это к фактическим поставкам в Россию китайских ИИ-ускорителей. Meta✴ готова предоставить ИИ-ботам конкурентов бесплатный доступ к WhatsApp, но с ограничениями

20.05.2026 [13:05],

Владимир Фетисов

Компания Meta✴✴ Platforms предложила конкурентам в сфере ИИ, таким как OpenAI, бесплатный доступ к своему сервису обмена сообщениями WhatsApp в Европе. При этом гигант соцсетей намерен взимать плату с разработчиков ИИ-ботов после достижения определённого лимита. Об этом пишет информационное агентство Reuters со ссылкой на собственные осведомлённые источники.

Источник изображения: Steve Johnson / unsplash.com В сообщении сказано, что Meta✴✴ представила своё предложение антимонопольным органам Евросоюза на прошлой неделе. Это произошло вскоре после того, как Еврокомиссия заявила о намерении издать распоряжение, обязывающее компанию предоставить конкурентам доступ к WhatsApp до завершения расследования отраслевого регулятора. Детали предложения Meta✴✴ по вопросу предоставления доступа к WhatsApp для сторонних ИИ-ботов остаются нераскрытыми. По данным источника, заинтересованные стороны должны были предоставить свои отзывы Еврокомиссии до 18 мая, то есть до того, как регулятор решит, принимать ли предложение Meta✴✴. Предложение предусматривает, что Meta✴✴ начнёт взимать плату с разработчиков ИИ-ботов после того, как они достигнут лимита по количеству сообщений, отправленных пользователям. Представители Еврокомиссии отказались от комментариев по данному вопросу, заявив, что для регулятора остаётся приоритетным сохранение растущего рынка ИИ-помощников открытым и конкурентным. Там также отметили, что предложение Meta✴✴ должно открыть пространство для дальнейших переговоров по устранению выявленных регулятором проблем. Meta✴✴ сообщила, что компания предоставила конкурирующим чат-ботам на базе ИИ в Европе бесплатный доступ к API WhatsApp на месяц, пока идёт процесс урегулирования вопросов с Еврокомиссией. При этом небольшие организации, такие как калифорнийская Interaction Company и французская Agentik, заявили, что их не впечатлило предложение Meta✴✴. Будущее Google в сфере ИИ сильно зависит от доверия пользователей и доступа к их личным данным

20.05.2026 [11:15],

Владимир Фетисов

Google строит большие планы, связанные с дальнейшим развитием искусственного интеллекта, и многие из них также связаны с доверием пользователей. В рамках конференции I/O 2026 компания анонсировала немало любопытных ИИ-функций, основанных на обработке массива личных данных пользователей.

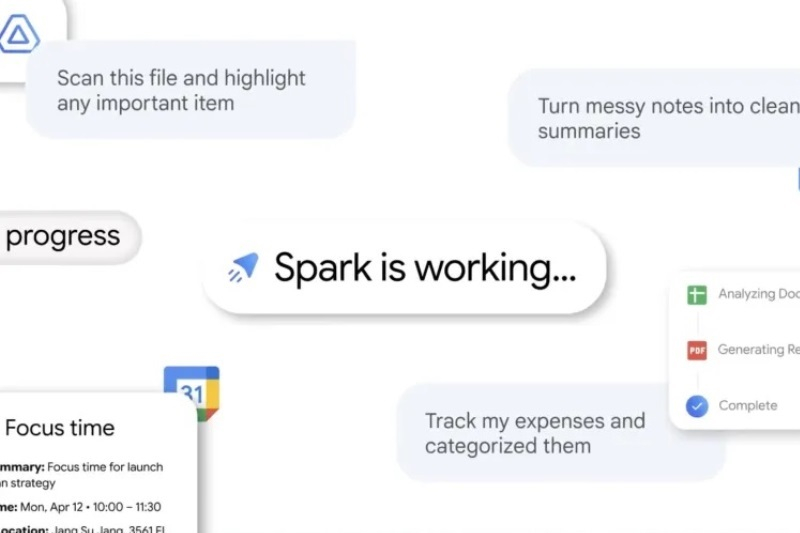

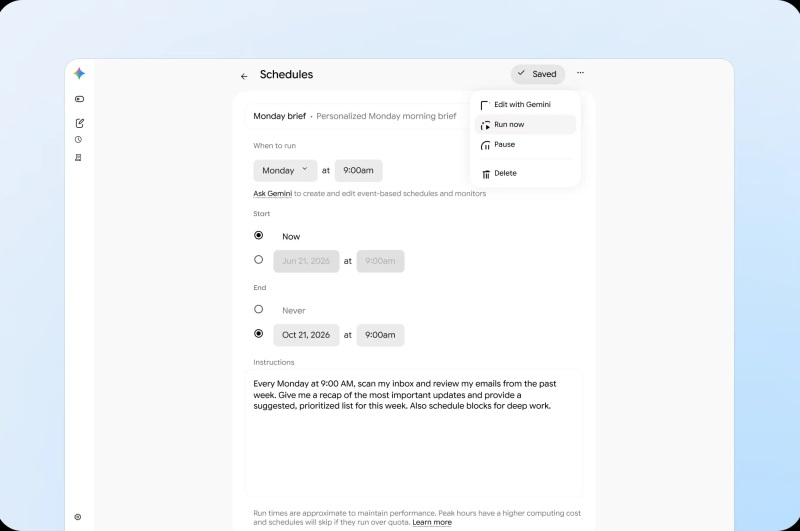

Источник изображений: Google Google анонсировала постоянно активного ИИ-агента Gemini Spark, который может помочь, например, с организацией предстоящего мероприятия, а инструмент Daily Brief предоставит краткий обзор запланированных на день дел. Google также расширяет доступ к ИИ-интерфейсу Gmail, который позволяет генерировать списки дел и ответы на поступающие письма. Многие из анонсированных функций выглядят действительно полезными, но в основе каждой из них ИИ-движок, работающий с массивом личных данных пользователя. В отличие от конкурентов, таких как OpenAI и Anthropic, которые позволяют подключать другие приложения и данные, доступ Gemini к личным данным, хранящимся в сервисах Google, находится за простым меню согласия. Именно это является одним из ключевых преимуществ поискового гиганта над конкурентами. Google начала внедрять персонализированные функции ещё в 2024 году, когда интегрировала Gemini в некоторые приложения Workspace, такие как Gmail, «Документы», «Таблицы» и др. На тот момент ИИ-бот мог выполнять некоторые действия, такие как поиск нужных документов и написание черновиков писем. В это же время инструмент Deep Research на базе Gemini может получать доступ к электронным письмам пользователей, облачному хранилищу и чатам, чтобы использовать эти данные в качестве источников в процессе своей работы. За последние несколько месяцев эти интеграции постепенно расширялись. В январе Google представила Personal Intelligence — ИИ-функцию, которая позволяет Gemini анализировать информацию из Gmail, «Google Фото», поисковика Google и истории YouTube без дополнительных запросов. Это означает, что Gemini может автоматически извлекать данные из аккаунтов пользователей, чтобы делать ответы на запросы более персонализированными.  Хотя доступ Gemini к данным пользователя является опциональным, похоже, что будущее ИИ-инструментов Google во многом зависит именно от того, будут ли люди доверять им конфиденциальную информацию. Так функция Daily Brief, которая уже внедряется для подписчиков Google AI Plus, Pro и Ultra, сканирует поступающие в Gmail письма и отмечает события из календаря пользователя. Gemini Spark проникает ещё глубже в данные пользователя. Google позиционирует этот инструмент, как персонального ассистента, способного работать внутри приложений Workspace круглосуточно и обрабатывать разные задачи. Однако подключение к Workspace это только начало, поскольку Gemini Spark может взаимодействовать со сторонними сервисами, такими как Canva, OpenTable, Spotify, Instacart, Adobe и др. Google даже планирует реализовать возможность предоставления доступа Gemini Spark к локальным файлам на компьютерах Apple Mac, подобно тому, как это происходит при использовании OpenClaw. Многие люди могут не захотеть предоставлять ИИ-помощнику доступ ко всему содержимому своих ПК. Однако успех OpenClaw доказывает, что ИИ-системы переходят из разряда новинок в разряд реальных инструментов для повышения производительности, которым для работы нужен доступ к данным пользователей. Вопрос лишь в том, насколько потребители доверяют компаниям, стоящим за такими системами. Google научила ИИ Project Genie превращать панорамы Street View в игровую 3D-вселенную

20.05.2026 [07:04],

Анжелла Марина

Google обновила свой экспериментальный ИИ-инструмент Project Genie, добавив в него интеграцию с панорамными снимками Street View. Об этом сообщил ресурс 9to5Google. Инструмент, запущенный в начале года на базе моделей Nana Banana Pro, теперь умеет на лету собирать небольшие трёхмерные пространства.

Источник изображения: 9to5google.com Раньше нейросеть генерировала исключительно вымышленные локации, но теперь способна превратить в игровую зону любое реальное место, включая улицу возле дома пользователя. Чтобы запустить симуляцию, достаточно поставить маркер на карте и выбрать стиль, например, превратить окружение в «Пустынные пески» или перенести его в «Каменный век». Что касается персонажа, то его можно выбрать, просто введя текстовый запрос. Им может стать любимое животное, герой комиксов или пластилиновый монстр. На основе этих параметров искусственный интеллект возьмёт за основу фотографии дорог и выстроит вокруг них интерактивное окружение с видом от первого или третьего лица. География виртуальных прогулок ограничена только масштабами базы Street View. Поскольку генерация сотен связанных между собой кадров требует огромных мощностей, картинка обновляется со скоростью 20–24 кадра в секунду, а одна сессия с привычным управлением на клавишах WASD (в английской раскладке) длится не более 60 секунд. Пока проект работает в режиме исследования, поэтому детализация мест может быть неточной. На данном этапе функция доступна только в США и исключительно для пользователей с премиальным тарифом AI Ultra, однако со временем Google планирует повысить чёткость графики и открыть доступ для других стран. Anthropic переманила сооснователя OpenAI — Андрей Карпатый будет обучать Claude

19.05.2026 [19:43],

Сергей Сурабекянц

Андрей Карпатый (Andrej Karpathy), исследователь в области ИИ, соучредитель и бывший сотрудник OpenAI, ранее возглавлявший отдел ИИ в Tesla, присоединился к компании Anthropic. Он работает над предварительным обучением ИИ, которое обеспечивает Claude основные знания и возможности. Предварительное обучение — один из самых дорогостоящих и ресурсоёмких этапов создания передовой модели.

Источник изображения: karpathy.ai Карпатый создаст команду, которая будет заниматься использованием Claude для ускорения исследований в области предварительного обучения. Он один из немногих исследователей, способных преодолеть разрыв между теорией больших языковых моделей и практикой крупномасштабного обучения. Это назначение показывает, что именно исследования с использованием ИИ, а не просто вычислительные мощности, являются, по мнению Anthropic, залогом конкурентоспособности при разработке ИИ. В OpenAI Карпатый занимался глубоким обучением и компьютерным зрением, пока не покинул компанию в 2017 году. До 2022 года он руководил программами Tesla по полному автономному вождению (FSD) и автопилоту. Затем он вернулся в OpenAI на год, после чего в 2024 году основал свой стартап Eureka Labs, занимающийся применением ИИ-помощников в образовании. Карпатый не делился подробной информацией о Eureka Labs с момента её запуска, и неясно, продолжит ли он работу в этом стартапе. Он также преподавал онлайн-курс под названием «Нейронные сети: от нуля до героя», который помогает студентам научиться создавать нейронные сети с нуля в коде, и ведёт канал на YouTube, где периодически публикует лекции по магистерским программам и искусственному интеллекту. «Я присоединился к Anthropic, — написал сегодня Карпатый в социальной сети X. — Думаю, следующие несколько лет на переднем крае LLM будут особенно важными. Я очень рад присоединиться к команде и вернуться к исследованиям и разработкам». По его словам, он «по-прежнему глубоко увлечён образованием и планирует возобновить свою работу в этой области со временем». Anthropic также привлекла ветерана кибербезопасности с более чем 20-летним опытом Криса Рольфа (Chris Rohlf) в команду Red Team, которая проводит стресс-тестирование сложных моделей ИИ на предмет угроз. Последние шесть лет Рольф проработал в Meta✴✴. Ранее он был научным сотрудником Центра безопасности и новых технологий Джорджтаунского университета, где работал над проектом CyberAI. «Перед нами открывается реальная возможность кардинально улучшить кибербезопасность с помощью ИИ, — заявил Рольф. — Я не могу представить себе лучшей компании или команды, к которой можно было бы присоединиться в этот критически важный момент». «Бессмысленная фиктивная работа»: ИИ завалил разработчиков Linux дублями сообщений об уязвимостях

18.05.2026 [18:51],

Сергей Сурабекянц

Основатель Linux Линус Торвальдс (Linus Torvalds) в своём последнем сообщении о состоянии ядра заявил, что «постоянный поток сообщений об ошибках, генерируемых ИИ, сделал список уязвимостей безопасности практически полностью неуправляемым, с огромным дублированием из-за того, что разные люди обнаруживают одни и те же проблемы с помощью одних и тех же инструментов».

Источник изображения: xAI По мнению Торвальдса, «предельно ясно: если вы обнаружили ошибку с помощью инструментов ИИ, велика вероятность, что кто-то другой тоже её обнаружил». Он назвал дублирующиеся отчёты об ошибках «совершенно бессмысленной рутиной». Торвальдс подчеркнул, что обнаруженные ИИ ошибки по определению не являются секретными, а их обработка в каком-либо закрытом списке — пустая трата времени для всех участников. Более того, это только усугубляет дублирование, потому что авторы сообщений о найденных уязвимостях не видят отчётов других исследователей. «Инструменты ИИ — это здорово, но только если они действительно помогают, а не причиняют ненужную боль и не создают бессмысленную фиктивную работу. Можете использовать их, но используйте продуктивно и для улучшения пользовательского опыта, — продолжил Торвальдс. — Если вы действительно хотите принести пользу, прочитайте документацию, создайте патч и добавьте реальную ценность к тому, что сделал ИИ. Не будьте тем, кто просто отправляет случайный отчёт, не имея реального понимания». Старший инженер по безопасности продуктов GitHub Джаром Браун (Jarom Brown) аналогичным образом отреагировал на волну недавних сообщений об ошибках, связанных с ИИ, заявив, что, хотя у GitHub «нет проблем» с инструментами ИИ в целом, сообщения об ошибках, созданные с помощью ИИ, должны быть проверены, чтобы приносить пользу. «Сообщение об ошибке, созданное с помощью ИИ, которое было проверено, воспроизведено и представлено с рабочим доказательством концепции, — это отличная заявка. Непроверенный результат, представленный как есть без воспроизведения или продемонстрированного влияния, — нет», — отметил он. Браун порекомендовал отдавать приоритет не количеству найденных ошибок, а глубине исследования. По его мнению, одно хорошо исследованное и проверенное сообщение стоит больше, чем десять предположительных — как с точки зрения вознаграждения, так и репутации. Он также обратил внимание, что больше всего на программе GitHub по поиску ошибок зарабатывают те, кто глубоко погружается в проблему и всесторонне её изучает. Google захлебнулась в спросе на ИИ: даже исследователи DeepMind стоят в очереди за TPU

18.05.2026 [18:03],

Сергей Сурабекянц

Исследователям ИИ Google приходится конкурировать за вычислительные мощности, которые распределяются в зависимости от потенциальной прибыльности проектов, к тому же приоритет порой отдаётся платным клиентам. Лидерство компании в разработке ИИ сделало вычислительные мощности настолько ценным ресурсом, что некоторые исследователи запускают собственные стартапы, где у них больше свободы и нет необходимости преодолевать бюрократические препоны Google.

Источник изображения: TechSpot В гонке за создание инфраструктуры, которая обеспечивает работу искусственного интеллекта, Google занимает завидное положение: компания имеет процветающий бизнес облачных вычислений, производит собственные чипы и заключила соглашения о совместном использовании с такими компаниями, как Anthropic и Meta✴✴. Однако успех компании сделал её вычислительные ресурсы настолько ценными, что собственным исследователям ИИ приходится вставать в очередь. В лаборатории искусственного интеллекта Google DeepMind доступ к вычислительным мощностям влияет на проекты, которые реализуют исследователи, на лидеров, с которыми они сотрудничают, и на темп работы. «Внутри Google на каждый TPU есть [как минимум] три претендента, — говорит опытный исследователь в области ИИ, почётный профессор Вашингтонского университета Орен Этциони (Oren Etzioni). — Если вы оказались в неудобном положении, когда у вас есть несбыточный проект, и вы конкурируете с прибыльным клиентом, это очень сложная ситуация». Google заявляет, что использует «строгий, непрерывный процесс, который гарантирует, что наши вычислительные ресурсы распределяются по наиболее важным приоритетам, балансируя сегодняшние потребности клиентов и пользователей с долгосрочными инвестициями в развитие исследований и инноваций». Генеральный директор Alphabet Сундар Пичаи (Sundar Pichai) утверждает, что при принятии решения о том, куда направить вычислительные мощности, руководители компании сосредоточены на обеспечении Google DeepMind необходимыми ресурсами для создания передовых моделей ИИ, «потому что это основа всего, что мы делаем».

Источник изображений: Google Исследователи ИИ когда-то считали Google местом, где они могли свободно заниматься своими интеллектуальными увлечениями, почти как в академической среде, но с лучшей оплатой и большими ресурсами. Однако в 2022 году запуск ChatGPT побудил Google инвестировать в большие языковые модели, которые создают компьютерный код, что, как показали конкуренты, может стать успешным продуктом и приносить существенный доход. Это снизило инвестиции в экспериментальные проекты, которые не могут принести сиюминутного дохода, и заставило многих ИИ-специалистов задуматься об основании собственных стартапов. Портфель заказов Google Cloud почти удвоился по сравнению с предыдущим кварталом и превысил $460 млрд. «В краткосрочной перспективе мы испытываем нехватку вычислительных мощностей, — признал Пичаи. — Мы преодолеваем этот момент и инвестируем». Чтобы наверстать упущенное в гонке ИИ, Google в 2023 году объединила лондонскую лабораторию DeepMind, имевшую более иерархическую структуру, и Google Brain, где исследователи занимались персональными проектами с минимальным контролем. Исследователи в Brain получали кредиты на покупку чипов во внутренней системе, где цена колебалась в зависимости от спроса, подобно фондовому рынку. По словам Голди, «это был мощный способ сплотиться и добиться результата».  В ведущих лабораториях ИИ некоторые исследователи вынуждены работать над приоритетными языковыми моделями, даже если их истинные интересы лежат в другой области. «Есть приманка в виде вычислительных мощностей, продвижения и, в целом, участия в триумфальном процессе обучения, — говорит бывший исследователь Google Том Макграт (Tom McGrath). — Есть и кнут: если вы этого не сделаете, у вас не будет никаких ускорителей». Доступ к вычислительным мощностям для многих учёных стал главным аргументом. По словам бывшей сотрудницы DeepMind Анны Голди (Anna Goldie), компания предлагала ей больше вычислительных мощностей, чтобы отговорить от ухода, но она всё равно ушла, основав компанию Ricursive Intelligence, которая уже привлекла $335 млн инвестиций. Голди «была приятно удивлена» тем, сколько вычислительных мощностей ей удалось найти за пределами компании. «Мне не нужно спрашивать разрешения у десяти вышестоящих руководителей, — заявила она. — Я могу просто принять решение […], чтобы сделать то, что лучше для компании. Я могу прислушиваться к своим сотрудникам и их идеям». «Игра в искусственный интеллект всегда имела два аспекта, — считает бывший исследователь Google DeepMind Иоаннис Антоноглу (Ioannis Antonoglou). — Первый — у кого больше вычислительных мощностей. А второй — кто сможет использовать их лучше». ИИ-функции Google Gemini Intelligence появятся лишь на нескольких производительных Android-смартфонах

17.05.2026 [21:09],

Владимир Фетисов

На этой неделе Google представила Gemini Intelligence — набор функций на базе искусственного интеллекта, которые будут доступны на производительных смартфонах с Android. Однако не стоит ждать того, что эти функции появятся на большом количестве смартфонов, по крайней мере какое-то время.

Источник изображения: Google В состав Gemini Intelligence входят инструменты для автоматизации выполнения многоэтапных задач в фоновом режиме. К примеру, можно автоматизировать поиск и преобразование информации, а также взаимодействие с приложениями и веб-сайтами от имени пользователя. В Gboard даже появился компонент, позволяющий пользователю свободно говорить привычным языком, в том числе с использованием слов-паразитов, а также смешивая слова из разных языков в одном предложении. Согласно имеющимся данным, функции Gemini Intelligence дебютируют на смартфонах Samsung Galaxy Z Fold8 и Z Flip8. Google также подтвердила, что позднее они станут доступны на смартфонах Galaxy S26 и Pixel 10. В описании Gemini Intelligence эти ИИ-функции представляются как премиальная и эксклюзивная вещь, по крайней мере пока. Для работы Gemini Intelligence нужно не менее 12 Гбайт оперативной памяти, а само устройство должно поддерживать AICore, являющееся системной службой Android для выполнения ИИ-задач с использованием модели Gemini Nano. В описании Gemini Intelligence сказано, что для работы ИИ-функций требуется модель Gemini Nano v3 или выше. В настоящее время существует всего несколько смартфонов, которые поддерживают это. Вместе с этим требуется наличие микропроцессора «флагманского уровня», а само устройство должно получать пять лет обновления ОС и шесть лет ежеквартальных обновлений безопасности. Необходима поддержка Android Virtualization Framework и Protected Kernel-based Virtual Machine. Есть даже расплывчатый пункт о соблюдении требований к «производительности мультимедиа»: пространственный звук, съёмка при плохом освещении, HDR и др. Всё это указывает на то, что функции Gemini Intelligence станут действительно эксклюзивным продуктом, который доступен на очень ограниченном количестве устройств. Любопытно, что базовые версии смартфонов Pixel 11, как ожидается, получат 8 Гбайт ОЗУ. Это может означать, что фирменные функции Gemini Intelligence будут доступны не всех смартфонах компании. Мальта стала первой страной, граждане которой бесплатно получат годовую подписку на ChatGPT Plus

17.05.2026 [07:17],

Дмитрий Федоров

OpenAI подписала соглашение с правительством Мальты, по которому все граждане страны получат бесплатный годовой доступ к ChatGPT Plus при условии прохождения курса по использованию ИИ.

Источник изображения: Levart_Photographer / unsplash.com Программа стартует в мае и будет расширяться по мере того, как новые участники будут завершать обучение. Курс бесплатный. Воспользоваться предложением смогут и мальтийские граждане, проживающие за рубежом. «Мы превращаем незнакомую концепцию в практическую помощь для наших семей, студентов и работников», — заявил министр экономики Мальты Сильвио Шембри (Silvio Schembri). Мальта стала первой страной мира, заключившей подобную сделку. Финансовые условия соглашения OpenAI не раскрыла. Китайские ИТ-гиганты ускорили переход на отечественные ИИ-ускорители, несмотря на возможное возвращение Nvidia

16.05.2026 [11:02],

Владимир Фетисов

Производство китайских ускорителей для ИИ может вырасти в этом году, поскольку крупнейшие технологические компании страны стремятся внедрить больше отечественных технологий. Это происходит на фоне сообщений о возможном возвращении на рынок Китая продукции американской Nvidia.

Источник изображения: Maxence Pira / unsplash.com На этой неделе интернет-гигант Tencent объявил, что ожидает активизации производства отечественной полупроводниковой продукции, а гигант электронной коммерции Alibaba сообщил об увеличении масштабов использования ускорителей собственной разработки. Эти сообщения подчёркивают, что в отсутствие на рынке Китая передовых чипов Nvidia из-за экспортных ограничений со стороны США страна активно продвигает отечественные разработки для реализации собственных амбиций в сфере искусственного интеллекта. Директор по стратегическому развитию Tencent Джеймс Митчелл (James Mitchell) заявил, что компания планирует «существенное увеличение» капитальных затрат, особенно во второй половине года, поскольку китайские ускорители «доступны нам из месяца в месяц». Он также добавил, что поставки графических ускорителей китайской разработки будут постепенно наращиваться в течение года. В дополнение к этому было сказано, что объём поставок китайских ускорителей растёт как за счёт производственных мощностей внутри КНР, так и за счёт предприятий в соседних странах. В Китае существует множество местных производителей чипов, которые активизировались за счёт выхода на биржу и запуска новых продуктов. В число компаний, которые пытаются заполнить вакуум, образовавшийся после введения экспортных ограничений со стороны США, входят Moore Threads, MetaX и Huawei. Это послужило основой для того, чтобы выручка китайских производителей чипов достигла рекордных показателей. Alibaba разрабатывает собственные ИИ-ускорители, которые использует в своих центрах обработки данных, являющихся основой облачного бизнеса компании. «Собственные ускорители от T-Head достигли стадии массового производства. В условиях нехватки вычислительных ресурсов это структурное преимущество благоприятно сказывается на росте нашей выручки и увеличении валовой маржи»,— заявил представитель Alibaba во время объявления финансовых результатов по итогам квартала. Alibaba также дала понять, что компания может поставлять серверы на базе собственных ускорителей другим игрокам, строящим вычислительные кластеры или центры обработки данных. Также не исключается вариант совместного строительства таких объектов, что подчёркивает растущую роль технологического гиганта в китайской полупроводниковой отрасли. Заявления Alibaba и Tencent прозвучали за день до того, как появились сообщения о том, что США дали зелёный свет нескольким китайским компаниям, включая Alibaba и Tencent, на покупку ускорителей Nvidia H200, входящих в число наиболее производительных ИИ-ускорителей на рынке. Однако официального подтверждения этого до сих пор не было. «Для меня это новость. Я знаю, что было много споров <…> и нам придётся посмотреть на это. Это функция министерства торговли», — прокомментировал данный вопрос министр финансов США Скотт Бессент (Scott Bessent). За последний год СМИ неоднократно писали о том, что Вашингтон дал разрешение Nvidia на поставку в Китай не самых мощных ИИ-ускорителей, таких как H20. Параллельно с этим сообщалось, что власти Китая поощряют местные компании за использование отечественных альтернатив. Аналитики Counterpoint Research считают, что по мере продвижения китайских компаний к агентному ИИ им потребуются более производительные ускорители, за счёт чего ускорители Nvidia H200 будут востребованы. ArXiv запретила учёным загружать статьи, сгенерированные нейросетями — за это предусмотрен бан на один год

16.05.2026 [08:17],

Анжелла Марина

Платформа для публикации научных препринтов ArXiv начнёт блокировать авторов за размещение статей с некачественным контентом, сгенерированным искусственным интеллектом. Нарушители лишатся права публиковать свои работы на ресурсе сроком на один год.

Источник изображения: Braňo/Unsplash Как сообщил в соцсети X председатель секции компьютерных наук ArXiv Томас Диттерих (Thomas Dietterich), санкции коснутся исследователей, в материалах которых найдут неопровержимые доказательства безответственного использования ИИ. К таким маркерам относятся выдуманные ссылки на источники или оставленные алгоритмом системные комментарии. После окончания блокировки авторы смогут загружать новые материалы на платформу только при условии их предварительного принятия в авторитетных рецензируемых изданиях. Согласно обновлённому кодексу поведения площадки, подписывая научную работу, авторы берут на себя полную ответственность за её содержимое независимо от способа создания. Диттерих в комментарии изданию 404Media подчеркнул, что наказание применяется исключительно в случаях с бесспорными доказательствами нарушения. При этом внутренний регламент требует обязательной фиксации проблемы модератором и последующего подтверждения председателем секции, а сами учёные сохраняют за собой право оспорить решение о блокировке. Ужесточение политики стало продолжением мер, принятых ArXiv в прошлом году для борьбы с наплывом низкокачественных ИИ-материалов. Тогда платформа ограничила публикацию обзорных статей и аналитических докладов по компьютерным наукам, обязав авторов сначала получать одобрение на профильных конференциях или в журналах. В администрации ресурса отметили, что развитие больших языковых моделей (LLM) позволило легко производить подобные тексты по запросу, из-за чего большинство поступающих обзоров превратились в простые аннотированные списки литературы без глубокого обсуждения открытых исследовательских проблем. Sony хотела похвастаться ИИ-камерой Xperia 1 VIII, но получила волну мемов

15.05.2026 [23:36],

Николай Хижняк

Компанию Sony затроллили в социальных сетях за работу ИИ-алгоритма камеры AI Camera Assistant нового флагманского смартфона Xperia 1 VIII. Пользователи соцсети X публикуют мемы и фотографии «до и после» вслед за публикацией японским гигантом рекламных изображений работы AI Camera Assistant, которые оказались менее качественными, чем оригиналы снимков без обработки.

Источник изображений: X (бывший Twitter) На фоне шуточных сообщений пользователей Sony впоследствии уточнила, что искусственный интеллект предлагает «креативные варианты оформления», а не автоматическую обработку изображений. Компания опубликовала официальное заявление, где пояснила особенность работы новой ИИ-функции камеры: «В продолжение публикации об AI Camera Assistant мы хотели бы подробнее рассказать об этой функции. Она не редактирует фотографии после съёмки, а предлагает четыре варианта настроек в разных творческих направлениях в зависимости от сцены и объекта. Вы можете выбрать любой вариант или использовать свои собственные настройки». Компания сопроводила сообщение примерами изображений, на которых ИИ-алгоритм предлагает пользователю выбрать наиболее подходящий вариант обработки снимка: Всё началось с публикации сравнения (изображения ниже), в котором Sony пыталась подчеркнуть возможности искусственного интеллекта в Xperia 1 VIII. Как ни странно, оригинальные фотографии (слева) оказались более сбалансированы по экспозиции и имели более естественные тени, в то время как версии с обработкой ИИ (справа) выглядели сильно переэкспонированными, с пересвеченными участками и блеклыми цветами. Реакция сообщества в соцсети X была быстрой и беспощадной. Поднялась такая волна критики, что генеральный директор компании Nothing Карл Пей (Carl Pei) присоединился к полемике и даже задался вопросом, не является ли это завуалированной накруткой интереса к устройству со стороны самой Sony. Вместо того чтобы просто критиковать результаты, пользователи X превратили ситуацию в полноценный мем. Возник целый тренд: пользователи начали делиться своими примерами фотографий «до и после», специально редактируя снимки «после» так, чтобы они выглядели, будто только что произошла ядерная вспышка. Один пользователь опубликовал фотографию фиолетовых цветов, где «отредактированная» версия представляет собой пустой белый квадрат. Другой поделился сравнением портретов, где версия, созданная с помощью ИИ, настолько яркая, что черты лица человека на снимке сливаются с фоном. Между тем многие создатели контента о технологиях оказались озадачены (на самом деле нет) результатами работы ИИ-алгоритмов Sony. Они начали ретвитить фотографии и задаваться вопросом, настоящие ли они. Будь то техническая ошибка при выборе изображений отделом маркетинга или продуманный ход для привлечения внимания, Xperia 1 VIII может стать самым обсуждаемым телефоном недели, хотя, возможно, и не по тем причинам, которые предполагала Sony. ChatGPT получит прямой доступ к банковским счетам пользователей — для анализа расходов и финансовых советов

15.05.2026 [19:42],

Сергей Сурабекянц

Глобальное доверие к ИИ вот-вот будет подвергнуто новому испытанию: OpenAI планирует предоставить своему чат-боту прямой доступ к банковским счетам пользователей. Новая функция, анонсированная сегодня в режиме предварительного просмотра, позволит пользователям «безопасно подключить» ChatGPT к Plaid — платформе для связи банков и приложений, используемой 12 000 финансовых учреждений, включая Schwab, Fidelity, Chase и Capital One.

Источник изображения: unsplash.com После подключения финансовых счетов пользователи ChatGPT смогут просматривать панель управления с подробной историей своих расходов, включая активные подписки. Пользователи также смогут обращаться к сервису за помощью в принятии финансовых решений, таких как покупка дома или оформление кредитных карт, а также отслеживать любые изменения в привычках расходования средств. Эта функция первоначально будет доступна пользователям в США, подписавшимся на тарифный план ChatGPT Pro стоимостью $200 в месяц. В дальнейшем, по словам OpenAI, компания «будет учиться и совершенствовать сервис на ранних этапах использования, прежде чем внедрить его в тарифный план Plus, с целью сделать его доступным для всех». Этот запуск последовал за январским представлением OpenAI сервиса ChatGPT Health для решения вопросов, связанных со здоровьем, который в то же время «не предназначен для диагностики или лечения». Здоровье, как и деньги, требует от пользователей полного доверия к политике конфиденциальности и безопасности данных OpenAI. OpenAI обещает пользователям «контроль над своими данными», включая возможность в любое время отключить свои банковские счета от ChatGPT, хотя на полное удаление данных может потребоваться до 30 дней. Пользователи также смогут просматривать и удалять «финансовые воспоминания», такие как цели или финансовые обязательства, сохранённые чат-ботом. Пользовательский контроль распространяется и на передачу данных в модели ИИ — например, опция «Улучшить модель для всех» разрешит использование финансовых данных из разговоров в ChatGPT для обучения ИИ. OpenAI уверяет, что ChatGPT не может вносить изменения в банковские счета или видеть «полные номера счетов». Тем не менее чат-боту доступны балансы, транзакции, портфель акций и обязательства, такие как ипотека и задолженность по кредитным картам. OpenAI не уточняет, что сама компания будет делать со всей этой финансовой информацией помимо обучения ИИ и существуют ли какие-либо дополнительные меры защиты финансовых данных пользователей от взлома системы. «Более 200 миллионов человек уже ежемесячно обращаются в ChatGPT с финансовыми вопросами — от составления бюджета до советов о том, как сократить расходы, — говорится в заявлении OpenAI. — Теперь пользователи могут безопасно подключить свои финансовые счета к Plaid, чтобы получить полное представление о своих финансовых делах в контексте личных целей, образа жизни и приоритетов, которыми они поделились с ChatGPT, используя передовые возможности логического мышления OpenAI». Звучит заманчиво. И что же может пойти не так? Трамп и Си Цзиньпин обсудили ограничения слишком умного ИИ и зависшие поставки Nvidia H200

15.05.2026 [19:18],

Сергей Сурабекянц

Президент США Дональд Трамп (Donald Trump) заявил, что обсуждал с китайским лидером Си Цзиньпином (Xi Jinping) совместные действия по ограничению использования искусственного интеллекта и возможность поставок чипов Nvidia H200. По словам Трампа, Китай не одобрил закупки чипов H200, «потому что они решили этого не делать, они хотят разработать свои собственные».

Источник изображений: magnific.com За несколько дней до визита Трампа в Китай американские официальные лица сообщили, что американская сторона выскажет свою обеспокоенность по поводу искусственного интеллекта, хотя и не уточнили, какие именно вопросы будут подняты в разговоре с китайскими коллегами. После заявления Anthropic о потенциальном глобальном киберриске, создаваемом её моделью Mythos, чиновники осознали необходимость открытия нового канала связи для регулярного обсуждения вопросов ИИ. По словам Трампа, лидеры двух стран обсуждали возможную совместную работу над ограничениями в отношении ИИ. На вопрос о том, какие именно ограничения могут быть введены, он ответил: «Стандартные ограничения, о которых мы постоянно говорим». Растущую обеспокоенность администрации Трампа вызывают действия китайских разработчиков, неправомерно использующих результаты передовых американских моделей ИИ для обучения собственных систем ИИ. OpenAI, Anthropic и Google обвиняют своих китайских конкурентов, таких как DeepSeek, Moonshot и MiniMax, в использовании американских достижений для разработки дешёвых и небезопасных продуктов. В прошлом месяце Белый дом представил меры, направленные на предотвращение такого извлечения результатов из систем, разработанных ведущими американскими компаниями, — практики, известной как «противодействие в процессе разработки». Ограничения США на продажу чувствительных американских технологий Китаю долгое время были камнем преткновения между двумя крупнейшими экономиками мира. В декабре 2025 года Трамп разрешил Nvidia поставлять свои чипы H200 китайским клиентам, что стало значительным смягчением мер, направленных на сдерживание роста Китая в области ИИ, но пока этот шаг не принёс компании или другим американским производителям чипов новых заказов.  Министр торговли США Говард Лютник (Howard Lutnick) сообщил, что, хотя некоторые чипы H200 были лицензированы для продажи в Китай, ни один из них не был экспортирован, поскольку китайское правительство не разрешило их закупки. Для решения этого вопроса в состав делегации Трампа в последний момент был включён глава Nvidia Дженсен Хуанг (Jensen Huang). Тем не менее торговый представитель США сегодня заявил, что решение об одобрении закупок чипов Nvidia H200 будет принимать Китай. «Но этот вопрос поднимался, и я думаю, что в этом направлении может произойти что-то ещё», — заявил Трамп. Ещё одной потенциальной областью конфликта может стать недавний запрет со стороны китайского правительства на сделку по поглощению за $2 млрд американской компанией Meta✴✴ стартапа Manus, занимающегося разработкой ИИ. Этот шаг лишил США достижений стартапа в области новаторского агентного ИИ. Решение, объявленное всего за несколько недель до саммита Трампа и Си Цзиньпина, подчеркнуло амбиции Пекина в отношении разработки собственного ИИ. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |