Приложение Ollama, предназначенное для локального запуска моделей искусственного интеллекта на компьютерах под управлением Windows, macOS и Linux, получило поддержку аппаратного ускорения на системах с процессорами семейства Apple M5.

Источник изображений: ollama.com

В отличие от облачных приложений, таких как ChatGPT, модели которых не могут запускаться локально и требуют подключения к интернету, Ollama позволяет загружать и запускать модели ИИ непосредственно на бытовых компьютерах. Открытые модели публикуются на платформах сообществ или выкладываются напрямую разработчиками и свободно загружаются.

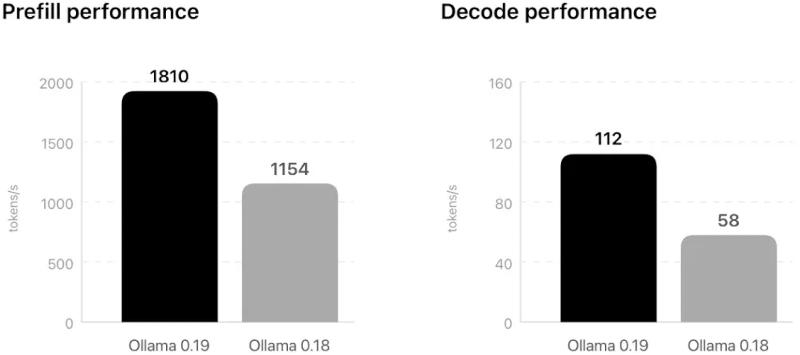

Однако их локальный запуск может быть непростой задачей, потому что модели ИИ, как правило, потребляют большие объёмы системной оперативной и видеопамяти. Чтобы преодолеть эту проблему, разработчики приложения добавили в Ollama 0.19 поддержку созданного Apple фреймворка машинного обучения MLX и унифицированной архитектуры памяти, благодаря чему скорость его работы на системах с чипами Apple возросла.

Правда, пока это касается только новейших чипов Apple M5, M5 Pro и M5 Max — приложение Ollama 0.19 обращается к нейроускорителям на платформе, сокращая время до выдачи первого токена и обеспечивая повышенную скорость генерации токенов в целом. В результате стали быстрее работать как персональные ИИ-агенты вроде OpenClaw, так и специализированные, в том числе OpenCode, Anthropic Claude Code и OpenAI Codex. Есть и ещё одно ограничение — на компьютере должно быть не менее 32 Гбайт унифицированной памяти.

Источник:

MWC 2018

MWC 2018 2018

2018 Computex

Computex

IFA 2018

IFA 2018