|

Опрос

|

реклама

Быстрый переход

OpenAI прокачала память ChatGPT — вскоре бот сможет помнить разное и для бесплатных пользователей

05.06.2026 [00:06],

Владимир Мироненко

OpenAI объявила об усовершенствовании функции запоминания ИИ-чат-бота ChatGPT, которая «стала умнее» и вскоре впервые станет доступна бесплатным пользователям.

Источник изображения: OpenAI «Сегодня мы начинаем внедрение более мощной и масштабируемой системы синтеза памяти, разработанной для решения проблем устаревания, корректности и масштабируемости, которые мы наблюдаем при использовании памяти для сотен миллионов пользователей и на многолетних временных горизонтах в ChatGPT», — сообщила компания. Функция запоминания в ChatGPT обеспечивает чат-боту возможность изучать пользователя и запоминать его предпочтения с течением времени. Память предоставляет ChatGPT полезный контекст для естественного взаимодействия с пользователем без необходимости каждый раз начинать его с нуля. Компания сообщила, что более мощная и эффективная с точки зрения вычислений архитектура памяти построена на основе метода обработки информации Dreaming, который помогает заполнять пробелы в воспоминаниях, автоматически подбирая в фоновом режиме нужный контент из истории чатов. Выбранные с помощью Dreaming воспоминания можно просмотреть на странице сводки памяти. Здесь пользователь сможет получить информацию о том, что ChatGPT знает о нём, добавить или обновить сведения о себе, а также указать, какие темы ChatGPT должен затрагивать и когда. При улучшении памяти разработчики фокусировались на трёх основных моментах:

Компания также сообщила, что удваивает объём памяти ChatGPT для хранения данных. Подписчики версий ChatGPT Plus и Pro в США получат доступ к обновлённой системе памяти уже сегодня. Кроме того, было объявлено, что функция запоминания ChatGPT вскоре станет доступна бесплатным пользователям. «Недавние улучшения позволили сократить вычислительные ресурсы, необходимые для предоставления функции памяти на основе Dreaming бесплатным пользователям, примерно в пять раз, что позволяет начать внедрение этой функции для них в ближайшие недели и увеличить объём памяти для пользователей Plus и Pro», — сообщила OpenAI. ChatGPT набрал миллиард активных пользователей — на это ушло рекордно мало времени

03.06.2026 [10:37],

Алексей Разин

Статистика Sensor Tower, на которую ссылается Reuters, демонстрирует ещё одно подтверждение популярности чат-бота ChatGPT, который был представлен стартапом OpenAI осенью 2022 года. Чуть более трёх лет понадобилось этому приложению, чтобы набрать миллиард активных пользователей в месячном измерении, и это рекордная скорость.

Источник изображения: Unsplash, Tim Witzdam Рубеж в 1 млрд ежемесячно использующих ChatGPT клиентов приложение преодолело в прошлом месяце, по данным Sensor Tower. Это быстрее, чем произошло в своё время с Google Maps, TikTok, Instagram✴✴ и YouTube. При этом нельзя утверждать, что высокой популярности ChatGPT ничего не угрожает. В первом квартале установившие себе Anthropic Claude пользователи в течение первого месяца с момента установки сократили время, проводимое в ChatGPT, на 5 % по сравнению с предыдущим восьмимесячным периодом. Сейчас Anthropic Claude может похвастать 56 млн активных пользователей в месячном измерении, но отставание от ChatGPT сокращается впечатляющими темпами. Если у последнего количество активных пользователей сейчас увеличивается на 62 % в годовом сравнении, то у Anthropic Claude этот показатель достигает 640 %. Вчера стало известно, что Anthropic сделала первый шаг к выходу на IPO, подав соответствующую заявку в США. Конкурирующая OpenAI тоже готовится к выходу на биржу в этом году, но пока ещё не подала свою заявку. Нейросеть Gemini начнёт объяснять пользователям, почему им стоит купить тот или иной товар

21.05.2026 [06:10],

Анжелла Марина

Компания Google представила масштабное обновление рекламных форматов в своей поисковой системе. Теперь пользователи увидят персонализированные объявления с развёрнутыми пояснениями от нейросети Gemini в ИИ-режиме (AI Mode).

Источник изображения: Google В ИИ-режиме Google уже тестирует два формата: Conversational Discovery ads и Highlighted Answers. Первый тип рекламы генерирует индивидуальный ответ на конкретный запрос пользователя, а второй встраивает спонсорские товары в списки рекомендаций нейросети. Каждое такое объявление будет сопровождаться независимым пояснением, составленным алгоритмами Gemini на основе анализа продукта, с обязательной пометкой «Спонсировано». При этом пояснение генерируется отдельно от рекламного креатива, чтобы обеспечить объективность ответа. В ближайшие месяцы Google добавит аналогичные возможности в обычный поиск, не ограничиваясь режимом AI Mode. Разработчики внедрят формат AI-powered Shopping ads для помощи в выборе крупных покупок, таких как бытовая техника или электроника. При поиске конкретной категории товаров система даст объяснение, подчёркивающее актуальность конкретного предложения для потенциального покупателя. Дополнительно Google обновит процесс взаимодействия бизнеса с клиентами, заменив статические формы обратной связи интерактивным инструментом Business Agent for Leads. Внутри рекламного блока появится чат-бот, работающий на базе Gemini, который сможет моментально проконсультировать пользователей на основе данных с сайта рекламодателя, облегчая процесс изучения информации об услугах или образовательных программах. Изменения также затронут пилотную программу Direct Offers, запущенную в январе 2026 года при участии таких брендов, как Chewy, Gap и L’Oreal. Рекламодатели получат функцию объединения скидок, подарков и локальных купонов в единую кампанию, используя инструмент AI Brief для подбора аудитории, из которой ИИ будет собирать наиболее привлекательные наборы под каждый запрос. Параллельно туристические партнёры, включая Booking и Expedia, начнут транслировать свои спецпредложения непосредственно в интерфейсе ИИ-планировщика поездок. Обновлённые блоки Direct Offers будут естественным образом отображаться в ответах AI Mode по мере изучения вариантов для шоппинга. Для максимального охвата этих форматов компания рекомендует использовать инструменты AI Max for Search, AI Max for Shopping и Performance Max. При этом для продавцов, работающих по протоколу UCP, добавлена встроенная система оформления заказов (native checkout), позволяющая без лишних шагов конвертировать интерес пользователей в завершённые продажи. Apple научит Siri автоматически удалять переписку ради приватности пользователей

18.05.2026 [09:46],

Алексей Разин

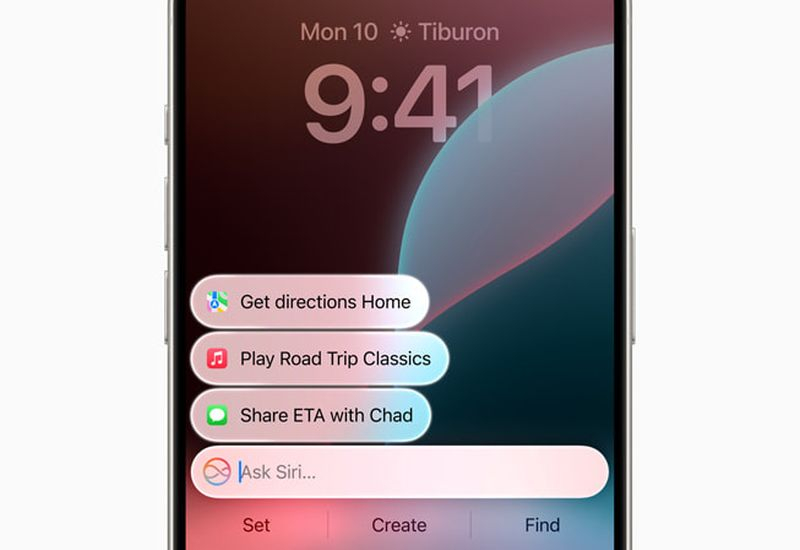

Забота о неприкосновенности личных данных пользователей позволила Apple заработать определённую репутацию, и в эру бурного развития ИИ компания не хочет снижать планку в этом отношении. Как отмечает Bloomberg, обновлённая версия голосового ассистента Siri, которая дебютирует в июне, обеспечит автоматическое удаление чатов.

Источник изображения: Apple В следующем месяце на конференции WWDC 2026 для разработчиков будет представлено обособленное приложение Siri, которое по основным принципам взаимодействия будет напоминать пользователям ChatGPT. При этом решение Apple будет изначально предлагать пользователю ограничить сроки хранения истории переписки либо 30 днями, либо 1 годом, но при желании её можно будет хранить неограниченно долго. Главное, что у пользователя будет выбор в этом вопросе. Если учесть, что новая версия Siri будет полагаться на Google Gemini, то соответствующий партнёр как раз будет отвечать за часть функций, связанных с безопасностью данных. Возможно, с учётом неизбежного отставания Apple от конкурентов в сфере ИИ, компания попытается сделать заботу о приватности одним из декларируемых преимуществ по сравнению с решениями других разработчиков. Мальта стала первой страной, граждане которой бесплатно получат годовую подписку на ChatGPT Plus

17.05.2026 [07:17],

Дмитрий Федоров

OpenAI подписала соглашение с правительством Мальты, по которому все граждане страны получат бесплатный годовой доступ к ChatGPT Plus при условии прохождения курса по использованию ИИ.

Источник изображения: Levart_Photographer / unsplash.com Программа стартует в мае и будет расширяться по мере того, как новые участники будут завершать обучение. Курс бесплатный. Воспользоваться предложением смогут и мальтийские граждане, проживающие за рубежом. «Мы превращаем незнакомую концепцию в практическую помощь для наших семей, студентов и работников», — заявил министр экономики Мальты Сильвио Шембри (Silvio Schembri). Мальта стала первой страной мира, заключившей подобную сделку. Финансовые условия соглашения OpenAI не раскрыла. Copilot в Microsoft Edge научился анализировать информацию со всех открытых вкладок одновременно

14.05.2026 [10:09],

Алексей Разин

Корпорация Microsoft добавит собственному чат-боту Copilot возможность собирать информацию со всех одновременно открытых вкладок в браузере Edge, сообщает The Verge. Это может быть удобно при сравнении нескольких товаров в интернет-магазинах или обобщения информации из нескольких источников.

Источник изображения: Microsoft Одновременно веб-обозреватель лишится прежней функции Copilot Mode, которая обладала аналогичными возможностями, но дополняла их агентскими задачами вроде полномочий по бронированию отелей от лица пользователя. Агентские функции перенесены в отдельный инструмент Browse with Copilot. В скором времени браузер также обзаведётся другими ИИ-функциями. Например, «Study and Learn» поможет создать на основе изучаемой статьи в интернете обучающее занятие или составить интерактивный тест по её материалам. Другой ИИ-инструмент позволит на основе открытых в Edge вкладок создавать подкасты по примеру NotebookLM. При вводе текста на веб-странице автоматически подключится ИИ-ассистент, упрощающий написание текстов. У пользователей также появится возможность предоставить Copilot доступ к своей истории посещения веб-страниц в браузере с целью более полных ответов на сопутствующие темы в будущем. Ассистент в настольной и мобильной версии обзаведётся более долговременной памятью, позволяя опираться в ответах на предыдущие запросы. Дизайн новой вкладки в интернет-обозревателе будет предусматривать поля для общения с чат-ботом, поиска и навигации по вебу, а также средство для сортировки истории браузера по категориям. В мобильном варианте обновлённый браузер Edge получит возможность делиться снимками экрана с Copilot, чтобы обсуждать в чат-боте их содержимое. Индикацию активности Copilot компания Microsoft сделала более заметной, чтобы пользователь чётко понимал, когда сервис задействован. xAI теряет популярность, но Илон Маск ещё может вернуть стартап в гонку

12.05.2026 [09:34],

Алексей Разин

Представители OpenAI убеждены, что судебные претензии со стороны Илона Маска (Elon Musk) направлены на укрепление рыночных позиций его собственного стартапа xAI, основанного в 2023 году и недавно присоединённого к SpaceX. Независимая статистика говорит о снижении популярности xAI, но эксперты убеждены, что при наличии мотивации Маск способен всё исправить.

Источник изображения: Unsplash, Мария Шалабаева В начале мая xAI заключила с Anthropic соглашение о сдаче в аренду вычислительных мощностей Colossus 1, которые xAI изначально планировала использовать для собственных нужд. Это может указывать на замедление темпов развития xAI и разработанного ею чат-бота Grok. Статистика AppMagic, на которую ссылается The Wall Street Journal, указывает на снижения количества скачиваний приложения Grok до 8,3 млн по итогам апреля против более чем 20 млн скачиваний в январе. Данные Recon Analytics гласят, что из более чем 260 000 американских пользователей ИИ-сервисов только 0,174 % в текущем квартале оплачивали подписку на Grok. Это почти столько же, как и годом ранее, и значительно меньше 6 %, соответствующих доле платных подписчиков конкурирующего ChatGPT. Сам Илон Маск в ходе своих апрельских судебных показаний назвал xAI «самой маленькой из ИИ-компаний». Для Grok проблемой остаётся отдалённость от нужд корпоративных пользователей, тогда как OpenAI и Anthropic активно развивают функции содействия ИИ в написании программного кода и автоматизации рутинных офисных задач при помощи ИИ-агентов. Опрос Enterprise Technology Research показал, что по итогам марта этого года 7 % корпоративных респондентов уже используют Grok или собираются это сделать. Годом ранее их доля не превышала 4 %, и хотя положительная динамика очевидна, в случае с Claude показатель вырос с 21 до 48 %, а у Google Gemini он увеличился с 27 до 40 %. При этом некоторые участники рынка верят, что Илон Маск ещё способен исправить ситуацию, если сконцентрируется на этой задаче. Он уже провёл в xAI серьёзную реорганизацию, и она может стать первым этапом реванша. Клиенты в стремительно меняющемся сегменте ИИ слабо привязаны к какой-то конкретной платформе. Если тот же Grok внезапно начнёт демонстрировать более впечатляющие результаты на форме конкурентов, то его популярность возрастёт довольно быстро. Twitch ужесточит борьбу с накрутками просмотров

08.05.2026 [11:58],

Павел Котов

Стриминговая платформа Twitch предупредила авторов о намерении вплотную заняться решением проблемы накруток просмотров. Компания примет новые меры для борьбы со стримерами, уличёнными в искусственном завышении статистики, сообщил её гендиректор Дэн Клэнси (Dan Clancy).

Источник изображения: ilgmyzin / unsplash.com «С сегодняшнего для вводим новый тип обеспечительных мер, которые планируем развернуть в ближайшие недели. Каналам, которые постоянно используют искусственное завышение количества просмотров, будем устанавливать ограничение на число одновременных просмотров на фиксированный период времени во всех разделах Twitch», — заявил он и добавил, что ограничения будут основываться на «исторических данных о трафике этого автора, не использовавшего искусственное завышение количества просмотров». При повторных нарушениях срок действия ограничений будет увеличиваться. Это одна из наиболее активных мер, на которую решилась администрация платформы для решения указанной проблемы. Она не намерена раскрывать, как именно собирается выявлять недобросовестных стримеров. «Эффективная борьба с ботами для накрутки просмотров — задача непростая. По мере того, как мы обновляем алгоритмы обнаружения в реальном времени, компании, которые занимаются ботами для накрутки просмотров, быстро реагируют обновлениями, чтобы избежать обнаружения», — пояснил господин Клэнси. Это не первая попытка Twitch бороться с ботами для накрутки просмотров: в 2021 году она удалила 7,5 млн бот-аккаунтов. Пользователи соцсетей уже вызвали опасения, что из-за новой политики малоизвестные стримеры смогут подвергаться злонамеренным атакам ботов в угоду недобросовестных конкурентов. Возникнут и вопросы о том, как платформа будет отличать накрутки от естественных всплесков активности. Telegram получил большое обновление с ИИ — ботов теперь можно призвать в любой чат и другие нововведения

07.05.2026 [22:59],

Андрей Созинов

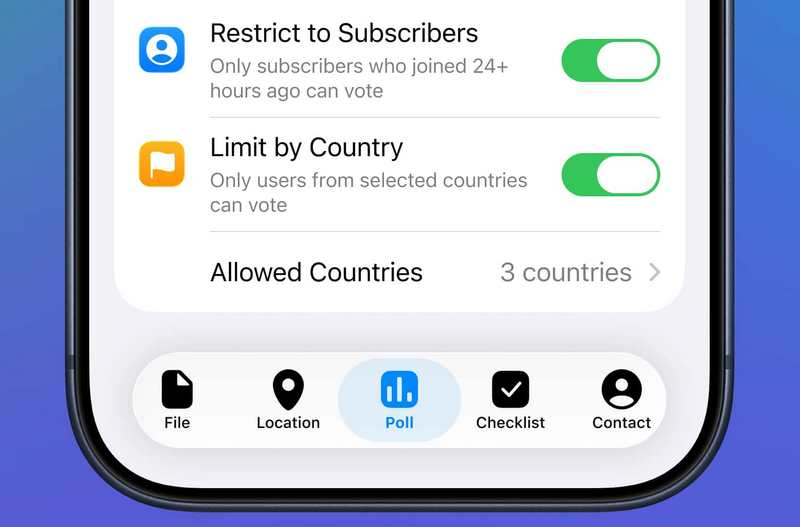

Telegram получил большое обновление, почти целиком посвящённое ИИ и автоматизации. В мессенджере появился гостевой режим для ботов, возможность общения ботов друг с другом, инструменты автоматизации чатов, а также поиск по более чем 100 млн эмодзи и стикеров. Заодно Telegram обновил опросы и инструменты модерации.

Источник изображений: Telegram Главным нововведением стал так называемый гостевой режим для ботов. Теперь ИИ-ботов можно вызывать прямо в любых личных и групповых чатах — достаточно упомянуть их через @username в сообщении. После этого бот сможет ответить в том же чате: например, найти информацию, сгенерировать текст или картинку, проверить информацию или выполнить другую задачу. При этом Telegram подчёркивает, что такие боты получают доступ только к сообщениям, где их упомянули, и не видят остальную переписку. Ещё одно важное изменение касается взаимодействия между самими ботами. Теперь Telegram разрешил ботам отвечать другим ботам, что открывает дорогу для создания целых цепочек из автономных ИИ-агентов и автоматизации рабочих сценариев. Например, один бот сможет собирать данные, второй — анализировать их, а третий — публиковать результат в чате, и всё без участия человека. Также разработчики улучшили отображение ответов от ботов. Сообщения теперь могут выводиться постепенно, по мере генерации текста, — аналогично тому, как это реализовано в современных ИИ-чатах. Telegram отмечает, что благодаря обновлениям Bot API ответы стали появляться быстрее и получили новые анимации. Ещё в Telegram появилась функция автоматизации чатов. Пользователи могут подключить бота к своему профилю и разрешить ему отвечать на сообщения от их имени. При этом можно гибко настроить, к каким именно чатам получит доступ бот — например, только к новым диалогам или к перепискам с незнакомыми пользователями. Настройка находится в разделе «Автоматизация чатов». Telegram также расширил возможности встроенного ИИ-редактора текста. Теперь пользователи смогут создавать собственные стили для ИИ-редактора сообщений, задавая набор инструкций для оформления текста. Такие стили можно сохранять и делиться ими по ссылке. Компания считает, что функция пригодится как сообществам с локальными мемами, так и командам, которым важно поддерживать единый стиль публикаций. Ещё одним заметным нововведением стал расширенный поиск по эмодзи и стикерам. Telegram заявляет, что пользователям теперь доступны более 100 млн стикеров и эмодзи, созданных сообществом. Поиск работает на 36 языках, а для автоматической разметки и индексации изображений используются ИИ-модели на базе сети Cocoon. Обновление затронуло и систему опросов. Администраторы групп и каналов получили доступ к интерактивной статистике голосования с графиками изменения голосов во времени. Правда, функция работает только для опросов, набравших более 100 голосов. Кроме того, теперь можно ограничивать участие в опросах — например, разрешать голосовать только подписчикам канала или пользователям из определённых стран.   Среди менее крупных изменений — возможность отправлять отложенные сообщения без звукового уведомления и новые инструменты модерации. Администраторы групп теперь могут удалять реакции отдельных пользователей, а при необходимости — сразу все реакции конкретного участника. Кроме новых функций, Telegram сообщил о более чем 200 исправлениях и мелких улучшениях во всех версиях приложения. Anthropic занялась повышением привлекательности ИИ-бота Claude для простых пользователей

07.05.2026 [13:26],

Алексей Разин

Изначально Anthropic свои ИИ-решения ориентировала главным образом на корпоративных клиентов, поскольку это обеспечивало более быстрый рост как пользовательской базы, так и выручки. Теперь же компания решила сделать чат-бот Claude более привлекательным для рядовых пользователей, сообщает Bloomberg.

Источник изображения: Anthropic В этом признался Майк Кригер (Mike Krieger), который возглавляет одну из лабораторий Anthropic, работающих над экспериментами с совершенствованием Claude. С прошлого года компания поручила своим специалистам научить чат-бота более качественной обработке запросов частного характера — например, имеющим отношение к здоровью, путешествиям и кулинарным рецептам. По словам Кригера, которые прозвучали из его уст на конференции для разработчиков в Сан-Франциско, сейчас Anthropic сконцентрирована на повышении качества и скорости работы чат-бота, а также устранении шероховатостей. В частности, ведётся работа по сокращению времени, необходимого для формирования и отправки пользовательских запросов после запуска мобильного приложения. Разработчикам Claude удалось сократить это время с прежних пяти-шести секунд до одной. Запущенный в 2023 году чат-бот Anthropic довольно быстро завоевал расположение рядовых пользователей, поскольку помимо рекламы в США, этому способствовали некоторые «вирусные истории» и даже скандал с исключением компании из числа доверенных поставщиков Пентагона. Сейчас Claude в магазине приложений Apple App Store находится на втором месте по популярности после ChatGPT конкурирующей OpenAI, обходя при этом Google Gemini. К марту Claude привлекал более 1 млн новых пользователей ежедневно. Сейчас, на волне такой популярности, Anthropic даже испытывает нехватку вычислительных мощностей. Эпидемию одиночества не вылечить ИИ-ботами — они лишь усиливают изоляцию

07.05.2026 [09:28],

Дмитрий Федоров

Одиночество толкает людей к ИИ-чат-ботам, но общение с ними лишь усиливает изоляцию. К такому выводу пришли психологи Данигэн Фолк (Dunigan Folk) и Элизабет Данн (Elizabeth Dunn), год наблюдавшие за 2149 взрослыми из четырёх англоязычных стран. Работа опубликована в журнале Psychological Science и ставит под сомнение надежды на то, что ИИ-компаньоны помогут справиться с эпидемией одиночества.

Источник изображения: Kristina Tripkovic / unsplash.com Фолк и Данн четырежды за двенадцать месяцев опросили жителей Великобритании (50 %), США (28 %), Канады (14 %) и Австралии (8 %). Все четыре волны опросов прошли 979 человек, три — 466, две — 395, одну — 309. Средний возраст участников составил 40 лет, мужчин и женщин оказалось почти поровну. Каждый раз респондентов спрашивали, как часто за минувшие четыре месяца они обращались к ИИ-чат-ботам за советом по жизненным вопросам, вели с ними повседневные разговоры или просто искали компанию. Одновременно анкеты фиксировали уровень эмоциональной изоляции опрашиваемых и более широкий показатель их социальной связанности с окружающими. Исследователи учитывали и крупные события в жизни участников опроса: переезд, расставание, начало устойчивых романтических отношений, рождение ребёнка. В каждой волне от 26 до 30 % опрошенных сообщали, что за предыдущие четыре месяца пользовались чат-ботами в социальных целях — например, обращались к ним за советом по жизненным вопросам, вели с ними повседневные разговоры или искали у них ощущение общения. При этом средняя частота таких обращений за год наблюдения статистически значимо не изменилась. Для эмоциональной изоляции ключевая закономерность оказалась двунаправленной: участники, которые чувствовали себя более эмоционально изолированными, через четыре месяца, как правило, чаще обращались к чат-ботам, а рост такого использования, в свою очередь, предсказывал более высокую эмоциональную изоляцию в следующей волне. Крупные жизненные события с последующим ростом обращений к ИИ-чат-ботам связаны не были. С более широким показателем социальной связанности картина оказалась иной. Люди, ощущавшие более слабую связь с социальным окружением, тоже чаще обращались к чат-ботам четыре месяца спустя, однако само по себе такое использование не предсказывало статистически значимого дальнейшего снижения социальной связанности. Из всех жизненных событий только разрыв отношений был связан с последующим ослаблением социальной связанности, но обращений к ИИ-чат-ботам после него не прибавлялось. Остальные события — переезд, начало устойчивых романтических отношений, рождение ребёнка — не показали статистически значимой связи с последующей социальной связанностью. Авторы предполагают, что люди могут снова и снова обращаться к ИИ-чат-ботам, потому что они доступны в любой момент и убедительно имитируют живое общение. Но такие сравнительно лёгкие и поверхностные контакты, по мнению Фолка и Данн, могут вытеснять более ценное общение с реальными людьми. У ИИ нет собственной внутренней жизни, поэтому он не способен на подлинную ответную откровенность, важную для полноценных долгосрочных человеческих отношений, и именно поэтому привязанность к чат-ботам может со временем не удовлетворять социальные потребности человека, а усиливать чувство одиночества. «В совокупности эти результаты дают первые свидетельства того, что одиночество может побуждать людей искать общение с чат-ботами, но такое использование со временем способно усугублять чувство одиночества. Тем не менее мы призываем к осторожности в выводах, учитывая предварительный характер нашего анализа», — заключили авторы. Наблюдательный характер исследования не позволяет делать однозначных причинно-следственных выводов, а все данные получены из ответов самих участников, что не исключает систематических искажений. Генераторы изображений стали главным драйвером роста ИИ-чат-ботов

05.05.2026 [11:50],

Павел Котов

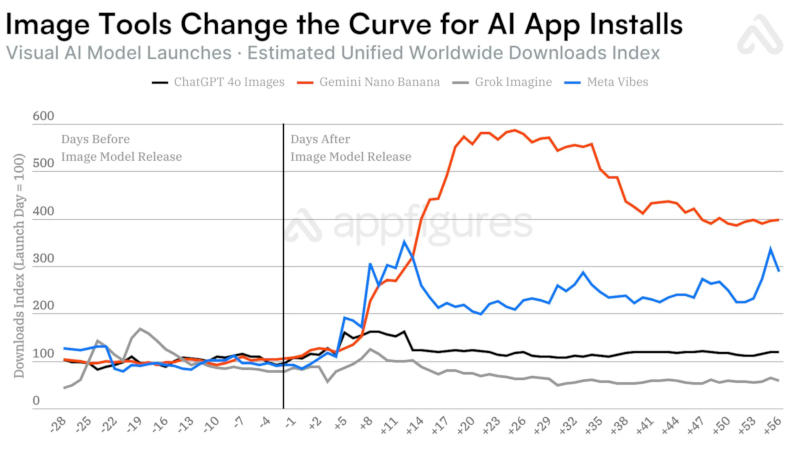

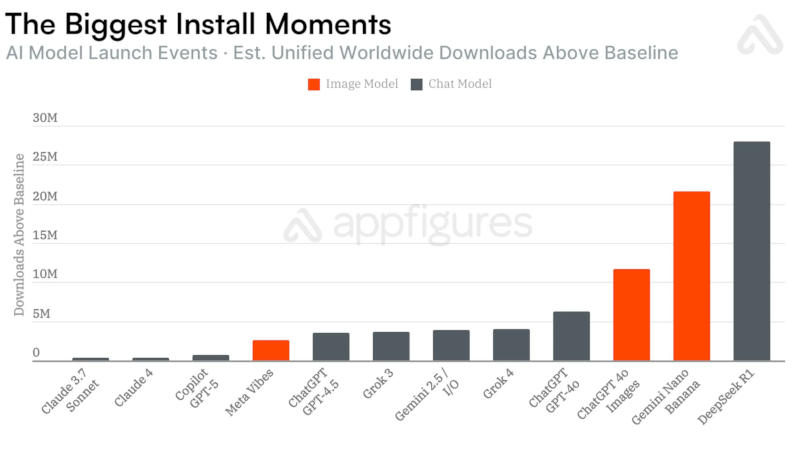

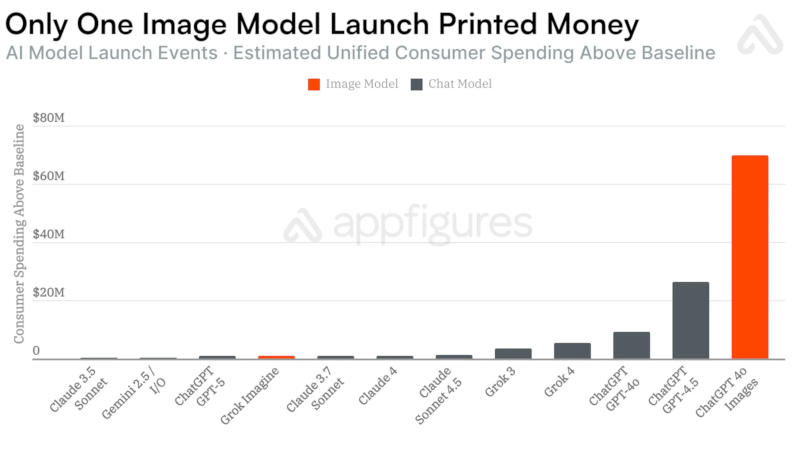

Выпуск моделей с генераторами изображений стимулирует увеличение популярности мобильных приложений с искусственным интеллектом — рост по сравнению с простыми обновлениями ускоряется в 6,5 раза, показала статистика аналитической компании Appfigures.

Источник изображения: Milad Fakurian / unsplash.com Для OpenAI ChatGPT и Google Gemini появление генераторов изображений увеличивало аудиторию на десятки миллионов пользователей. В течение 28 дней после выхода генератора изображений Nano Banana с чат-ботом Gemini 2.5 Flash приложение набрало 22 млн новых пользователей, что соответствует росту числа загрузок более чем вчетверо за указанный период.  В случае генератора изображений в составе OpenAI GPT-4o рост аудитории составил 12 млн человек — в 4,5 раза быстрее по сравнению с базовым вариантом GPT-4o, а также GPT-4.5 и GPT-5. Аналогичная тенденция сработала и с появлением ленты Vibes в приложении Meta✴✴ AI, хотя оно предлагало генерацию не изображений, а видео — нововведение дало 2,6 млн дополнительных загрузок.  К сожалению для разработчиков, росту числа загрузок не всегда сопутствует рост выручки: в случае с Nano Banana компания Google заработала лишь на $181 тыс. больше; приложение Meta✴✴ AI с появлением Vibes существенного роста дохода не показало; и только в случае OpenAI модель GPT-4o с генератором изображения помогла компании нарастить выручку на $70 млн за 28 дней.  Единственным исключением из правил оказался взрывной рост в 28 млн загрузок с выходом модели DeepSeek R1, отметили в Appfigures. Всё потому, объясняют аналитики, что компания DeepSeek сама по себе стала мировой сенсацией из-за уникальных методов обучения ИИ с минимальными затратами по сравнению с конкурентами — генератора изображений в приложении не было. Google готова показывать рекламу в Gemini — OpenAI уже делает это в ChatGPT

30.04.2026 [19:51],

Анжелла Марина

Руководство Google подтвердило готовность интегрировать рекламные объявления в приложение Gemini, отказавшись от прежней политики полного их отсутствия. Решение продиктовано стремлением компании масштабировать продукт и монетизировать растущую аудиторию пользователей Gemini.

androidauthority.com По сообщению Android Authority со ссылкой на Business Insider, в ходе конференции по итогам первого квартала 2026 года главный коммерческий директор Google Филипп Шиндлер (Philipp Schindler) подтвердил готовность компании разместить рекламу в приложении Gemini. Он уточнил, что если рекламный формат покажет свою эффективность в ИИ-режиме поиска Google (AI Mode Search), он будет применён и в Gemini. Ранее корпорация не торопилась с внедрением рекламы, но теперь её позиция изменилась. Шиндлер обосновал изменение планов тем, что грамотно встроенная реклама предоставляет пользователям полезную коммерческую информацию и помогает развивать продукты для миллиардов людей. Это заявление согласуется с декабрьским сообщением издания Adweek, которое ещё раньше сообщало о планах Google разместить рекламные объявления в Gemini в течение 2026 года. Таким образом, ожидаемые изменения стали логичным шагом в стратегии монетизации ИИ-сервисов компании. Ранее мы также сообщали о том, что Google не исключает появление рекламы в Gemini. Несмотря на наличие платных подписок, общее число которых достигло 350 миллионов человек, дохода от них может быть недостаточно для поддержания полностью бесплатного режима работы чат-бота. Ситуация также усугубляется действиями конкурентов. В частности, компания OpenAI уже начала показ рекламы пользователям бесплатной версии ChatGPT. Google, вероятно, последует этому тренду, чтобы сохранить экономическую устойчивость своего флагманского ИИ-продукта на фоне растущих затрат на инфраструктуру. OpenAI заявила, что ChatGPT научился считать буквы в словах — но на деле он продолжает ошибаться

29.04.2026 [10:59],

Владимир Мироненко

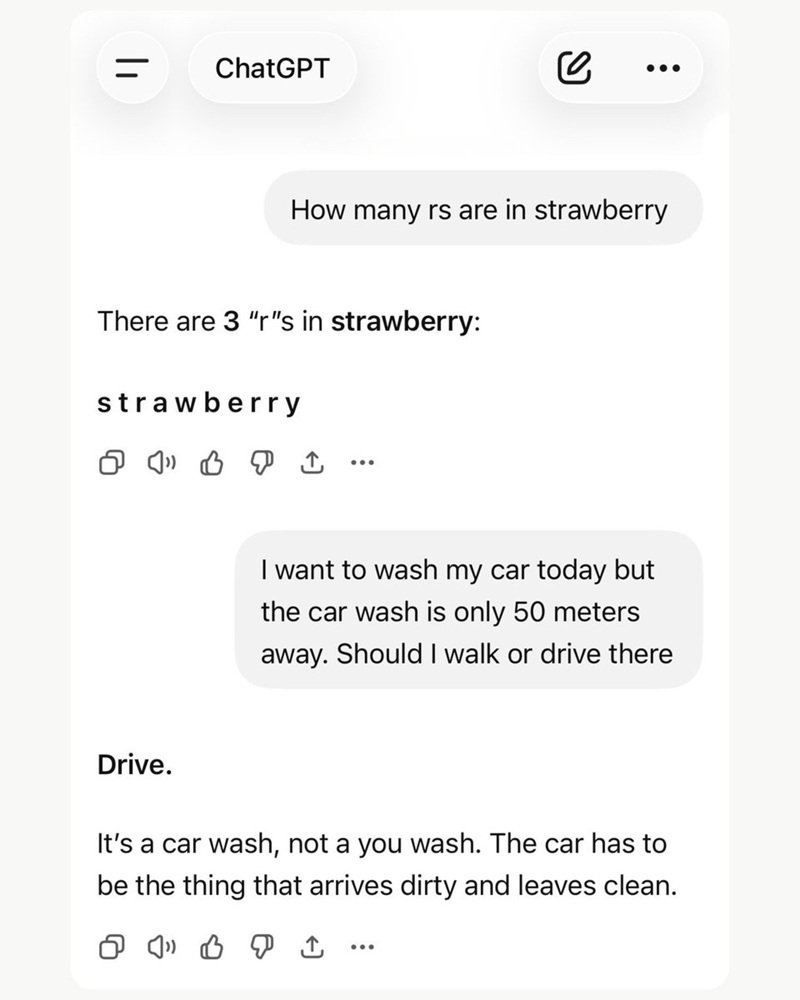

Распространённой проблемой больших языковых моделей, используемых в чат-ботах с искусственным интеллектом, являются уверенные ошибки или, другими словами, ложь. Например, до недавних пор ChatGPT не мог правильно ответить на вопрос, сколько букв R в слове strawberry (клубника).

Источник изображения: Levart_Photographer/unsplash.com Долгое время чат-бот выдавал неверный ответ, утверждая, что в слове strawberry буква R не встречается три раза. У других ИИ-моделей нередко наблюдалась аналогичная проблема. Еще одна распространённая ошибка: в ответ на вопрос «Я хочу сегодня помыть машину, но автомойка всего в 50 метрах. Стоит ли мне идти пешком, чтобы доехать туда?» чат-бот ChatGPT часто рекомендовал идти пешком, несмотря на очевидную логическую нестыковку.

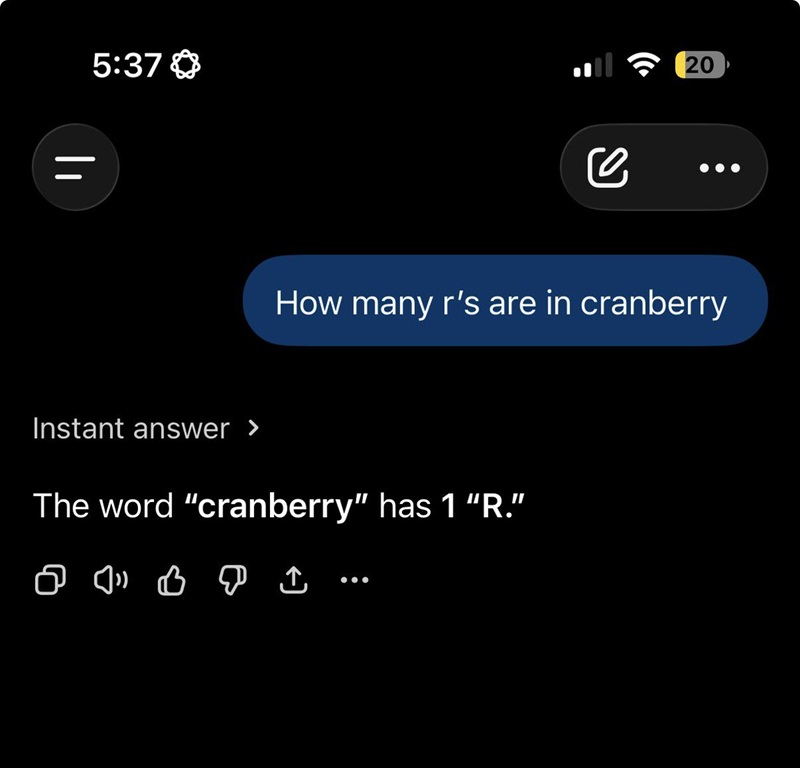

Источник изображений: 9to5google.com Одной из самых больших проблем, как пишет 9to5google.com, остается частота, с которой ИИ-инструменты уверенно лгут пользователям. Если информация неверна, чат-бот этого может не заметить, и, если указать на ошибку, ИИ может упорствовать и продолжать ошибаться, утверждая при этом, что он прав. Эта проблема рассматривается как опасность ИИ-инструментов, помимо того, что такие ответы просто раздражают с учётом потребляемых ИИ ресурсов. Сегодня OpenAI сообщила, что «наконец-то» ChatGPT может правильно ответить на вопросы по поводу количества букв R в слове strawberry и нужно ли идти к заправке для того, чтобы пополнить бак машины бензином. Но, как отметил 9to5google.com, существует подозрение, что это могут быть жёстко закодированные решения, поскольку в других случаях чат-бот продолжает ошибаться по той же логике. Например, на вопрос «Сколько букв R в слове cranberry (клюква)?» он постоянно отвечает: «В слове cranberry одна буква R», что, конечно же, неверно.  То есть, проблема по-прежнему существует, хотя OpenAI с гордостью объявила о её решении. ChatGPT Plus потеряет 80 % подписчиков в этом году — зато более дешёвый тариф ChatGPT Go расширит аудиторию в 37 раз

29.04.2026 [09:17],

Алексей Разин

Ещё вчера появилась общая информация о том, что руководство OpenAI обеспокоено снижением количества подписчиков и замедлением роста выручки, но подробности этого отчёта позволяют понять, как компания собирается бороться с данными тенденциями. Тарифный план ChatGPT Go за $8 в месяц должен увеличить количество подписчиков в текущем году с 3 млн до 112 млн человек.

Источник изображения: OpenAI В некоторых регионах ChatGPT Go доступен за $5 в месяц. А вот количество желающих платить по $20 в месяц за доступ к тарифу ChatGPT Plus, по данным компании, в текущем году сократится почти в пять раз, с 44 млн до 9 млн человек. Кроме того, прогнозы OpenAI гласят, что количество подписчиков самого дорогого плана ChatGPT Pro вырастет в этом году вдвое, но их доля в общем количестве не превысит 1 %, поэтому рассчитывать именно на данный ценовой сегмент компания просто не может. Впрочем, даже приток пользователей к тарифу ChatGPT Pro не сможет компенсировать упущенную выручку из-за отказа клиентов от более дорогого тарифа ChatGPT Plus, если проанализировать динамику. Выручка OpenAI от подписок по итогам текущего года всё равно сократится на $155 млн. Кроме того, привлечение 109 млн новых подписчиков наверняка увеличит расходы OpenAI, и не факт, что выручка от подписок на этом направлении сможет их перекрыть. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |