|

Опрос

|

реклама

Быстрый переход

Google запустила «Живой перевод» прямо в наушники в 12 странах и на iOS

27.03.2026 [06:11],

Анжелла Марина

Google объявила о расширении функции «Живой перевод» (Live Translate), которая позволяет слышать синхронный перевод разговора прямо в наушниках. Если раньше эта возможность была доступна только владельцам устройств на Android в трёх странах, то теперь она появилась и на iOS, а география сервиса охватила 12 стран.

Источник изображения: androidauthority.com Технология, работающая на базе искусственного интеллекта Gemini, фактически превращает любые наушники в персональное устройство для перевода, сохраняя при этом интонации и темп речи говорящего. С сегодняшнего дня, как сообщает TechCrunch, воспользоваться функцией могут жители США, Индии, Мексики, Германии, Испании, Франции, Нигерии, Италии, Великобритании, Японии, Бангладеш и Таиланда. Ранее сервис был доступен только на Android в США, Индии и Мексике. Как отмечают в компании, сохранение тона, акцентов и темпа речи собеседника, которые обеспечивает ИИ, помогает легче следить за диалогом, понимая кто именно говорит в данный момент. Компания предлагает использовать эту возможность как в бытовых ситуациях, например, за ужином с родственниками, говорящими на другом языке, так и в путешествиях по другим странам. Для работы функции подходят любые модели наушников, а всего система поддерживает более 70 языков. Чтобы запустить перевод, пользователю необходимо открыть приложение Google Translate, нажать на опцию «Живой перевод» и подключить гарнитуру. В тот же день Google объявила о глобальном расширении функции поиска Search Live. Запущенная в июле 2025 года функция позволяет наводить камеру смартфона на объекты и получать помощь в режиме реального времени. Система поддерживает диалог с пользователем, опираясь на визуальный контекст, получаемый через камеру в приложении Google. Теперь этот инструмент доступен более чем в 200 странах на всех языках, где поддерживается режим AI Mode (ранее он работал только в США и Индии). В WhatsApp появится автоматический перевод сообщений с поддержкой русского и ещё 20 языков

21.03.2026 [13:19],

Павел Котов

Вскоре владельцы iPhone смогут общаться через WhatsApp с людьми, которые говорят на других языках. Функция, основанная на встроенных возможностях Apple iOS, предлагает поддержку 21 языка мира. В последней бета-версии WhatsApp на TestFlight обнаружились упоминания о переключателе «Переводить сообщения» для каждого чата — в мессенджере появится функция автоматического перевода всех новых входящих сообщений. Активировав эту функцию, пользователь сможет выбрать, с какого на какой язык будут переводиться сообщения — в приведённом примере — с испанского на английский. Данная возможность есть в WhatsApp для iPhone и сейчас, но она не работает в автоматическом режиме — сейчас необходимо коснуться и удерживать сообщение, выбрать пункт меню «Ещё...» и установить исходный и целевой языки. Автоматический перевод пока не работает даже для участников программы бета-тестирования, отмечает ресурс WABetaInfo, но в перспективе функция будет присутствовать как в личном, так и в групповых чатах — при условии, что все их участники пишут на одном языке. Ручной и автоматический перевод работает на основе входящих в комплект iOS языковых пакетов, то есть обработка осуществляется локально, и сквозное шифрование переписки не нарушается. В настоящее время Apple поддерживает арабский, голландский, английский (Великобритания и США), французский (Франция), немецкий (Германия), хинди, индонезийский, итальянский (Италия), японский, корейский, мандаринский китайский (Китай и Тайвань), польский, португальский (Бразилия), русский, испанский (Испания), тайский, турецкий, украинский и вьетнамский языки. По мере добавления новых языков в приложение «Переводчик» от Apple будут расширяться и возможности WhatsApp. Сроки официального выхода новой функции неизвестны. Apple представила наушники AirPods Max 2 с улучшенным шумоподавлением и переводом в реальном времени за $549

16.03.2026 [17:35],

Сергей Сурабекянц

Компания Apple анонсировала наушники AirPods Max 2 с улучшенным активным шумоподавлением и повышенным качеством звука. Наушники оснащены чипом H2, который обеспечивает работу множества новых функций, включая перевод в реальном времени с помощью нейросети. AirPods Max 2 также научились распознавать разговоры, повышать приоритет голоса владельца и снижать фоновый шум во время телефонных звонков.

Источник изображений: Apple По утверждению Apple, AirPods Max 2 обеспечивают в 1,5 раза более эффективное шумоподавление по сравнению с оригинальными AirPods Max, выпущенными в 2020 году. AirPods Max 2 также получили функцию распознавания разговоров, которая снижает громкость, когда кто-то начинает говорить рядом. Новинка улучшает качество телефонных звонков, повышая приоритет голоса владельца и снижая фоновый шум. AirPods Max 2 поддерживают 24-битное аудио без потерь с частотой 48 кГц при подключении через кабель USB Type-C. По словам Apple, режим прозрачности, позволяющий слышать окружающую обстановку, не снимая наушников, теперь звучит «более естественно». Наушники также получили функцию автоматического снижения особенно громких звуков окружающей среды.  AirPods Max 2 обеспечивают дистанционное управление камерой и персонализированную регулировку громкости, которая, по словам производителя, с течением времени «автоматически настраивает звучание» в зависимости от предпочтений владельца. Наушники распознают в качестве элементов управления кивок или покачивание головы.  По данным Apple, наушники AirPods Max 2 обеспечивают до 20 часов прослушивания на одном заряде. AirPods Max 2 выпускаются в синем, чёрном, фиолетовом, бежевом и оранжевом цветах. Предзаказ на наушники можно оформить, начиная с 25 марта, а в продажу они поступят в начале апреля. T-Mobile запустит ИИ-перевод телефонных звонков в реальном времени на полсотни языков — без дополнительных приложений

11.02.2026 [19:45],

Сергей Сурабекянц

Сотовый оператор T-Mobile готовится представить новую функцию на основе искусственного интеллекта «Перевод в режиме реального времени», которая переводит телефонные беседы на более чем 50 языков в режиме реального времени. Бета-тестирование новой функции начнётся весной, а регистрация в программе для клиентов T-Mobile доступна уже сегодня.

Источник изображения: unsplash.com «Одно из самых больших препятствий, с которым сталкиваются абоненты беспроводной связи, — это понимание друг друга, — заявил генеральный директор T-Mobile Шрини Гопалан (Srini Gopalan). — Внедряя искусственный интеллект в режиме реального времени непосредственно в нашу сеть, мы предоставляем больше, чем просто связь». Включение функции «Перевод в режиме реального времени» на уровне сети означает, что пользователям не понадобятся специальные приложения или устройства для использования сервиса. Единственное требование — перевод должен быть инициирован пользователем сети T-Mobile. Функция будет работать только во время звонка, T-Mobile не планирует сохранять записи или расшифровки разговоров. Перевод возможен как в сети 5G, так и в 4G. Ключевым требованием является технология передачи голоса с использованием LTE (Voice over LTE, VoLTE), которая позволяет сервису надёжно работать на широком спектре устройств и в различных сетевых условиях. Также поддерживаются режимы «голос через 5G» (VoNR или Vo5G) и «голос через Wi-Fi» (VoWiFi). По словам T-Mobile, участники бета-тестирования смогут активировать функцию «Перевод в режиме реального времени» «на столько времени, сколько им потребуется», без дополнительной платы. Компания не сообщила, станет ли функция платной после запуска для массовой аудитории. Google Meet получил голосовой перевод в реальном времени, но это не бесплатно и пока без русского

06.02.2026 [14:06],

Павел Котов

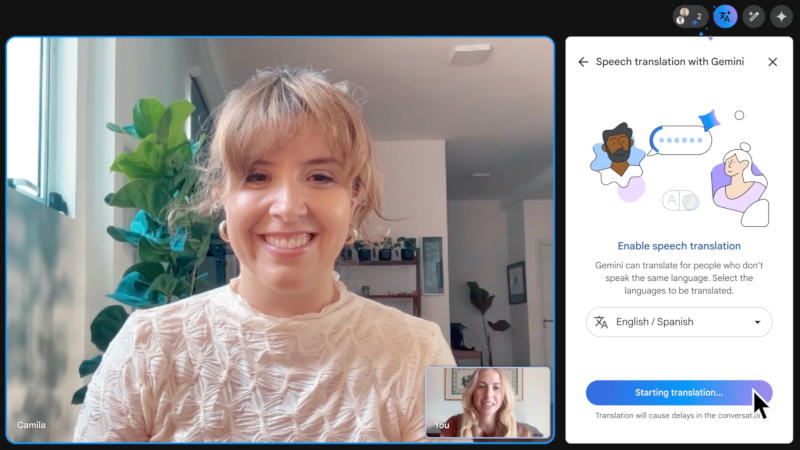

Из стадии тестирования вышла функция голосового перевода устной речи в мессенджере Google Meet — теперь она доступна для большинства пользователей сервисов Workspace в настольной версии. В ближайшие месяцы функция дебютирует в приложениях для Google Android и Apple iOS.

Источник изображения: youtube.com/@googleworkspace Возможность осуществлять сгенерированный искусственным интеллектом голосовой перевод синхронно с речью собеседника компания анонсировала для Google Meet ещё в мае минувшего года. До недавнего времени функция была доступна только подписчикам Google AI Pro и AI Ultra, а также участникам программы тестирования Enterprise Alpha. Уже 27 января Google расширила эту функцию на пользователей Workspace Business Standard, Business Plus, Enterprise Standard, Enterprise Plus и Frontline Plus; она также работает для обладателей подписки Workspace Business и Education с тарифами AI Pro или AI Ultra в качестве дополнения. Нововведение распространяется поэтапно. У обладателей вышеуказанных типов учётных записей он может появиться в течение 15 дней. Когда она станет доступной, перевод можно будет включить в настройках совещания — желающие услышать перевод смогут нажать на соответствующий значок в правом верхнем углу экрана; доступны также некоторые другие опции. На момент запуска общедоступной версии функции поддерживаются английский, испанский, французский, немецкий, итальянский и португальский языки. Но в совещании можно выбрать только одну пару. С 2022 года в Google Meet также поддерживается перевод с помощью субтитров. «Яндекс Переводчика» прокачали с помощью ИИ — он стал лучше справляться со сложными текстами в 80 % случаев

22.12.2025 [11:22],

Алексей Разин

Системы машинного перевода существуют на рынке не первое десятилетие, но с появлением искусственного интеллекта они получили новый стимул для развития. «Яндекс» в фирменном онлайн-сервисе «Переводчик» с недавних пор предлагает пользователям опробовать новый режим работы, основанный на больших языковых моделях, который даёт более качественный перевод сложных и длинных текстов.

Источник изображения: Unsplash, Antony Hyson Seltran Большие языковые модели позволяют лучше понять контекст и приблизить результат перевода к естественному языку, который могли бы использовать профессиональные переводчики при работе с текстом. При этом потери точности смысла не происходит, как утверждают разработчики нового режима «Яндекс Переводчика». Классический режим при переводе названия фильма Me Before You придерживается буквального дословного перевода, выдавая довольно корявое сочетание «Я перед тобой», но ИИ-режим позволяет благодаря анализу общего контекста придерживаться более идиоматичного «До встречи с тобой». В новом режиме сервис лучше работает с устойчивыми выражениями. Например, фразу It is a truth universally acknowledged в старом варианте он перевёл бы пояснительным сочетанием «Общепризнанной истиной является то, что…» В новом варианте сервис предпочитает более естественный и короткий перевод «Все знают, что…», избегая лишнего формализма. По словам привлечённых «Яндексом» экспертов в сфере лингвистики, перевод сложных текстов с привлечением ИИ позволил повысить их качество в 80 % случаев по сравнению с классическими моделями машинного перевода. Пользователи при работе с онлайн-сервисом «Яндекс» теперь могут сами выбирать между традиционным способом перевода и новым режимом, который получил обозначение «Переводчик AI». Работа с последним требует большего времени, но позволяет получить более качественный перевод. Для простых текстов с устоявшимися выражениями без сложной терминологии имеет смысл использовать традиционный режим перевода, который осуществляется почти моментально. Новый режим доступен в приложении «Яндекс Переводчика» для английского, французского, немецкого, итальянского и испанского языков. Поддерживается перевод с указанных языков на русский и обратно. Для экономии ресурсов предусмотрено ограничение на количество запросов, подаваемых одним пользователем за день. Apple заблокирует функцию онлайн-перевода в AirPods для пользователей из Европы

11.09.2025 [16:37],

Владимир Фетисов

Функция онлайн-перевода (Live Translation) в беспроводных наушниках Apple AirPods будет недоступна миллионам европейских пользователей после запуска, который запланирован на следующую неделю. Внедрению этого нововведения в регионе препятствует законодательство, действующее в регионе.

Источник изображения: Apple В описании функции онлайн-перевода для AirPods сказано, что она будет недоступна, если пользовать физически находится на территории ЕС, а регионом регистрации его учётной записи Apple является Европа. Apple не называет причины таких ограничений, но, вероятно, они связаны с давлением со стороны действующего в регионе законодательства и местных отраслевых регуляторов. Напомним, Закон ЕС об искусственном интеллекте и Общий регламент по защите данных (GDPR) устанавливают строгие требования к предоставлению услуг устного перевода. Не исключено, что местные регуляторы захотят более детально изучить, как работает новая функция Apple и как это влияет на конфиденциальность, обработку данных, права граждан и др. Apple также захочет убедиться, что новая функция компании соответствует правилам ЕС, прежде чем онлайн-перевод станет доступен европейцам. Apple анонсировала функцию онлайн-перевода для своих наушников во время презентации AirPods Pro 3, которая состоялась на этой неделе. Она будет доступна не только в новых флагманских наушниках, но и в некоторых более старых моделях, включая AirPods 4 и AirPods Pro 2. При общении с пользователем, который не носит AirPods, перевод его речи может выводиться в виде текста на сопряжённый iPhone. Ещё более эффективен этот инструмент, когда оба собеседника носят AirPods. Функция шумоподавления автоматически снижает громкость одного динамика, а перевод речи транслируется во второй, за счёт чего пользователь может сосредоточиться именно на этом. Функция онлайн-перевода требует обновления прошивки AirPods до последней версии, а также наличие iPhone с поддержкой ИИ-функций Apple Intelligence с iOS 26 или более поздними версиями ОС. На начальном этапе наушники Apple смогут переводить с британского английского на американский, а также французский, немецкий, португальский и испанский языки. Позднее в этом году должна появиться поддержка итальянского, японского, корейского и китайского языков. Функция Google Circle to Search теперь обеспечивает перевод при прокрутке

05.09.2025 [11:20],

Владимир Мироненко

Google сообщила о расширении возможностей перевода в функции визуального поиска Circle to Search, благодаря чему перевод текста будет виден при прокрутке, пишет ресурс TechCrunch.

Источник изображения: blog.google «Перевод — одна из самых популярных функций Circle to Search. Вы можете получить больше контекста для публикаций в социальных сетях от авторов, говорящих на другом языке, или просматривать меню при бронировании столиков в ресторанах за границей», — сообщили в блоге Google, отметив, что до этого момента приходилось перезапускать процесс перевода каждый раз при прокрутке или изменении содержимого на экране. Теперь перевод производится непрерывно при прокрутке страницы и даже при переключении приложений. Если, например, пользователь при прокрутке страницы в соцсети Instagram✴✴ видит публикацию с изображениями, содержащими текст на другом языке, он сможет использовать новую функцию, чтобы читать его на родном языке с непрерывным переводом при прокрутке фотографий. Для доступа к новой функции пользователям необходимо удерживать кнопку «Домой» или панель навигации, чтобы запустить Circle to Search, затем — нажать значок «Перевод» и далее — «Прокрутить и перевести». Google сообщила, что начнёт распространять обновление для платформы Android на этой неделе, начиная с некоторых устройств семейства Samsung Galaxy. Ранее Google добавила в Circle to Search режим AI Mode, поддержку в прохождении игр, а также запустила возможность использования Circle to Search для решения уравнений. Apple представила ИИ-переводчик в реальном временим Live Translation для звонков, переписок и FaceTime

09.06.2025 [23:23],

Николай Хижняк

В рамках презентации на WWDC 2025 компания Apple представила новую функцию живого перевода Live Translation для приложений «Сообщения», FaceTime и телефонных звонков. Функция основана на ИИ-моделях Apple и работает полностью локально на устройстве, тем самым повышая уровень конфиденциальности пользователя.

Источник изображения: Apple В приложении «Сообщения» функция Live Translation автоматически переводит текст по мере его ввода, обеспечивая двустороннее общение на языке получателя. Ответы на сообщения мгновенно переводятся обратно. Во время звонков через FaceTime функция отображает субтитры с переводом в реальном времени, а при телефонных звонках обеспечивает устный перевод на протяжении всего разговора. Перевод и обработка данных происходят непосредственно на устройстве, что гарантирует сохранение конфиденциальности личных разговоров без отправки информации на внешние серверы. Apple продемонстрировала работу функции на примере сценариев планирования поездок в реальном времени, показав, как пользователи могут координировать свои действия с друзьями за границей без языковых барьеров. Live Translation представляет собой очередной шаг Apple в расширении инструментов общения на основе искусственного интеллекта в рамках более широкой инициативы Apple Intelligence, объявленной на прошлогодней WWDC. Аcer показала смарт-кольцо и наушники со встроенным двухсторонним переводчиком

16.05.2025 [19:31],

Сергей Сурабекянц

Acer в преддверии выставки Computex 2025 представила свои дебютные носимые устройства с искусственным интеллектом — смарт-кольцо FreeSense Ring для отслеживания состояния здоровья и наушники AI TransBuds, которые обеспечивают двусторонний голосовой перевод в реальном времени и поддерживают 15 языков. Acer не привела подробностей, но похоже, что наушники оснащены двумя выступающими микрофонами, которые могут улавливать речь собеседника и осуществлять её перевод для владельца. Предположительно, наушники также могут перевести речь своего владельца и озвучить её. TransBuds не могут осуществлять перевод автономно — для этого их требуется подключать к смартфону или планшету. Acer не раскрыла информацию об используемых моделях ИИ. «Для эффективного перевода наушники должен носить только один человек, что делает их идеальными для неформальных бесед, деловых встреч, прямых трансляций или онлайн-сессий обучения, — заявили в Acer. — Наушники также поддерживают субтитры и транскрипцию в реальном времени, помогая пользователям следить за разговорами в режиме реального времени и просматривать их позже». Смарт-кольцо Acer FreeSense Ring сделано из «сверхлёгкого титанового сплава». Устройство может отслеживать частоту сердечных сокращений, вариабельность сердечного ритма, уровень кислорода в крови и качество сна, при этом вся информация отображается в сопутствующем мобильном приложении, которое предоставляет персонализированные рекомендации по оздоровлению. «Пользователи также получают полный доступ ко всем данным о состоянии здоровья без дополнительной абонентской платы, что делает кольцо FreeSense практичным и надёжным ежедневным спутником для поддержания хорошего самочувствия», — сообщила Acer. Шведские учёные обучили ИИ переводу с лошадиного

16.04.2025 [12:40],

Павел Котов

Группа учёных из Швеции разработала модель искусственного интеллекта Dessie, предназначенную для перевода языка тела лошадей в понятный для человека формат. В основу решения легли технологии машинного обучения и синтетические изображения.

Источник изображений: Helena Lopes / unsplash.com Во время клинических осмотров ветеринары часто изучают визуальные сигналы, которые подают животные, но этот способ не всегда надёжен: лошадь может перенести боль на другую ногу, изменить распределение веса или позу. Её поведение может указывать на проблемы ортопедического характера, расстройства поведения или признаки травмы. Традиционные средства диагностики, в том числе рентген и МРТ, дают результаты уже после того, как проблема возникла. Цель Dessie — прочитать язык тела лошади, чтобы обнаружить признаки проблемы заранее. Во время работы модель в реальном времени преобразует плоские изображения в трёхмерные, которые отражают форму, позу и движение лошади. Это не просто визуализация, а попытка осуществить перевод с выразительного языка тела. При создании Dessie использовалось обучение с разделением факторов. В традиционных моделях вся информация — поза, форма, фон, освещение — идёт в едином потоке, что может сбить ИИ с толку и затруднить фокусировку на главном — самой лошади. Обучение с разделением факторов позволяет учитывать каждую особенность отдельно: форма представляется одной сущностью, поза — другой, а не имеющий отношения к задаче фоновый шум игнорируется. Генерируемые Dessie трёхмерные объекты отличаются не только высокой детализацией, но и надёжностью. ИИ помогает исследователям изолировать шаблоны движения, не отвлекаясь на окружающие объекты и различия в освещении. Dessie не требует высококачественных камер и маркеров на теле лошади — ей достаточно одной простой камеры и базовых видеоматериалов. Воспользоваться технологией могут работники сельских клиник, не имеющие доступа к дорогостоящим средствам визуализации.  Для обучения ИИ исследователям потребовались огромные объёмы визуальных данных. Поскольку собрать реальные изображения лошадей разных пород в различных позах и при разном освещении сложно, они разработали генератор синтетических данных DessiePIPE. Он способен создавать неограниченное количество изображений лошадей с использованием трёхмерной модели и текстур, сгенерированных ИИ, на основе характеристик разных пород. Это позволило авторам проекта обучить Dessie особенностям движений лошадей без необходимости изучения тысяч реальных животных: DessiePIPE визуализирует лошадей, которые ходят, едят, встают на дыбы или отдыхают — в различных фонах и условиях освещения. Система также создаёт пары изображений для сопоставления, отличающиеся лишь одним параметром — например, формой или позой, — чтобы модель научилась замечать тонкие различия. В результате Dessie научилась распознавать малые изменения в движении и стала эффективнее обобщать данные для новых условий. Лошади сигнализируют о болевых ощущениях незначительными изменениями в походке и позе, заметными лишь опытному ветеринару. Dessie переводит эти сигналы в объективные трёхмерные показатели, помогая выявлять проблемы на ранней стадии. Она создаёт цифровую запись позы и движений животного, которую можно просматривать многократно, отслеживать в динамике и передавать в другие клиники. Несмотря на то что Dessie обучалась на синтетических данных, ИИ эффективно работает с реальными изображениями: для настройки системы потребовалось всего 150 реальных снимков с аннотациями. Этого набора хватило, чтобы Dessie обошла передовые модели в тестовых задачах: при обнаружении ключевых точек, таких как суставы и другие важные элементы, система показала лучшие результаты, чем MagicPony и Farm3D. Также Dessie точнее предсказывает форму тела и движение, что важно для диагностики хромоты или мышечной асимметрии. При увеличении объёма обучающих данных её эффективность возрастала ещё сильнее — благодаря преимуществам обучения с разделением факторов. Dessie создавалась для анализа лошадей, но архитектура системы настолько гибка, что позволяет получать качественные результаты и при работе с другими похожими животными: коровами, зебрами, оленями. Модель успешно реконструировала их в 3D, несмотря на отсутствие прямого обучения на этих видах. Это открывает большой потенциал в сфере защиты животных: система может изучать редкие виды, используя только готовые фотографии и видео, без необходимости в инвазивном мониторинге. Dessie также продемонстрировала высокую эффективность при обработке художественных изображений, включая картины и мультфильмы, по которым она способна строить точные трёхмерные модели. Однако у системы есть и недостатки. Она работает лучше всего, когда в кадре находится только одна лошадь, и испытывает трудности при столкновении с необычными формами тела, отсутствовавшими в обучающих данных. Эту проблему должна решить новая модель VAREN, поддерживающая большее разнообразие форм. В целом Dessie проста в использовании: она анализирует язык тела лошади и переводит его в синтезированную речь, благодаря чему общение человека с животным выходит на новый уровень. После выхода iOS 19 наушники Apple AirPods получат возможность синхронного перевода речи

14.03.2025 [06:55],

Алексей Разин

Логичным этапом в эволюционном развитии функциональности наушников является появление возможности синхронного перевода речи с разных языков — при условии сопряжения со смартфоном, разумеется. Apple в этой сфере не может претендовать на звание первопроходца, но с выходом iOS 19 планирует наделить данной функцией беспроводные наушники AirPods.

Источник изображения: Apple Об этом на страницах Bloomberg сообщил Марк Гурман (Mark Gurman), традиционно осведомлённый о планах Apple. Соответствующее обновление достанется AirPods до конца этого года, и будет привязано к операционной системе iOS 19. Непосредственно смартфоны Apple подобную функцию реализовали ещё в 2020 году, но применение для соответствующих нужд наушников сделает её использование более удобным. Примечательно, что конкурирующая Google в своих наушниках первого поколения Pixel Buds подобную функцию предусмотрела ещё в 2017 году, продолжив её совершенствовать в дальнейшем. Компании Meta✴✴ и Humane синхронный перевод речи также закладывали в свои носимые устройства в предыдущие годы. Предполагается, что в сопряжении с iPhone функция синхронного перевода будет работать таким образом, что пользователь будет слышать в наушниках перевод речи собеседника на нужный язык, а ответные высказывания владельца iPhone будут через микрофон наушников поступать в смартфон, переводиться на другой язык, и озвучиваться собеседнику уже через динамики iPhone. Meta✴ в партнёрстве с ЮНЕСКО запускает новую программу сбора данных для улучшения речи и перевода ИИ

07.02.2025 [18:49],

Сергей Сурабекянц

LTPP (Language Technology Partner Program — партнёрская программа по языковым технологиям) — совместная инициатива ЮНЕСКО и Meta✴✴ по поиску авторов, которые могут предоставить более 10 часов записей речи с транскрипциями, большие объёмы письменного текста и наборы переведённых текстов на разных языках. В дальнейшем эти данные будут интегрированы в ИИ-модели с открытым исходным кодом для распознавания речи и перевода. Усилия LTPP будут сосредоточены на недостаточно обслуживаемых языках для поддержки работы, уже проводимой в этом направлении ЮНЕСКО. «В конечном итоге наша цель — создать интеллектуальные системы, которые могут понимать и реагировать на сложные потребности человека, независимо от языка или культурного происхождения», — заявил представитель Meta✴✴. В дополнение к новой инициативе Meta✴✴ опубликовала открытый исходный код программы для оценки производительности моделей языкового перевода. Тест, состоящий из предложений, созданных лингвистами, поддерживает семь языков, и доступен на платформе разработки ИИ Hugging Face. Meta✴✴ продолжает расширять количество языков, поддерживаемых её ИИ-моделями и развивать функции автоматического перевода для создателей контента. В сентябре прошлого года компания начала тестирование инструмента для перевода голосов в Instagram✴✴ Reels, который дублирует речь создателя на другом языке с автоматическим липсинком. На сегодняшний день обработка на платформах Meta✴✴ контента на языках, отличных от английского, далека от совершенства. По некоторым данным, в соцсети Facebook✴✴ 79 % дезинформации о COVID на итальянском и испанском языках не были распознаны и отмечены системой, по сравнению с 29 % на английском языке. А сообщения на арабском языке, наоборот, часто ошибочно помечаются как разжигающие ненависть. Meta✴✴ заявила, что принимает меры по улучшению своих технологий перевода и модерации. И, хотя компания позиционирует обе свои языковые инициативы как филантропические, нет никаких сомнений, что главным бенефициаром этих программ станет именно Meta✴✴, которая сможет существенно улучшить качество распознавания речи и перевода. Adobe Premiere Pro теперь может находить видеоклипы по словесному описанию

22.01.2025 [18:57],

Сергей Сурабекянц

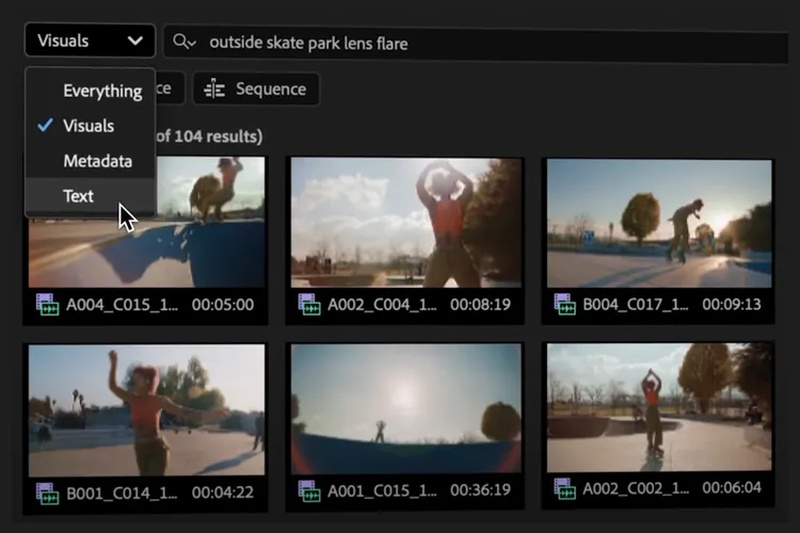

Adobe обновила функцию поиска материалов в Premiere Pro, добавив инструменты визуального распознавания на основе ИИ. Теперь для поиска нужного видеоклипа из подборки достаточно словами описать его содержание. Это всего лишь одна из новых функций, повышающих удобство пользователей, создателей контента и видеоредакторов, которые Adobe добавляет в Premiere Pro, After Effects и Frame.io.

Источник изображения: Adobe Поисковый запрос на естественном языке может выглядеть как «человек на коньках с бликом на объективе» или «счастливый рыбак, поймавший огромного сома». Adobe уверяет, что ИИ может автоматически распознавать «объекты, местоположения, углы обзора камеры и многое другое» наряду с произнесёнными словами, правда, при условии, что к видео прикреплена расшифровка. Новый инструмент поиска не распознаёт звук в видеоклипе и не идентифицирует конкретных людей, но может просматривать любые метаданные, прикреплённые к видеофайлам, что позволяет извлекать клипы на основе дат съёмки, местоположения и модели камеры. Анализ медиа выполняется на устройстве и не требует подключения к интернету. Adobe гарантирует, что видеоконтент пользователей не применяется для обучения каких-либо моделей ИИ. Одновременно с обновлённым поиском Adobe запустила инструмент перевода субтитров, который на сегодняшний день поддерживает 17 языков. Для упрощения просмотра и редактирования сразу нескольких переводов в Premiere Pro можно открыть несколько дорожек субтитров одновременно. Панель поиска с поддержкой ИИ и перевод субтитров доступны с сегодняшнего дня в бета-версии Premiere Pro, которая доступна всем, у кого есть активная подписка Creative Cloud или Premiere Pro. В Adobe After Effects появилась поддержка HDR и новая система кэширования, заметно ускоряющая предварительный просмотр или воспроизведение больших проектов. Теперь для повышения производительности используются как оперативная память, так и дисковый кэш ПК. Adobe утверждает, что это позволит старым компьютерам и ноутбукам воспроизводить крупные проекты без задержек «для кэширования или рендеринга». Новые возможности уже доступны в бета-версии After Effects. Frame.io Camera to Cloud теперь поддерживает интеграцию с камерами Canon C80 и C400, что позволяет автоматически загружать файлы в приложение непосредственно с камеры. Для использования этой возможности владельцам камер необходимо обновить их прошивки до актуальной версии, выпущенной в декабре 2024 года. Meta✴ выпустила ИИ, который налету переводит текст с русского и ещё ста языков

16.01.2025 [13:34],

Павел Котов

Meta✴✴ выпустила модель искусственного интеллекта SeamlessM4T, способную осуществлять перевод со 101 языка. Проект является шагом к созданию универсального переводчика в реальном времени, который сможет обрабатывать устную речь, как только она произносится.

Источник изображения: Sophia Richards / unsplash.com Традиционные модели ИИ для перевода работают по многоэтапной схеме: сначала устная речь превращается в текст, затем осуществляется перевод этого текста на другой язык, после чего текст на новом языке снова превращается в устную речь. Этот метод не всегда достаточно эффективен, поскольку на каждом этапе существует вероятность возникновения ошибок, которые грозят неправильным результатом перевода. Новая модель Meta✴✴ SeamlessM4T осуществляет перевод напрямую и срабатывает, по словам разработчиков, на 23 % точнее, чем лучшие современные модели. В арсенале Google значится модель AudioPaLM, которая поддерживает 113 языков, но осуществляет перевод только на английский; SeamlessM4T переводит со 101 языка на 36. Залогом успеха проекта стал процесс параллельного сбора данных: ИИ фиксирует случаи в просканированных данных источников в вебе совпадения звука или видео с субтитрами на другом языке. В результате модель научилась связывать эти звуки на одном языке с соответствующими фрагментами текста на другом. Авторы проекта, однако, признают, что участие человека в переводе остаётся важным: человек способен учитывать культурный контекст и обеспечить передачу смысла высказывания с одного языка на другой. В медицине или юриспруденции машинный перевод должен тщательно проверяться человеком — в противном случае могут возникать недоразумения. Следует также учесть, что у моделей ИИ могут быть разные объёмы обучающих данных для разных языков: может быть много примеров перевода с греческого на английский, но отсутствовать данные для перевода с суахили на греческий. Чтобы решить эту проблему, разработчики SeamlessM4T предварительно обучали модель на миллионах часов аудиозаписей разговоров на разных языках. Эта подготовка помогла ИИ распознавать общие закономерности языков — в результате упростилась обработка менее распространённых языков, поскольку модель уже располагала основными данными о том, как должна звучать разговорная речь на них. Система доступна с открытым исходным кодом, что, как надеются разработчики, побудит других развивать её текущие возможности. Некоторые эксперты пока сомневаются в том, насколько SeamlessM4T может быть полезна на практике и указывают, что закрытая модель Google работает значительно быстрее. В Meta✴✴ же утверждают, что специалисты компании уже создали более свежую версию Seamless, которая по скорости работы не уступает переводчикам-людям. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |