|

Опрос

|

реклама

Быстрый переход

AMD выпустила профессиональные видеокарты Radeon AI PRO R9700S и R9600D с 32 Гбайт памяти

11.12.2025 [16:01],

Николай Хижняк

Компания AMD расширила ассортимент профессиональных видеокарт Radeon AI Pro R9000 для рабочих станций двумя новыми моделями на архитектуре RDNA 4 — Radeon AI Pro R9700S и AI Pro R9600D. В серию также входит ранее выпущенная Radeon AI Pro R9700. Все три карты предлагают по 32 Гбайт памяти с поддержкой 256-битной шины, имеют по 64 Мбайт кеш-памяти Infinity Cache и поддерживают интерфейс PCIe 5.0 x16.

Источник изображений: VideoCardz / AMD Модель Radeon AI Pro R9700S сохранила конфигурацию GPU Navi 48 стандартной модели R9700. В состав чипа входят 64 исполнительных блока и 4096 потоковых процессоров. «Игровая» частота GPU заявлена на уровне 2350 МГц, а Boost-частота составляет до 2920 МГц. Для карты указана пиковая производительность в операциях формата FP32 на уровне 47,8 Тфлопс. Энергопотребление составляет 300 Вт. Видеокарта оснащена одним разъёмом питания 12V-2×6. Маркировка «S» в названии означает «Silent» — модель оснащена пассивной системой охлаждения. Дизайн карты рассчитан с учётом её использования в составе плотных стоек, где дополнительное охлаждение обеспечивают корпусные вентиляторы. Модель Radeon AI Pro R9600D также построена на чипе Navi 48, но в его составе используются только 48 исполнительных блоков и 3072 потоковых процессора. В то же время карта сохранила 32 Гбайт видеопамяти с поддержкой 256-битной шины и пропускной способностью 640 Гбайт/с. Boost-частота графического процессора составляет 2020 МГц. Энергопотребление заявлено на уровне 150 Вт. Производительность в операциях FP32 составляет 24,8 Тфлопс. В целом конфигурация Radeon AI Pro R9600D похожа на игровую модель Radeon RX 9700 GRE для рынка Китая, но Radeon AI Pro R9600D имеет вдвое больше памяти. В отличие от Radeon AI Pro R9700S и AI Pro R9700, модель Radeon AI Pro R9600D оснащена активной системой охлаждения с одним вентилятором. Все три карты получили по четыре разъёма DisplayPort 2.1a, предлагают опциональную поддержку VRAM ECC под Linux, а также управляются через программное обеспечение AMD Software Pro Edition с полной интеграцией ROCm. После скандала с цензурой OnePlus отключила ИИ-генератор текста в своих смартфонах

08.12.2025 [17:51],

Владимир Фетисов

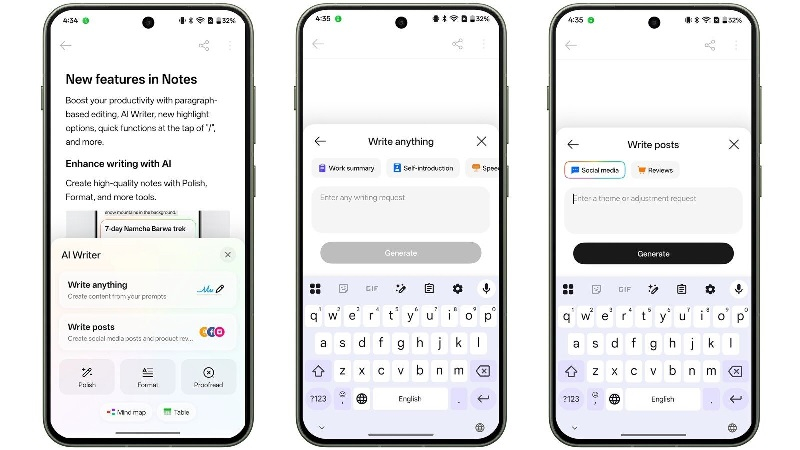

Бренд OnePlus подтвердил временное отключение ИИ-функции AI Writer для устранения «технических проблем». Это произошло вскоре после того, как появились сообщения пользователей о том, что данный инструмент подвержен цензуре и отказывается генерировать тексты на определённые темы.

Источник изображения: OnePlus Функция AI Writer в приложении Notes задействует генеративные алгоритмы OnePlus для создания и редактирования текстов на устройствах бренда. Этот инструмент стал недоступен после появления сообщений о том, что он не генерирует текст на темы, которые часто подвергаются цензуре на домашнем рынке OnePlus в Китае. Многочисленные сообщения пользователей на Reddit, в соцсети X и на форуме OnePlus говорят о том, что при попытке создания текста, например, о Далай-ламе или Тайване, алгоритм сообщает «Попробуйте ввести что-то другое» и не генерирует контент. В некоторых случаях текст начинает генерироваться, но затем он исчезает, и появляется сообщение об ошибке. Аналогичным образом AI Writer ведёт себя, если пользователь просит сгенерировать текст, связанный с индийским штатом Аруначал-Прадеш. Все эти темы часто подвергаются цензуре для пользователей технологических продуктов в Китае, и, по всей видимости, аналогичные правила распространились на глобальную версию ИИ-алгоритма. В сообщении на форуме OnePlus не уточнила, с чем именно связано закрытие доступа к AI Writer, сославшись на проблемы технического характера. Несколько дней назад компания также сообщила, что после проведения внутреннего расследования было установлено, что для устранения проблем потребуется больше времени. Mistral AI сделал заявку на лидерство на рынке открытых моделей, выпустив Mistral 3

03.12.2025 [15:34],

Владимир Мироненко

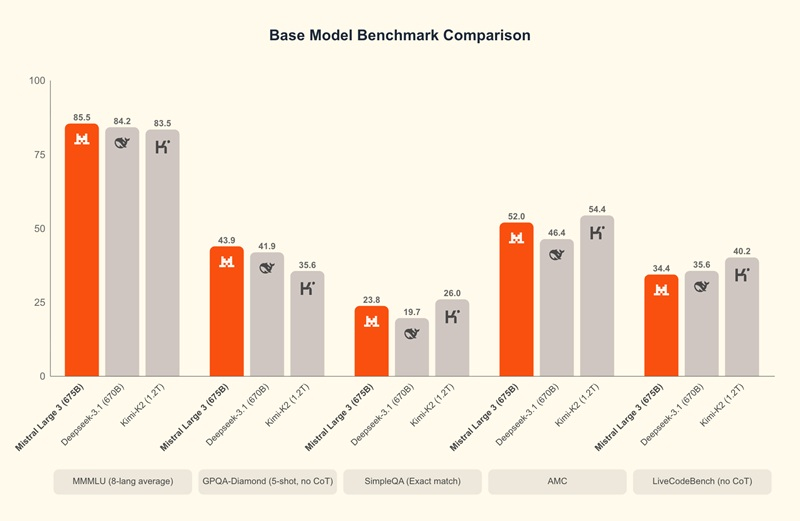

Французский ИИ-стартап Mistral AI представил семейство моделей Mistral 3 следующего поколения с открытыми весами (Open-weight), сделав серьёзную заявку на лидерство в сегменте общедоступных ИИ-моделей, которые обладают рядом преимуществ для корпоративных клиентов по сравнению с решениями крупных технологических компаний.

Источник изображения: Mistral AI Семейство Mistral 3 состоит из 10 моделей, включая большую модель разреженной архитектуры (Mixture of Experts, MoE) с открытыми весами, мультимодальными и многоязычными возможностями — Mistral Large 3. Это самая мощная на сегодняшний день модель компании, обученная с 41 млрд активных и 675 млрд общих параметров. Также в состав семейства входят девять небольших моделей с возможностью автономной работы и полной настройкой, в том числе три современные модели Ministral высокой плотности с 4, 8 и 3 млрд параметров. Модели Mistral обладают лучшим соотношением производительности и стоимости в своей категории. В то же время Mistral Large 3 входит в число передовых моделей с открытым исходным кодом, оптимизированных под тонко настроенные инструкции. Компания указала, что все модели выпускаются по лицензии Apache 2.0, добавив, что открытый исходный код моделей в различных сжатых форматах расширяет возможности сообщества разработчиков и позволяет использовать возможности ИИ благодаря распределённому интеллекту. Как сообщает TechCrunch, стартап Mistral, основанный бывшими сотрудниками DeepMind и Meta✴✴, существует всего два года и на сегодняшний день привлек около $2,7 млрд инвестиций при оценке рыночной стоимости в $13,7 млрд. Это значительно меньше, чему у конкурентов, таких как OpenAI (привлечено $57 млрд при оценке в $500 млрд) и Anthropic (привлечено $45 млрд при оценке в $350 млрд). Mistral утверждает, что больше не всегда значит лучше, особенно для корпоративных сценариев использования ИИ-продуктов. «Наши клиенты иногда рады начать с очень большой [закрытой] модели, которую им не нужно настраивать… но, развернув её, они понимают, что это дорого и медленно, — рассказал ресурсу TechCrunch Гийом Лампле (Guillaume Lample), соучредитель и главный научный сотрудник Mistral. — Затем они обращаются к нам, чтобы мы настроили небольшие модели для более эффективного решения конкретной задачи». По его словам, подавляющее большинство корпоративных сценариев использования ИИ-решений можно реализовать с помощью небольших моделей с тонкой настройкой. Лампле утверждает, что при сравнении с эталонными моделями, когда открытые модели значительно отстают от конкурентов с закрытым исходным кодом, результаты могут быть обманчивы. Он отметил, что большие закрытые модели могут со старта работать лучше, но реальный выигрыш при использовании небольших моделей достигается при настройке. Илон Маск выдал базу для безопасного ИИ — три принципа, без которых технологии грозит безумие

03.12.2025 [06:41],

Анжелла Марина

Илон Маск (Elon Musk) в подкасте с индийским миллиардером Нихилом Каматом (Nikhil Kamath) вновь предупредил об угрозах, исходящих от искусственного интеллекта, и выделил три ключевых принципа, которые, по его мнению, должны лежать в основе безопасного развития технологии: истина, красота и любопытство. По словам Маска, игнорирование этих основ может привести к тому, что ИИ начнёт генерировать опасные выводы, теряя связь с реальностью.

Источник изображения: Tesla Маск, являющийся главой Tesla, SpaceX, xAI, X, Neuralink и The Boring Company, подчеркнул, что мощные технологии по своей природе несут потенциальную угрозу, особенно если они не ориентированы на объективную реальность. Он отметил, что ИИ, обучаясь на данных из интернета, неизбежно усваивает ложную информацию, что может нарушить его способность к логическому выводу и привести к «безумным» или разрушительным заключениям. В подтверждение этой мысли, как пишет CNBC, Маск сослался на проблему «галлюцинаций», то есть генерации ИИ-системами ложных или вводящих в заблуждение ответов, которые уже проявились в реальных продуктах. Например, функция Apple Intelligence на iPhone в начале 2025 года распространила фейковое уведомление о победе британского дартсиста Люка Литтлера (Luke Littler) в чемпионате PDC до того, как тот действительно выиграл турнир. Маск также подчеркнул важность эстетического восприятия и стремления к познанию, заявив, что ИИ должен проявлять интерес к природе реальности и будущему человечества, а не быть инструментом его уничтожения. Его позиция перекликается с мнением «крёстного отца ИИ» Джеффри Хинтона (Geoffrey Hinton), который ранее оценил вероятность гибели человечества от ИИ в 10–20 %. Среди краткосрочных рисков он назвал галлюцинации и автоматизацию рабочих мест начального уровня. «Мы надеемся, что если достаточно умных людей проведут достаточно исследований, располагая достаточными ресурсами, мы найдём способ создания таких систем ИИ, которые никогда не захотят причинить нам вред», — добавил Хинтон. Вышел генератор HD-видео Runway Gen 4.5 — и он сразу обошёл Veo 3 и Sora 2 Pro

02.12.2025 [07:00],

Алексей Разин

Развитие сегмента сервисов, позволяющих генерировать видео по текстовому описанию, перестало вызывать снисходительную улыбку у «старожилов отрасли», поскольку подобные инструменты теперь позволяют создавать реалистичные ролики малыми затратами. Runway утверждает, что её модель Gen-4.5 выводит реалистичность генерируемых ИИ видео на качественно новый уровень.

Источник изображения: YouTube, Runway В блоге Runway, как отмечает The Verge, сообщает о «результатах кинематографического качества». Внимание уделяется не только точности визуального отображения пейзажей, людей, животных и объектов, но и тщательной проработке физики движущихся объектов. Даже поведение жидкостей реализовано настолько реалистично, что неискушённому зрителю сложно догадаться, что видео было сгенерировано искусственным интеллектом. Распространение Runway Gen-4.5 осуществляется постепенно среди всех пользователей сервиса, по быстродействию и эффективности новая модель не будет уступать предыдущей, по словам представителей компании. Тем не менее, некоторые недостатки в её работе пока наблюдаются, в основном они связаны с логикой взаимодействия объектов на видео. Например, дверь может открываться до того, как кто-то в кадре взялся за её ручку. Создатели Runway утверждают, что новая модель лучше адаптирует генерируемое видео под стилистические запросы в описании и может добиваться более зрелищных визуальных эффектов, которые практически неотличимы от реальных видеосъёмок. Конкурирующая OpenAI тоже активно совершенствует свои средства для генерации видео. В сентябре была выпущена модель Sora 2, которая продемонстрировала заметный прогресс в улучшении отображения физических процессов. По словам создателей, она способна реалистично воспроизводить трюки, выполняемые с сапбордом на поверхности воды. Однако новый генератор Runway Gen 4.5 превзошёл главных конкурентов в лице Google Veo 3 и OpenAI Sora 2 Pro и возглавил рейтинг ИИ-моделей для генерации видео по текстовым описаниям Video Arena от Artificial Analysis. После скандала Character.AI закрыла свободные чаты для детей — вместо них появились безопасные «Истории»

26.11.2025 [19:26],

Владимир Фетисов

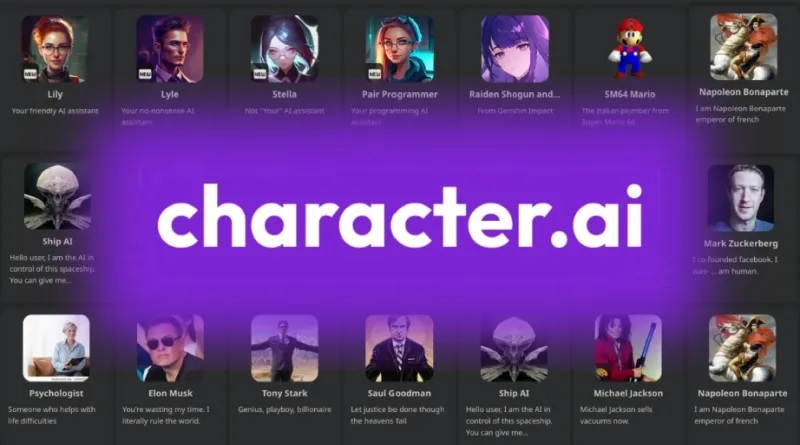

Платформа Character.AI после столкновения с угрозой нескольких судебных исков из-за негативного влияния на психическое здоровье подростков запретила несовершеннолетним взаимодействовать с открытыми чатами. Вместо этого для таких пользователей сервис запустил «Истории», которые в отличии от обычных чатов предлагают «структурированное» виртуальное приключение с участием ИИ-персонажей.

Источник изображения: Character.AI Формат историй доступен всем пользователям Character.AI, но разработчиками он позиционируется именно как способ «улучшить» опыт взаимодействия с ИИ-персонажами для несовершеннолетних. Ещё в прошлом месяце Character.AI объявила, что чаты будут закрыты для подростков с 25 ноября. Параллельно с этим разработчики сообщили о скором запуске функции для проверки возраста пользователей, которая будет автоматически направлять несовершеннолетних пользователей в «более консервативные» ИИ-чаты. Эти меры были приняты после того, как на Character.AI подали в суд, обвинив в том, что платформа способствовала доведению до самоубийства подростка. По мнению истца, взаимодействие несовершеннолетних с ИИ-персонажами также наносит вред их психическому здоровью. Новый формат «Истории» работает по следующему принципу: пользователь может выбрать двух или трёх персонажей, задать жанр, а затем написать самостоятельно описание сюжета или предоставить такую возможность ИИ-алгоритму. Затем платформа сгенерирует «управляемое повествование», где пользователю часто будет предоставляться возможность выбора для изменения хода истории. В «Историях» также используются изображения, сгенерированные ИИ, а в будущем разработчики планируют добавить «более разнообразные мультимодальные элементы». Инженеры проиграли ИИ: модель Claude Opus 4.5 справилась с заданием Anthropic лучше любого из людей

26.11.2025 [01:23],

Анжелла Марина

Anthropic вчера объявила о выпуске новой флагманской модели искусственного интеллекта Claude Opus 4.5. Позже компания рассказала, что в двухчасовом задании, предлагаемом самой Anthropic при найме сотрудников на инженерные позиции, Opus 4.5 показала лучший результат по сравнению с живыми участниками теста.

Источник изображения: AI По утверждению Anthropic, результат ИИ достигнут за счёт многократного решения каждой задачи и выбора лучшего из полученных ответов. Хотя тест не охватывает все компетенции, необходимые инженеру, сам факт превосходства модели над сильными кандидатами в ключевых технических аспектах заставляет предположить, что ИИ в будущем может изменить инженерию как профессию, пишет Business Insider. Подробности содержания теста не раскрываются, но из отзывов на платформе Glassdoor известно лишь, что в 2024 году он включал четыре уровня и требовал реализации определённой системы с последующим добавлением функциональности. Неизвестно, был ли использован аналогичный формат задания при оценке новой версии Claude Opus 4.5, которая вышла спустя всего три месяца после предыдущей модели, получив улучшения не только в генерации кода, но и в создании профессиональных документов, включая таблицы Excel и презентации PowerPoint. Данный релиз, по мнению специалистов, продолжает укреплять лидирующие позиции Anthropic в сфере ИИ для программирования. Даже компания Meta✴✴ Марка Цукерберга (Mark Zuckerberg), являющаяся конкурентом в гонке ИИ, использует Claude для поддержки своего внутреннего помощника по кодированию под названием Devmate. Методы обучения своих моделей компания держит в секрете. Однако ранее Эрик Саймонс (Eric Simons), генеральный директор стартапа Stackblitz, разработавшего сервис Bolt.new, предположил, что Anthropic, возможно, использует ИИ для написания и запуска кода, а затем анализирует результаты как с помощью людей, так и с применением ИИ-инструментов. Это описание подтвердила Дианна Пенн (Dianne Penn), руководитель направления управления продуктами, исследований и передовых технологий в Anthropic, назвав его «в целом верным». Ещё в октябре глава Anthropic Дарио Амодеи (Dario Amodei) сообщил, что ИИ Claude уже пишет 90 % кода для большинства команд внутри компании. При этом он отметил, что это не приведёт к сокращению инженеров, а скорее наоборот, увеличит в них потребность, так как люди смогут сосредоточиться на самой сложной 10-процентной части работы или на контроле группы ИИ-моделей. «Роботы могут проломить череп»: Figure AI уволила инженера за такие слова и теперь ответит за это в суде

23.11.2025 [22:14],

Владимир Фетисов

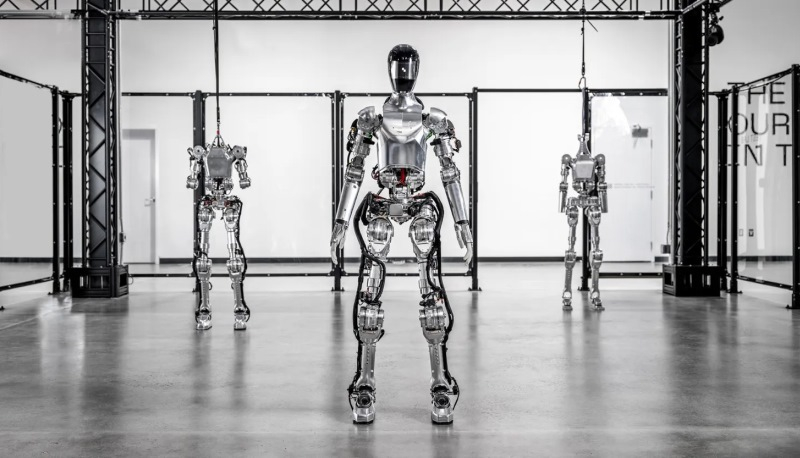

Роберт Грюндель (Robert Gruendel), бывший глава отдела безопасности продукции стартапа Figure AI, занимающегося разработкой человекоподобных роботов и поддерживаемого Nvidia, подал в суд на компанию. Он утверждает, что был безосновательно уволен после того, как предупредил руководство стартапа о том, что роботы компании «достаточно сильны, чтобы проломить человеческий череп».

Источник изображения: Figure AI Иск Грюнделя в конце этой недели был подан в федеральный суд Северного округа Калифорнии. Адвокаты истца позиционируют своего клиента, как разоблачителя, который был уволен из Figure AI в сентябре, всего через несколько дней после того, как направил задокументированные опасения по вопросам безопасности руководству стартапа. Иск подан спустя два месяца после того, как Figure AI была оценена в $39 млрд в ходе очередного раунда финансирования, в котором в роли основного инвестора выступил фонд Parkway Venture Capital. Рыночная стоимость стартапа выросла в 15 раз по сравнению с началом 2024 года, когда компания привлекла средства таких инвесторов, как Джефф Безос (Jeff Bezos), Nvidia и Microsoft. В исковом заявлении говорится, что Грюндель предупреждал гендиректора Figure AI Бретта Адкока (Brett Adcock) и главного инженера Кайла Эдельберга (Kyle Edelberg) о возможности того, что роботы могут нанести серьёзный вред человеку. Он также сообщил, что один из них из-за неисправности проделал отверстие шириной четверть дюйма в стальной дверце холодильника. В документе сказано, что Грюндель предостерегал руководство от «сворачивания дорожной карты по безопасности», которую ранее он презентовал двум потенциальным инвесторам, в итоге профинансировавшим стартап. Грюндель выразил опасения по поводу того, что «план обеспечения безопасности продукции, который повлиял на их решение об инвестициях, фактически уничтожен» ещё в том месяце, когда Figure AI завершила раунд финансирования. В иске говорится, что такие действия впоследствии могли быть расценены, как мошенничество. Отмечается, что опасения истца по поводу безопасности воспринимались руководством как «препятствия, а не выполнение служебных обязательств». В конечном счёте компания с расплывчатой формулировкой об «изменении бизнес-направления» уволила Грюнделя. Теперь же он требует возмещения понесённого ущерба, а также компенсации и штрафа для Figure AI, настаивая на том, чтобы дело рассматривалось судом присяжных. Представитель Figure AI, комментируя данный вопрос, заявил, что Грюндель «был уволен за неудовлетворительную работу», и что его «обвинения являются ложью, которую Figure AI опровергнет в суде». ИИ-режим в поиске Google научился визуализировать маршруты планируемых путешествий

18.11.2025 [10:46],

Владимир Фетисов

Пользователи Google, которые собираются в деловую поездку или отпуск, теперь могут задействовать ИИ-режим AI Mode в поисковике компании для визуализации маршрута своих перемещений. Достаточно описать будущую поездку в AI Mode и выбрать опцию Create with Canvas, после чего сервис в боковой панели сформирует маршрут перемещений с включением в него данных о перелётах и отелях.

Источник изображений: Google Сформированный таким образом файл может содержать предложения ИИ на основе введённых пользователем данных, а также фотографии мест, где пользователь может оказаться, и отзывы из «Google Карт». Изначально сгенерированный маршрут можно доработать с помощью дополнительных текстовых запросов. К примеру, можно попросить ИИ-помощника подобрать отели в определённом ценовом диапазоне или найти развлечения с учётом проводимого в пути времени. На данном этапе это нововведение доступно пользователям из США, которые взаимодействуют с AI Mode на компьютерах. Напомним, функция Canvas была запущена в марте как динамическое рабочее пространство для Gemini, способное отображать разную информацию в режиме онлайн. Google анонсировала функцию планирования поездок с использованием Gemini ещё в прошлом году, и теперь она постепенно становится доступной пользователям поисковой системы. Вероятно, это плохая новость для некоторых крупных туристических компаний, которые занимаются разработкой собственных аналогов. Пользователи могут задействовать ИИ-агента для автоматизированного бронирования билетов на разные мероприятия и встречи, а вскоре к этому добавится возможность бронирования столиков в ресторанах. AI Mode формирует список вариантов с ссылками для завершения процесса бронирования через партнёров Google в США, таких как OpenTable, Resy и др. Google также сотрудничает с гостиничными компаниями и онлайн-платформами бронирования, включая Booking.com, Expedia, Marriott и др., чтобы в будущем запустить бронирование билетов на авиаперелёты и номеров в отелях с помощью AI Mode. В дополнение к этому компания расширяет доступность ИИ-функции поиска выгодных предложений по авиаперелётам, которая прежде была доступна в США, Канаде и Индии. По данным Google, этот инструмент постепенно станет доступен в более чем 200 странах и будет поддерживать свыше 60 языков. Google выпустит мобильную версию AI Studio для вайб-кодинга на ходу

17.11.2025 [22:29],

Владимир Фетисов

Сервис Google AI Studio помогает разработчикам создавать приложения с помощью текстовых запросов на естественном языке. На этой неделе IT-гигант анонсировал скорое появление мобильного приложения для доступа к сервису. Начать взаимодействие с ним разработчики смогут в начале 2026 года.

Источник изображений: Google Это означает, что ещё один популярный инструмент Google на базе искусственного интеллекта станет доступен на мобильных устройствах. Напомним, AI Studio — это интегрированная веб-среда разработки на базе ИИ-модели Gemini, которую разработчики приложений и веб-сайтов могут задействовать для создания новых продуктов. Руководитель проекта AI Studio в Google Логан Килпатрик (Logan Kilpatrick) сообщил о скором запуске мобильного приложения в соцсети X, заявив, что «не может дождаться» релиза. Другой представитель команды разработчиков Аммар Реши (Ammaar Reshi) в комментариях к посту попросил пользователей поделиться идеями касательно функций, которые они хотели бы видеть в новом мобильном приложении. Ни Килпатрик, ни Реши не уточнили, как будет выглядеть AI Studio на мобильных устройствах, когда именно приложение будет запущено и какие платформы оно будет поддерживать. Другие ИИ-приложения Google, такие как Gemini, доступны в App Store. Это означает, что AI Studio также может быть доступен пользователям iPhone и iPad. Google описывает AI Studio как инструмент, с помощью которого разработчики могут использовать команды на естественном языке для создания полнофункциональных приложений. С момента запуска в 2023 году AI Studio стал популярным веб-инструментом, благодаря чему мобильная версия сервиса может обзавестись немалой пользовательской базой уже на старте. Глава Microsoft раскритиковал идею единой доминирующей ИИ-модели на замену человека

14.11.2025 [18:50],

Анжелла Марина

Генеральный директор Microsoft Сатья Наделла (Satya Nadella) выразил сомнение в том, что сильный искусственный интеллект (AGI) должен быть главной целью развития ИИ. Вместо этого он предложил сосредоточиться на создании «когнитивных усилителей» — систем, которые расширяют возможности человека, а не заменяют его.

Источник изображения: AI Ранее OpenAI представила модель GPT-5 с улучшениями в области логического вывода, качества кода и пользовательского опыта. Несмотря на ожидания, что это станет определённым шагом к достижению AGI, впоследствии появились сообщения о сбоях и ошибках в работе модели. По мере углубления в ИИ-ландшафт — как OpenAI, так и Microsoft — постепенно стали смещать акценты, намекая, что AGI больше не рассматривается как конечная цель. В ходе интервью с Дваркешем Пателем (Dwarkesh Patel) и основателем SemiAnalysis Диланом Пателем (Dylan Patel) Наделла подчеркнул, что для него важнее не создание единой сверхмощной модели, а практическая польза технологий. По его словам, ключевой задачей остаётся разработка множества моделей и экосистем, а не ставка на один универсальный ИИ. Наделла сослался на определение ИИ, предложенное учёным Раджем Редди (Raj Reddy), согласно которому «искусственный интеллект должен выступать либо в роли ангела-хранителя, либо в роли когнитивного усилителя». Наделла назвал этот подход простым и глубоко ориентированным на человека, признавая потенциал технологии. В то же время он отметил, что традиционное понимание AGI подразумевает систему, превосходящую человека в когнитивных задачах. В гипотетическом сценарии, где одна лаборатория создаст такую модель и развернёт её повсеместно, система со временем сможет занять все рабочие места в экономике. На вопрос, позволила бы такая модель Microsoft захватить всю прибыль, Наделла ответил: «Если существует одна доминирующая модель, развёрнутая повсюду, поглощающая все данные и непрерывно обучающаяся, то да — это конец игры». Глава Microsoft пояснил, что компаниям, создающим базовые модели, и компаниям, строящим вокруг них инфраструктуру, необходимо работать вместе из-за того, что создатели моделей могут столкнуться с риском «проклятия победителя». То есть, можно проделать всю тяжёлую работу, совершить невероятные инновации, но при этом продукт будет всегда находиться в одном шаге от копирования или компиляции. Google представила геймерского ИИ-агента SIMA 2 — он умеет проходить незнакомые игры

13.11.2025 [21:25],

Анжелла Марина

Разработчики исследовательского подразделения Google DeepMind создали новую версию ИИ-агента SIMA 2 для игр. Этот инструмент способен не просто следовать командам, а понимать цели игрока и самостоятельно выполнять сложные действия в видеоиграх. В отличие от первой версии, запущенной в марте 2024 года, SIMA 2 использует языковую модель Gemini, что позволяет ему рассуждать и принимать решения даже в тех играх, которые он никогда раньше не видел, например, No Man’s Sky, Valheim и Goat Simulator 3.

Источник изображения: Google DeepMind Пока система доступна лишь ограниченному числу исследователей и разработчиков в рамках закрытого тестирования. При этом в DeepMind подчёркивают, что главная цель проекта состоит не в создании игрового помощника для массового пользователя, а в отработке технологий, которые в будущем могут применяться вне виртуального мира. Джейн Ванг (Jane Wang), старший научный сотрудник DeepMind, назвала видеоигры «идеальной площадкой для обучения ИИ навыкам, полезным в реальной жизни». Команда DeepMind рассматривает проект SIMA 2 как важный шаг на пути к созданию искусственного общего интеллекта (AGI). В компании считают, что способность ИИ действовать в незнакомой среде и выполнять сложные цели лежит в основе будущих систем, включая роботов общего назначения, и именно эта способность адаптироваться к новым условиям может привести к развитию действительно универсального ИИ. ElevenLabs получила разрешение от голливудских звёзд на коммерческое применение их ИИ-голосов

13.11.2025 [09:00],

Анжелла Марина

Компания ElevenLabs, являющаяся одним из популярных ИИ-стартапов, специализирующихся на создании реалистичных голосов с помощью генеративного искусственного интеллекта (ИИ), заключила соглашение с актёрами Майклом Кейном (Michael Caine) и Мэттью Макконахи (Matthew McConaughey) о возможности генерации их голосов с помощью ИИ. Об этом сообщило издание TechCrunch.

Источник изображения: ElevenLabs На сегодняшний день отношения Голливуда с искусственным интеллектом остаются противоречивыми: отсутствие чётких правил использования технологий стало одной из ключевых причин забастовок в индустрии несколько лет назад. Тем не менее, в последнее время отдельные артисты начали проявлять интерес к коммерческому применению своих цифровых голосов. Например, в прошлом году Meta✴✴ анонсировала, что встроенные в её платформу голосовые ассистенты будут озвучены в стиле актрис Кристен Белл (Kristen Bell) и Джуди Денч (Judi Dench). В случае с Макконахи, который также является инвестором ElevenLabs, его ИИ-голос будет использоваться для перевода на испанский язык его авторского информационного бюллетеня. На этой неделе ElevenLabs также запустила маркетплейс, через который бренды смогут легально использовать авторизованные ИИ-голоса знаменитостей. Помимо Майкла Кейна и Мэттью Макконахи, в число известных людей, чьи голоса будут представлены на новой платформе, войдут такие имена, как Лайза Миннелли (Liza Minnelli) и поэтесса Майя Энджелоу (Maya Angelou). Сообщается также, что ElevenLabs, входящая в число наиболее известных «единорогов» в сфере ИИ, привлекла инвестиции от фондов a16z и ICONIQ. Google Pixel научились распознавать мошенников в чатах и делать ИИ-сводки уведомлений

12.11.2025 [10:26],

Анжелла Марина

Google выпустила крупное обновление для смартфонов Pixel с новой функцией ИИ-сводок уведомлений. В отличие от Apple, которая столкнулась с трудностями при внедрении аналогичного инструмента, Google выбрала осторожный подход, при котором изначально сводки будут генерироваться только для чатов и только в случае длительных переписок. Функция появится в ноябрьском обновлении для устройств Pixel 9 и новее, за исключением модели Pixel 9a. Как сообщает The Verge со ссылкой на более раннюю публикацию издания Android Authority, код этой функции был обнаружен ещё в августе в бета-версии Android 16. Согласно данным в коде, сводки будут формироваться исключительно для разговоров в чат-приложениях, и только если диалог содержит достаточное количество сообщений. Отмечается, что такое ограничение даёт системе больше контекста и помогает избежать ошибок, подобных тем, что допускала ИИ-система Apple. В декабре Google планирует расширить функциональность за счёт автоматической сортировки уведомлений и отключения звука у тех, которые расценены системой как менее приоритетные.

Источник изображения: Google Ранее компания также внедрила технологию обнаружения мошеннических сообщений за пределами собственного приложения «Google Сообщения» (Messages). Теперь функция станет доступна на устройствах Pixel 6 и новее, а также в сторонних мессенджерах, включая Telegram и Discord. Уведомления, распознанные как потенциально неблагонадёжные, получат маркировку «Вероятно, мошенничество», а при нажатии на такое уведомление появится всплывающее окно с предупреждением о необходимости проявлять осторожность. Кроме того, компания расширит доступ к функции обнаружения мошенничества при звонках, предоставив её владельцам Pixel 9 (за исключением 9A) в Великобритании, Ирландии, Индии, Австралии и Канаде. Примечательно, что в самом приложении «Google Сообщения» появится возможность делать ремиксы фотографий с помощью ИИ прямо внутри чата. Эта функция будет доступна не только на Pixel, но и на других устройствах с Android, однако пока ограничена англоязычными пользователями из США, Великобритании, Австралии, Канады, Индии, Ирландии и Новой Зеландии. Также на Pixel 6 и новее уведомления от «VIP-контактов» будут получать повышенный приоритет. AyaNeo перепредставила портативную консоль Next II на чипе Ryzen AI Max+ 395 — теперь она похожа на Steam Deck

07.11.2025 [19:00],

Николай Хижняк

Компания AyaNeo решила изменить дизайн будущей портативной приставки Next II. Ранее анонсированная консоль имела более эргономичную форму контроллера, теперь же устройство выглядит как клон Steam Deck.

Источник изображений: VideoCardz / AyaNeo Характеристики приставки при этом не изменились. Она по-прежнему будет оснащаться флагманским 16-ядерным процессором Ryzen AI Max+ 395 с производительной встроенной графикой Radeon 8060S на базе 40 исполнительных блоков архитектуры RDNA 3.5. Также консоль сохранила свою собственную внутреннюю батарею, что выгодно отличает её от тех же моделей приставок OneXplayer OneXfly Apex и GPD Win 5, оснащённых внешними аккумуляторами. Ёмкость батареи Next II компания пока не сообщает — как, впрочем, и многие другие характеристики. Производитель отмечает использование в устройстве системы охлаждения с двумя вентиляторами. В условиях компактного корпуса консоли самой сложной задачей станет обеспечение эффективного теплоотвода. Напомним, что процессоры серии Ryzen AI Max (Strix Halo) обладают TDP до 120 Вт — для портативного устройства это, очевидно, избыточно. Если AyaNeo сможет удерживать TDP на уровне 45–65 Вт в режиме максимальной мощности при работе от аккумулятора, это уже можно будет считать достижением. При подключении к сети приставка, вероятно, сможет обеспечить больший запас по мощности и производительности. Однако пока это лишь предположение. AyaNeo Next II оснащается линейными триггерами с эффектом Холла и двумя сенсорными панелями. Один из стиков консоли использует технологию магнитного сопротивления, устойчивую к дрейфу. AyaNeo не сообщает, когда полноценно представит устройство, сколько оно будет стоить и когда поступит в продажу. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |