|

Опрос

|

реклама

Быстрый переход

ИИ-модель OpenAI GPT-5.5 оказалась в 1,5–2 раза дороже предшественницы

09.05.2026 [14:38],

Павел Котов

В мире высоких технологий, как оказалось, дорожают не только чипы памяти, но и модели искусственного интеллекта: с выпуском GPT-5.5 компания OpenAI подняла цены за доступ к ней через API — в некоторых случаях она оказалась вдвое дороже предшественницы.

Источник изображения: Mariia Shalabaieva / unsplash.com Цены за работу с OpenAI GPT-5.5 составляют $5 (входящие), $0,50 (кешированные входящие) и $30 (выходящие) за 1 млн токенов — для сравнения, при работе с GPT-5.4 эти ценники равны соответственно $2,50, $0,25 и $15. Рост цен частично компенсируется более высокой эффективностью — способностью модели показывать лучшие результаты, используя меньше токенов, заверили в OpenAI. Но даже с учётом этого работа с моделью обходится заметно дороже, подсчитали в OpenRouter: «Фактическая стоимость GPT-5.5 выросла на 49–92 %, показал наш анализ. При более длинных запросах, более 10 000 токенов, затраты компенсируются сокращённым временем выполнения. При более коротких запросах, менее 10 000 [токенов], отмечается более значительное увеличение стоимости, тогда как время обработки не сокращается». Модель OpenAI GPT-5.5 генерирует на величину 19–34 % меньше токенов при более длинных запросах. Считающиеся лидерами мировой отрасли ИИ компании OpenAI и Anthropic остаются убыточными: по итогам 2026 года убытки первой составят $14 млрд, второй — $11 млрд. При этом новая флагманская модель Anthropic Claude Opus 4.7 доступна по тем же ценникам, что и её предшественница, несмотря на заявления разработчика об улучшенном токенизаторе. Но на практике подорожала и она, отметили в OpenRouter: при запросах длиной более 2000 токенов затраты выросли на величину 12–27 % с учётом экономии за счёт кеширования токенов; при запросах менее 2000 символов более короткие ответы помогли компенсировать накладные расходы токенизатора. Windows 11 до сих пор держится на коде эпохи Windows 95 — попытки заменить его провалились

08.05.2026 [17:25],

Павел Котов

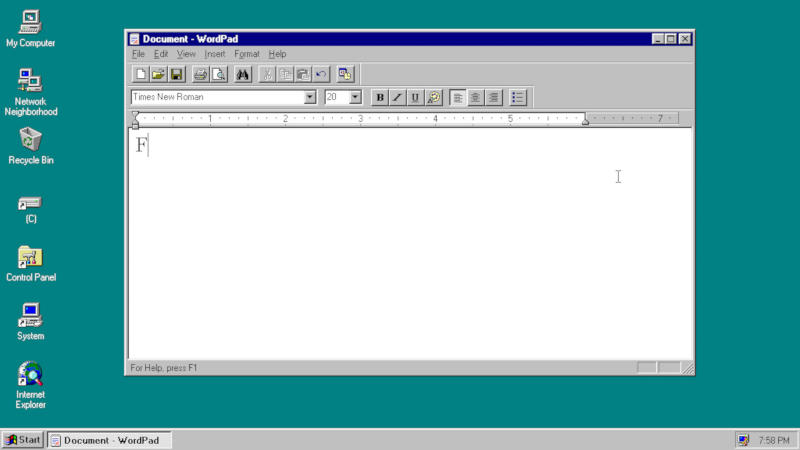

Центральным элементом функциональности Windows 11 до сих пор остаётся проверенный не годами, а десятилетиями API Win32. Своими корнями он восходит к Windows 95, разработчики которого мечтали, что в 2026 году появятся летающие автомобили и лунные станции.

Источник изображения: Microsoft Об истинных корнях Windows 11 рассказал ветеран Microsoft Марк Руссинович (Mark Russinovich). «Кто-нибудь в девяностые ожидал, что Win32 останется первоклассным API в 2026 году? Могу с уверенностью ответить: нет. Никто не ожидал бы такого, потому что мы мечтали о летающих автомобилях и лунных станциях к 2026 году. Не о Win32, разработанном ещё во времена Windows 95», — поведал он. Win32 — это набор входящих в комплект Windows функций или вызовов, которые стороннее ПО может использовать для взаимодействия с ОС. Когда программе нужно отобразить окно на экране, прочитать файл, обработать щелчок мыши, показать текст или отреагировать на нажатие клавиши на клавиатуре, разработчику не нужно включать код для выполнения этих задач. Он обращается к предварительно написанным функциям Win32, таким как «CreateWindow()», «ReadFile()» и «GetCursorPos()» — и все они восходят к Windows 95. Microsoft пыталась отказаться от Win32. С Windows 8 вышел новый API WinRT, к которому обращался пользовательский интерфейс системы — тогда предполагалось, что «квадратики» останутся надолго. Но оглушительного успеха Windows 8 не имела, и с Windows 10 компания в значительной степени вернулась к Win32. WinRT почти полностью поглотила Universal Windows Platform for Windows 10, которую впоследствии переименовали в Windows App SDK и WinUI 3. Но большинство программ так и обращается к Win32. OpenAI выпустила GPT-Realtime-2 и ещё две голосовые модели, но доступны они лишь через API

08.05.2026 [11:42],

Владимир Мироненко

Компания OpenAI объявила о включении в API ряда новых возможностей голосового интеллекта, призванных помочь разработчикам создавать приложения, способные «говорить», расшифровывать и переводить разговоры с пользователями.

Источник изображения: Zac Wolff/unsplash.com В частности, разработчикам через API Realtime теперь доступны три новые модели голосового управления в реальном времени — GPT-Realtime-2, GPT-Realtime-Translate и GPT-Realtime-Whisper. Новые модели поддерживают более естественное голосовое взаимодействие, перевод в реальном времени и транскрипцию речи в текст с низкой задержкой. Модель GPT-Realtime-2 создана для голосового взаимодействия в реальном времени, обладая способностью анализировать запросы, вызывать инструменты, обрабатывать исправления и естественно продолжать разговор. В отличие от своей предшественницы GPT-Realtime-1.5, эта модель построена на основе логики класса GPT-5, разработанной для обработки более сложных запросов от пользователей. GPT-Realtime-2 включает в себя следующие новые возможности для голосовых агентов:

Модель GPT-Realtime-Translate предназначена для предоставления услуг перевода в реальном времени, «поддерживая темп» разговора с пользователем. Модель поддерживает более 70 языков ввода (то есть языков, которые она может понимать) и 13 языков вывода (языков, которые она передает говорящему). Сообщается, что модель может сохранять смысл, подстраиваясь под говорящего, даже когда пользователи меняют контекст, используют региональное произношение или специфическую для предмета лексику. Модель GPT-Realtime-Whisper — потоковая модель транскрипции, созданная для преобразования речи в текст с низкой задержкой. «Запускаемые нами модели переводят аудио в реальном времени из простого диалога в голосовые интерфейсы, которые действительно могут работать: слушать, рассуждать, переводить, транскрибировать и предпринимать действия по мере развития разговора», — сообщила компания. Стоимость GPT-Realtime-2 составляет $32 за 1 млн входных аудиотокенов, $0,40 за 1 млн кешированных входных токенов и $64 за 1 млн выходных аудиотокенов. Стоимость GPT-Realtime-Translate составляет $0,034 в минуту, а GPT-Realtime-Whisper — $0,017 в минуту. Разработчики могут опробовать новые модели на онлайн-платформе OpenAI Playground. ИИ с «глазами» оказался в разы дороже обычного API — агенты сжигают бюджеты, ходя по сайтам

07.05.2026 [17:44],

Павел Котов

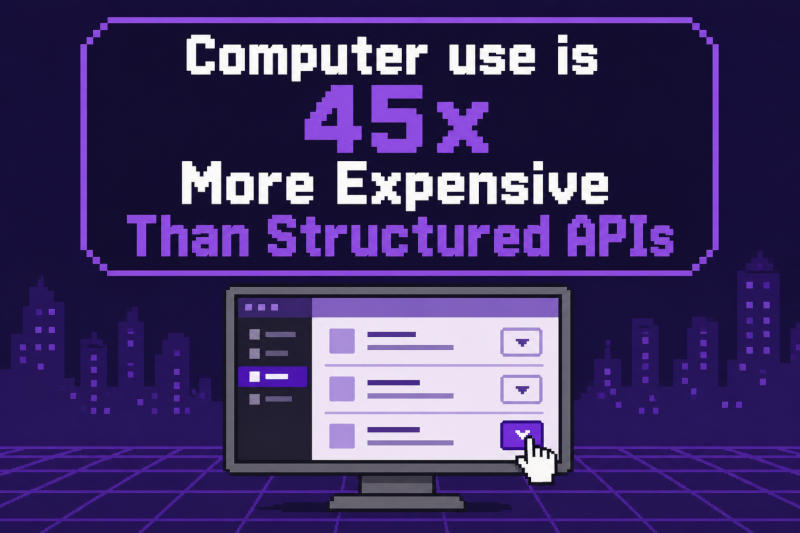

Компании, которые используют агентов искусственного интеллекта, могут потратить значительно больше денег, если эти агенты оперируют визуальными данными, имитируя человеческое зрение.

Источник изображения: reflex.dev Специалисты платформы корпоративных приложений Reflex сравнили визуальных ИИ-агентов с теми, что осуществляют доступ к внешним ресурсам через API. Обоими агентами управляла нейросеть Anthropic Claude Sonnet: в первом случае она контролировала Python-фреймворк browser-use 0.12 для автоматизированной работы с браузером; во втором — обращалась к тем же веб-приложениям по API. При обращении по API агент вызывал те же механизмы обработки, что при работе с пользовательским интерфейсом, но получал в ответ структурированные данные, а не скриншот веб-страницы, который требовалось дополнительно анализировать. Обоим агентам организаторы эксперимента дали задание: «Клиент по имени Смит пожаловался на недавний заказ. Найди Смита с наибольшим количеством заказов, прими все его отзывы на модерации и отметь последний как доставленный». ИИ-агент с обращением по API выполнил задачу за восемь запросов к ИИ-модели; визуальный вариант нашёл только один из четырёх ожидающих отзывов — остальные три он пропустил, потому что не догадался прокрутить страницу. Когда условия задачи упростили в угоду визуальному ИИ-агенту, тот выполнял её около 17 минут; вариант с обращением по API добился результата за 20 секунд и израсходовал в 45 раз меньше токенов модели ИИ. По оценкам Anthropic, обработка изображения размером 1000 × 1000 пикселей с помощью модели Claude Sonnet 4.6 расходует около 1334 токенов. Визуальный ИИ-агент израсходовал на выполнение задачи около 500 000 входных и около 38 000 выходных токенов; обращавшийся по API агент потратил около 12 150 входных и 934 выходных токенов. Авторы эксперимента сделали такой вывод: агентов с машинным зрением следует использовать только для работы с приложениями, которые пользователь не контролирует; внутренние процессы должны обрабатываться по API. Публикация ссылок в X подорожала в 20 раз, но не для всех

22.04.2026 [06:30],

Дмитрий Федоров

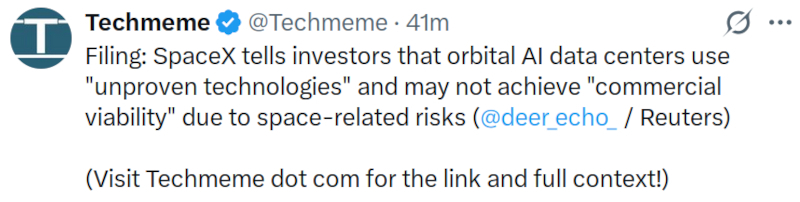

X увеличила стоимость публикации ссылок через свой программный интерфейс (API) на 1900 % — с $0,01 до $0,20 за каждый пост с URL-адресом. Удорожание уже вынудило новостной агрегатор Techmeme отказаться от размещения ссылок в постах на платформе, заменив их просьбой перейти на сайт агрегатора. Повышение цен усиливает опасения издателей, что X целенаправленно снижает ценность новостного контента.

Источник изображения: x.com Руководитель продуктового направления X Никита Бир (Nikita Bier) заявил, что повышение стоимости направлено на борьбу с поисковым спамом. Это нововведение немедленно сказалось на Techmeme — одном из самых заметных технологических аккаунтов на платформе. До воскресенья посты агрегатора содержали краткие заголовки новостей со ссылкой на первоисточник. Теперь вместо ссылки агрегатор просит читателей перейти на сайт: «Visit Techmeme dot com for the link and full context!» Аккаунт Techmeme подтвердил отказ от ссылок в постах, объяснив его ростом расходов на API в 20 раз.

Источник изображения: @Techmeme / x.com Удорожание обостряет и без того болезненную для издателей тему. Многие подозревают, что внешняя ссылка снижает охват поста в алгоритмической выдаче X. Свежее исследование Nieman Lab, охватившее посты 18 крупных медиакомпаний, подтвердило, что ссылки, по всей видимости, вредят новостным издателям на платформе X. Вопрос всплыл в недавней публичной перепалке между аналитиком Нейтом Сильвером (Nate Silver) и Биром: последний настаивал, что ссылки не понижаются в выдаче. Бир пояснил Techmeme, что посты в X должны содержать материал, на который пользователи могут отреагировать, — иначе алгоритму неоткуда «получить сигнал». Аккаунты из исследования Nieman Lab, по словам Бира, систематически публиковали заголовок со ссылкой и больше ничего. В ответе основателю и гендиректору Techmeme Гейбу Ривере (Gabe Rivera) Бир заявил: «Говорю вам прямо: в коде нет ничего, что понижало бы ссылки в выдаче». Bose спасёт устаревшие колонки SoundTouch от потери функций, открыв исходный код и документацию API

08.01.2026 [19:10],

Павел Котов

Компания Bose решила пойти навстречу своим потребителям и выложила в открытый доступ документацию и исходный код API своих умных колонок серии SoundTouch, поддержка которых должна была прекратиться 18 февраля 2026 года. Само отключение компания перенесла на 6 мая.

Источник изображения: Bose Когда поддержка облачных сервисов прекратится, с обновлением приложения SoundTouch добавятся локальные элементы управления, которые помогут сохранить как можно больше функциональности без облачных сервисов. Музыку на колонки SoundTouch по-прежнему можно будет транслировать через Bluetooth, AirPlay, Spotify Connect и, конечно, проводное подключение. Продолжат работать функции дистанционного управления и синхронизации колонок; возможность настройки SoundTouch сохранится. Когда API умных колонок перейдёт в формат открытого исходного кода, владельцы акустики Bose SoundTouch смогут создавать свои собственные совместимые инструменты, чтобы попытаться восполнить пробелы, возникшие из-за отсутствия облачных сервисов. Прекращение официальной поддержки, конечно, огорчает, но решение производителя поможет людям продолжать использовать колонки в полной мере и не лишит их части востребованных функций. На такой шаг сегодня решается не каждый производитель — часто облачные сервисы отключаются, и оборудование перестаёт работать, частично или полностью. Иногда и владельцам устройств удаётся вмешаться, чтобы исправить ситуацию. В 2016 году Pebble прекратила свою работу, и пользователи сохранили работоспособность своих часов, создав Rebble Alliance — сообщество заменило облачные сервисы, прошивки и магазин приложений. Стартап Modos разработал первый в мире дисплей на электронной бумаге с частотой обновления 75 Гц

09.09.2025 [20:24],

Сергей Сурабекянц

Дисплеи на электронных чернилах (электронная бумага) ценятся за удобство чтения и низкое энергопотребление, но долгое время они оставались слишком медленными для использования в ПК и ноутбуках. Modos, стартап из двух человек, утверждает, что решил часть этой проблемы, представив комплект разработчика, способный управлять дисплеем на электронной бумаге с частотой обновления 75 Гц.

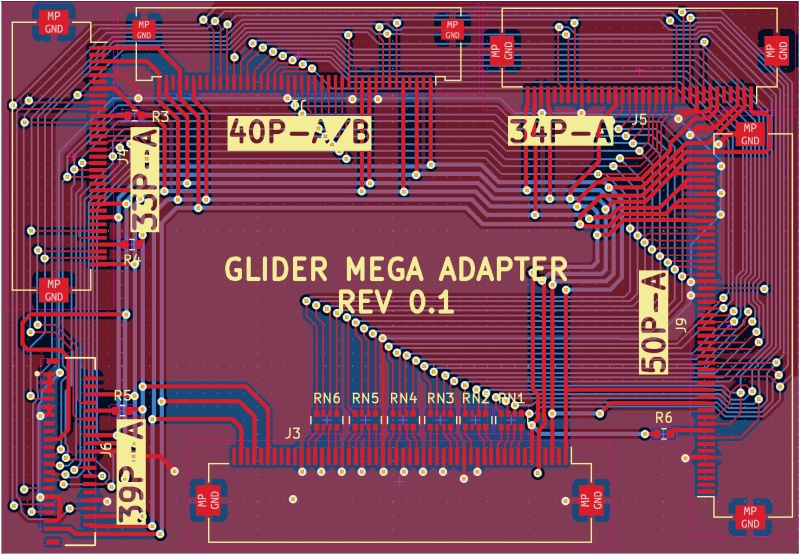

Источник изображений: Modos Дисплей Modos Paper Monitor и комплект разработчика Dev Kit доступны для краудфандинга на Crowd Supply. Разработчики предлагают комплексное решение из непосредственно панели на электронной бумаге, драйвера дисплея и контроллера с открытым исходным кодом на базе программируемой логической интегральной схемы (ПЛИС). Этот комплект предоставляет энтузиастам и разработчикам широкие возможности для экспериментов с различными дисплеями на электронной бумаге. «Я бы сказал, что вместо секретного ингредиента у нас есть открытый ингредиент, — говорит соучредитель компании Александр Сото (Alexander Soto). — Вам даже не обязательно использовать предлагаемую нами панель. Вы можете использовать другую панель и всё равно получить [75 Гц]».  Большинство панелей на основе электронной бумаги обновляются с частотой около 10 Гц или меньше. Для некоторых дисплеев частота обновления вообще не указана, и обновление может занимать до секунды. Более высокая частота обновления позволяет отображать больше кадров в секунду, что обеспечивает более плавное и реалистичное движение. Современное цифровое видео обычно воспроизводится с частотой 30 или 60 кадров в секунду, что до недавнего времени было далеко за пределами возможностей дисплеев на основе электронной бумаги. В этом отношении электронная бумага явно отстаёт от ЖК-дисплеев, частота обновления которых лишь начинается с 60 Гц и простирается вплоть до 750 Гц. Modos утверждает, что их разработка способна достигать частоты обновления до 75 Гц на 13-дюймовой панели на электронной бумаге с разрешением 1600 × 1200 пикселей. Также доступна 6-дюймовая панель на электронной бумаге с разрешением 1448 × 1072 пикселей и такой же частотой обновления. Заявленная Modos частота обновления 75 Гц — самая высокая на сегодняшний день для дисплея на электронной бумаге, хотя несколько конкурентов уже предлагают подобные дисплеи с частотой обновления до 60 Гц. Главным достижением Modos является Caster, контроллер дисплея с открытым исходным кодом, совместимый с широким спектром панелей на электронной бумаге. Он основан на ПЛИС AMD Spartan-6 и отличается от типичных контроллеров на электронной бумаге управлением дисплеем на уровне пикселей. «Традиционный контроллер […] имел всего два состояния: статическое и обновляемое, — говорит соучредитель Modos Вентинг Чжан (Wenting Zhang). — Caster обрабатывает каждый пиксель индивидуально, а не как целую панель, что обеспечивает локальное управление пикселями». Контроллер дисплея, разработанный Modos, работает в паре с адаптером Modos Glider Mega, который предлагает четыре различных разъёма, обеспечивая совместимость с несколькими десятками дисплеев на электронной бумаге размером от 4,3 до 13 дюймов. Сото утверждает, что адаптер можно использовать даже для перепрофилирования дисплеев старых электронных книг, таких как Kindle от Amazon.  Modos также предоставляет интерфейс прикладного программирования (API), написанный на языке программирования C, который позволяет приложениям динамически выбирать режимы управления дисплеем. Как показано на видео, оконный менеджер Linux можно использовать для рендеринга текста в двоичном цветовом режиме с малой задержкой, отображения карт в более подробных, но адаптивных оттенках серого и отображения видео с максимально точной градацией серого — и всё это одновременно на одном экране. Краудфандинговая кампания Modos должна завершиться 18 сентября. Ожидается, что заказы начнут поставляться в январе 2026 года. Достижение этого этапа заняло несколько лет. Изначально основатели компании надеялись создать ноутбук на электронной бумаге — Modos Paper Laptop, анонсированный в январе 2022 года. Однако реалии производства электроники осложнили реализацию проекта на ранних этапах, и ноутбук так и не стал доступен для заказа. «Отчасти это было связано с тем, что основное соотношение сторон для большинства корпусов [ноутбуков] — 16:9 и 16:10. А у дисплеев на электронной бумаге соотношение сторон было 4:3. Поэтому нам приходилось либо изготавливать корпус на заказ, либо изготавливать панель, но оба варианта были непомерно дорогими», — говорит Сото. Производство панелей электронной бумаги ориентировано на электронные книги и цифровые вывески, поэтому большинство панелей не подходят по размеру для компьютера. Однако недавно были представлены 13-дюймовые дисплеи на электронной бумаге, многие из которых имеют разрешение, аналогичное ЖК- и OLED-панелям, разработанным для ноутбуков. «Многие по умолчанию думают, что электронные книги или электронная бумага медленные и будут постоянно мигать, — говорит Сото. — Наша задача заключалась в том, чтобы посещать конференции, мероприятия и показывать людям… электронная бумага может быть очень быстрой». Код и схемы для всех разработок Modos являются открытыми и доступны на Github. Microsoft лишит сторонних разработчиков доступа к API поисковика Bing, но будут исключения

15.05.2025 [19:47],

Дмитрий Федоров

Microsoft официально объявила о закрытии доступа к Bing Search API для всех сторонних разработчиков c 11 августа 2025 года. С этого момента все существующие пользователи API поисковика Bing будут полностью отключены от сервиса, а продукт станет недоступен для использования и новых регистраций.

Источник изображения: Rubaitul Azad / Unsplash В качестве альтернативы Microsoft рекомендует разработчикам использовать механизм привязки ИИ к веб-данным Bing Search в рамках платформы Azure AI Agents. Эта технология позволяет чат-ботам обращаться к веб-данным из поисковой системы Bing и использовать их в процессе генерации ответов. Таким образом, доступ к информации через Bing становится возможным в управляемой среде Azure, ориентированной на безопасную и масштабируемую интеграцию ИИ. Хотя официально Microsoft не раскрывает список клиентов, которые сохранят доступ к API после 11 августа, известно, что исключения всё же будут. По данным издания Wired, поисковая система DuckDuckGo продолжит получать информацию из Bing. Предположительно, несколько других крупных клиентов компании, работающих по долгосрочным соглашениям, также не попадут под отключение. Однако большая часть разработчиков — особенно малые команды и независимые приложения — потеряет доступ к данным, что может сказаться на их бизнес-моделях. Отключение API следует за постепенным ростом стоимости доступа к поисковым данным Microsoft, начавшимся ещё в 2022 году. Тогда компания увеличила цену за обработку поисковых запросов в ответ на рост спроса на ИИ-сервисы, в первую очередь — ИИ-чат-боты, использующие внешние источники данных. Эксперты отмечают, что уже к 2024 году API Bing стал одним из самых дорогих среди аналогов. Таким образом, закрытие доступа — это не отдельное событие, а часть последовательной стратегии Microsoft. Анонс прекращения поддержки Bing API прозвучал за неделю до ежегодной конференции Microsoft Build 2025. Ожидается, что ключевыми темами мероприятия станут генеративный ИИ и облачные платформы. Представители Microsoft подчёркивают, что переход от открытых API к защищённой облачной модели обеспечит надёжность, масштабируемость и контроль над пользовательскими сценариями. Однако разработчики опасаются централизации и потери гибкости в использовании поисковых решений. Mistral AI представила инструмент, который превратит любой PDF-документ в текстовый файл для ИИ

07.03.2025 [11:20],

Владимир Фетисов

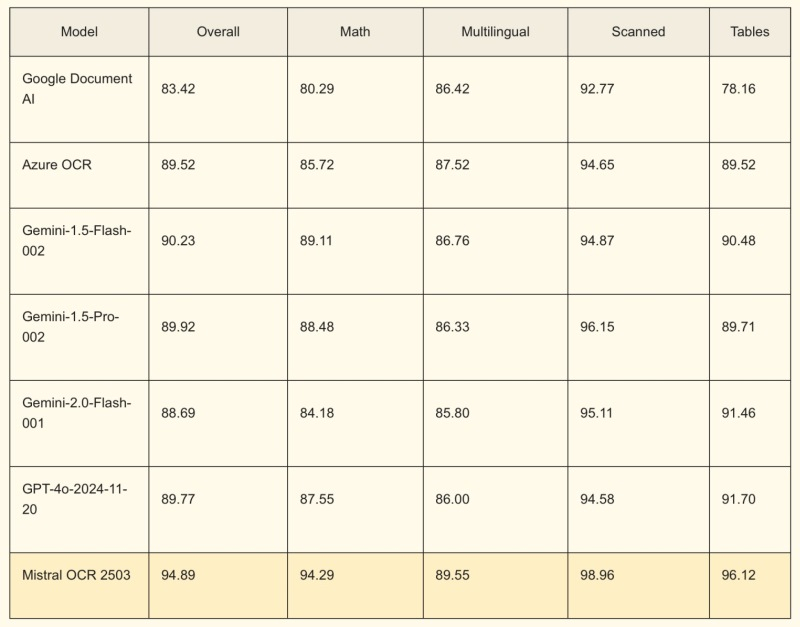

Французский разработчик больших языковых моделей (LLM) Mistral AI объявил о выпуске нового API, который предназначен для обработки сложных PDF-документов. Mistral OCR — это API оптического распознавания символов (OCR), с помощью которого любой PDF-документ можно превратить в текстовый файл, чтобы облегчить его обработку алгоритмами на основе искусственного интеллекта.

Источник изображения: Scott Graham / Unsplash Языковые модели, лежащие в основе популярных генеративных алгоритмов, таких как ChatGPT от OpenAI, особенно хорошо работают с необработанным текстом. Поэтому компании, которые намерены вводить собственные рабочие ИИ-процессы, знают о важности хранения и индексации данных в чистом формате, чтобы эту информацию можно было повторно использовать в процессе обработки ИИ-алгоритмами. В отличие от многих API OCR, разработка Mistral представляет собой мультимодальный API, который способен распознавать не только текст, но также иллюстрации и фотографии, размещённые между текстовыми блоками. API OCR формирует ограничительные рамки вокруг обнаруженных графических элементов и включает их в вывод. В результате обработки PDF-документа с помощью Mistral OCR формируется отформатированный в Markdown текст, который ИИ-алгоритмы обрабатывают более эффективно.

Источник изображения: Mistral «С годами в организациях накапливается множество документов, часто в формате PDF или в виде слайдов, которые недоступны для обработки LLM, особенно для систем RAG [Retrieval-Augmented Generation — техника получения и использования данных в качестве контекста для генеративных ИИ-алгоритмов]. Благодаря Mistral OCR наши клиенты могут преобразовывать сложные документы в читаемый контент на всех языках. Это важнейший шаг на пути к широкому внедрению ассистентов с искусственным интеллектом в компаниях, которым необходимо упростить доступ к обширной внутренней документации», — считает соучредитель и научный руководитель Mistral Гийом Лэмпл (Guillaume Lample). Mistral OCR доступен на собственной платформе компании, а также в инфраструктуре облачных партнёров Mistral, таких как AWS, Azure и др. Для компаний, которые работают с конфиденциальными или секретными данными, Mistral предлагает версию API для локального развёртывания. В компании заявили, что Mistral OCR работает лучше, чем аналогичные API от Google, Microsoft или OpenAI. Компания протестировала свой API на сложных PDF-документах, в том числе содержащих математические выражения, сложные макеты и таблицы. В приложениях для iPhone появятся новые способы оплаты, но на цены это вряд ли повлияет

24.01.2025 [19:20],

Владимир Фетисов

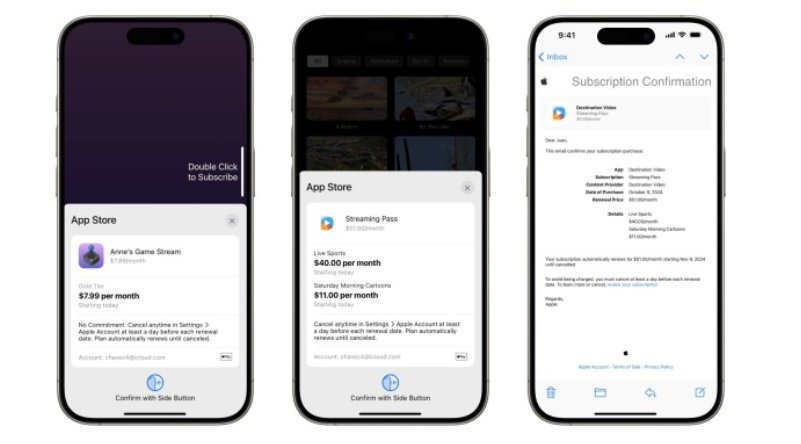

Компания Apple анонсировала Advanced Commerce API, который обеспечит поддержку большего количества форматов покупок в приложениях, включая покупку дополнительного контента в рамках подписки. При этом комиссионные сборы меняться не будут.

Источник изображений: Apple «App Store ежегодно проводит миллиарды транзакций, помогая разработчикам развивать свой бизнес и обеспечивать качественное обслуживание клиентов. Для дальнейшей поддержки развивающихся бизнес-моделей разработчиков, таких как исключительно большие каталоги контента, опции для авторов контента и подписки с дополнительным опциями, мы представляем Advanced Commerce API», — говорится в сообщении Apple. В описании нового API упоминаются три основных варианта его использования. Прежде всего, он предназначен для приложений с крупными каталогами разовых покупок и частыми обновлениями, таких как сервисы аудиокниг или онлайн-курсов. Второй вариант использования API — в приложениях с авторским контентом, доступ к которому предоставляется в рамках разовой или возобновляемой подписки. Третий вариант использования — для осуществления покупок в рамках уже действующей подписки, например, для получения доступа к новым каналам, региональному контенту и др.  После того, как в прошлом году Евросоюз вынудил Apple разрешить альтернативные платёжные системы и магазины приложений внутри своей экосистемы, компания пытается сформировать выгодные для разработчиков условия, чтобы удержать их от использования сторонних альтернатив. К примеру, компания разрешила эмуляторы ретро-игр, а также организовала систему скидок для пользователей с истёкшим сроком подписки. Tesla установила грабительские расценки для разработчиков сторонних приложений

29.11.2024 [14:16],

Алексей Разин

Больше года назад компания Tesla начала распространять среди сторонних разработчиков мобильных приложений документацию по работе с фирменным программным интерфейсом (API), но расценки на доступ к этой экосистеме стали доступны лишь недавно. Некоторые разработчики подсчитали, что им придётся отдавать по $60 млн в год компании Tesla и в итоге похоронить бизнес.

Источник изображения: Tesla Компания Tesla не только располагает многомиллионным парком электромобилей, с которых собирает различную информацию, но и весьма развитой в отдельных регионах планеты сетью зарядных станций. Монетизировать сопутствующие данные можно, предоставляя к ним доступ разработчикам различных сервисных и информационных приложений. Эксплуатирующие парк электромобилей Tesla компании также могут создавать собственные программные инструменты для контроля за расходами и управления корпоративным автопарком. За доступ к фирменному программному интерфейсу разработчикам сторонних приложений придётся платить. На первый взгляд, профильный раздел сайта Tesla содержит довольно безобидные расценки. За получение 150 000 потоковых сигналов придётся отдать $1, в ту же сумму обойдётся отправка 1000 команд на бортовую электронику электромобиля, аналогично стоят и 500 запросов данных, либо 50 команд на пробуждение. Как сообщает Electrek со ссылкой на разработчиков приложения Tessie, которые могут похвастать аудиторией из примерно 400 000 владельцев электромобилей Tesla, эти внешне безобидные расценки на работу с API в случае с конкретным ПО будут выливаться в ежегодные платежи в адрес Tesla в размере $60 млн. Разработчики Tessie видят альтернативу в подключении к электромобилям своих клиентов напрямую по IP-адресу либо через Bluetooth в момент нахождения смартфона в электромобиле или поблизости. Разработчики Teslascope также считают предложенные расценки на доступ к API неразумными, поскольку в случае с их приложением выплаты компании Tesla в 7,5 раз превысят ежемесячную выручку. И это не самые плохие варианты калькуляции, но и они могут поставить под сомнение саму целесообразность ведения бизнеса на предложенных условиях. Для сравнения, Apple за доступ к своему API берёт с индивидуальных разработчиков плату в размере $99 в год, а потом взимает комиссию в размере около 30 % за ряд транзакций внутри приложения. Корпоративные клиенты, которым нужны приложения в экосистеме Apple для внутреннего использования, в этом случае платят $299. Google в этом отношении более демократична: единовременный взнос для разработчика составляет $25, но комиссии за транзакции могут достигать всё тех же 30 %. В любом случае, многообразие приложений под платформы Apple iOS и Google Android позволяет предположить, что разработчиков условия сотрудничества с обеими компаниями чаще всего устраивают. Tesla же пытается нащупать какую-то свою бизнес-модель в этой сфере, и пока эти попытки не выглядят удачными. В iOS-приложениях скоро появится встроенный перевод через Apple Translate

22.06.2024 [13:09],

Павел Котов

С выходом watchOS 11 на умных часах Apple появится приложение «Перевод». Новые функции также появятся в версиях приложения для iPhone и iPad, которые существуют уже давно. В частности, Apple сделала общедоступным новый API, который позволит разработчикам интегрировать средства перевода в свои приложения.  Apple представила API для перевода на мероприятии WWDC 2024 — он избавит разработчиков от необходимости использовать сторонние платформы для реализации этих функций в своих приложениях. Сторонним приложениям, таким образом, открывается доступ к тем же моделям машинного обучения, что используются в собственном приложении Apple «Перевод», а функция перевода работает в автономном режиме. Новый API доступен для устройств под управлением iOS 17.4 и более поздних версий, а в SDK iOS 18 появятся и некоторые эксклюзивные функции. В частности, новая версия системы получит возможность переводить строки поодиночке или пакетами, а также выводить результаты перевода в любом пользовательском интерфейсе. Пока Apple iOS 18 доступна в виде предварительной бета-версии для разработчиков. Выпуск общедоступной бета-версии запланирован на июль, а финальная появится осенью. Meta✴ анонсировала запуск API для соцсети Threads — для «уникальных интеграций»

18.06.2024 [16:57],

Павел Котов

Meta✴✴ сообщила о создании API для платформы микроблогов Threads, официальный запуск которого запланирован на конец июня. Инструменты API с бесплатным доступом помогут разработчикам создавать «уникальные интеграции» с Threads — возможно, даже альтернативные клиентские приложения.

Источник изображения: Julio Lopez / unsplash.com «Теперь люди могут публиковать через API сообщения, выводить собственный контент и применять наши функции работы с комментариями для настройки элементов управления ответами и цитатами, выводить ответы на свои сообщения, скрывать, открывать или комментировать определённые ответы», — рассказал технический директор Threads Джесси Чэнь (Jesse Chen). Анализ публикаций в Threads — «одна из наших самых востребованных функций API», уточнил Чэнь, поэтому Meta✴✴ открыла разработчикам доступ к числу просмотров, лайков, ответов, репостов и цитат сообщений. Компания опубликовала подробную документацию по работе с API Threads и выложила пример приложения с открытым исходным кодом. Пока инструменты тестируются с небольшим числом партнёров компании: портал Techmeme автоматизировал публикацию контента в Threads, а платформы Sprout и Hootsuite интегрировали поддержку Threads наравне с другими соцсетями. Ранее Threads получила интеграцию с распределёнными соцсетями семейства Fediverse, включая Mastodon, но её возможности ограничены: пользователи Threads могут открывать свои публикации через клиенты Mastodon и публиковать контент на серверах Mastodon, но пока не имеют доступа к просмотру комментариев и подписок пользователей Fediverse. |

|

✴ Входит в перечень общественных объединений и религиозных организаций, в отношении которых судом принято вступившее в законную силу решение о ликвидации или запрете деятельности по основаниям, предусмотренным Федеральным законом от 25.07.2002 № 114-ФЗ «О противодействии экстремистской деятельности»; |