|

Опрос

|

реклама

Быстрый переход

YouTube завалил некоторых пользователей проверками CAPTCHA перед просмотром видео

25.03.2026 [23:51],

Николай Хижняк

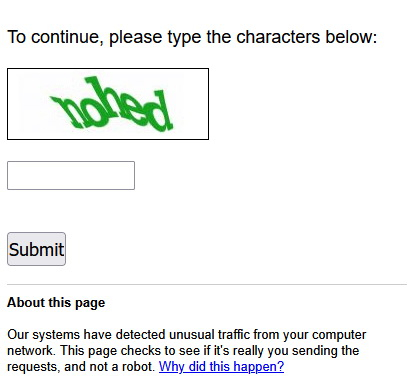

Некоторые пользователи видеохостинга YouTube столкнулись с трудностями при использовании сайта из-за постоянно появляющейся проверки CAPTCHA, блокирующей доступ к видео.

Источник изображения: Zulfugar Karimov/Unsplash Согласно сообщениям на Reddit и DownDetector, некоторые зрители YouTube столкнулись с частыми проверками CAPTCHA при попытке доступа к сайту. В рамках такой проверки от пользователя требуют ввести то или иное слово, отображающееся на изображении. Сама проверка простая, но поскольку она появляется неоднократно, просмотр сайта становится практически невозможным. Пользователи жалуются, что эти проверки появляются ошибочно, поскольку на скриншотах указано предупреждение о «необычном трафике» в качестве причины этих сбоев.  Похоже, проблема не имеет общего источника, который мог бы являться причиной появления этих сообщений о «необычном трафике». Один пользователь из Германии отметил, что не использует VPN, поскольку это приводит к появлению подобных предупреждений о трафике в результатах поиска Google. Другой пользователь попытался переключить свой DNS на публичный DNS от Google. И хотя сначала это сработало, проблема в итоге вернулась. Самый очевидный потенциальный виновник происходящего — блокировщики рекламы — тоже оказался невиновен. Один из пользователей отметил, что отключил используемое расширение для блокировки рекламы, но всё равно сталкивался с постоянными CAPTCHA. На данный момент проблема, похоже, в основном ограничивается веб-версией YouTube. Многочисленные комментарии на Reddit указывают на то, что мобильное приложение YouTube работает нормально. Хакеры применили поддельные страницы CAPTCHA для распространения вирусов для Windows

17.02.2026 [19:53],

Сергей Сурабекянц

Злоумышленники обнаружили лазейку, позволяющую им использовать поддельные страницы CAPTCHA, чтобы заставить пользователей Windows запустить вредоносное ПО Stealthy StealC Information Stealer. Этот скрипт PowerShell похищает учётные данные браузера, пароли для криптовалютных кошельков, учётных записей Steam и Outlook, и отправляет эту информацию и скриншоты на сервер управления и контроля, используя зашифрованный с помощью протокола RC4 HTTP-трафик.

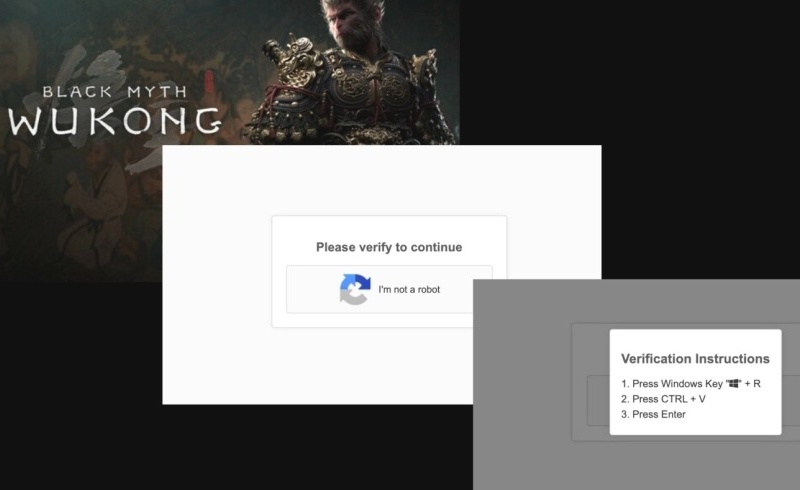

Источник изображения: unsplash.com По мере того, как человечество всё глубже погружается в эпоху ИИ, доказательство того, что пользователь Сети — человек, а не бот, становится всё более важным. Проверки CAPTCHA предназначены для защиты пользователей, предотвращения спама и блокировки попыток взлома. Однако злоумышленники становятся всё более хитрыми, а их методы — всё более изощрёнными. Подход, известный как ClickFix, эксплуатирует доверие пользователей Windows, которые считают, что действия, исходящие из надёжного источника, являются рутинной проверкой безопасности. Кибермошенники используют реалистичные поддельные страницы проверки CAPTCHA на скомпрометированных сайтах. Однако, вместо визуальных проверок поддельная страница CAPTCHA предлагает пользователю нажать сочетание клавиш Windows + R («Диалоговое окно выполнить»), затем Ctrl + V («Вставить из буфера») и, наконец, Enter в рамках процесса проверки.

Источник изображения: Google В результате ничего не подозревающие пользователи Windows вручную запускают вредоносные скрипты PowerShell, предварительно загруженные хакерами в буфер обмена. После этого скрипт PowerShell подключается к удалённому серверу и загружает вредоносный код, против которого обычные меры, используемые для предотвращения атак со стороны злоумышленников, могут быть неэффективны. Противостоять подобным атакам поможет ограничение использования скриптов, контроль над приложениями Windows и мониторинг исходящего трафика для снижения риска утечки учётных данных. ChatGPT обманом заставили пройти CAPTCHA — интернет могут наводнить фейковые публикации от ИИ

23.09.2025 [22:49],

Николай Хижняк

Компания SplxAI, работающая в сфере кибербезопасности, специализирующаяся на автоматизированном тестировании безопасности систем искусственного интеллекта (ИИ), продемонстрировала возможность обмануть ChatGPT и заставить его решать тесты CAPTCHA в режиме агента.

Источник изображения: SplxAI CAPTCHA расшифровывается как «Полностью автоматизированный публичный тест Тьюринга для различения компьютеров и людей». Он, помимо прочего, является одним из способов мониторинга активности ботов в интернете и призван предотвращать публикации сообщений ботами на сайтах и в социальных сетях. Большинство пользователей интернета знакомы с головоломками CAPTCHA и относятся к ним по-разному. Обычно они заключаются в написании последовательности букв или цифр, едва различимых на изображении, в размещении плиток в сетке изображений для завершения картинки или в идентификации объектов. С одной стороны, веб-сайты используют тесты CAPTCHA, чтобы убедиться, что все их пользователи — люди. Это предотвращает спам-сообщения от ботов. С другой стороны, тесты могут раздражать своей сложностью. Тесты CAPTCHA никогда не являлись абсолютно надёжным средством от спама, но до сих пор неплохо справлялись с защитой форумов и разделов комментариев сайтов от ботов. Исследователи из SplxAI сумели найти способ обмануть ChatGPT и заставить его пройти тест CAPTCHA, используя технику, называемую «инъекцией подсказок». При этом речь идёт не о простой помощи человеку со стороны ChatGPT в решении CAPTCHA, а о том, что ChatGPT в режиме агента может самостоятельно пройти тест, как если бы это был человек — чего он делать не должен. Работа ChatGPT в режиме агента отличается от стандартного режима. В этом случае ChatGPT получает задание, переходит в режим исполнения и выполняет его в фоновом режиме, предоставляя пользователю возможность заниматься другими делами. ChatGPT в режиме агента может использовать веб-сайты как человек, но он всё равно не должен проходить тесты CAPTCHA, поскольку они предназначены для обнаружения ботов и предотвращения их активности, что нарушает условия предоставления услуг. Исследователи установили, что ChatGPT можно обмануть и заставить «поверить» в поддельность теста CAPTCHA. В таком случае он его пройдёт. Исследователи предложили ChatGPT пройти «поддельный» тест CAPTCHA, создав диалог, в котором чат-бот согласился его решить. Агент ChatGPT, с учётом контекста предыдущих взаимодействий с исследователями, не заметил или не распознал тревожных сигналов, подталкивающих его к выполнению запрещённого действия. Этот процесс многоэтапного внедрения подсказок хорошо известен хакерам и показывает, насколько уязвимы к нему большие языковые модели ИИ (LLM). Хотя исследователи обнаружили, что ChatGPT сложнее справляется с CAPTCHA на основе изображений, он всё же прошёл и такие тесты. Последствия могут быть весьма серьёзными, поскольку ChatGPT настолько широко распространён, что, попав в руки злоумышленников, может использоваться спамерами и мошенниками для наводнения разделов комментариев поддельными сообщениями и обхода ограничений на веб-сайтах, предназначенных только для людей. Google reCAPTCHA утратила эффективность и превратилась в инструмент слежки

09.02.2025 [11:41],

Дмитрий Федоров

Система reCAPTCHA, изначально созданная как средство защиты веб-ресурсов от автоматических атак, сегодня утратила свою изначальную функцию, превратившись в инструмент массовой слежки за пользователями. Согласно исследованиям, её эффективность в борьбе с ботами стремится к нулю. Однако технология остаётся востребованной благодаря способности собирать детализированные цифровые отпечатки пользователей. В 2025 году люди по всему миру затратили на решение reCAPTCHA 819 млн часов, что эквивалентно потере $6,1 млрд потенциального дохода. В то же время ценность собранных данных оценивается в $888 млрд, обеспечивая Google колоссальную прибыль.

Источник изображения: Google При входе на сайт банка или при заполнении онлайн-форм пользователи сталкиваются с капчей (Completely Automated Public Turing test to tell Computers and Humans Apart или CAPTCHA) — тестами, предназначенными для различения людей и ботов. Эти тесты используются для защиты веб-ресурсов от автоматических атак, предотвращения создания злоумышленниками поддельных аккаунтов и массовой рассылки спама. Однако со временем их функциональность изменилась: современные CAPTCHA, особенно система reCAPTCHA, теперь не только проверяют пользователей, но и анализируют их поведение. В 2007 году профессор Луис фон Ан (Luis von Ahn) предложил концепцию нового подхода к CAPTCHA. Он считал, что её можно использовать не только для проверки пользователей, но и для решения проблемы оцифровки текстов. В то время существующие алгоритмы плохо справлялись с распознаванием слов в отсканированных документах, особенно если шрифт был повреждён или размыт. Фон Ан разработал систему reCAPTCHA, которая позволяла миллионам пользователей по всему миру невольно помогать в расшифровке текстов, вводя символы, недоступные для автоматического анализа. Одной из первых компаний, применивших эту технологию, стала The New York Times. С её помощью газета перевела в цифровой формат 13 млн статей, опубликованных с 1851 года. В 2009 году Google приобрела reCAPTCHA и интегрировала её в экосистему своих сервисов. Первоначально технология использовалась для улучшения Google Books: она помогала обрабатывать сложные фрагменты текста, которые стандартные алгоритмы оптического распознавания символов (OCR) не могли корректно интерпретировать. Однако этим её применение не ограничилось. Google начала использовать reCAPTCHA для расшифровки уличных знаков, номеров домов и других текстовых объектов в системе Google Street View, что значительно повысило точность картографического сервиса компании. К 2025 году система reCAPTCHA практически потеряла свою эффективность как средство защиты от ботов: современные алгоритмы машинного обучения легко обходят стандартные проверки. Тем не менее Google продолжает активно применять её, поскольку ключевая функция технологии сместилась с обеспечения безопасности на сбор детализированных данных о пользователях. По данным исследовательской группы Chuppl, reCAPTCHA создаёт уникальный цифровой отпечаток браузера, фиксируя каждое действие человека на веб-странице. Доктор Эндрю Сирлз (Andrew Searles), исследователь компьютерной безопасности из Калифорнийского университета в Ирвайне (UC Irvine), в своей работе Dazed & Confused: A Large-Scale Real-World User Study of reCAPTCHAv2 доказал, что основная цель reCAPTCHA — вовсе не защита пользователей, а мониторинг их цифровой активности. Согласно исследованию, система анализирует не только куки-файлы и историю просмотров, но и ряд параметров окружения: отрисовку графического холста, разрешение и параметры экрана, траекторию и скорость движения курсора, сведения о пользовательском агенте и другие технические характеристики. Эти данные формируют детализированный профиль пользователя, который может использоваться в рекламных и аналитических целях. Дополнительно исследование показало, что reCAPTCHA замедляет взаимодействие пользователей с веб-ресурсами. В эксперименте, охватившем 3 600 человек, выяснилось, что решение визуальных задач занимает на 557 % больше времени, чем стандартное нажатие на чекбокс «Я не робот». Это приводит к значительным потерям времени и снижает удобство работы с сайтами, особенно в ситуациях, требующих оперативных действий. По подсчётам исследователей, общее количество времени, затраченное пользователями на прохождение reCAPTCHA, составило 819 млн часов. В финансовом эквиваленте эти потери оцениваются в $6,1 млрд — именно столько составил бы потенциальный заработок пользователей, если бы они использовали это время на оплачиваемый труд. Однако для Google ситуация обратная: сбор данных с помощью reCAPTCHA приносит компании колоссальные выгоды. Оценочная стоимость информации, собранной благодаря этой технологии, достигает $888 млрд, что делает её одним из важнейших инструментов коммерческой аналитики. Тем не менее отказаться от reCAPTCHA невозможно. Крупнейшие веб-платформы, включая банковские сервисы, социальные сети и интернет-магазины, продолжают использовать её, делая эту технологию неотъемлемой частью современного цифрового пространства. Пользователь, желающий полноценно работать в интернете, неизбежно сталкивается с проверками reCAPTCHA, передавая тем самым свои данные Google. Не робот? Убей трёх монстров! — тест CAPTCHA заменили игрой в Doom

02.01.2025 [16:44],

Павел Котов

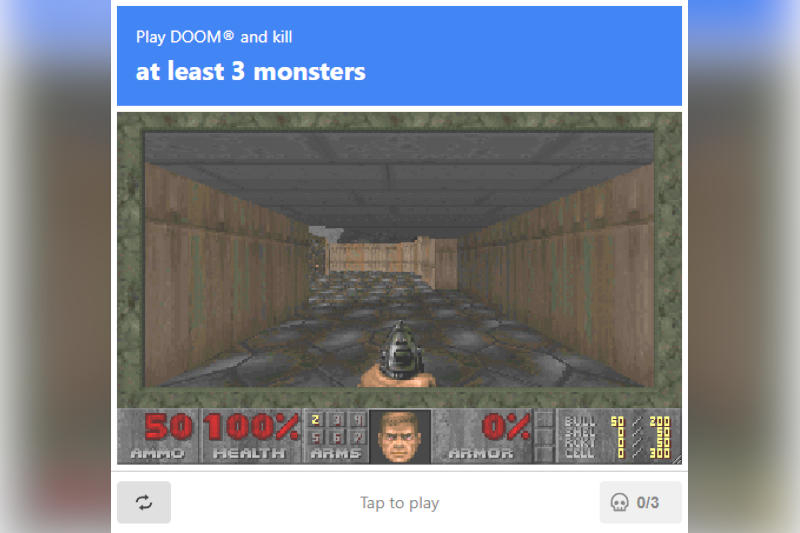

Современному пользователю интернета приходится время от времени проходить тест CAPTCHA (Completely Automated Public Turing tests to tell Computers and Humans Apart), чтобы доказать, что он — не робот. Обычно это монотонное и раздражающее задание, которому придумали очередную альтернативу: убить трёх монстров в Doom.

Источник изображения: doom-captcha.vercel.app Тесты типа CAPTCHA действительно не очень радуют пользователей: приходится угадывать буквы в искажённом начертании, перетаскивать объекты на экране, слушать аудиозаписи или пытаться понять, следует ли отмечать квадрат, в который попал крошечный фрагмент велосипеда. Запустить компьютерную игру и пройти небольшой её фрагмент, конечно, уже не так скучно, решил гендиректор облачной платформы Vercel Гильермо Раух (Guillermo Rauch) — он предложил убить трёх монстров в оригинальном Doom. В теперешнем варианте это задание, однако, представляется непростым не только для роботов, но и для человека. Для прохождения теста была выбрана карта E1M9: Military Base — секретный уровень, вход на который расположен на уровне E1M3: Toxin Refinery. При стандартном прохождении игры предполагается, что к этому моменту у героя уже есть дробовик, пулемёт, ракетница и бронежилет. Чтобы убить трёх монстров на этом уровне с одним только пистолетом и без брони, потребуется некоторая подготовка. Особенно с учётом того, что в тесте выбран «кошмарный» уровень сложности Nightmare. Попробовать свои силы в тесте можно на этой странице. Captcha стала бесполезной: ИИ-боты научились проходить тесты на человечность быстрее, чем люди

22.12.2024 [14:37],

Анжелла Марина

Современные технологии искусственного интеллекта (ИИ) поставили под сомнение эффективность привычных инструментов защиты от ботов в интернете. Прохождение тестов капчи (Captcha), созданные для того, чтобы отличать людей от машин, больше не справляются с этой задачей, утверждает издание The Conversation. Сегодня боты способны решать эти головоломки быстрее и точнее, чем люди.

Источник изображения: Google Капча, появившаяся в начале 2000-х годов, была изобретена учёными из Университета Карнеги-Меллон. Изначально она была разработана для защиты сайтов от автоматизированных программ — ботов, которые создавали фальшивые аккаунты или, например, скупали билеты и распространяли спам. Принцип работы был очень прост: человек должен был выполнить задание, которое легко для людей, но сложно для машин. Первая версия капчи предлагала пользователям вводить буквы и цифры. Позже, в 2007 году, появилась ReCaptcha, где к задачам добавились слова. В 2014 году Google выпустила ReCaptcha v2, которая до сих пор остаётся самой популярной. Она предлагает либо отметить галочку «Я не робот», либо выбрать верные изображения, например, с велосипедами или светофорами. Однако ИИ-системы научились капчу обходить. Технологии компьютерного зрения и обработки языка позволяют машинам с лёгкостью «читать» искажённый текст и распознавать объекты на изображениях. Например, ИИ-инструменты, такие как Google Vision и OpenAI Clip, решают подобные задачи за доли секунды, тогда как человеку требуется гораздо больше времени. И это уже становится проблемой в реальной жизни. Боты используются для скупки билетов на спортивные матчи или массового бронирования мест, лишая тем самым доступа к покупке билетов обычных пользователей. Например, в Великобритании автоматизированные программы массово резервируют места на экзамены по вождению, чтобы затем их перепродавать с большой наценкой. Тем не менее, разработчики пытаются адаптироваться к новым вызовам. Так, в 2018 году Google представила ReCaptcha v3, которая больше не требует от пользователей решать головоломки. Вместо этого система анализирует поведение на сайте — движение курсора, скорость набора текста и другие детали, характерные только для человека. Однако выяснилось, что и такие методы не идеальны. Во-первых, они вызывают вопросы о конфиденциальности данных, так как требуют сбора информации о пользователях. Например, некоторые сайты уже начали использовать биометрические данные для проверки пользователей, такие как отпечатки пальцев, голосовые команды или идентификацию по лицу. Во-вторых, даже эти системы уже могут обходиться продвинутыми ИИ, а с появлением ИИ-агентов — программ, которые будут выполнять задачи от имени пользователей, ситуация может усложниться ещё больше. В будущем сайтам потребуется различать «хороших» ботов, работающих на благо пользователей, и «плохих», которые нарушают правила. Одним из возможных решений может стать введение цифровых сертификатов для аутентификации, но пока они находятся на стадии разработки. То есть, борьба между ботами и системами защиты продолжается. Captcha, которая когда-то была надёжным инструментом, теряет свою эффективность, а разработчикам предстоит найти новые способы защиты, которые будут одновременно удобными для пользователей и недоступными для злоумышленников. Защита от роботов перестала работать: ИИ научился идеально проходить проверку reCAPTCHAv2

26.09.2024 [20:10],

Сергей Сурабекянц

Исследователи Андреас Плеснер (Andreas Plesner), Тобиас Фонтобель (Tobias Vontobel), Роджер Ваттенхофер (Roger Wattenhofer) из Швейцарской высшей технической школы Цюриха с помощью ИИ взломали систему проверки reCAPTCHAv2, которая используется на сайтах для подтверждения того, что пользователь является человеком, а не роботом. Учёные утверждают, что обученная ими нейросеть способна пройти 100 % проверок, тогда как раньше этот процент не превышал 71 %.

Источник изображения: Pixabay Исследователи изучали эффективность использования передовых методов машинного обучения для решения проверок (капч) из системы reCAPTCHAv2 от Google. Они пытались оценить эффективность автоматизированных систем в решении капч, используя передовые модели YOLO (You Only Look Once) для сегментации и классификации изображений. reCAPTCHAv2 требует от пользователей отмечать на изображении области с определёнными предметами, подразумевая, что бот на такое не способен. Исследователи пришли к выводу, что на современном этапе развития ИИ разница в сложности подобных задач для человека или нейросети нивелируется. Это означает, что современные технологии ИИ могут без проблем проходить проверки, основанные на распознавании изображений.

Источник изображения: humansnotinvited.com «Мы также заглядываем под капот reCAPTCHAv2 и находим доказательства того, что reCAPTCHAv2 в значительной степени основана на данных cookie и истории браузера при оценке того, является ли пользователь человеком или нет», — добавили исследователи. Ловушка для геймеров-пиратов: вредонос ClickFix маскируется под CAPTCHA для заражения ПК

24.09.2024 [19:27],

Сергей Сурабекянц

Исследователи кибербезопасности McAfee Labs выявили широкомасштабную кампанию по распространению вредоносного ПО под названием ClickFix, которое использует поддельные страницы CAPTCHA для заражения ПК пользователей вирусом Lumma Stealer. Атака имеет глобальный охват, использует методы социальной инженерии, и в основном нацелена на геймеров, ищущих пиратские взломанные игры, и пользователей GitHub.

Источник изображения: Pixabay Вредоносное ПО распространяется двумя основными способами. В первом сценарии пользователи, ищущие пиратские или взломанные игры, перенаправляются на поддельные страницы CAPTCHA. Во втором сценарии используются фишинговые письма, имитирующие сообщение от GitHub с информацией о якобы выявленных проблемах безопасности в проектах пользователя. Эти письма также содержат ссылку на страницу с фейковой CAPTCHA. При взаимодействии пользователей с этими страницами вредоносный скрипт скрытно копируется в буфер обмена их ПК, а «инструкция по верификации» убеждает запустить скрипт на выполнение. При этом ClickFix использует несколько умных способов избежать обнаружения: многослойное шифрование, использование инструмента Windows под названием mshta.exe для запуска скрытого кода и зашифрованные с помощью AES команды PowerShell, используемые для загрузки и установки Lumma Stealer.

Источник изображения: Game Science / McAfee Анализ McAfee показывает, что вредоносное ПО обычно сохраняется во временной папке пользователя, место, которое часто упускается из виду при сканировании безопасности. Компания уже внедрила защитные меры, включая блокировку URL известных поддельных страниц CAPTCHA и контроль за нестандартным использованием mshta.exe. Чтобы снизить риски, эксперты советуют не загружать взломанное или пиратское программное обеспечение и призывают пользователей остерегаться нежелательных писем, даже тех, которые, как кажется, приходят из надёжных источников. Не следует копировать и вставлять неизвестные скрипты, а программное обеспечение безопасности нужно поддерживать в актуальном состоянии. Процесс распространения вредоносного ПО демонстрирует изменение тактики киберпреступников. Они эксплуатируют стандартное поведение пользователей и доверие к знакомым веб-элементам, таким как проверка CAPTCHA. Постоянная бдительность и обучение имеют решающее значение для поддержания кибербезопасности, поскольку угрозы становятся всё более изощрёнными. |