|

Опрос

|

реклама

Быстрый переход

Голосовой ИИ-помощник Gemini Live поможет в прохождении игр на Android

23.09.2025 [20:59],

Анжелла Марина

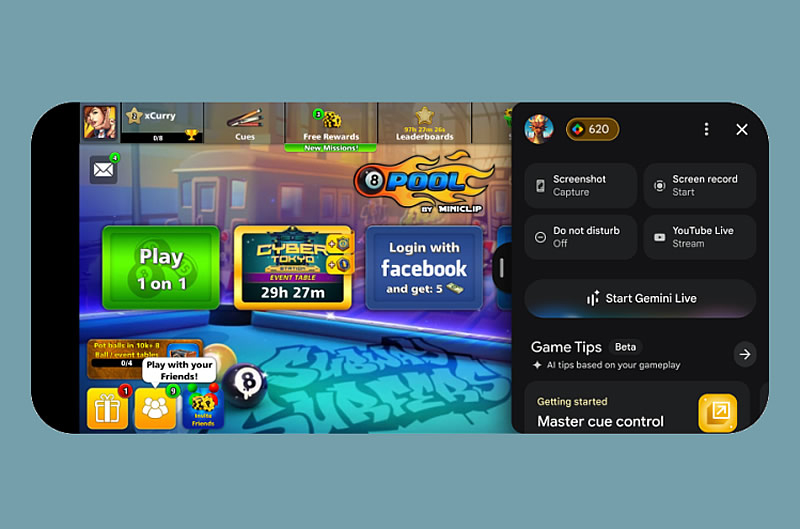

Компания Google объявила, что в скором времени голосовой ИИ-помощник Gemini Live, встроенный в приложение Gemini, сможет взаимодействовать с мобильными играми из Google Play. Нейросеть сможет анализировать игровой процесс на экране и давать пользователям подсказки для прохождения сложных моментов.

Источник изображения: Google По сообщению The Verge, функция будет доступна в отдельных играх. По своему принципу она напоминает инструмент Gaming Copilot, который Microsoft ранее внедрила в мобильное приложение Xbox и на ПК под управлением Windows 11. Помимо помощи от Gemini, новый внутриигровой оверлей будет отображать информацию о наградах, специальных предложениях и достижениях пользователя. Одновременно Google расширяет доступность своей платформы «Google Play Игры» для персональных компьютеров — спустя три года после запуска бета-версии. На данный момент более 200 000 игр из Google Play поддерживают кроссплатформенную игру между мобильными устройствами и ПК. Также в магазине Google Play появятся обновлённые страницы игр с расширенной информацией о прогрессе пользователя, списке достижений и новостях от разработчиков. В отдельных регионах появится возможность задавать вопросы о конкретной игре прямо на её странице в магазине, при этом другие игроки смогут на них отвечать. ИИ-помощник Google Gemini Live научился видеть мир через камеру смартфона — точно и без задержек

21.08.2025 [11:27],

Владимир Фетисов

Компания Google анонсировала несколько новых функций для виртуального ассистента Gemini Live, с которым пользователи могут взаимодействовать посредством голосовых команд. В ближайшее время Gemini Live сможет точнее распознавать и выделять объекты, которые пользователь «показывает» ему с помощью камеры своего смартфона.

Источник изображения: Google Это нововведение будет полезным в разных ситуациях. Например, когда пользователь не уверен, какой инструмент лучше подходит для выполнения определённой задачи, он может спросить об этом Gemini Live и задействовать камеру, чтобы ИИ-помощник помог с выбором оптимального варианта. Данная функция будет доступна на анонсированных на этой неделе смартфонах Google Pixel 10. В конце месяца визуальные подсказки станут доступны пользователям других устройств на базе Android, а в течение нескольких недель — в приложении ассистента для iOS. Вместе с этим разработчики расширили возможности Gemini Live в плане взаимодействия с другими приложениями, включая «Телефон», «Сообщения» и «Часы». Например, если пользователь обсуждает с Gemini Live маршрут до определённого пункта, но понимает, что не успеет вовремя туда добраться. В этом случае пользователь может сказать ИИ-помощнику, что предложенный маршрут его устраивает, но нужно составить и отправить одному из контактов сообщение о том, что он задержится на несколько минут. После этого Gemini Live самостоятельно сгенерирует и отправит указанному контакту сообщение, тем самым предупредив его об опоздании заранее. Google также анонсировала запуск обновлённой аудиомодели для Gemini Live. За счёт этого алгоритм будет лучше распознавать интонацию человека, ритм и высоту голоса. В скором времени ИИ-ассистент научится менять интонацию в зависимости от того, о чём идёт речь. В дополнение к этому пользователь сможет ускорять и замедлять Gemini Live в зависимости от того, как ему удобнее воспринимать ответы ИИ-помощника. Если же пользователь попросит Gemini Live драматично пересказать какую-то историю от имени конкретного персонажа или исторической фигуры, алгоритм сумеет выдать «насыщенное и увлекательное повествование». ИИ-функция Circle to Search получила AI Mode и теперь может помочь в прохождении игр

09.07.2025 [18:49],

Николай Хижняк

Google расширила функциональность ИИ-инструментов Circle to Search («Обвести и найти») и Gemini Live для Android. Обновление было анонсировано сегодня, одновременно с запуском складных устройств Samsung Galaxy нового поколения. Оно включает новые возможности Gemini Live для устройств Samsung и интеграцию чат-бота Google AI Mode, ориентированного на поиск, непосредственно в Circle to Search.

Источник изображений: Google Режим AI Mode дебютировал в Google Поиске в начале этого года, позволяя пользователям находить информацию и веб-ссылки с помощью чат-бота в стиле Gemini вместо традиционного интерфейса поисковой системы. Пока он недоступен для широкого круга пользователей — за пределами США его запустили только в Индии, — однако теперь, по заявлению Google, получить доступ к AI Mode можно с помощью инструмента Circle to Search на смартфонах Pixel и Samsung. Это позволяет находить информацию прямо на экране, не переключаясь между приложениями. «Просто нажмите и удерживайте кнопку “Домой” или панель навигации, затем обведите, коснитесь или сделайте жест на том, что хотите найти. Если ответ ИИ покажется вам наиболее полезным, в результатах появится AI Overview. Отсюда прокрутите вниз и нажмите “Подробнее с режимом ИИ”, чтобы задать уточняющие вопросы и узнать больше о визуальном поиске», — говорится в сообщении Google в её блоге.  Circle to Search теперь также может предоставлять внутриигровую помощь мобильным геймерам. Эту функцию Google тестировала ещё в январе. Её можно использовать для поиска информации о персонажах и стратегиях, не выходя из игры, а также для просмотра статей и видео, связанных с конкретным игровым моментом, в котором требуется помощь. Google также заявила, что работает над внедрением режима поиска AI Mode в Google Lens через приложение Google для Android- и iOS-устройств.  Новые Galaxy Z Fold7, Galaxy Z Flip7 и Watch 8, представленные сегодня на мероприятии Samsung Unpacked, стали первыми устройствами с предустановленными Android 16 и Wear OS 6. Google также анонсировала обновление Gemini Live для смартфона Flip 7, которое добавляет возможность передачи изображения с камеры устройства на внешний экран. Это позволяет ИИ-помощнику отвечать на вопросы о том, что он «видит», без необходимости открывать телефон. Интеграция Gemini Live теперь поддерживается в таких приложениях Samsung, как «Календарь», «Заметки» и «Напоминания». По словам Google, вскоре поддержка Gemini Live появится и в приложениях других производителей. Кроме того, Gemini будет поддерживаться на смарт-часах под управлением Wear OS 6, устройствах Pixel, OnePlus, Oppo, Xiaomi, а также на новых моделях Samsung — Watch 8, Watch 8 Classic и Watch Ultra (2025). Гендир Google DeepMind рассказал о будущем ИИ и появлении у него самосознания

21.04.2025 [19:27],

Сергей Сурабекянц

Генеральный директор Google DeepMind Демис Хассабис (Demis Hassabis) в течение часа рассказывал журналистам о перспективах Gemini, темпах разработки сильного ИИ (Artificial General Intelligence, AGI) и общем росте самосознания нейросетей. Он уделил много внимания модели Project Astra, которая сейчас находится в стадии предварительного тестирования. Astra узнаёт пользователей и помнит историю общения с ними, — скоро эти возможности появятся в Gemini Live.

Источник изображения: 9to5Google Хассабис отметил, что перспективная модель Project Astra отличается, прежде всего, увеличенным количеством памяти. В частности, она запоминает ключевые детали из предыдущих разговоров для лучшего контекста и персонализации. Также имеется отдельная «10-минутная память» текущего диалога. Эти возможности, предположительно, скоро появятся в Gemini Live. Хассабис подчеркнул, что Google DeepMind «обучает свою модель ИИ под названием Gemini не просто показывать мир, но и совершать действия в нём, такие как бронирование билетов и покупки онлайн». По мнению Хассабиса, реальный срок появления AGI — 5-10 лет, причём это будет «система, которая действительно понимает все вокруг вас очень тонким и глубоким образом и как бы встроена в вашу повседневную жизнь». На вопрос, «работает ли Google DeepMind сегодня над системой, которая будет осознавать себя», Хассабис заявил, что теоретически это возможно, но он не воспринимает какую-либо из сегодняшних систем как осознающую себя. Он полагает, что «каждый должен принимать собственные решения, взаимодействуя с этими чат-ботами». На вопрос, «является ли самосознание вашей целью» (при разработке ИИ), он ответил, что это может произойти неявно: «Эти системы могут обрести некоторое чувство самосознания. Это возможно. Я думаю, что для этих систем важно понимать вас, себя и других. И это, вероятно, начало чего-то вроде самосознания». «Я думаю, есть две причины, по которым мы считаем друг друга сознательными. Одна из них заключается в том, что вы демонстрируете поведение сознательного существа, очень похожее на моё поведение. Но вторая причина в том, что вы работаете на одном и том же субстрате. Мы сделаны из одного и того же углеродного вещества с нашими мягкими мозгами. Очевидно, что машины работают на кремнии. Так что даже если они демонстрируют одинаковое поведение, и даже если они говорят одно и то же, это не обязательно означает, что это ощущение сознания, которое есть у нас, будет тем же самым, что будет у них», — пояснил Хассабис в заключение. Google запустила ИИ-ассистента Gemini Live с возможностью полного контроля над диалогом

13.09.2024 [07:20],

Дмитрий Федоров

Google запустила бесплатный голосовой режим Gemini Live для всех пользователей Android. Эта функция, доступная через приложение Gemini, позволяет вести голосовой диалог с ИИ-ассистентом в реальном времени, прерывать его ответы и выбирать различные голоса.

Источник изображения: Google Gemini App / X Google впервые анонсировала Gemini Live на презентации Pixel 9 в прошлом месяце, но до сих пор эта функция была доступна только подписчикам Gemini Advanced. Как сообщает ресурс 9to5Google, для активации режима достаточно выбрать новую иконку в форме волны в правом нижнем углу интерфейса. Gemini Live предлагает функциональность, схожую с голосовым чатом ChatGPT, но обладает рядом уникальных особенностей. Пользователи могут не только задавать вопросы голосом, но и прерывать ответы ИИ-ассистента в середине фразы, что позволяет вести с ним более естественный и динамичный диалог. Интерфейс предоставляет опции «hold» для приостановки ответа Gemini и «end» для завершения беседы, что даёт пользователю полный контроль над диалогом. Для ещё большей персонализации взаимодействия с ИИ пользователи могут выбрать для ассистента один из понравившихся голосов. На данный момент Gemini Live работает только на английском языке, но Google уже сообщила о планах расширения языковой поддержки и разработки версии для iOS. Google запускает голосовой чат Gemini Live для живых интеллектуальных бесед

13.08.2024 [23:30],

Анжелла Марина

На презентации Pixel 9 компания Google объявила о запуске нового режима голосового чата для Gemini под названием «Gemini Live». Эта функция во многом напоминает функцию голосового чата ChatGPT, предлагая на выбор несколько вариантов голосов и возможность вести разговор в естественной манере, включая прерывание ответов ИИ в любое время.

Источник изображения: Google Как поясняет TheVerge, общение с Gemini Live может происходить в свободной форме, позволяя прерывать ответы на полуслове, приостанавливать разговор не нажимая никаких кнопок и возобновлять его позднее. Функция также работает в фоновом режиме и при заблокированном экране смартфона. Интересно, что о планах запуска Gemini Live компания Google впервые объявила на своей конференции разработчиков I/O ранее в этом году, где также было сказано, что «Live» сможет интерпретировать видео в режиме реального времени. В дополнение к этому, Google представила 10 новых голосов для Gemini, которые пользователи смогут выбрать по своему усмотрению. Функция начала развёртываться сегодня на устройствах Android, пока только на английском языке, но нам обещают, что в ближайшие недели Gemini Live станет доступен на iOS и получит поддержку дополнительных языков.

Источник изображения: Google Помимо Gemini Live, анонсированы и другие функции для ИИ-ассистента, в частности возможность анализировать контекст экрана пользователя, что напоминает функцию ИИ, анонсированную недавно Apple на мероприятии WWDC. После того как пользователь выберет опцию «Ask about this screen» (Спросить о том, что изображено на экране) или «Ask about this video» (Спросить, что показано на видео), Gemini сможет предоставить информацию, включая извлечение деталей, например, пунктов назначения из туристических видео, для добавления в Google Maps. Отметим, что Gemini Live будет доступен пока только для подписчиков Gemini Advanced. |