|

Опрос

|

реклама

Быстрый переход

В США возник дефицит видеокарт GeForce RTX 4080 Super

09.02.2024 [16:29],

Николай Хижняк

В магазинах США наблюдается нехватка видеокарт GeForce RTX 4080 Super, пишет портал VideoCardz. Ускоритель с рекомендованной стоимостью $999, что ниже стартовой цены обычной модели RTX 4080, оказался востребованным среди геймеров. Как пишет источник, в большинстве магазинов карту невозможно заказать онлайн.

Источник изображения: VideoCardz У ряда ретейлеров, включая BestBuy и MicroCenter, ещё остался некоторый запас видеокарт GeForce RTX 4080 Super по рекомендованной цене. В частности, BestBuy реализует эталонную версию RTX 4080 Super Founders Edition от NVIDIA. Однако купить эти карты онлайн невозможно, за ними нужно идти в ближайший физический магазин. Самая же доступная версия RTX 4080 Super, которую всё ещё можно приобрети онлайн, предлагается за $1123. По данным VideoCardz, у ретейлера B&H Photo Video, а также в фирменных магазинах ASUS, MSI и Zotac карты отсутствуют. У Newegg самая доступная RTX 4080 Super предлагается за $1149. Других версий нет в наличии. Ограниченная доступность RTX 4080 Super на момент запуска может быть связана с малыми запасами обычной RTX 4080 в течение последних недель. Напомним, что RTX 4080 Super полностью заменит обычную модель в продаже. Сейчас RTX 4080 Super по рекомендованной цене $999 нет ни у одного крупного американского ретейлера и партнёра NVIDIA. Ситуация на европейских рынках, с другой стороны, выглядит более оптимистичной. Несколько магазинов предлагают RTX 4080 Super по цене €1109. Как пишет VideoCardz, проблем с запасами видеокарт RTX 4070 Super и RTX 4070 Ti Super у продавцов не наблюдается. NASA предлагает осваивать космос примитивными роботами с навыками сборки детских конструкторов

09.02.2024 [15:06],

Геннадий Детинич

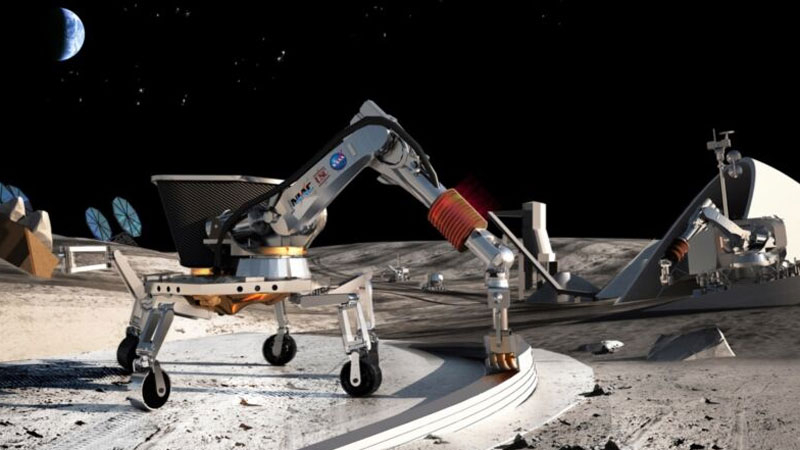

Более глубокое освоение Солнечной системы будет невозможно без массового использования роботов и локальных ресурсов. С Земли много не увезёшь, поэтому почти всё для строительства и поддержания баз придётся искать на месте, включая самовоспроизводство роботов. В NASA работают над этой концепцией и заметно продвинулись в создании автоматов и базовых принципов их деятельности.

Источник изображения: NASA В серии научных работ, первая из которых была опубликована в журнале Science Robotics, группа инженеров NASA рассказала, как три примитивных робота могут строить в автономном режиме защитные и служебные сооружения. Роботы не имеют компьютерного зрения, лидаров и радаров. Они ориентируются исключительно на ощупь, отслеживая количества и конфигурации уложенных в конструкцию базовых блоков. Один робот подвозит блоки на строительную площадку, второй передаёт их строительному автомату, а тот укладывает их друг на друга по заранее составленной программе. Примитивизм в данном случае необходим для того, чтобы вдали от передовых производств роботы могли воспроизводить друг друга. И чем проще они будут, тем надёжнее будет результат. Но это пока впереди. На данном отрезке исследования специалисты NASA разработали конфигурацию базового строительного элемента — что-то подобное кубику из детского конструктора. Армированные усиленным пластиком «кубики» легко соединяются друг с другом (и отсоединяются по необходимости). Такие базовые блоки также можно и нужно будет изготавливать на месте, чтобы не везти всё это за тридевять земель. Базовые блоки в NASA назвали «вокселями». Для проверки концепции было изготовлено 256 блоков. Каждый из них необычайно лёгкий и прочный для своего размера и плотности 0,0103 г/см3. Созданная из блоков ферма в конфигурации 3 × 3 могла выдерживать свыше 90 кг нагрузки. Общий вес 256 блоков составил около 18 кг вместе с тремя рюкзаками, в которые они поместились. Во время похода на природу инженеры построили из этих блоков укрытие, лодку и даже мост для перехода через реку.

Обложка свежего номера Science Robotics Концепцию освоения космоса с использованием политики «нулевой массы» за спиной в своё время предложил всемирно известный американский учёный Джон фон Нейман. В 80-х годах прошлого века его идеи развил американский инженер Роберт А. Фрейтас младший. В его представлении межзвёздный космический корабль должен будет долететь до ближайшей звёздной системы, собрать там необходимые ресурсы и отправиться дальше. Сегодня в NASA и не только разрабатывают необходимые для этого метаматериалы, простым примером которых могут быть базовые строительные блоки. Но у NASA есть и более насущная задача. Как известно, новая высадка на Луну планируется в районе южного полюса спутника. Для организации связи в зоне прямой видимости антенны надо будет поднимать повыше. Также надо будет поднимать солнечные фермы, поскольку полюс плохо освещается солнцем. В идеале высота ферм должна достигать 100 м. На примере разработанных инженерами NASA базовых блоков агентство изучает вопрос наиболее оптимального способа возведения подобных башенных конструкций. Samsung вряд ли начнёт выпускать 4-нм чипы в Техасе до конца года

09.02.2024 [13:14],

Алексей Разин

Распределение средств по принятому в 2022 году в США «Закону о чипах» в основной своей части должно начаться ещё в текущем квартале, но потенциальных получателей субсидий такие сроки не совсем устраивают. Даже Samsung боится не уложиться в первоначальный график строительства в штате Техас нового предприятия по контрактному выпуску чипов.

Источник изображения: Samsung Electronics Как сообщает Business Korea, в ходе регулярного заседания окружного суда в округе Вильямсон, где возводится новое предприятие Samsung Electronics, судья Билл Грейвелл (Bill Gravell) заявил, что связанный с производственной деятельностью персонал должен приступить к работе не позднее 1 июля текущего года. Власти штата Техас имеют право требовать от Samsung соблюдения определённого графика, поскольку предоставляли локальные субсидии независимо от федерального правительства. Представители Samsung Electronics заявили, что выполнению этого требования могут воспрепятствовать различные факторы, и начало работы персонала на новом предприятии в Техасе с 1 июля не может гарантироваться. Как правило, привлечение персонала к подготовке производства чипов на новом предприятии осуществляется за шесть месяцев до фактического старта выпуска продукции. Если Samsung начнёт подготовительные работы позднее 1 июля, то начало выпуска 4-нм продукции может быть задержано до следующего года. Напомним, что TSMC задерживается со строительством своих предприятий в Аризоне отстаёт от первоначального графика минимум на год. По слухам, Intel тоже ждёт выделения субсидий от властей США, прежде чем продвинуться со строительством двух передовых предприятий в штате Огайо общей стоимостью $20 млрд. Пока нет официальных свидетельств наличия подобной задержки в случае с проектом Samsung в Техасе, но некоторая неопределённость сохраняется. На строительство предприятия в Тейлоре, округ Вильямсон, Samsung Electronics собирается потратить $17 млрд. В прошлом году, однако, представители компании заявили, что собираются вложить на протяжении последующих 20 лет $24,5 млрд в развитие комплекса предприятий в Остине, а также $167,6 млрд на развитие предприятий в Тейлоре. В общей сложности за это время южнокорейской компанией на территории штата Техас может быть построено 11 предприятий по выпуску чипов. За кражу секретов Apple инженера приговорили к 120 дням тюрьмы и штрафу в $147 тысяч

09.02.2024 [13:09],

Владимир Мироненко

На этой неделе, наконец, был вынесен приговор бывшему инженеру Apple, арестованному в 2018 году и признавшему себя виновным в краже коммерческой тайны, касающейся проекта Project Titan по созданию электромобиля Apple Car. Он был приговорён к 120 дням тюремного заключения, трём годам испытательного срока и возмещению ущерба в размере $146 984.

Источник изображения: 9to5Mac Уроженец Китая Сяолан Чжан (Xiaolang Zhang) за время работы в Apple участвовал в нескольких проектах, включая разработку и тестирование системных плат, оснащённых чипами для анализа данных с датчиков. В ходе расследования выяснилось, что он похитил в 2018 году множество файлов, касающихся проектов Apple, включая 25-страничный документ с инженерными схемами печатной платы будущего беспилотного автомобиля Apple Car. Чжан пытался вывезти документ в Китай для использования в XMotors, китайском стартапе, разрабатывающем автономные технологии для автомобилей. Сначала Сяолан Чжан отказывался признать себя виновным, но в конечном итоге заключил соглашение о признании вины с властями США в 2022 году. За это правонарушение Чжану грозило до 10 лет тюремного заключения и штраф в размере $250 000. В ходе судебных заседаний федеральная прокуратура Калифорнии требовала приговорить его к одному году лишения свободы. Процессоры с ИИ-движками пропишутся в 60 % новых ПК к 2027 году

09.02.2024 [12:26],

Алексей Разин

Разработчики центральных процессоров и некоторые производители ПК уцепились за идею создания клиентских систем, которые будут локально ускорять некоторые вычисления, связанные с работой искусственного интеллекта. По мнению представителей IDC, к 2027 году подобные процессоры будут находиться в 60 % новых ПК, поставляемых на рынок.

Источник изображения: Lenovo В целом, как поясняют аналитики, по итогам текущего года объёмы поставок ПК на базе центральных процессоров с функцией аппаратного ускорения ИИ достигнут 50 млн штук, а к 2027 году увеличатся до 167 млн штук. Из этого можно сделать вывод, что эксперты IDC не рассчитывают на существенное увеличение оборотов на рынке ПК как таковом к 2027 году, поскольку 167 млн изделий будут составлять 60 % от 278 млн поставленных персональных компьютеров к концу периода прогнозирования. Системы, использующие ресурсы дискретных графических процессоров (GPU) для ускорения работы искусственного интеллекта, в статистику не попали. По мнению представителей IDC, популярности ПК на базе процессоров с такими возможностями будут способствовать не только рост производительности соответствующих операций, но и повышение степени информационной безопасности. Пользователю уже не потребуется отправлять в облако чувствительные данные для ускорения их обработки на сервере провайдера, эти операции можно будет эффективно осуществлять на локальном компьютере. К 2027 году технология превратится из нишевой в доминирующую, как убеждены представители IDC. Специалисты компании уже предлагают классифицировать центральные процессоры по своей вычислительной способности с точки зрения обработки информации в системах искусственного интеллекта. Наделённые нейронным блоком процессоры первого поколения сейчас предлагаются компаниями Qualcomm, Apple, AMD и Intel, они обладают способностью обрабатывать не более 40 триллионов операций в секунду (TOPS). При помощи таких процессоров достигается аппаратное ускорение отдельных функций в составе приложений, использующих системы искусственного интеллекта. В следующем поколении центральных процессоров быстродействие нейронных блоков будет поднято до 40–60 TOPS, и это уже будет способствовать распространению специфических функций работы с ИИ на уровне операционной системы и множества приложений. Скорее всего, поставки подходящих процессоров Intel, AMD и Qualcomm начнут в текущем году. Microsoft при этом предусмотрит поддержку соответствующих функциональных возможностей на уровне Windows 11. Процессоры третьего поколения с производительностью выше 60 TOPS никем из разработчиков пока не анонсированы, и они даже не включаются IDC в текущий вариант прогноза развития рынка до 2027 года, но по мере анонса таких процессоров в ближайшие годы в аналитические материалы будут внесены соответствующие коррективы. К 2027 году процессоры второго поколения будут примерно в два раза превосходить по численности процессоры первого поколения, как считают в IDC. Немалая часть ПК на основе таких процессоров будет продаваться корпоративным заказчикам. В целом, перенос части вычислений из облака на локальный ПК при работе систем искусственного интеллекта выгодно по трём основным причинам. Во-первых, это снижает задержки в обработке информации, неизбежно возникающие при сетевом взаимодействии. Во-вторых, достигается более высокая информационная безопасность. В-третьих, дорогие облачные ресурсы высвобождаются под другие вычислительные задачи. «Хаббл» увидел космическое «жемчужное ожерелье», образованное столкновением галактик

09.02.2024 [11:40],

Геннадий Детинич

Космический телескоп NASA «Хаббл» представил снимок галактики AM 1054-325, названной «жемчужным ожерельем» за свой характерный внешний вид — S-образную последовательность из миллионов ярких голубых звёзд. Это одно из 12 наблюдаемых «Хабблом» слияний пар галактик. В процессе взаимного воздействия в пространстве возникают невообразимые по длине приливные хвосты вещества, в которых одновременно рождаются миллионы звёзд. Изучаемые «Хабблом» слияния пар галактик в прошлом могли происходить намного чаще. Тем самым мы можем у себя под боком изучать процессы, которые в остальной Вселенной давно прошли. Слияния наблюдаемых пар галактик наглядно показывают, что звездообразование практически одновременно вспыхивает по всей длине приливного хвоста — собранного гравитационными силами обеих галактик в изогнутый жгут молекулярного водорода. Если бы столкновения не произошло, то обе галактики продолжили бы свой путь без интенсивного процесса рождения новых звёзд и планет. Слияние привело к сжатию межзвёздного газа и пыли до состояния, когда начали запускаться термоядерные реакции и возникать новые звёзды. В 12 парах сливающихся галактик «Хаббл» смог обнаружить 425 скоплений с примерно по одному миллиону новорожденных звёзд в каждом, настолько интенсивными оказались процессы звездообразования. Судьба новорожденных звёзд в приливных хвостах неизвестна. Молодые звёзды могут собраться в скопления и сопровождать свои галактики дальше в путешествии по Вселенной, а могут рассеяться по гало галактик одиночными объектами, как и покинуть их и стать межгалактическими скитальцами. В сухом остатке следует признать, что «космическое ДТП» в случае столкновения галактик ведёт не к смерти участников процесса, а к интенсивному зарождению множества новых полноценных обитателей этой Вселенной. Япония выделит $300 млн на разработку передовых полупроводников

09.02.2024 [11:12],

Алексей Разин

Основанный в Японии консорциум Rapidus рассчитывает наладить производство 2-нм чипов на территории страны к 2027 году, но для достижения этой цели ему потребуется поддержка профильного исследовательского центра и коллег из американской корпорации IBM. На субсидирование исследовательского центра LSTC власти Японии решили выделить $300 млн сроком на пять лет.

Источник изображения: Nikon Власти Японии, как отмечает Bloomberg, осознают важность фундаментальных исследований в сфере технологий полупроводникового производства и одновременно разделяют опасения частного бизнеса по поводу наличия высокого риска инвестиций в эту сферу. Государство готово частично взять на себя данные риски, предоставляя субсидирование деятельности основанного год назад исследовательского центра. В его задачи входит поиск передовых технологий производства полупроводниковых чипов, а также содействие разработке процессоров, использующих технологии искусственного интеллекта. Субсидии в размере $300 млн, выделяемые центру властями страны, подразумевают и содействие в освоении 2-нм технологии, помимо прочего. Исследовательский центр будет усиливать кооперацию японских вузов в данной сфере, но одновременно привлекать и зарубежных разработчиков технологий. Возглавляет центр председатель совета директоров Rapidus Тэцуро Хигаси (Tetsuro Higashi), который ранее руководил компанией Tokyo Electron, специализирующейся на выпуске литографического оборудования. Министр экономики Японии Кэн Саито (Ken Saito) выразил надежду, что все эти усилия помогут усилить долгосрочную конкурентоспособность японской полупроводниковой промышленности на мировом рынке. Во французском офисе Huawei прошли обыски

09.02.2024 [08:17],

Алексей Разин

Притеснения китайского телекоммуникационного гиганта Huawei в странах Европы, лояльных по отношению к США, не ограничиваются исключением оборудования этой марки из национальных сетей связи. На этой неделе во французском офисе Huawei Technologies прошли обыски по делу о предполагаемых финансовых злоупотреблениях.

Источник изображения: Huawei Technologies Поскольку обвинение пока не сформулировано официально, представители французских властей предпочли пояснить, что Huawei подозревается в широком спектре нарушений местного законодательства, начиная от коррупции и «торговлей влиянием», и заканчивая нецелевым использованием общественных средств. Представительство Huawei во Франции, располагающееся в пригороде Парижа, подтвердило Bloomberg факт проведения обысков в минувший вторник. Компания настроена на сотрудничество со следствием. Свой бизнес во Франции она ведёт более 20 лет, и до сих пор придерживалась принципа неукоснительного соблюдения законов. В этой стране у Huawei имеются исследовательские центры, а недалеко от Страсбурга компания строит своё первое производственное предприятие за пределами Китая. Оно должно открыться к концу следующего года и наладить выпуск телекоммуникационного оборудования для европейского рынка. Предполагается, что предприятие обеспечит работой около 500 человек. Франция не осталась в стороне от процесса вытеснения оборудования Huawei из своих сетей передачи данных. Если в 2019 году выручка компании на местном рынке достигала 1,4 млрд евро, то по итогам 2022 года она сократилась до 992 млн евро. В декабре представители Huawei отметили, что компания продолжает сотрудничество с отдельными операторами связи во Франции в сфере развития их сетей связи пятого поколения (5G). Lenovo работает над ноутбуком с двумя дисплеями, один из которых прозрачный

09.02.2024 [07:55],

Владимир Фетисов

В конце этого месяца в Барселоне состоится ежегодная выставка Mobile World Congress 2024, на которой производители электроники со всего мира представят свои новинки. Одним из постоянных участников мероприятия является Lenovo. В этом году китайская компания покажет несколько устройств, одним из которых, как ожидается, станет необычный ноутбук с двумя дисплеями, один из которых полностью прозрачный.

Источник изображений: windowsreport.com С развитием технологий производства прозрачных OLED-дисплеев производители стали чаще использовать их в своих устройствах. Тем не менее, наличие прозрачного дисплея всё ещё означает, что устройство будет стоить значительно дороже, чем если бы было оснащено обычным экраном. Несмотря на это Lenovo, по всей видимости, готова представить концепт ноутбука с прозрачным экраном.  Судя по опубликованным в интернете рендерам, устройство имеет безрамочный дизайн с полностью прозрачным экраном. Нижняя крышка ноутбука также частично прозрачная, но она не является самостоятельным экраном, выполняя функции сенсорной клавиатуры и тачпада. На одной из боковых граней размещены интерфейсы для подключения внешних устройств.  На данный момент отсутствует какая-либо информация касательно технических характеристик нового ноутбука Lenovo. По всей видимости, устройство работает под управлением Windows 11 и станет продолжением линейки ThinkBook. Планы Lenovo относительно ноутбука с прозрачным экраном остаются загадкой. Вероятно, узнать больше об этом необычном устройстве можно будет в конце месяца в рамках выставки MWC 2024, которая пройдёт с 26 по 29 февраля. Капитализация Arm за день взлетела на 48 % и превысила $116 млрд

09.02.2024 [07:53],

Алексей Разин

Публикация квартального отчёта, данные которого превысили ожидания аналитиков, позволила британскому разработчику процессорных архитектур Arm завершить вчерашнюю торговую сессию в США ростом котировок акций на 48 %. В итоге капитализация компании превысила $116 млрд, и оптимизм инвесторов также помог материнской корпорации SoftBank зафиксировать рост курса акций на 15,29 %.

Источник изображения: Arm Как поясняет CNBC, владеющая более 90 % акций Arm японская корпорация SoftBank номинально нарастила стоимость своих активов только за счёт роста курса первых на $34 млрд, хотя пока она не может их продавать из-за ограничений по условиям состоявшегося осенью IPO. Лишь в марте ограничения будут сняты, и тогда у SoftBank появится возможность заработать на продаже акций Arm. Ровно два года прошло с тех пор, как развалилась сделка NVIDIA по покупке Arm за $40 млрд. Если учесть, что сейчас капитализация последней превышает $116 млрд, можно говорить о выгодном для SoftBank решении выйти с акциями Arm на американскую биржу после неудачи с продажей этих активов NVIDIA. Инвесторы демонстрируют высокий оптимизм в отношении дальнейших перспектив развития бизнеса Arm, поскольку курсовая стоимость акций компании почти в 90 раз превышает ожидаемый удельный доход в пересчёте на одну ценную бумагу. Для NVIDIA этот разрыв гораздо меньше, он не превышает 33 раз, но и акции этой компании за последний год выросли в цене более чем в три раза. Компания AMD на этом фоне может похвастать мультипликатором 46, занимая «золотую середину». Корпорация SoftBank вчера тоже отчиталась лучше ожиданий, и первоначально её акции выросли в цене на 11,06 %, прибавив ещё несколько процентов сегодня с утра. По итогам прошлого квартала SoftBank впервые за четыре квартала получила прибыль в размере $6,36 млрд, превзойдя ожидания аналитиков почти в пять раз. Если в прошлом фискальном году инвестиционный фонд Vision Fund приносил SoftBank одни убытки, то в минувшем квартале он обеспечил прирост стоимости активов на сумму более $4 млрд. Переходники CableMod 12VHPWR нанесли владельцам видеокарт NVIDIA ущерб на $74 тысячи

08.02.2024 [23:15],

Николай Хижняк

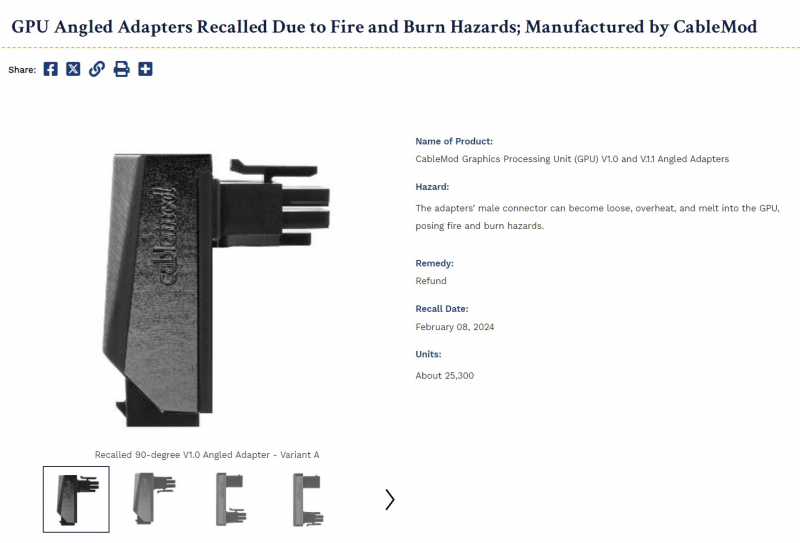

На сайте Комиссии по безопасности потребительских товаров США (CPSC) появилась информация, которая более подробно раскрывает детали отзыва специальных угловых переходников питания 12VHPWR для видеокарт NVIDIA последних поколений, выпускаемых американской компанией CableMod. В частности, ведомство указывает количество отзываемых переходников, а также размер финансового ущерба, который был причинён указанными переходниками владельцам видеокарт NVIDIA.

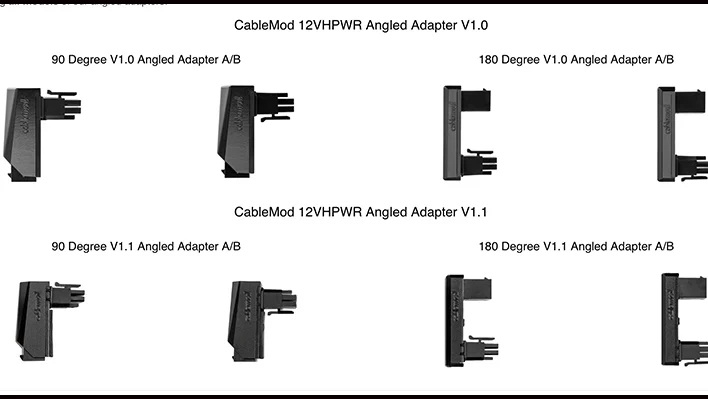

Источник изображений: CableMod Об отзыве своих переходников CableMod сообщила в декабре прошлого года. В частности, под отзыв попали следующие модели угловых адаптеров: CableMod 12VHPWR 90 V1.0, CableMod 180 Angled Adapter V1.0, CableMod 12VHPWR 90 V1.1 и CableMod 180 Angled Adapter V1.1. В то же время компания не стала отзывать из продажи специальные угловые кабели питания. В своём заявлении производитель сообщил, что штекерный разъём может ослабнуть в процессе эксплуатации, что впоследствии может привести к его перегреву и даже потенциальному расплавлению. Под отзыв попали все переходники, выпущенные с февраля по декабрь 2023 года, продажа которых осуществлялась через официальный онлайн-магазин CableMod, а также торговую площадку Amazon.

Виды угловых переходников питания 12VHPWR компании CableMod Как указано на сайте Комиссии по безопасности потребительских товаров США, под отзыв попало более 25 300 реализованных переходников питания. Известно, что CableMod обязалась взять на себя все расходы на возврат владельцами указанных переходников производителю. В качестве альтернативы компания готова предложить депозит в размере $60, которые можно потратить в её официальном онлайн-магазине на другие товары. «Компания получила 272 жалобы, связанные с ослаблением, перегревом и расплавлением разъёма питания видеокарт, с которыми использовались указанные переходники питания. Общая сумма ущерба, причинённого владельцам видеокарт, составила как минимум $74 500. Ни об одном случае получения травм владельцами указанных адаптеров питания неизвестно», — сообщила Комиссия по безопасности потребительских товаров США.

Информация об отзыве переходников питания CableMod на сайте Комиссии по безопасности потребительских товаров США Безопаснее всего использовать родные кабели питания 12VHPWR, которые поставляются с современными моделями блоков питания. Если имеющийся в распоряжении пользователя блок питания не имеет поддержки соответствующего разъёма и кабеля в комплекте, то рекомендуется использовать официальный переходник питания, который поставляется с каждой видеокартой GeForce RTX 40-й серии или в крайнем случае попробовать обратиться к производителю блока питания, чтобы он предоставил нужный переходник. При подключении же коннектора питания к видеокарте необходимо убедиться, что он полностью вставлен и надёжно закреплён в разъёме. В США научились эффективно гнать авиационный керосин из древесных опилок

08.02.2024 [20:18],

Геннадий Детинич

Учёные из Калифорнийского университета в Риверсайде разработали экономически выгодный техпроцесс производства авиационного керосина из отходов деревообрабатывающей промышленности и сельского хозяйства. По себестоимости один литр такого древесного биотоплива почти в два раза дешевле ископаемого, а по воздействию на экологию — почти в два раза чище. Это прорыв, говорят учёные, но к его реализации ещё нужно прийти.

Источник изображения: ИИ-генерация Кандинский 3.0/3DNews В настоящее время в мире используется биотопливо второго поколения, которое производится в основном из грубых отходов сельского хозяйства — из жмыха. Первое поколение, от которого уже многие отказались, производилось из чистых продуктов: кукурузы, сои, сахарного тростника и так далее. Лишать выращенных на сельхозземлях продуктов людей и животных — сомнительное решение. С грубыми отходами главной проблемой была глубокая и эффективная переработка сахаров и лигнина в составе древесины. И чем твёрже породы деревьев, тем больше в них лигнина и тем сложнее его переработка в углеродсодержащее топливо. Команда учёных из США занималась проблемой эффективной переработки лигнина около 10 лет. В конечном итоге они добились впечатляющего успеха. Предложенный ими техпроцесс помог на 18 % увеличить выход биотоплива из кукурузного жмыха и древесины. В частности, с каждой тонны грубых отходов кукурузы в обычном случае получали 167 л топлива. Благодаря новому техпроцессу выход увеличился до 196 л. При использовании древесины тополя выход составил 287 л топлива, что почти в два раза больше, чем при переработке кукурузного жмыха старым способом. Если вывести за скобки логистику и неготовность к массовому производству по новой технологии CELF (co-solvent enhanced lignocellulosic fractionation), то себестоимость нового биотоплива составит $3,15 за галлон (почти 3,8 литра). Для сравнения, средняя цена на авиационный керосин в США сегодня составляет примерно $6,45 за галлон, а средняя цена на авиационный керосин обычного биологического происхождения достигает $9,28. Разница впечатляет! Тем не менее, не всё так просто. В существующих реалиях себестоимость производства перспективного биотоплива из опилок будет существенно выше. Но также сложно спорить с тем, что у него есть явные перспективы, что может ускорить внедрение новых технологий, ведь сегодня отходы древесины просто сжигают, и хорошо, если делают это для обогрева помещений и получения электрической энергии.

Экспериментальная перегонная установка на 20 галлонов (75 л). Источник изображения: UC Riverside В чём же секрет такой эффективной переработки? Учёные подобрали состав для предварительной обработки древесины и жмыха. Они добавляют к отходам воду с раствором тетрагидрофурана (THF) и разбавленную кислоту. Предварительное замачивание опилок и жмыха в этом растворе помогает эффективнее извлекать из сахаров и лигнина углеродную составляющую, которая затем преобразуется в авиационный керосин биологического происхождения. Такое топливо сгорает чуть лучше и с меньшими выбросами в воздух серы и твёрдых частиц. Раз уж нам нужен авиационный керосин, пусть он, хотя бы, будет чище. Работа опубликована здесь. AOC представила 27-дюймовый игровой монитор AGON Gaming Q27G4X с разрешением 1440p и частотой обновления 180 Гц

08.02.2024 [19:56],

Николай Хижняк

Компания AOC пополнила свою серию игровых мониторов G4 Gaming новой 27-дюймовой моделью AGON Gaming Q27G4X. Новинка поддерживает разрешение 2560 × 1440 пикселей и частоту обновления 180 Гц.

Источник изображения: AOC В основе AGON Gaming Q27G4X используется плоская матрица IPS со временем отклика 1 мс GtG (0,5 мс MPRT). Новинка является старшим братом-близнецом ранее выпущенной модели AGON Gaming 27G4X. Ключевым отличием между ними является то, что 27G4X поддерживает разрешение 1080p, а Q27G4X работает с разрешением 1440p. Для AGON Gaming Q27G4X заявлена поддержка технологий синхронизации изображения NVIDIA G-Sync и Adaptive Sync, а также сертификация VESA DisplayHDR 400. Дисплей новинки обладает 8-битной глубиной цвета и пиковым показателем яркости 400 кд/м2. AGON Gaming Q27G4X получил разъёмы DisplayPort 1.4 и HDMI 2.0, а также крепление VESA и эргономичную подставку с регулировкой углов поворота и наклона, а также высоты экрана над столом. В продаже игровой монитор AOC AGON Gaming Q27G4X появится в текущем месяце. Его стоимость составит €290 в странах ЕС. Yandex не сможет конкурировать с «Яндексом» в течение пяти лет

08.02.2024 [19:52],

Сергей Сурабекянц

Нидерландская компания Yandex N.V. после продажи «Яндекса» и реструктуризации лишится права создавать и развивать аналоги сервисов «Яндекса» в течение пяти лет по всему миру. Эта информация получена из официальных документов по реструктуризации бизнеса. Разделение компании запланировано на первое полугодие 2024 года.

Источник изображения: Яндекс Зарубежные стартапы Avride, Toloka, Nebius и TripleTen, которые после разделения бизнеса останутся у Yandex N.V смогут продолжить профильную деятельность во всех странах, кроме России и Беларуси. При этом в подписанных обеими сторонами документах оговаривается, что «независимо от рынка, им запрещено развиваться так, чтобы создавать конкуренцию сервисам "Яндекса". По этому соглашению "Яндекс" сможет развивать свои сервисы без каких‑либо ограничений». Ранее стало известно, что нидерландская компания Yandex N.V. решила продать за 475 млрд рублей свои российские активы консорциуму инвесторов во главе с менеджментом компании, которые после соответствующей реструктуризации российского бизнеса «Яндекса» надеются вывести её акции на Московскую биржу. Новые собственники обещают, что «Яндекс» останется частной и независимой публичной компанией. Генеральным директором «Яндекса» останется Артём Савиновский. Головная структура Yandex N.V до 31 июля сменит название и перестанет использовать торговые марки «Яндекса». Российская структура компании получит наименование «Международная компания акционерное общество Яндекс» (МКАО «Яндекс»). Основную долю акций МКАО «Яндекс» получат топ-менеджеры «Яндекса» и ЗПИФ «Консорциум.Первый». В состав пайщиков закрытого паевого инвестиционного фонда войдут ещё четыре юридических лица: структура Александра Чачава, предпринимателя и основателя венчурного фонда LETA Capital; структура Павла Прасса, генерального директора одного из крупнейших специализированных депозитариев «ИНФИНИТУМ»; структура группы «ЛУКОЙЛ»; структура Александра Рязанова, многопрофильного инвестора и предпринимателя. Никто из пайщиков не получит контролирующей доли, «Консорциум.Первый» при этом сможет номинировать шесть из десяти представителей в состав Совета директоров МКАО «Яндекс». В дальнейшем ЗПИФ планирует предложить держателям акций класса «А» различные опции по их позициям в ценных бумагах, что должно позволить розничным инвесторам стать акционерами МКАО «Яндекс» после выхода компании на Московскую биржу. Группа менеджеров Яндекса через «Фонд менеджеров» сохранит особые права при голосовании на заседаниях совета директоров по ключевым вопросам, а также на общем собрании акционеров. «Фонд менеджер» сможет номинировать двух из десяти членов совета директоров МКАО «Яндекс». Сделку планируется закрыть во второй половине текущего года. Выходец из Tesla поможет GM нарастить производство аккумуляторов

08.02.2024 [18:37],

Сергей Сурабекянц

General Motors наняла эксперта по батареям и бывшего руководителя Tesla Курта Келти (Kurt Kelty) на специально созданную для него новую должность вице-президента автопроизводителя по батареям. Келти приступит к работе 19 февраля. GM в настоящее время прилагает титанические усилия, чтобы увеличить производство аккумуляторных блоков для своей новой платформы Ultium, которая станет базовой для электромобилей следующего поколения.

Источник изображений: GM Келти более десяти лет проработал главой команды аккумуляторов Tesla. Он участвовал в запуске первых четырёх автомобилей Tesla: Roadster, Model S, Model X и Model 3. Он также работал в Panasonic, партнёре Tesla по разработке аккумуляторов на заводе Gigafactory в Неваде. До прихода в GM Курт Келти занимал пост вице-президента по коммерции в Sila Nanotechnologies, компании, основанной одним из первых сотрудников Tesla Джином Бердичевски (Gene Berdichevsky). Sila Nanotechnologies занималась разработкой нового типа аккумуляторного анода на основе кремния, который в перспективе может значительно увеличить плотность энергии литий-ионных батарей.  «Фундамент, созданный GM, в сочетании с исключительным опытом Курта в разработке аккумуляторной химии, установлении партнёрских отношений, построении цепочек поставок и тесном взаимодействии с командами, которые разработали ведущие аккумуляторные системы, помогут нам достичь наших целей в области электрификации и позиционировать GM как лидера в технологии электромобилей», — заявил президент GM Марк Ройсс (Mark Reuss). ASUS ещё раз увеличила гарантию на выгорание OLED-мониторов — теперь до трёх лет, но только для одной модели

08.02.2024 [16:54],

Павел Котов

Недавно ASUS объявила, что до двух лет продлевает гарантию от выгорания экрана для OLED-мониторов серии ROG. Вслед за этим MSI сообщила, что для своей последней линейки OLED-мониторов готова предложить гарантию до трёх лет. У ASUS не оставалось иного выбора, кроме как пойти на аналогичную меру.

Источник изображения: asus.com Важно отметить, что трёхлетнюю гарантию от выгорания дисплея пока что получил только один OLED-монитор из всей линейки ASUS ROG, включающей пять моделей. И непонятно, какие будут решения в отношении четырёх оставшихся. Пока же известно что трёхлетняя гарантия распространяется на модель ASUS ROG PG32UCDM — одну из самых дорогих в линейке производителя. Монитор ещё не поступил в продажу, но на странице предварительного заказа уже значится ценник в €1500. ASUS ROG PG32UCDM — это 32-дюймовый монитор QD-OLED с разрешением 4K и частотой обновления 240 Гц. Он имеет сертификат DisplayHDR 400 True Black и предлагает цветовой охват 99 % пространства DCI-P3. ASUS также работает над двухрежимным вариантом этого монитора с индексом PG32UCDP — он будет поддерживать 240 Гц при 4K и 480 Гц при 1080p. Этот вариант пока не имеет собственной веб-страницы на сайте производителя, поэтому и о гарантии говорить преждевременно. Непостоянство ASUS может показаться забавным, но в действительности это шаг в верном направлении для всех производителей OLED-мониторов. Пожалуй, было бы справедливым распространить эту гарантию и на другие модели. SpaceX запустила спутник NASA PACE для мониторинга атмосферы и изучения океанов

08.02.2024 [15:40],

Владимир Фетисов

Национальное управление по аэронавтике и исследованию космического пространства (NASA) США отправило в космос спутник Plankton, Aerosol, Cloud, ocean Ecosystem (PACE), который предназначен для изучения океана, контроля качества воздуха и наблюдения за последствиями изменения климата. Аппарат вывели на орбиту с помощью ракеты-носителя SpaceX Falcon 9, которая сегодня стартовала с площадки космодрома на мысе Канаверал во Флориде в 01:33 по местному времени (09:33 мск).

Старт ракеты Falcon 9 со спутником PACE на борту / Источник изображения: NASA Примерно через пять минут после запуска спутник был доставлен на расчётную орбиту, и специалисты NASA сумели выйти с ним на связь. «Поздравляю команду PACE с успешным запуском. В дополнения к парку спутников NASA, используемых для наблюдения за Землёй, PACE поможет нам лучше узнать, как частицы в нашей атмосфере и океанах могут определять ключевые факторы, влияющие на глобальное потепление», — сказал глава NASA Билл Нельсон (Bill Nelson). Находясь на высоте около 800 км от поверхности Земли, спутник PACE будет изучать воздействие крошечных, зачастую невидимых глазу, частиц в воде и атмосфере планеты. В конструкции аппарата имеется прибор Ocean Color Instrument, который представляет собой оптический спектрометр для наблюдения за океаном и другими водоёмами. Он поможет учёным следить за распространением фитопланктона и изучить сообщества этих микроорганизмов. PACE также оборудован поляриметром HARP2 и спектрополяриметром SPEXone, которые помогут узнать больше о взаимодействии солнечного света с микрочастицами в атмосфере. Евросоюз заставит производителей давать дополнительный год гарантии на электронику после гарантийного ремонта

08.02.2024 [15:34],

Павел Котов

Европейский совет и Европейский парламент достигли предварительного соглашения в рамках утверждённого ранее законопроекта о праве на ремонт. Среди положений документа значится обязательное предоставление 12-месячной гарантии на отремонтированные по гарантии устройства, причём входящие в ЕС государства могут по своему усмотрению увеличивать этот срок. Сегодня Европа требует двухлетней гарантии на продукцию.

Источник изображения: NoName_13 / pixabay.com Новый закон может стать для европейских потребителей стимулом сдавать вышедшие из строя до окончания гарантийного срока устройства в ремонт и быть уверенными, что в течение дополнительного года данный вопрос не станет подниматься вновь. Но это не единственное примечательное положение в законопроекте. Документ, в частности, обязывает производителей предоставлять на своих сайтах подробную информацию о запасных частях и обеспечивать их доступность по «разумной» цене. ЕС запретит производителям препятствовать установке независимыми ремонтными мастерскими бывших в употреблении компонентов или напечатанных на 3D-принтере запчастей — наиболее проблемной в этом аспекте традиционной считается Apple. Производителей обяжут осуществлять ремонт в разумные сроки и за разумную цену, если он не бесплатный — при этом если продукт оказывается неисправным до истечения гарантийного срока, у потребителя остаётся выбор между ремонтом и заменой. Услуги диагностики останутся платными. Наконец, в ЕС запустят онлайн-платформу, посвящённую вопросам ремонта, где будут перечислены различные службы ремонта — как по ЕС в целом, так и в каждом государстве Европы. Все эти меры направлены на то, чтобы облегчить получение услуг по ремонту в Европе. Если большинство стран мира примет аналогичные законы, производители масштаба Apple в условиях юридического давления будут вынуждены отказаться от текущей политики. Российские учёные обнаружили перспективные химические соединения для аккумуляторов будущего

08.02.2024 [15:28],

Геннадий Детинич

Группа химиков нашла новый класс материалов, который поможет ускорить разработку мультивалентных металл-ионных аккумуляторов. В отличие от литий-ионных аккумуляторов, новые накопители энергии будут безопаснее в эксплуатации и значительно дешевле. Вместо дефицитного лития в них будут использоваться соединения магния, цинка и даже алюминия.

Руководитель проекта Кабанов Артем. Источник изображения: Зарина Беркимбаева, СамГТУ. Проектом руководил Артём Кабанов, кандидат физико-математических наук, старший научный сотрудник Международного научно-исследовательского центра по теоретическому материаловедению (МНИЦТМ) СамГТУ. Помимо исследователей из Самарского государственного технического университета поиском занимались учёные из Физического института им. П. Н. Лебедева РАН (Москва), Самарского государственного медицинского университета (Самара) и Фрайбергской горной академии (Германия). Работа опубликована в журнале Physical Chemistry Chemical Physics. Использование в качестве альтернативы литию магний-, цинк- или алюминий-ионных соединений серьёзно снизило бы удельную стоимости хранения энергии. Это подтолкнуло бы в развитии, как электротранспорт, так и область возобновляемой энергетики. Но пока разработка металл-ионных аккумуляторов сдерживается отсутствием ключевых элементов таких батарей — электродов и электролитов с высокой ионной проводимостью. Именно такие перспективные соединения искала группа Кабанова. Учёные из СамГТУ вместе с коллегами проанализировали свыше 1,5 тысячи химических соединений. Исследуемые материалы были пропущены через систему теоретических фильтров по принципу «от простого к сложному». «Для каждого соединения химики рассчитали характеристики свободного кристаллического пространства, энергию активации диффузии ионов, коэффициент диффузии и проводимость. В итоге они отобрали 16 соединений, которые могут быть эффективными ионными проводниками», — сказано в пресс-релизе СамГТУ. Среди отобранных соединений был выявлен новый класс кристаллических материалов, которые обладают особенно высокой катионной проводимостью. Эти вещества относятся к структурному классу La3CuSiS7, и их ионная проводимость в 10–100 раз выше аналогов. «Результаты нашей работы помогут ускорить разработку аккумуляторов нового поколения. С помощью теоретических методов мы смогли найти новые перспективные материалы. Наша следующая цель — синтезировать и экспериментально подтвердить характеристики найденных веществ, после чего можно будет собрать прототип аккумулятора», — говорят исследователи. Xiaomi выпустила дешёвый игровой монитор Redmi G Pro с подсветкой Mini-LED

08.02.2024 [15:16],

Николай Хижняк

Компания Xiaomi представила продвинутый, но при этом весьма доступный для своих характеристик 27-дюймовый игровой монитор Redmi G Pro (Xiaomi P27OBA-RGP). Новинка обладает подсветкой Mini-LED и поддерживает интерфейс DisplayPort 2.1.

Источник изображения: Xiaomi Redmi G Pro поддерживает разрешение 2560 × 1440 пикселей и обладает 1152 зонами локального затемнения, а подсветка насчитывает 4608 светодиодов. Он поддерживает четыре температурных режима отображения. Яркость экрана Redmi G Pro составляет 1000 кд/м2. Он имеет сертификацию DisplayHDR 1000. Производитель также отмечает наличие у новинки сертификации TÜV Rheinland, указывающую на наличие защиты от вредного синего излучения. Дисплей монитора Redmi G Pro обладает 100-процентным охватом цветового пространства sRGB, 99-процентным охватом DCI-P3 и 97-процентным охватом цветовой гаммы Adobe RGB. Для экрана заявляется возможность передачи 10-битной глубины цвета и точность цветопередачи на уровне Delta E <2. В набор внешних разъёмов монитора входят два DisplayPort 2.1, а также два HDMI 2.0. Кроме того, новинка оснащена эргономичной подставкой с возможностью регулирования высоты экрана над столом, а также его углов поворота и наклона. При желании дисплей монитора Redmi G Pro можно повернуть в портретный режим. Монитор Redmi G Pro уже предлагается в Китае по цене 2199 юаней или примерно за $310. Это весьма привлекательная цена. Большинство игровых моделей мониторов с подсветкой Mini-LED от других производителей предлагаются значительно дороже. Apple увернулась от иска о чрезмерно высокой оплате труда Тима Кука и других топ-менеджеров

08.02.2024 [14:13],

Алексей Разин

Публичные компании нередко сталкиваются с тем, что акционеры выражают недовольство величиной компенсационного пакета, назначаемого руководству, иногда такие претензии доходят до суда. В случае с Apple активисты оспаривали справедливость выплаты генеральному директору Тиму Куку (Tim Cook) по $99 млн на протяжении 2021 и 2022 годов. Суд отверг эти претензии и оставил компенсацию в силе.

Источник изображения: Apple Как поясняет Reuters, в роли истца выступал пенсионный фонд, связанный с International Brotherhood of Teamsters. Он оспаривал правильность расчёта компенсационного пакета Тим Кука и ещё четырёх руководителей Apple высшего звена по итогам 2021 и 2022 годов, ссылаясь на готовность комитета по компенсациям в составе совета директоров Apple одобрить по $77,5 млн выплат Тиму Куку в течение каждого из двух периодов. Справедливая стоимость акций, которые и формируют основную часть такого компенсационного пакета, по мнению истца, была рассчитана неправильно, и компания якобы «переплатила» Куку и ещё четырём руководителям компании в указанные периоды. В форме акций генеральный директор Apple и четыре других руководителя получили $92,7 млн по итогам 2021 года и $94 млн по итогам 2022 года. Непосредственно Куку в форме акций досталось по $82 млн за каждый год из спорного периода. Четыре других руководителя за три предыдущих года получили более чем по $26 млн каждый в ежегодном измерении. Судья Федерального окружного суда Южного округа Нью-Йорка Дженнифер Рошон (Jennifer Rochon) постановила, что в расчётах Apple не было никаких ошибок, и они были произведены в строгом соответствии с американскими законами и рекомендациями Комиссии по ценным бумагам и биржам США. Не было найдено и нарушений в процедуре назначения компенсационного пакета, а истцу было указано на излишнюю поспешность в направлении судебной претензии, поскольку совет директоров мог бы рассчитывать на некоторую отсрочку для предоставления официального досудебного ответа. В 2023 году Тим Кук получил в качестве компенсации за свой труд лишь $63,2 млн, и величину этой выплаты истец в ходе данного спора не призывал пересмотреть. Производство компьютеров в России выросло более чем на 20 % в 2023 году, подсчитал Росстат

08.02.2024 [13:55],

Владимир Фетисов

По сообщениям сетевых источников, производство компьютеров, электронных и оптических изделий в России в 2023 году выросло на 32,8 % по сравнению с 2022 годом. Об этом пишет «Интерфакс» со ссылкой на данные Росстата.

Источник изображения: jarmoluk / Pixabay В сообщении сказано, что в декабре 2023 года производство продукции этой категории увеличилось на 24 % по сравнению с аналогичным периодом 2022 года. Прирост производства в сравнении с показателем ноября составил 31,8 %. Также отмечается, что цены на продукцию производителей компьютеров, электронных и оптических изделий в минувшем году увеличились на 5 % по сравнению с показателем 2022 года. В декабре продукция упомянутой категории подорожала на 7,6 % по сравнению с аналогичным периодом 2022 года и на 2 % по сравнению с предыдущим месяцем. Южнокорейская прокуратура обжалует оправдание главы Samsung

08.02.2024 [13:52],

Алексей Разин

Казалось бы, вынесенный на этой неделе оправдательный приговор главе Samsung Electronics Ли Чжэ Ёну (Lee Jae-yong) открывал перед внуком основателя компании перспективы более активного участия в управлении ею. Но сегодня мировые информационные агентства сообщили о намерениях корейской прокуратуры обжаловать данное решение окружного суда Сеула в высшей инстанции.

Источник изображения: Samsung Electronics Таким образом, рассмотрение дела о манипуляциях с ценными бумагами и подлогом финансовой отчётности в 2015 году, которые и позволили Ли Чжэ Ёну усилить фактическое влияние в компании ещё при жизни своего отца, будет продолжено в суде более высокой инстанции. Какое решение он в итоге вынесет, остаётся только догадываться. В ноябре прокуратура настаивала на лишении обвиняемого свободы на срок до пяти лет и присуждении ему штрафа в сумме $376 000. Злоключения тогда ещё вице-президента Samsung Electronics Ли Чжэ Ёна начались в 2017 году, когда его обвинили в коррупционных действиях, связанных с выборами президента Южной Кореи. Ли Чжэ Ёну пришлось отбыть в заключении около одного года вместо куда более длительных сроков, запрашиваемых обвинением. Летом 2021 года он вышел на свободу в результате президентского помилования, но в ноябре прошлого года ему пришлось отвечать по новому обвинению в деле о махинациях с ценными бумагами 2015 года. Оправдательный приговор Центрального окружного суда Сеула, который вступил в силу на этой неделе, уже обжалуется стороной обвинения, теперь дело будут рассматривать судебные инстанции более высокого уровня. Apple MacBook и хромбуки оказались наименее ремонтопригодными ноутбуками

08.02.2024 [13:18],

Павел Котов

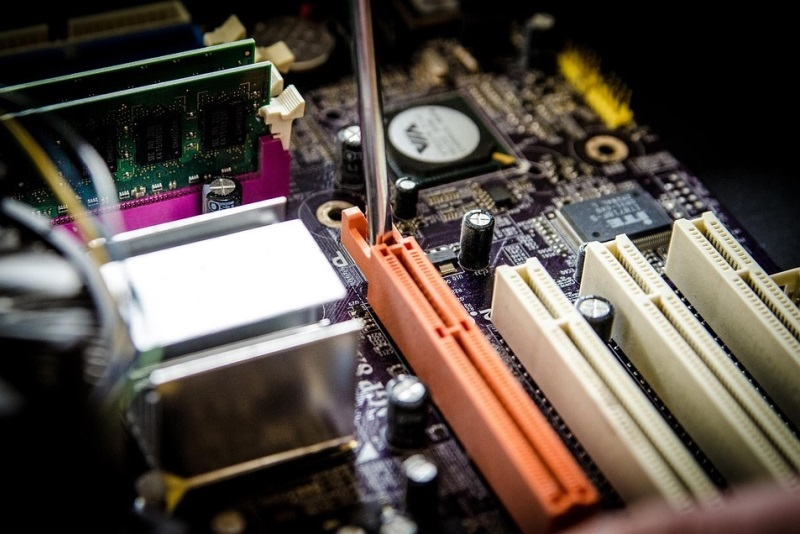

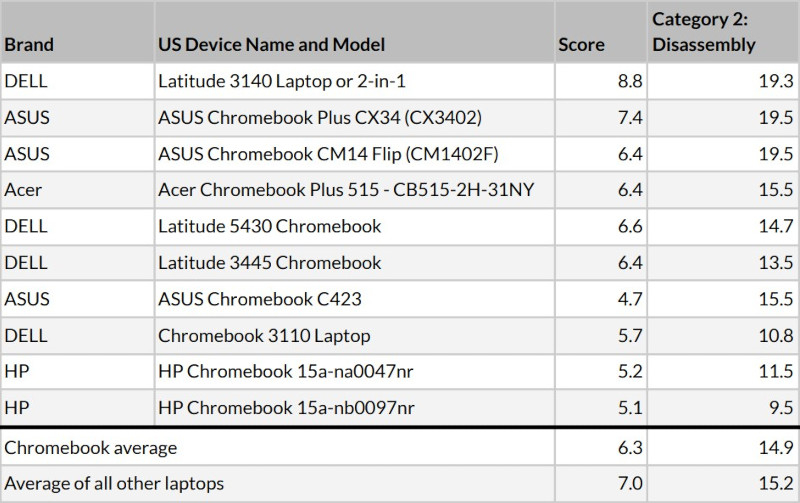

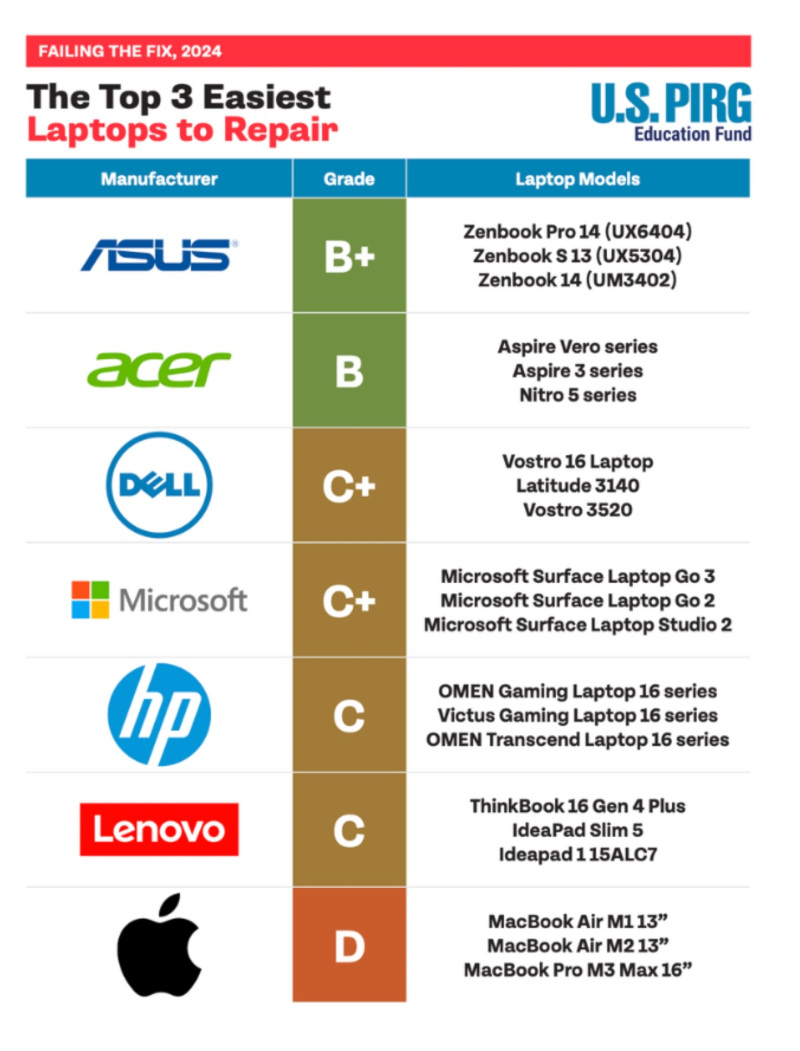

Хромбуки и MacBook являются наименее ремонтопригодными ноутбуками, гласят результаты анализа, проведённого отделом по защите прав потребителей при американской организации Public Interest Research Group (PIRG). Apple и Google уже не впервые подвергаются критике за продажу устройств, которые сложнее ремонтировать, чем другие.

Источник изображения: google.com/chromebook Доклад Failing the Fix (2024) во многом основан на показателях индекса ремонтопригодности, который присваивается ноутбукам и другой электронике, продаваемой во Франции. Но эксперты PIRG отметили и другие аспекты, в том числе наличие доступность запчастей; учитывались наличие документации по ремонту, выпуск обновлений ПО и возможность сброса прошивки к заводским настройкам; а также участие производителя в организациях, которые противостоят введению законов о праве потребителей на самостоятельный ремонт техники.

Источник изображения: PIRG Всего PIRG изучила 139 моделей ноутбуков и пришла к выводу, что хромбуки хотя и остаются более доступными по цене, чем другие устройства, но по-прежнему меньше поддаются ремонту, в сравнении с другими ноутбуками. Так, индекс разборки хромбуков составил 14,9 против 15,2 для других моделей. В докладе приводятся десять хромбуков производства Acer, ASUS, Dell и HP — для них средний рейтинг ремонтопригодности составил 6,3, тогда как для других моделей он был 7,0. Недавно Google увеличила сроки поддержки хромбуков с восьми до десяти лет, но в PIRG этот аспект, во-первых, не учли, а, во-вторых отметили, что если производителю и становится экономически невыгодно поддерживать устаревшие устройства, ему следует дать сообществу возможность делать это своими силами или упростить установку альтернативных ОС, чтобы потребителям не приходилось выбрасывать исправные устройства.

Источник изображения: PIRG Наименьшую оценку ремонтопригодности авторы исследования присвоили продукции Apple: семейство MacBook получило оценку «D», оказавшись позади продукции ASUS, Acer, Dell, Microsoft, HP и Lenovo. Apple получила самый низкий балл разборки среди других производителей — 4 из 10 против среднего показателя в 7,3. Компания не первый год подвергается критике за то, что она считает приоритетом дизайн, которому приносятся в жертву простота ремонта и технические потребности. Традиционно выступавшая противником права на ремонт Apple с принятием соответствующего закона в Калифорнии теперь активно его поддерживает — у неё даже есть программа самостоятельного ремонта. По сравнению с прошлым годом Apple улучшила свои показатели по разборке и наличию документации по ремонту, но этого оказалось недостаточно, чтобы противостоять другим производителям. PIRG рассматривала различные модели у каждого производителя компьютеров: это, например, были 8 ноутбуков Apple и 48 ноутбуков Dell — в рейтинг вошли модели, которым уже был присвоен французский индекс ремонтопригодности, и продающиеся в США. Эксперты обнаружили, что изученные в этом году модели разбирать было труднее, чем год назад — средний балл по разборке упал с 7,5 до 7,3. Это, вероятно, указывает, что «производители не справляются с разработкой ноутбуков, которые проще разбирать и ремонтировать». Но с появлением таких новаторов как Framework, которые активно расширяют границы долговечности продукции, у производителей хромбуков и MacBook появился стимул к повышению её ремонтопригодности. Беспилотные баржи SpaceX превратят в морские интернет-станции Starlink для улучшения покрытия в море

08.02.2024 [12:59],

Геннадий Детинич

Компания SpaceX подала заявку в Федеральную комиссию по связи (FCC) на получение разрешения для тестирования беспилотных барж в море в качестве морских интернет-станций. На баржи планируют установить 12 обычных наземных комплексов Starlink для проверки работы системы в морских условиях. Как эти комплексы будут соединяться с наземной сетью, не уточняется. Возможно, у всего этого другие задачи и не обязательно гражданские.

Источник изображения: SpaceX Спутниковый интернет Starlink устроен таким образом, что его пользователи (терминалы) подключаются к интернету через сеть наземных станций Starlink, соединённых с глобальной сетью посредством оптических линий. Спутники Starlink на орбите выступают ретрансляторами, которые передают данные от терминалов пользователей к наземным станциям Starlink. Если терминал и наземная станция вне досягаемости для одного спутника, то в космосе начинается ретрансляция по лазерному лучу от одного спутника к другому, пока терминал и наземная станция не соединятся потоком данных. На этом же принципе строится морское покрытие Starlink. Компания с июля 2022 года предоставляет пакет услуг Starlink Maritime стоимостью $5 тыс. в месяц. Если беспилотные баржи SpaceX, которые создавались для подхватывания в океане возвращаемых ступеней ракет компании, превратят в «шлюзы» для спутниковой сети, то, возможно, услуга Starlink на море станет дешевле. Пока о проекте ничего не известно. Разрешение на проведение тестирования наземного комплекса на море тоже пока не выдано. С учётом растущей напряжённости в Азиатско-Тихоокеанском регионе нельзя исключать, что морские станции могут рассматриваться как способ обеспечения интернет-связью корабельных группировок. |